RuoYi-AI 本地运行全流程指南

RuoYi-AI 本地运行全流程指南

本文将详细介绍如何在本地环境部署和运行 RuoYi-AI 项目,实现基于大模型的智能问答和 RAG 知识库功能。

技术栈概览

| 类别 | 组件 |

|---|---|

| 数据库 | MySQL、Redis |

| 大模型平台 | Ollama |

| 问答模型 | qwen2:0.5b |

| 向量模型 | embeddinggemma:300m |

| 向量数据库 | Milvus(Docker 部署) |

| 可视化工具 | Attu |

| 容器化 | Docker、Docker Compose、MinIO、Etcd |

| 开发环境 | Node.js、Maven、NPM、Git、PNPM、JDK21 |

第一步:克隆项目

git clone https://gitee.com/ageerle/ruoyi-ai

第二步:配置后端项目

2.1 初始化数据库

找到项目中的 SQL 脚本文件 script/sql/ruoyi-ai.sql,连接本地 MySQL 数据库并执行该脚本完成数据初始化。

2.2 修改数据库连接配置

编辑配置文件 ruoyi-admin/src/main/resources/application-dev.yml,修改数据库连接信息:

strict: true

datasource:

master:

type: ${spring.datasource.type}

driverClassName: com.mysql.cj.jdbc.Driver

url: jdbc:mysql://127.0.0.1:3306/ruoyi-ai?useUnicode=true&characterEncoding=utf8

username: root

password: 123456

同时修改 Redis 连接配置(同一文件中)。

第三步:安装 Ollama

系统要求

在开始安装前,请确认你的电脑满足以下基本要求:

- 操作系统:Windows 10/11 64位(建议 21H2 及以上版本)

- 内存:最低 8GB,推荐 16GB 或以上(运行 7B 参数模型建议 32GB)

- 存储空间:至少 10GB 可用空间,推荐 40GB 以上用于存放多个模型

- 显卡(可选但强烈推荐):支持 CUDA 的 NVIDIA 显卡可大幅提升运行速度

- 依赖项:如安装后无法正常运行,可能需要安装 Visual C++ Redistributable

安装步骤

-

下载安装包

访问 Ollama 官网 https://ollama.com/,点击 “Download for Windows” 下载安装程序。

-

运行安装

双击下载的

OllamaSetup.exe文件,按照向导提示完成安装。默认安装路径为C:\Program Files\Ollama。如需自定义安装路径,可使用管理员权限打开 PowerShell,运行:

.\OllamaSetup.exe /DIR="E:\Ollama" -

验证安装

打开命令提示符或 PowerShell,输入:

ollama --version显示版本号(如

ollama version 0.1.xx)即表示安装成功。

第四步:安装推理模型(问答模型)

使用 Ollama 安装 qwen2:0.5b 问答模型:

ollama pull qwen2:0.5b

安装完成后,可使用以下命令查看已安装的模型:

ollama list

输出示例:

NAME ID SIZE MODIFIED

qwen2:0.5b 6f48b936a09f 352 MB 4 months ago

第五步:安装向量模型

使用 Ollama 安装 embeddinggemma:300m 向量模型:

ollama pull embeddinggemma:300m

安装完成后验证:

ollama list

输出示例:

NAME ID SIZE MODIFIED

embeddinggemma:300m 85462619ee72 621 MB 24 hours ago

qwen2:0.5b 6f48b936a09f 352 MB 4 months ago

第六步:部署向量数据库(Milvus)

6.1 编写 Docker Compose 配置

⚠️ 注意:Attu 和 Milvus 的版本必须兼容

创建 docker-compose.yml 文件:

version: '3.5'

services:

etcd:

container_name: milvus-etcd

image: quay.io/coreos/etcd:v3.5.5

environment:

- ETCD_AUTO_COMPACTION_MODE=revision

- ETCD_AUTO_COMPACTION_RETENTION=1000

- ETCD_QUOTA_BACKEND_BYTES=4294967296

- ETCD_SNAPSHOT_COUNT=50000

volumes:

- ${DOCKER_VOLUME_DIRECTORY:-.}/volumes/etcd:/etcd

command: etcd -advertise-client-urls=http://127.0.0.1:2379 -listen-client-urls http://0.0.0.0:2379 --data-dir /etcd

minio:

container_name: milvus-minio

image: minio/minio:RELEASE.2023-03-20T20-16-18Z

environment:

MINIO_ACCESS_KEY: minioadmin

MINIO_SECRET_KEY: minioadmin

volumes:

- ${DOCKER_VOLUME_DIRECTORY:-.}/volumes/minio:/minio_data

command: minio server /minio_data

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:9000/minio/health/live"]

interval: 30s

timeout: 20s

retries: 3

standalone:

container_name: milvus-standalone

image: milvusdb/milvus:v2.5.12

command: ["milvus", "run", "standalone"]

environment:

ETCD_ENDPOINTS: etcd:2379

MINIO_ADDRESS: minio:9000

volumes:

- ${DOCKER_VOLUME_DIRECTORY:-.}/volumes/milvus:/var/lib/milvus

ports:

- "19530:19530"

- "9091:9091"

depends_on:

- "etcd"

- "minio"

attu:

container_name: milvus-attu

image: zilliz/attu:v2.5.6

environment:

MILVUS_URL: standalone:19530

ports:

- "8000:3000"

depends_on:

- "standalone"

networks:

default:

name: milvus

6.2 启动服务

docker compose up -d

6.3 验证服务状态

docker ps

第七步:配置向量数据库和模型

编辑配置文件 ruoyi-admin/src/main/resources/application.yml,添加大模型和向量库配置:

spring:

ai:

openai:

api-key: localOllama

base-url: http://localhost:11434

embedding:

api-key: localOllama

base-url: http://localhost:11434

options:

model: embeddinggemma:300m

chat:

api-key: localOllama

base-url: http://localhost:11434

options:

model: qwen2:0.5b

temperature: 0.5

vector-store:

type: milvus

weaviate:

protocol: http

host: 127.0.0.1:6038

classname: LocalKnowledge

milvus:

url: http://127.0.0.1:19530

collectionname: LocalKnowledge

第八步:安装前端项目

管理端

git clone https://gitee.com/ageerle/ruoyi-admin

cd ruoyi-admin

pnpm install

pnpm run dev:antd

配置修改:

- 后台接口配置:

/apps/web-antd/vite.config.mts - 其他配置:

/apps/web-antd/.env.development

用户端

git clone https://gitee.com/ageerle/ruoyi-web

cd ruoyi-web

pnpm install

pnpm run dev

第九步:启动项目

- 启动后端:运行 SpringBoot 主类

org.ruoyi.RuoYiAIApplication - 启动前端:确保依赖安装完成后启动前端项目

第十步:访问系统

| 服务 | 地址 |

|---|---|

| Attu 向量数据库可视化 | http://127.0.0.1:8000/ |

| 管理端 | http://localhost:5666/ |

| 用户端 | http://localhost:1002/ |

界面预览

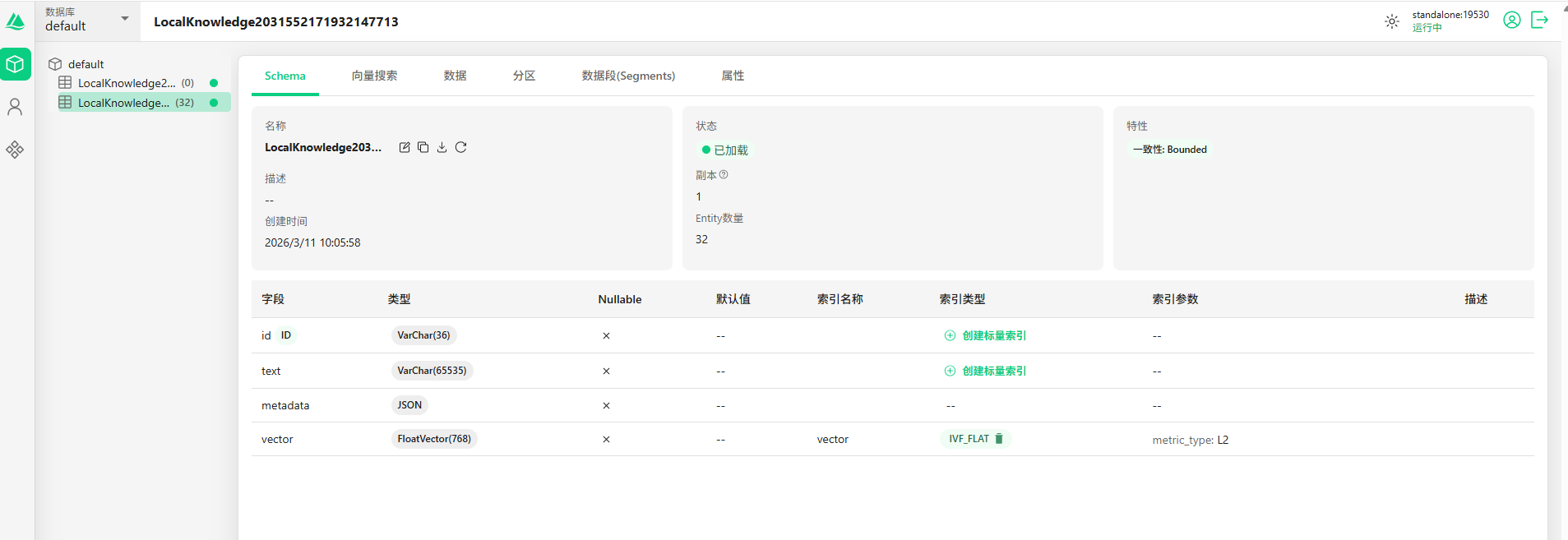

Attu 向量数据库可视化面板:

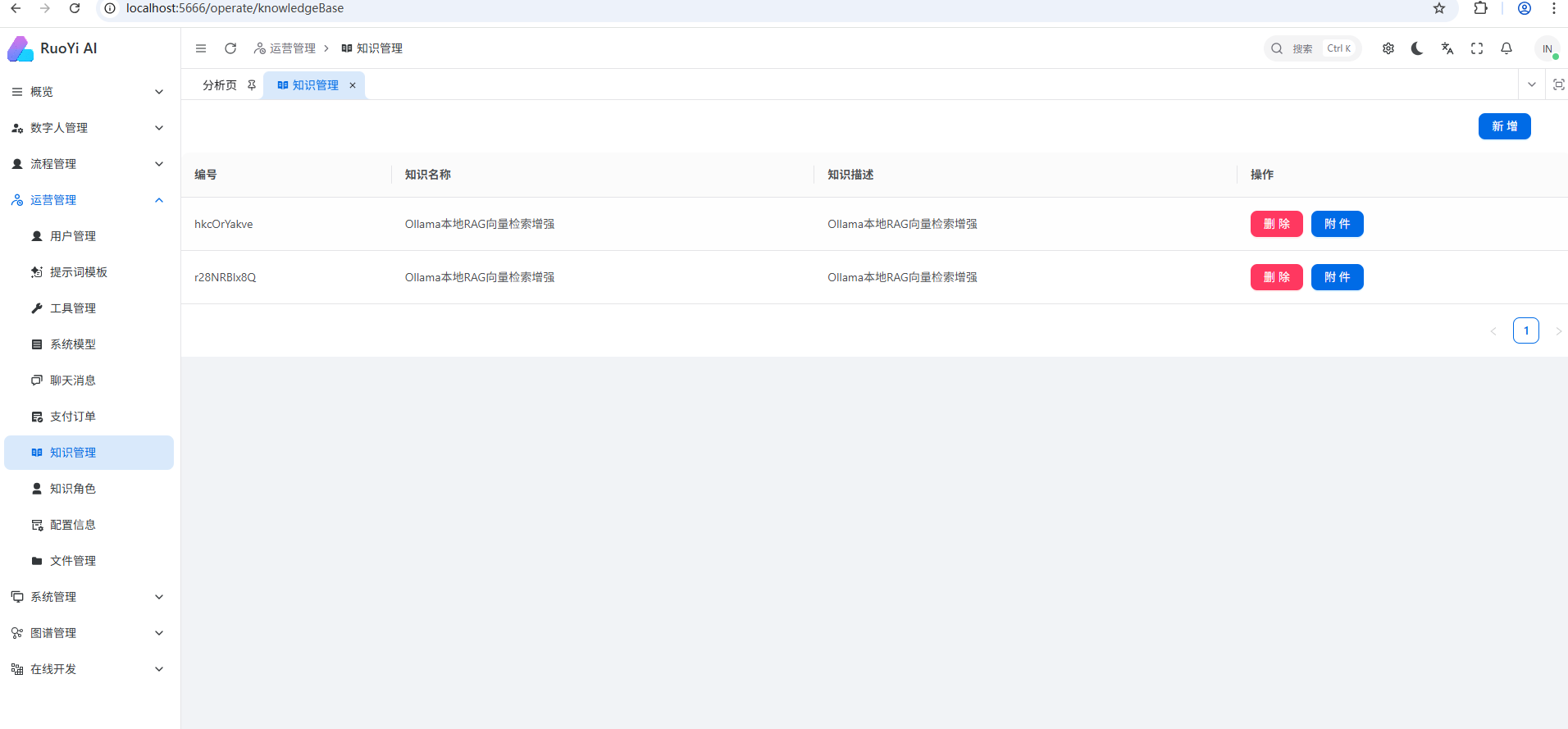

管理端界面:

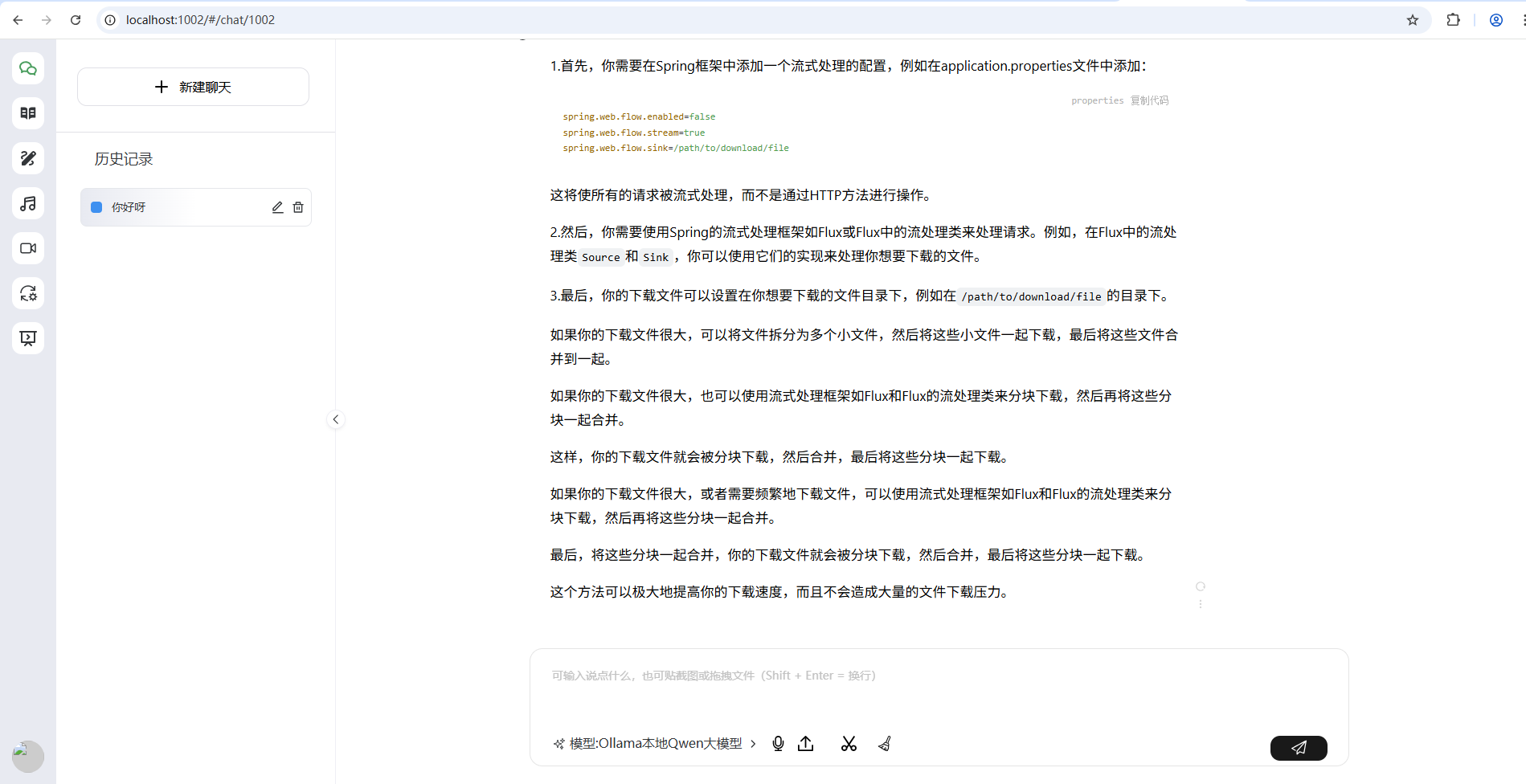

用户端界面:

第十一步:测试问答模型

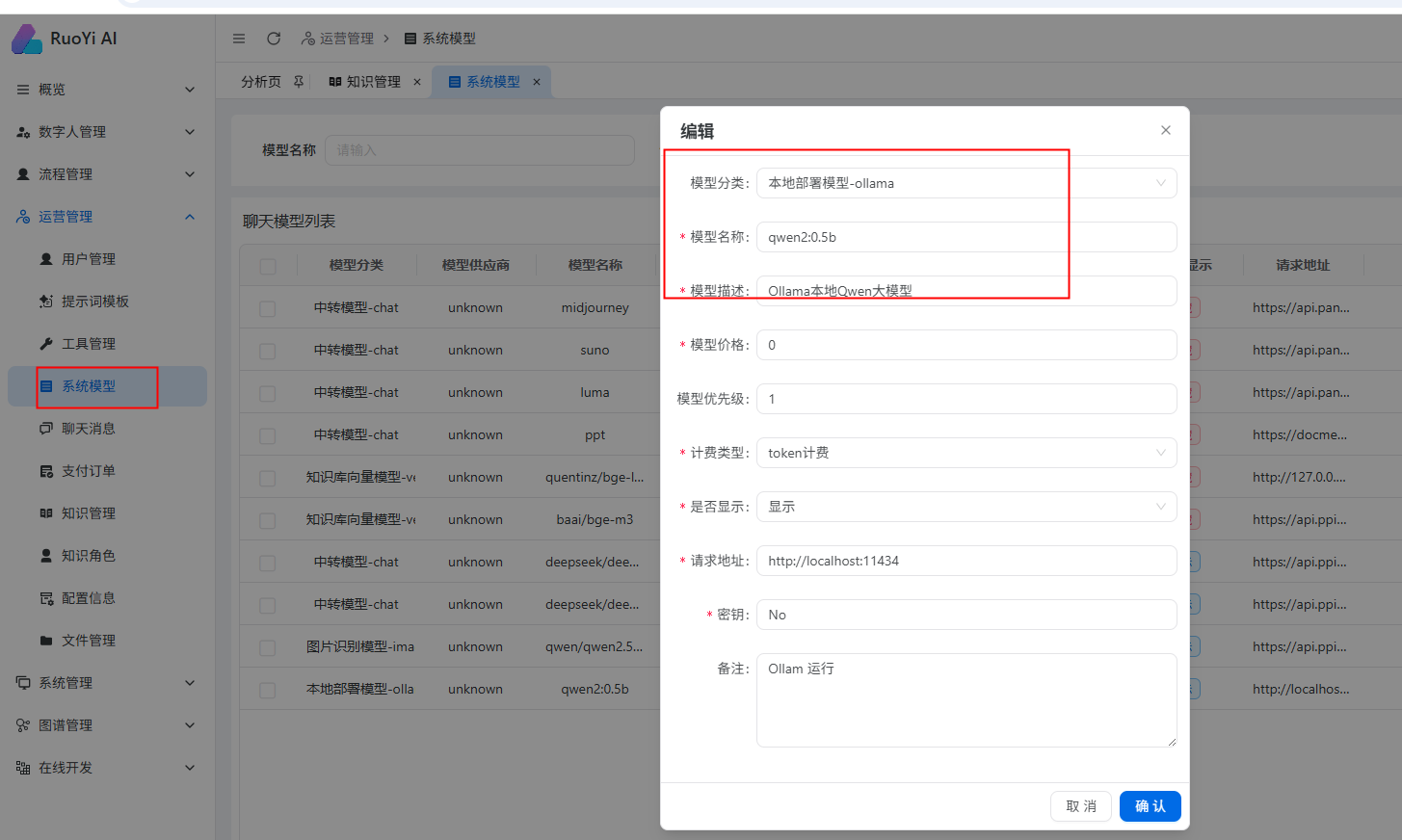

11.1 管理端添加模型

在管理端添加 Ollama 的问答推理模型:

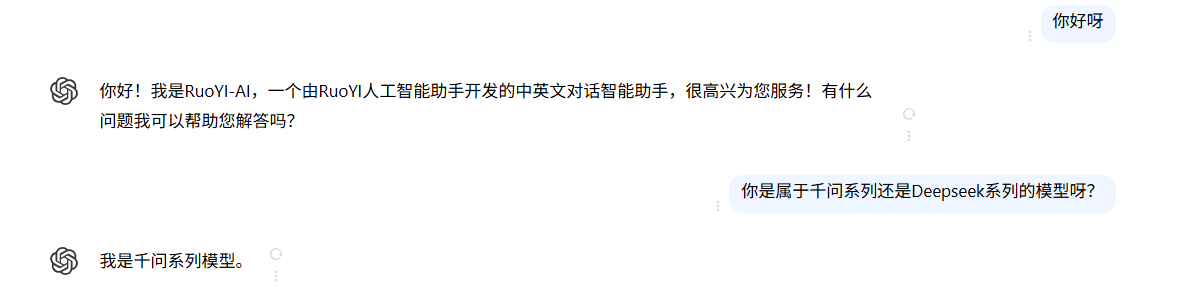

11.2 用户端测试

在用户端选择已添加的模型进行问答测试:

第十二步:配置 RAG 知识库

12.1 配置向量模型

在管理端配置向量模型:

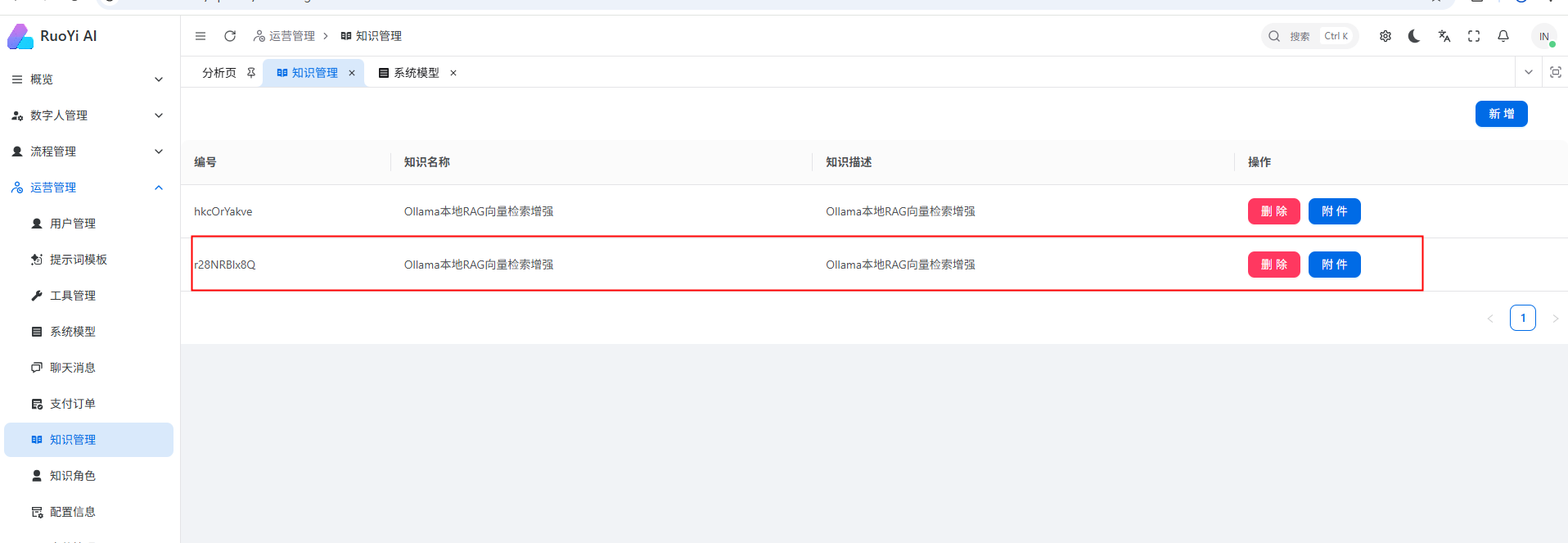

12.2 创建知识库

建立本地知识库:

12.3 上传文档

为知识库上传本地文件进行 RAG 向量化处理:

12.4 等待向量化完成

文档处理完成后会生成知识片段:

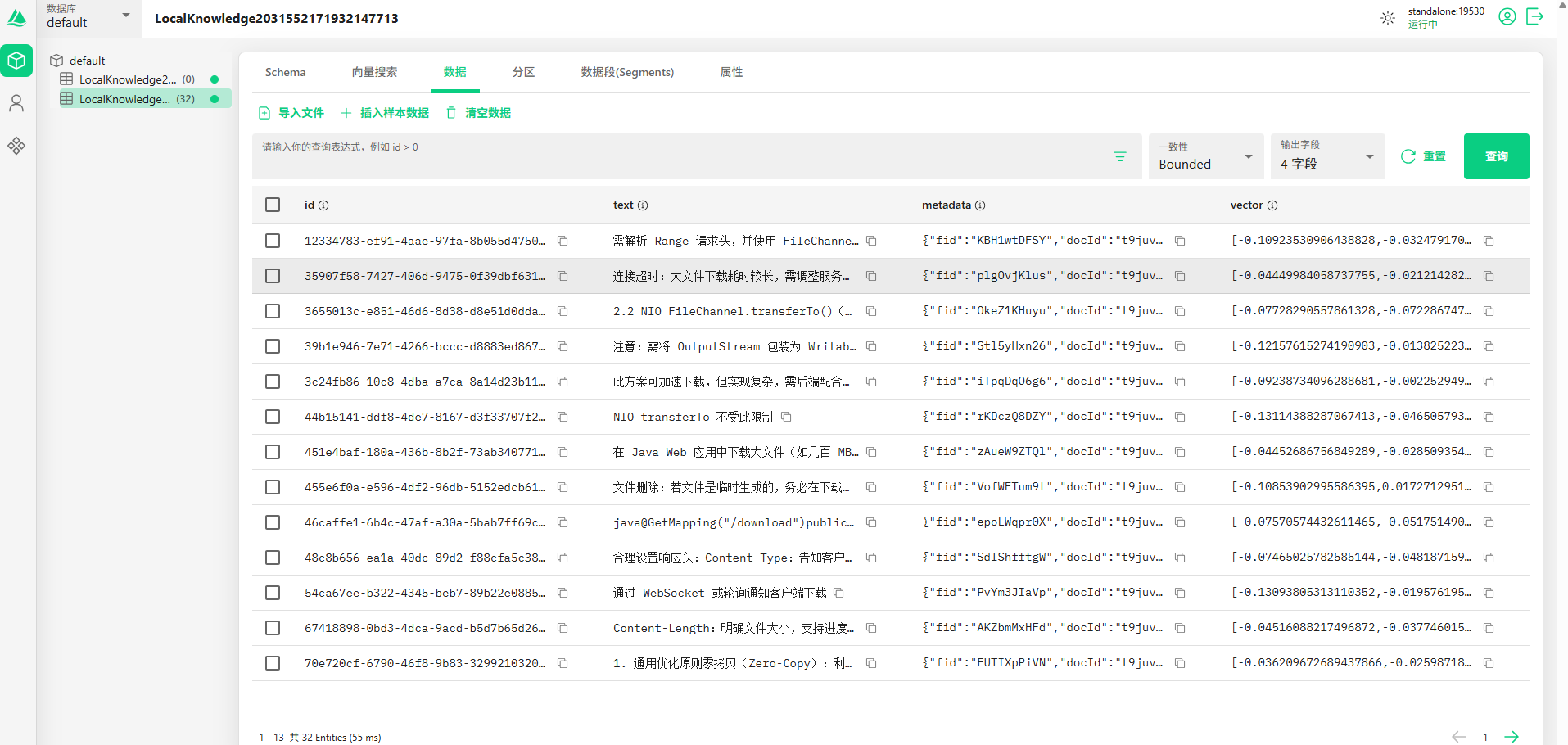

12.5 验证向量数据

在 Attu 中查看向量数据库中的数据:

第十三步:基于 RAG 的智能问答

完成以上配置后,即可体验基于大模型 + RAG 检索增强 + 本地知识库的智能问答功能:

总结

本文详细介绍了 RuoYi-AI 项目的本地部署流程,涵盖:

- 环境准备:MySQL、Redis、Ollama、Docker 等基础组件

- 模型部署:qwen2:0.5b 问答模型和 embeddinggemma:300m 向量模型

- 向量数据库:Milvus 及其可视化工具 Attu 的 Docker 部署

- 前后端配置:项目克隆、依赖安装、配置修改

- 功能验证:问答测试和 RAG 知识库配置

通过本指南,你可以快速搭建一套完整的本地 AI 问答系统,实现基于私有知识库的智能问答能力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)