AI推理成本18个月下降240倍,企业级应用迎来“经济奇点”

导语

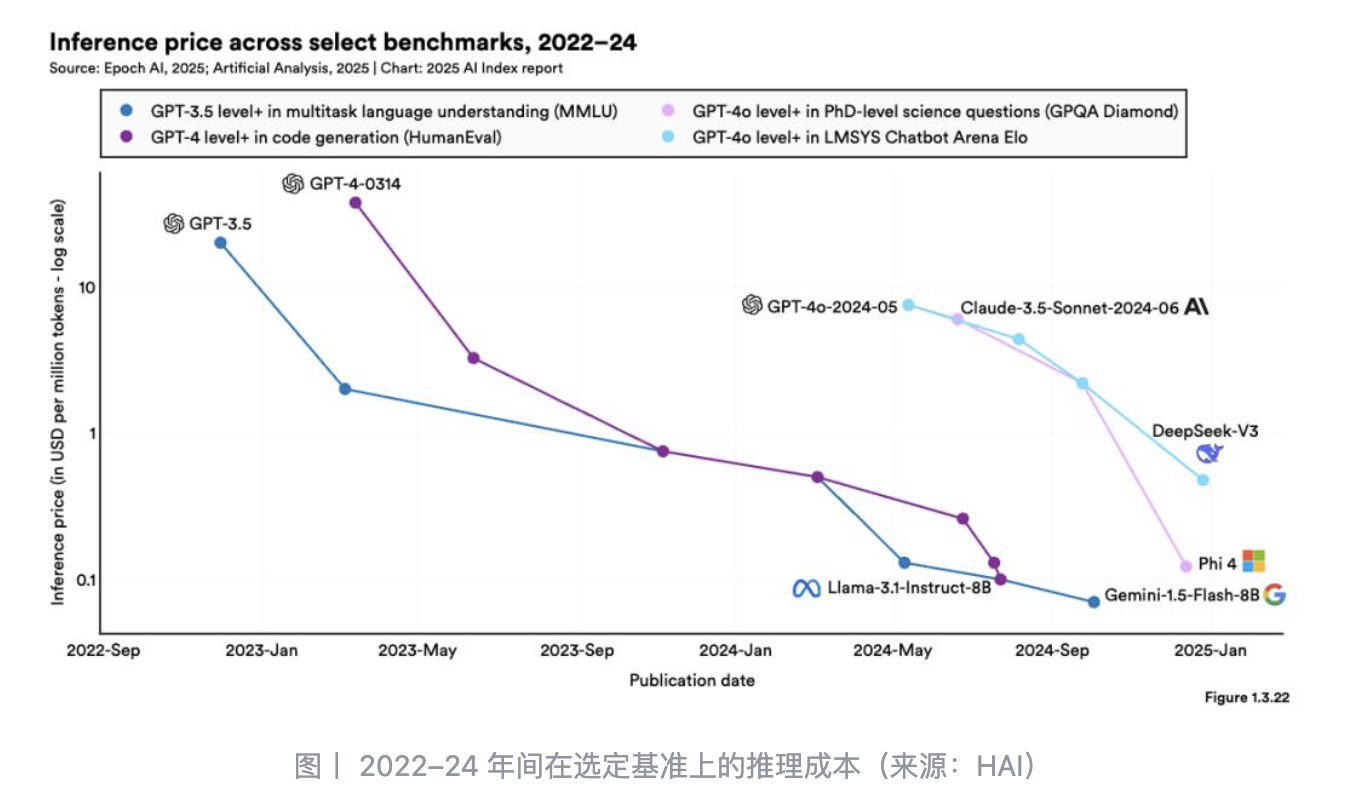

2026年初,一组数据在AI圈持续刷屏:在过去18个月内,AI推理成本从每百万token 60元骤降至不足10元,降幅高达240倍。与此同时,开源模型的使用成本已低至闭源模型的5%。这一“技术经济拐点”的到来,不仅改写了AI产业的成本账,更预示着企业级AI应用将从“试点探索”走向“规模化落地”的爆发期。

成本突破:从“实验品”到“日用品”的跨越

最新行业调研显示,AI推理的边际成本正在经历类似“摩尔定律”般的急速下探。以API调用价格为例,2023年初每百万token高达60元(约8.3美元)的成本,如今在主流厂商中已普遍降至10元人民币以内,头部厂商甚至推出了更低的定价策略。阿里云高管近期在访谈中提到,推理成本“每半年接近10倍下降”,与240倍的降幅趋势完全吻合。

更具颠覆性的是开源模型的成本优势。根据美国国家经济研究局(NBER) 的最新研究,同等智能水平的开源模型使用成本仅为闭源模型的10%~20%,部分场景下甚至低至5%。对于年调用量达十亿级token的企业而言,这意味着年成本从数千万元直接压缩至百万元级别,AI从“奢侈品”变成了“日用品”。

这一成本突破直接改变了企业的投资回报率(ROI)模型。此前因算力成本过高而被搁置的“海量数据处理”“实时个性化推荐”“全量日志分析”等场景,如今已具备落地的经济可行性。

技术驱动:三驾马车拉动“推理效率革命”

成本断崖式下跌的背后,绝非单纯的价格战,而是模型压缩、量化技术与硬件协同三大核心技术引擎的合力驱动。

-

极致压缩:让模型“瘦身”不减配

模型蒸馏和混合专家架构(MoE)已成为标配。通过将大模型的能力压缩进更小的架构,推理时仅激活部分参数,大幅降低计算量。例如,腾讯混元近期推出的HY-1.8B-2Bit模型,通过产业级2Bit量化技术,将1.8B参数模型压缩至等效0.3B,存储占用仅600MB,生成速度提升2-3倍,且保留了完整的思维链能力。 -

量化突破:1比特的极限挑战

学术界和工业界正在逼近量化的物理极限。最新的研究如NanoQuant技术,已实现将LLaMA2-70B模型压缩25.8倍,使其能在单张消费级8GB GPU上运行。这意味着原本需要昂贵A100/H100集群的任务,如今可以在边缘设备或普通服务器上完成。 -

软硬协同:把“每一滴油”都烧出动力

从Google的TPU到各大CSP自研的ASIC,针对Transformer架构的深度优化使能效比实现数倍提升。系统层面的KVCache优化、高效批处理策略以及编译器级调优,让同一套硬件能服务更多的Token请求。硬件利用率从训推一体时期的5%-10%,在专用推理芯片上得到大幅改善。

应用爆发:企业支出激增,AI渗透“千行百业”

成本门槛的降低,直接点燃了应用端的“爆点”。

根据Gartner最新预测,2026年全球AI支出总额将达2.52万亿美元,同比增长44%。其中,企业级AI应用支出占比约44%,行业解决方案支出增长44%,开发工具与平台增长40%。这组数据印证了一个事实:AI正在从“聊天机器人”向“核心生产系统”渗透。

- Agent即服务:低成本token是Agent规模化的前提。Cursor作为AI编程工具的标杆,在成立不到24个月内,年度经常性收入(ARR)突破10亿美元,成为B2B软件史上增长最快的公司之一。一个Agent往往需要调用上百次API才能完成任务,token成本的每一次下降,都在扩大Agent的商业边界。

- 端侧AI觉醒:随着推理成本的下降,AI正从云端向端侧“下沉”。AI手机渗透率预计从2024年的18%攀升至2026年的45%,AI眼镜、人形机器人等新硬件形态迎来奇点。

- C端流量变现:国内头部AI应用如豆包月活已突破2.26亿,累计Token消耗量达数万亿级别。高频、海量的交互背后,是推理成本下降提供的“底气”。

产业重构:算力需求“狂飙”中的新蓝海

推理成本的下降,带来了一个看似反直觉的结果:虽然单价降低了,但总需求却爆炸式增长。

360集团创始人周鸿祎曾预判,推理算力需求在1-3年内将增长百倍级,5-10年内可达千倍级。这一“杰文斯悖境”(Jevons Paradox)正在AI领域上演——效率提升导致使用需求激增,反而拉动了全产业链的投资。

- 芯片层:推理专用GPU/ASIC迎来窗口期。国内厂商如曦望(Sunrise)提出“百万Token一分钱”的目标,通过定制化架构试图重构算力成本底线。英伟达预计到2026年底,Blackwell与Rubin GPU总出货量或将达到2000万颗,合计带来5000亿美元销售额。

- 封装与制造:需求转向多元,先进封装CoWoS、SoIC应用从云端扩散至CPU与边缘AI,非台积电体系厂商崛起,封测、载板环节量价齐升。

- 算力服务:IDC向AIDC演进,电力供应成为新的瓶颈。甲骨文最新财报显示,其云收入暴增44%,积压订单(主要来自AI合同)高达5530亿美元,同比暴增325%,印证了AI基础设施需求的疯狂增长。

结语:决胜“后半场”,成本与生态定乾坤

AI产业的发展,正从“第一阶段”的“能不能做”(模型能力竞赛),转向“第二阶段”的“能不能用好”(成本与生态竞争)。

对于企业决策者而言,关注前沿模型分数的同时,更需紧盯推理成本的下降曲线。谁能把TCO(总拥有成本)压得够低,谁能把平台做得够开放,让更多应用在上面生长,谁就能在下一波市场重心转移中占据主动。

随着推理成本持续下探,我们正站在一个普惠化AI时代的门槛上——技术不再是少数巨头的专利,而将成为如水、电般赋能千行百业的“新生产力”。

参考资料

- NBER:The Emerging Market for Intelligence (2026.01)

- Gartner:全球AI支出预测报告 (2026.02)

- arXiv:NanoQuant: Efficient Sub-1-Bit Quantization (2026.02)

- 甲骨文2026财年第三季度财报及电话会议记录

- a16z《2026年AI报告》深度解读

- 阿里云技术访谈:推理成本的“十倍速”下降路径

- 国金证券:计算机行业研究:国内算力斜率惊人 (2026.03)

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)