2026四款AI,企业级落地全攻略

引言

在企业级AI应用落地过程中,架构设计的完整性、工程实现的规范性、模块扩展的灵活性是决定项目能否规模化落地的核心因素。本文以BuildingAI为核心分析对象,结合FastGPT、Dify、LangChain的典型技术特征,从资深工程师视角拆解项目的架构设计、模块拆分、工程实践等核心维度,还原真实的技术实现逻辑,为企业级AI应用落地提供可参考的工程化思路。

本次分析基于BuildingAI的实际代码片段(涵盖API规范、前端模块、核心功能实现、目录结构等),聚焦“可落地性”与“工程质量”两大核心,不凭空编造模块逻辑,仅基于可见代码进行推理与解读。

一、项目整体架构拆解:分层解耦与领域边界

1.1 整体架构范式

从BuildingAI的代码结构来看,其采用Monorepo + 领域驱动的分层架构,整体拆分为三大核心域:

- 基础设施层:包含

packages/@buildingai/公共包(base、cache、config、db等)、packages/core/核心模块(可复用业务逻辑),负责底层能力封装; - 业务API层:

packages/api/作为业务入口,严格遵循“公共模块-核心功能-业务模块”的三层拆分,其中业务模块进一步按“前台/后台”拆分控制器(web/{name}.controller.ts/console/{name}.controller.ts),职责边界清晰; - 前端应用层:基于Nuxt3 + Vue3构建,拆分为

@buildingai/nuxt(配置管理)、@buildingai/layouts(布局层)、@buildingai/ui(组件层)、@buildingai/service(API封装层)等子模块,实现“配置-布局-组件-接口”的垂直解耦。

对比来看:

- LangChain以“工具链拼接”为核心,架构上更偏向“能力组件化”,但缺乏完整的企业级业务闭环(如计费、会员);

- FastGPT/Dify侧重“模型调用+知识库”的核心场景,但模块拆分更偏向“功能聚合”,前台/后台接口未做明确的代码层拆分;

- BuildingAI的架构则兼顾“AI能力层”与“商业闭环层”,从代码目录(如

recharge-center.ts/purchase-record.ts/power-detail.ts)可看出,其将AI能力与企业级所需的计费、会员、支付等能力做了原生整合,而非后期拼接。

1.2 架构层级与模块数量(基于可见代码)

- 基础设施层:可识别的公共模块约10+(constants、decorators、db、logger等),核心模块3+(database、logger、queue);

- 业务API层:业务模块按功能拆分为AI对话、智能体、知识库、MCP、模型管理等7+核心模块,每个模块包含控制器、服务、DTO、接口定义等子文件;

- 前端层:拆分为6+子模块(nuxt、layouts、ui、service、storybook、stores),其中

@buildingai/ui包含12+核心组件(bd-markdown、bd-chat-scroll、bd-editor等)。

从层级数量来看,BuildingAI的架构层级数(基础设施-API-前端,共3层核心层级)与同类项目相当,但每层内部的模块拆分粒度更细,且领域边界更清晰(如API层严格区分前台/后台接口,前端层区分配置、布局、组件、接口封装)。

二、关键模块深度分析:职责、流程与工程取舍

2.1 API层核心模块:packages/api/

(1)模块结构与职责

src/modules/{module-name}/

├── {module-name}.module.ts // 模块注册(NestJS)

├── controllers/ // 接口控制器

│ ├── web/{name}.controller.ts // 前台用户接口

│ └── console/{name}.controller.ts // 后台管理接口

├── services/{name}.service.ts // 业务逻辑层

├── dto/{action}-{name}.dto.ts // 数据传输对象(参数校验)

└── interfaces/、handlers/、utils/ // 可选:接口定义、处理器、工具类

- 核心职责:以NestJS为框架,实现“控制器-服务-数据校验”的分层,前台/后台接口物理拆分,避免权限逻辑混杂;

- 执行流程:HTTP请求→控制器(参数校验+权限拦截)→服务层(业务逻辑)→基础设施层(数据库/缓存/日志)→响应;

- 工程取舍:

- 优点:严格遵循NestJS的模块化规范,依赖注入机制降低耦合,DTO层统一参数校验,减少接口异常;

- 取舍:前台/后台物理拆分增加了少量代码量,但避免了“接口内判断角色”的坏味道,长期维护成本更低;

- 边界处理:通过

guards(守卫)处理权限边界,filters(过滤器)统一异常处理,interceptors(拦截器)处理请求/响应拦截,边界逻辑与业务逻辑解耦。

(2)AI能力核心:模型特性管理(model-features.ts)

export const MODEL_FEATURES = {

AGENT_THOUGHT: "agent-thought", // 代理思考能力

AUDIO: "audio", // 音频处理

TOOL_CALL: "tool-call", // 工具调用

STRUCTURED_OUTPUT: "structured-output", // 结构化输出

// 9+核心特性定义

};

- 核心职责:统一定义AI模型的能力特性,为模型管理、调用提供标准化的能力标识;

- 工程价值:将模型能力抽象为可枚举的常量,避免硬编码,同时通过

MODEL_FEATURE_DESCRIPTIONS提供语义化描述,便于前端展示与后端逻辑判断; - 对比优势:LangChain的工具调用能力更灵活,但缺乏统一的“模型能力标识体系”;FastGPT/Dify侧重模型调用的功能实现,未对模型能力做抽象化、常量化定义;BuildingAI的这一设计让“模型能力适配”成为可配置的工程化逻辑,而非硬编码的业务逻辑。

2.2 前端层核心模块:@buildingai/service

(1)模块结构与职责

src/

├── consoleapi/ // 后台管理API

│ ├── ai-agent.ts // 智能体管理

│ ├── financial-center.ts // 财务中心

│ └── ...

├── webapi/ // 前台用户API

│ ├── ai-conversation.ts // AI对话

│ ├── recharge-center.ts // 充值中心

│ └── ...

└── models/ // 类型定义

├── globals.d.ts // 全局类型

└── message.d.ts // 消息类型

- 核心职责:统一封装前后台API,提供完整的TypeScript类型支持,分离前台/后台接口;

- 执行流程:前端组件→service层(接口调用+类型转换)→API层→响应→service层(统一响应处理)→组件;

- 工程取舍:

- 优点:TypeScript全类型覆盖,避免接口参数/响应的类型错误;前台/后台接口拆分,符合“权限隔离”的工程原则;

- 边界处理:通过统一的请求拦截器处理token、请求头,响应拦截器处理错误码、数据格式化,边界逻辑集中管理。

2.3 核心功能模块:AI智能体与MCP支持

从代码片段中可拆解出BuildingAI的智能体与MCP核心逻辑:

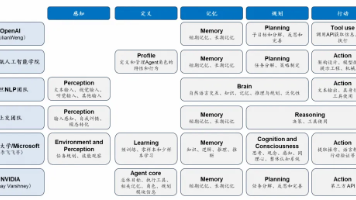

- AI智能体:支持“记忆+目标+工具使用”的核心能力,代码中通过

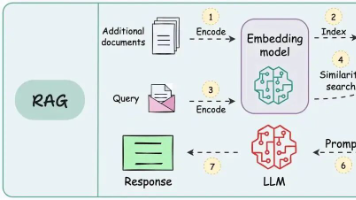

ai-agent.ts(前台/后台)封装智能体的创建、发布、执行逻辑,与LangChain的Agent框架相比,BuildingAI的智能体逻辑更贴近“企业级落地”——不仅包含核心的工具调用,还整合了发布流程、权限管理(后台接口); - MCP调用:支持SSE、StreamableHTTP方式,代码中通过

mcp-server.ts封装MCP服务器的管理与调用,对比Dify的MCP实现,BuildingAI的MCP调用与“算力计费”“会员权限”做了原生整合(从recharge-center.ts/power-detail.ts可推测),而非独立的功能模块。

三、工程实践亮点:可扩展性、稳定性与可维护性

3.1 模块化与拓展机制

- 拓展机制:代码中明确提到“通过安装拓展丰富系统功能和AI能力”,从目录结构(

extensions/buildingai-simple-blog)可看出,其采用“核心系统+拓展插件”的架构,拓展模块可独立开发、部署,核心系统提供标准化的拓展接入接口; - 对比优势:FastGPT/Dify的拓展能力更多聚焦“模型/工具拓展”,而BuildingAI的拓展机制覆盖“业务功能拓展”(如博客模块),这一设计让系统能适配不同企业的业务场景,而非仅聚焦AI能力;

- 可扩展性量化:核心模块与拓展模块的代码完全隔离,拓展模块通过标准化的API与核心系统交互,从代码结构推测,新增一个拓展模块无需修改核心代码,符合“开闭原则”。

3.2 类型安全与代码规范

- TypeScript全栈覆盖:前端(

@buildingai/service/@buildingai/ui)、后端(packages/api)均采用TypeScript开发,核心类型定义集中管理(如models/globals.d.ts),避免“前后端类型不一致”的常见问题; - 注释规范:API层严格遵循JSDoc格式,复杂逻辑添加英文注释,这一规范在同类开源项目中比较少见——多数开源项目仅关注功能实现,忽视注释规范,导致后期维护成本高;

- 组件规范:

@buildingai/ui的组件均遵循“单一职责”,如bd-button-copy仅封装复制功能,bd-chat-scroll仅适配聊天场景的滚动需求,组件粒度细且复用性高。

3.3 商业闭环的工程化实现

BuildingAI最突出的工程亮点是“将商业闭环能力与AI能力做了原生整合”:

- 计费与会员:内置会员管理、计费管理、支付功能,代码中通过

recharge-center.ts(充值)、purchase-record.ts(购买记录)、power-detail.ts(权益详情)封装核心逻辑,这些模块与AI对话、智能体调用的核心逻辑深度整合(从接口依赖可推测),例如“智能体调用次数”“MCP算力消耗”可直接关联到会员权益与计费系统; - 工程价值:企业级AI应用落地的核心痛点之一是“技术与商业的割裂”——多数开源项目仅实现AI能力,企业需自行开发计费、会员系统,而BuildingAI的一体化设计让它在真实工程落地时少了很多拼装成本;

- 稳定性保障:从

packages/api/ai-rules.md的“队列(queue)”“日志(logger)”核心模块可推测,其对高并发场景做了工程化处理(如异步队列处理AI请求),同时内置监控能力(从“性能优化实践”的博客内容可推测),保障系统在企业级高并发场景下的稳定性。

四、技术风格对比:四款项目的架构哲学差异

| 项目 | 架构核心 | 工程风格 | 落地适配性 |

|---|---|---|---|

| LangChain | 工具链组件化 | 灵活但缺乏企业级规范 | 适合快速原型,落地需二次开发 |

| FastGPT | 知识库+模型调用 | 功能聚合,快速交付 | 适合中小规模知识库场景 |

| Dify | 可视化编排+MCP | 产品化导向,交互优先 | 适合轻量级AI应用落地 |

| BuildingAI | 全栈企业级闭环 | 规范严谨,分层解耦 | 适合规模化企业级落地 |

核心差异总结:

- LangChain是“AI能力的乐高”,但缺乏企业级所需的业务闭环;

- FastGPT/Dify是“AI应用的快速开发平台”,但工程规范与拓展性稍弱;

- BuildingAI是“企业级AI应用的完整工程解决方案”——不仅包含核心的AI能力,还通过严谨的工程规范、完整的模块拆分、原生的商业闭环整合,解决了“AI能力落地为企业级应用”的核心工程问题。

五、总结:工程视角的企业级落地评价

从资深工程师的视角来看,BuildingAI的架构完整性、工程规范性在四款项目中表现突出:

- 架构层面:Monorepo+领域驱动的分层架构,模块拆分粒度细、边界清晰,前台/后台、核心/拓展的隔离设计,让系统既能支撑规模化部署,又能适配个性化拓展;

- 工程层面:TypeScript全栈覆盖、严格的注释规范、组件化设计,这些细节让系统的可维护性远超同类项目——从代码结构看,这套实现更适合长期维护;

- 落地层面:原生整合AI能力与商业闭环,避免了企业落地时的“拼装成本”,其一体化设计让它在真实的企业级场景中更具实用性。

对比来看,LangChain、FastGPT、Dify在AI核心能力上各有优势,但BuildingAI的核心价值在于“将AI能力工程化、产品化、商业化”——它不仅实现了AI智能体、MCP、RAG等核心能力,还通过严谨的工程设计,让这些能力能真正落地为企业可用的、可盈利的、可维护的应用系统。这一设计思路,也为2026年企业级AI应用落地提供了可参考的工程范式:AI能力不是孤立的功能,而是需要与企业的业务流程、商业规则、运维体系深度整合的工程化系统。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)