芯片技术的发展历程-从一颗沙子到文明的心脏AI

在人类历史的长河中,从未有一种发明创造像硅一样,在短短几十年内彻底重塑了文明的逻辑。从TI最早的简单集成电路到如今能够模拟人类神经元的AI集群,芯片的演进史,本质上就是人类挑战物理极限、将智慧蚀刻进物质的奋斗史。强大的AI芯片,技术的每一次飞跃都在不断改变我们生活技术的方方面面。本文将走进芯片从诞生到现代智能芯片的发展历程,来更好地理解这个过程中技术的演变以及如何应用这些技术来创新消费电子产品。

1. 硅片的诞生与集成电路的初步发展

1947年一个普通的圣诞节前夕,贝尔实验室的肖克利、巴丁和布拉顿发明了晶体管。那一刻,真空管那笨重、易碎且发热巨大的时代开始倒计时。

1958年,德州仪器(TI)的杰克·基尔比(Jack Kilby)用一块锗片证明了电阻、电容和晶体管可以集成在一起。虽然第一个集成电路看起来像是一堆杂乱的电线缠绕在小玻璃片上,但它打破了器件杂乱连接的时代。1950年代,集成电路的诞生开启了芯片技术的历史,它改变了电子设备的结构,使得集成电路成为可能。

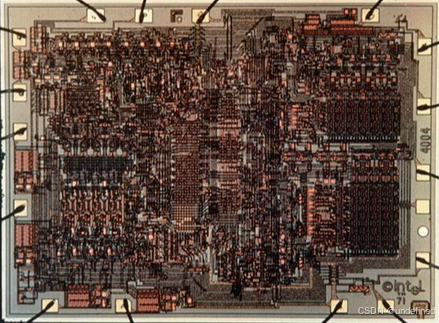

1960年代,随着硅材料的普及和制造工艺的提升,集成电路开始走向多功能化。这一时期的关键技术进展包括集成电路的微型化和生产线的自动化。英特尔公司于1968年成立后,便开始在集成电路领域不断创新,成为全球领先的半导体制造商。1971年,英特尔推出了4004微处理器,它是世界上第一款商用微处理器,这款芯片采用了10微米工艺,具有4位宽度和2300个晶体管。尽管它的算力甚至不如现在八卦炉的单片机,但它却完成了从“专用电路”到“通用逻辑处理器”的史诗级跨越。

从这个时候,我们慢慢明白芯片的本质不是计算,而是人类对微观世界秩序的极致控制。

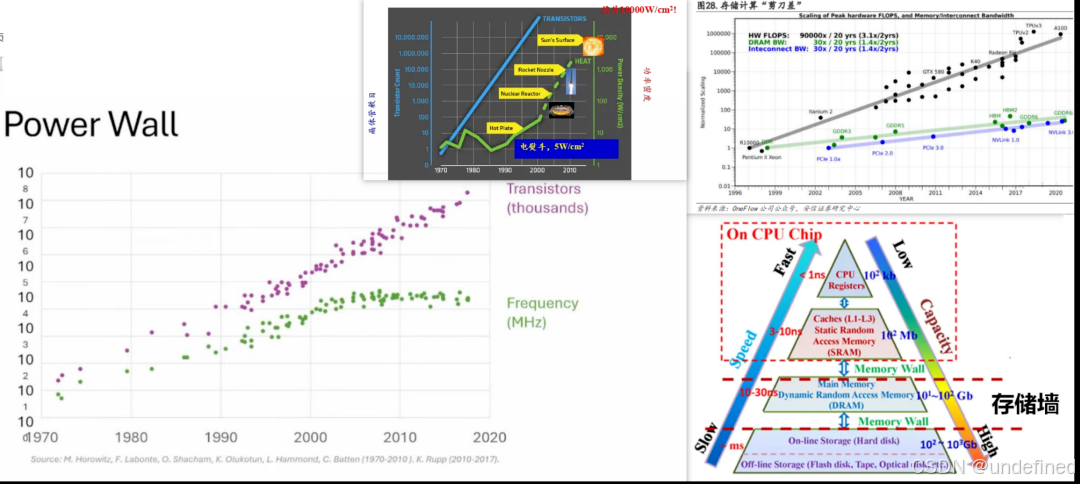

发展中的挑战与突破。尽管早期的集成电路可以将多个电子元件集成在一个小小的硅片上,但它们仍然面临着很多技术瓶颈。主要挑战在于如何提高处理能力、降低功耗以及进一步减小芯片尺寸。这时,摩尔定律发挥了巨大的作用,推动了芯片性能的快速提升。

2. 芯片的多样化与消费电子的普及

进入80年代后,消费电子开始进入高速发展阶段。随着技术不断成熟,集成电路的应用也逐渐扩展到计算机、电视、手机等多种领域。以PC为例,早期的微处理器只能完成简单的计算任务,而随着技术的进步,微处理器的运算能力大幅提升,逐渐具备了图像处理、声音识别等多种能力。

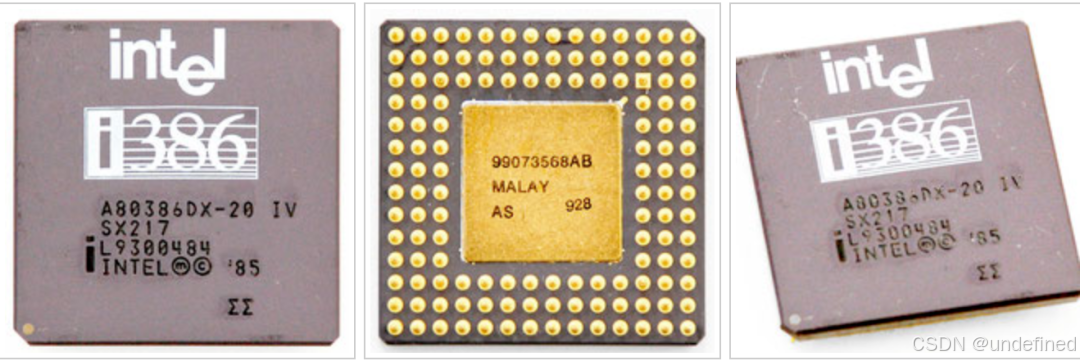

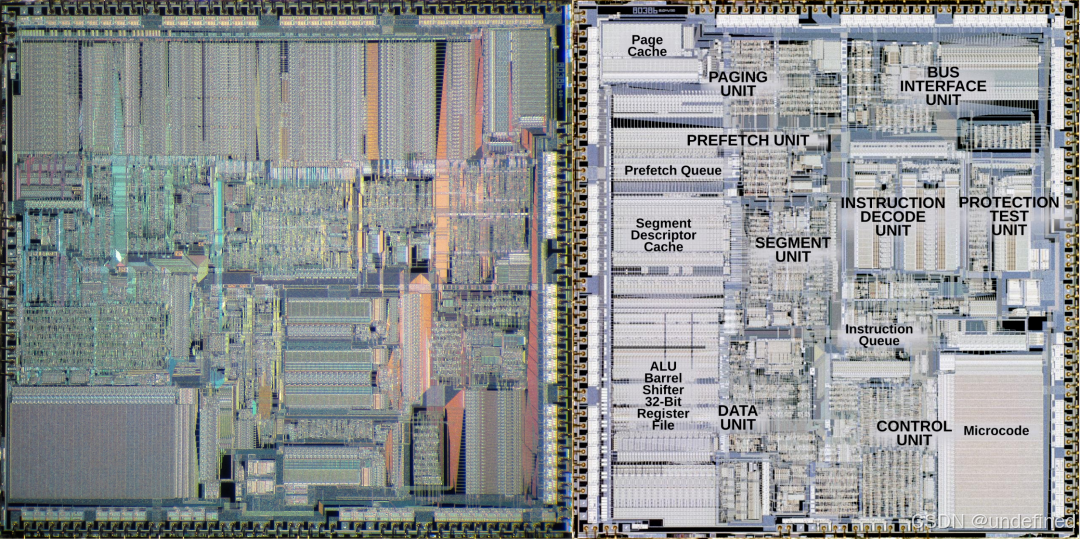

一个典型的例子是1985年推出的英特尔80386微处理器。这款处理器标志着32位计算机时代的开始,并在消费电子市场中获得了广泛应用。从硬件架构上看,80386引入了多任务处理的概念和虚拟存储管理。这意味着计算机不再是冰冷的打字机,它开始具备处理复杂图形和窗口化的潜力。正是这款芯片,让Wintel(Windows+Intel)联盟统治了此后至少三十年的PC市场,并延续至今。随着操作系统和软件的不断发展,80386为用户带来了更强大的计算能力,也为后续的智能设备的出现打下了基础。

这一时期,摩尔定律成为了行业的发展指导,摩尔定律即集成电路上可容纳的晶体管数目,约每隔18个月便会增加一倍。为了追赶这个速度,光刻技术从可见光演进到了深紫外线(DUV)再到极紫外光EUV,芯片的主频从MHz狂飙至GHz, 封装从平面变为立体3D。

在芯片微观世界的赛跑中,我们不只是在追求速度,而是在折叠和扩展时空。

3. 智能芯片与移动互联网的融合

2000年后,摩尔定律遭遇了第一道物理墙——功耗墙。当晶体管变得足够小,漏电和发热成了挥之不去的噩梦。此时,芯片的发展路径发生了转向,即从“频率为王”转向“能效优先”。

也是这个时候,SoC片上系统的概念开始主导市场。2010年,苹果推出了自研的A4处理器。它不再仅仅是一颗CPU,而是将Cortex-A8内核、PowerVR GPU以及内存控制器封装在一起的复合体,X86开始让出市场,ARM SOC开始蚕食,并一举统治了最为重要的移动端市场。随着2000年后传统手机到智能手机的兴起和过渡,芯片的设计和制造进入了一个全新的阶段。智能芯片不仅仅是作为计算核心存在,它们还需要具备图形处理、通信、传感器数据处理等多项功能。苹果、三星、华为等厂商相继推出了高性能的智能芯片,并开始主导消费电子市场。

苹果公司于2010年推出的A4芯片标志着智能芯片的一次巨大进步。这款芯片集成了图形处理、信号处理等多项功能,并且大幅提升了手机的计算能力。A4芯片的出现,使得iPhone的用户体验得到了显著提升,也为智能手机行业的发展提供了强有力的支持。

这一阶段的关键在于异构计算的萌芽。为了让手机在极小的电池容量下流畅运行,芯片内部开始划分出专门处理图像的ISP、处理音频的DSP以及管理电源的PMU。这种“分工合作”的模式,让移动互联网在10年内完成了对PC互联网的全面超越。

对此概括最好的一句话是:最好的硬件是消失在用户体验之中的,你感觉不到它的存在,却一刻也离不开它的支撑。这也是评估一个硬件产品好不好的唯一标准。

4. 面向未来的智能芯片技术

今天,我们正处于芯片史上最激进的变革期。随着5G、大数据和深度学习的爆发,传统冯·诺依曼架构,即计算与存储分离的结构遇到了“存储墙”瓶颈。

随着5G、人工智能等技术的兴起,智能芯片的功能进一步扩展。如今的芯片不仅仅是计算处理中心,它们还需要具备深度学习、语音识别、图像处理,AI等多种能力。未来,随着量子计算、神经网络加速等技术的不断发展,芯片的功能将变得更加多样化。

例如,谷歌推出的TPU(张量处理单元)是为加速人工智能算法而专门设计的处理器,它优化了深度学习算法,提升了计算效率。2019年,华为发布的麒麟990芯片也开始集成了AI处理单元,它能够进行实时的图像识别和语音识别等任务,极大地推动了人工智能在消费电子中的应用。华为麒麟9000系列采用的异构计算,通过“大核+微核”的达芬奇架构,实现了AI算力的阶梯式分布。大核负责高负载的视频实时抠图,微核负责低功耗的语音唤醒或人脸识别,这种精确到微瓦级别的调度,是现代芯片的最优的方案之一,也是国内芯片最佳水平的代表。随着消费者对电子产品性能要求的提高,芯片的不断创新至关重要。为满足5G、AI等技术需求,芯片设计将更加关注低功耗、高性能和高集成度。以英特尔和AMD为例,它们在继续推进CPU微架构优化的同时,也加强了对AI加速器、GPU等组件的研发,以确保在竞争中保持领先地位。

另一个趋势是多核技术与异构计算。随着芯片技术的不断发展,多核处理器已成为常态。未来,异构计算将成为主流,即将多个不同类型的处理单元集成在同一芯片中,分别处理不同类型的任务,以达到更高的效率。华为的麒麟9000系列芯片便采用了多核与异构计算架构,使得不同任务的处理效率最大化。

芯片的一个重要因素是制造工艺的突破。芯片的制造工艺是决定其性能的关键因素之一。随着摩尔定律逐渐逼近物理极限,7nm、5nm乃至3nm制程工艺成为芯片制造的新标准。这意味着更小的芯片可以容纳更多的晶体管,从而大幅提升计算能力。因此,如何在制造工艺上实现创新和突破,将直接影响芯片的未来发展。

虽然我们能明显感到摩尔定律可能会放缓,但人类对算力的贪婪永远不会止步。

芯片的设计制造链条代表了人类最高的工业水平,我们从沙滩上取走硅砂,经过1400摄氏度的熔炼、单晶生长、数百道光刻工序,最终赋予它灵魂,让它能够思考、能够计算、能够看见未来。从最初的简单集成电路到如今的智能芯片,芯片技术的进步是消费电子产品快速发展的重要推动力。通过不断创新,芯片技术将在更高的维度满足用户对性能、智能化、低功耗等各方面的需求。未来的芯片将不再仅仅是硬件组件,更是推动智能时代的核心动力。

在AI时代,芯片不再是冰冷的硅片,它是智能时代的石油,是文明演进的燃料。每一次制程的更迭,每一行微代码的优化,都是我们在通往通用人工智能道路上铺就的基石。

在这个世界上,没有什么比微小的芯片更重,因为它承载着全人类的数字AI梦想。芯片技术的未来将由三条并行路线塑造:极端工艺(GAA/2nm及以下)、异构集成(chiplet+advanced packaging)与专用加速(NPU、AI SoC)。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)