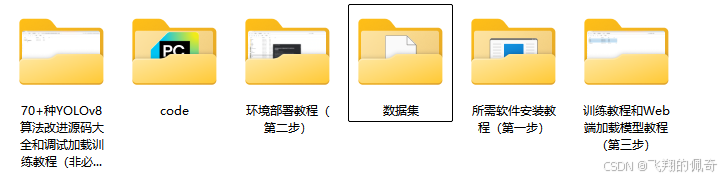

【完整源码+数据集+部署教程】医疗设备检测系统源码分享[一条龙教学YOLOV8标注好的数据集一键训练_70+全套改进创新点发刊_Web前端展示]

背景意义

随着全球医疗技术的不断进步,医疗设备的种类和数量日益增加,这为医疗服务的高效性和安全性提供了保障。然而,医疗设备的多样性也带来了管理和监控的挑战,尤其是在设备的实时检测和维护方面。传统的人工检测方法不仅耗时耗力,而且容易出现遗漏,无法满足现代医疗环境对设备管理的高效需求。因此,基于计算机视觉和深度学习技术的自动化检测系统应运而生,成为提升医疗设备管理效率的重要手段。

在众多深度学习模型中,YOLO(You Only Look Once)系列因其高效的实时目标检测能力而备受关注。YOLOv8作为该系列的最新版本,结合了更为先进的网络结构和算法优化,具备了更高的检测精度和速度。通过对YOLOv8进行改进,能够进一步提升其在医疗设备检测中的应用效果。具体而言,改进的YOLOv8模型可以更好地适应医疗环境中复杂的背景和多样的设备形态,提高对医疗设备的识别率和定位精度。

本研究所使用的数据集包含1900张图像,涵盖17类医疗设备,包括CT扫描仪、医院病床、呼吸机、透析机等。这些设备在医疗服务中扮演着至关重要的角色,及时、准确地检测和识别这些设备不仅有助于提高医疗服务的效率,还能在紧急情况下确保设备的正常运转。通过对这些设备进行有效的监控和管理,可以大幅度降低设备故障带来的风险,提升患者的安全性和治疗效果。

此外,随着人工智能技术的不断发展,基于深度学习的医疗设备检测系统不仅能够实现设备的自动识别,还能够与医院信息管理系统进行有效集成,形成一个智能化的医疗设备管理平台。这一平台可以实时监控设备的使用状态,及时预警设备故障,优化设备的使用效率,从而提升整个医疗机构的运营效率。

综上所述,基于改进YOLOv8的医疗设备检测系统具有重要的研究背景和现实意义。它不仅为医疗设备的管理提供了新的思路和方法,还为实现智能医疗、提升医疗服务质量奠定了基础。通过本研究的深入探索,期望能够为医疗行业提供一个高效、可靠的设备检测解决方案,推动医疗设备管理的智能化进程,为患者的健康保驾护航。

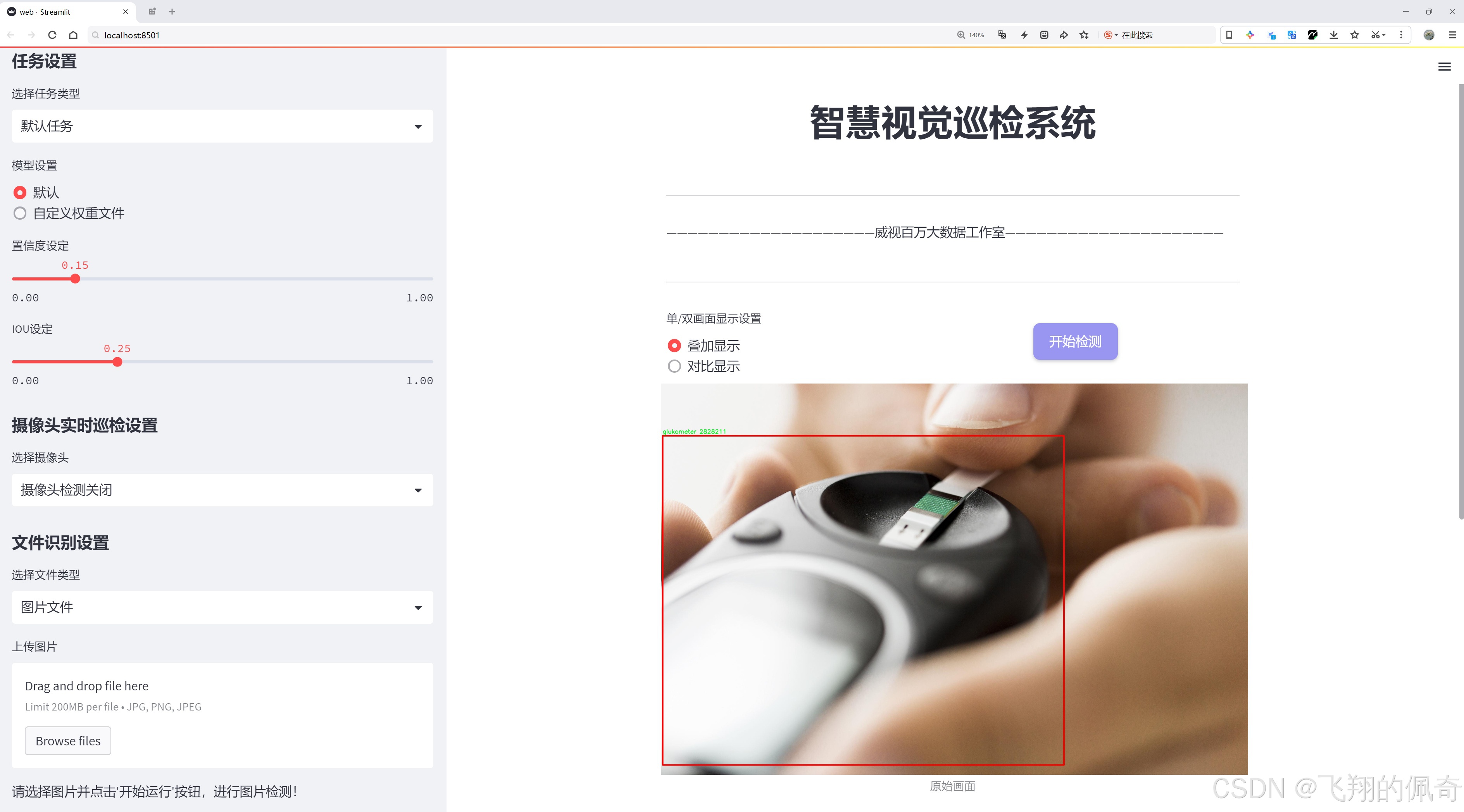

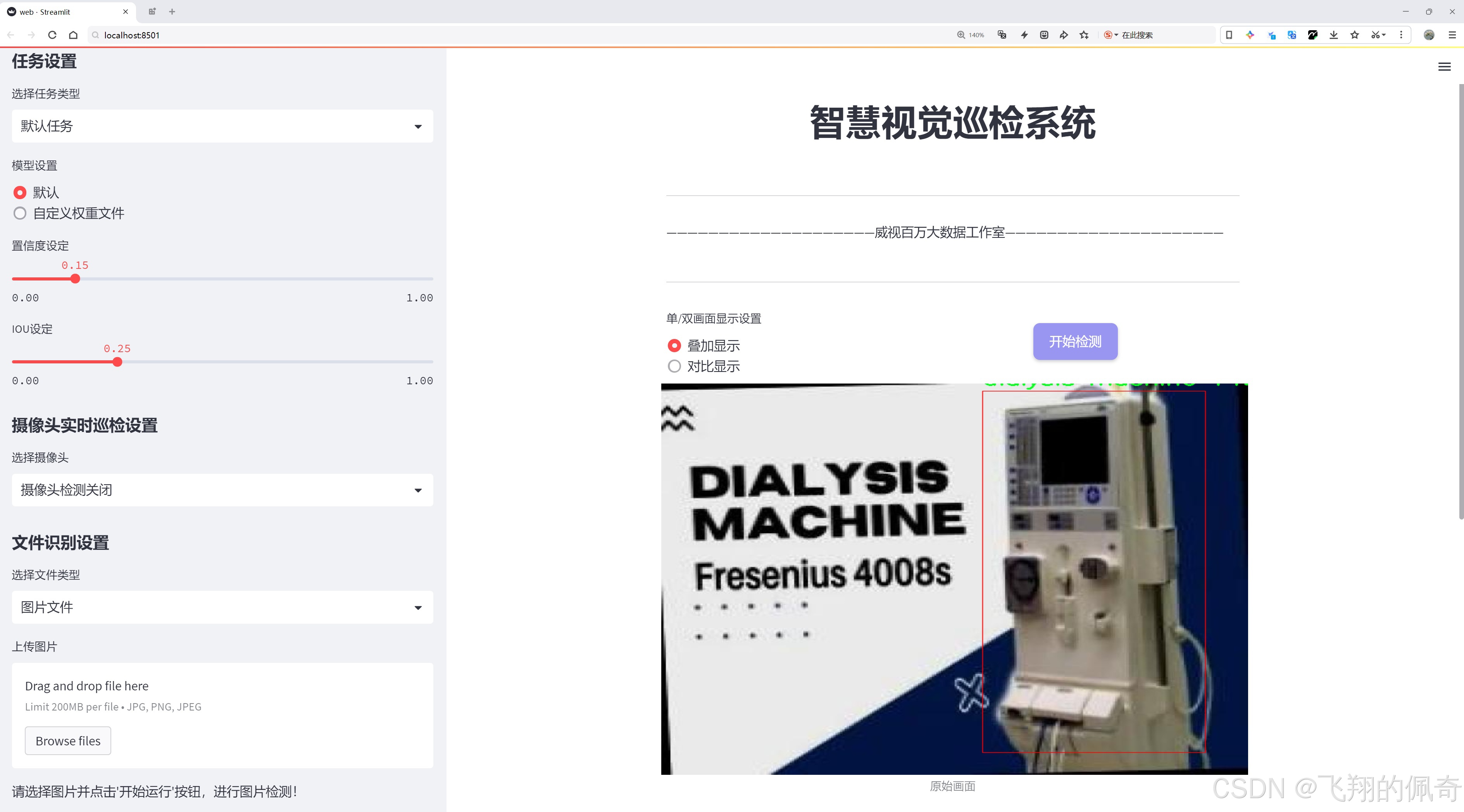

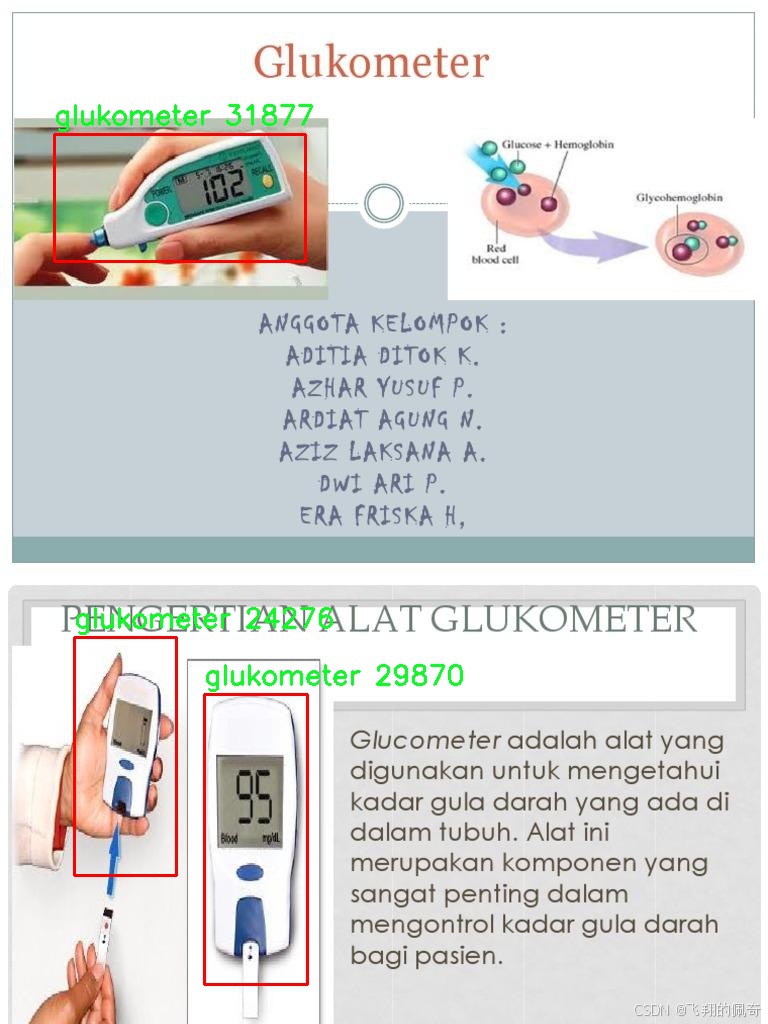

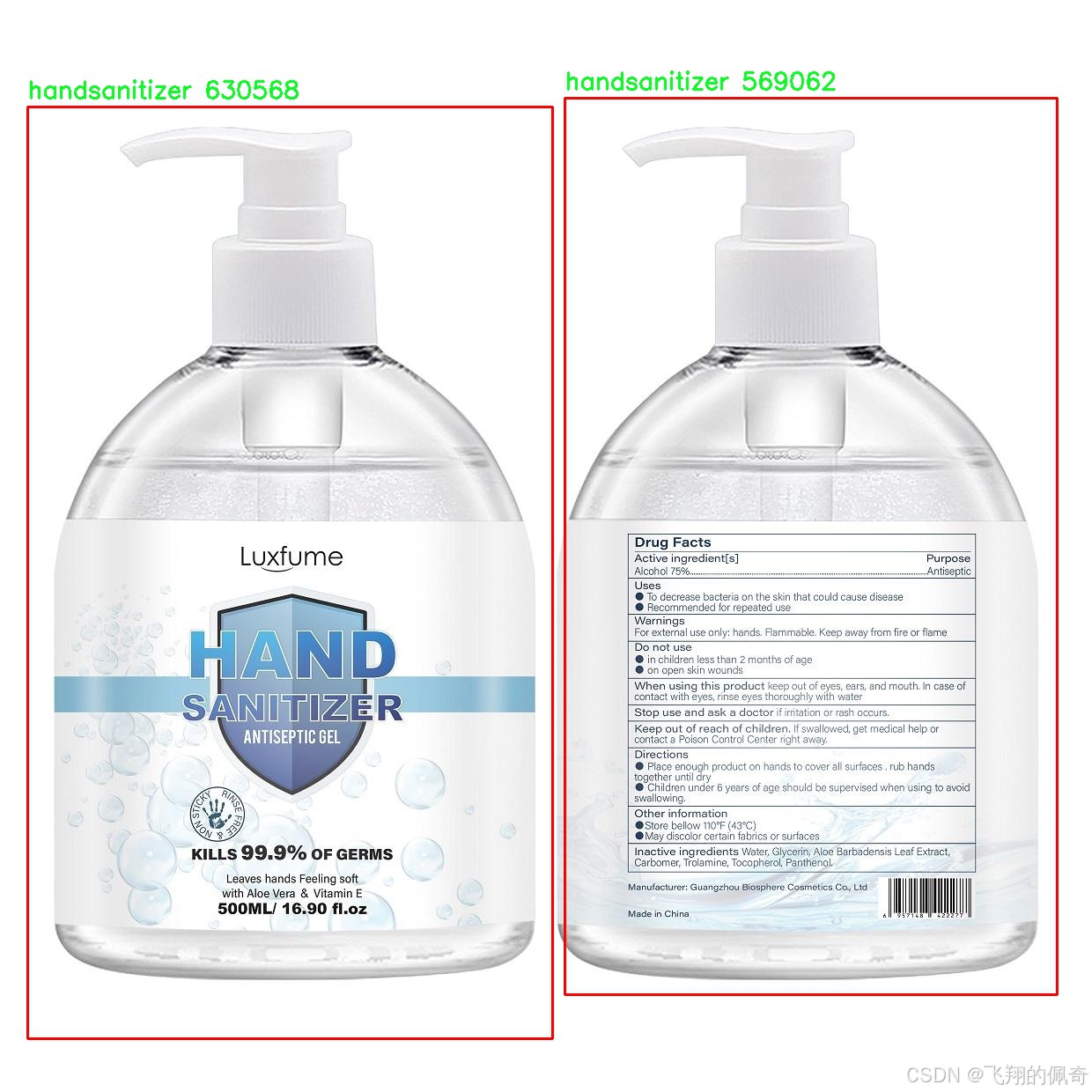

图片效果

数据集信息

在本研究中,我们使用了名为“object-detection aseto”的数据集,以训练和改进YOLOv8的医疗设备检测系统。该数据集专门设计用于医疗领域,涵盖了17种不同类别的医疗设备,旨在提高计算机视觉算法在医疗环境中的应用效果。通过对这些设备的有效检测和识别,我们期望能够提升医疗服务的效率和安全性。

数据集中包含的类别包括CT扫描仪、医院病床、医院呼吸机、外周磁刺激设备(PMS)、呼吸机面罩、X光机、除颤器、透析机、血糖仪、洗手液、胰岛素、口罩、药膏、秤、听诊器、血压计和温度计。这些设备在现代医疗实践中扮演着至关重要的角色,涵盖了从基础护理到复杂治疗的各个方面。

CT扫描仪是现代医学影像学的重要工具,能够提供高分辨率的内部结构图像,帮助医生进行诊断。医院病床则是患者在住院期间接受治疗和护理的基本设施,其数量和分布直接影响医院的接收能力和患者的舒适度。医院呼吸机和呼吸机面罩则是危重病人救治中不可或缺的设备,尤其在疫情期间,其重要性愈加凸显。

此外,外周磁刺激设备(PMS)在神经康复领域的应用日益广泛,能够有效促进患者的康复进程。X光机作为一种常见的影像学检查工具,广泛应用于骨折和其他病变的诊断。除颤器则是心脏骤停患者的生命救助设备,其快速有效的使用能够显著提高患者的生存率。

透析机和血糖仪在慢性病管理中发挥着重要作用,前者用于肾功能不全患者的治疗,后者则是糖尿病患者日常监测血糖水平的必备工具。洗手液、口罩和药膏等设备则是医院感染控制和日常护理中不可或缺的组成部分,能够有效预防交叉感染和促进伤口愈合。

秤、听诊器、血压计和温度计等基础医疗设备,虽然在技术上相对简单,但在日常护理和健康监测中却发挥着不可替代的作用。它们不仅是医疗工作者进行常规检查的工具,也是患者健康管理的重要组成部分。

通过对“object-detection aseto”数据集的深入分析和应用,我们希望能够训练出更为精准和高效的YOLOv8模型,从而在医疗环境中实现更为智能化的设备检测。这将有助于提高医疗服务的自动化水平,减少人为错误,并为医疗工作者提供更为可靠的决策支持。随着数据集的不断丰富和模型的不断优化,我们相信未来的医疗设备检测系统将能够在更广泛的场景中发挥作用,为患者提供更安全、更高效的医疗服务。

核心代码

```python

import math

import torch

import torch.nn as nn

from torch.nn.init import constant_, xavier_uniform_

from ..modules import Conv, DFL, Proto

from ultralytics.utils.tal import dist2bbox, make_anchors

class Detect_DyHead(nn.Module):

"""YOLOv8 检测头,使用动态头(DyHead)进行目标检测。"""

def __init__(self, nc=80, hidc=256, block_num=2, ch=()):

"""

初始化检测头。

参数:

nc (int): 类别数量。

hidc (int): 隐藏层通道数。

block_num (int): 动态头块的数量。

ch (tuple): 输入通道数的元组。

"""

super().__init__()

self.nc = nc # 类别数量

self.nl = len(ch) # 检测层的数量

self.reg_max = 16 # DFL通道数

self.no = nc + self.reg_max * 4 # 每个锚点的输出数量

self.stride = torch.zeros(self.nl) # 构建时计算的步幅

c2, c3 = max((16, ch[0] // 4, self.reg_max * 4)), max(ch[0], self.nc) # 通道数

self.conv = nn.ModuleList(nn.Sequential(Conv(x, hidc, 1)) for x in ch) # 卷积层

self.dyhead = nn.Sequential(*[DyHeadBlock(hidc) for _ in range(block_num)]) # 动态头块

self.cv2 = nn.ModuleList(

nn.Sequential(Conv(hidc, c2, 3), Conv(c2, c2, 3), nn.Conv2d(c2, 4 * self.reg_max, 1)) for _ in ch)

self.cv3 = nn.ModuleList(nn.Sequential(Conv(hidc, c3, 3), Conv(c3, c3, 3), nn.Conv2d(c3, self.nc, 1)) for _ in ch)

self.dfl = DFL(self.reg_max) if self.reg_max > 1 else nn.Identity() # DFL层

def forward(self, x):

"""连接并返回预测的边界框和类别概率。"""

for i in range(self.nl):

x[i] = self.conv[i](x[i]) # 通过卷积层处理输入

x = self.dyhead(x) # 通过动态头处理

shape = x[0].shape # 获取输出形状

for i in range(self.nl):

# 将边界框和类别概率拼接

x[i] = torch.cat((self.cv2[i](x[i]), self.cv3[i](x[i])), 1)

if self.training:

return x # 如果是训练模式,返回原始输出

else:

# 计算锚点和步幅

self.anchors, self.strides = (x.transpose(0, 1) for x in make_anchors(x, self.stride, 0.5))

self.shape = shape

# 将所有检测层的输出拼接

x_cat = torch.cat([xi.view(shape[0], self.no, -1) for xi in x], 2)

box, cls = x_cat.split((self.reg_max * 4, self.nc), 1) # 分割边界框和类别

dbox = dist2bbox(self.dfl(box), self.anchors.unsqueeze(0), xywh=True, dim=1) * self.strides # 转换为边界框

y = torch.cat((dbox, cls.sigmoid()), 1) # 拼接边界框和类别概率

return y # 返回最终输出

def bias_init(self):

"""初始化检测头的偏置,警告:需要步幅可用。"""

for a, b, s in zip(self.cv2, self.cv3, self.stride):

a[-1].bias.data[:] = 1.0 # 边界框偏置初始化

b[-1].bias.data[:self.nc] = math.log(5 / self.nc / (640 / s) ** 2) # 类别偏置初始化

class Detect_AFPN_P345(nn.Module):

"""YOLOv8 检测头,使用自适应特征金字塔网络(AFPN)进行目标检测。"""

def __init__(self, nc=80, hidc=256, ch=()):

"""

初始化检测头。

参数:

nc (int): 类别数量。

hidc (int): 隐藏层通道数。

ch (tuple): 输入通道数的元组。

"""

super().__init__()

self.nc = nc # 类别数量

self.nl = len(ch) # 检测层的数量

self.reg_max = 16 # DFL通道数

self.no = nc + self.reg_max * 4 # 每个锚点的输出数量

self.stride = torch.zeros(self.nl) # 构建时计算的步幅

c2, c3 = max((16, ch[0] // 4, self.reg_max * 4)), max(ch[0], self.nc) # 通道数

self.afpn = AFPN_P345(ch, hidc) # 自适应特征金字塔网络

self.cv2 = nn.ModuleList(

nn.Sequential(Conv(hidc, c2, 3), Conv(c2, c2, 3), nn.Conv2d(c2, 4 * self.reg_max, 1)) for _ in ch)

self.cv3 = nn.ModuleList(nn.Sequential(Conv(hidc, c3, 3), Conv(c3, c3, 3), nn.Conv2d(c3, self.nc, 1)) for _ in ch)

self.dfl = DFL(self.reg_max) if self.reg_max > 1 else nn.Identity() # DFL层

def forward(self, x):

"""连接并返回预测的边界框和类别概率。"""

x = self.afpn(x) # 通过AFPN处理输入

shape = x[0].shape # 获取输出形状

for i in range(self.nl):

# 将边界框和类别概率拼接

x[i] = torch.cat((self.cv2[i](x[i]), self.cv3[i](x[i])), 1)

if self.training:

return x # 如果是训练模式,返回原始输出

else:

# 计算锚点和步幅

self.anchors, self.strides = (x.transpose(0, 1) for x in make_anchors(x, self.stride, 0.5))

self.shape = shape

# 将所有检测层的输出拼接

x_cat = torch.cat([xi.view(shape[0], self.no, -1) for xi in x], 2)

box, cls = x_cat.split((self.reg_max * 4, self.nc), 1) # 分割边界框和类别

dbox = dist2bbox(self.dfl(box), self.anchors.unsqueeze(0), xywh=True, dim=1) * self.strides # 转换为边界框

y = torch.cat((dbox, cls.sigmoid()), 1) # 拼接边界框和类别概率

return y # 返回最终输出

def bias_init(self):

"""初始化检测头的偏置,警告:需要步幅可用。"""

for a, b, s in zip(self.cv2, self.cv3, self.stride):

a[-1].bias.data[:] = 1.0 # 边界框偏置初始化

b[-1].bias.data[:self.nc] = math.log(5 / self.nc / (640 / s) ** 2) # 类别偏置初始化

代码核心部分说明

-

Detect_DyHead 类:

- 该类实现了YOLOv8的检测头,使用动态头(DyHead)来处理目标检测任务。

__init__方法中初始化了类别数量、隐藏层通道数、检测层数量等参数,并构建了卷积层和动态头块。forward方法负责处理输入数据,生成边界框和类别概率,并在训练和推理模式下有不同的返回值。

-

Detect_AFPN_P345 类:

- 该类实现了使用自适应特征金字塔网络(AFPN)的YOLOv8检测头。

- 结构与

Detect_DyHead类似,但使用了AFPN来处理输入特征。 forward方法同样负责处理输入,生成边界框和类别概率。

总结

这段代码的核心部分主要集中在目标检测头的实现上,包括如何通过卷积层和动态头或AFPN来处理输入特征,并生成最终的检测结果。每个类的设计都考虑了不同的网络结构和功能,以适应不同的检测需求。```

这个文件是YOLOv8模型中检测头(Detect Head)的实现,主要用于目标检测任务。文件中定义了多个类,每个类实现了不同的检测头,使用了不同的网络结构和模块。以下是对代码的逐部分分析。

首先,文件导入了一些必要的库和模块,包括数学库、PyTorch的神经网络模块以及自定义的卷积、DFL(Distribution Focal Loss)、C2f、RepConv、Proto等模块。这些模块构成了YOLOv8的基础。

接下来,定义了多个检测头类。Detect_DyHead类是YOLOv8的动态检测头,具有动态网格重建的能力。构造函数中,初始化了类别数、检测层数、最大回归通道数、输出数等参数,并定义了卷积层和动态头的结构。forward方法负责前向传播,计算预测的边界框和类别概率,并在训练和推理阶段有不同的处理逻辑。

Detect_DyHeadWithDCNV3类继承自Detect_DyHead,并使用了DCN(Deformable Convolutional Networks)模块,增强了模型的特征提取能力。

Detect_AFPN_P345和Detect_AFPN_P345_Custom类实现了使用自适应特征金字塔网络(AFPN)的检测头。AFPN通过自适应地融合不同层次的特征,提升了检测性能。构造函数中初始化了AFPN模块和卷积层,forward方法同样负责特征的处理和输出。

Detect_AFPN_P2345和Detect_AFPN_P2345_Custom类是AFPN的另一种变体,适用于不同的特征层组合。

Detect_Efficient类实现了高效的检测头,采用了更简化的结构,适合于对计算资源要求较高的场景。构造函数中定义了卷积层和其他必要的组件,forward方法处理输入特征并输出预测结果。

DetectAux类实现了带有辅助头的检测模型,主要用于多任务学习场景。它在主检测头的基础上增加了辅助输出,帮助提升模型的学习效果。

最后,Segment_Efficient类是YOLOv8的分割头,专门用于图像分割任务。它在检测头的基础上增加了处理掩码的能力,使用了原型网络来生成掩码原型,并在前向传播中返回掩码系数。

整体来看,这个文件实现了YOLOv8中多种检测头的结构,灵活地适应不同的检测和分割任务,利用了现代深度学习中的多种技术和模块,展示了YOLOv8在目标检测领域的强大能力。

```python

import math

import torch

from torch import Tensor, nn

class Attention(nn.Module):

"""注意力层,允许在投影到查询、键和值后对嵌入的大小进行下采样。"""

def __init__(self, embedding_dim: int, num_heads: int, downsample_rate: int = 1) -> None:

"""

初始化注意力模型,设置嵌入维度和头数。

Args:

embedding_dim (int): 输入嵌入的维度。

num_heads (int): 注意力头的数量。

downsample_rate (int, optional): 内部维度下采样的因子,默认为1。

"""

super().__init__()

self.embedding_dim = embedding_dim # 嵌入维度

self.internal_dim = embedding_dim // downsample_rate # 内部维度

self.num_heads = num_heads # 注意力头数量

assert self.internal_dim % num_heads == 0, "num_heads must divide embedding_dim." # 确保头数能整除内部维度

# 定义线性投影层

self.q_proj = nn.Linear(embedding_dim, self.internal_dim) # 查询的线性投影

self.k_proj = nn.Linear(embedding_dim, self.internal_dim) # 键的线性投影

self.v_proj = nn.Linear(embedding_dim, self.internal_dim) # 值的线性投影

self.out_proj = nn.Linear(self.internal_dim, embedding_dim) # 输出的线性投影

@staticmethod

def _separate_heads(x: Tensor, num_heads: int) -> Tensor:

"""将输入张量分离为指定数量的注意力头。"""

b, n, c = x.shape # b: 批量大小, n: 令牌数量, c: 通道数

x = x.reshape(b, n, num_heads, c // num_heads) # 重新调整形状以分离头

return x.transpose(1, 2) # B x N_heads x N_tokens x C_per_head

@staticmethod

def _recombine_heads(x: Tensor) -> Tensor:

"""将分离的注意力头重新组合为单个张量。"""

b, n_heads, n_tokens, c_per_head = x.shape # 获取形状信息

x = x.transpose(1, 2) # 转置以便重新组合

return x.reshape(b, n_tokens, n_heads * c_per_head) # B x N_tokens x C

def forward(self, q: Tensor, k: Tensor, v: Tensor) -> Tensor:

"""根据输入的查询、键和值张量计算注意力输出。"""

# 输入投影

q = self.q_proj(q) # 查询投影

k = self.k_proj(k) # 键投影

v = self.v_proj(v) # 值投影

# 分离为多个头

q = self._separate_heads(q, self.num_heads) # 分离查询

k = self._separate_heads(k, self.num_heads) # 分离键

v = self._separate_heads(v, self.num_heads) # 分离值

# 计算注意力

_, _, _, c_per_head = q.shape # 获取每个头的通道数

attn = q @ k.permute(0, 1, 3, 2) # 计算注意力得分

attn = attn / math.sqrt(c_per_head) # 缩放

attn = torch.softmax(attn, dim=-1) # 应用softmax以获得注意力权重

# 获取输出

out = attn @ v # 计算加权值

out = self._recombine_heads(out) # 重新组合头

return self.out_proj(out) # 通过输出投影层返回结果

代码说明

- Attention类:这是一个实现注意力机制的核心类。它允许对输入的查询、键和值进行线性投影,并计算注意力输出。

- 初始化方法:在初始化时设置嵌入维度、注意力头数量和下采样率,并定义线性投影层。

- _separate_heads方法:将输入张量分离为多个注意力头,以便进行并行计算。

- _recombine_heads方法:将分离的注意力头重新组合为一个张量,以便进行后续处理。

- forward方法:实现了注意力计算的核心逻辑,包括输入投影、注意力得分计算、加权值计算和输出投影。```

这个程序文件定义了一个名为TwoWayTransformer的神经网络模块,主要用于处理图像和查询点之间的注意力机制,适用于目标检测、图像分割和点云处理等任务。该模块的核心是一个双向变换器(Transformer),它可以同时关注输入图像和查询点。

在 TwoWayTransformer 类的构造函数中,定义了一些关键参数,包括变换器的层数(depth)、输入嵌入的通道维度(embedding_dim)、多头注意力的头数(num_heads)、MLP块的内部通道维度(mlp_dim)等。构造函数还创建了多个 TwoWayAttentionBlock 层,这些层负责处理查询和键之间的注意力机制。

forward 方法是该模块的前向传播函数,接收图像嵌入、图像的位置信息编码和查询点的嵌入作为输入。首先,它将图像嵌入和位置信息编码展平并调整维度,以便后续处理。然后,准备查询和键,依次通过所有的注意力层进行处理。最后,应用一个最终的注意力层,将查询点的注意力输出与图像嵌入结合,并进行层归一化。

TwoWayAttentionBlock 类实现了一个注意力块,包含自注意力和交叉注意力机制。该块由四个主要部分组成:对稀疏输入的自注意力、稀疏输入对密集输入的交叉注意力、稀疏输入的MLP块以及密集输入对稀疏输入的交叉注意力。每个部分后面都有层归一化,以帮助稳定训练过程。

Attention 类实现了一个注意力层,允许在投影到查询、键和值之后对嵌入的大小进行下采样。该类的构造函数中定义了输入嵌入的维度、注意力头的数量以及下采样率。它还包含了输入投影的线性层,以及分离和重组合注意力头的静态方法。

整体来看,这个文件实现了一个复杂的双向变换器结构,能够有效地处理图像和查询点之间的交互,适用于多种计算机视觉任务。通过模块化的设计,便于在不同的上下文中复用和扩展。

import sys

import subprocess

def run_script(script_path):

"""

使用当前 Python 环境运行指定的脚本。

Args:

script_path (str): 要运行的脚本路径

Returns:

None

"""

# 获取当前 Python 解释器的路径

python_path = sys.executable

# 构建运行命令

command = f'"{python_path}" -m streamlit run "{script_path}"'

# 执行命令

result = subprocess.run(command, shell=True)

if result.returncode != 0:

print("脚本运行出错。")

# 实例化并运行应用

if __name__ == "__main__":

# 指定您的脚本路径

script_path = "web.py" # 这里直接指定脚本路径

# 运行脚本

run_script(script_path)

代码注释说明:

-

导入模块:

import sys:导入sys模块,用于访问与 Python 解释器紧密相关的变量和函数。import subprocess:导入subprocess模块,用于执行外部命令。

-

定义

run_script函数:- 该函数接受一个参数

script_path,表示要运行的 Python 脚本的路径。 - 函数内部首先获取当前 Python 解释器的路径,存储在

python_path变量中。 - 然后构建一个命令字符串

command,该命令使用streamlit模块运行指定的脚本。 - 使用

subprocess.run方法执行构建的命令,并将shell参数设置为True,以便在 shell 中运行命令。 - 如果命令执行返回的状态码不为 0,表示脚本运行出错,打印错误信息。

- 该函数接受一个参数

-

主程序入口:

if __name__ == "__main__":语句确保当脚本作为主程序运行时,以下代码块会被执行。- 指定要运行的脚本路径为

web.py。 - 调用

run_script函数,传入脚本路径以执行该脚本。```

这个程序文件名为ui.py,其主要功能是通过当前的 Python 环境运行一个指定的脚本,具体是使用 Streamlit 来启动一个 Web 应用。

首先,程序导入了必要的模块,包括 sys、os 和 subprocess。sys 模块用于访问与 Python 解释器相关的变量和函数,os 模块提供了与操作系统交互的功能,而 subprocess 模块则用于创建新进程、连接到它们的输入/输出/错误管道,并获取它们的返回码。

接下来,程序定义了一个名为 run_script 的函数,该函数接受一个参数 script_path,表示要运行的脚本的路径。在函数内部,首先获取当前 Python 解释器的路径,使用 sys.executable 来实现。然后,构建一个命令字符串,该命令使用当前的 Python 解释器来运行指定的脚本,并通过 Streamlit 的 run 命令来启动 Web 应用。

使用 subprocess.run 方法执行构建好的命令,并通过 shell=True 参数允许在 shell 中执行该命令。执行后,程序检查返回码,如果返回码不为零,表示脚本运行出错,则打印出相应的错误信息。

在文件的最后部分,使用 if __name__ == "__main__": 语句来确保当该文件作为主程序运行时,以下代码才会被执行。此处指定了要运行的脚本路径为 web.py,并调用 run_script 函数来执行该脚本。

总的来说,这个程序的主要目的是方便地通过当前 Python 环境来启动一个 Streamlit Web 应用,确保用户能够轻松地运行指定的脚本。

```python

class DetectionTrainer(BaseTrainer):

"""

DetectionTrainer类,继承自BaseTrainer类,用于基于检测模型的训练。

"""

def build_dataset(self, img_path, mode="train", batch=None):

"""

构建YOLO数据集。

参数:

img_path (str): 包含图像的文件夹路径。

mode (str): 模式,可以是'train'或'val',用户可以为每种模式自定义不同的数据增强。

batch (int, optional): 批次大小,仅用于'rect'模式。默认为None。

"""

gs = max(int(de_parallel(self.model).stride.max() if self.model else 0), 32)

return build_yolo_dataset(self.args, img_path, batch, self.data, mode=mode, rect=mode == "val", stride=gs)

def get_dataloader(self, dataset_path, batch_size=16, rank=0, mode="train"):

"""构造并返回数据加载器。"""

assert mode in ["train", "val"] # 确保模式是'train'或'val'

with torch_distributed_zero_first(rank): # 在分布式训练中,确保数据集只初始化一次

dataset = self.build_dataset(dataset_path, mode, batch_size) # 构建数据集

shuffle = mode == "train" # 训练模式下打乱数据

if getattr(dataset, "rect", False) and shuffle:

LOGGER.warning("WARNING ⚠️ 'rect=True'与DataLoader的shuffle不兼容,设置shuffle=False")

shuffle = False

workers = self.args.workers if mode == "train" else self.args.workers * 2 # 根据模式设置工作线程数

return build_dataloader(dataset, batch_size, workers, shuffle, rank) # 返回数据加载器

def preprocess_batch(self, batch):

"""对一批图像进行预处理,包括缩放和转换为浮点数。"""

batch["img"] = batch["img"].to(self.device, non_blocking=True).float() / 255 # 将图像转换为浮点数并归一化

if self.args.multi_scale: # 如果启用多尺度训练

imgs = batch["img"]

sz = (

random.randrange(self.args.imgsz * 0.5, self.args.imgsz * 1.5 + self.stride)

// self.stride

* self.stride

) # 随机选择一个新的尺寸

sf = sz / max(imgs.shape[2:]) # 计算缩放因子

if sf != 1: # 如果缩放因子不为1

ns = [

math.ceil(x * sf / self.stride) * self.stride for x in imgs.shape[2:]

] # 计算新的形状

imgs = nn.functional.interpolate(imgs, size=ns, mode="bilinear", align_corners=False) # 进行插值缩放

batch["img"] = imgs # 更新批次中的图像

return batch

def set_model_attributes(self):

"""设置模型的属性,包括类别数量和名称。"""

self.model.nc = self.data["nc"] # 将类别数量附加到模型

self.model.names = self.data["names"] # 将类别名称附加到模型

self.model.args = self.args # 将超参数附加到模型

def get_model(self, cfg=None, weights=None, verbose=True):

"""返回一个YOLO检测模型。"""

model = DetectionModel(cfg, nc=self.data["nc"], verbose=verbose and RANK == -1) # 创建检测模型

if weights:

model.load(weights) # 加载预训练权重

return model

def get_validator(self):

"""返回用于YOLO模型验证的DetectionValidator。"""

self.loss_names = "box_loss", "cls_loss", "dfl_loss" # 定义损失名称

return yolo.detect.DetectionValidator(

self.test_loader, save_dir=self.save_dir, args=copy(self.args), _callbacks=self.callbacks

)

def plot_training_samples(self, batch, ni):

"""绘制带有注释的训练样本。"""

plot_images(

images=batch["img"],

batch_idx=batch["batch_idx"],

cls=batch["cls"].squeeze(-1),

bboxes=batch["bboxes"],

paths=batch["im_file"],

fname=self.save_dir / f"train_batch{ni}.jpg",

on_plot=self.on_plot,

)

def plot_metrics(self):

"""从CSV文件中绘制指标。"""

plot_results(file=self.csv, on_plot=self.on_plot) # 保存结果图像

代码核心部分说明:

- DetectionTrainer类:用于处理YOLO模型的训练过程,继承自BaseTrainer。

- build_dataset方法:构建YOLO数据集,支持训练和验证模式。

- get_dataloader方法:创建数据加载器,处理数据集的初始化和数据打乱。

- preprocess_batch方法:对输入图像进行预处理,包括归一化和多尺度调整。

- set_model_attributes方法:设置模型的类别数量和名称等属性。

- get_model方法:返回YOLO检测模型,并可选择加载预训练权重。

- get_validator方法:返回用于模型验证的验证器。

- plot_training_samples和plot_metrics方法:用于可视化训练样本和训练指标。```

这个程序文件train.py是一个用于训练目标检测模型的脚本,基于Ultralytics的YOLO(You Only Look Once)架构。它主要定义了一个名为DetectionTrainer的类,该类继承自BaseTrainer,用于处理YOLO模型的训练过程。

在文件的开头,导入了一些必要的库和模块,包括数学运算、随机数生成、深度学习相关的PyTorch模块,以及Ultralytics库中的一些功能模块,如数据加载、模型构建和可视化工具。

DetectionTrainer 类中包含多个方法,首先是 build_dataset 方法,它用于构建YOLO数据集。该方法接收图像路径、模式(训练或验证)和批量大小作为参数,使用 build_yolo_dataset 函数来创建数据集,支持不同模式下的增强操作。

接下来是 get_dataloader 方法,该方法构建并返回数据加载器。它会根据传入的模式(训练或验证)来初始化数据集,并设置是否打乱数据的顺序。对于训练模式,数据会被打乱,而在验证模式下则不会。

preprocess_batch 方法用于对图像批次进行预处理,包括缩放和转换为浮点数格式。它还支持多尺度训练,通过随机选择图像大小来增强模型的鲁棒性。

set_model_attributes 方法用于设置模型的属性,包括类别数量和类别名称。这些信息是从数据集中提取的,并附加到模型上,以便在训练过程中使用。

get_model 方法返回一个YOLO检测模型,并可以加载预训练的权重。这个方法确保模型配置与数据集的类别数量一致。

get_validator 方法返回一个用于模型验证的 DetectionValidator 实例,帮助评估模型在验证集上的表现。

label_loss_items 方法用于返回一个包含训练损失项的字典,便于在训练过程中监控模型的表现。

progress_string 方法生成一个格式化的字符串,用于显示训练进度,包括当前的epoch、GPU内存使用情况、损失值、实例数量和图像大小。

plot_training_samples 方法用于绘制训练样本及其标注,便于可视化训练过程中的数据。

最后,plot_metrics 和 plot_training_labels 方法用于绘制训练过程中的指标和标签,帮助用户分析模型的训练效果。

总体而言,这个脚本为YOLO模型的训练提供了全面的支持,包括数据处理、模型构建、训练监控和结果可视化等功能。

```python

# 导入必要的模块和类

from .model import FastSAM # 导入FastSAM模型类

from .predict import FastSAMPredictor # 导入FastSAMPredictor类,用于进行预测

from .prompt import FastSAMPrompt # 导入FastSAMPrompt类,用于处理提示信息

from .val import FastSAMValidator # 导入FastSAMValidator类,用于验证模型性能

# 定义模块的公开接口,包含可以被外部访问的类

__all__ = "FastSAMPredictor", "FastSAM", "FastSAMPrompt", "FastSAMValidator"

代码注释说明:

-

导入模块:

from .model import FastSAM:从当前包的model模块中导入FastSAM类,该类可能是实现YOLO模型的核心部分。from .predict import FastSAMPredictor:从predict模块中导入FastSAMPredictor类,该类负责对输入数据进行预测。from .prompt import FastSAMPrompt:从prompt模块中导入FastSAMPrompt类,该类可能用于处理用户输入的提示信息。from .val import FastSAMValidator:从val模块中导入FastSAMValidator类,该类用于验证模型的性能和准确性。

-

定义公开接口:

__all__:这是一个特殊变量,用于定义模块的公开接口。它指定了当使用from module import *时,哪些类会被导入。这里列出了四个类:FastSAMPredictor、FastSAM、FastSAMPrompt和FastSAMValidator,这些类是该模块的核心功能部分。```

这个程序文件是一个Python模块的初始化文件,通常用于定义模块的公共接口。在这个文件中,首先有一个注释,提到这是与Ultralytics YOLO相关的代码,并且使用的是AGPL-3.0许可证。接下来,文件通过相对导入的方式引入了四个类或函数:FastSAM、FastSAMPredictor、FastSAMPrompt和FastSAMValidator。这些类或函数分别来自于同一目录下的不同文件。

FastSAM可能是一个核心模型类,负责实现FastSAM算法的主要功能。FastSAMPredictor则可能是一个用于进行预测的类,利用FastSAM模型来处理输入数据并生成预测结果。FastSAMPrompt可能涉及到与用户交互的功能,比如接受用户输入或提示,而FastSAMValidator则可能用于验证模型的性能或输出结果。

最后,__all__变量定义了模块的公共接口,只有在使用from module import *时,这些名称才会被导入。这种做法有助于控制模块的可见性,避免不必要的名称冲突或混淆。在这里,__all__包含了四个类的名称,表明它们是该模块对外提供的主要功能。

```python

import numpy as np

import torch

class BaseTensor:

"""基础张量类,提供对数据的基本操作和设备管理功能。"""

def __init__(self, data, orig_shape) -> None:

"""

初始化 BaseTensor。

参数:

data (torch.Tensor | np.ndarray): 预测结果,例如边界框、掩码和关键点。

orig_shape (tuple): 原始图像的形状。

"""

assert isinstance(data, (torch.Tensor, np.ndarray)) # 确保数据是张量或数组

self.data = data # 存储数据

self.orig_shape = orig_shape # 存储原始形状

@property

def shape(self):

"""返回数据张量的形状。"""

return self.data.shape

def cpu(self):

"""返回在CPU内存上的数据副本。"""

return self if isinstance(self.data, np.ndarray) else self.__class__(self.data.cpu(), self.orig_shape)

def numpy(self):

"""返回数据的numpy数组副本。"""

return self if isinstance(self.data, np.ndarray) else self.__class__(self.data.numpy(), self.orig_shape)

def cuda(self):

"""返回在GPU内存上的数据副本。"""

return self.__class__(torch.as_tensor(self.data).cuda(), self.orig_shape)

def __len__(self):

"""返回数据张量的长度。"""

return len(self.data)

def __getitem__(self, idx):

"""返回指定索引的数据副本。"""

return self.__class__(self.data[idx], self.orig_shape)

class Results:

"""存储和操作推理结果的类。"""

def __init__(self, orig_img, path, names, boxes=None, masks=None, probs=None, keypoints=None) -> None:

"""初始化 Results 类。"""

self.orig_img = orig_img # 原始图像

self.orig_shape = orig_img.shape[:2] # 原始图像的形状

self.boxes = Boxes(boxes, self.orig_shape) if boxes is not None else None # 边界框

self.masks = Masks(masks, self.orig_shape) if masks is not None else None # 掩码

self.probs = Probs(probs) if probs is not None else None # 概率

self.keypoints = Keypoints(keypoints, self.orig_shape) if keypoints is not None else None # 关键点

self.names = names # 类别名称

self.path = path # 图像文件路径

def __getitem__(self, idx):

"""返回指定索引的 Results 对象。"""

return self._apply('__getitem__', idx)

def __len__(self):

"""返回检测结果的数量。"""

for k in ['boxes', 'masks', 'probs', 'keypoints']:

v = getattr(self, k)

if v is not None:

return len(v)

def _apply(self, fn, *args, **kwargs):

"""对所有非空属性应用指定函数,并返回修改后的新 Results 对象。"""

r = self.new()

for k in ['boxes', 'masks', 'probs', 'keypoints']:

v = getattr(self, k)

if v is not None:

setattr(r, k, getattr(v, fn)(*args, **kwargs))

return r

def cpu(self):

"""返回在CPU内存上的Results对象副本。"""

return self._apply('cpu')

def numpy(self):

"""返回数据的numpy数组副本。"""

return self._apply('numpy')

def cuda(self):

"""返回在GPU内存上的Results对象副本。"""

return self._apply('cuda')

def new(self):

"""返回一个新的 Results 对象,具有相同的图像、路径和名称。"""

return Results(orig_img=self.orig_img, path=self.path, names=self.names)

class Boxes(BaseTensor):

"""存储和操作检测框的类。"""

def __init__(self, boxes, orig_shape) -> None:

"""初始化 Boxes 类。"""

if boxes.ndim == 1:

boxes = boxes[None, :] # 如果是1D数组,转换为2D

super().__init__(boxes, orig_shape) # 调用父类构造函数

@property

def xyxy(self):

"""返回边界框的xyxy格式。"""

return self.data[:, :4]

@property

def conf(self):

"""返回边界框的置信度值。"""

return self.data[:, -2]

@property

def cls(self):

"""返回边界框的类别值。"""

return self.data[:, -1]

class Masks(BaseTensor):

"""存储和操作检测掩码的类。"""

def __init__(self, masks, orig_shape) -> None:

"""初始化 Masks 类。"""

if masks.ndim == 2:

masks = masks[None, :] # 如果是2D数组,转换为3D

super().__init__(masks, orig_shape) # 调用父类构造函数

@property

def xyn(self):

"""返回归一化的掩码段。"""

return [self.data[i] / self.orig_shape for i in range(self.data.shape[0])]

class Keypoints(BaseTensor):

"""存储和操作检测关键点的类。"""

def __init__(self, keypoints, orig_shape) -> None:

"""初始化 Keypoints 类。"""

if keypoints.ndim == 2:

keypoints = keypoints[None, :] # 如果是2D数组,转换为3D

super().__init__(keypoints, orig_shape) # 调用父类构造函数

@property

def xy(self):

"""返回关键点的x, y坐标。"""

return self.data[..., :2]

@property

def xyn(self):

"""返回归一化的关键点坐标。"""

return self.xy / self.orig_shape

class Probs(BaseTensor):

"""存储和操作分类预测的类。"""

def __init__(self, probs, orig_shape=None) -> None:

"""初始化 Probs 类。"""

super().__init__(probs, orig_shape) # 调用父类构造函数

@property

def top1(self):

"""返回最高置信度类别的索引。"""

return int(self.data.argmax())

@property

def top5(self):

"""返回前五个类别的索引。"""

return (-self.data).argsort(0)[:5].tolist() # 返回前五个类别的索引

代码说明:

-

BaseTensor: 这是一个基础类,提供了对张量数据的基本操作,包括在不同设备(CPU/GPU)之间的转换,以及获取数据的形状和长度等功能。

-

Results: 这个类用于存储推理结果,包括原始图像、边界框、掩码、概率和关键点等。它提供了对这些结果的访问和更新方法。

-

Boxes: 该类专门用于处理检测到的边界框,提供了获取边界框坐标、置信度和类别等属性的方法。

-

Masks: 该类用于处理检测到的掩码,提供了获取掩码的归一化坐标的方法。

-

Keypoints: 该类用于处理检测到的关键点,提供了获取关键点坐标和归一化坐标的方法。

-

Probs: 该类用于处理分类预测结果,提供了获取最高置信度类别及其索引的方法。```

该程序文件是Ultralytics YOLO(You Only Look Once)模型的一个重要组成部分,主要用于处理推理结果,包括目标检测、分割和关键点检测等功能。文件中定义了多个类,分别用于管理不同类型的推理结果,如边界框、掩码、关键点和分类概率。

首先,BaseTensor类是一个基础类,提供了一些用于处理张量的通用方法,如在CPU和GPU之间转换、获取张量的形状等。它接受数据和原始图像的形状作为输入,确保可以在不同设备上进行操作。

接下来,Results类用于存储和操作推理结果。它包含原始图像、路径、类别名称、边界框、掩码、概率和关键点等信息。该类提供了多种方法来更新、转换和可视化结果,包括返回结果的数量、更新边界框和掩码、将结果绘制到图像上等。

Boxes类专门用于处理检测到的边界框。它提供了获取边界框坐标、置信度、类别和跟踪ID等信息的方法,并支持将边界框转换为不同的格式(如xyxy和xywh)。

Masks类用于处理分割掩码,提供了获取掩码的像素坐标和归一化坐标的方法。它将掩码转换为可用于后续处理的格式。

Keypoints类用于处理关键点检测结果,提供了获取关键点坐标和置信度的方法,并支持将坐标归一化。

最后,Probs类用于处理分类概率,提供了获取最高置信度类别及其置信度的方法。

整体而言,该文件通过定义多个类,系统地管理YOLO模型的推理结果,使得后续的处理和可视化变得更加方便和高效。通过这些类,用户可以轻松地获取检测结果、进行可视化以及保存结果等操作。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式👇🏻

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)