【前瞻创想】Kurator:集成业界精华的分布式云原生实战派,一键构建跨云-跨边-弹性的云原生舰队

【前瞻创想】Kurator:集成业界精华的分布式云原生实战派,一键构建跨云-跨边-弹性的云原生舰队

【前瞻创想】Kurator:集成业界精华的分布式云原生实战派,一键构建跨云-跨边-弹性的云原生舰队

一家电商企业的运维团队负责人从未想过,管理分散在三大洲的七个Kubernetes集群,从过去的每周手动部署、数小时故障排查,到现在只需一次声明式配置和15分钟全自动发布,效率提升的秘密就藏在Kurator的舰队管理中。

摘要:在多云混合云成为企业IT新常态的今天,分布式云原生环境的管理复杂性急剧上升。Kurator,作为一款开源的分布式云原生套件,通过创新性地集成 Karmada、Istio、KubeEdge等业界顶尖项目,并引入 “舰队(Fleet)” 这一核心抽象,提供了一站式的多集群统一管理体验。它不仅解决了应用分发、流量治理和监控观测的割裂问题,更通过声明式API和 “基础设施即代码” 的理念,将分布式云原生的门槛降至新低。本文将从架构解读、深度实践和未来展望三个维度,深入剖析Kurator如何成为“云原生实战派”的利器,并分享对分布式云原生技术发展的前瞻思考。

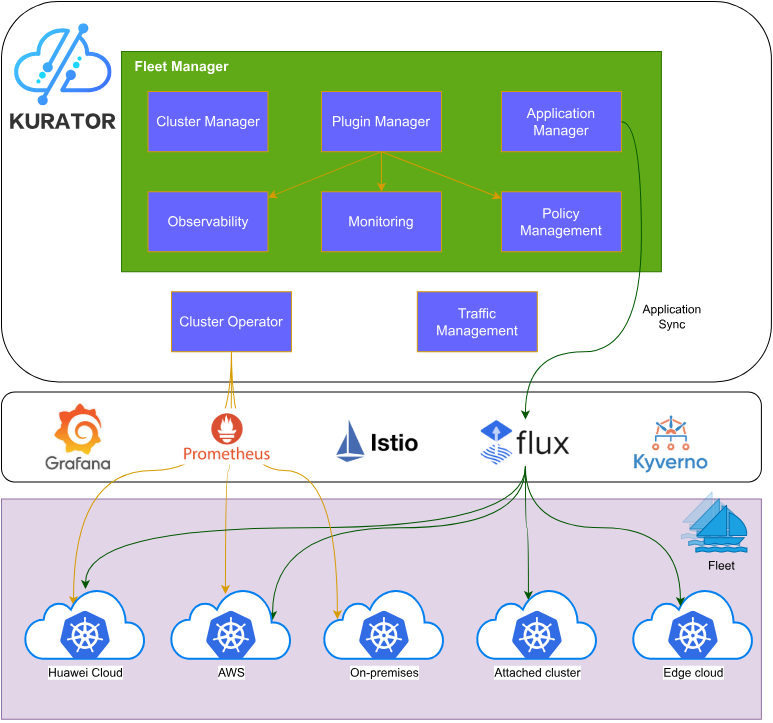

01 集成之道:站在巨人肩膀上的架构哲学

Kurator的设计智慧在于其并非从零造轮子,而是扮演了一位卓越的“策展人”角色,精心挑选并有机融合了云原生生态系统中最成熟、最强大的开源组件。

这种集成不是简单的堆砌,而是通过统一的控制平面和声明式API,为用户提供了一个连贯、一致的管理界面。

它构建了一个完整的技术矩阵,覆盖了从基础设施到应用观测的整个生命周期。

核心集成技术栈全景如下:

| 能力维度 | 集成项目 | 在 Kurator 中的角色与价值 |

|---|---|---|

| 多集群编排 | Karmada | 实现跨集群的应用分发与资源调度,是“舰队”能力的基石。 |

| 服务网格 | Istio | 提供跨集群、跨网络的统一流量治理、安全与可观测性。 |

| 监控观测 | Prometheus + Thanos | 构建全局统一的监控体系,聚合所有集群的指标数据。 |

| 边缘计算 | KubeEdge | 将云原生能力无缝延伸至边缘侧,管理海量边缘节点和设备。 |

| 批量计算 | Volcano | 为AI、大数据等批处理作业提供先进的集群调度能力。 |

| 策略治理 | Kyverno | 确保多集群环境下的安全合规,实施统一策略。 |

| GitOps引擎 | FluxCD | 驱动声明式、自动化的统一应用分发与持续交付。 |

通过上表的整合,Kurator 将原本需要深厚专业知识才能打通的复杂技术栈,转化为开箱即用的标准化产品能力。

用户无需再关心各个组件间复杂的兼容性、配置与对接问题,从而能聚焦于业务逻辑本身。

02 核心创新:Fleet抽象与统一应用分发

Kurator 最具革命性的创新是引入了 “舰队(Fleet)” 的概念。一个舰队是一个逻辑上的集群组,它可以包含任何地点、任何供应商提供的Kubernetes集群,包括由Kurator自己创建的、在公有云上已有的,甚至是本地数据中心的集群。

“舰队”的核心理念是将一组物理上分散的集群,抽象为一个逻辑上统一的资源池和管理单元。

这种抽象带来了三大关键特性的统一:身份相同性、命名空间相同性和服务相同性。

这意味着,在同一个舰队内,服务账户、命名空间和服务可以被自动同步和识别,极大地简化了跨集群的服务发现与通信。

基于 Fleet 的抽象,Kurator 实现了强大的统一应用分发功能。

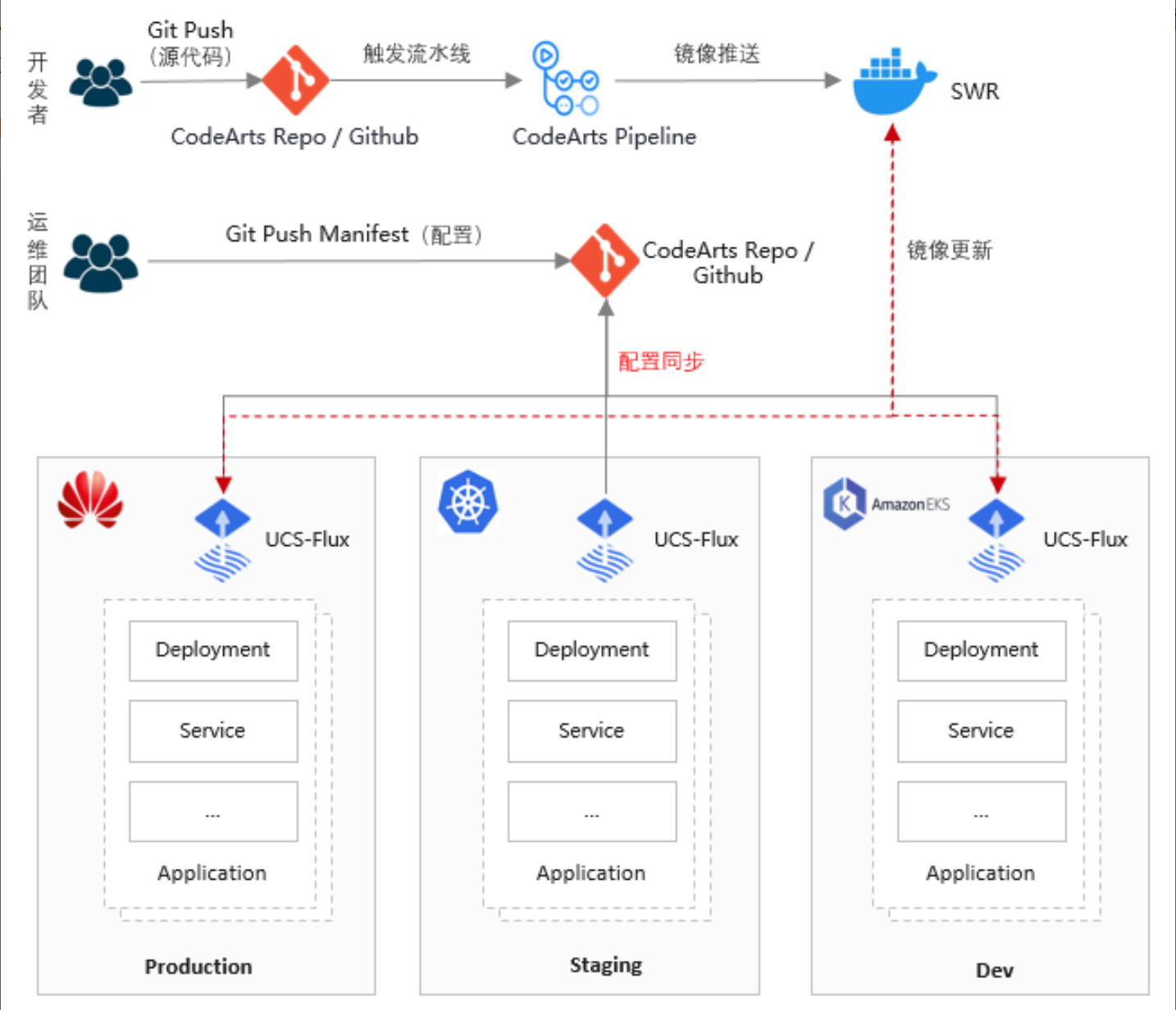

它采用 GitOps 范式,将应用的期望状态定义在 Git 仓库中,通过集成 FluxCD,自动将应用同步和部署到舰队内的指定集群。

GitOps实现方式如图所示:

用户只需要定义一个如下的 Application 资源,即可完成从代码到多集群部署的全流程:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: my-app

spec:

source:

gitRepository:

url: https://github.com/my-org/my-app

branch: main

syncPolicies:

- destination:

fleet: production-fleet

kustomization:

path: ./deploy/overlays/prod

这套机制从根本上解决了多云场景下配置繁琐、版本不一致和部署状态管理困难等痛点。

03 实战起点:十分钟完成Kurator基础环境搭建

理论需要实践来验证。让我们从零开始,搭建一个最小化的 Kurator 环境,作为后续所有深度实践的基石。

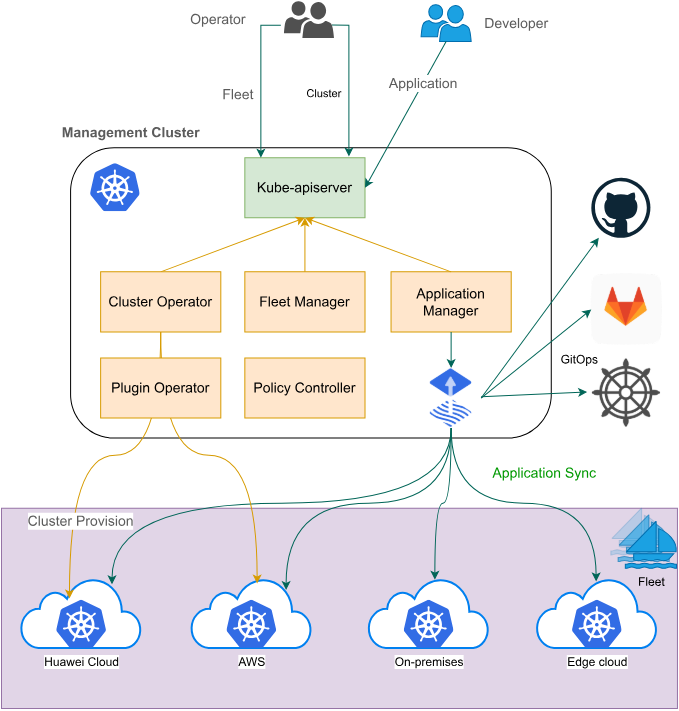

整个过程围绕一个宿主集群(Host Cluster) 展开,它既是 Kurator 控制平面的安装地,也是管理整个舰队的“大脑”。

第一步,获取 Kurator 源代码或安装 CLI 工具。

最直接的方式是克隆其官方仓库以获取最新代码和示例:git clone https://github.com/kurator-dev/kurator.git。

gitCode的源码文件

我们可以拉取下来

git clone https://github.com/kurator-dev/kurator.git

源码文件如下,接下来就可以使用了

也可以选择下载预编译的 CLI 工具,方便后续操作。

第二步,准备一个 Kubernetes 集群作为宿主集群。

可以使用 Kind、Minikube 快速创建一个本地开发集群,也可以使用现有的云上ACK、EKS等集群。确保 kubectl 能够正常访问该集群。

第三步,在宿主集群上安装 Kurator 控制平面。

进入克隆的仓库目录,或使用 CLI 工具执行安装命令。基础安装通常只需一条命令,例如 kurator install。

安装程序会自动部署 Fleet Manager、Karmada 控制面等核心组件。

第四步,处理常见的安装问题。

安装时可能会遇到 CRD(自定义资源定义)未就绪 导致的错误,只需等待片刻或手动检查 kubectl get crd 状态后重试即可。

如果集群已存在其他网络插件,可能需要在安装时指定网络配置以避免冲突,例如 --set global.network.cni=calico。

环境就绪后,你可以通过 kubectl get pods -n kurator-system 查看核心组件的运行状态,开启你的舰队管理之旅。

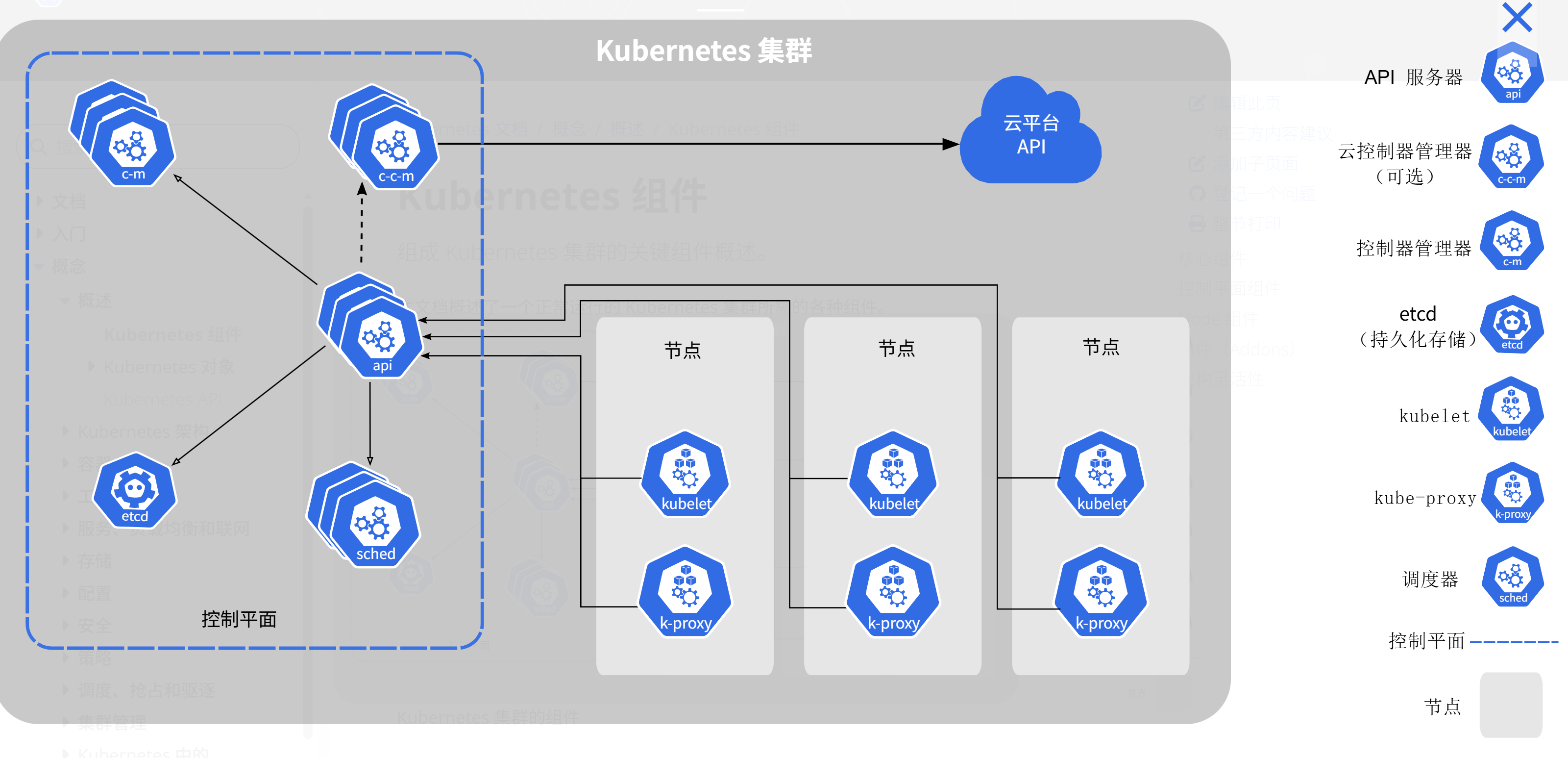

04 集群纳管:从边缘到中心的全面融合

Kubernetes集群结构图:

环境搭建完成后,下一步是将各个业务集群纳入 Kurator 的管辖范围。Kurator 在此展现了极大的灵活性,支持多种集群类型,其中最关键的是 AttachedCluster。

AttachedCluster 的设计初衷是为了管理那些 并非由 Kurator 创建,但需要被统一管理的现有 Kubernetes 集群。

无论是公有云上的托管集群、企业内部私有化部署的集群,还是边缘侧的 KubeEdge 集群,都可以通过 AttachedCluster 资源轻松接入。

这使得企业已有的 IT 投资能够得到充分尊重和利用,实现平滑演进而非颠覆式重建。

创建一个 AttachedCluster 资源非常简单,核心是提供目标集群的访问凭证(kubeconfig):

apiVersion: cluster.kurator.dev/v1alpha1

kind: AttachedCluster

metadata:

name: my-existing-cluster

spec:

kubeconfig:

secretRef:

name: my-cluster-kubeconfig-secret

将集群接入舰队的操作则更为直观。你只需要在 Fleet 资源的 spec.clusters 列表中,加入该 AttachedCluster 的引用即可。

一个实战案例中,用户通过编写简单的 Shell 脚本循环,成功将 30个位于树莓派上的 KubeEdge 边缘集群 批量接入到一个舰队中,并统一打上了地理位置标签。

这种能力对于管理大规模、异构的分布式基础设施具有不可估量的价值。

05 深度实践:基于GitOps与渐进式的发布体系

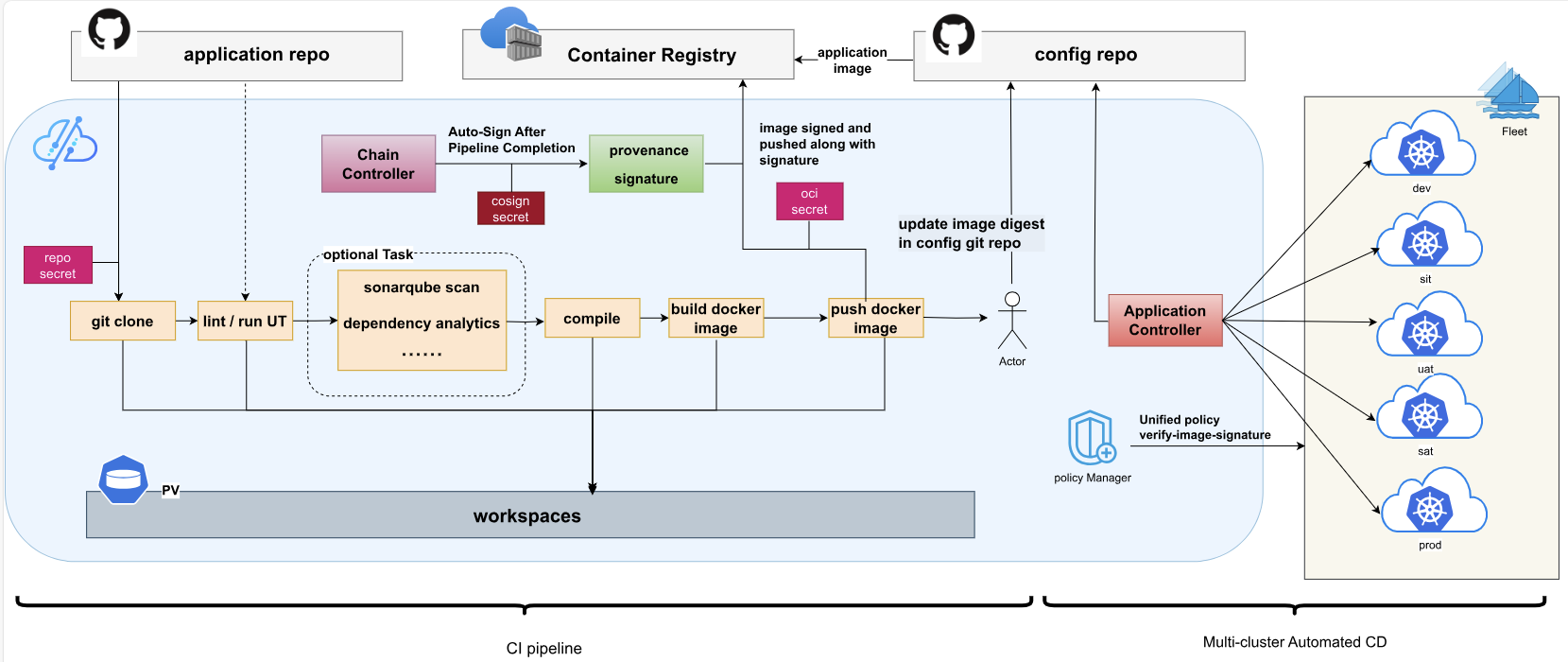

Kurator CI/CD 的结构如图所示:

当舰队组建完毕,真正的威力体现在应用的部署与发布上。Kurator v0.6.0 版本的重大增强,便是将统一的CI/CD流水线与渐进式发布策略深度集成,实现了从源码到生产发布的完整 GitOps 工作流。

Kurator CI/CD 流水线 通过预置常用的任务模板(如代码克隆、静态检查、单元测试、镜像构建推送等),极大地简化了流水线的创建。

用户无需从零开始编写复杂的 Tekton Task,只需在 Pipeline 定义中引用任务名称,大大降低了学习和使用门槛。同时,它也支持自定义任务以满足特定需求。

更值得关注的是其渐进式发布能力,它直接集成在统一应用分发功能中,支持三种高级发布策略:

- 金丝雀发布:将新版本应用先部署到少数副本或特定集群,通过监控关键指标(如请求成功率、延迟)逐步扩大流量比例,实现风险可控的平滑升级。

- A/B测试:基于 HTTP 头部、Cookie 等规则将用户流量导向不同版本的应用,用于对比测试不同功能特性的用户转化率或体验效果。

- 蓝绿发布:同时维护“蓝”(旧)和“绿”(新)两套完整环境,通过一次性切换全部流量实现零停机发布与快速回滚。

这些策略都可以通过声明式 API 进行配置。例如,一个金丝雀发布的配置会指定目标 Deployment、用于验证的健康指标(如 request-success-rate > 99%)、以及每次流量递增的步长(如 10%)。

06 核心支撑:统一流量治理与全局可观测性

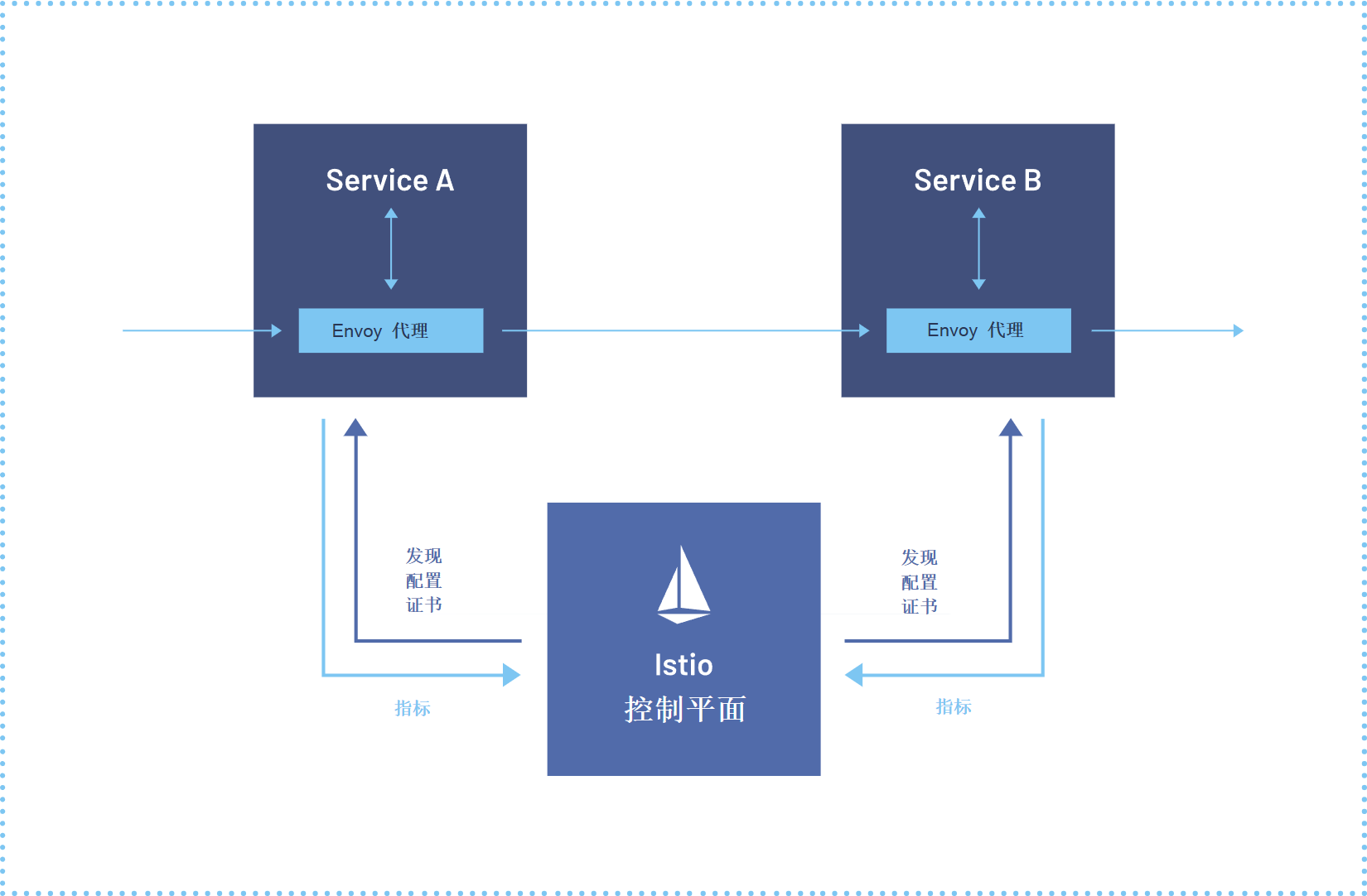

lstio服务网格如图所示:

应用分发之后,确保跨集群服务的可靠通信和全局可视性至关重要。Kurator 通过集成 Istio 和 Prometheus+Thanos,提供了企业级的解决方案。

在统一流量治理方面,Kurator 简化了多集群服务网格的部署。

它支持 Istio 的 多主模式 部署,自动为舰队中的集群配置控制平面与工作平面之间的证书签发与发现机制。

用户无需手动处理复杂的跨网络 mTLS 配置,即可实现跨云、跨数据中心的安全、加密的服务通信。

在一个跨越公网延迟达150毫秒的实战场景中,Kurator 管理的 Istio 在实现双向加密的同时,仅增加了2毫秒的延迟,几乎实现了安全性的“零损耗”。

统一监控(可观测性) 是另一个亮点。Kurator 为舰队中的每个集群自动部署 Prometheus 实例和 Thanos Sidecar。

所有集群的监控数据通过 Sidecar 上传到中心化的对象存储,并由 Thanos Query 组件提供全局统一的查询入口。

最终,运维人员可以在一个 Grafana 看板上,毫无感知地查询和展示来自云端、本地和边缘数十个集群的监控指标,实现真正的全局一张图。

这种设计将原本需要大量人工集成的监控体系,变成了舰队的一个可插拔插件,只需在 Fleet 配置中启用即可。

07 未来创想:分布式云原生的发展方向与Kurator的进化

基于当前的技术演进和社区实践,分布式云原生技术正朝着场景化、智能化和泛在化方向发展。Kurator 作为该领域的集成创新者,其未来进化路径也清晰可见。

其一,深度拥抱场景化解决方案。

未来的 Kurator 可能会推出针对 边缘AI、全球应用分发、多云灾备 等特定场景的“一键部署”最佳实践包或模板。

例如,针对边缘AI场景,深度优化 KubeEdge 与 Volcano 的集成,实现训练任务在云、推理任务在边的自动协同与资源调度。

其二,赋能智能化运维。

当前的调度和策略管理虽已自动化,但仍有优化空间。结合机器学习,Kurator 未来可能实现预测性伸缩、成本感知调度和智能故障定位。

调度器不仅能感知当前资源状态,还能预测业务负载趋势,并综合考虑不同云服务商的资费标准,实现成本和性能的最优平衡。

其三,构建更强大的生态互联。

作为平台,Kurator 将继续深化与上下游生态的集成,例如与更多的 GitOps 工具链(如 ArgoCD)、DevOps 平台、云服务商市场服务无缝对接,让用户在一个平台内完成更多工作。

08 总结:从集成到赋能,Kurator的实战派价值

回顾全文,Kurator 的成功并非源于某个单一技术的突破,而在于其精准的定位和卓越的集成能力。

它敏锐地捕捉到企业在多云时代最迫切的痛点——管理的碎片化与复杂性——并通过“舰队”这一巧妙的抽象,将业界经过验证的最佳实践组合成一个连贯、易用的整体。

对于运维团队,Kurator 是效率倍增器,它将跨集群的重复性操作转化为声明式配置和自动化流程。

对于开发团队,Kurator 是能力使能器,它将过去难以企及的多集群灰度发布、全局流量治理等高级特性变得触手可及。

对于企业决策者,Kurator 是风险缓解器和成本优化器,它通过标准化和自动化提升系统稳定性与合规性,同时通过更优的资源调度降低整体云支出。

正如一位实践者所评价:“Kurator 不是又一个‘多集群仪表盘’,而是把 Karmada、KubeEdge、Istio 的‘三把剑’焊成一把瑞士军刀。”

它降低的是分布式云原生的整体拥有成本和技术门槛,让更多企业能够专注于业务创新,而非底层基础设施的泥潭。

随着社区的不断发展和功能的持续丰富,Kurator 正稳步朝着成为分布式云原生领域事实标准的方向迈进,引领云原生技术从单点突破走向全局协同的新纪元。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)