【探索实战】Kurator分布式云原生平台:从环境搭建到高级流量治理的全栈实践

【探索实战】Kurator分布式云原生平台:从环境搭建到高级流量治理的全栈实践

【探索实战】Kurator分布式云原生平台:从环境搭建到高级流量治理的全栈实践

摘要

在数字化转型浪潮中,企业对云原生基础设施的需求已从单一集群管理演进至跨云、跨地域、跨边缘的分布式架构。Kurator作为一款开源的分布式云原生平台,凭借其统一的资源编排、调度、流量管理和监控能力,为企业构建自有的分布式云原生基础设施提供了强大支撑。本文从实战角度出发,详细剖析Kurator的核心架构与关键功能,通过环境搭建、Fleet集群管理、Karmada集成和高级流量治理等实践案例,深入探讨如何利用Kurator构建高可用、高弹性的分布式云原生平台,并分享在实际应用中的深度思考与优化经验。

一、Kurator概述与核心价值

云原生分布式基础设施的演进

随着企业业务全球化布局和边缘计算场景的兴起,单一云厂商或单一集群架构已无法满足业务需求。分布式云原生平台需要同时解决多云环境下的资源统一管理、应用无缝迁移、流量智能调度等核心问题。Kurator立足于这一背景,通过整合Kubernetes、Istio、Karmada、KubeEdge等成熟云原生组件,构建了完整的分布式云原生解决方案。

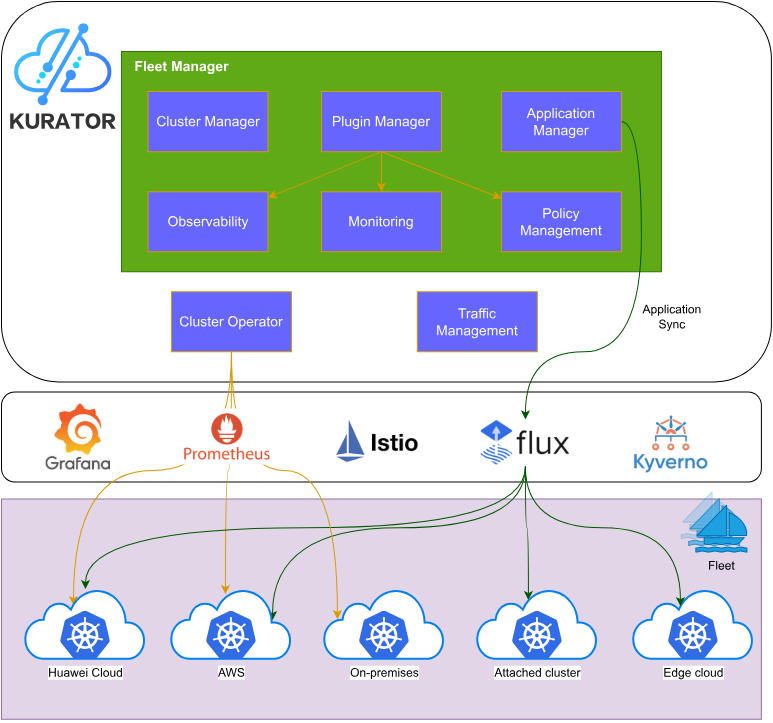

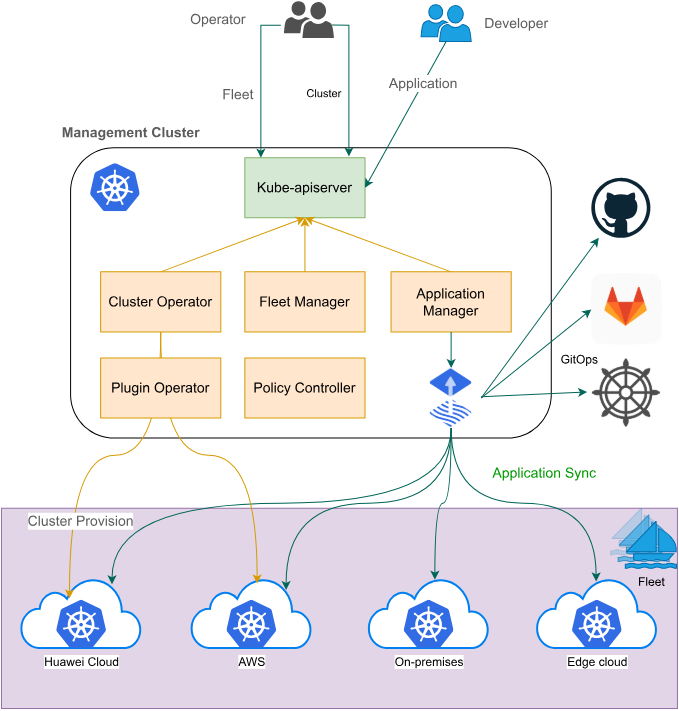

Kurator架构全景图

Kurator采用分层架构设计,底层以Kubernetes为统一调度基座,中间层集成了Karmada负责跨集群调度、FluxCD实现GitOps、Istio提供服务网格能力,上层通过Fleet抽象实现集群联邦管理。这种架构既保证了各组件的专业能力,又通过统一API实现了无缝集成,为用户提供一致的操作体验。

与传统云原生平台的差异化优势

相比传统云原生平台,Kurator在多云协同方面具有显著优势:统一资源编排消除了不同云环境的差异性;统一流量管理实现了跨集群的服务发现与调用;统一策略管理确保了安全合规的一致性;基础设施即代码的理念则大幅提升了运维效率。这些特性使Kurator成为企业构建分布式云原生基础设施的理想选择。

二、Kurator环境搭建与基础配置

基础环境准备与依赖

在开始搭建Kurator环境前,需要准备以下基础组件:至少两个Kubernetes集群(可使用Kind或Minikube创建)、kubectl 1.23+、Helm 3.8+、Docker 20.10+。网络环境需确保各集群间能够通过Service IP或NodePort互相访问,同时具备访问GitHub和Docker Hub的权限。

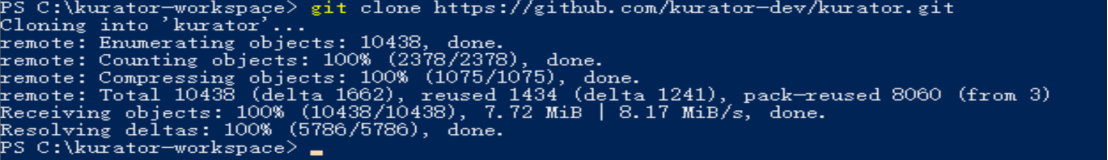

从源码构建Kurator平台

# 克隆Kurator源码仓库

git clone https://github.com/kurator-dev/kurator.git

cd kurator

# 安装Kurator CLI工具

make build

sudo mv ./bin/kurator /usr/local/bin/

# 验证安装

kurator version

在构建过程中,可能会遇到Go依赖问题,可通过设置GOPROXY解决:

export GOPROXY=https://goproxy.cn,direct

make build

结果如下:

多集群环境初始化与验证

完成Kurator安装后,需要初始化一个多集群环境。这里我们使用Kind创建两个测试集群:

# 创建成员集群配置

cat <<EOF > member-cluster.yaml

kind: Cluster

apiVersion: cluster.kurator.dev/v1alpha1

meta

name: member-cluster-1

spec:

kubeconfigSecret: member-cluster-1-kubeconfig

---

kind: Cluster

apiVersion: cluster.kurator.dev/v1alpha1

meta

name: member-cluster-2

spec:

kubeconfigSecret: member-cluster-2-kubeconfig

EOF

# 应用配置

kubectl apply -f member-cluster.yaml

# 验证集群注册状态

kurator get clusters

在初始化过程中,常见的问题包括kubeconfig权限不足、网络策略限制等。解决这些问题需要仔细检查RBAC配置和网络安全组设置,确保Kurator控制平面能够正常访问各成员集群的API Server。

三、Fleet集群管理架构深度解析

Fleet概念与生命周期管理

Fleet是Kurator的核心抽象,代表一组逻辑上相关的Kubernetes集群集合。通过Fleet,管理员可以统一管理多个集群的资源、策略和应用。Fleet的生命周期包括创建、注册集群、配置同步策略、监控状态和最终注销等环节。

# Fleet定义示例

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

meta

name: production-fleet

spec:

clusters:

- member-cluster-1

- member-cluster-2

syncPolicy:

namespace: kurator-system

serviceAccount: fleet-controller

跨集群资源同步机制

Kurator通过Fleet实现了跨集群资源同步,包括命名空间、ServiceAccount、ConfigMap等基础资源。这种同步不是简单的复制,而是考虑了各集群的特性和上下文,确保资源在不同环境中的一致性。

# 跨集群资源同步策略

apiVersion: fleet.kurator.dev/v1alpha1

kind: ClusterResourceSync

meta

name: global-config-sync

spec:

fleet: production-fleet

resources:

- apiVersion: v1

kind: ConfigMap

name: global-config

namespace: default

syncMode: bidirectional # 支持unidirectional, bidirectional

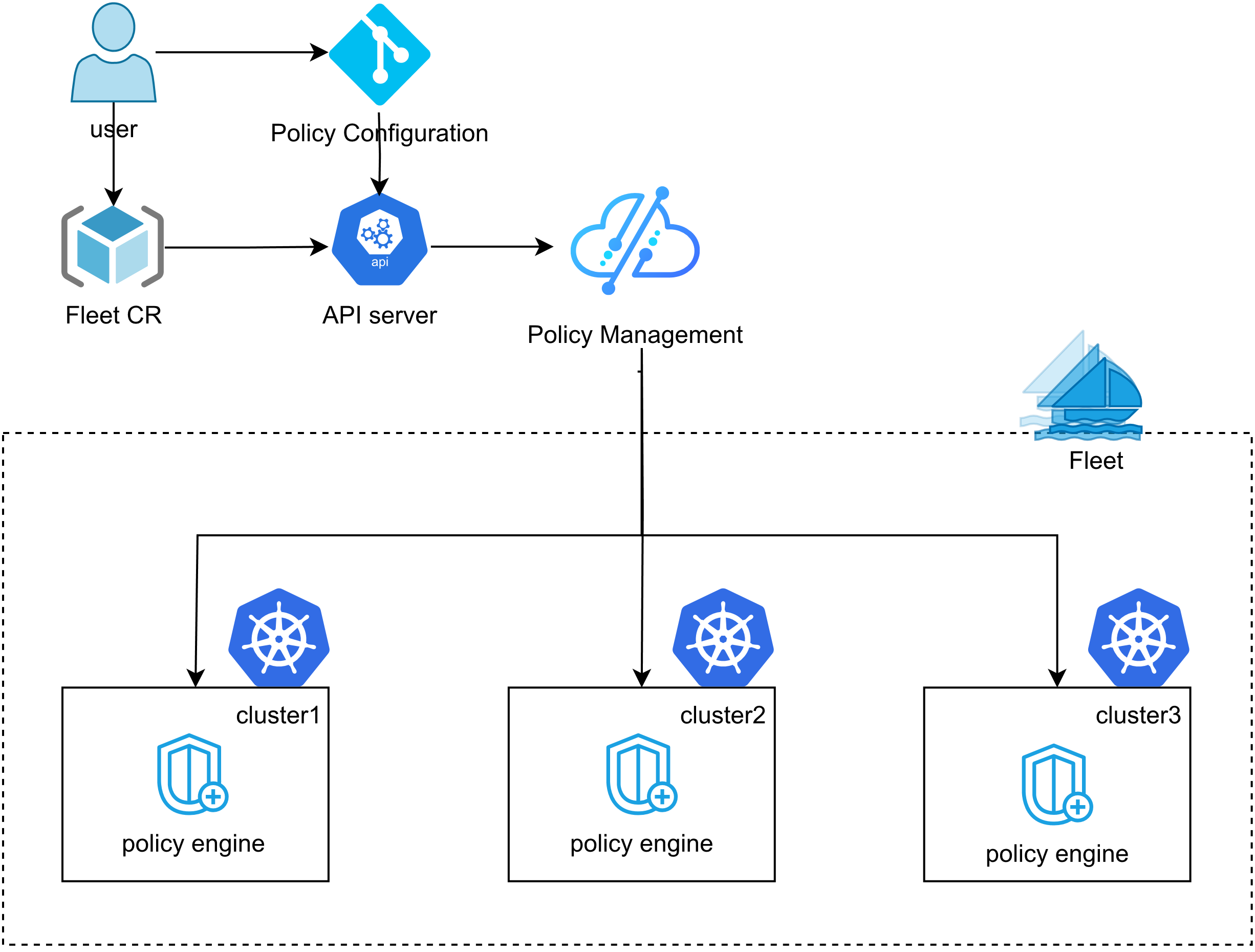

集群策略统一治理实践

在多集群环境中,保持策略一致性是关键挑战。Kurator集成了Kyverno等策略引擎,通过Fleet实现了跨集群的策略统一管理。例如,可以定义一个统一的安全策略,确保所有集群都符合最小权限原则:

apiVersion: policies.kurator.dev/v1alpha1

kind: ClusterPolicy

meta

name: security-baseline

spec:

fleet: production-fleet

policy:

validationFailureAction: enforce

rules:

- name: require-requests-limits

match:

resources:

kinds:

- Pod

validate:

message: "CPU and memory requests and limits are required"

pattern:

spec:

containers:

- resources:

requests:

memory: "?*"

cpu: "?*"

limits:

memory: "?*"

cpu: "?*"

这种策略治理方式不仅提高了安全性,还简化了多集群环境下的合规性管理,减少了人为错误风险。

四、Karmada集成与跨集群调度实践

Karmada与Kurator集成架构

Karmada作为CNCF的多集群调度项目,在Kurator中扮演着跨集群工作负载调度的核心角色。Kurator通过抽象层将Karmada的能力无缝集成,使用户无需直接操作Karmada API即可享受其强大的调度功能。集成架构中,Kurator负责集群注册和资源发现,Karmada负责具体调度决策,两者通过CRD实现数据同步。

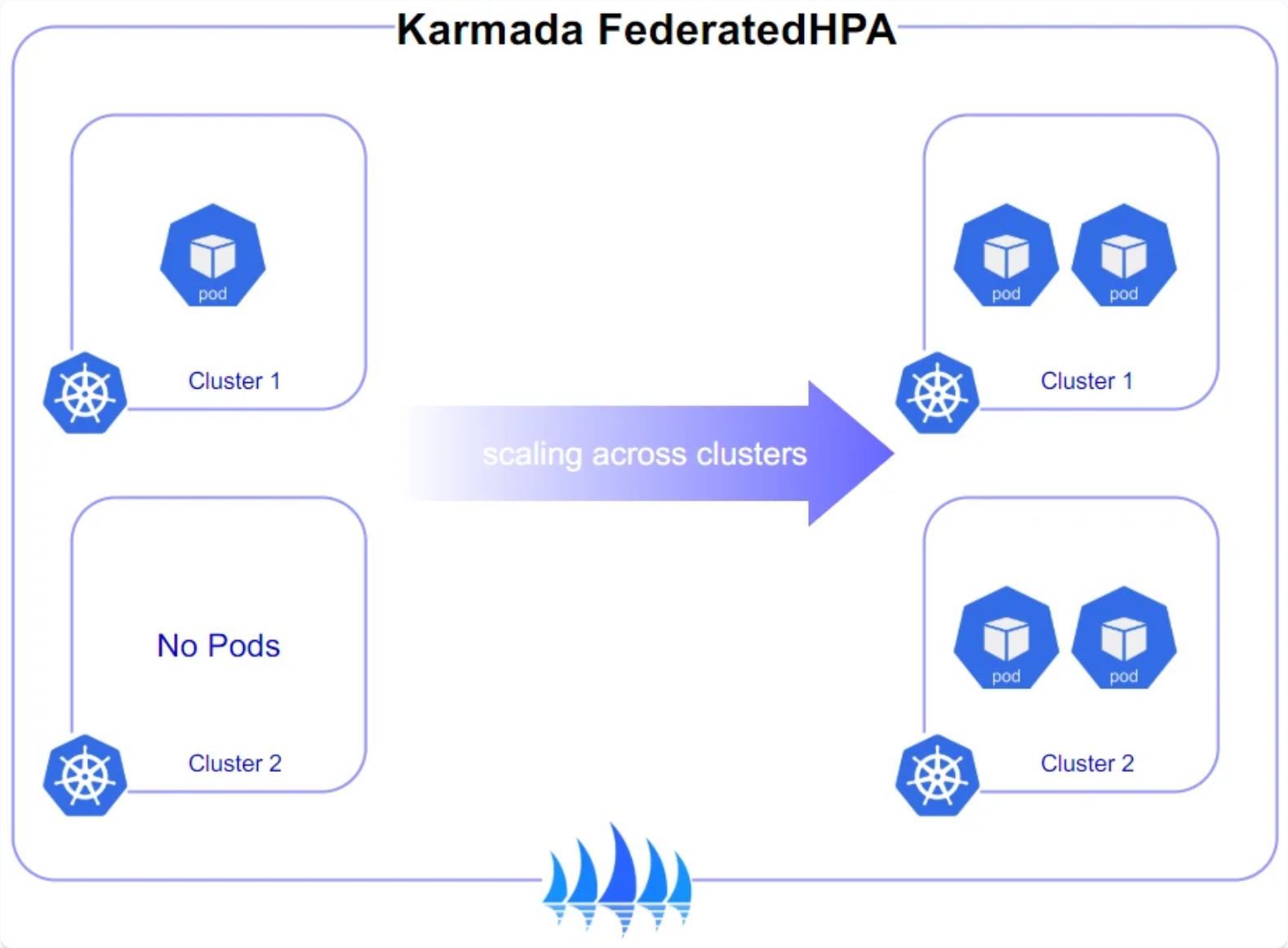

跨集群弹性伸缩配置

在分布式环境中,单一集群可能面临资源不足或区域性故障,跨集群弹性伸缩成为保障服务高可用的关键。Kurator结合Karmada实现了智能的跨集群HPA(Horizontal Pod Autoscaler):

apiVersion: autoscaling.kurator.dev/v1alpha1

kind: FederatedHPA

metadata:

name: frontend-hpa

spec:

fleet: production-fleet

target:

apiVersion: apps/v1

kind: Deployment

name: frontend

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 50

minReplicas: 3

maxReplicas: 20

spreadConstraints:

- maxGroups: 2

topologyKey: topology.kubernetes.io/region

该配置不仅定义了传统的CPU利用率指标,还通过spreadConstraints确保Pod在不同地域的集群间合理分布,提高了系统的整体弹性。

统一调度策略优化

在实际生产环境中,简单的负载均衡策略往往不足以应对复杂的业务需求。Kurator提供了丰富的调度策略配置选项,包括基于延迟的调度、基于成本的调度以及混合调度策略。以下是一个基于延迟的调度策略示例:

apiVersion: scheduling.kurator.dev/v1alpha1

kind: ClusterSchedulingPolicy

meta

name: latency-aware-scheduling

spec:

fleet: production-fleet

strategy: latency-based

latencyProfile:

targetService: frontend

maxAcceptableLatency: 50ms

measurementInterval: 5m

fallbackStrategy: weighted-replica

weights:

member-cluster-1: 0.6

member-cluster-2: 0.4

这种策略会动态测量各集群到目标服务的网络延迟,并根据延迟数据调整工作负载分布。当所有集群的延迟都超过阈值时,会回退到加权副本策略,确保服务质量不会因过度调度而下降。

五、统一流量治理:金丝雀与蓝绿发布实战

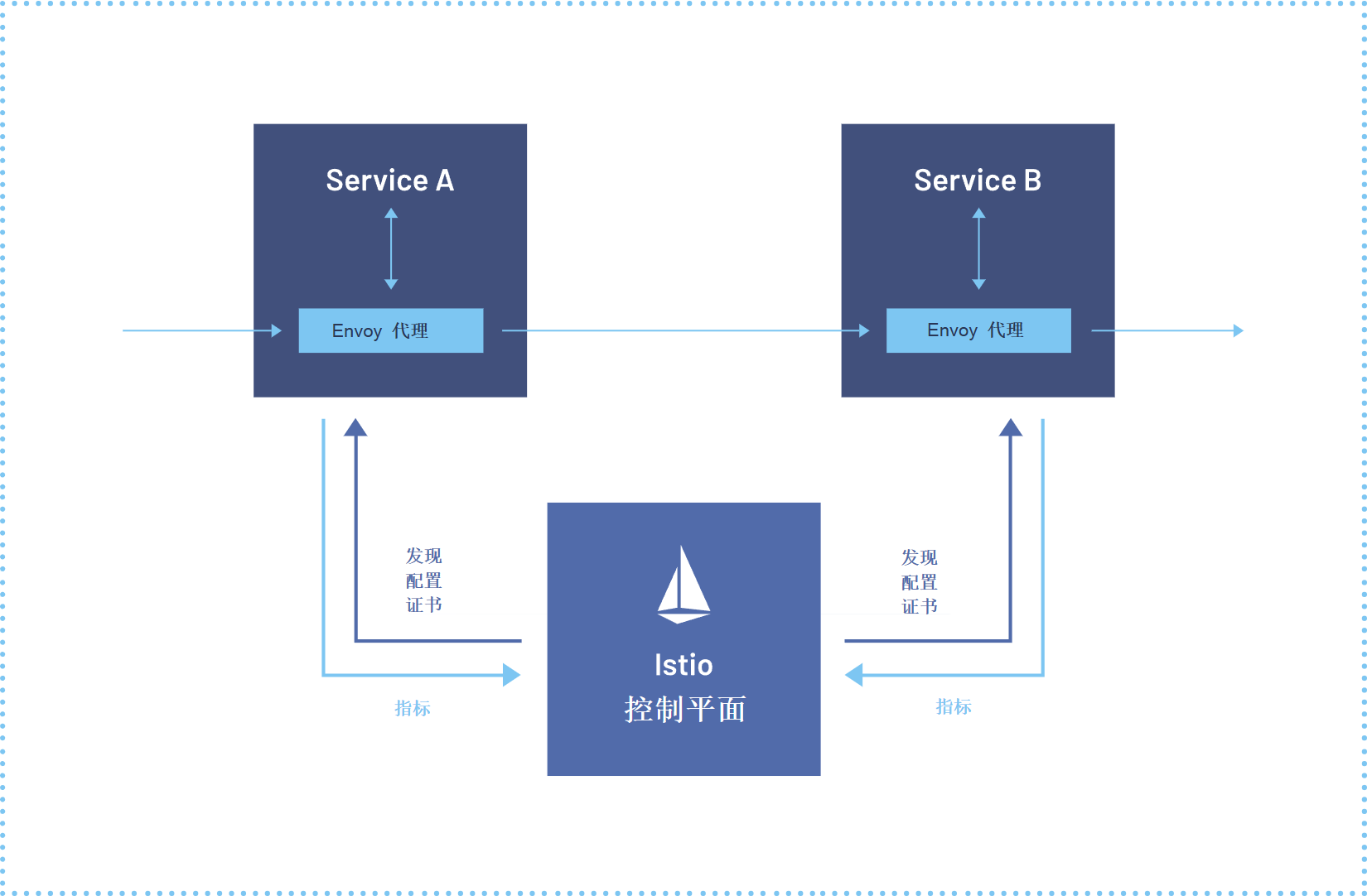

基于Istio的流量管理架构

Kurator集成了Istio作为其服务网格组件,为跨集群流量管理提供了强大支持。在Kurator架构中,Istio控制平面部署在中央集群,数据平面分布在各成员集群中。通过Kurator的抽象层,用户可以定义统一的流量策略,而无需关心底层Istio的具体配置细节。

金丝雀发布配置与验证

金丝雀发布是渐进式交付的关键策略,Kurator简化了这一过程。以下是一个典型的金丝雀发布配置,将10%的流量导向新版本:

apiVersion: traffic.kurator.dev/v1alpha1

kind: CanaryRelease

meta

name: frontend-canary

spec:

fleet: production-fleet

target:

service: frontend

namespace: default

versions:

- name: v1

weight: 90

image: frontend:v1.0

- name: v2

weight: 10

image: frontend:v2.0

analysis:

metrics:

- name: error-rate

threshold: 0.5%

interval: 5m

autoPromote: true

promoteCondition:

consecutiveSuccessfulAnalysis: 3

该配置不仅定义了流量分配策略,还集成了自动分析和升级机制。当新版本的错误率连续3次低于0.5%时,系统会自动将流量权重逐步调整至100%,完成无缝升级。

蓝绿发布策略实现

相比金丝雀发布,蓝绿发布提供了更彻底的环境隔离。Kurator通过服务切分和流量切换实现蓝绿发布:

apiVersion: traffic.kurator.dev/v1alpha1

kind: BlueGreenRelease

meta

name: payment-service-release

spec:

fleet: production-fleet

service: payment-service

namespace: financial

blue:

image: payment-service:v1.0

replicas: 5

green:

image: payment-service:v2.0

replicas: 5

testEndpoints:

- path: /health

method: GET

- path: /api/transaction

method: POST

payload: '{"amount": 100}'

verificationStrategy:

type: automated

successCriteria:

- metric: success-rate

threshold: 99.5%

duration: 10m

switchStrategy:

type: immediate # 或 gradual

gradualSchedule:

- after: 5m

percentage: 25

- after: 10m

percentage: 50

- after: 15m

percentage: 100

这种配置允许在切换前对新版本进行全面验证,确保其在各种业务场景下的稳定性。渐进式切换策略则进一步降低了风险,使运维团队能够在问题出现时快速回滚。

A/B测试场景应用

除了发布策略,Kurator还支持复杂的A/B测试场景,允许基于用户特征进行精细化流量分配:

apiVersion: traffic.kurator.dev/v1alpha1

kind: ABTesting

meta

name: recommendation-abtest

spec:

fleet: production-fleet

service: recommendation-engine

namespace: user-facing

variants:

- name: algorithm-v1

weight: 50

image: recommendation:v1

matchRules:

- header: x-user-region

exact: asia

- name: algorithm-v2

weight: 50

image: recommendation:v2

matchRules:

- header: x-user-region

exact: europe

metricsCollection:

- name: click-through-rate

query: sum(rate(http_requests_total{path="/recommendation",status="200"}[5m])) by (variant)

- name: conversion-rate

query: sum(rate(order_completed_total[5m])) by (variant)

evaluationPeriod: 24h

winnerCriteria: max-conversion-rate

该配置实现了基于用户地域的A/B测试,同时收集关键业务指标用于效果评估。24小时后,系统会自动选择转化率最高的算法版本作为胜出者,并调整流量分配,实现数据驱动的产品优化。

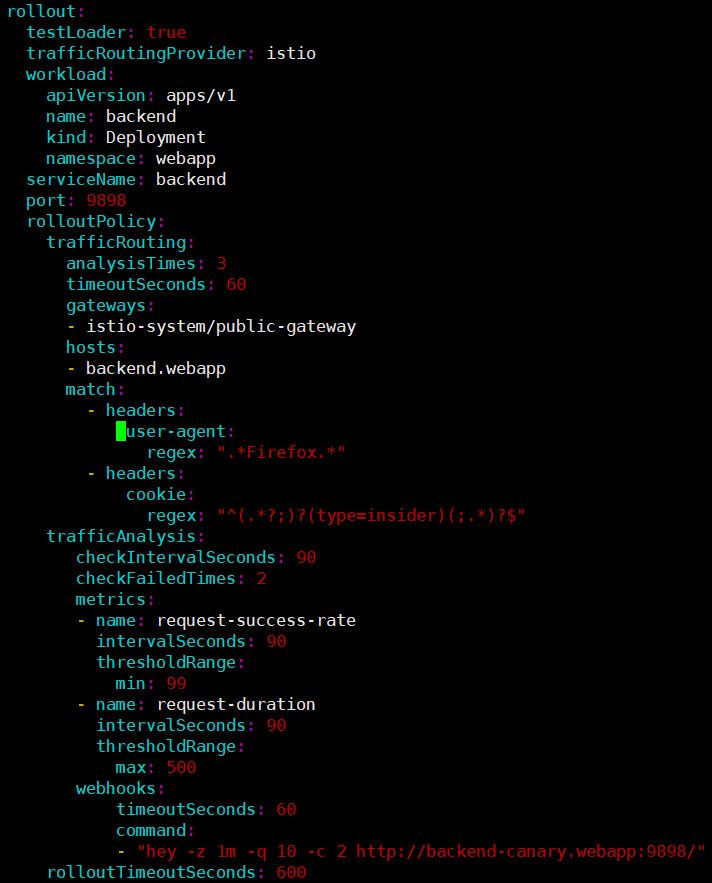

Kurator配置应用的A/B测试如图所示:

六、GitOps实现与CI/CD流水线构建

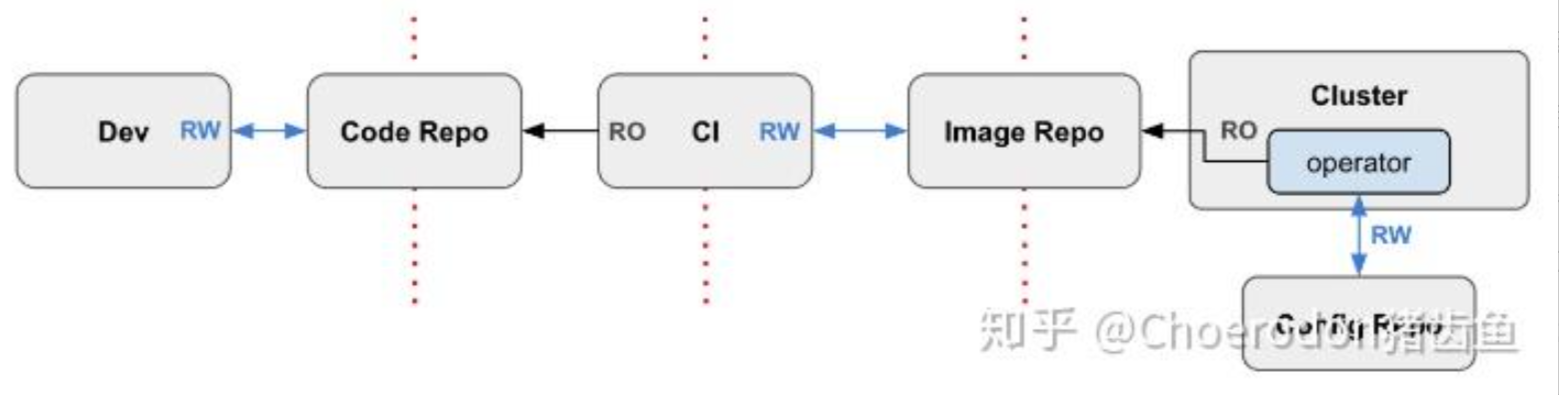

FluxCD集成与GitOps工作流

Kurator深度集成了FluxCD,实现了完整的GitOps工作流。在这一架构中,Git仓库作为唯一真实源,所有环境配置和应用定义都通过声明式方式存储在Git中。Kurator通过Fleet同步机制,确保多集群环境与Git仓库状态保持一致。

# GitRepository定义

apiVersion: source.toolkit.fluxcd.io/v1beta2

kind: GitRepository

meta

name: app-repo

namespace: flux-system

spec:

url: https://github.com/company/application-config

ref:

branch: main

interval: 1m

secretRef:

name: git-auth

# Kustomization定义

apiVersion: kustomize.toolkit.fluxcd.io/v1beta2

kind: Kustomization

meta

name: app-kustomization

namespace: flux-system

spec:

targetNamespace: default

sourceRef:

kind: GitRepository

name: app-repo

path: "./clusters/production"

prune: true

validation: client

interval: 5m

retryInterval: 1m

timeout: 2m

这种配置确保了应用配置的变更能够自动同步到目标集群,同时通过prune选项自动清理已删除的资源,保持环境整洁。

应用分发与版本控制

在多集群环境中,应用分发需要考虑不同环境的差异性。Kurator通过环境覆盖(Environment Overrides)机制,实现了基础配置与环境特定配置的分离:

# 基础应用定义

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

meta

name: user-service

spec:

source:

repoURL: https://github.com/company/user-service

path: k8s/base

targetRevision: HEAD

destinations:

- fleet: production-fleet

namespace: user-system

syncPolicy:

automated:

prune: true

selfHeal: true

syncOptions:

- CreateNamespace=true

- Validate=true

# 环境覆盖配置

apiVersion: apps.kurator.dev/v1alpha1

kind: EnvironmentOverride

metadata:

name: user-service-production

spec:

application: user-service

destination:

fleet: production-fleet

components:

- name: deployment

patch:

apiVersion: apps/v1

kind: Deployment

metadata:

name: user-service

spec:

replicas: 5

template:

spec:

containers:

- name: user-service

resources:

requests:

memory: 512Mi

cpu: 200m

limits:

memory: 1Gi

cpu: 500m

这种模式使团队能够在保持核心配置一致性的同时,灵活调整各环境的特定参数,如副本数量、资源限制和环境变量等。

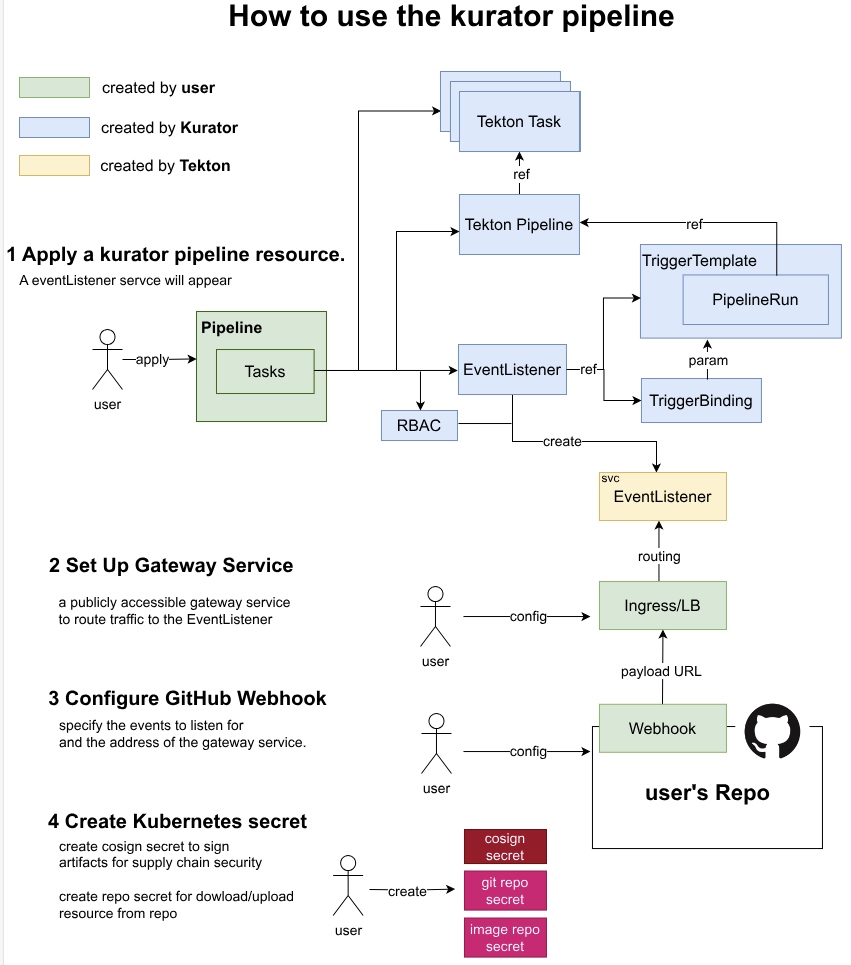

自动化流水线设计

Kurator支持与主流CI系统(如Jenkins、GitHub Actions、GitLab CI)集成,构建端到端的自动化流水线。以下是一个GitHub Actions工作流示例,展示如何在代码变更后自动构建镜像并更新GitOps仓库:

name: User Service CI/CD Pipeline

on:

push:

branches: [ main ]

paths:

- 'user-service/**'

pull_request:

branches: [ main ]

jobs:

build-and-test:

runs-on: ubuntu-latest

steps:

- name: Checkout

uses: actions/checkout@v3

- name: Set up Docker Buildx

uses: docker/setup-buildx-action@v2

- name: Login to Container Registry

uses: docker/login-action@v2

with:

registry: ghcr.io

username: ${{ github.actor }}

password: ${{ secrets.GITHUB_TOKEN }}

- name: Build and push

uses: docker/build-push-action@v3

with:

context: ./user-service

push: true

tags: ghcr.io/company/user-service:${{ github.sha }}

cache-from: type=gha

cache-to: type=gha,mode=max

- name: Run tests

run: |

cd user-service

docker build -t user-service-test .

docker run --rm user-service-test npm test

update-gitops:

needs: build-and-test

runs-on: ubuntu-latest

if: github.ref == 'refs/heads/main'

steps:

- name: Checkout GitOps repo

uses: actions/checkout@v3

with:

repository: company/gitops-config

token: ${{ secrets.GITOPS_PAT }}

- name: Update image tag

run: |

yq e '.spec.templates[0].spec.containers[0].image = "ghcr.io/company/user-service:${{ github.sha }}"' -i clusters/production/user-service/deployment.yaml

- name: Create PR

uses: peter-evans/create-pull-request@v4

with:

token: ${{ secrets.GITOPS_PAT }}

commit-message: "Update user-service to ${{ github.sha }}"

branch: update/user-service-${{ github.sha }}

title: "Update user-service to ${{ github.sha }}"

body: |

Automated update from CI pipeline

Commit: ${{ github.sha }}

Build URL: ${{ github.server_url }}/${{ github.repository }}/actions/runs/${{ github.run_id }}

reviewers: devops-team

这种设计实现了从代码提交到生产部署的完整自动化,同时通过Pull Request机制保留了人工审核环节,平衡了自动化与安全控制的需求。

七、监控与排障:网络连通性与性能优化

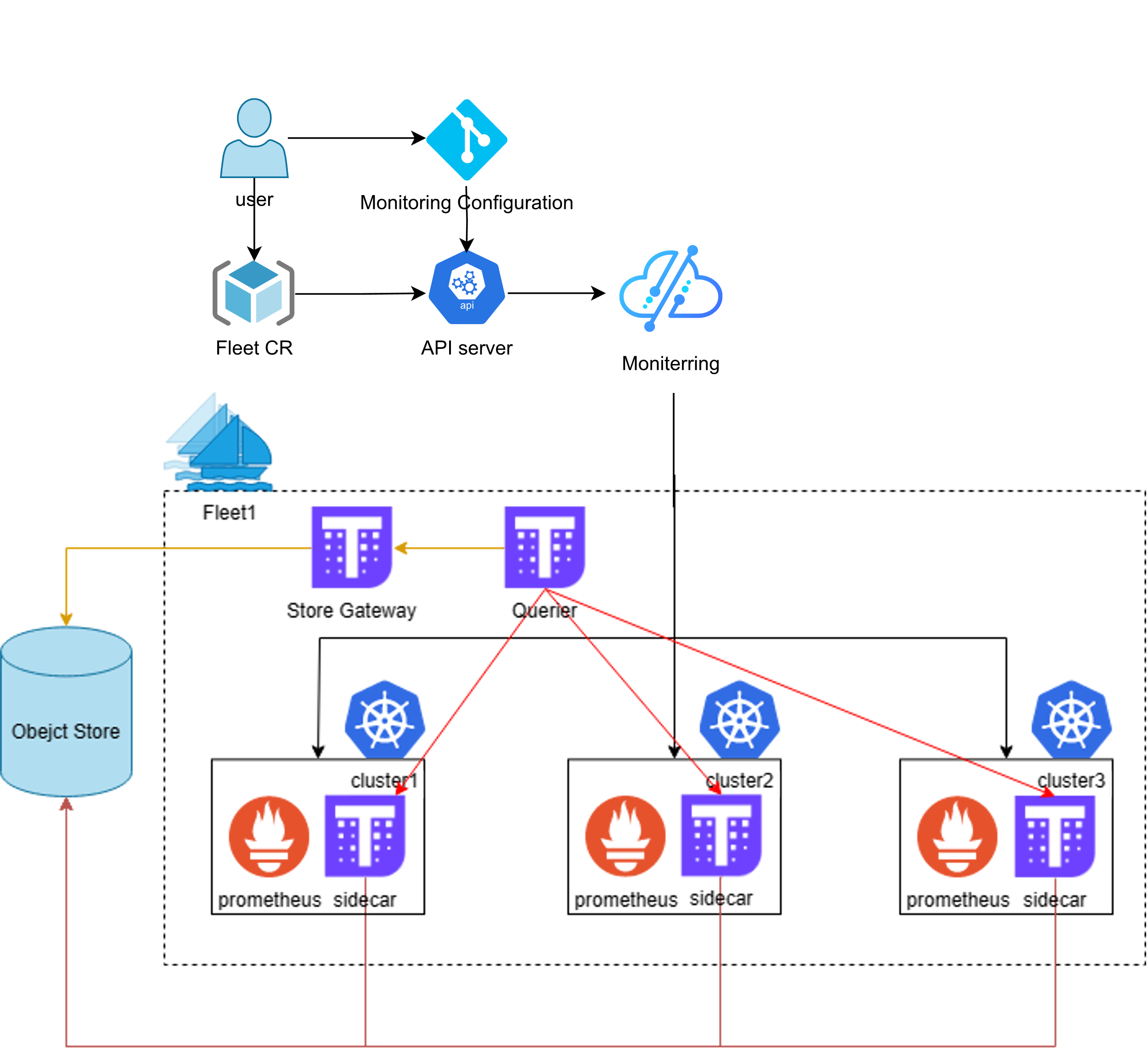

统一监控体系构建

Kurator集成了Prometheus、Grafana等监控组件,构建了跨集群的统一监控体系。通过Federated Monitoring机制,各集群的指标数据被聚合到中央监控平台,提供全局视角:

apiVersion: monitoring.kurator.dev/v1alpha1

kind: FederatedMonitoring

meta

name: global-monitoring

spec:

fleet: production-fleet

serviceMonitorSelector:

matchLabels:

monitoring: enabled

ruleSelector:

matchLabels:

rule: global

alerting:

alertmanagers:

- namespace: monitoring

name: main-alertmanager

port: 9093

grafana:

enabled: true

dashboardSelector:

matchLabels:

dashboard: production

该配置确保了所有启用了监控的集群都遵循相同的告警规则和仪表板配置,同时支持集群特定的覆盖设置,满足不同环境的监控需求。

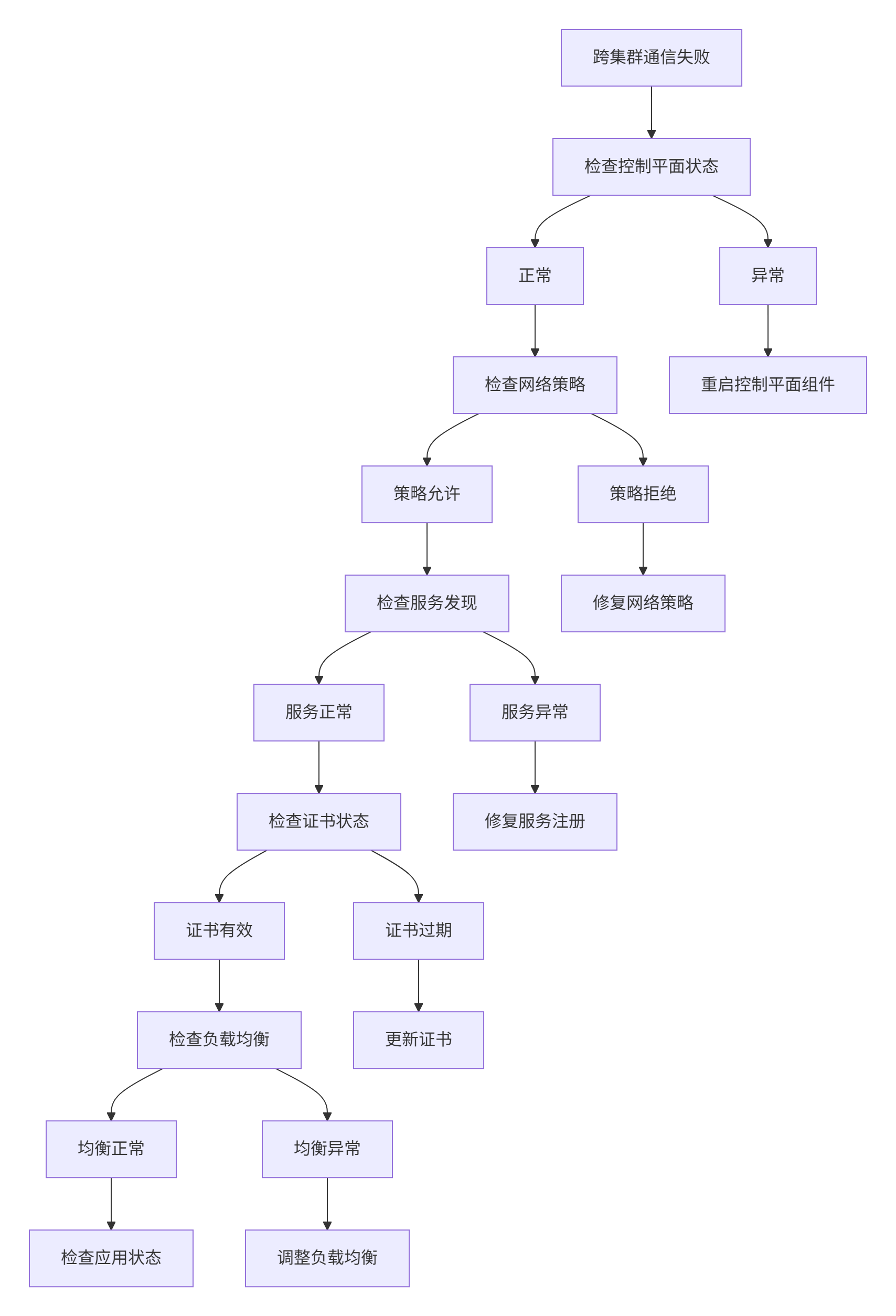

多集群网络连通性排查

在分布式环境中,网络连通性是常见痛点。Kurator提供了内置的网络诊断工具,帮助快速定位问题。以下是一个典型的网络连通性检查命令序列:

# 检查集群间服务发现

kurator diagnose connectivity --fleet production-fleet --service frontend --namespace default

# 检查隧道状态

kubectl get tunnels.kurator.dev -n kurator-system

# 检查ServiceExport和ServiceImport状态

kubectl get serviceexports.kurator.dev -A

kubectl get serviceimports.kurator.dev -A

# 端到端连通性测试

kurator test connectivity --source-cluster member-cluster-1 \

--source-namespace test \

--source-service client \

--target-cluster member-cluster-2 \

--target-service backend \

--target-port 8080 \

--timeout 30s

这些命令提供了从基础连通性到应用级通信的全方位诊断能力,大大缩短了故障排除时间。

隧道机制与跨集群通信

Kurator通过隧道机制解决了跨集群通信的安全性和可靠性问题。隧道不仅加密了集群间流量,还处理了NAT穿越和动态IP变化等复杂场景。配置示例如下:

apiVersion: networking.kurator.dev/v1alpha1

kind: ClusterTunnel

meta

name: secure-tunnel-prod

spec:

sourceCluster: member-cluster-1

targetCluster: member-cluster-2

type: wireguard # 支持 wireguard, ipsec, vxlan

encryption:

enabled: true

algorithm: aes-256-gcm

qos:

bandwidthLimit: 100Mbps

priority: high

failover:

enabled: true

timeout: 10s

backupEndpoints:

- member-cluster-2-backup

这种隧道配置在保证安全性的同时,提供了服务质量保障和故障转移能力,确保关键业务流量不受网络波动影响。

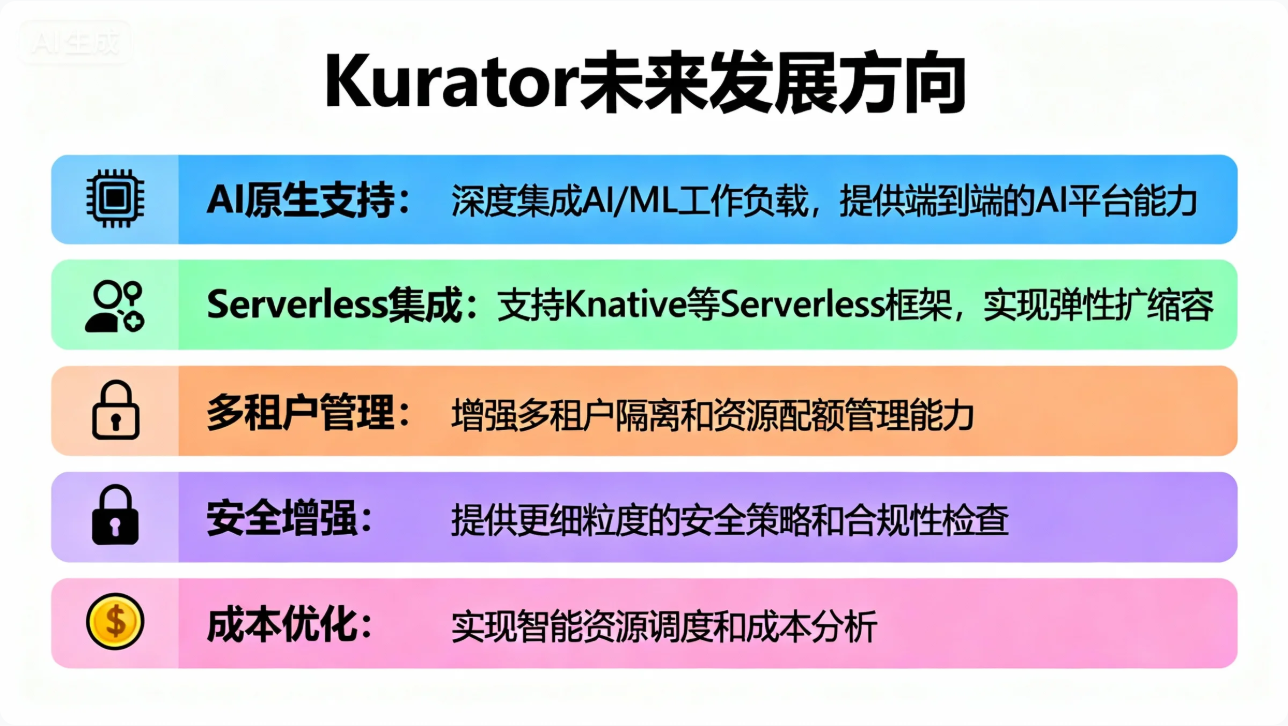

八、Kurator未来展望与企业级应用思考

边缘计算与云边协同

随着5G和IoT技术的发展,边缘计算场景日益重要。Kurator通过集成KubeEdge,正在构建完整的云-边协同解决方案。未来的Kurator将支持边缘节点的自动发现、边缘应用的智能分发以及边缘数据的本地处理与云端聚合。这一能力将为智能制造、智慧城市和车联网等场景提供强大支撑,实现计算资源的最优分布。

安全能力增强方向

在企业级应用中,安全性是首要考虑因素。Kurator未来将在以下方面增强安全能力:基于eBPF的运行时安全监控、跨集群的密钥管理统一服务、零信任网络架构的深度集成以及合规性自动化审计。这些能力将帮助企业满足日益严格的合规要求,如GDPR、HIPAA和等保2.0。

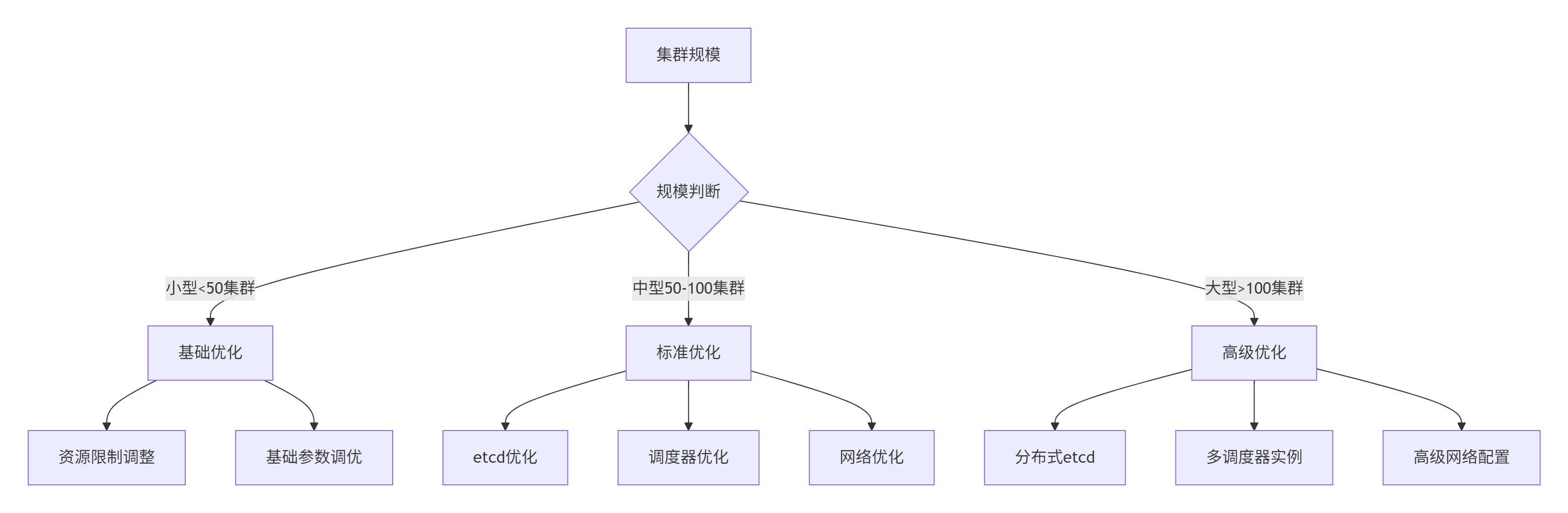

企业级生产环境落地建议

基于实践经验,企业在落地Kurator时应遵循渐进式策略:首先在非核心业务验证基础功能,建立运维流程和应急预案;其次扩展到关键业务,实施严格的变更管理和监控体系;最后构建完整的平台能力,包括自助服务平台、成本优化和容量规划。同时,团队技能转型和组织协作模式调整同样重要,建议设立专门的平台工程团队,负责Kurator平台的持续优化和赋能业务团队。

社区生态与贡献参与

Kurator作为开源项目,其健康发展依赖于活跃的社区生态。企业用户可以通过多种方式参与社区建设:贡献代码修复bug或实现新功能、编写文档和最佳实践指南、组织用户会议和培训活动、提供商业支持和咨询服务等。这种参与不仅有助于项目成长,也能提升企业在云原生领域的影响力和人才吸引力。

结语

Kurator代表了分布式云原生平台的发展方向,通过统一的抽象层整合了多个云原生组件的能力,为企业构建自有的分布式基础设施提供了强大工具。本文从环境搭建到高级流量治理,全面探讨了Kurator的核心功能和实践场景,展示了其在多集群管理、应用分发、流量治理和监控排障等方面的卓越能力。随着云原生技术的不断演进,Kurator将持续完善其功能体系,为企业的数字化转型提供更加坚实的技术支撑。对于云原生从业者而言,掌握Kurator不仅意味着提升技术能力,更是拥抱未来分布式架构的重要一步。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)