【前瞻创想】Kurator·云原生实战派:分布式云原生平台的深度剖析与企业级落地实践指南

【前瞻创想】Kurator·云原生实战派:分布式云原生平台的深度剖析与企业级落地实践指南

【前瞻创想】Kurator·云原生实战派:分布式云原生平台的深度剖析与企业级落地实践指南

摘要

在数字化转型浪潮中,分布式云原生架构已成为企业IT基础设施的必然选择。Kurator作为一款新兴的开源分布式云原生平台,通过整合Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada、Kyverno等顶尖云原生技术栈,为企业提供了从中心云到边缘端的完整解决方案。本文将深入剖析Kurator的核心架构,从环境搭建到多集群管理、从智能调度到GitOps实践,通过真实场景的代码示例和架构设计,揭示Kurator如何解决分布式环境下的资源编排、流量管理、监控告警等核心挑战。文章不仅关注技术实现细节,更从企业级应用角度出发,探讨Kurator在边缘计算、AI训练、微服务治理等场景的最佳实践,并对未来分布式云原生技术发展趋势提出前瞻性思考,为企业技术决策者提供切实可行的落地路径。

1. Kurator:分布式云原生基础设施的集大成者

1.1 什么是Kurator:开源分布式云原生平台定义

Kurator是一个开源的分布式云原生平台,旨在帮助用户构建自己的分布式云原生基础设施,加速企业数字化转型进程。与传统的单集群Kubernetes解决方案不同,Kurator面向的是多云、混合云、边云协同的复杂环境,提供统一的管理控制面,实现资源、应用、策略的全局视图和统一治理。

Kurator的核心价值在于"统一"二字——统一资源编排、统一调度、统一流量管理、统一遥测,以及基础设施即代码(IaC)的声明式管理能力。这种统一不是简单的功能堆砌,而是深度整合各组件优势,通过抽象层屏蔽底层复杂性,让开发者和运维人员能够以更高效的方式管理分布式系统。

1.2 核心价值:企业数字化转型的加速器

Kurator的核心价值参考图:

在企业数字化转型过程中,面临着多云管理复杂、边缘计算能力不足、应用分发困难、资源利用率低下等诸多挑战。Kurator通过其独特的架构设计,为企业提供了一站式解决方案:

多云协同能力:Kurator支持公有云、私有云、边缘节点的统一管理,打破云厂商锁定,实现资源的最优分配。企业可以根据业务需求,将计算密集型任务调度到公有云,将数据敏感型应用部署在私有环境,将实时处理任务下沉到边缘节点,构建真正弹性的基础设施。

边缘计算赋能:通过集成KubeEdge,Kurator将云原生能力延伸到边缘设备,支持离线运行、边缘自治、设备管理等特性。这使得物联网、智能制造、智慧城市等场景能够享受云原生带来的敏捷性和可观测性,同时保持边缘侧的低延迟和高可靠性。

应用现代化加速:Kurator内置的GitOps能力,结合FluxCD实现声明式的应用交付,大大简化了CI/CD流程。开发人员只需提交代码到Git仓库,系统自动完成构建、测试、部署全流程,实现真正的"Git驱动一切"。

1.3 技术全景:站在巨人肩膀上的创新

Kurator并非从零开始构建,而是站在众多优秀开源项目的肩膀上,通过深度整合和创新设计,创造出1+1>2的效果。其技术栈涵盖:

- 基础设施层:Kubernetes作为基础运行时,Karmada实现多集群管理,KubeEdge扩展到边缘计算

- 应用层:Istio提供服务网格能力,Volcano优化批处理和AI工作负载调度

- 运维层:Prometheus实现监控告警,FluxCD驱动GitOps工作流,Kyverno提供策略引擎

- 管理层:Fleet提供统一的集群舰队管理,抽象多集群复杂性

这种技术整合不是简单的拼凑,而是通过精心设计的API和扩展机制,让各组件能够无缝协作。例如,Kurator的Fleet管理不仅注册集群,还确保命名空间、ServiceAccount、Service在集群间的一致性,实现真正的"服务相同性",这是单一组件无法实现的高级能力。

2. Kurator核心架构与技术栈深度剖析

2.1 基础设施即代码:声明式管理的革命

Kurator将"基础设施即代码"(IaC)理念推向极致,不仅管理应用配置,还管理集群、节点、VPC等基础设施资源。通过声明式API,用户可以定义期望状态,系统自动处理实现细节。这种模式带来几个关键优势:

可重复性:环境配置以代码形式存储在Git仓库中,任何环境都可以通过相同配置重建,消除"雪花服务器"问题。

版本控制:所有变更都经过Git版本控制,可以追溯历史、回滚错误变更、进行代码审查,大大提升安全性和可靠性。

自动化:声明式配置天然适合自动化,结合GitOps模式,实现从代码提交到生产部署的全自动化流程。

# 示例:Kurator集群声明式配置

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

meta

name: production-cluster

spec:

cloudProvider: aws

region: us-west-2

nodeGroups:

- name: worker-nodes

instanceType: m5.xlarge

minSize: 3

maxSize: 10

networking:

podCIDR: 10.244.0.0/16

serviceCIDR: 10.96.0.0/12

vpcCIDR: 10.0.0.0/16

2.2 统一资源编排:多云、边云协同的核心

Kurator的统一资源编排能力是其区别于其他平台的关键特性。通过抽象层,Kurator将不同云厂商、边缘节点的资源统一管理,提供一致的操作体验。这种统一体现在几个层面:

资源抽象:无论底层是AWS EC2、阿里云ECS还是边缘物理机,Kurator都提供统一的资源模型,用户无需关心底层细节。

策略统一:通过Kyverno等策略引擎,Kurator确保安全策略、网络策略、资源配额等在所有集群中一致应用,避免策略漂移带来的安全风险。

监控统一:Prometheus联邦架构收集所有集群的指标,提供全局视图,支持跨集群的告警和诊断。

3. 从零开始:Kurator环境搭建与配置实战

3.1 环境准备:系统要求与前置条件

在开始Kurator安装之前,需要确保环境满足基本要求。Kurator支持在Linux、macOS系统上运行,对硬件资源有一定要求,具体取决于管理的集群规模:

系统要求:

- 操作系统:Ubuntu 20.04+、CentOS 7+ 或 macOS 11+

- CPU:至少4核(生产环境建议8核以上)

- 内存:至少8GB(生产环境建议16GB以上)

- 磁盘空间:至少50GB可用空间

- 网络:稳定的互联网连接,能够访问GitHub、Docker Hub等镜像源

前置依赖:

- Kubernetes集群(v1.20+):作为Kurator的管理集群

- kubectl(v1.20+):Kubernetes命令行工具

- Helm(v3.7+):Kubernetes包管理工具

- Docker或containerd:容器运行时

- Git:版本控制工具

3.2 源码获取与编译:从GitHub到本地部署

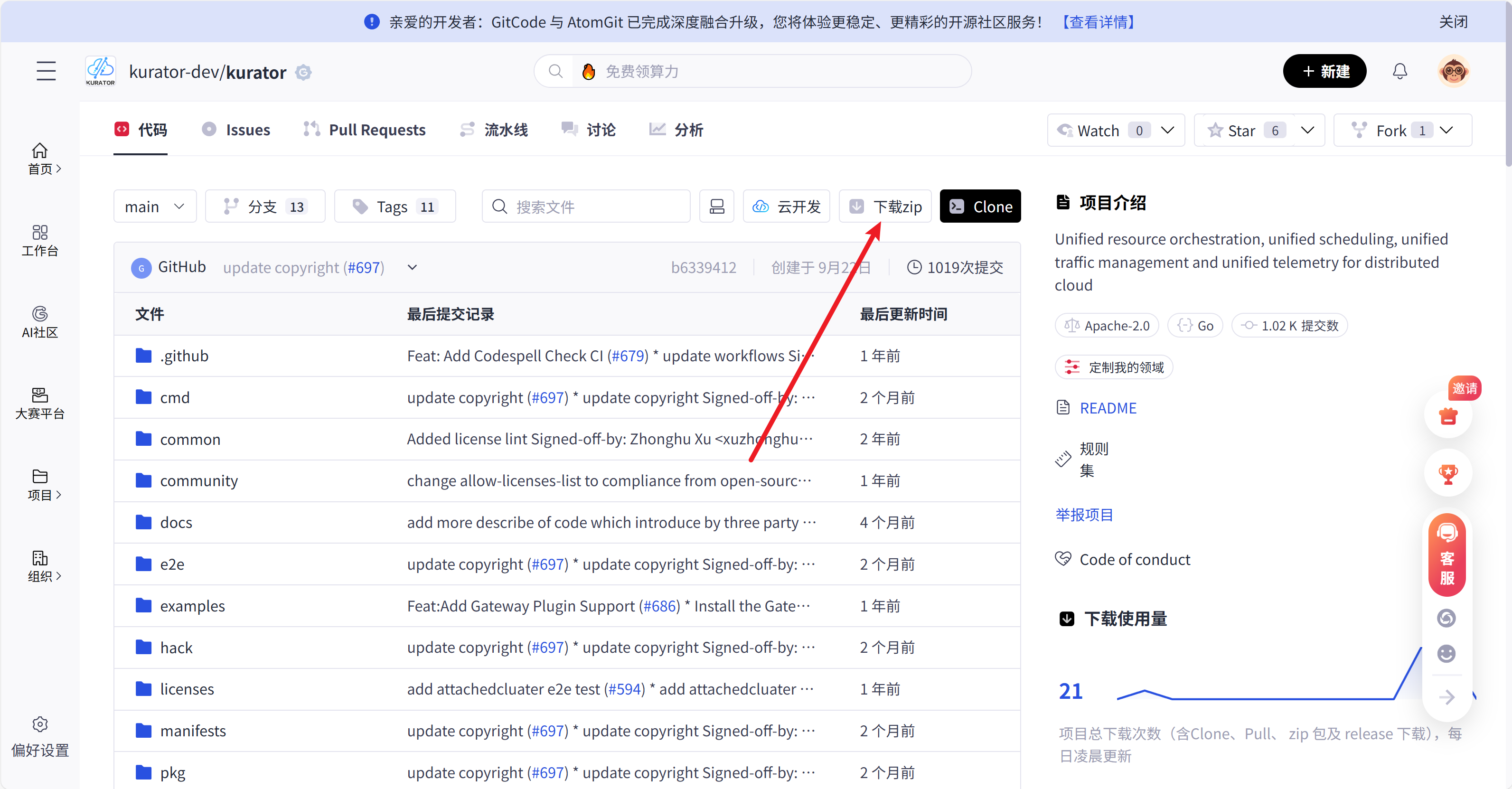

Kurator的安装有两种主要方式:从发布版本安装或从源码编译安装。对于希望深度定制或贡献代码的用户,源码编译是更好的选择。以下是获取源码的标准步骤:

在项目地址中,可以看到可以clone到本地

https://gitcode.com/kurator-dev/kurator.git

或者我们也可以下载到本地

可以看到我们资源文件已经下载下来了

源码编译完成后,会在./bin目录下生成可执行文件。这种方式的优势是可以获取最新特性,但需要处理依赖和编译问题。对于生产环境,建议使用官方发布的稳定版本。

3.3 集群初始化:构建第一个Kurator管理集群

完成源码获取后,需要初始化Kurator管理集群。这个过程包括安装Kurator控制平面、配置存储后端、设置认证授权等关键步骤:

# 初始化Kurator控制平面

./bin/kurator init --config kurator.yaml

# 配置文件示例(kurator.yaml)

apiVersion: kurator.dev/v1alpha1

kind: Kurator

meta

name: kurator-system

spec:

storage:

type: s3

bucket: kurator-artifacts

region: us-west-2

authentication:

type: oidc

issuerUrl: https://your-oidc-provider.com

clientId: kurator-client

monitoring:

enabled: true

prometheus:

retention: 15d

初始化过程中,Kurator会自动安装必要的CRD(Custom Resource Definitions)、创建服务账户、配置网络策略等。完成初始化后,可以通过以下命令验证状态:

kubectl get pods -n kurator-system

# 应该看到所有核心组件处于Running状态

4. Fleet舰队管理:多集群统一治理的艺术

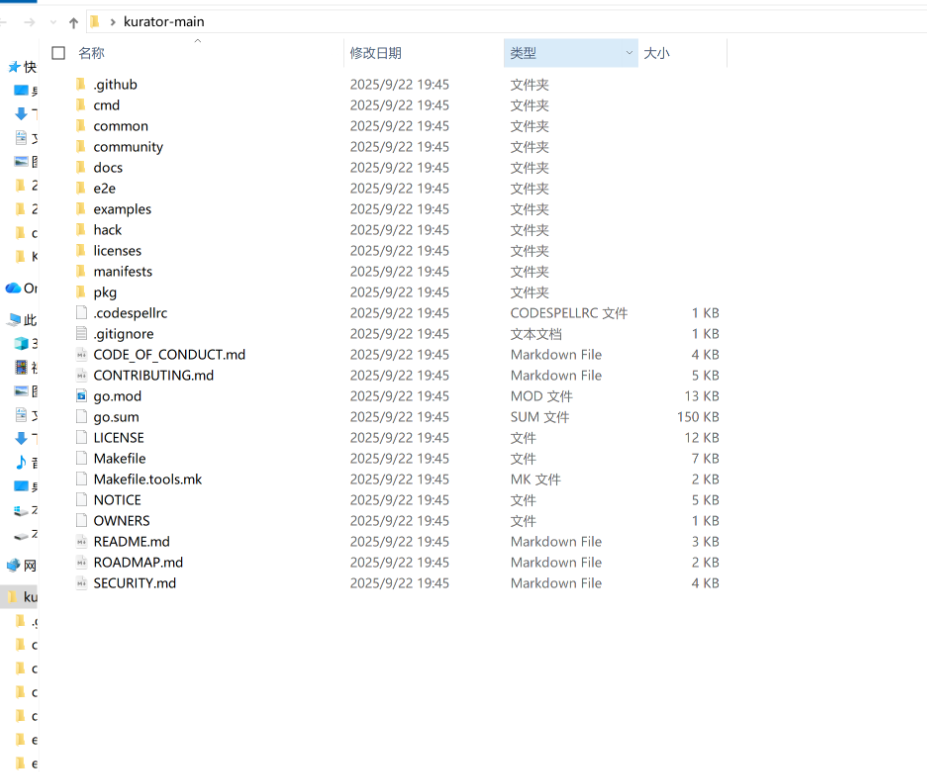

4.1 Fleet架构解析:集群联邦的统一控制面

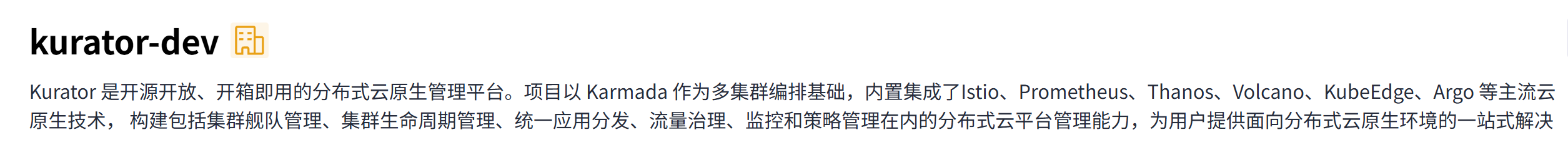

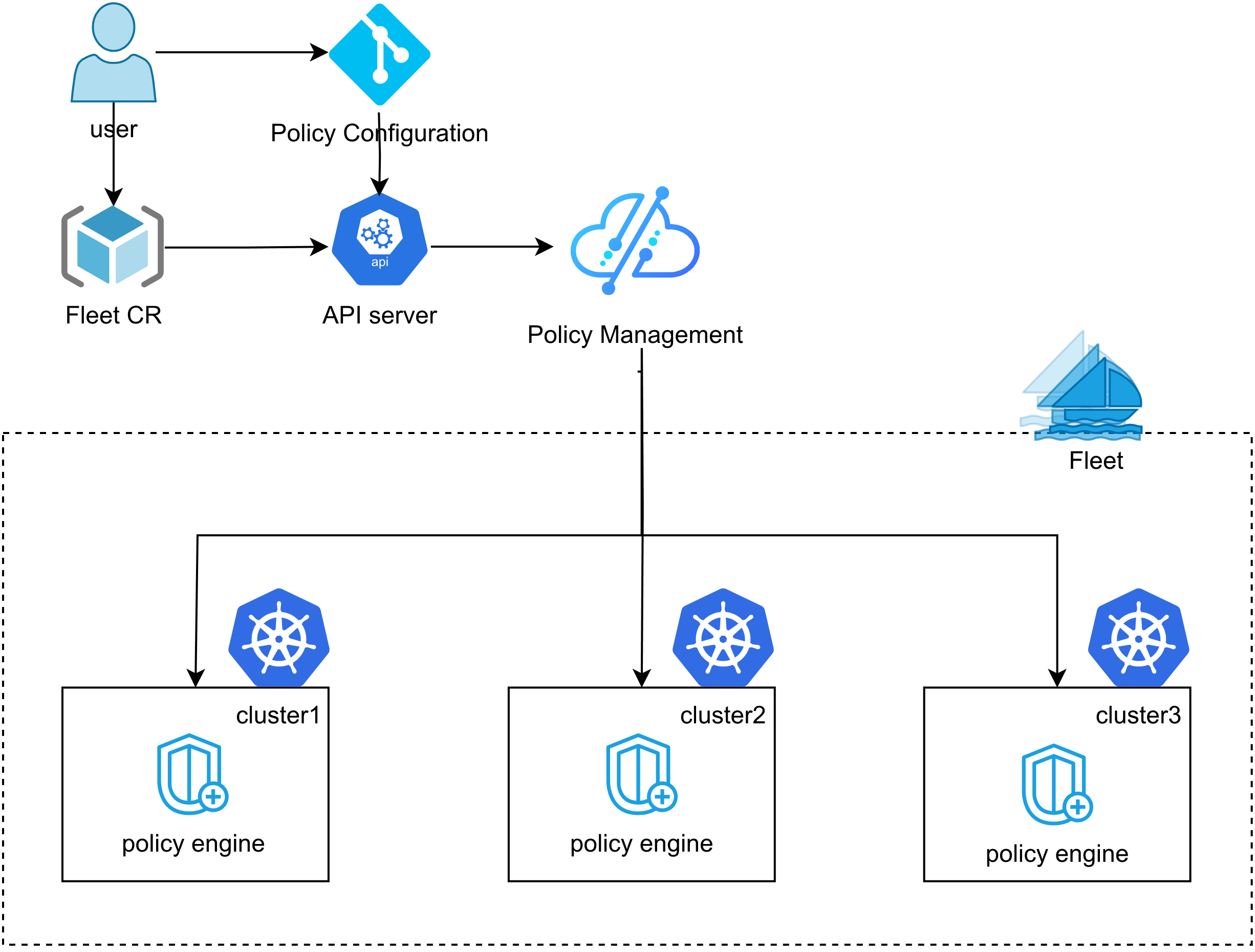

Fleet架构官方参考图:

Fleet是Kurator的核心概念之一,代表一组逻辑上相关的Kubernetes集群。Fleet架构的设计目标是提供统一的管理体验,同时保持各集群的自治性。其架构包含几个关键组件:

Fleet Controller:负责Fleet生命周期管理,处理集群注册、策略同步、状态收集等核心逻辑。Controller采用事件驱动架构,对集群状态变化做出实时响应。

Cluster Registry:维护集群元数据,包括集群类型(中心云、边缘云)、版本、节点数量、可用资源等信息。Registry支持动态注册和注销,适应云环境的弹性特性。

Policy Engine:基于Kyverno实现,确保所有集群遵守统一的安全、网络、资源策略。策略可以定义在Fleet级别,自动同步到成员集群。

# Fleet配置示例

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

meta

name: production-fleet

spec:

clusters:

- name: aws-us-west-2

kubeconfigRef: aws-kubeconfig

- name: edge-beijing

kubeconfigRef: edge-kubeconfig

policies:

- name: security-baseline

kind: ClusterPolicy

spec:

rules:

- name: require-namespace

match:

resources:

kinds: ["Pod"]

validate:

message: "Pods must have a namespace label"

pattern:

meta

labels:

namespace: "?*"

4.2 服务相同性:跨集群服务发现与通信

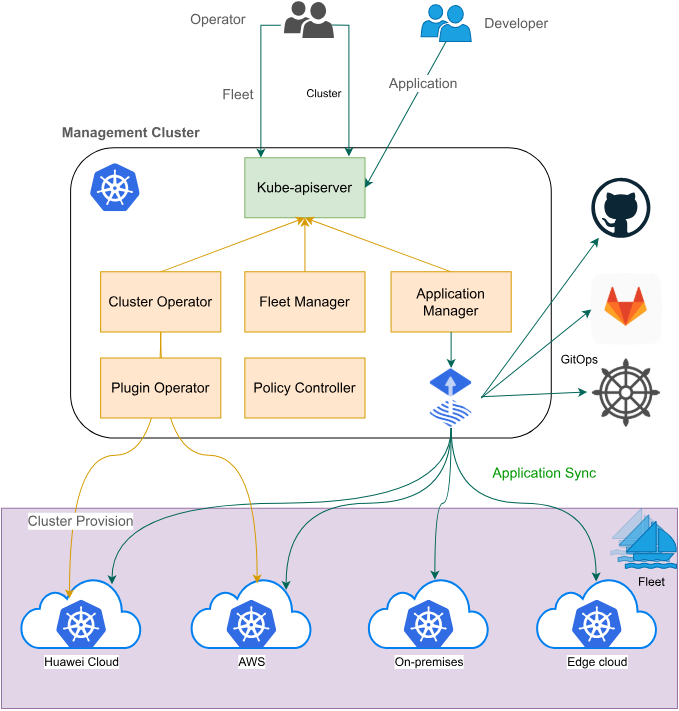

Fleet 队列中的服务相同性参考图:

在分布式系统中,服务发现是核心挑战之一。Kurator通过Fleet实现"服务相同性"(Service Sameness),确保相同名称的服务在不同集群中具有相同的行为和访问方式。这通过几个机制实现:

全局服务注册表:Kurator维护一个全局服务目录,记录所有集群中定义的服务。当服务发生变化时,自动更新注册表,确保一致性。

跨集群DNS解析:通过扩展CoreDNS,Kurator支持跨集群服务发现。服务请求可以透明地路由到任何集群中的实例,无需应用感知底层拓扑。

流量管理集成:与Istio深度集成,Kurator提供细粒度的流量控制能力,支持按地域、版本、权重进行流量切分,实现蓝绿发布、金丝雀发布等高级场景。

# 跨集群服务定义

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: user-service

namespace: default

spec:

hosts:

- user-service.default.svc.cluster.local

http:

- route:

- destination:

host: user-service.default.svc.cluster.local

subset: v1

weight: 80

- destination:

host: user-service.edge-beijing.svc.cluster.local

subset: v1

weight: 20

4.3 策略一致性:统一安全与治理策略

Kurator 统一策略管理参考图:

多集群环境下的策略一致性是安全治理的关键挑战。Kurator通过集中式策略定义和分布式执行机制,确保所有集群符合企业安全标准:

策略继承机制:Fleet级别的策略自动继承到成员集群,子集群可以覆盖特定策略,但必须遵守父策略的基本约束。这种机制平衡了统一性和灵活性。

实时策略同步:当Fleet策略变更时,Kurator自动同步到所有成员集群,确保策略的及时生效。同步过程支持版本控制和回滚,避免错误策略导致系统故障。

策略审计与报告:Kurator定期审计各集群策略合规性,生成详细报告,帮助安全团队及时发现和修复违规配置。

5. Volcano调度引擎:AI/大数据工作负载的最佳拍档

5.1 Volcano核心架构:批处理调度的重构

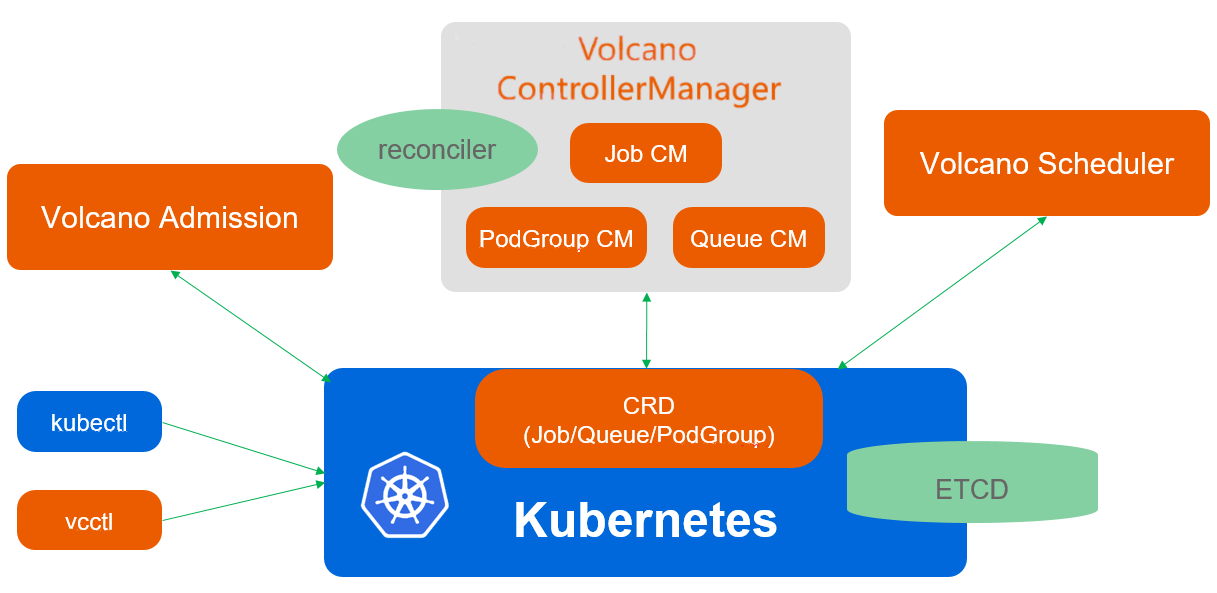

Volcano调度架构官方参考图:

Volcano是Kurator集成的批处理调度器,专门为AI训练、大数据分析、HPC等计算密集型工作负载优化。与Kubernetes默认调度器相比,Volcano提供了更丰富的调度语义和更高的资源利用率:

增强的调度算法:Volcano支持gang scheduling(全有或全无调度)、bin packing(装箱算法)、fair sharing(公平共享)等多种算法,适应不同工作负载需求。

任务依赖管理:支持DAG(有向无环图)任务依赖,确保任务按依赖顺序执行,避免资源浪费和执行错误。

资源拓扑感知:了解物理资源拓扑(如NUMA节点、GPU拓扑),优化数据局部性和通信效率,提升AI训练性能。

5.2 PodGroup与Queue:资源分组调度的艺术

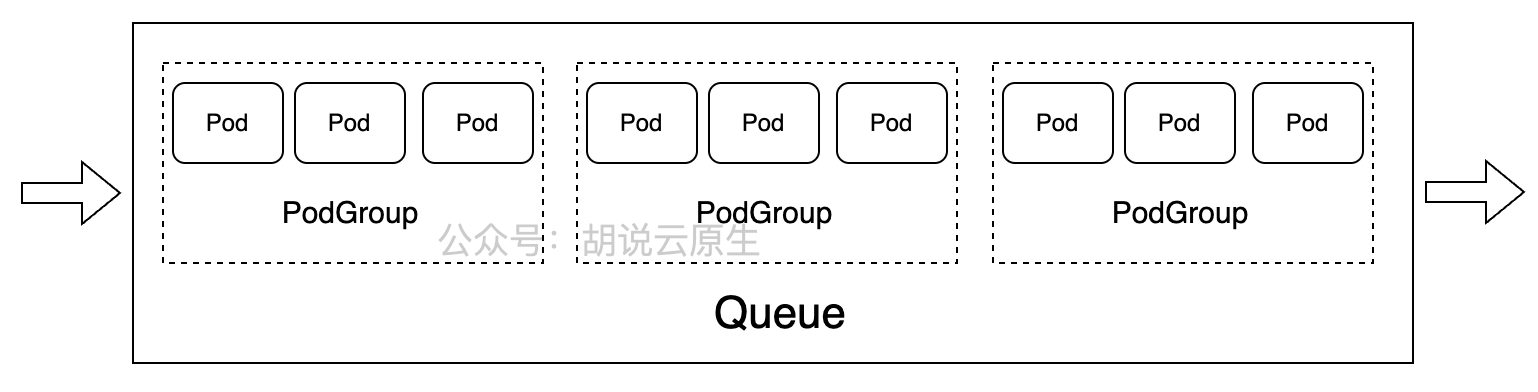

Volcano的核心抽象是PodGroup和Queue,它们解决了传统Kubernetes调度在批处理场景中的局限性:

PodGroup:代表一组需要协同调度的Pod。如果无法满足所有Pod的资源需求,整个PodGroup会等待,避免部分调度导致的资源浪费。这对于MPI、TensorFlow等分布式训练框架至关重要。

Queue:提供多租户资源隔离机制,不同团队或项目可以分配到不同的Queue,确保资源公平分配。Queue支持权重分配、资源配额、优先级等高级特性。

# Volcano PodGroup配置示例

apiVersion: scheduling.volcano.sh/v1beta1

kind: PodGroup

meta

name: tensorflow-training

spec:

minMember: 8

minTaskMember:

- name: ps

minMember: 2

- name: worker

minMember: 6

queue: ai-training

5.3 VolcanoJob:复杂工作负载的调度优化

VolcanoJob是Volcano提供的高级工作负载抽象,封装了批处理作业的完整生命周期管理:

弹性伸缩:根据训练进度和资源利用率,动态调整Worker数量,平衡训练速度和资源成本。

容错恢复:当节点故障时,自动重新调度失败任务,支持checkpoint恢复,避免从头开始训练。

异构资源调度:智能分配CPU、GPU、TPU等异构资源,确保不同类型任务获得最优硬件加速。

# VolcanoJob配置示例

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

metadata:

name: distributed-training

spec:

minAvailable: 8

schedulerName: volcano

tasks:

- replicas: 2

name: ps

template:

spec:

containers:

- image: tensorflow/tensorflow:latest-gpu

name: tensorflow

resources:

limits:

nvidia.com/gpu: 1

- replicas: 6

name: worker

template:

spec:

containers:

- image: tensorflow/tensorflow:latest-gpu

name: tensorflow

resources:

limits:

nvidia.com/gpu: 4

6. Karmada集成实践:跨集群弹性伸缩的奥秘

6.1 Karmada架构与Kurator的深度集成

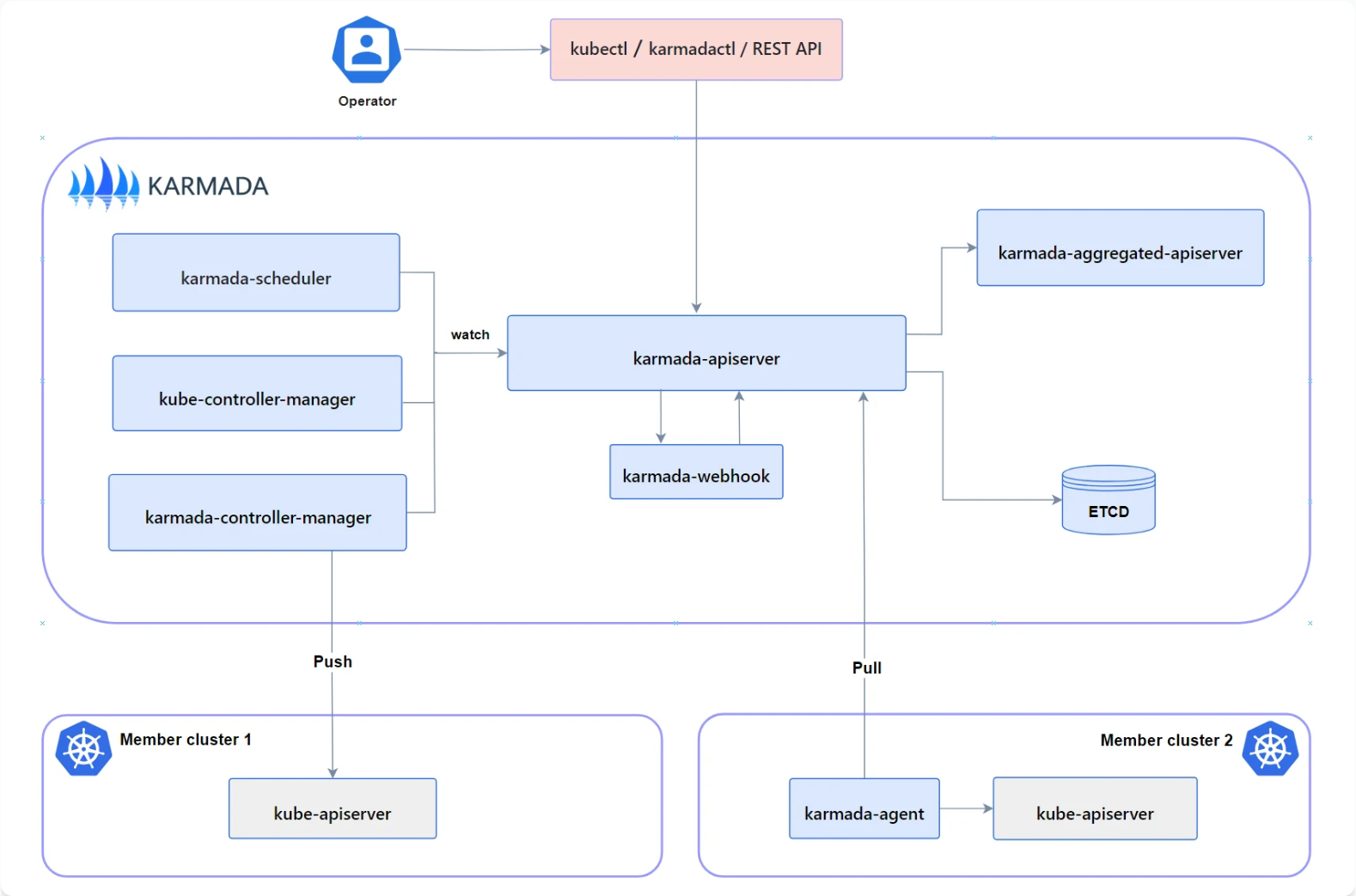

Karmada 架构官方参考图:

Karmada是Kurator集成的多集群管理解决方案,提供集群联邦、应用分发、弹性伸缩等核心能力。Kurator与Karmada的集成不是简单的组件包含,而是深度协同:

分层架构:Kurator提供全局控制面,Karmada负责集群联邦管理,两者通过API无缝协作。Kurator的Fleet概念与Karmada的Cluster概念相互映射,形成统一的视图。

策略协同:Kurator的策略引擎与Karmada的PropagationPolicy结合,实现从全局到局部的策略分层管理。全局策略定义基本约束,局部策略处理特定集群的例外情况。

状态聚合:Karmada收集各集群状态,Kurator聚合这些状态形成全局视图,支持跨集群的监控、告警和诊断。

6.2 跨集群应用分发:从单集群到多集群

Karmada的PropagationPolicy是应用分发的核心机制,定义如何将应用部署到多个集群:

分发策略:支持按集群标签、资源需求、地理位置等条件分发应用。例如,可以将前端服务部署到靠近用户的边缘集群,将数据处理服务部署到计算资源丰富的中心集群。

副本分配:智能分配应用副本数,考虑各集群的资源容量、负载情况、故障域等因素,确保高可用性和资源均衡。

版本同步:当应用镜像更新时,自动同步到所有目标集群,支持滚动更新、蓝绿发布等策略,最小化服务中断。

# Karmada PropagationPolicy示例

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

metadata:

name: frontend-policy

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: frontend

placement:

clusterAffinity:

clusterNames:

- us-west-cluster

- edge-shanghai

replicaScheduling:

replicaDivisionPreference: Weighted

replicaSchedulingType: Divided

weightList:

- targetCluster:

clusterNames:

- us-west-cluster

weight: 70

- targetCluster:

clusterNames:

- edge-shanghai

weight: 30

6.3 弹性伸缩策略:基于负载的智能扩缩容

跨集群弹性伸缩是Karmada的核心能力,通过结合Kurator的监控数据,实现真正的智能扩缩容:

全局HPA:基于聚合的监控指标(如全局QPS、平均延迟),在集群间动态调整副本分布。当某个集群负载过高时,自动将流量和副本迁移到空闲集群。

预测性伸缩:利用历史负载模式,预测未来资源需求,提前进行容量规划。例如,在促销活动前自动扩容相关服务,避免突发流量导致的性能下降。

成本优化:结合云厂商定价策略,将工作负载调度到成本最低的区域,同时满足性能要求。例如,将离线计算任务调度到Spot实例丰富的区域,将在线服务保持在按需实例上。

7. GitOps在边缘计算中的创新应用

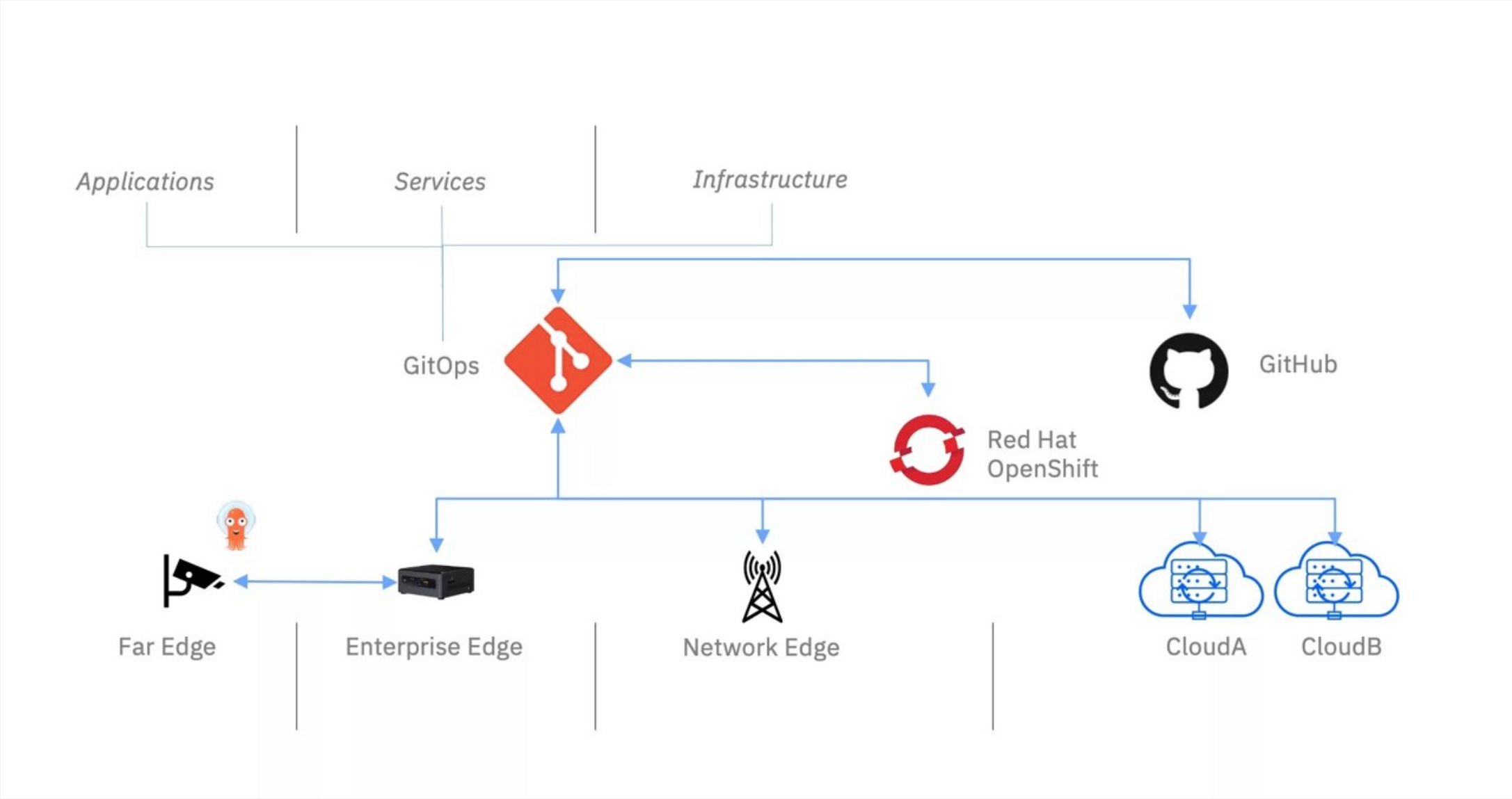

边缘计算中的 GitOps 参考图:

7.1 GitOps理念:声明式配置的终极形态

GitOps是Kurator的核心理念之一,将Git作为系统状态的唯一真实来源。在边缘计算场景中,GitOps面临网络不稳定、设备资源受限等挑战,Kurator通过创新设计解决了这些问题:

离线优先架构:边缘节点可以在离线状态下运行,定期同步Git仓库状态。当网络恢复时,自动同步变更,确保最终一致性。

增量同步:只同步必要的配置变更,减少带宽消耗和同步时间,适应边缘网络条件。

本地缓存:在边缘节点缓存关键配置和镜像,减少对外部依赖,提升离线运行能力。

7.2 FluxCD集成:持续交付的自动化引擎

FluxCD是Kurator集成的GitOps工具,负责监控Git仓库变化并自动应用到集群。在Kurator中,FluxCD被深度集成,支持多集群、多环境的复杂场景:

多仓库支持:不同环境(dev、staging、prod)可以使用不同Git仓库,通过分支或目录隔离。Kurator统一管理这些仓库的关系,确保环境一致性。

镜像自动化:FluxCD监控容器镜像仓库,当新镜像发布时,自动更新Kubernetes部署,实现从代码提交到生产部署的全自动化。

金丝雀发布:与Flagger集成,支持渐进式发布策略,监控关键指标,自动回滚失败发布,降低发布风险。

# FluxCD GitRepository配置示例

apiVersion: source.toolkit.fluxcd.io/v1beta1

kind: GitRepository

meta

name: kurator-apps

namespace: flux-system

spec:

interval: 5m

url: https://github.com/organization/kurator-apps

ref:

branch: main

secretRef:

name: git-credentials

---

# FluxCD Kustomization配置

apiVersion: kustomize.toolkit.fluxcd.io/v1beta1

kind: Kustomization

meta

name: apps-production

namespace: flux-system

spec:

interval: 10m

path: "./production"

prune: true

sourceRef:

kind: GitRepository

name: kurator-apps

postBuild:

substitute:

ENVIRONMENT: production

7.3 边缘场景挑战:离线环境下的GitOps实践

边缘计算环境通常面临网络不稳定、设备异构、安全要求高等挑战。Kurator通过以下机制确保GitOps在边缘环境的可靠性:

同步策略定制:根据边缘节点的重要性,设置不同的同步频率和策略。关键节点采用高频同步,普通节点采用低频同步,平衡一致性和资源消耗。

故障转移机制:当Git仓库不可用时,边缘节点使用最后已知的良好配置继续运行,同时记录变更请求,待网络恢复后同步。

安全增强:所有配置变更经过签名验证,确保来源可信。敏感配置通过加密存储,只有授权节点可以解密,防止数据泄露。

8. Kurator未来展望:分布式云原生的星辰大海

8.1 技术演进路线:从基础设施到应用层

Kurator的技术演进将沿着"基础设施→平台→应用"的路径深化,重点关注几个方向:

边缘智能:将AI推理能力下沉到边缘,实现毫秒级响应。Kurator将集成轻量级推理引擎,支持模型自动优化和分发,让边缘设备具备智能决策能力。

无服务器架构:扩展对Serverless工作负载的支持,提供事件驱动的弹性伸缩,让开发者专注于业务逻辑而非基础设施管理。

数据网格:解决分布式环境下的数据一致性问题,提供统一的数据访问接口,支持跨集群的数据查询和分析,打破数据孤岛。

8.2 社区生态建设:开放协作的创新模式

Kurator的成功依赖于活跃的开源社区。未来将加强社区建设,通过以下方式促进生态繁荣:

开发者体验优化:简化贡献流程,提供详细的文档和示例,降低参与门槛。建立mentorship计划,帮助新贡献者快速成长。

企业合作计划:与领先企业建立深度合作,共同解决实际业务问题,将实践经验反馈到开源项目,形成良性循环。

标准推动:积极参与CNCF等标准组织,推动分布式云原生相关标准的制定,确保Kurator与行业趋势保持一致。

8.3 企业落地建议:数字化转型的最佳实践

基于社区经验,为计划采用Kurator的企业提供以下建议:

渐进式采用:从非关键业务开始试点,验证技术可行性,积累运维经验,再逐步扩展到核心业务。

能力建设:投资团队培训,培养云原生技能,建立内部专家团队,确保长期成功。

度量驱动:定义清晰的度量指标(如部署频率、故障恢复时间、资源利用率),持续优化平台性能和团队效率。

Kurator不仅是一个技术平台,更是企业数字化转型的战略伙伴。在分布式云原生的时代浪潮中,Kurator通过整合最优秀的开源项目,创造出独特的价值主张:统一而不僵化,灵活而不混乱,强大而不复杂。随着边缘计算、AI、5G等技术的融合发展,Kurator将继续演进,成为连接中心云与边缘端、连接数据与智能、连接现在与未来的桥梁。我们期待更多开发者和企业加入Kurator社区,共同塑造分布式云原生的未来。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)