【前瞻创想】Kurator·云原生实战派:分布式云原生平台的创新整合与深度实践

【前瞻创想】Kurator·云原生实战派:分布式云原生平台的创新整合与深度实践

【前瞻创想】Kurator·云原生实战派:分布式云原生平台的创新整合与深度实践

摘要

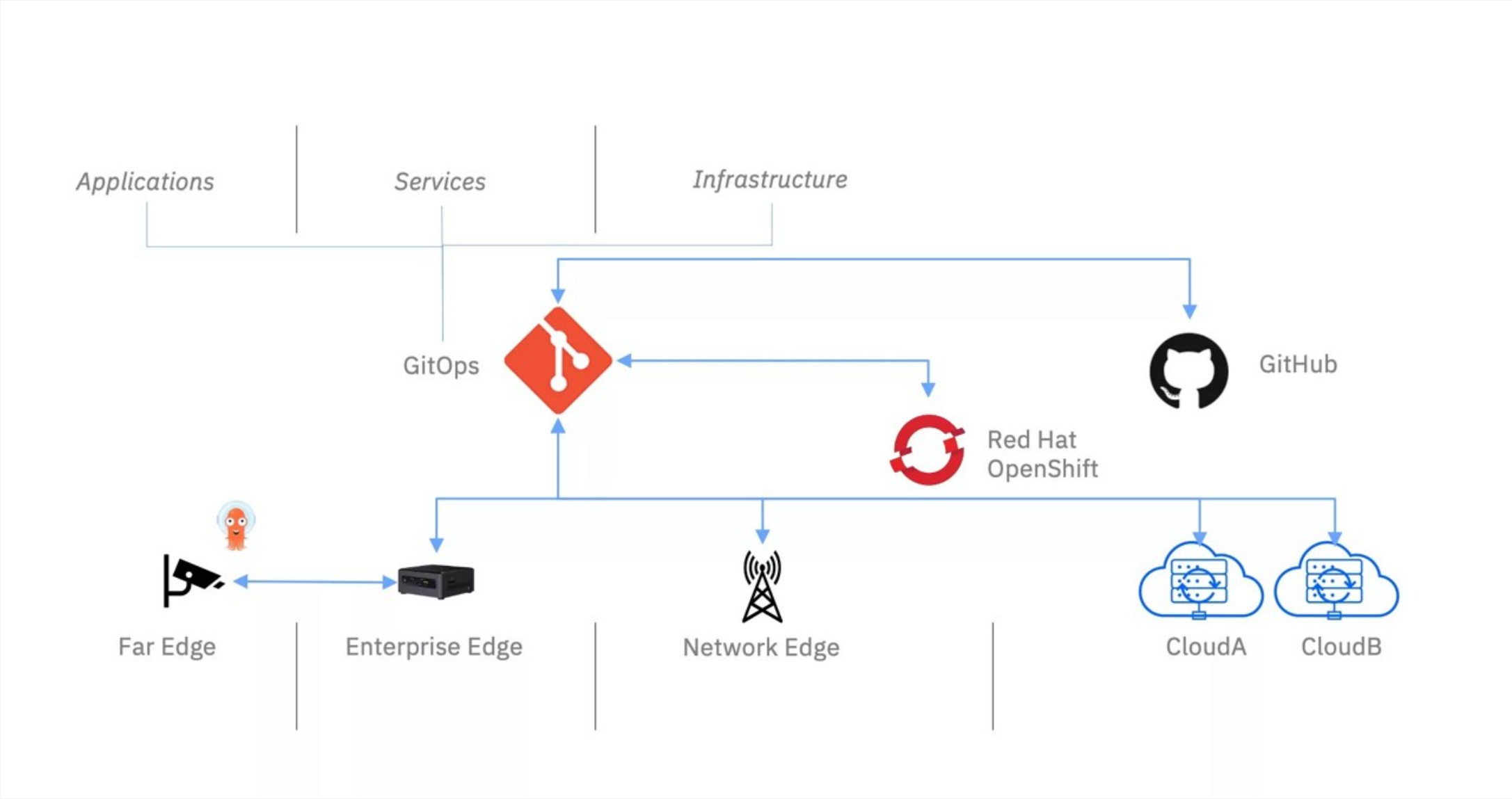

在云原生技术迅猛发展的今天,企业面临多云、混合云、边缘计算等复杂场景下的基础设施管理挑战。Kurator作为一款开源的分布式云原生平台,通过整合Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada、Kyverno等优秀开源项目,为企业提供了一站式的分布式云原生解决方案。本文将深入解读Kurator的技术架构与创新优势,结合多集群管理、边缘计算、GitOps等实践场景,分享实战经验与深度思考,并对分布式云原生技术的未来发展方向提出专业建议。通过本文,读者将全面了解Kurator如何帮助企业构建自己的分布式云原生基础设施,加速数字化转型进程。

一、Kurator平台概述与架构设计

1.1 什么是Kurator:分布式云原生平台的定义

Kurator是一个开源的分布式云原生平台,旨在帮助用户构建自己的分布式云原生基础设施,促进企业数字化转型。它并非从零开始构建,而是站在众多优秀云原生软件栈的肩膀上,通过整合与创新,提供统一的管理界面和API,简化多云、多集群环境下的复杂性。

不同于传统的单集群管理工具,Kurator专注于解决分布式场景下的核心挑战:资源分散、策略不一致、应用分发困难、可观测性割裂等问题。它将云原生理念从单集群扩展到多集群、多云甚至边缘环境,真正实现了"一次定义,随处运行"的愿景。

1.2 Kurator的技术架构与核心组件

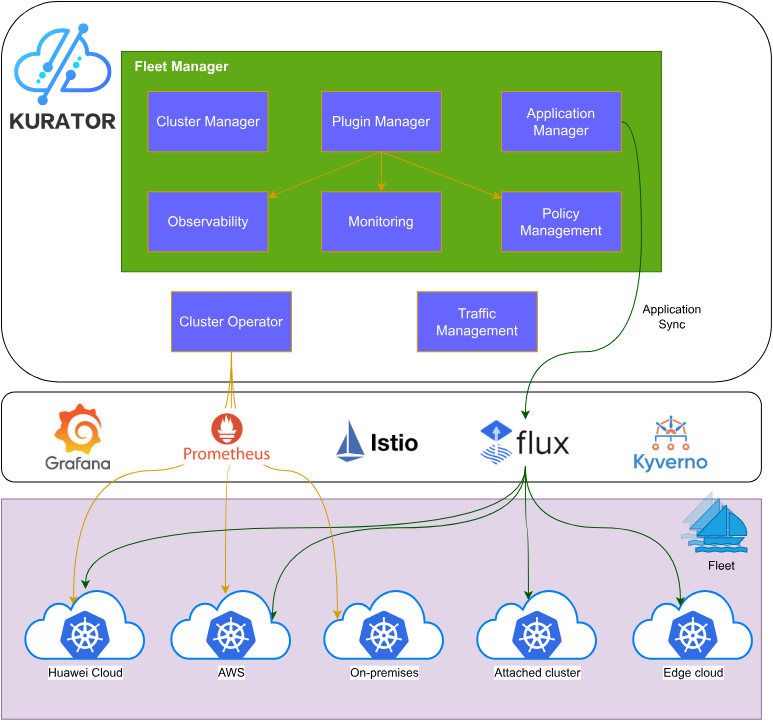

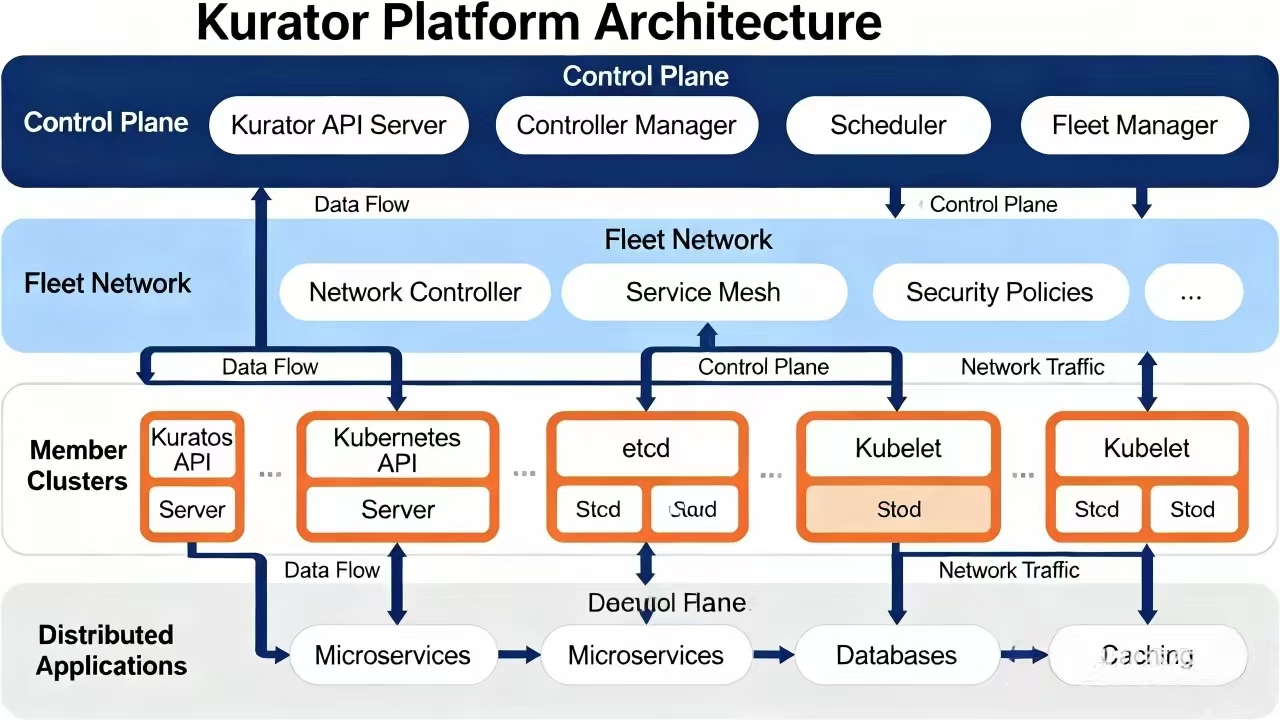

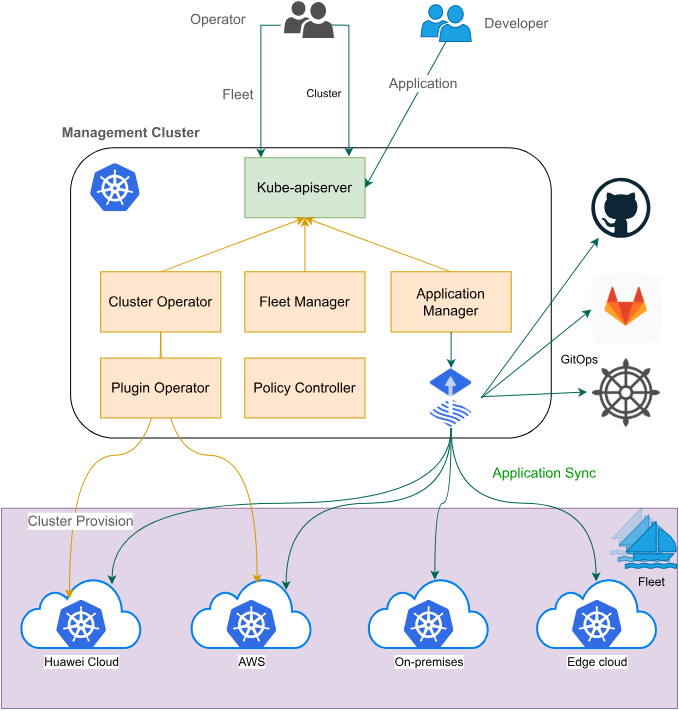

Kurator的架构设计体现了"分层解耦、能力聚合"的理念。底层是各种基础设施提供者(公有云、私有云、边缘节点),中间层是Kubernetes集群,上层则是Kurator提供的统一管理平面。

核心组件包括:

- Fleet Manager:多集群管理的核心,负责集群注册、策略同步、应用分发

- GitOps Engine:基于FluxCD的声明式配置管理,实现基础设施即代码

- Policy Engine:基于Kyverno的策略引擎,确保多集群环境下的策略一致性

- Scheduler Framework:整合Volcano的高级调度能力,支持AI/ML、批处理等复杂工作负载

- Edge Connector:与KubeEdge集成,实现云边协同

- Service Mesh Integration:与Istio深度集成,提供统一的流量管理

1.3 Kurator与传统云原生平台的差异化优势

相比传统的云原生平台,Kurator具有显著的差异化优势:

统一性:Kurator提供统一的资源编排、调度、流量管理、遥测能力,避免了在多集群环境中使用多套工具带来的管理复杂性。

声明式管理:通过基础设施即代码(Infrastructure-as-Code)的方式,Kurator将集群、节点、VPC等基础设施的管理也纳入声明式配置范畴,实现全栈自动化。

开箱即用:Kurator提供"一键安装"的云原生软件栈,大大降低了企业采用云原生技术的门槛。

扩展性:Kurator设计为高度可扩展的架构,通过插件机制可以轻松集成新的组件和能力,适应不断变化的业务需求。

1.4 Kurator在企业数字化转型中的角色

在企业数字化转型中,Kurator扮演着"数字化基座"的角色。它不仅提供了技术基础设施,更重要的是建立了标准化、自动化的管理流程,让企业能够专注于业务创新而非基础设施维护。

通过Kurator,企业可以:

- 快速构建混合云、多云环境,避免供应商锁定

- 实现应用在不同环境间无缝迁移

- 建立统一的安全策略和合规标准

- 加速新业务上线,提高IT响应速度

- 降低运维复杂性和总体拥有成本(TCO)

二、Kurator环境搭建与基础配置

2.1 环境准备与前置条件

在开始搭建Kurator环境前,需要准备以下前置条件:

- 至少一个运行中的Kubernetes集群(v1.20+)

- Helm v3.8+

- kubectl v1.20+

- 具有集群管理员权限的kubeconfig

- 充足的CPU、内存和存储资源

- 网络连接到GitHub和Docker Hub

对于生产环境,建议准备多个Kubernetes集群(至少3个)以充分体验Kurator的多集群管理能力。这些集群可以分布在不同云提供商或本地数据中心。

2.2 Kurator源码获取与安装流程

首先,我们需要获取Kurator的源代码:

git clone https://github.com/kurator-dev/kurator.git

cd kurator

获取完的图片:

获取源码后,我们可以查看Kurator的目录结构,其中包含:

charts/:Helm Chart定义examples/:示例配置文件hack/:开发和构建脚本pkg/:Go源代码scripts/:安装和管理脚本

安装Kurator核心组件:

# 添加Kurator Helm仓库

helm repo add kurator https://kurator-dev.github.io/kurator-charts

helm repo update

# 创建命名空间

kubectl create namespace kurator-system

# 安装Kurator控制平面

helm install kurator kurator/kurator -n kurator-system --set global.clusterName=management-cluster

安装过程会部署Kurator的核心组件,包括Fleet Manager、GitOps引擎、策略引擎等。整个过程通常需要5-10分钟,取决于网络连接速度和集群资源。

2.3 集群初始化与基础配置

安装完成后,需要初始化Kurator配置。创建一个Fleet资源定义,用于管理多个集群:

# examples/fleet.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

meta

name: production-fleet

namespace: kurator-system

spec:

clusters:

- name: cluster-1

kubeConfigSecret: cluster-1-kubeconfig

- name: cluster-2

kubeConfigSecret: cluster-2-kubeconfig

placement:

clusterSelector:

env: production

应用Fleet配置:

kubectl apply -f examples/fleet.yaml

接下来,需要为每个成员集群创建kubeconfig secret:

# 为cluster-1创建secret

kubectl create secret generic cluster-1-kubeconfig \

--from-file=kubeconfig=./cluster-1.kubeconfig \

-n kurator-system

# 为cluster-2创建secret

kubectl create secret generic cluster-2-kubeconfig \

--from-file=kubeconfig=./cluster-2.kubeconfig \

-n kurator-system

2.4 验证安装与基础功能测试

验证Kurator安装是否成功:

# 检查Kurator核心组件状态

kubectl get pods -n kurator-system

# 检查Fleet状态

kubectl get fleet -n kurator-system

# 检查成员集群注册状态

kubectl get clusters.fleet.kurator.dev -n kurator-system

测试基础功能,创建一个简单的应用配置:

# examples/nginx-app.yaml

apiVersion: apps/v1

kind: Deployment

meta

name: nginx

namespace: default

spec:

replicas: 3

selector:

matchLabels:

app: nginx

template:

meta

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx:1.21

ports:

- containerPort: 80

使用Kurator的GitOps能力,将应用部署到所有注册的集群:

# 将配置提交到Git仓库

git add examples/nginx-app.yaml

git commit -m "Add nginx application"

git push origin main

# 观察应用部署状态

kubectl get deployments -A --context=cluster-1

kubectl get deployments -A --context=cluster-2

三、Kurator多集群管理框架详解

3.1 Fleet架构设计与核心概念

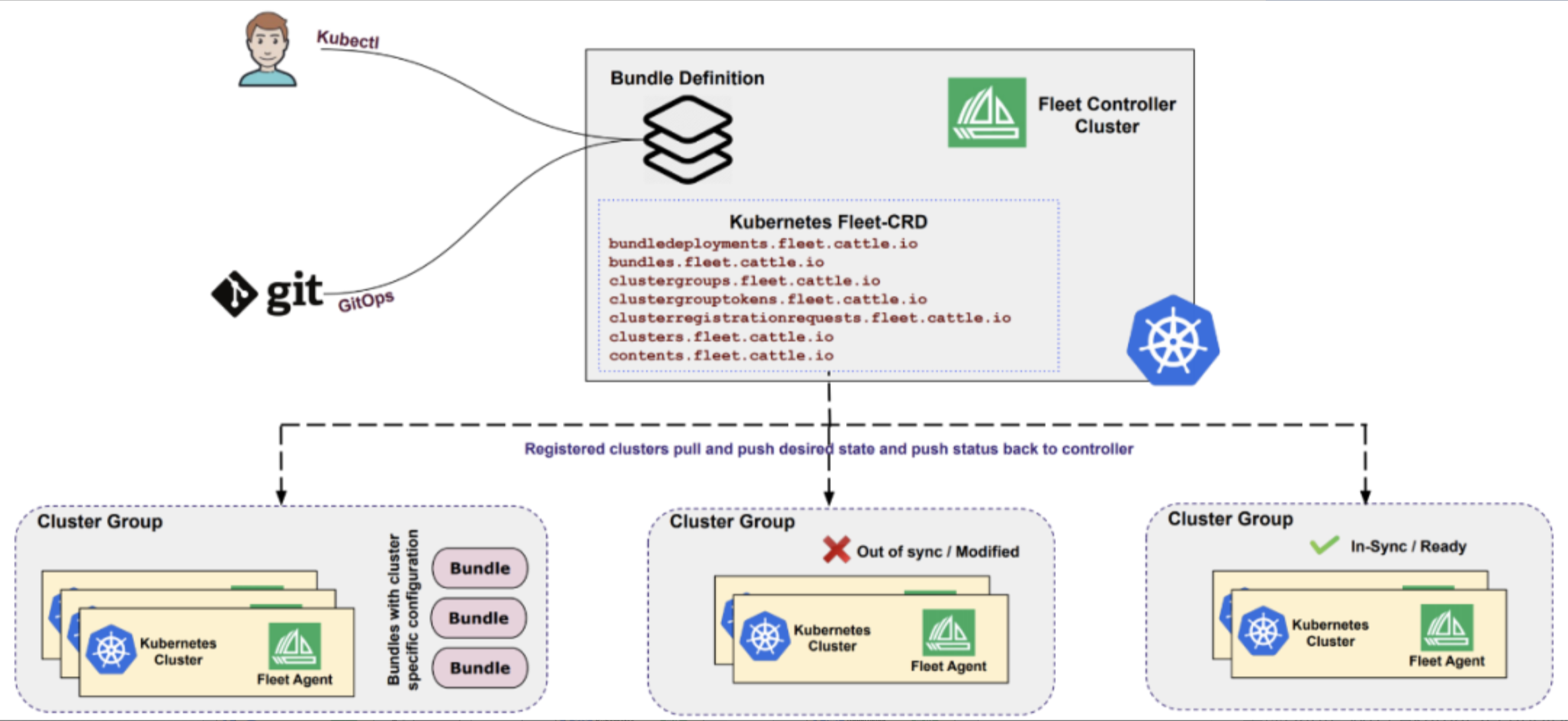

Fleet是Kurator多集群管理的核心抽象,它代表了一组具有共同管理目标的Kubernetes集群集合。Fleet的设计理念是"逻辑分组,统一管理",通过将物理上分散的集群组织成逻辑上的Fleet,实现统一的策略应用、资源分发和监控聚合。

Fleet的核心概念包括:

- Cluster Registration:集群注册机制,支持自动发现和手动注册

- Cluster Selector:基于标签的集群选择器,用于精确控制策略和应用的分发范围

- Namespace Sameness:确保相同命名空间在不同集群中具有一致的配置和策略

- Service Sameness:跨集群服务发现,使应用能够在不同集群间无缝通信

Fleet架构采用控制器模式,通过持续监控集群状态和期望状态,自动进行状态同步和修复,确保多集群环境的一致性和可靠性。

3.2 集群注册与生命周期管理

Kurator支持多种集群注册方式:

- 手动注册:通过kubeconfig文件注册现有集群

- 自动发现:通过云提供商API自动发现和注册集群

- 自助注册:边缘集群通过注册令牌自助加入Fleet

集群生命周期管理包括:

- 注册:将新集群加入Fleet

- 升级:统一管理集群Kubernetes版本和组件升级

- 扩缩容:根据负载自动或手动调整集群规模

- 注销:安全地将集群从Fleet中移除

以下是一个完整的集群注册流程示例:

# 生成集群注册令牌

kubectl create token kurator:cluster-registrar -n kurator-system --duration=24h

# 在成员集群上安装Kurator代理

helm install kurator-agent kurator/kurator-agent \

--set agent.registration.token=<generated-token> \

--set agent.registration.server=https://kurator-control-plane:8443 \

-n kurator-system

3.3 统一资源编排与同步机制

Kurator通过GitOps模式实现统一资源编排,核心是将集群期望状态存储在Git仓库中,通过自动化流程同步到目标集群。

资源同步机制包括:

- Pull模式:成员集群主动从Git仓库拉取配置

- Push模式:控制平面主动将配置推送到成员集群

- 混合模式:关键配置使用Pull模式,动态配置使用Push模式

同步策略可以定义:

- 同步频率(实时、定时)

- 同步范围(全量、增量)

- 冲突解决策略(控制平面优先、成员集群优先、人工审核)

以下是一个复杂的同步策略配置示例:

apiVersion: gitops.kurator.dev/v1alpha1

kind: ClusterSyncPolicy

meta

name: production-sync

namespace: kurator-system

spec:

source:

git:

repoURL: https://github.com/your-org/cluster-configs.git

path: production

revision: main

target:

fleetSelector:

env: production

syncPolicy:

automated:

prune: true

selfHeal: true

syncOptions:

- CreateNamespace=true

- PrunePropagationPolicy=foreground

- RespectIgnoreDifferences=true

retryStrategy:

limit: 3

backoff:

duration: 5s

factor: 2

maxDuration: 3m

3.4 跨集群服务发现与通信

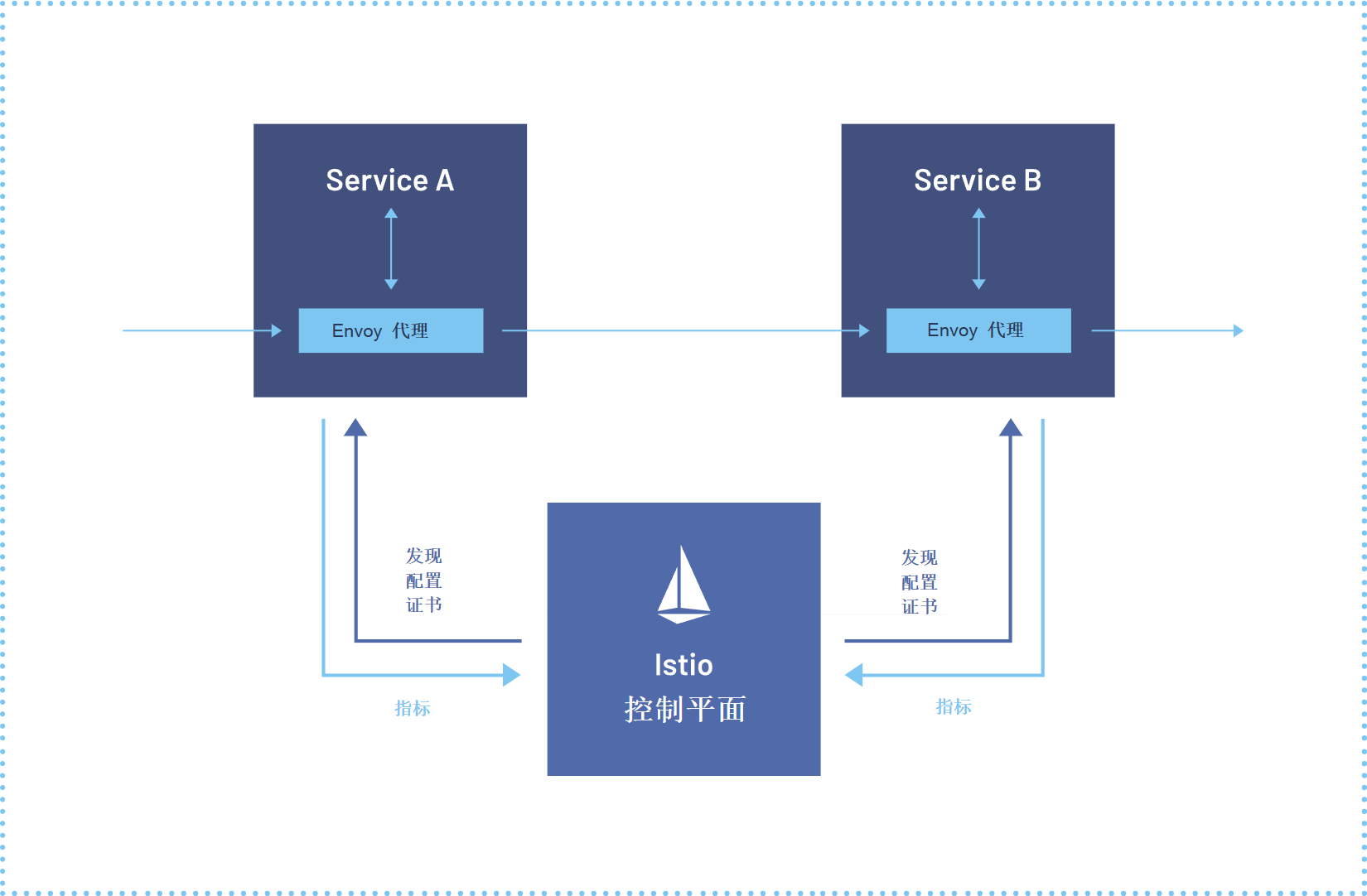

在多集群环境中,服务发现和通信是最复杂的挑战之一。Kurator通过集成Istio服务网格,提供统一的服务发现和通信能力。

跨集群服务通信模式包括:

- 全局服务:在所有集群中暴露相同的服务

- 区域服务:仅在特定区域的集群中暴露服务

- 分片服务:将服务分片部署在不同集群,通过统一入口访问

服务发现机制:

- DNS-based:通过CoreDNS插件实现跨集群DNS解析

- Service Mesh:通过Istio控制平面实现统一的服务目录

- API Gateway:通过统一的API网关暴露多集群服务

以下是一个跨集群服务配置示例:

apiVersion: networking.istio.io/v1alpha3

kind: ServiceEntry

meta

name: global-service

namespace: istio-system

spec:

hosts:

- global-service.example.com

location: MESH_INTERNAL

resolution: DNS

endpoints:

- address: service-namespace.service-1.svc.cluster.local

ports:

http: 80

locality: cluster-1

- address: service-namespace.service-2.svc.cluster.local

ports:

http: 80

locality: cluster-2

ports:

- number: 80

name: http

protocol: HTTP

四、Karmada集成实践与跨集群调度

4.1 Karmada在Kurator中的定位与价值

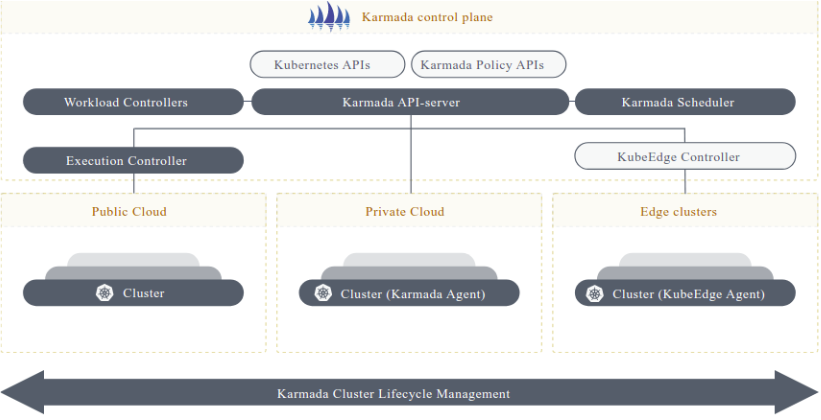

Karmada是CNCF的多集群调度项目,专注于应用的跨集群部署和调度。在Kurator中,Karmada作为核心调度引擎,负责:

- 应用在多集群间的分发策略

- 基于集群资源状况的智能调度

- 跨集群弹性伸缩

- 故障转移和自愈

Karmada的集成使Kurator具备了企业级的多集群应用管理能力,特别适合需要高可用性、多活部署的业务场景。

4.2 多集群应用分发策略配置

Karmada提供了丰富的分发策略,可以通过PropagationPolicy资源定义:

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

meta

name: nginx-propagation

namespace: default

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: nginx

placement:

clusterAffinity:

clusterNames:

- cluster-1

- cluster-2

replicaScheduling:

replicaDivisionPreference: Weighted

replicaSchedulingType: Divided

weightPreference:

staticWeightList:

- targetCluster:

clusterNames:

- cluster-1

weight: 60

- targetCluster:

clusterNames:

- cluster-2

weight: 40

此配置将nginx deployment按60:40的比例分发到两个集群,实现负载均衡和容灾。

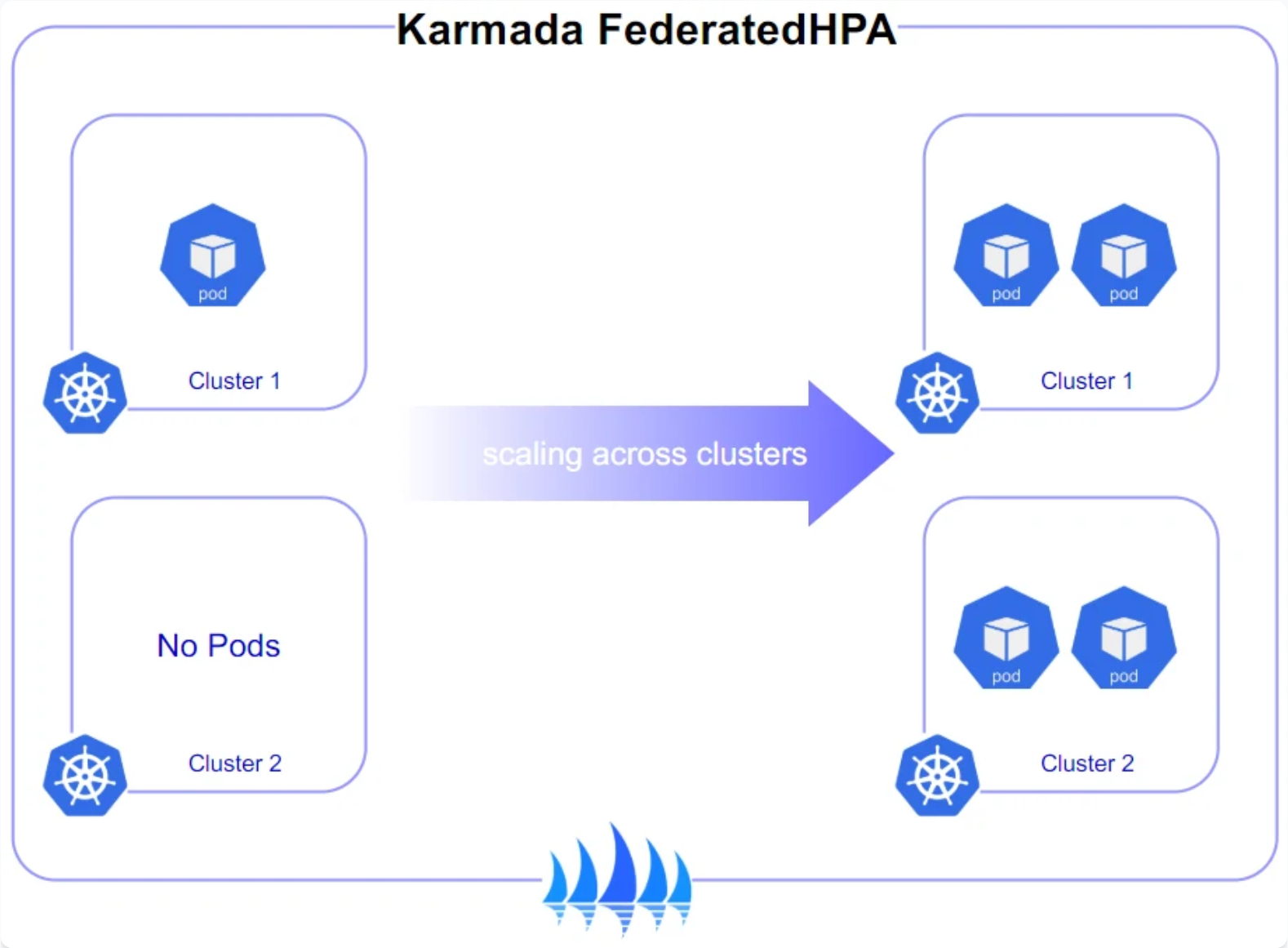

4.3 跨集群弹性伸缩实战

跨集群弹性伸缩是Karmada的核心能力之一。通过结合Kubernetes HPA和Karmada的ClusterPropagationPolicy,可以实现基于全局指标的弹性伸缩:

apiVersion: policy.karmada.io/v1alpha1

kind: ClusterPropagationPolicy

meta

name: hpa-policy

spec:

resourceSelectors:

- apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

name: global-hpa

placement:

clusterAffinity:

clusterNames:

- cluster-1

- cluster-2

---

apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

meta

name: global-hpa

namespace: default

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: nginx

minReplicas: 10

maxReplicas: 100

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 50

Karmada会监控全局CPU利用率,当超过50%时,自动在两个集群中增加副本数,保持整体负载均衡。

五、边缘计算与KubeEdge深度集成

5.1 边缘-云协同架构设计

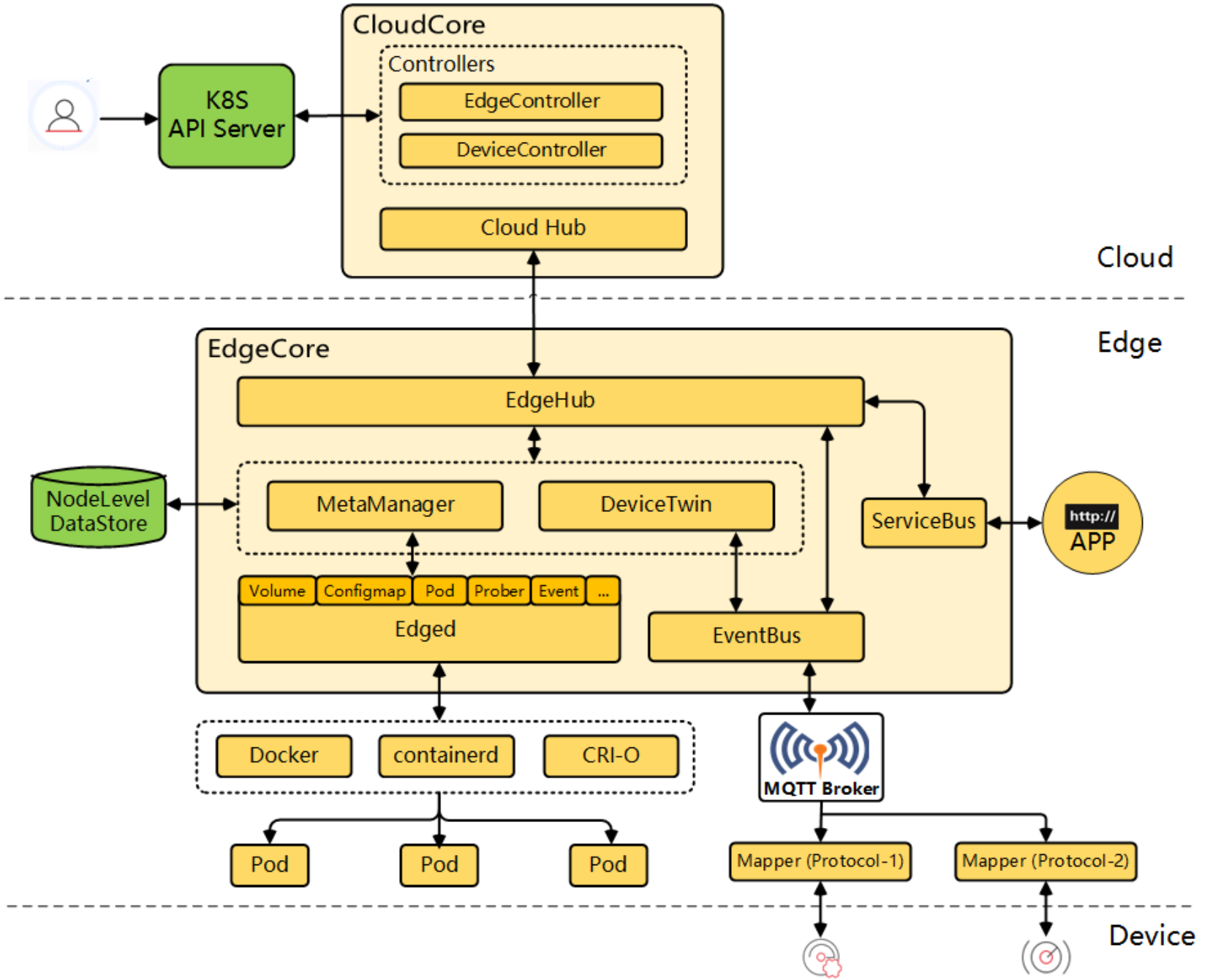

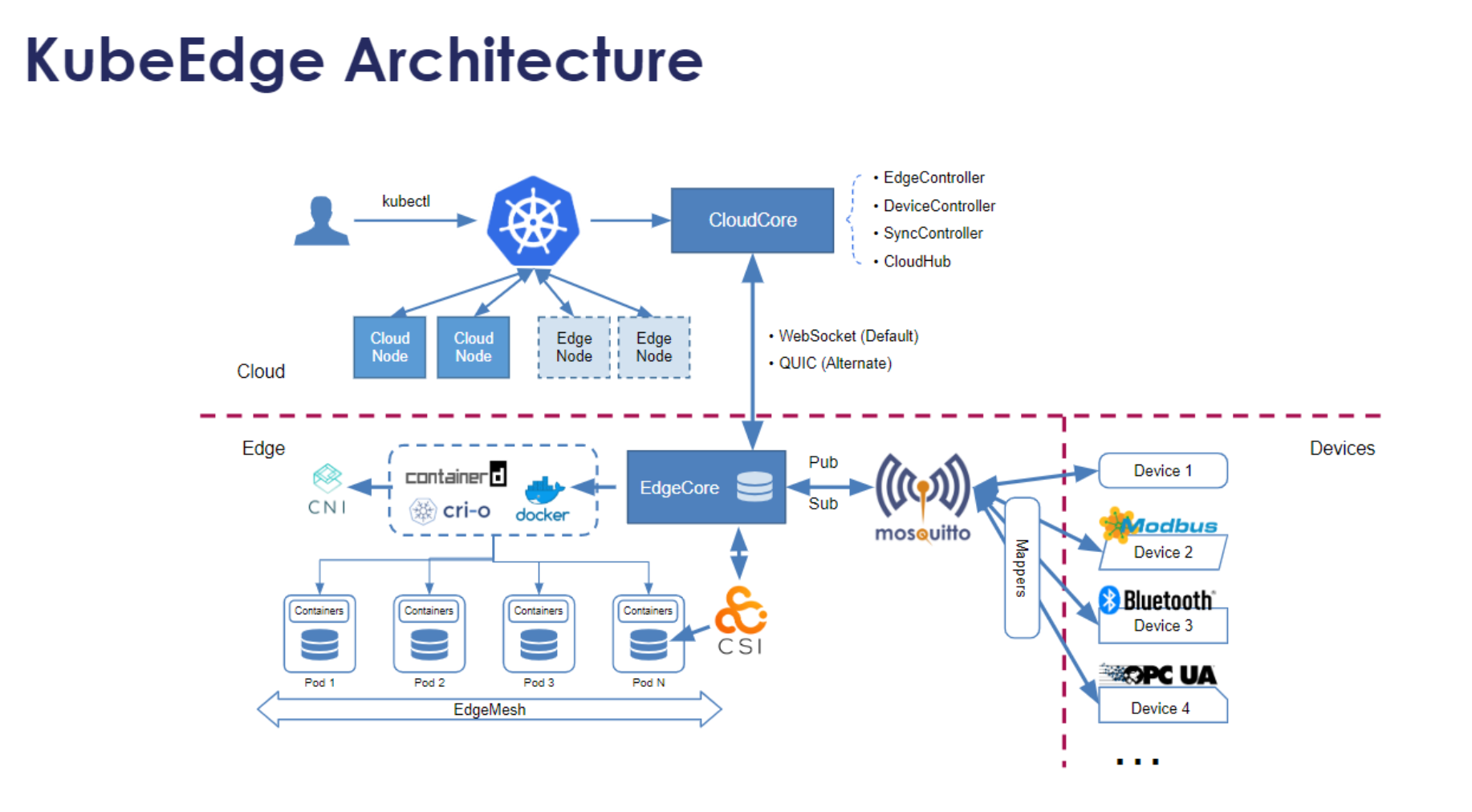

Kurator通过集成KubeEdge,实现了云边协同架构。在这种架构中:

- 云侧:负责全局策略管理、应用编排、监控聚合

- 边缘侧:负责本地执行、数据预处理、离线运行

- 通信层:通过MQTT、WebSocket等协议实现云边双向通信

架构设计原则:

- 分层自治:边缘节点在断网情况下能够独立运行

- 策略同步:云侧策略能够及时同步到边缘

- 数据过滤:边缘数据经过过滤后再上传到云端

- 安全隔离:云边通信采用TLS加密,边缘节点身份严格验证

5.2 KubeEdge在Kurator中的集成模式

Kurator与KubeEdge的集成采用插件化设计:

- 边缘集群注册:边缘节点通过Kurator Fleet注册为特殊类型的集群

- 边缘应用分发:通过Karmada策略,将适合边缘的应用分发到边缘集群

- 边缘监控集成:边缘监控指标聚合到云侧Prometheus

- 边缘策略管理:通过Kyverno策略引擎,统一管理边缘安全策略

集成架构图:

+----------------+ +----------------+ +----------------+

| Cloud Control | | Edge Cluster | | Edge Nodes |

| Plane |<-->| (KubeEdge) |<-->| (EdgeCore) |

| (Kurator) | | | | |

+----------------+ +----------------+ +----------------+

^

|

+----------------+

| GitOps Repo |

| (Config) |

+----------------+

5.3 边缘节点管理与应用分发

边缘节点注册流程:

# 1. 在Kurator控制平面创建边缘集群

kubectl create cluster edge-cluster-1 --kubeconfig=edge-kubeconfig.yaml

# 2. 部署KubeEdge组件到边缘集群

kubectl apply -f https://raw.githubusercontent.com/kubeedge/kubeedge/master/build/crds/devices/devices_v1alpha2_device.yaml

kubectl apply -f https://raw.githubusercontent.com/kubeedge/kubeedge/master/build/crds/devices/devices_v1alpha2_devicemodel.yaml

# 3. 在边缘节点安装EdgeCore

wget https://github.com/kubeedge/kubeedge/releases/download/v1.12.1/keadm-v1.12.1-linux-amd64.tar.gz

tar xvf keadm-v1.12.1-linux-amd64.tar.gz

./keadm init edge --cloudcore-ipport=<cloudcore-ip>:10000 --edgenode-name=edge-node-1

边缘应用分发策略:

apiVersion: policy.kurator.dev/v1alpha1

kind: EdgeAppPolicy

metadata:

name: edge-ai-inference

namespace: default

spec:

appSelector:

matchLabels:

app: ai-inference

placement:

edgeNodeSelector:

region: factory

zone: production-line

resourceRequirements:

cpu: "2"

memory: 4Gi

gpu: "1"

offlineStrategy:

tolerateUnreadySeconds: 300

reconnectStrategy: Always

六、GitOps与持续交付实践

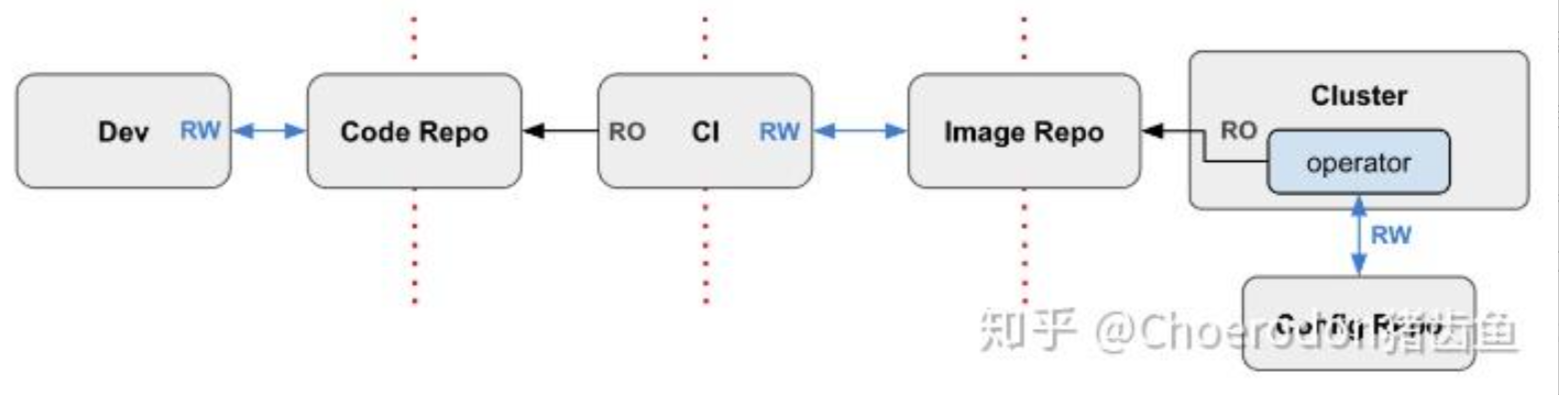

6.1 Kurator中的GitOps实现方式

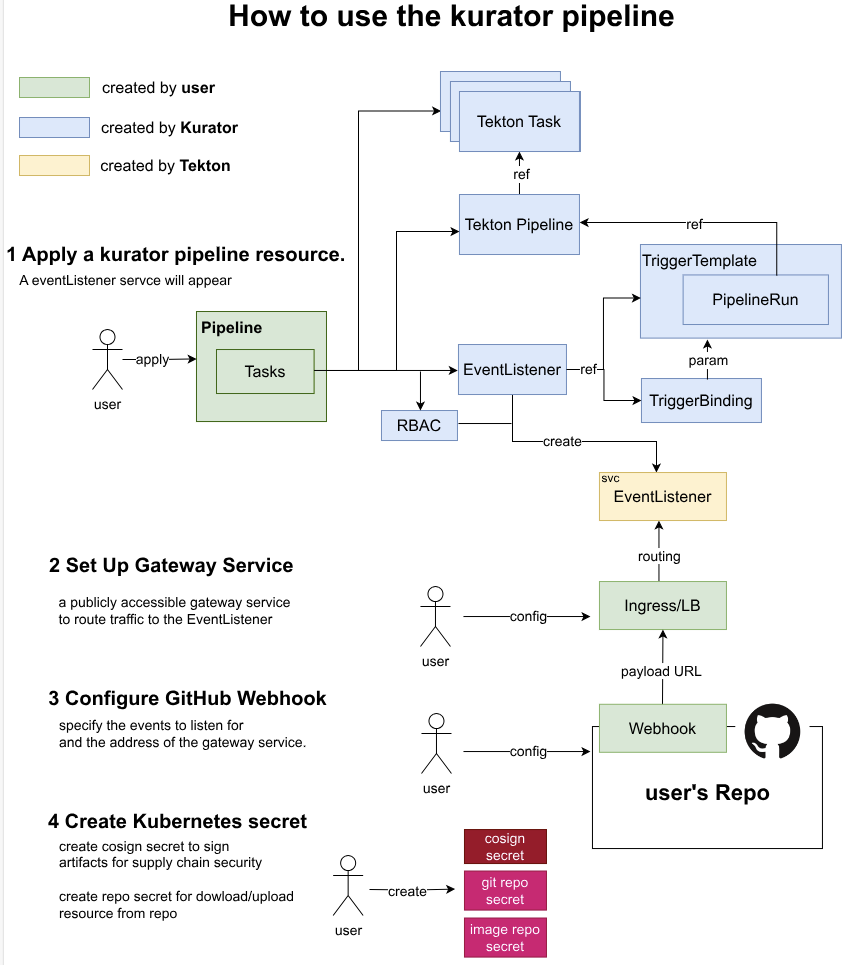

Kurator基于FluxCD实现了完整的GitOps能力,其核心架构包括:

- Source Controller:管理Git、Helm、Bucket等源

- Kustomize Controller:处理Kustomize配置

- Helm Controller:管理Helm releases

- Notification Controller:处理事件通知

GitOps工作流:

- 开发者提交代码和配置到Git仓库

- Source Controller检测到变更

- Kustomize/Helm Controller应用变更到集群

- 系统状态与Git仓库保持同步

- 通知团队变更结果

优势:

- 审计追踪:所有变更都有Git提交记录

- 回滚简单:通过Git revert快速回滚

- 协作友好:通过Pull Request实现团队协作

- 环境一致:不同环境通过不同分支或路径管理

6.2 应用部署流水线设计

Kurator的CI/CD流水线设计遵循声明式原则:

+--------+ +---------+ +-----------+ +----------+

| Code | -> | Build | -> | GitRepo | -> | Deploy |

| Commit| | Image | | (Config) | | (Fleet) |

+--------+ +---------+ +-----------+ +----------+

| | |

v v v

Container Registry Git Server Kubernetes Clusters

流水线配置示例(GitHub Actions):

name: Kurator CI/CD Pipeline

on:

push:

branches: [ main ]

pull_request:

branches: [ main ]

jobs:

build-and-test:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Build Docker image

run: |

docker build -t my-app:${{ github.sha }} .

docker push my-registry/my-app:${{ github.sha }}

- name: Run tests

run: ./run-tests.sh

deploy-to-staging:

needs: build-and-test

if: github.ref == 'refs/heads/main'

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Update staging manifest

run: |

sed -i "s/image: .*/image: my-registry\/my-app:${{ github.sha }}/" manifests/staging/deployment.yaml

- name: Commit and push

run: |

git config user.name "GitHub Actions"

git config user.email "actions@github.com"

git add manifests/staging/deployment.yaml

git commit -m "Update staging to ${{ github.sha }}"

git push

deploy-to-production:

needs: deploy-to-staging

runs-on: ubuntu-latest

environment: production

steps:

- uses: actions/checkout@v3

- name: Update production manifest

run: |

sed -i "s/image: .*/image: my-registry\/my-app:${{ github.sha }}/" manifests/production/deployment.yaml

- name: Create Pull Request

uses: peter-evans/create-pull-request@v4

with:

token: ${{ secrets.GITHUB_TOKEN }}

commit-message: Update production to ${{ github.sha }}

title: Update production deployment

body: |

This PR updates the production deployment to commit ${{ github.sha }}

Please review carefully before merging.

branch: update-production-${{ github.sha }}

base: main

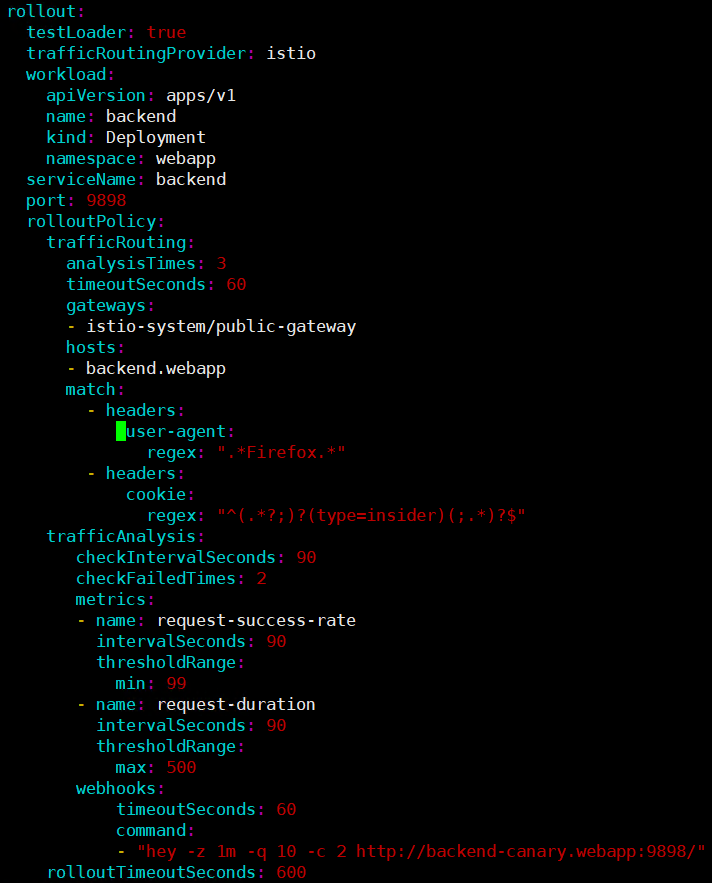

6.3 A/B测试与流量管理实践

Kurator通过Istio实现精细化的流量管理:

A/B测试配置:

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: user-service

namespace: default

spec:

hosts:

- user-service

http:

- match:

- headers:

user-agent:

regex: ".*Firefox.*"

route:

- destination:

host: user-service

subset: firefox-users

weight: 100

- match:

- headers:

cookie:

regex: "user_segment=premium"

route:

- destination:

host: user-service

subset: premium-users

weight: 100

- route:

- destination:

host: user-service

subset: default

weight: 100

---

apiVersion: networking.istio.io/v1alpha3

kind: DestinationRule

metadata:

name: user-service

namespace: default

spec:

host: user-service

subsets:

- name: firefox-users

labels:

version: v2

- name: premium-users

labels:

version: v3

- name: default

labels:

version: v1

基于用户特征的流量分割:

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: recommendation-service

spec:

hosts:

- recommendation-service

http:

- match:

- headers:

x-user-type:

exact: "new"

route:

- destination:

host: recommendation-service

subset: new-user-model

weight: 100

- match:

- headers:

x-user-type:

exact: "returning"

route:

- destination:

host: recommendation-service

subset: returning-user-model

weight: 100

- route:

- destination:

host: recommendation-service

subset: default-model

weight: 100

七、统一可观测性与智能运维

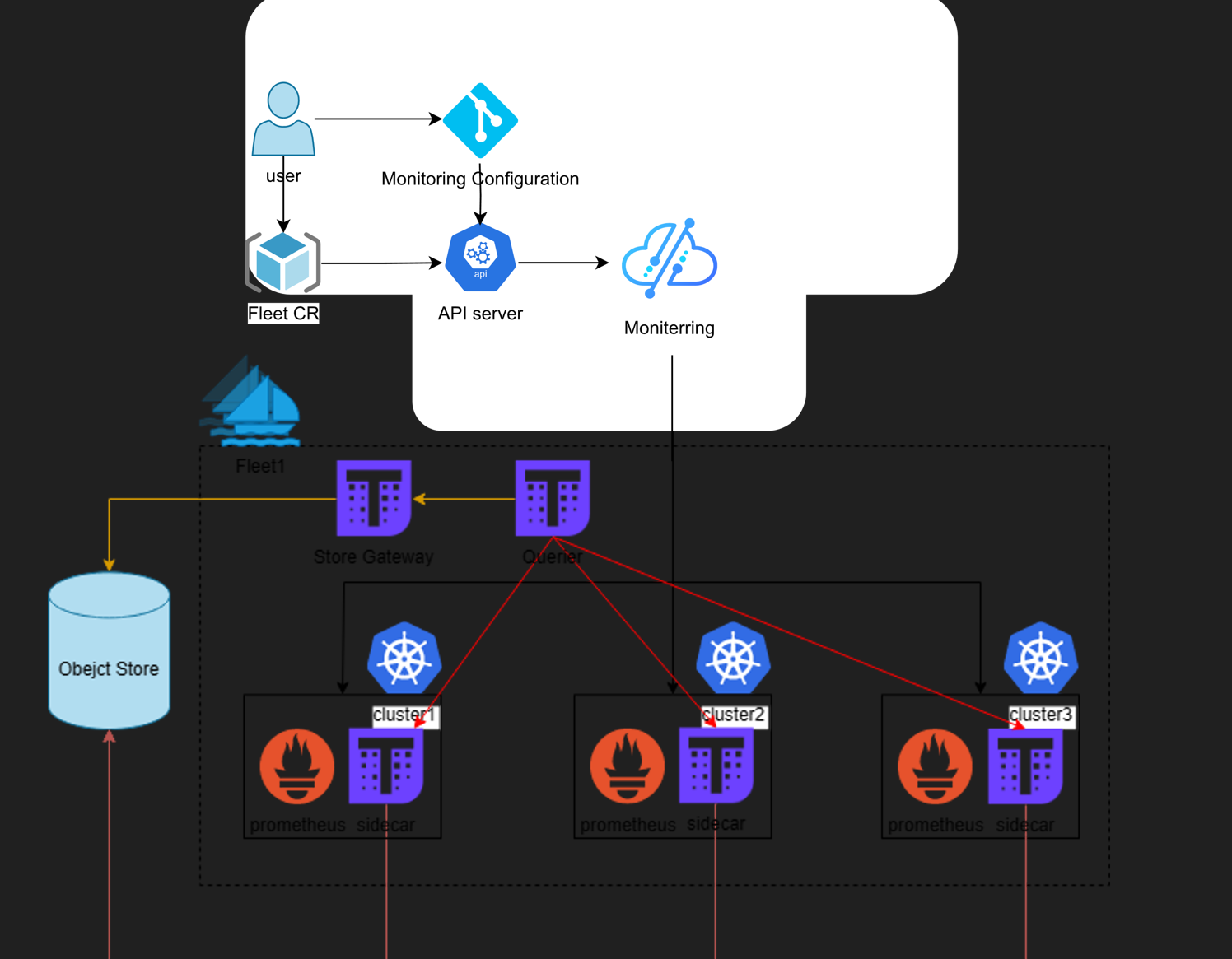

7.1 多集群监控指标聚合

Kurator通过Prometheus联邦和Thanos实现多集群监控聚合:

架构设计:

- 每个集群部署本地Prometheus实例

- Thanos Sidecar将本地数据上传到对象存储

- Thanos Query提供统一查询接口

- Thanos Ruler实现全局告警规则

配置示例:

apiVersion: monitoring.coreos.com/v1

kind: Prometheus

meta

name: cluster-prometheus

namespace: monitoring

spec:

replicas: 2

serviceAccountName: prometheus

serviceMonitorSelector:

matchLabels:

team: frontend

ruleSelector:

matchLabels:

role: rulefile

retention: 24h

storage:

volumeClaimTemplate:

spec:

storageClassName: standard

resources:

requests:

storage: 50Gi

thanos:

image: quay.io/thanos/thanos:v0.25.0

version: v0.25.0

objectStorageConfig:

key: objectstorage.yaml

name: thanos-objstore-config

全局查询配置:

apiVersion: v1

kind: ConfigMap

meta

name: thanos-query-config

namespace: monitoring

stores.yaml: |

- member: cluster-1

address: cluster-1-thanos-query.monitoring.svc.cluster.local:10901

- member: cluster-2

address: cluster-2-thanos-query.monitoring.svc.cluster.local:10901

- member: edge-cluster-1

address: edge-cluster-1-thanos-query.monitoring.svc.cluster.local:10901

7.2 分布式追踪与日志管理

Kurator集成Jaeger和Loki实现全栈可观测性:

分布式追踪配置:

apiVersion: jaegertracing.io/v1

kind: Jaeger

metadata:

name: kurator-jaeger

spec:

strategy: production

storage:

type: elasticsearch

options:

es:

server-urls: http://elasticsearch:9200

ingress:

enabled: true

hosts:

- jaeger.example.com

agent:

strategy: DaemonSet

sampling:

options:

default_strategy:

type: probabilistic

param: 0.1

日志管理配置:

apiVersion: v1

kind: ServiceAccount

meta

name: loki

namespace: logging

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

meta

name: loki-read

rules:

- apiGroups: [""]

resources:

- nodes

- namespaces

- pods

verbs: ["get", "list", "watch"]

---

apiVersion: v1

kind: ConfigMap

meta

name: loki-config

namespace: logging

loki.yaml: |

auth_enabled: false

server:

http_listen_port: 3100

ingester:

lifecycler:

address: 127.0.0.1

ring:

kvstore:

store: inmemory

replication_factor: 1

final_sleep: 0s

chunk_idle_period: 5m

chunk_retain_period: 30s

schema_config:

configs:

- from: 2020-05-15

store: boltdb

object_store: filesystem

schema: v11

index:

prefix: index_

period: 168h

storage_config:

boltdb:

directory: /data/loki/index

filesystem:

directory: /data/loki/chunks

limits_config:

enforce_metric_name: false

reject_old_samples: true

reject_old_samples_max_age: 168h

chunk_store_config:

max_look_back_period: 0s

table_manager:

retention_deletes_enabled: false

retention_period: 0s

## 八、Kurator未来发展方向与生态建设

### 8.1 分布式云原生技术趋势分析

随着云计算向分布式演进,以下趋势将塑造未来:

- **边缘智能化**:边缘节点将具备更强的AI推理能力

- **服务网格融合**:服务网格将成为多集群通信的标准

- **无服务器边缘**:边缘函数计算将兴起

- **数据网格**:分布式数据管理将成为关键挑战

- **安全左移**:安全策略将在设计阶段集成

Kurator需要在这些趋势中保持前瞻性,通过模块化架构适应变化。

### 8.2 Kurator社区发展与贡献指南

开源社区是Kurator成功的关键。贡献方式包括:

- **代码贡献**:核心功能开发、Bug修复

- **文档贡献**:教程、最佳实践、案例研究

- **生态集成**:与新组件的集成适配器

- **社区支持**:回答问题、组织活动

贡献流程:

1. Fork仓库

2. 创建特性分支

3. 编写代码/文档

4. 提交PR

5. 通过CI测试

6. 社区评审

7. 合并到主干

### 8.3 企业级特性路线图

Kurator的企业级特性路线图包括:

- **多租户支持**:RBAC增强、资源配额管理

- **合规性框架**:GDPR、HIPAA等合规性检查

- **商业支持**:SLA保障、专属支持团队

- **高级监控**:AIops、预测性维护

- **灾难恢复**:跨地域备份、快速恢复

### 8.4 开源协作与生态伙伴计划

Kurator的成功依赖于广泛的生态合作:

- **云提供商合作**:与主流云厂商深度集成

- **ISV合作**:与独立软件供应商共建解决方案

- **学术合作**:与高校研究机构合作创新

- **标准参与**:积极参与CNCF等标准制定

生态伙伴计划包括:

- 技术认证计划

- 联合解决方案开发

- 市场推广支持

- 培训与认证

## 结语

Kurator作为分布式云原生平台的先行者,通过整合优秀开源项目并创新性地解决多集群、多云、边缘计算等复杂场景下的挑战,为企业数字化转型提供了强大支撑。本文从平台架构、多集群管理、边缘计算、GitOps实践到统一可观测性,全面展示了Kurator的技术深度和实践价值。

随着云原生技术向分布式演进,Kurator将持续创新,通过开放的社区协作和生态建设,推动分布式云原生技术的发展。对于企业而言,拥抱Kurator意味着拥抱未来的云原生架构,在数字化浪潮中保持竞争优势。

技术发展永无止境,我们期待更多开发者和企业加入Kurator社区,共同构建更加开放、智能、可靠的分布式云原生平台。正如Kurator的理念所言:"站在巨人肩膀上,看得更远"。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)