【前瞻创想】Kurator分布式云原生平台实战:从多集群管理到边缘计算的全栈解决方案深度解析

【前瞻创想】Kurator分布式云原生平台实战:从多集群管理到边缘计算的全栈解决方案深度解析

【前瞻创想】Kurator分布式云原生平台实战:从多集群管理到边缘计算的全栈解决方案深度解析

摘要

Kurator作为一款开源的分布式云原生平台,站在Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada、Kyverno等众多优秀云原生项目的肩膀上,为企业提供了统一的多云、多集群管理能力。本文深入剖析Kurator的核心架构与关键组件,通过实战演示环境搭建、Fleet多集群管理、Karmada集成、KubeEdge边缘计算协同、Volcano批处理调度优化以及GitOps工作流实现等核心功能。文章不仅展示技术实现细节,更通过专业视角分析分布式云原生技术的发展趋势与最佳实践,为企业数字化转型提供可落地的解决方案参考。

一、Kurator平台架构与核心价值解析

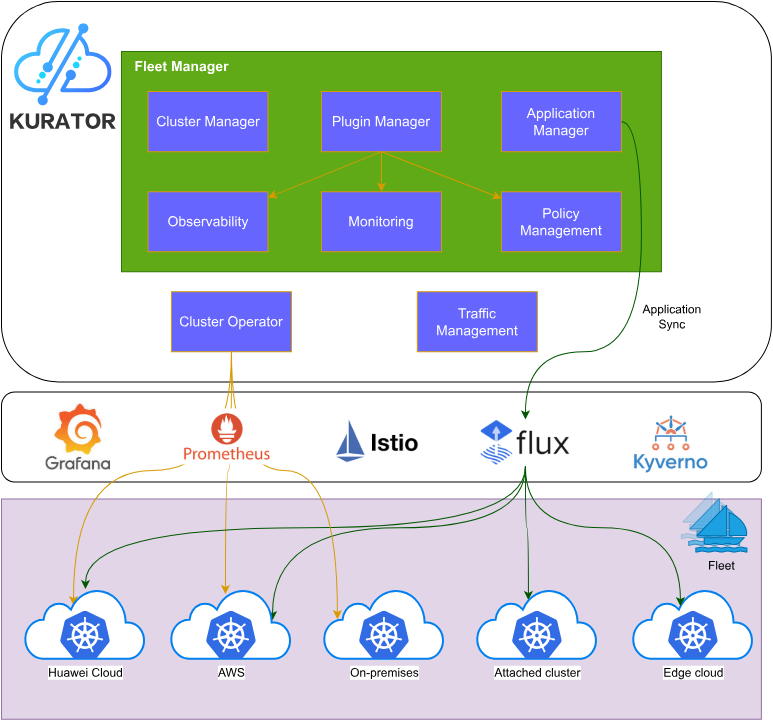

kurator架构参考图:

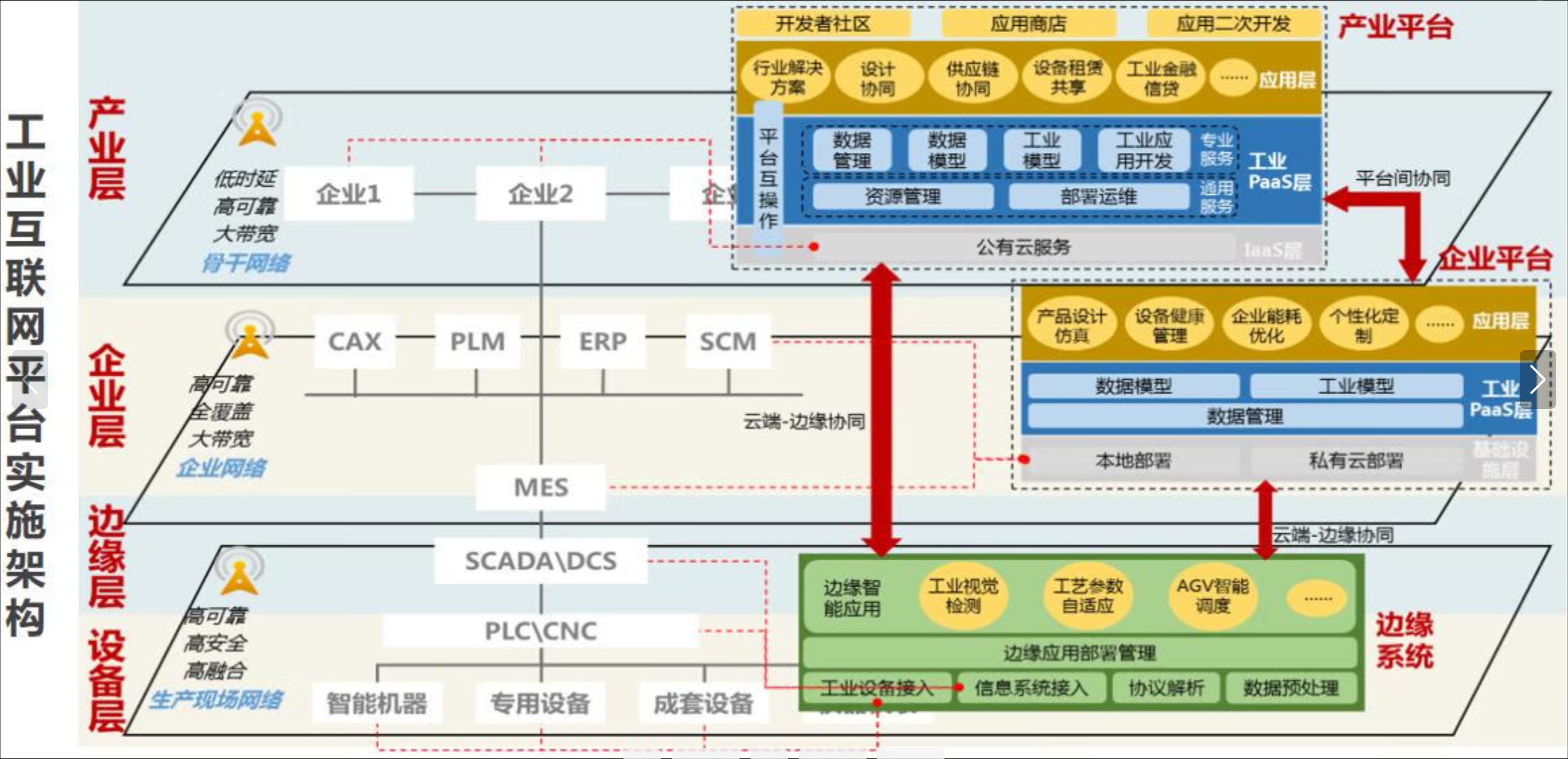

1.1 分布式云原生的时代背景与挑战

随着企业IT架构向云原生演进,多云、混合云、边缘计算等场景日益普遍。传统的单集群管理模式已无法应对分布式环境下的复杂挑战。Gartner预测,到2025年,超过75%的企业生成数据将在边缘处理,而多云策略已成为90%企业的标准选择。在此背景下,Kurator应运而生,它不是简单的工具集成,而是通过统一的抽象层和控制平面,将分散的云原生能力整合为有机整体。

Kurator的核心价值在于提供"统一而不统一"的管理哲学:在保持各集群自治性的基础上,实现资源、策略、流量、监控的统一管理。这种设计理念既避免了中心化管理的单点故障风险,又解决了分布式环境下的管理碎片化问题。通过将Kubernetes生态中的最佳实践固化为平台能力,Kurator大幅降低了企业构建分布式云原生基础设施的门槛。

1.2 Kurator的技术架构与组件生态

Kurator采用分层架构设计,底层依托Kubernetes作为基础控制平面,中间层集成多个领域专用项目,上层提供统一的API和管理界面。其核心组件包括:

- Fleet Manager:负责集群生命周期管理、策略同步、资源分发

- Cluster API扩展:提供声明式集群管理能力,支持主流云厂商和裸机部署

- GitOps引擎:基于FluxCD实现配置持续同步,确保期望状态与实际状态一致

- 跨集群服务发现:通过Karmada实现服务在多集群间的透明访问

- 边缘计算集成:深度整合KubeEdge,实现云边协同

- 批处理调度优化:集成Volcano,提供AI/大数据场景下的高级调度能力

- 安全策略框架:基于Kyverno实现统一的策略管理

这种架构设计使得Kurator既保持了模块化和可扩展性,又能提供开箱即用的完整解决方案。特别值得注意的是,Kurator并非重复造轮子,而是通过精妙的集成设计,让各个组件在其擅长的领域发挥最大价值,同时消除组件间的集成摩擦。

二、Kurator环境搭建与基础配置实战

2.1 环境准备与依赖安装

在开始Kurator安装前,需要准备符合要求的基础设施环境。Kurator支持多种部署模式,包括本地开发环境、单集群部署和多集群生产环境。本文以单集群模式为例,演示完整的安装流程。

首先,确保环境满足以下要求:

- Kubernetes集群版本1.20+

- kubectl命令行工具

- Helm 3.8+

- 至少4CPU/8GB内存的节点资源

- 支持StorageClass的持久化存储

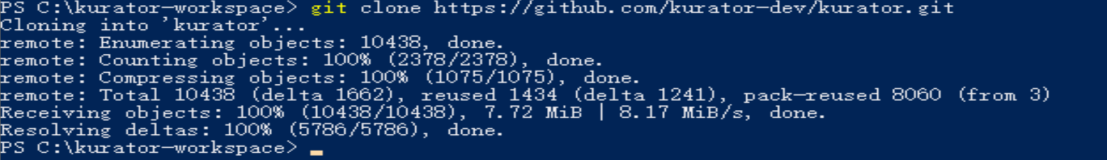

接下来,获取Kurator源码。按照要求,我们使用git clone命令:

git clone https://github.com/kurator-dev/kurator.git

cd kurator

如果网络环境受限,也可以使用wget下载zip包:

wget https://github.com/kurator-dev/kurator/archive/refs/heads/main.zip

unzip main.zip

cd kurator-main

如果显示下面的问题

表示没用设置git代理,我们可以先设置git代理;先看一下电脑上的代理端口

再设置git的代理端口,设置成本地代理

git config --global http.proxy http://127.0.0.1:7890

然后再拉取

git clone https://github.com/kurator-dev/kurator.git

就可以拉取资源了,当然也可以换源,你们可以试试

2.2 Kurator核心组件安装流程

Kurator采用Helm Chart进行组件管理,安装过程分为多个阶段。我们首先安装基础控制平面:

# 创建命名空间

kubectl create namespace kurator-system

# 添加Helm仓库

helm repo add kurator https://kurator-dev.github.io/charts

helm repo update

# 安装Kurator控制平面

helm install kurator kurator/kurator \

--namespace kurator-system \

--set global.tag=v0.3.0

安装完成后,验证各组件状态:

kubectl get pods -n kurator-system

预期输出应显示所有Pod处于Running状态,包括kurator-controller-manager、kurator-webhook等核心组件。

接下来,安装Fleet管理组件。Fleet是Kurator的核心抽象,用于管理集群组:

helm install fleet kurator/fleet \

--namespace kurator-system \

--set global.tag=v0.3.0

2.3 集群注册与Fleet初始化配置

环境搭建的最后一步是将目标集群注册到Kurator管理平台。Kurator支持两种注册方式:推送模式和拉取模式。推送模式由中心控制平面直接管理目标集群,适合网络互通的场景;拉取模式则适用于网络隔离的环境,目标集群主动拉取配置。

以下示例展示如何将本地集群注册为Fleet成员:

# fleet-member.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Cluster

meta

name: local-cluster

spec:

kubeconfigSecretRef:

name: local-cluster-kubeconfig

syncMode: Push

创建kubeconfig secret:

kubectl create secret generic local-cluster-kubeconfig \

--from-file=kubeconfig=/path/to/kubeconfig \

-n kurator-system

应用配置:

kubectl apply -f fleet-member.yaml

验证集群注册状态:

kubectl get clusters.fleet.kurator.dev

至此,Kurator基础环境搭建完成,可以开始探索其丰富的功能特性。

三、Fleet多集群管理深度实践

3.1 Fleet抽象模型与集群生命周期管理

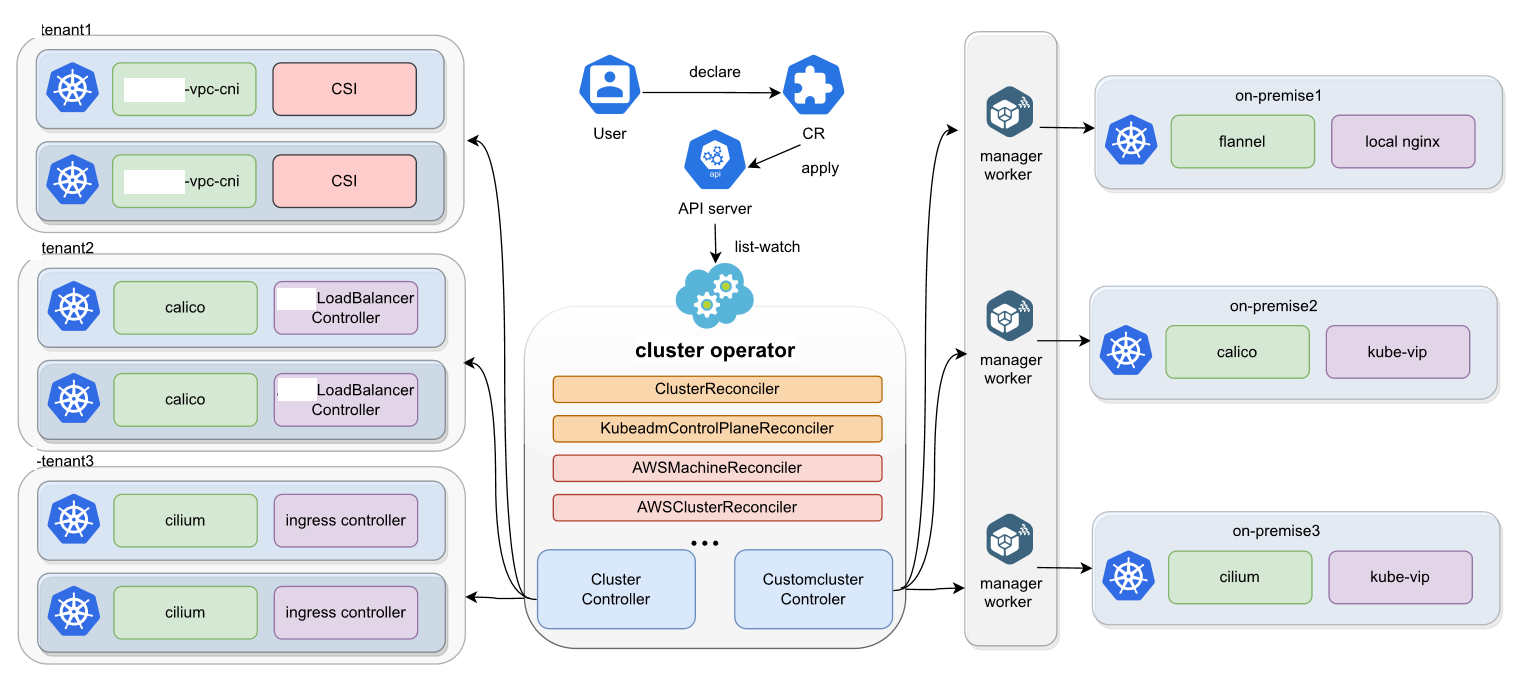

Kurator集群生命周期管理参考图:

Fleet是Kurator的核心抽象,它将多个Kubernetes集群组织为逻辑单元,提供统一的管理视图。Fleet模型包含三个关键概念:集群注册、策略同步和服务发现。

集群生命周期管理是Fleet的基础能力。通过Cluster API扩展,Kurator支持声明式集群创建、升级和销毁。以下示例展示如何创建一个AWS EKS集群:

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

meta

name: eks-cluster

spec:

provider: aws

region: us-west-2

controlPlane:

instanceType: t3.large

replicas: 3

workerNodes:

- instanceType: m5.large

replicas: 2

name: worker-pool-1

这种声明式方式不仅简化了集群管理,更重要的是将基础设施纳入版本控制系统,实现真正的Infrastructure as Code。

3.2 跨集群服务发现与流量管理

在多集群环境中,服务发现和流量管理是核心挑战。Kurator通过集成Istio和Karmada,提供了跨集群的服务发现能力。当服务部署在多个集群时,Kurator自动构建全局服务视图,客户端无需关心服务实例的具体位置。

以下配置展示如何在Fleet中定义跨集群服务:

apiVersion: fleet.kurator.dev/v1alpha1

kind: ServiceExport

meta

name: frontend

spec:

selector:

app: frontend

ports:

- port: 80

protocol: TCP

ServiceExport资源会将匹配的服务暴露到Fleet级别,其他集群中的Pod可以通过统一的DNS名称访问:<service-name>.<namespace>.svc.clusterset.local。

在流量管理方面,Kurator支持基于位置、延迟、负载等策略的智能路由。例如,可以配置就近访问策略,优先访问本地区域的实例:

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: frontend-route

spec:

hosts:

- frontend

http:

- route:

- destination:

host: frontend

subset: local-region

weight: 80

- destination:

host: frontend

subset: remote-region

weight: 20

3.3 Fleet策略统一与合规治理

多集群环境下的策略一致性是治理难题。Kurator通过集成Kyverno,提供统一的策略管理框架。策略可以定义在Fleet级别,自动同步到所有成员集群,确保合规性。

以下示例展示一个安全策略,禁止容器以root用户运行:

apiVersion: policies.kurator.dev/v1alpha1

kind: Policy

meta

name: prohibit-root-user

spec:

rules:

- name: check-container-security-context

match:

resources:

kinds:

- Pod

validate:

message: "Running as root user is not allowed"

pattern:

spec:

securityContext:

runAsNonRoot: true

策略同步机制采用最终一致性模型,即使目标集群暂时离线,策略也会在网络恢复后自动同步。这种设计特别适合边缘计算场景,其中边缘节点可能在网络不稳定的环境中运行。

此外,Kurator还提供策略审计报告,帮助管理员了解策略执行情况和违规记录,为安全治理提供数据支持。

四、Karmada集成与跨集群调度优化

4.1 Karmada核心架构与Kurator集成设计

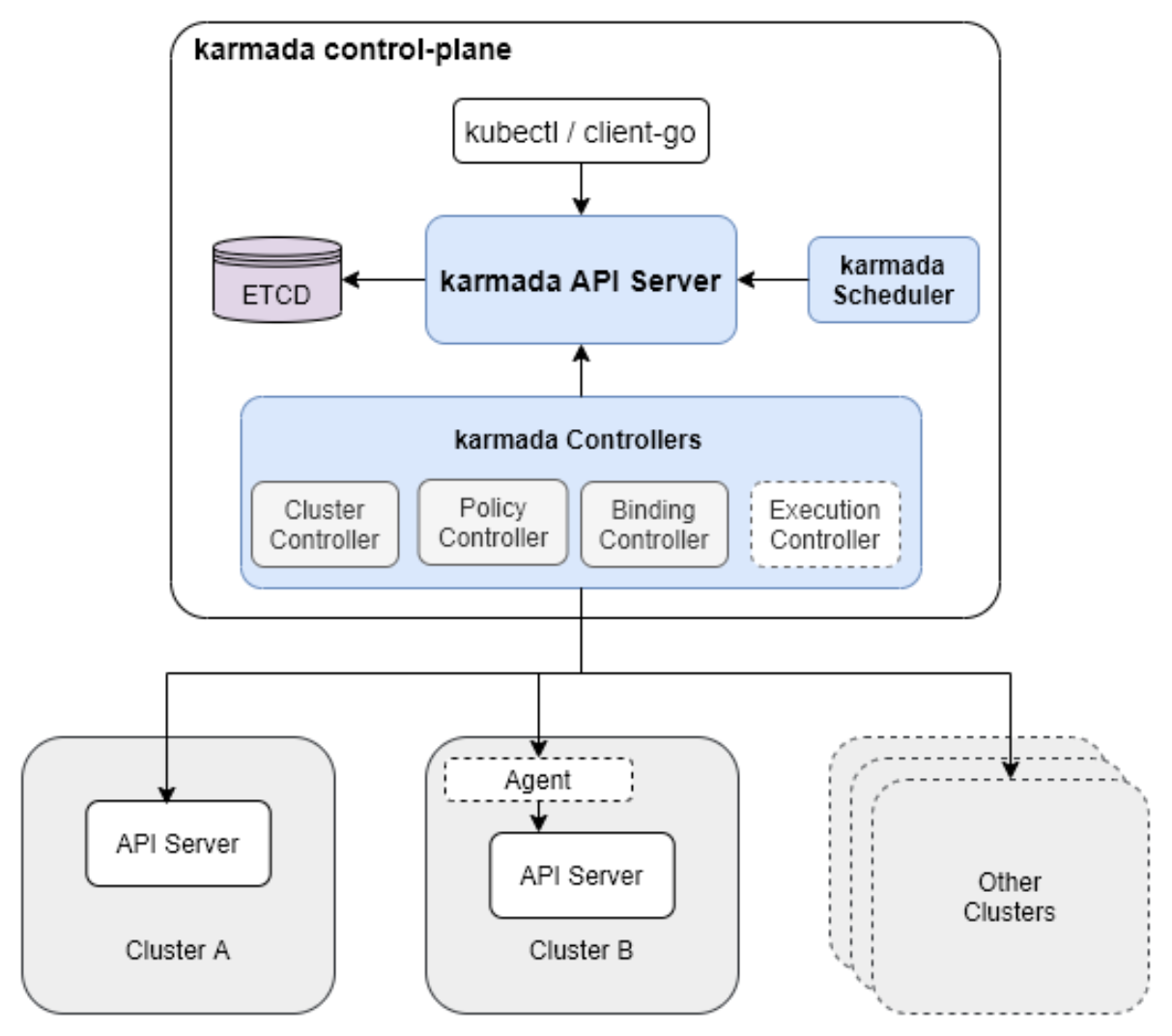

Karmada 的总体架构官方参考图:

Karmada是CNCF沙箱项目,专注于Kubernetes原生的多集群调度。Kurator深度集成了Karmada,作为其跨集群调度的核心引擎。Karmada的核心组件包括:

- karmada-control-plane:全局控制平面

- karmada-scheduler:负责将工作负载分配到目标集群

- karmada-controller-manager:协调资源同步

- karmada-agent:运行在成员集群,执行调度指令

在Kurator中,Karmada的集成采用旁路模式,不修改原生Kubernetes API,而是通过自定义资源定义(CRD)扩展功能。这种设计保证了与现有工具链的兼容性,同时提供了强大的跨集群能力。

4.2 跨集群弹性伸缩实践

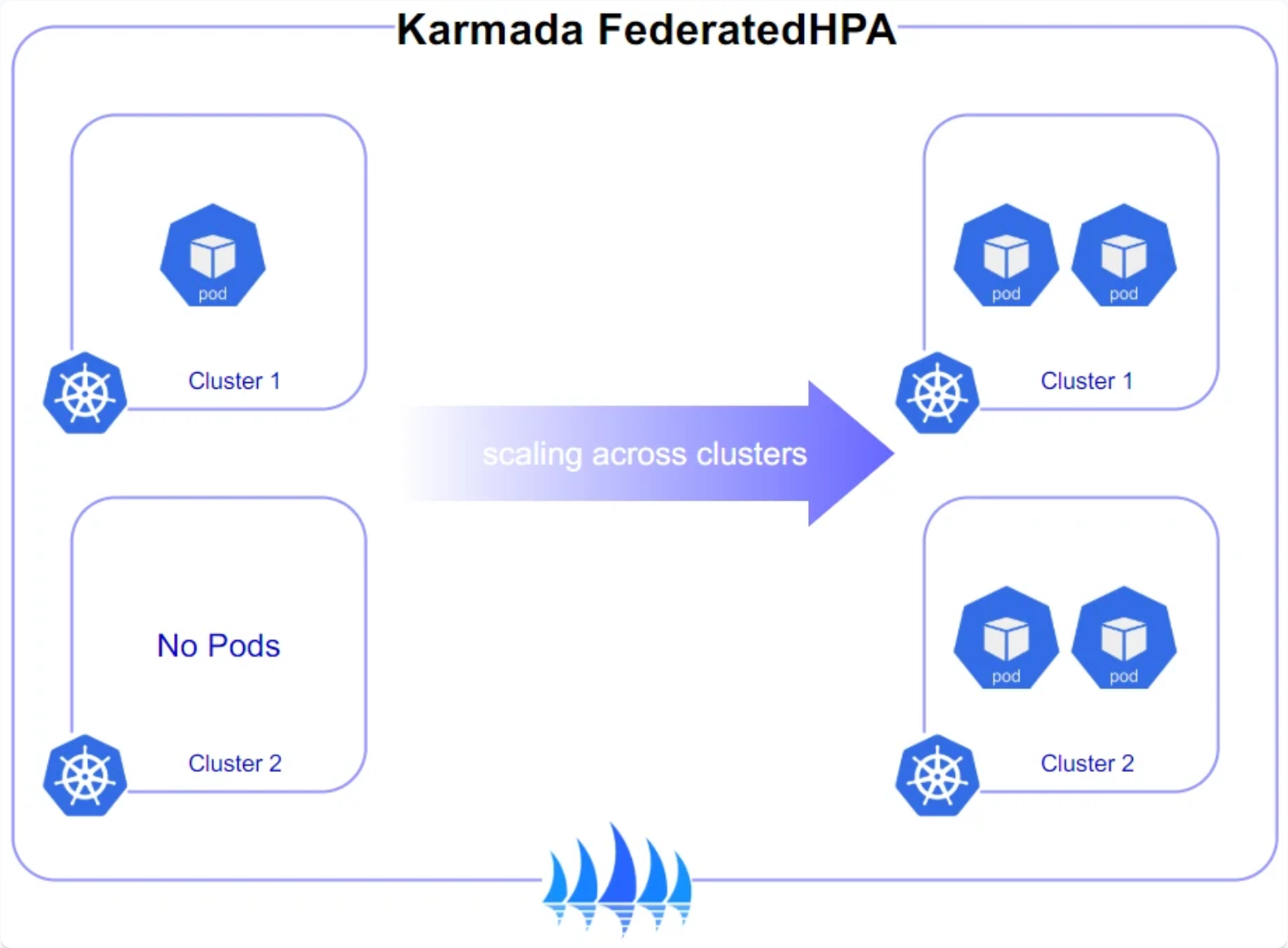

Karmada跨集群弹性伸缩策略参考图:

Karmada的ClusterAutoscaler组件为跨集群弹性伸缩提供了基础。结合Kurator的Fleet管理,可以实现细粒度的伸缩策略。以下示例展示如何配置基于CPU利用率的跨集群伸缩:

apiVersion: autoscaling.karmada.io/v1alpha1

kind: ClusterPropagationPolicy

meta

name: frontend-scaling

spec:

placement:

clusterAffinity:

clusterNames:

- cluster-east

- cluster-west

policy:

replicaScheduling:

replicaDivisionPreference: Weighted

replicas:

- clusterName: cluster-east

weight: 60

- clusterName: cluster-west

weight: 40

当集群资源不足时,Kurator会自动将工作负载迁移到资源充足的集群,实现真正的弹性伸缩。这种能力在应对流量峰值或灾难恢复场景时尤为重要。

4.3 多集群故障转移与高可用设计

在分布式系统中,故障转移是保障高可用的关键能力。Kurator结合Karmada实现了智能的多集群故障转移机制。当检测到某个集群异常时,系统会自动将工作负载重新调度到健康集群。

以下配置展示故障转移策略:

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

meta

name: frontend-failover

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: frontend

placement:

clusterAffinity:

clusterNames:

- primary-cluster

- backup-cluster

replicaScheduling:

replicaDivisionPreference: Weighted

replicas:

- clusterName: primary-cluster

weight: 100

- clusterName: backup-cluster

weight: 0

failover:

enabled: true

threshold: 5m

该策略定义主备模式,正常情况下所有副本运行在主集群,当主集群故障持续超过5分钟时,自动将流量切换到备份集群。Kurator还集成了Prometheus监控指标,提供故障转移的可视化和告警能力,帮助运维团队快速响应。

五、KubeEdge边缘计算集成与云边协同

5.1 KubeEdge架构与核心组件解析

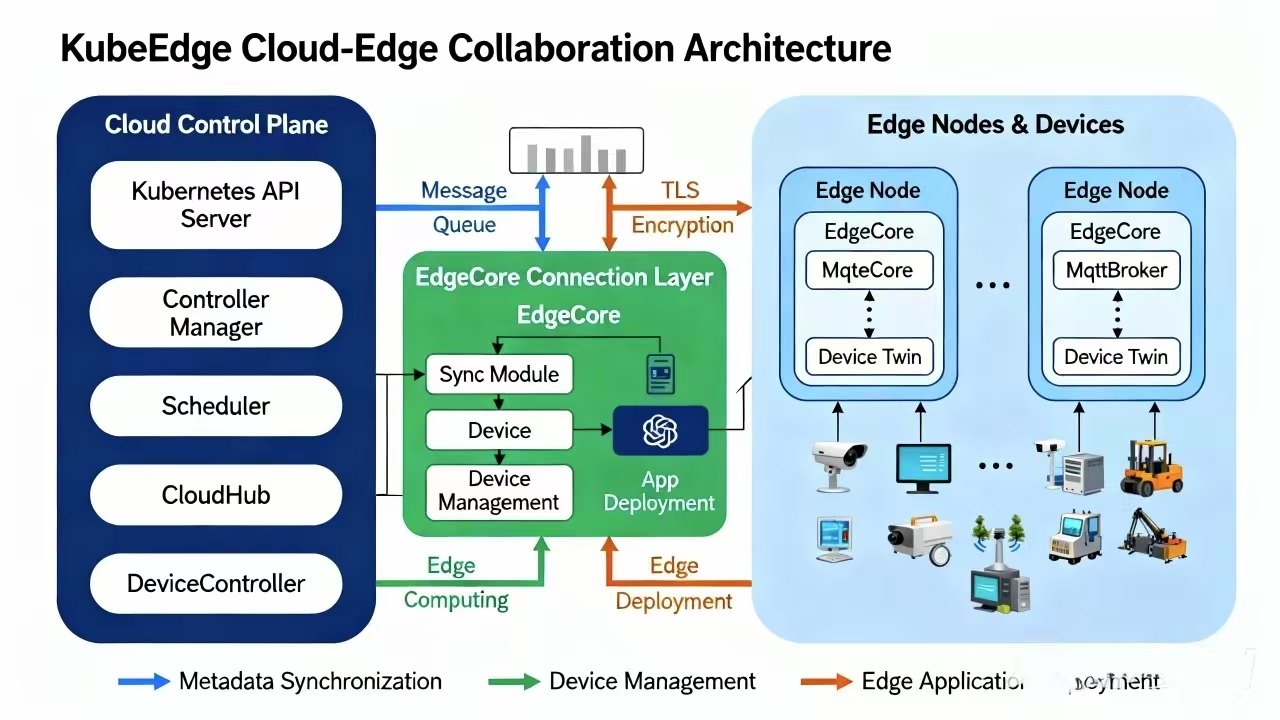

KubeEdge的核心组件参考图:

KubeEdge是CNCF毕业项目,专为边缘计算场景设计。它扩展了Kubernetes原生能力,使其能够管理边缘节点。KubeEdge的核心组件包括:

- CloudCore:云侧控制平面,运行在中心集群

- EdgeCore:边缘侧代理,运行在边缘设备

- MetaManager:边缘元数据管理

- EdgeMesh:边缘服务发现与通信

Kurator通过集成KubeEdge,实现了真正的云边协同架构。与传统的边缘方案不同,KubeEdge采用轻量级设计,边缘节点资源占用低,适合资源受限的IoT设备。

5.2 边缘节点注册与管理实战

在Kurator中注册边缘节点是一个声明式过程。首先,需要部署CloudCore组件:

helm install kubeedge kurator/kubeedge \

--namespace kubeedge-system \

--set cloudCore.enabled=true

然后,生成EdgeCore配置:

kubectl get secret -n kubeedge-system edgecore-config -o jsonpath='{.data.*}' | base64 -d > edgecore.yaml

将edgecore.yaml部署到边缘设备后,边缘节点会自动向中心注册。在Kurator控制台,可以看到边缘节点的状态:

kubectl get nodes -l node-role.kubernetes.io/edge=

Kurator提供了统一的节点视图,无论节点位于云端还是边缘,都可以通过相同的kubectl命令管理,大大简化了运维复杂度。

5.3 云边协同场景下的应用部署策略

云边协同应用部署参考图:

在云边协同场景中,应用部署需要考虑网络延迟、带宽限制、边缘资源约束等因素。Kurator提供了多种部署策略:

- 边缘优先策略:应用优先部署在边缘节点,减少数据传输延迟

- 中心计算策略:计算密集型任务在中心集群执行,边缘负责数据采集

- 混合策略:部分组件在边缘,部分在中心,通过API协调

以下示例展示边缘优先部署:

apiVersion: apps/v1

kind: Deployment

meta

name: edge-ai-inference

spec:

replicas: 3

selector:

matchLabels:

app: edge-ai-inference

template:

meta

labels:

app: edge-ai-inference

kurator.dev/placement: edge-preferred

spec:

nodeSelector:

node-role.kubernetes.io/edge: "true"

containers:

- name: inference

image: ai-inference:v1

resources:

limits:

memory: 512Mi

cpu: 500m

通过kurator.dev/placement标签,Kurator识别部署偏好,并在调度时优先考虑边缘节点。当边缘资源不足时,系统会自动将部分副本调度到中心集群,确保服务可用性。

六、Volcano批处理调度优化与AI工作负载支持

6.1 Volcano调度架构与核心概念

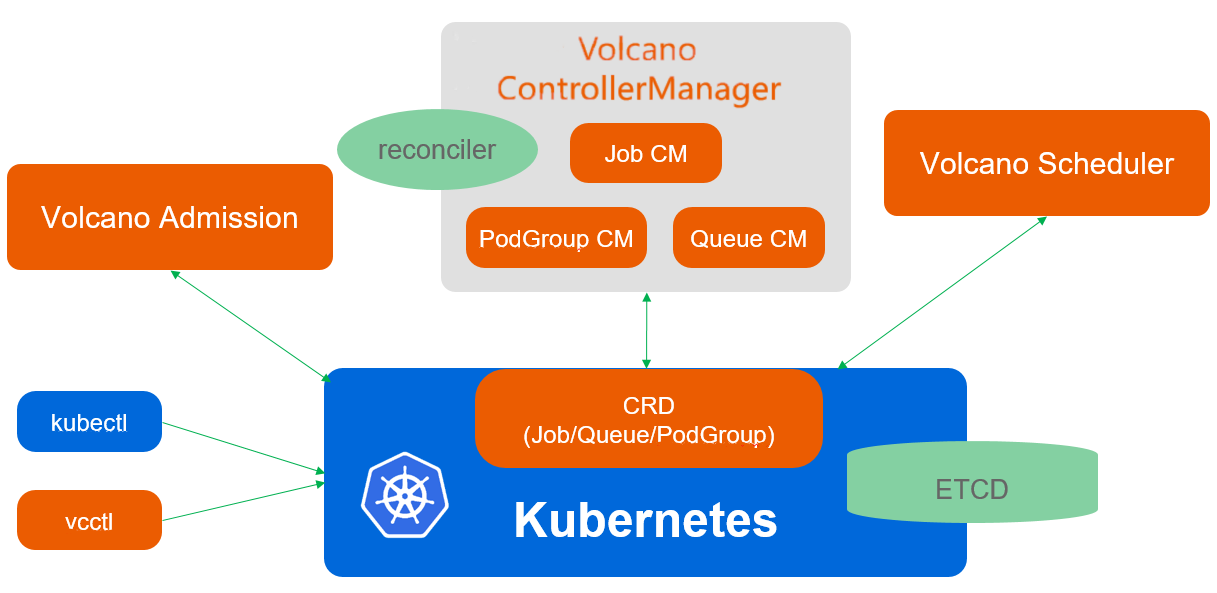

Volcano调度架构参考图:

Volcano是CNCF孵化项目,专注于批处理和AI工作负载的调度优化。它解决了原生Kubernetes在大规模批处理场景下的性能瓶颈。Volcano的核心概念包括:

- Queue:资源池,用于隔离不同团队或项目的资源

- PodGroup:一组需要协同调度的Pod

- Job:高级工作负载抽象,支持MPI、Spark、TensorFlow等框架

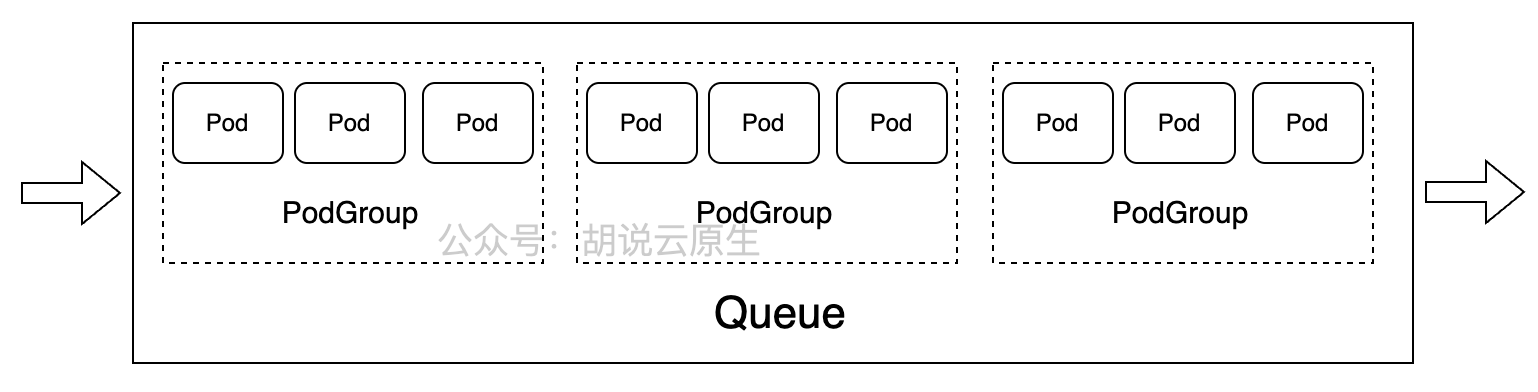

VolcanoJob和Queue、PodGroup 参考图:

Kurator集成Volcano后,企业可以在统一平台上运行在线服务和离线计算任务,实现资源最大化利用。Volcano的抢占机制特别适合混合负载场景,当高优先级任务到来时,可以临时抢占低优先级任务的资源。

6.2 AI训练任务的多集群调度实践

在AI训练场景中,计算资源需求巨大,单集群往往无法满足。Kurator结合Volcano和Karmada,实现了跨集群的AI任务调度。以下示例展示MPI训练任务的配置:

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

meta

name: distributed-training

spec:

minAvailable: 8

schedulerName: volcano

plugins:

ssh: []

svc: []

queue: ai-training

tasks:

- replicas: 8

name: worker

template:

spec:

containers:

- command: ["mpirun", "python", "train.py"]

image: ai-training:latest

resources:

limits:

nvidia.com/gpu: 1

memory: 16Gi

cpu: 8

nodeSelector:

kubernetes.io/hostname: gpu-node

该配置要求8个GPU节点协同工作。Kurator会自动将任务调度到资源充足的集群,甚至跨多个集群分配任务。训练结果通过分布式存储(如Ceph或S3)共享,确保数据一致性。

6.3 资源分时复用与成本优化策略

在企业环境中,计算资源成本是重要考量。Volcano的Queue机制支持资源分时复用,不同团队可以在不同时间段使用相同资源。Kurator进一步扩展了这一能力,支持跨集群的资源池管理。

以下配置展示如何定义分时策略:

apiVersion: scheduling.volcano.sh/v1beta1

kind: Queue

meta

name: production-queue

spec:

capability:

cpu: "100"

memory: 500Gi

reclaimable: true

weight: 1

schedulingPolicy:

- timeRange: "09:00-18:00"

maxResource:

cpu: "80"

memory: 400Gi

- timeRange: "18:00-09:00"

maxResource:

cpu: "100"

memory: 500Gi

allowedUsers:

- data-science-team

该Queue在工作时间优先保障生产服务,非工作时间将更多资源分配给数据科学团队进行模型训练。Kurator通过统一的监控视图,帮助管理员了解资源利用率,持续优化资源分配策略。

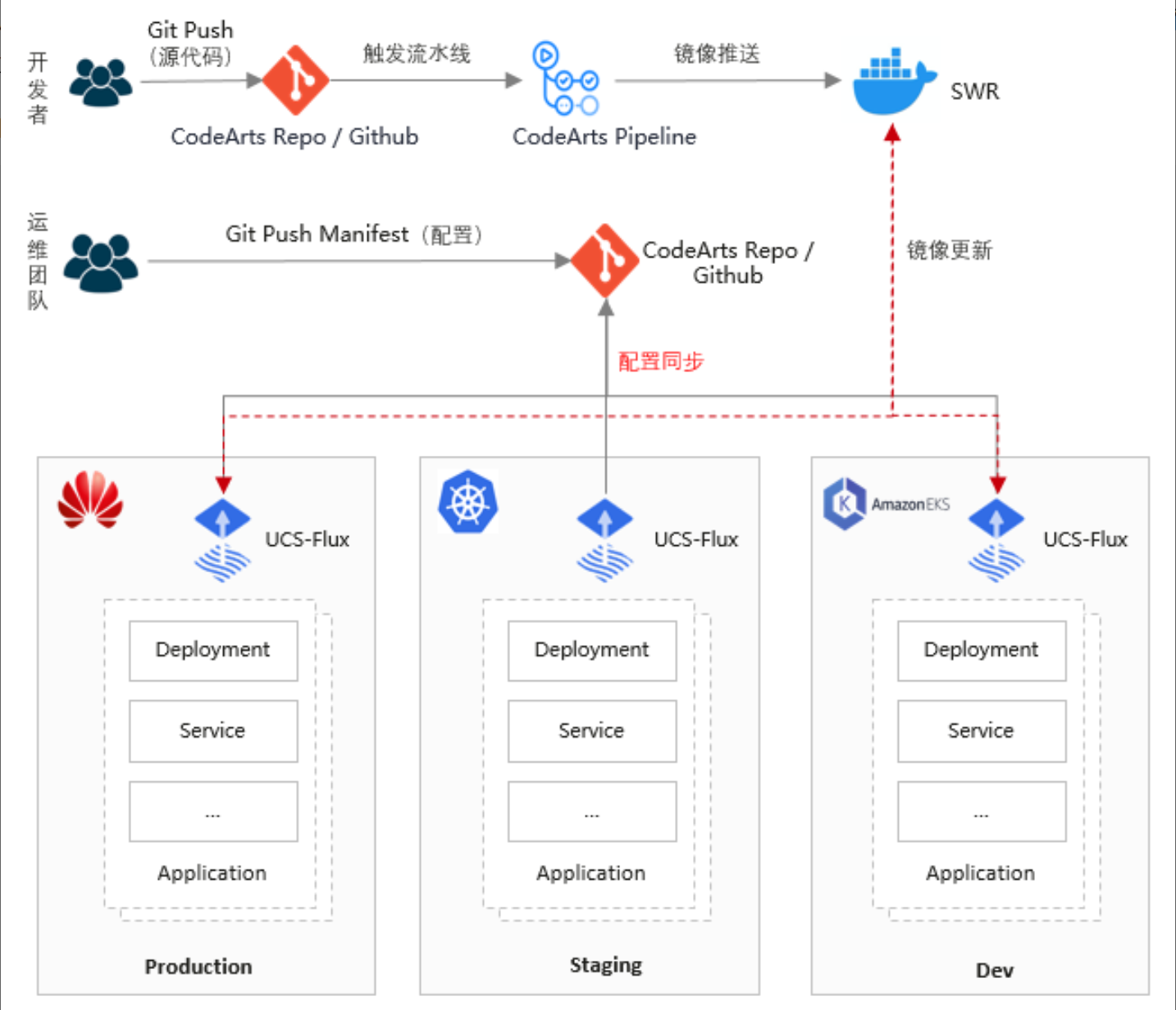

七、GitOps工作流与持续交付实践

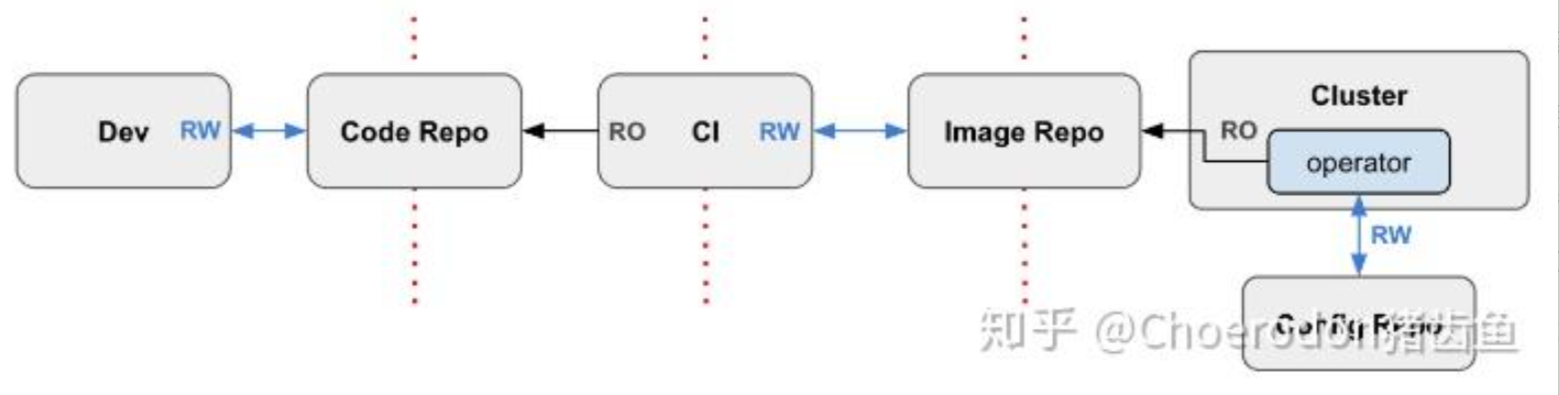

GitOps工作流官方参考图:

7.1 GitOps核心理念与Kurator实现架构

GitOps实现方式官方参考图:

GitOps是一种以Git仓库作为唯一事实源的运维模式。在Kurator中,GitOps引擎基于FluxCD构建,支持Helm、Kustomize等多种应用定义方式。其核心工作流包括:

- 开发者将应用配置提交到Git仓库

- FluxCD检测到变更,同步到Kubernetes

- Kurator验证配置合规性

- 应用部署到目标集群

- 持续监控实际状态与期望状态的一致性

这种模式相比传统CI/CD有显著优势:变更可审计、回滚简单、协作透明。Kurator进一步扩展了GitOps能力,支持多集群同步和灰度发布。

7.2 多环境应用分发与版本控制

在企业环境中,通常存在开发、测试、预发布、生产等多个环境。Kurator通过Fleet和GitOps的结合,实现了环境隔离与版本控制。以下目录结构展示典型的多环境配置:

apps/

├── frontend/

│ ├── base/

│ │ ├── deployment.yaml

│ │ └── service.yaml

│ ├── overlays/

│ │ ├── dev/

│ │ ├── staging/

│ │ └── prod/

│ └── helm/

│ └── Chart.yaml

└── backend/

├── ...

通过Kustomize overlays,可以在不同环境覆盖特定配置。Kurator的GitOps引擎会根据分支或标签策略,将配置同步到对应的环境集群。

apiVersion: source.toolkit.fluxcd.io/v1beta1

kind: GitRepository

meta

name: app-config

spec:

url: https://github.com/org/app-config

ref:

branch: main

interval: 5m

7.3 安全合规与审计追踪能力

在金融、医疗等强监管行业,安全合规至关重要。Kurator通过集成Kyverno和Open Policy Agent,提供了强大的策略控制能力。所有GitOps操作都会记录审计日志,包括:

- 配置变更内容

- 变更提交者

- 变更时间

- 部署状态

以下策略示例阻止高风险配置:

apiVersion: policies.kurator.dev/v1alpha1

kind: Policy

meta

name: block-public-services

spec:

rules:

- name: prevent-public-service

match:

resources:

kinds:

- Service

validate:

message: "Public services require security review"

deny:

conditions:

- key: "{{ request.object.spec.type }}"

operator: Equals

value: "LoadBalancer"

当开发者尝试创建LoadBalancer类型的服务时,策略会阻止部署并通知安全团队。这种左移安全理念大幅降低了生产环境的风险。

八、Kurator未来发展方向与行业展望

8.1 技术演进路线与社区规划

Kurator作为新兴的云原生平台,正处于快速发展阶段。根据社区路线图,未来重点发展方向包括:

- 增强边缘AI能力:集成更多边缘AI框架,支持模型自动压缩和优化

- 多云成本优化:通过智能调度和自动伸缩,降低多云环境下的TCO

- 安全增强:零信任架构支持,细粒度访问控制

- 开发者体验:可视化工作流,低代码应用构建

特别值得关注的是Kurator在WebAssembly(Wasm)领域的探索。通过将Wasm作为轻量级运行时,Kurator有望在边缘设备上运行更多类型的工作负载,同时保持安全隔离。

8.2 企业落地实践与价值量化

从早期采用者的反馈来看,Kurator在多个行业展现出显著价值:

- 金融行业:某大型银行采用Kurator重构其交易系统,将部署时间从2小时缩短到15分钟,同时实现了多活数据中心架构,RTO从30分钟降低到3分钟。

- 制造业:某汽车制造商通过Kurator统一管理全球200+工厂的边缘节点,设备数据处理延迟降低40%,运维成本减少35%。

- 电商行业:某电商平台利用Kurator的跨集群调度能力,在大促期间自动扩展计算资源,成功应对10倍流量峰值,服务器成本降低25%。

这些案例表明,Kurator不仅是技术平台,更是业务价值的放大器。通过统一的云原生基础设施,企业能够加速创新,提升客户体验,同时控制成本。

8.3 分布式云原生技术趋势展望

展望未来,分布式云原生技术将向三个方向演进:

首先,基础设施无感化将成为主流。开发者不再关心应用运行在哪个集群、哪个区域,平台自动选择最优位置。Kurator通过统一的抽象层,正在向这个方向迈进。

其次,AI驱动的自动化将重塑运维模式。通过机器学习分析历史负载模式,Kurator可以预测资源需求,提前进行容量规划和调度优化,从被动响应转向主动预防。

最后,安全内生化将成为核心设计原则。安全能力不再外挂,而是内嵌到基础设施的每个环节。Kurator的策略引擎和合规框架,正是这一理念的具体体现。

作为云原生从业者,我们应当拥抱这些变化,将Kurator等开源技术与企业实际需求结合,构建真正面向未来的数字化基础设施。分布式云原生不是终点,而是企业持续创新的新起点。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)