【前瞻创想】分布式云原生新纪元:Kurator平台架构解析与企业级多云协同实践指南

【前瞻创想】分布式云原生新纪元:Kurator平台架构解析与企业级多云协同实践指南

【前瞻创想】分布式云原生新纪元:Kurator平台架构解析与企业级多云协同实践指南

摘要

在数字化转型浪潮下,企业面临着多云、混合云和边缘计算环境下的基础设施管理挑战。Kurator作为一款开源分布式云原生平台,通过集成Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada、Kyverno等优秀开源项目,为用户提供了一站式解决方案。本文深入剖析Kurator架构设计、核心组件集成机制,并通过实际案例展示其在多云管理、边缘计算、批处理调度等场景的应用价值。通过环境搭建、Fleet管理、Karmada集成、KubeEdge协同等实战环节,帮助读者理解Kurator如何帮助企业构建统一的云原生基础设施,实现真正的分布式云原生转型。文章最后探讨了Kurator的发展方向和企业落地的最佳实践策略。

1. Kurator云原生平台架构全景

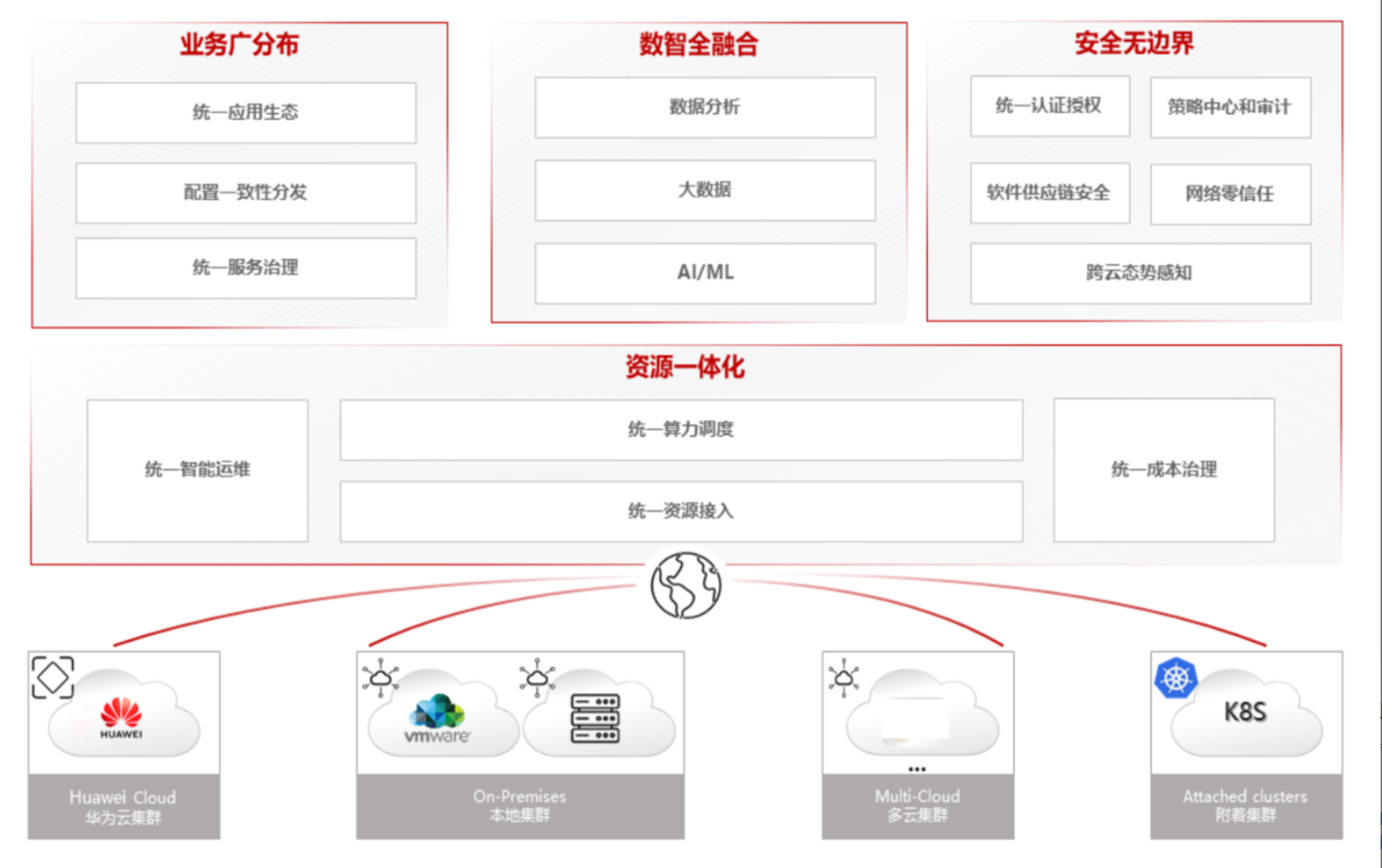

分布式云原生架构参考图:

1.1 核心组件与设计哲学

Kurator的设计哲学源于"站在巨人肩膀上"的理念,它不是重新发明轮子,而是通过深度集成和优化现有的优秀云原生项目,构建一个统一的分布式云原生平台。其核心架构采用分层设计,底层是基础设施抽象层,中间是服务编排层,上层是应用管理层。

Kurator的核心设计原则包括:

- 声明式API:所有资源都采用声明式配置,符合云原生最佳实践

- 多租户隔离:支持多团队、多业务线在同一平台上的安全隔离

- 统一治理:通过策略引擎实现跨集群、跨环境的一致性管理

- 可扩展性:插件化架构允许根据业务需求灵活扩展功能

这种设计使得Kurator能够无缝适配公有云、私有云、边缘环境等多种基础设施,为企业提供真正的分布式云原生能力。

1.2 集成生态与技术创新

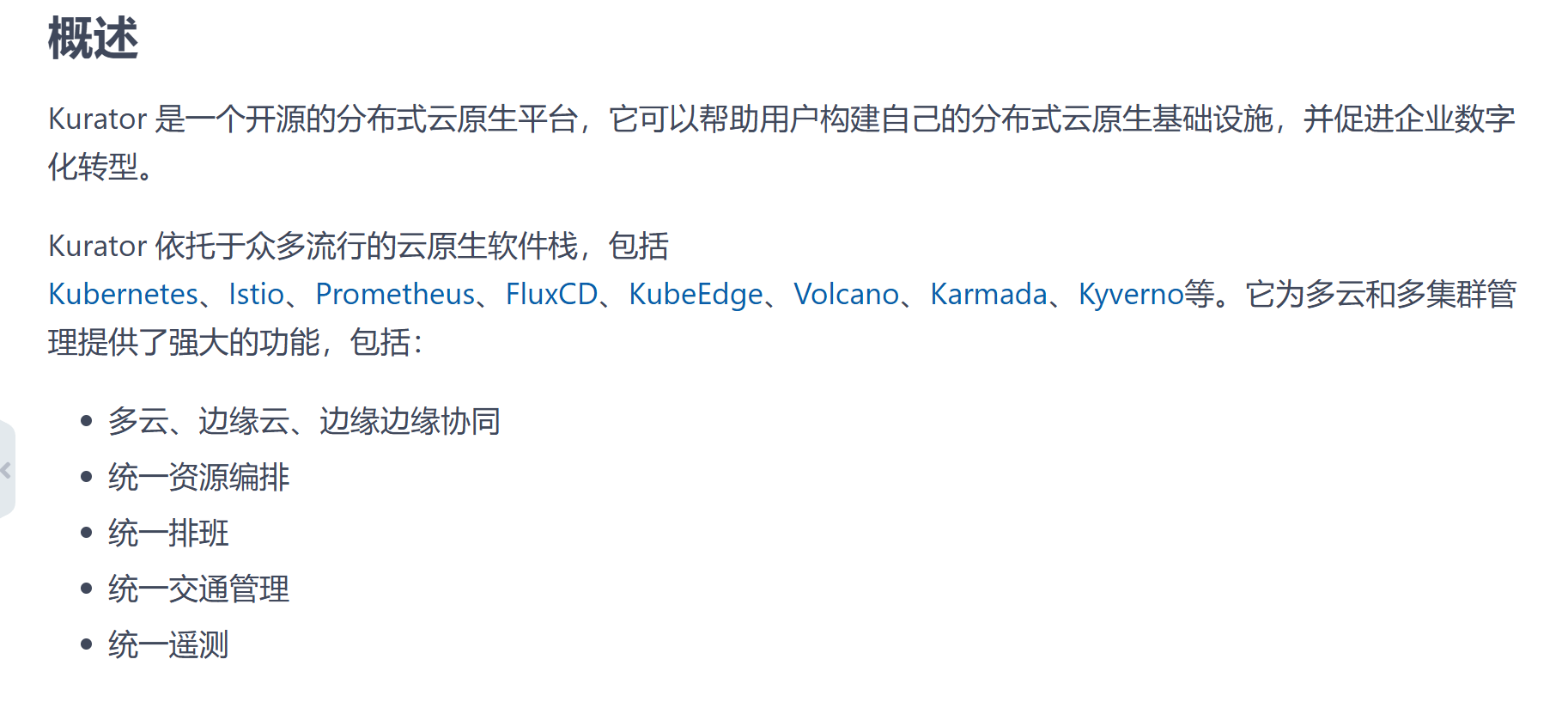

Kurator组成参考图:

Kurator集成的技术栈代表了当前云原生生态的顶尖水平:

- Kubernetes:作为基础容器编排引擎

- Istio:提供服务网格能力,实现细粒度的流量管理和安全控制

- Prometheus:构建统一的监控和告警体系

- FluxCD:实现GitOps持续交付

- KubeEdge:连接云和边缘的能力

- Karmada:多集群管理的核心引擎

- Volcano:批处理和高性能计算场景的调度优化

- Kyverno:策略管理引擎,确保集群合规性

Kurator的创新之处在于,它不仅仅是一个简单的项目集合,而是通过深度集成和API抽象,将这些技术融合成一个有机的整体。例如,Kurator的Fleet API统一了Karmada的多集群管理能力,同时集成了Kyverno的策略引擎,实现了"一次定义,处处执行"的治理理念。

1.3 多云协同的技术优势

在多云环境下,Kurator展现出了显著的技术优势:

- 统一资源模型:通过抽象层屏蔽不同云厂商的差异,提供一致的资源管理体验

- 智能调度:结合Volcano和Karmada的能力,实现跨云、跨区域的资源优化调度

- 数据协同:通过边缘计算能力,实现边缘数据的本地处理和云端聚合

- 安全合规:统一的策略管理确保所有环境都符合企业安全标准

这些优势使得Kurator成为企业构建分布式云原生基础设施的理想选择,特别是对于那些需要在混合云和边缘环境中部署应用的企业。

2. Kurator Fleet机制深度解析

2.1 Fleet集群注册与管理机制

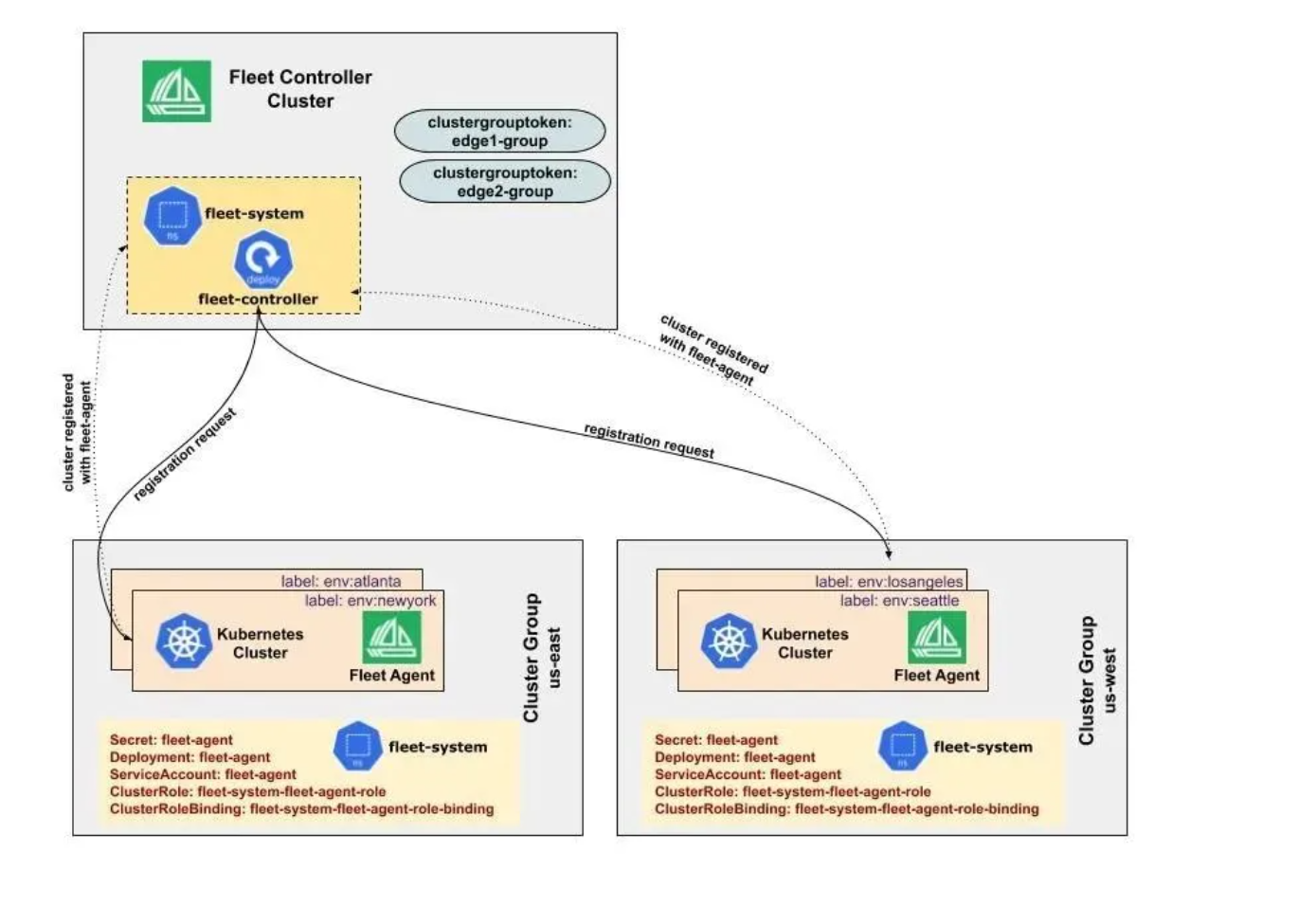

Fleet 的集群注册官方参考图:

Fleet是Kurator的核心概念,代表一组逻辑上关联的集群。Fleet机制允许管理员将多个物理集群组织成一个管理单元,实现统一的策略应用和资源分发。

Fleet的集群注册流程包含以下关键步骤:

# fleet-cluster-registration.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Cluster

meta

name: production-cluster-1

spec:

kubeconfigSecretRef:

name: production-cluster-1-kubeconfig

labels:

environment: production

region: ap-southeast-1

annotations:

kurator.dev/provider: aws

kurator.dev/cluster-type: eks

注册过程自动化程度高,管理员只需提供目标集群的kubeconfig,Kurator会自动建立安全连接,并将集群纳入Fleet管理范围。这种机制大大简化了多集群环境的管理复杂度。

2.2 跨集群服务相同性实现原理

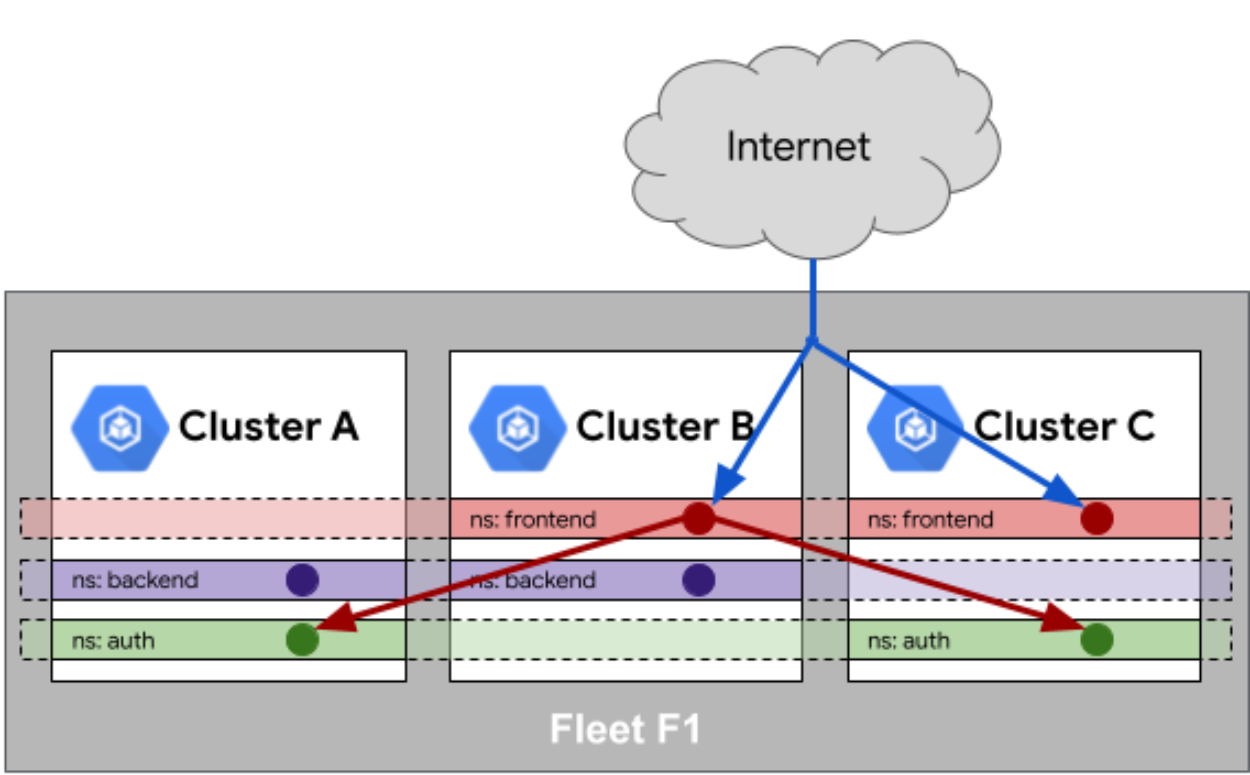

Fleet 队列中的服务相同性官方参考图:

服务相同性(Service Sameness)是Kurator Fleet的核心特性之一,它确保同一服务在不同集群中保持一致的身份和可访问性。这一机制的实现依赖于以下几个关键技术:

- 统一的服务发现:通过DNS和Service Mesh技术,实现跨集群的服务发现

- 身份统一:使用SPIFFE/SPIRE标准,为服务提供统一的身份标识

- 流量管理:Istio的多集群配置实现跨集群流量的智能路由

# service-sameness-example.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: ServiceImport

meta

name: frontend-service

spec:

type: ClusterSetIP

ports:

- port: 80

protocol: TCP

selector:

app: frontend

通过ServiceImport资源,Kurator能够将不同集群中的同名服务聚合起来,形成一个逻辑上的统一服务。这种设计极大简化了多集群环境下的服务调用,开发者无需关心服务部署在哪个具体集群。

2.3 Fleet策略引擎与统一治理

Kurator集成了Kyverno作为策略引擎,实现了Fleet级别的统一治理。策略可以定义在Fleet级别,自动同步到所有成员集群,确保整个组织遵循一致的安全和合规标准。

策略引擎的核心能力包括:

- 准入控制:在资源创建前进行验证

- 配置审计:定期检查集群配置的合规性

- 自动修复:自动修复不符合策略的资源配置

- 策略报告:提供可视化的策略执行报告

# fleet-policy-example.yaml

apiVersion: kyverno.io/v1

kind: ClusterPolicy

metadata:

name: require-pod-requests-limits

spec:

validationFailureAction: enforce

rules:

- name: validate-resources

match:

any:

- resources:

kinds:

- Pod

validate:

message: "CPU and memory resource requests and limits are required"

pattern:

spec:

containers:

- resources:

requests:

memory: "?*"

cpu: "?*"

limits:

memory: "?*"

cpu: "?*"

这种策略管理机制使得企业能够在大规模分布式环境中保持配置的一致性和安全性,同时减少了运维团队的手动干预需求。

3. Karmada在Kurator中的集成实践

3.1 Karmada跨集群调度架构

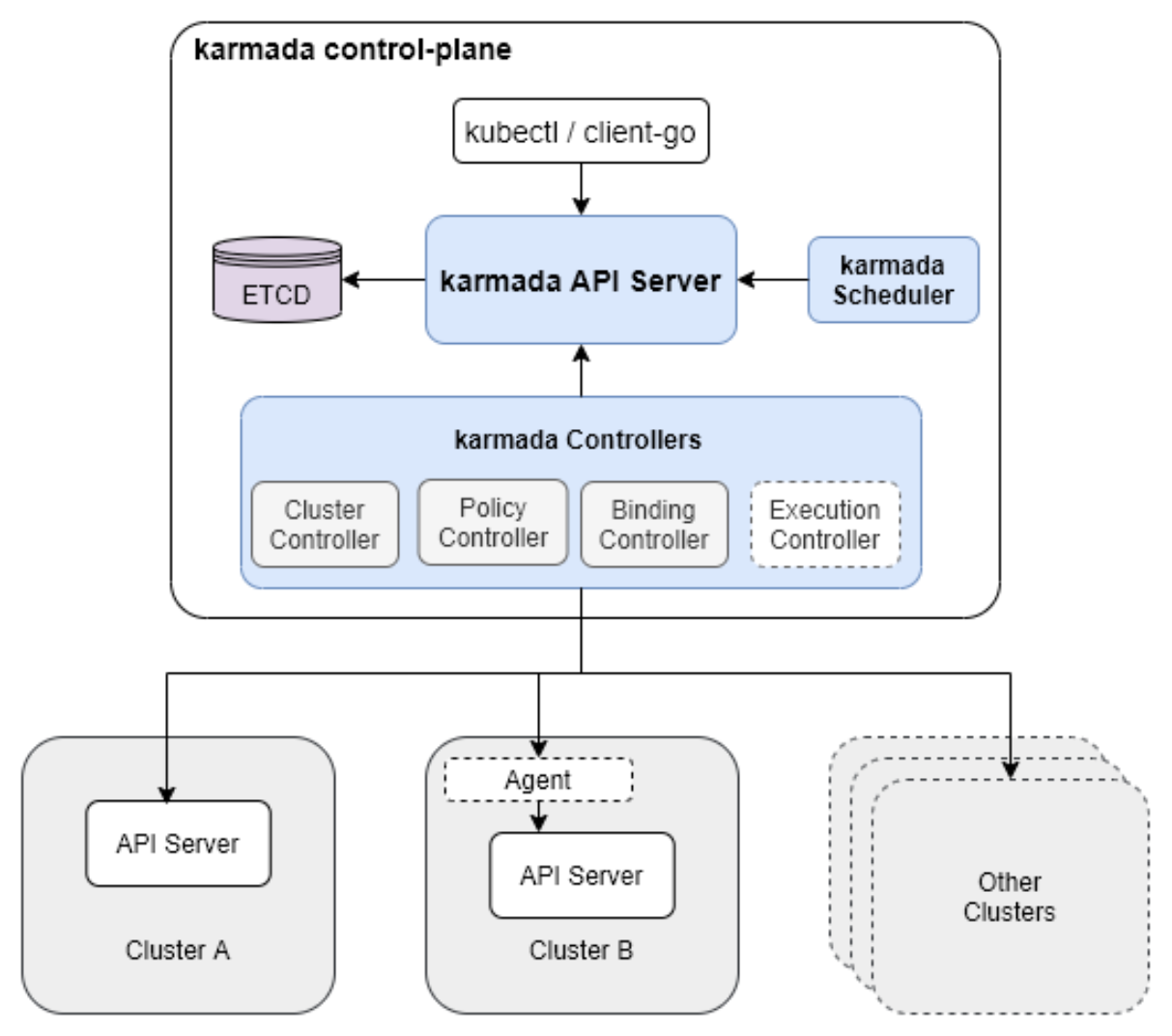

Karmada 的总体架构官方参考图:

Karmada是Kurator实现多集群管理的核心组件,其调度架构分为多个层次:

- 全局调度器:负责将工作负载分发到合适的集群

- 集群调度器:在单个集群内进行资源调度

- 调度策略:定义如何选择目标集群

Karmada的核心概念包括PropagationPolicy(传播策略)、ClusterPropagationPolicy(集群级传播策略)和ResourceBinding(资源绑定),这些概念在Kurator中被进一步抽象和简化。

# karmada-propagation-policy.yaml

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

meta

name: nginx-propagation

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: nginx

placement:

clusterAffinity:

clusterNames:

- cluster-east

- cluster-west

replicaScheduling:

replicaDivisionPreference: Weighted

replicaSchedulingType: Divided

weightList:

- targetCluster:

clusterNames:

- cluster-east

weight: 70

- targetCluster:

clusterNames:

- cluster-west

weight: 30

在Kurator中,这些配置被进一步简化,同时保持了Karmada的核心能力,使得多集群调度更加直观和易于管理。

3.2 多集群应用分发与同步

Kurator通过深度集成Karmada,实现了应用在多集群环境下的无缝分发和同步。这一过程包含以下几个关键环节:

- 资源抽象:将应用资源抽象为通用模型

- 策略定义:定义应用如何在不同集群间分布

- 状态同步:实时同步各集群的应用状态

- 故障转移:在集群故障时自动迁移应用

Kurator还提供了高级的同步策略,如基于地理位置的延迟优化、基于成本的资源优化等,这些都是通过Karmada的扩展能力实现的。

# 使用Kurator CLI创建多集群应用

kurator apply -f multi-cluster-app.yaml --fleet=my-fleet

# 查看应用在不同集群的分布状态

kurator get applications --fleet=my-fleet -o wide

这种多集群应用管理能力,使得企业能够轻松构建高可用、高性能的全球分布式应用架构。

3.3 弹性伸缩策略的实践案例

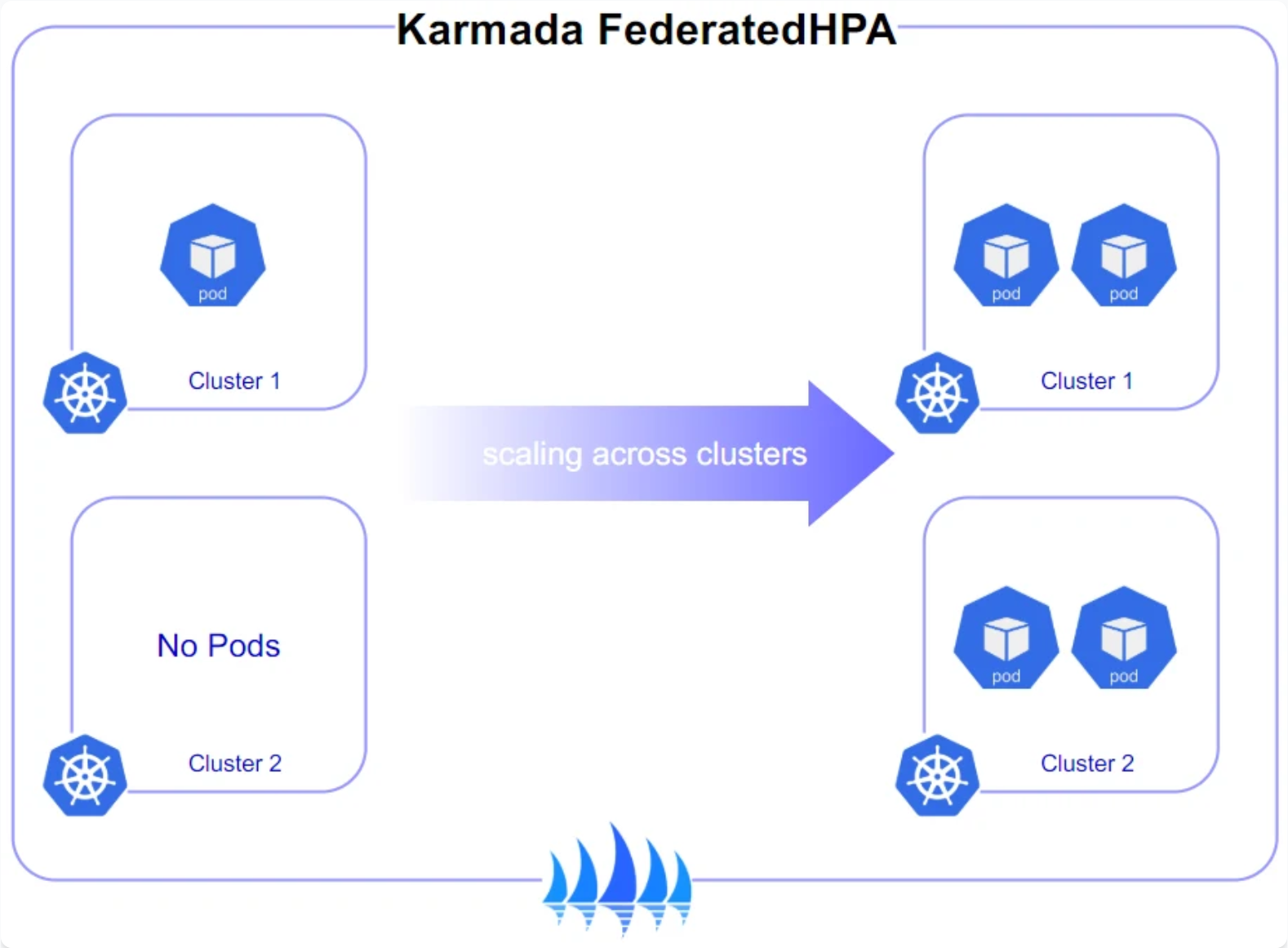

Karmada跨集群弹性伸缩策略参考图:

在实际业务场景中,Karmada的弹性伸缩能力被广泛应用。结合Kurator的统一监控体系,可以实现基于全局指标的智能伸缩。

一个典型的实践案例是电商平台的大促场景:

- 预测性伸缩:基于历史数据预测流量高峰,提前在多个区域集群中分配资源

- 实时伸缩:根据实时流量和资源利用率,在各区域集群间动态调整实例数量

- 故障隔离:当某个区域出现问题时,自动将流量切换到其他健康区域

# karmada-hpa-example.yaml

apiVersion: autoscaling.karmada.io/v1alpha1

kind: PropagationHorizontalPodAutoscaler

meta

name: frontend-hpa

spec:

sourceRef:

apiVersion: apps/v1

kind: Deployment

name: frontend

minReplicas: 10

maxReplicas: 100

targetCPUUtilizationPercentage: 50

placement:

clusterAffinity:

clusterNames:

- cluster-east

- cluster-west

- cluster-central

replicaScheduling:

replicaDivisionPreference: Aggregated

replicaSchedulingType: Duplicated

这种跨集群的弹性伸缩策略,使得应用能够充分利用全球资源,同时保持高可用性和成本效益。

4. KubeEdge边缘计算能力整合

4.1 KubeEdge核心组件与架构

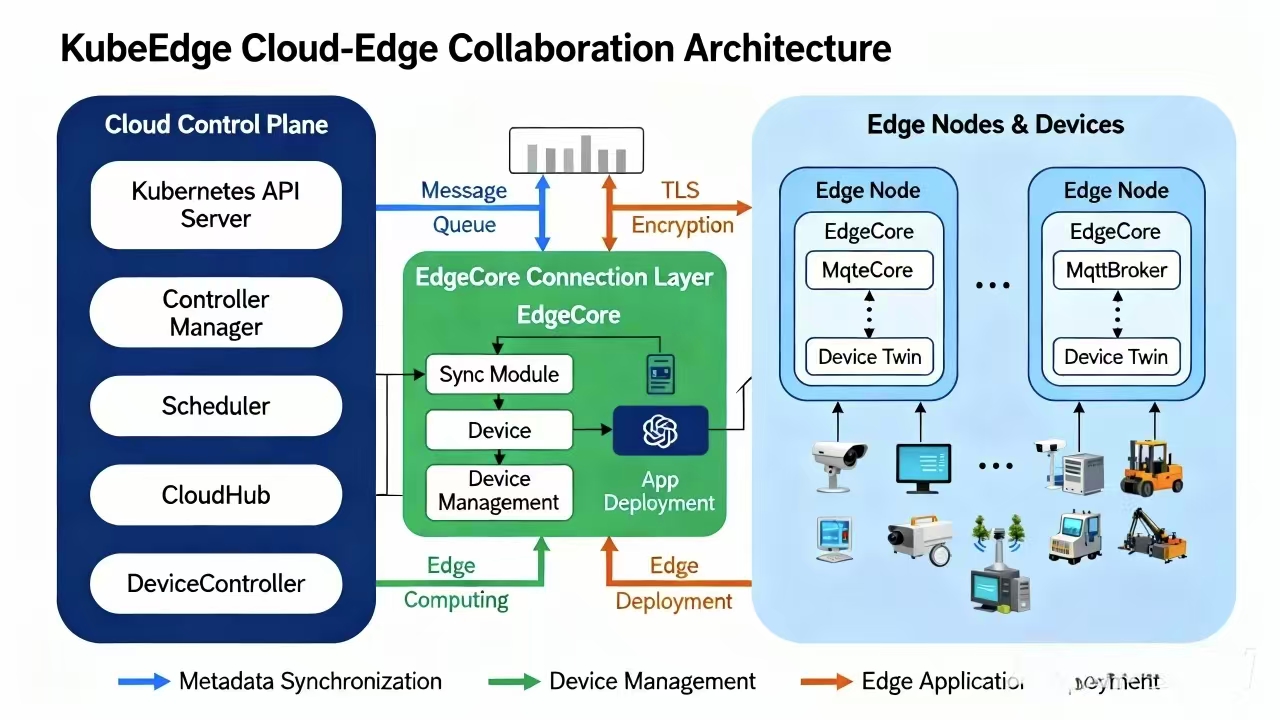

KubeEdge的核心组件参考图:

KubeEdge是Kurator实现边云协同的关键组件,其架构设计充分考虑了边缘环境的特殊需求:

- 云边通信:通过WebSocket和QUIC协议实现高效、稳定的云边通信

- 边缘自治:在网络中断时,边缘节点能够独立运行

- 设备管理:统一管理各种边缘设备和传感器

- 边缘计算:在边缘侧执行数据处理和AI推理

KubeEdge的核心组件包括:

- CloudCore:云端组件,负责与Kubernetes集群通信

- EdgeCore:边缘侧组件,负责边缘节点管理

- DeviceTwin:设备状态同步组件

- EdgeMesh:边缘服务网格

在Kurator中,KubeEdge被无缝集成到统一的管理平面,管理员可以通过相同的API管理云端和边缘资源。

4.2 边云协同的网络通信机制

Kurator通过KubeEdge实现了高效的边云协同网络通信,解决了边缘环境中的关键挑战:

- 弱网络环境:优化的数据传输协议,适应高延迟、不稳定网络

- NAT穿透:自动处理NAT环境下的连接问题

- 安全隧道:端到端加密,确保数据传输安全

- 带宽优化:数据压缩和差量同步,减少带宽消耗

Kurator中的网络配置简化了边缘节点的接入过程:

# edge-node-registration.yaml

apiVersion: edge.kurator.dev/v1alpha1

kind: EdgeNode

meta

name: factory-edge-node-01

spec:

clusterRef: production-cluster

labels:

location: factory-shanghai

environment: production

edgeCoreVersion: v1.12.1

network:

tunnelType: websocket

encryption: true

compression: true

这种简化的配置方式,大大降低了边缘计算的采用门槛,使得企业能够快速构建边云协同架构。

4.3 边缘场景下的GitOps实践

在边缘计算环境中,GitOps实践面临着独特挑战:网络不稳定、资源受限、安全要求高等。Kurator结合FluxCD和KubeEdge,为边缘场景提供了优化的GitOps解决方案。

关键实践包括:

- 渐进同步:在弱网络环境下,采用渐进式同步策略

- 离线路由:当边缘节点离线时,自动切换到本地缓存

- 边缘策略:针对边缘环境的特定策略,如数据本地化

- 状态回传:边缘节点状态定期回传到中心集群

# edge-gitops-example.yaml

apiVersion: source.toolkit.fluxcd.io/v1beta2

kind: GitRepository

meta

name: edge-apps

spec:

url: https://github.com/company/edge-apps.git

ref:

branch: main

interval: 5m

secretRef:

name: git-auth

---

apiVersion: kustomize.toolkit.fluxcd.io/v1beta2

kind: Kustomization

meta

name: edge-deployments

spec:

targetNamespace: edge-system

sourceRef:

kind: GitRepository

name: edge-apps

path: ./edge-deployments

prune: true

interval: 5m

timeout: 2m

retryInterval: 30s

maxRetries: 5

这种GitOps实践,使得边缘应用的部署和管理变得简单可靠,同时保持了与中心云环境一致的管理体验。

5. Kurator环境搭建与部署实战

5.1 环境准备与依赖项

在开始Kurator的安装之前,需要确保环境满足以下要求:

- 操作系统:Linux(推荐Ubuntu 20.04+或CentOS 7+)

- CPU:至少4核

- 内存:至少8GB

- 磁盘:至少50GB可用空间

- 网络:稳定的互联网连接

- 软件依赖:

- Docker 20.10+

- Kubernetes 1.23+

- Helm 3.8+

- kubectl 1.23+

对于生产环境,建议准备多个节点,以实现高可用部署。同时,确保所有节点之间的网络互通,特别是各节点的6443、2379-2380、10250等关键端口。

5.2 从源码构建Kurator平台

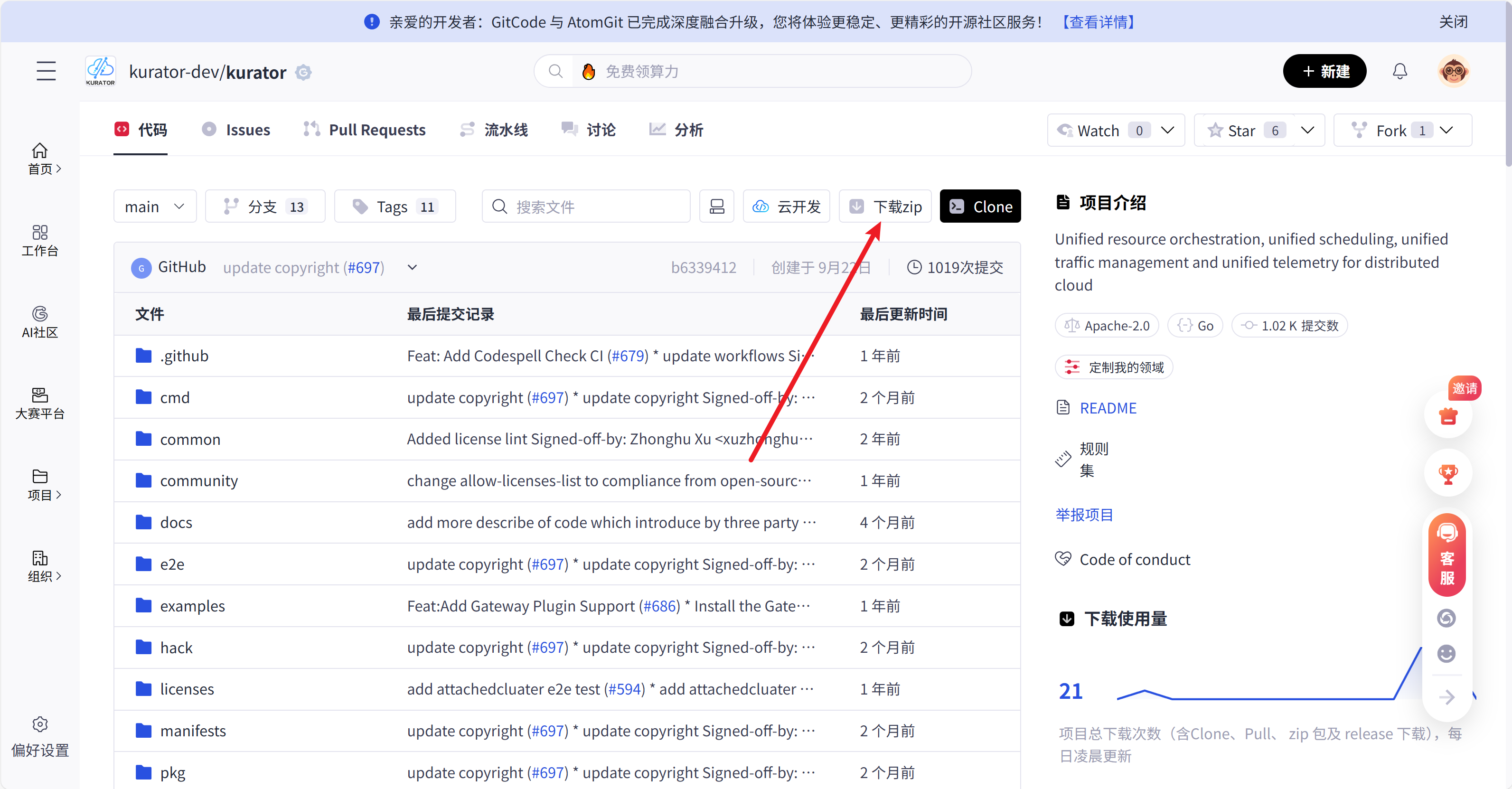

Kurator提供了灵活的安装方式,包括从源码构建和使用预构建包。下面介绍从源码构建的详细步骤:

# 克隆Kurator代码仓库

git clone https://github.com/kurator-dev/kurator.git

cd kurator

# 安装依赖

make deps

# 构建Kurator组件

make build

# 验证构建结果

ls bin/

# 应该看到 kurator-controller-manager, kurator-agent 等可执行文件

# 安装Kurator CLI

sudo cp bin/kurator /usr/local/bin/

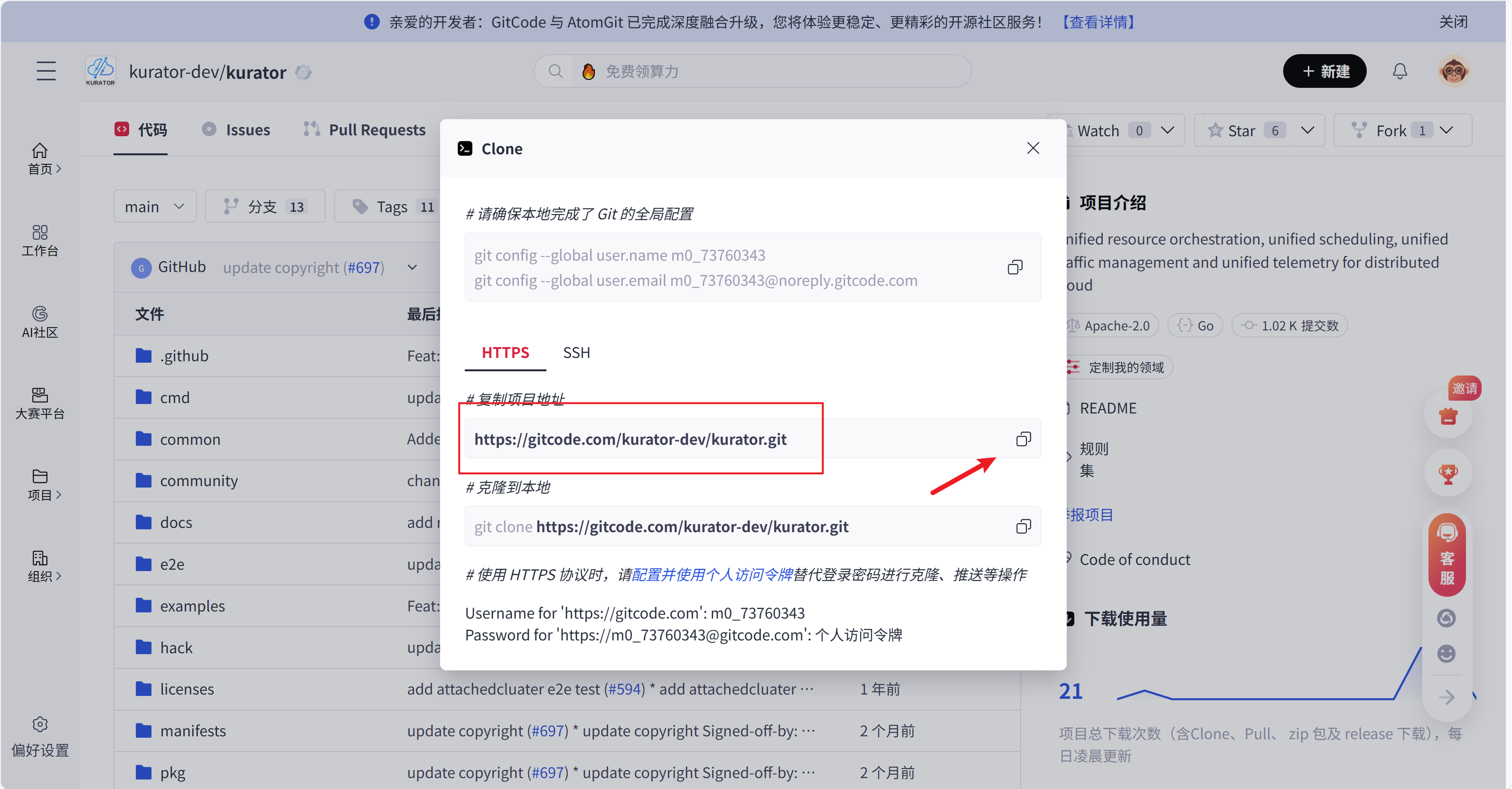

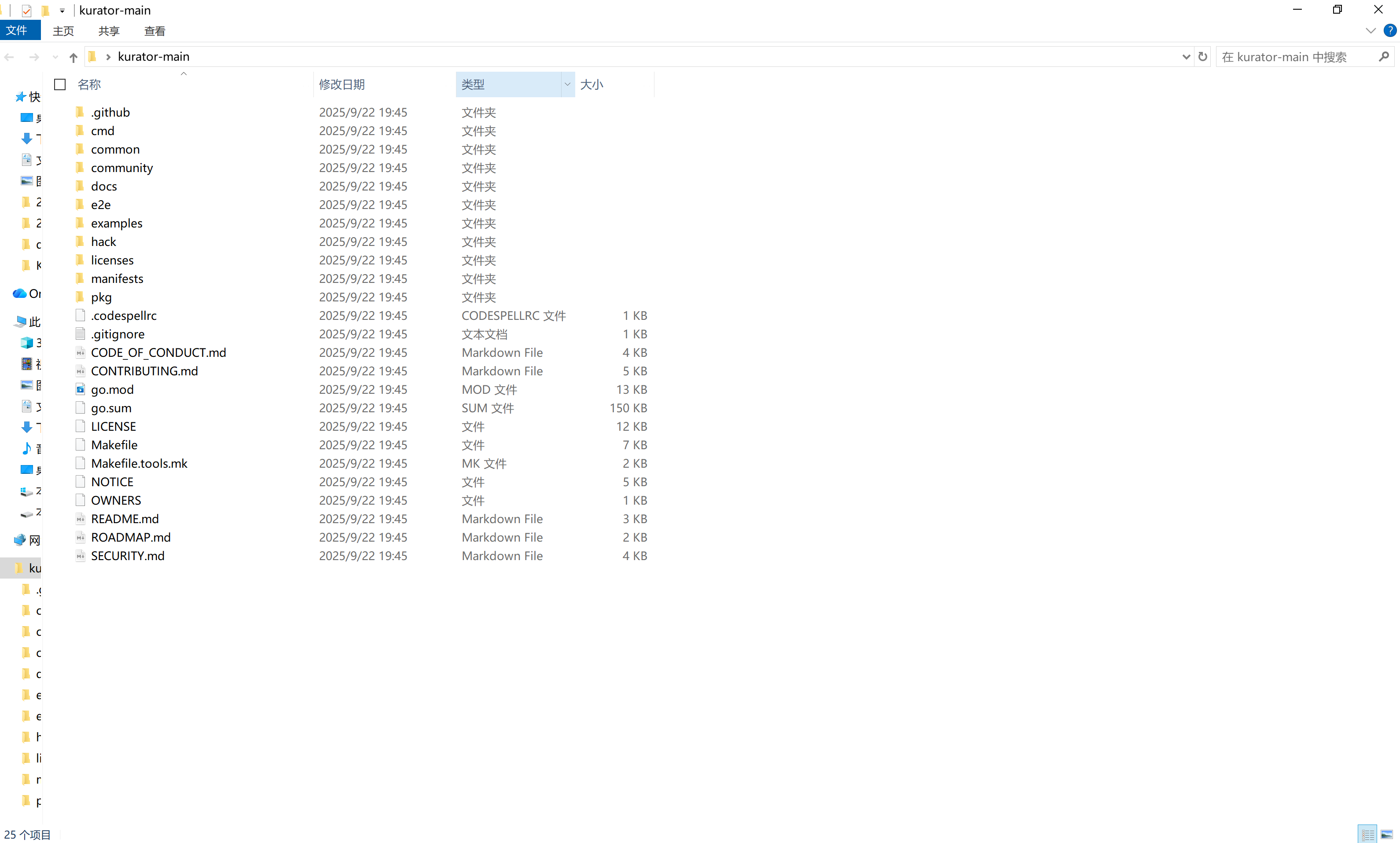

在项目地址中,可以看到可以clone到本地

https://gitcode.com/kurator-dev/kurator.git

或者我们也可以下载到本地

可以看到我们资源文件已经下载下来了

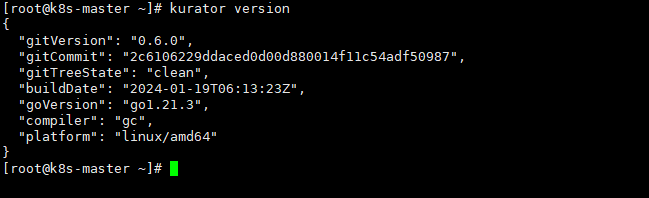

可以看到版本是0.6.0

构建完成后,可以使用Kurator CLI进行平台的初始化和配置:

# 初始化Kurator平台

kurator init --components all

# 验证安装状态

kurator status

这种从源码构建的方式,适合需要定制化修改或贡献代码的开发人员。对于生产环境,建议使用Helm chart或官方提供的安装包。

5.3 集群生命周期管理配置

Kurator提供了完整的集群生命周期管理能力,包括集群创建、升级、备份和销毁。下面是一个创建多集群环境的示例配置:

# cluster-lifecycle-example.yaml

apiVersion: lifecycle.kurator.dev/v1alpha1

kind: ClusterPlan

meta

name: production-clusters

spec:

clusters:

- name: production-east

provider: aws

region: ap-southeast-1

nodeGroups:

- name: general

instanceType: m5.large

count: 3

- name: gpu

instanceType: g4dn.xlarge

count: 2

- name: production-west

provider: azure

region: westus2

nodeGroups:

- name: general

instanceType: Standard_D4s_v3

count: 3

syncPolicy:

interval: 1h

autoRepair: true

backup:

enabled: true

schedule: "0 2 * * *"

retention: 7

通过这个配置,Kurator会自动创建和管理指定的集群,包括节点配置、网络设置、安全组等。同时,自动配置备份和自修复策略,确保集群的高可用性。

# 应用集群生命周期配置

kurator apply -f cluster-lifecycle-example.yaml

# 监控集群创建进度

kurator get clusters -w

# 查看集群详细信息

kurator describe cluster production-east

这种声明式的集群管理方式,大大简化了多云环境下的基础设施管理,使得运维团队能够专注于业务价值创造,而不是基础设施的复杂性。

6. Kurator GitOps与CI/CD流水线

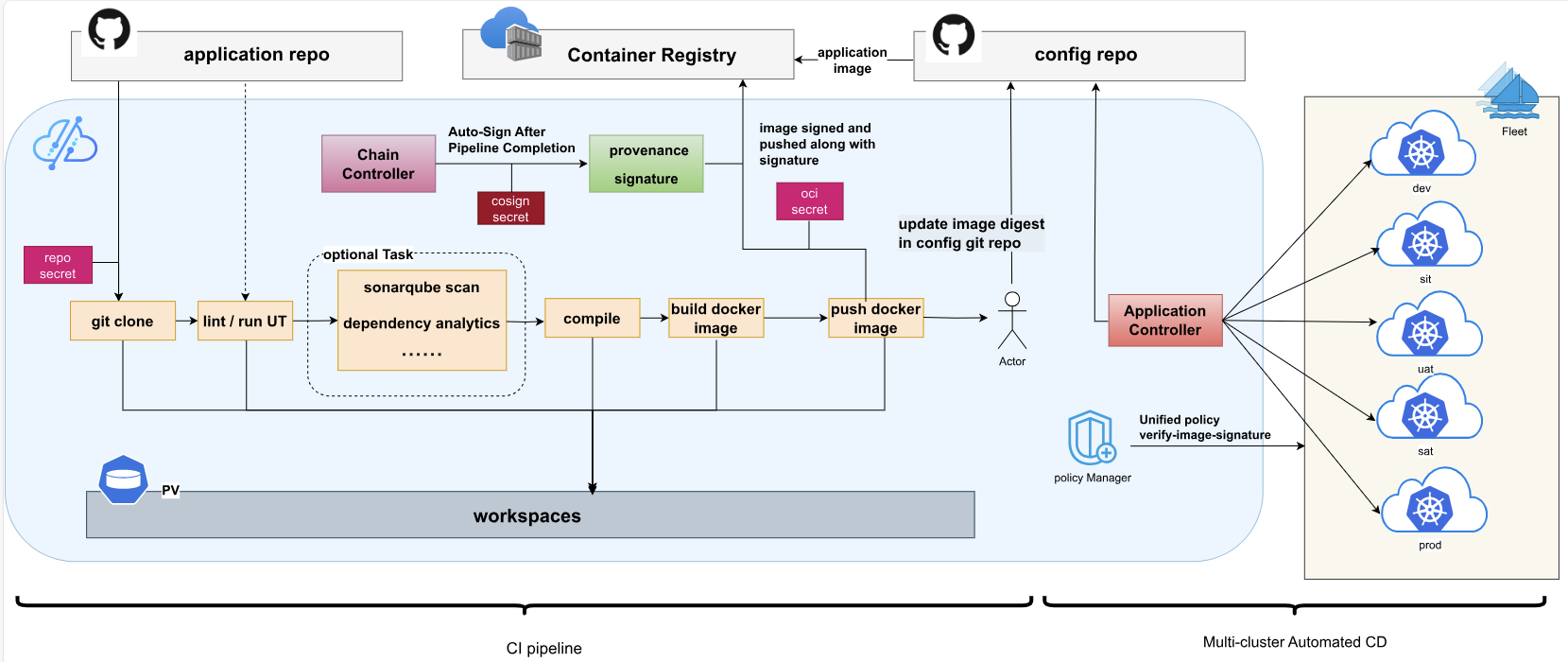

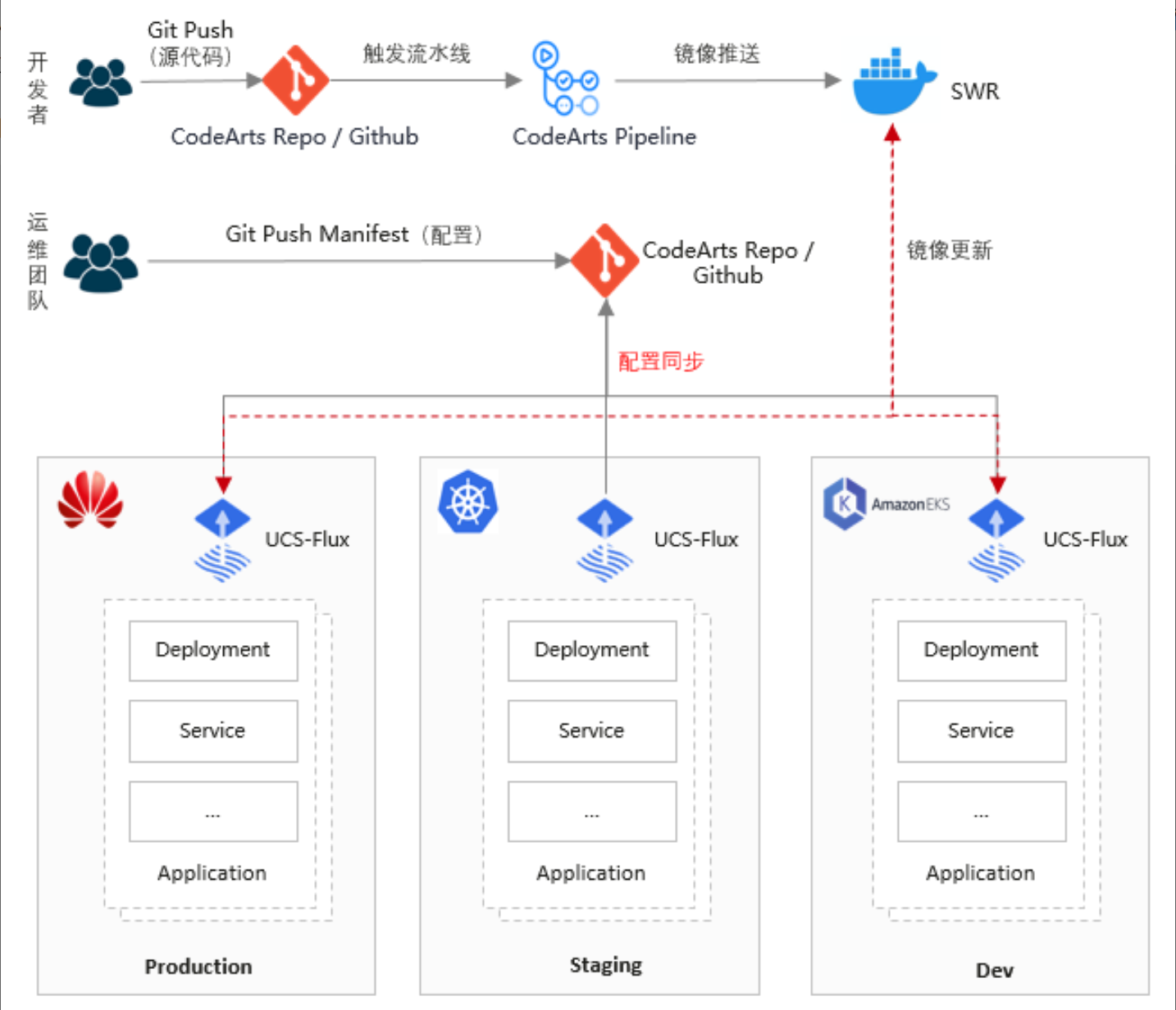

Kurator CI/CD 的结构参考图:

6.1 GitOps在多云环境中的实现

GitOps实现方式官方参考图:

GitOps是Kurator的核心理念之一,它通过将基础设施和应用配置存储在Git仓库中,实现了声明式、可审计、可回滚的系统管理方式。在多云环境中,GitOps面临的主要挑战包括:

- 配置漂移:不同环境之间的配置不一致

- 环境隔离:开发、测试、生产环境的隔离需求

- 权限管理:不同团队对不同环境的访问控制

- 变更审计:所有变更的完整审计跟踪

Kurator通过以下方式解决这些挑战:

- 环境分层:使用Kustomize或Helm实现环境特定的配置覆盖

- 策略继承:基础策略在所有环境中继承,特定环境可以覆盖

- 自动化同步:自动检测Git仓库变更并应用到目标集群

- 状态反馈:实时反馈集群状态与期望状态的差异

# gitops-environment-structure.yaml

environments/

├── base/

│ ├── deployment.yaml

│ ├── service.yaml

│ └── kustomization.yaml

├── dev/

│ ├── kustomization.yaml

│ └── patches/

├── staging/

│ ├── kustomization.yaml

│ └── patches/

└── prod/

├── kustomization.yaml

└── patches/

这种结构化的Git仓库组织方式,使得多环境管理变得清晰和可维护。

6.2 FluxCD集成与Helm应用管理

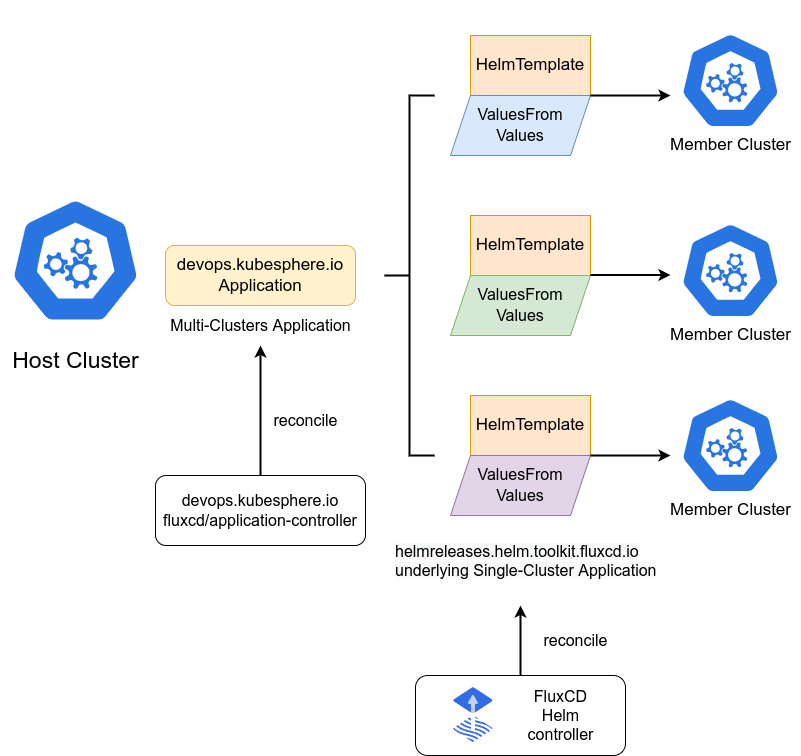

FluxCD Helm 应用的示意图:

Kurator深度集成了FluxCD和Helm,为GitOps提供了强大的工具链支持。FluxCD负责监控Git仓库的变化,而Helm则提供了应用打包和版本管理能力。

一个典型的FluxCD + Helm集成配置如下:

# flux-helm-integration.yaml

apiVersion: source.toolkit.fluxcd.io/v1beta2

kind: HelmRepository

meta

name: kurator-charts

spec:

url: https://kurator-dev.github.io/charts

interval: 1h

---

apiVersion: helm.toolkit.fluxcd.io/v2beta1

kind: HelmRelease

meta

name: kurator-fleet-manager

spec:

chart:

spec:

chart: fleet-manager

version: 0.1.0

sourceRef:

kind: HelmRepository

name: kurator-charts

interval: 5m

targetNamespace: kurator-system

values:

replicaCount: 3

resources:

requests:

memory: 256Mi

cpu: 100m

limits:

memory: 512Mi

cpu: 500m

service:

type: ClusterIP

Kurator提供了增强的Helm应用管理能力,包括:

- 多集群Helm发布:在多个集群中同步部署Helm charts

- 版本回滚:一键回滚到历史版本

- 依赖管理:自动处理应用间的依赖关系

- 状态监控:实时监控Helm发布的状态

# 查看Helm发布状态

kurator get helmreleases --all-namespaces

# 回滚到特定版本

kurator rollback helmrelease kurator-fleet-manager --to-revision=2

# 查看发布历史

kurator history helmrelease kurator-fleet-manager

这种集成化的应用管理方式,大大提高了应用交付的效率和可靠性。

6.3 企业级CI/CD流水线设计

在企业环境中,CI/CD流水线需要满足严格的安全、合规和审计要求。Kurator提供了构建企业级CI/CD流水线的能力,其核心设计原则包括:

- 安全第一:所有镜像必须经过安全扫描,所有变更必须经过审批

- 渐进发布:从开发环境到生产环境的渐进式发布

- 可观测性:每个阶段都有完整的监控和日志

- 自动化恢复:发现问题时自动回滚

一个典型的企业级CI/CD流水线包含以下阶段:

- 代码提交:开发者提交代码到Git仓库

- 构建验证:自动构建Docker镜像,运行单元测试

- 安全扫描:扫描镜像漏洞,检查代码安全问题

- 集成测试:在测试环境中部署,运行集成测试

- 预发布验证:在预发布环境中进行最终验证

- 生产发布:在生产环境中部署,监控关键指标

- 验证与观察:监控应用指标,确保发布成功

Kurator通过GitOps模式实现这些阶段的自动化:

# enterprise-cicd-pipeline.yaml

apiVersion: kurator.dev/v1alpha1

kind: Pipeline

meta

name: enterprise-app-pipeline

spec:

stages:

- name: build-and-test

type: Jenkins

steps:

- name: build

command: docker build -t $IMAGE .

- name: test

command: go test ./...

- name: security-scan

type: Trivy

image: $IMAGE

- name: deploy-to-staging

type: GitOps

gitRepository: https://github.com/company/apps.git

path: staging/app

branch: staging

approvalRequired: true

- name: deploy-to-prod

type: GitOps

gitRepository: https://github.com/company/apps.git

path: prod/app

branch: main

approvalRequired: true

canary:

enabled: true

steps:

- weight: 10

duration: 5m

- weight: 50

duration: 10m

- weight: 100

这种流水线设计,结合了自动化和人工审批,既保证了效率,又确保了安全性。Kurator的GitOps模式使得整个流水线的实现变得简单和可靠。

7. Kurator Volcano批处理调度优化

7.1 Volcano调度架构与工作流

Volcano是Kurator集成的批处理调度器,专为AI/ML、大数据和HPC工作负载优化。其核心架构包含以下组件:

- Scheduler:核心调度引擎,支持多种调度算法

- Controller:管理Volcano自定义资源的生命周期

- Admission Controller:验证和修改Volcano资源

- Webhook:扩展调度决策

Volcano的工作流包括:

- 作业提交:用户提交Job、TFJob等资源

- 资源分配:Scheduler根据策略分配资源

- 任务调度:将Pod调度到合适的节点

- 执行监控:监控任务执行状态,处理失败情况

- 资源回收:任务完成后回收资源

在Kurator中,Volcano被深度集成,提供了统一的批处理作业管理界面:

# 查看Volcano作业

kurator get jobs -n ai-workloads

# 查看队列状态

kurator get queues

# 描述作业详情

kurator describe job image-classification-training

7.2 分组调度与资源优化

Volcano的核心优势在于其分组调度能力,这对于需要多个相关Pod同时调度的场景(如MPI作业)至关重要。分组调度确保所有相关的Pod能够同时获得资源,避免部分调度导致的资源浪费。

Kurator通过Volcano实现了以下资源优化策略:

- gang scheduling:确保作业的所有任务同时调度

- bin packing:将相关任务调度到同一节点,减少通信开销

- fair sharing:在多租户环境中公平分配资源

- preemption:高优先级作业可以抢占低优先级作业的资源

# volcano-job-example.yaml

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

meta

name: distributed-training

spec:

minAvailable: 8

schedulerName: volcano

queue: ai-training

tasks:

- replicas: 4

name: ps

template:

spec:

containers:

- image: tensorflow/tensorflow:2.8.0-gpu

name: tensorflow

resources:

limits:

nvidia.com/gpu: 1

memory: 16Gi

cpu: 4

- replicas: 4

name: worker

template:

spec:

containers:

- image: tensorflow/tensorflow:2.8.0-gpu

name: tensorflow

resources:

limits:

nvidia.com/gpu: 1

memory: 32Gi

cpu: 8

这种分组调度能力,使得Kurator能够高效地管理复杂的AI/ML训练工作负载,最大化资源利用率。

7.3 大规模AI/ML工作负载实践

在实际企业环境中,Kurator结合Volcano被广泛应用于大规模AI/ML工作负载。一个典型的实践案例是自动驾驶公司的模型训练平台:

挑战:

- 需要同时运行数百个GPU训练任务

- 不同团队对资源有不同优先级需求

- 训练任务需要共享大型数据集

- 需要快速响应业务需求变化

解决方案:

- 分层队列:创建不同优先级的队列,确保关键任务优先执行

- 数据本地化:将数据集缓存在计算节点,减少IO瓶颈

- 弹性伸缩:根据训练队列长度动态调整集群规模

- 混合调度:结合CPU和GPU资源,优化整体利用率

# ai-platform-queue-config.yaml

apiVersion: scheduling.volcano.sh/v1beta1

kind: Queue

meta

name: high-priority

spec:

weight: 100

capability:

cpu: "1000"

memory: 4000Gi

nvidia.com/gpu: "200"

---

apiVersion: scheduling.volcano.sh/v1beta1

kind: Queue

metadata:

name: normal-priority

spec:

weight: 50

capability:

cpu: "2000"

memory: 8000Gi

nvidia.com/gpu: "400"

通过这种设计,公司能够在高峰期同时运行500+个训练任务,资源利用率提升40%,同时保证了关键任务的优先执行。Kurator的统一管理界面,使得运维团队能够轻松监控和管理这些复杂的AI工作负载。

8. Kurator未来发展与社区贡献

8.1 技术演进路线图

Kurator作为新兴的分布式云原生平台,其技术演进路线图聚焦于以下几个关键方向:

- 边缘智能增强:深化KubeEdge集成,支持更多边缘AI场景,如联邦学习、边缘推理优化

- 多云成本优化:引入智能成本分析引擎,自动推荐最优的资源分配策略

- 安全零信任架构:实现基于SPIFFE/SPIRE的零信任网络,提供端到端的安全保障

- 可观测性统一:整合OpenTelemetry,提供跨云、跨集群的统一可观测性体验

- 自动化运维:引入AIOps能力,实现问题的自动检测、诊断和修复

2024-2025年的重点将是企业级特性的完善,包括多租户隔离、灾难恢复、合规审计等。同时,社区将重点关注与CNCF生态项目的深度集成,确保Kurator成为云原生生态的核心组成部分。

8.2 开源社区建设策略

Kurator的开源社区建设遵循"开放、透明、协作"的原则,其社区建设策略包括:

- 贡献者体验优化:简化贡献流程,提供详细的文档和示例

- 多样化贡献渠道:除了代码贡献,还鼓励文档、测试、案例分享等多样化贡献

- 社区治理透明化:采用开放的治理模型,重要决策通过社区讨论决定

- 全球社区建设:在各大洲建立本地化社区,支持多语言文档和活动

对于想要参与Kurator社区的开发者,建议从以下几个方面入手:

- 报告问题:通过GitHub Issues报告bug或提出改进建议

- 文档贡献:完善文档,特别是实践案例和最佳实践

- 代码贡献:从标记为"good first issue"的问题开始

- 社区分享:在meetup、conference上分享使用经验

# 参与Kurator社区的常用命令

git clone https://github.com/kurator-dev/kurator.git

cd kurator

make test # 运行测试

make docs # 生成文档

# 提交PR前的检查

make verify

通过积极参与社区,开发者不仅能够提升技术能力,还能够影响Kurator的未来发展方向,使其更好地满足实际业务需求。

8.3 企业数字化转型价值定位

在企业数字化转型的大背景下,Kurator的价值定位越来越清晰:

- 基础设施现代化:帮助企业从传统基础设施向云原生架构转型

- 多云战略支撑:实现真正的多云战略,避免供应商锁定

- 边缘计算赋能:支持物联网、智能制造等边缘场景

- AI/ML工作负载优化:为数据科学团队提供高效的AI/ML平台

- 开发运维一体化:通过GitOps实现开发和运维的无缝协作

一个成功的数字化转型案例是某大型零售企业,他们使用Kurator实现了:

- 统一管理:将分布在3个公有云和20+边缘站点的应用统一管理

- 成本优化:通过智能调度,将年度基础设施成本降低了35%

- 部署加速:应用部署时间从小时级缩短到分钟级

- 业务连续性:实现了99.99%的业务可用性,支持全球业务连续运行

未来,随着5G、AI、IoT技术的发展,Kurator将在企业数字化转型中扮演更加重要的角色,成为连接云端和边缘、数据和智能、开发和运维的关键平台。企业应该尽早规划云原生转型路线,将Kurator纳入技术战略,以获取数字化时代的竞争优势。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)