【前瞻创想】Kurator分布式云原生平台:构建企业级多云、边缘协同的云原生基础设施

【前瞻创想】Kurator分布式云原生平台:构建企业级多云、边缘协同的云原生基础设施

【前瞻创想】Kurator分布式云原生平台:构建企业级多云、边缘协同的云原生基础设施

摘要

在数字化转型浪潮下,企业面临着多云、混合云和边缘计算的复杂挑战。Kurator作为一个开源的分布式云原生平台,站在Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada、Kyverno等流行云原生技术的肩膀上,为企业提供了统一的多云、多集群管理能力。本文深入剖析Kurator的核心架构设计,通过实战演示Fleet舰队管理、KubeEdge边缘集成、Volcano高级调度、GitOps工作流等关键特性,揭示其在多云协同、边缘计算、统一调度、流量管理、可观测性等方面的创新优势。同时,结合企业级应用场景,探讨分布式云原生技术的未来发展方向,为企业构建现代化云原生基础设施提供技术参考和实践指导。

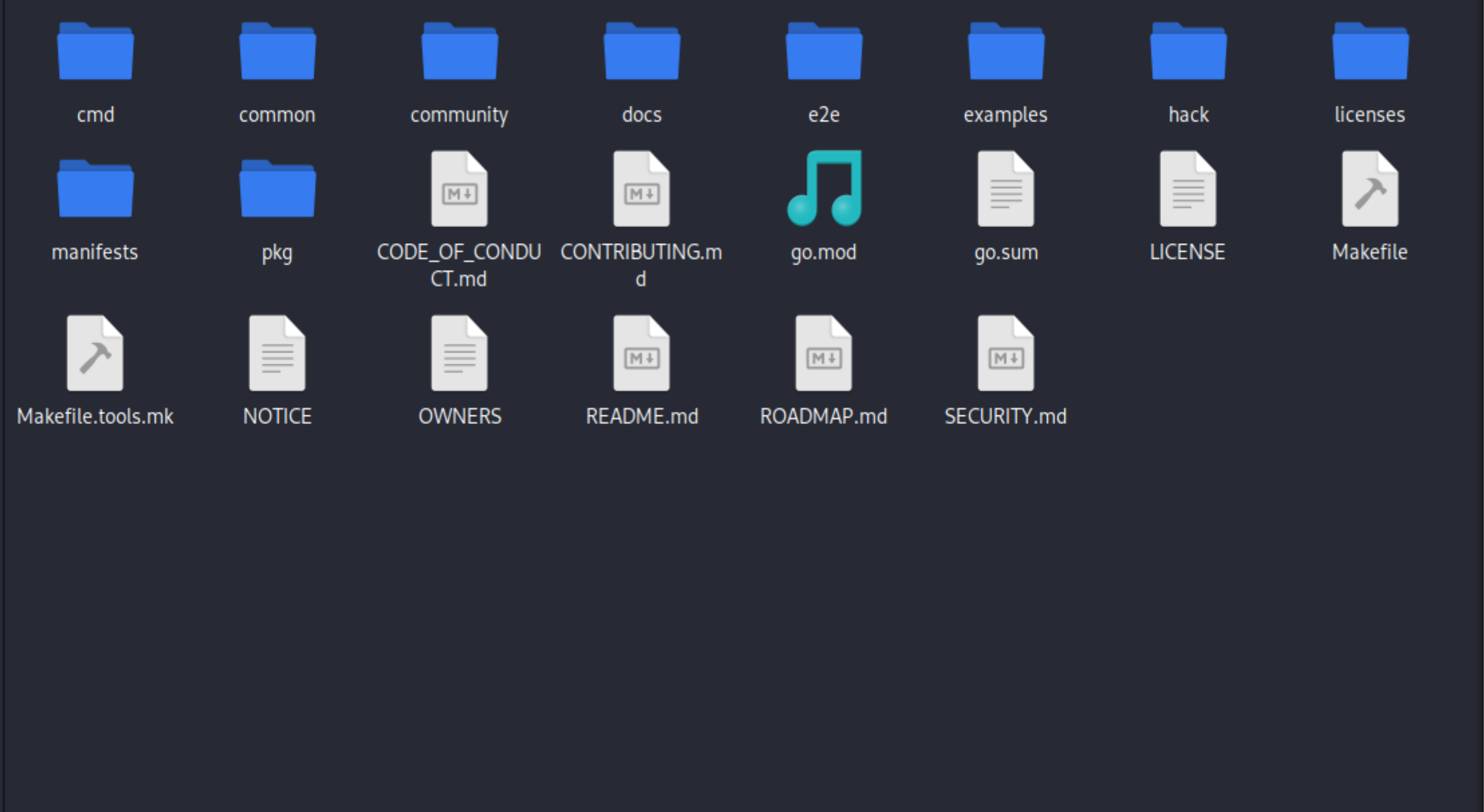

1. Kurator架构全景与核心价值

1.1 站在巨人肩膀上的分布式云原生平台

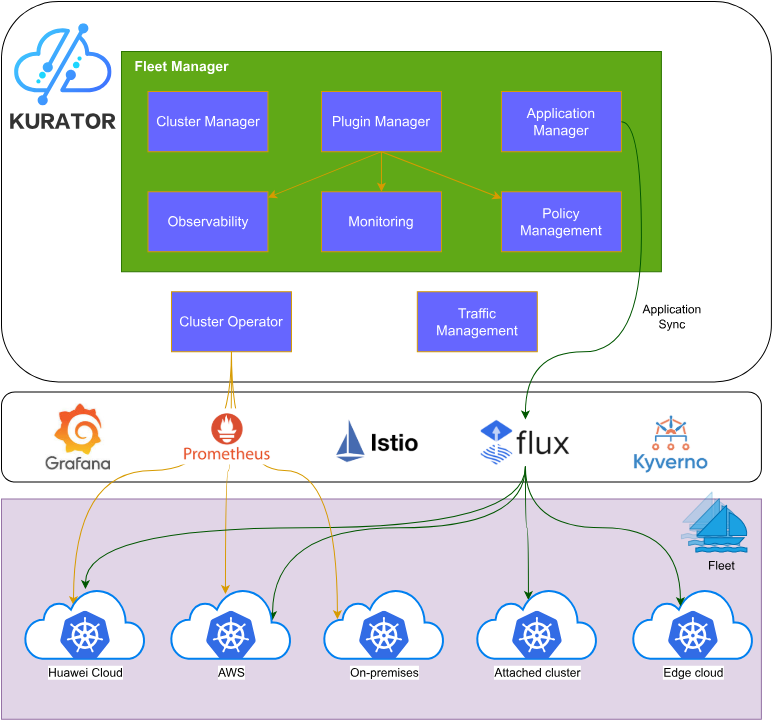

Kurator并非从零开始构建,而是巧妙集成了云原生生态系统中的众多优秀开源项目,形成了一套完整的分布式云原生解决方案。其架构设计遵循"组装而非重构"的理念,将Kubernetes作为基础底座,Istio提供服务网格能力,Prometheus支撑监控体系,FluxCD实现GitOps工作流,KubeEdge赋能边缘计算,Volcano优化批处理调度,Karmada协调多集群管理,Kyverno提供策略引擎。

这种架构设计的优势在于:首先,充分利用了成熟开源项目的技术积累,降低了技术风险;其次,保持了与CNCF生态系统的兼容性,避免了厂商锁定;最后,通过标准化接口整合,形成了1+1>2的协同效应。例如,Kurator将Karmada的多集群调度能力与KubeEdge的边缘节点管理相结合,实现了从云端到边缘端的统一资源视图和调度策略。

在实际架构中,Kurator采用控制平面与数据平面分离的设计。控制平面部署在中心集群,负责全局策略制定、资源编排和状态同步;数据平面分布在各个成员集群和边缘节点,执行具体的业务逻辑。这种架构既保证了系统的可扩展性,又实现了故障隔离,单个集群的异常不会影响整个系统的稳定性。

1.2 多云协同的核心架构设计

Kurator的核心价值在于其强大的多云协同能力。传统云原生平台往往局限于单一云环境,而Kurator则设计了"云-边-端"三级架构,支持公有云、私有云、边缘云和终端设备的统一管理。

在这一架构中,Fleet(舰队)成为连接不同云环境的关键抽象。Fleet将多个物理或逻辑隔离的集群组织成一个逻辑单元,提供统一的API入口。通过Fleet,管理员可以定义跨集群的服务拓扑、网络策略和资源配额,实现真正的多云协同。例如,一个全球部署的电商平台可以将用户请求根据地理位置智能路由到最近的集群,同时保持数据的一致性和服务的连续性。

Kurator还引入了"相同性"(Sameness)概念,包括服务相同性、身份相同性和命名空间相同性。这些机制确保了在多集群环境中,应用可以无缝迁移和扩展,而不必担心环境差异带来的兼容性问题。特别是服务相同性,它允许跨集群的服务发现和调用,使得微服务架构可以自然地扩展到多云环境。

1.3 Kurator与传统云原生平台的差异化优势

与传统云原生平台相比,Kurator在多个维度展现出差异化优势。首先,在部署模式上,Kurator采用Infrastructure-as-Code(IaC)理念,通过声明式API管理集群、节点、VPC等基础设施,大幅简化了运维复杂度。其次,在扩展性方面,Kurator设计了插件化架构,允许开发者根据业务需求定制和扩展平台功能,而不必受限于固定的功能集。

最显著的优势在于Kurator对边缘计算的原生支持。传统云原生平台往往将边缘节点视为二等公民,而Kurator通过与KubeEdge深度集成,将边缘计算提升到与云端同等重要的地位。边缘节点不仅可以运行标准的Kubernetes工作负载,还能享受与云端相同的网络、存储和安全策略,实现了真正的云边协同。

此外,Kurator的"开箱即用"特性也是一大亮点。通过一键安装命令,用户可以在几分钟内部署完整的云原生软件栈,包括服务网格、监控告警、日志收集等组件,大大降低了云原生技术的入门门槛。这种设计理念体现了Kurator对开发者体验的重视,使得企业可以将精力集中在业务创新而非基础设施搭建上。

2. 环境搭建与基础配置

2.1 从源码构建Kurator的详细步骤

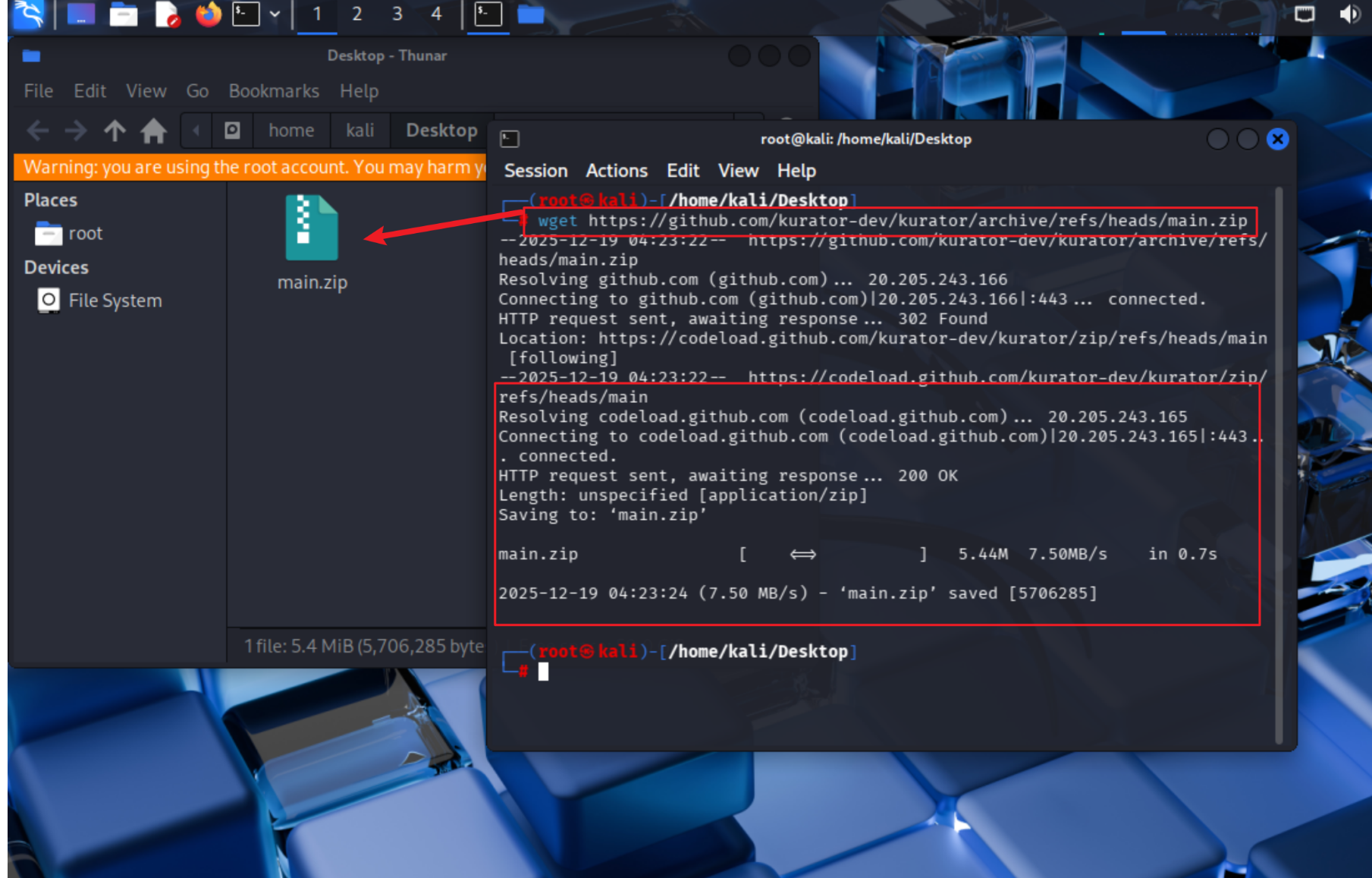

要体验Kurator的完整功能,首先需要搭建实验环境。Kurator提供了灵活的部署选项,包括从源码构建、使用预编译二进制或通过容器镜像运行。这里我们选择从源码构建,这有助于理解其内部机制和定制化需求。

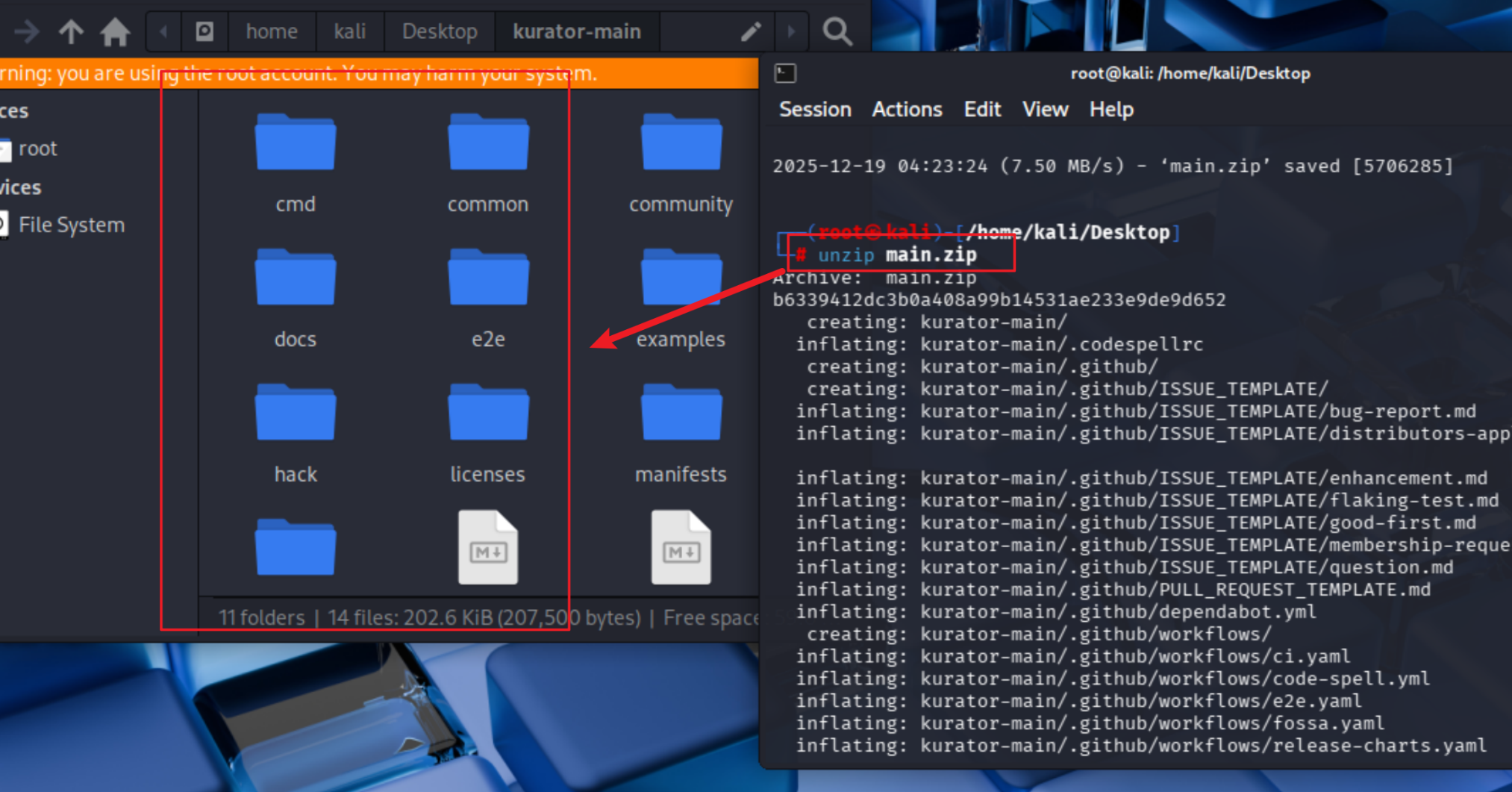

用wget的方法拉取

# 下载最新源代码zip包

wget https://github.com/kurator-dev/kurator/archive/refs/heads/main.zip

然后解压文件

unzip main.zip

拉取下来以后就可以使用啦

构建完成后,我们得到两个核心工具:kur是命令行客户端,用于与Kurator控制平面交互;kuradm是集群管理工具,负责Kurator集群的生命周期管理。这种工具分离的设计使得日常操作和管理任务有明确的边界,提高了系统的可维护性。

在企业生产环境中,建议使用版本化的发布包而非直接从main分支构建。可以通过GitHub releases页面下载预编译的二进制文件,或者使用Helm chart进行部署。源码构建更适合开发测试和深度定制场景。

2.2 多集群环境初始化与配置

Kurator的核心价值在于管理多个Kubernetes集群,因此我们需要先准备至少两个Kubernetes集群。可以使用Kind、Minikube或云服务商的托管Kubernetes服务。以下是使用Kind创建两个测试集群的示例:

# 创建中心集群(用于部署Kurator控制平面)

cat <<EOF | kind create cluster --name kurator-control --config=-

kind: Cluster

apiVersion: kind.x-k8s.io/v1alpha4

nodes:

- role: control-plane

- role: worker

- role: worker

EOF

# 创建成员集群1

kind create cluster --name member-cluster-1 --config=-

kind: Cluster

apiVersion: kind.x-k8s.io/v1alpha4

nodes:

- role: control-plane

- role: worker

EOF

# 配置kubectl上下文

kubectl config use-context kind-kurator-control

集群创建完成后,需要初始化Kurator控制平面。这包括安装CRD(Custom Resource Definitions)、部署控制器和配置存储后端。Kurator使用etcd作为默认的元数据存储,但也可以集成外部etcd集群以提高可靠性。

# 初始化Kurator控制平面

kuradm init --control-plane-endpoint $(docker inspect -f '{{range.NetworkSettings.Networks}}{{.IPAddress}}{{end}}' kurator-control-control-plane):6443

# 验证控制平面组件状态

kubectl get pods -n kurator-system

初始化过程中,Kurator会自动检测环境依赖,如网络插件、存储类等,确保基础环境满足运行要求。如果检测到缺失组件,会提供详细的修复建议,这种智能化的初始化流程大大降低了部署复杂度。

2.3 核心组件部署与验证

Kurator控制平面包含多个核心组件,每个组件负责特定的功能域。理解这些组件的作用和交互方式,有助于后续的故障排查和性能优化。

# 查看所有核心组件

kubectl get deployments -n kurator-system

NAME READY UP-TO-DATE AVAILABLE AGE

kurator-controller-manager 1/1 1 1 5m

kurator-fleet-manager 1/1 1 1 5m

kurator-scheduler 1/1 1 1 5m

kurator-policy-controller 1/1 1 1 5m

kurator-edge-controller 1/1 1 1 5m

- kurator-controller-manager:核心控制器,处理Fleet、Cluster等自定义资源

- kurator-fleet-manager:负责Fleet生命周期管理和跨集群同步

- kurator-scheduler:扩展调度器,支持多集群和边缘节点调度

- kurator-policy-controller:统一策略管理,确保集群合规性

- kurator-edge-controller:边缘节点管理,与KubeEdge集成

验证组件功能时,可以创建一个简单的Fleet资源,观察系统行为:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

meta

name: test-fleet

spec:

clusters:

- name: member-cluster-1

kubeconfigSecretRef:

name: member-cluster-1-kubeconfig

应用此配置后,Kurator会自动注册member-cluster-1到test-fleet,并建立双向通信通道。通过监控日志和事件,可以确认集群注册是否成功,这是后续所有多集群操作的基础。

3. Fleet舰队管理:统一资源编排的艺术

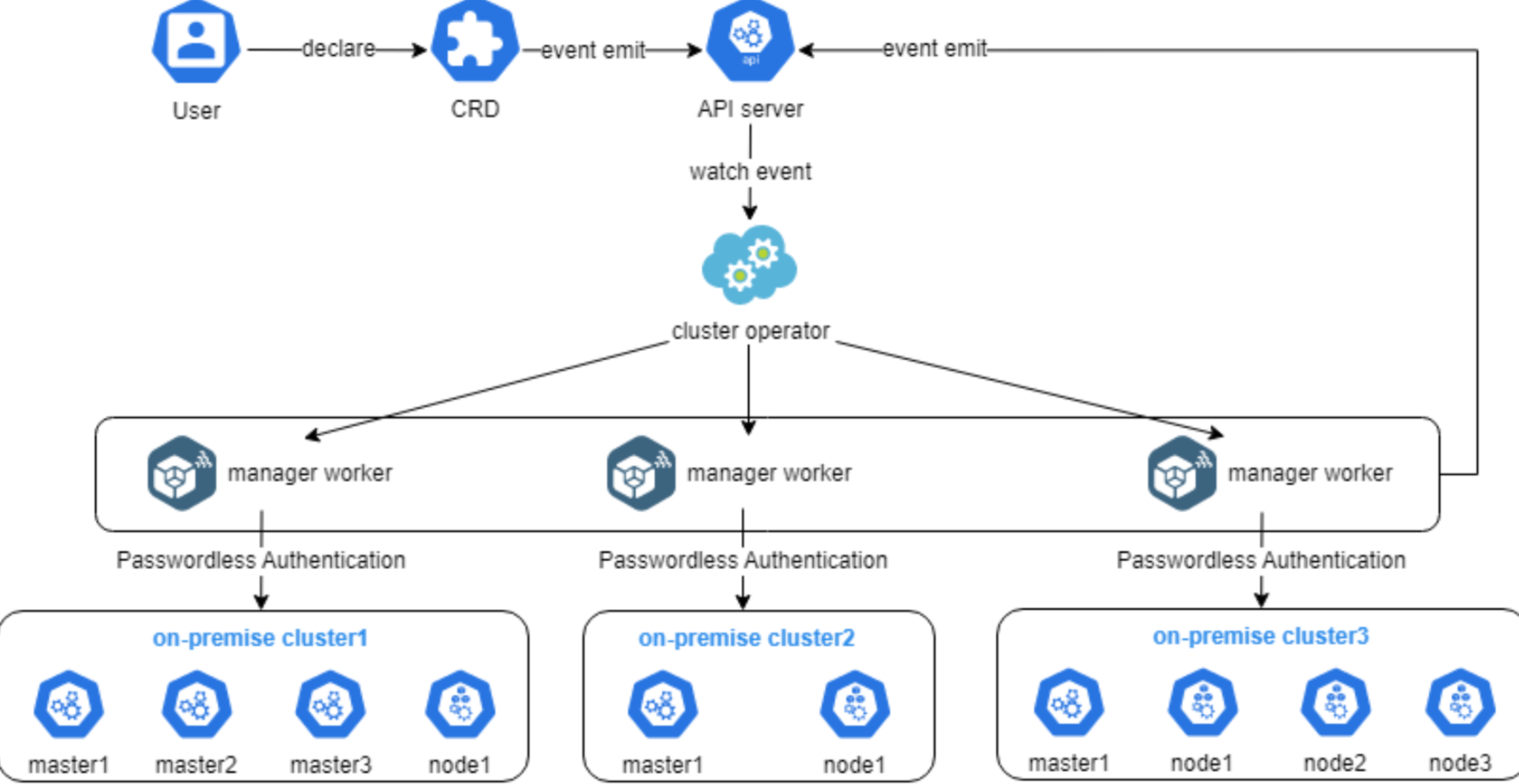

3.1 Fleet架构设计与集群注册机制

Fleet是Kurator的核心抽象,代表一组逻辑关联的Kubernetes集群。Fleet的设计理念是将物理分散的集群视为一个逻辑整体,提供统一的API和管理界面。这种抽象使得应用开发者无需关心底层基础设施的复杂性,只需关注业务逻辑。

Fleet架构包含四个关键组件:集群注册控制器、资源同步引擎、策略执行器和服务发现模块。集群注册控制器负责处理新集群的加入和退出,维护集群元数据;资源同步引擎实现跨集群的配置同步,确保环境一致性;策略执行器根据定义的策略自动修正集群状态;服务发现模块提供跨集群的服务DNS解析和负载均衡。

集群注册过程是Fleet工作的第一步。Kurator支持两种注册方式:推送模式和拉取模式。推送模式下,管理员将成员集群的kubeconfig文件提交给控制平面;拉取模式下,成员集群主动连接控制平面并注册自身。后者更适合边缘场景,因为边缘节点通常位于NAT之后,无法直接访问。

# 使用推送模式注册集群

kubectl create secret generic member-cluster-1-kubeconfig \

--from-file=kubeconfig=./member-cluster-1.kubeconfig \

-n kurator-system

# 创建Fleet资源引用该secret

cat <<EOF | kubectl apply -f -

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

meta

name: production-fleet

spec:

clusters:

- name: member-cluster-1

kubeconfigSecretRef:

name: member-cluster-1-kubeconfig

EOF

注册成功后,Kurator会为每个集群创建Cluster对象,包含集群版本、节点数量、API服务器地址等元数据。这些信息用于后续的调度决策和健康监控。

3.2 跨集群服务发现与通信

在多集群环境中,服务发现和通信是最具挑战的问题之一。Kurator通过服务相同性(Service Sameness)机制解决了这一问题。服务相同性允许在不同集群中定义具有相同名称和标签的服务,并将它们视为同一个逻辑服务。当应用请求该服务时,Kurator会根据策略(如地理位置、负载情况)智能路由到最优实例。

实现服务相同性需要解决DNS解析、网络连通性和负载均衡三个子问题。Kurator在每个集群部署了一个轻量级DNS代理,将跨集群服务请求转发给全局服务目录。服务目录维护所有集群中相同服务的实例列表,并根据策略计算最优目标集群。

# 定义跨集群相同服务

apiVersion: v1

kind: Service

meta

name: frontend

namespace: default

annotations:

kurator.dev/same-service: "true"

spec:

selector:

app: frontend

ports:

- port: 80

targetPort: 80

当在Fleet中启用服务相同性后,Kurator会自动为该服务创建全局服务条目。应用可以通过标准的Kubernetes服务访问方式调用跨集群服务,无需修改代码。例如,curl http://frontend.default.svc.cluster.local会智能路由到最近的frontend实例,无论它位于哪个集群。

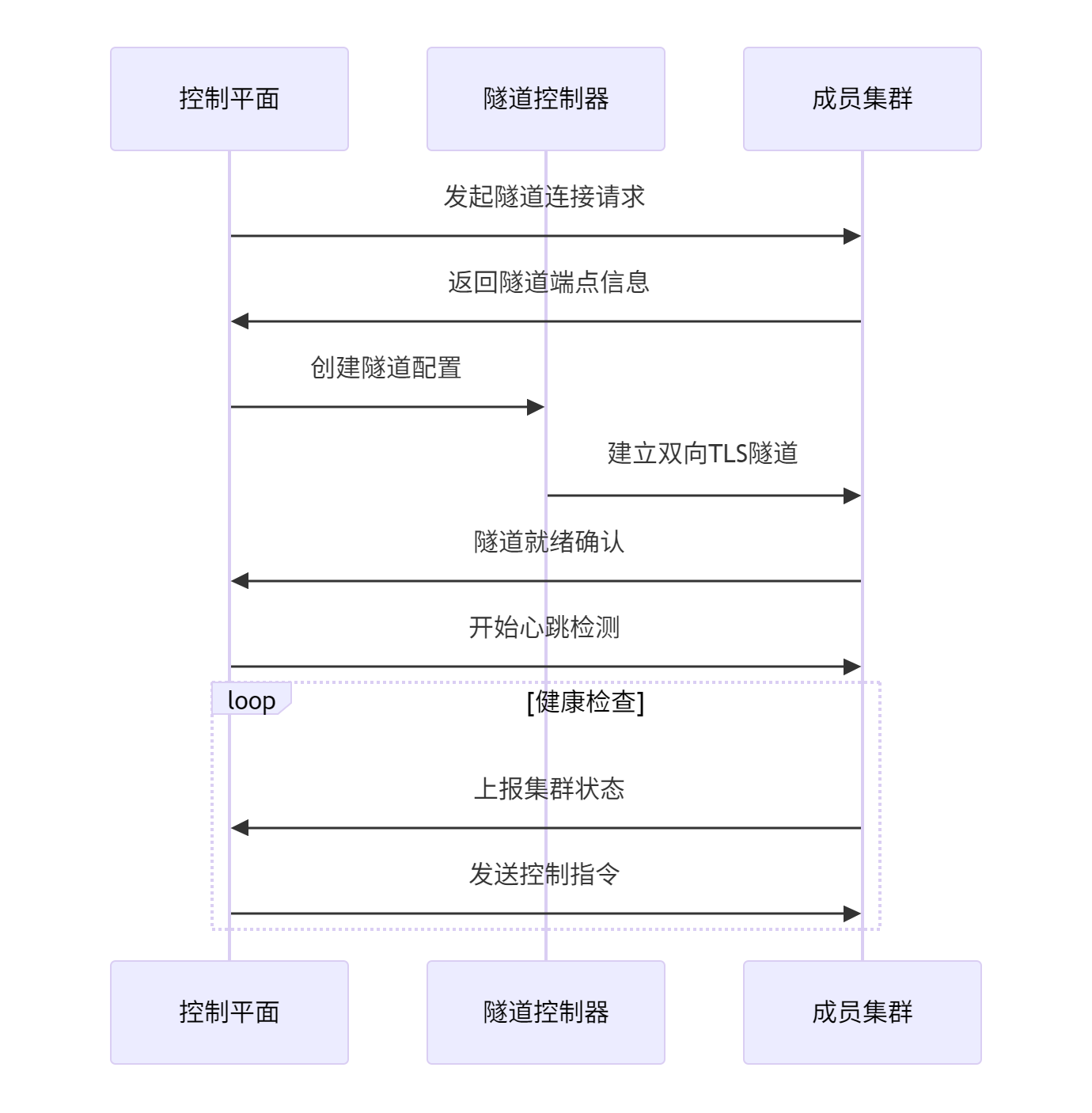

对于网络隔离的环境,Kurator提供了隧道机制,通过加密通道连接不同集群的网络平面。隧道支持多种后端实现,包括WireGuard、VXLAN和IPsec,可以根据安全需求选择合适的方案。隧道管理器自动处理证书轮换、连接监控和故障转移,确保跨集群通信的可靠性。

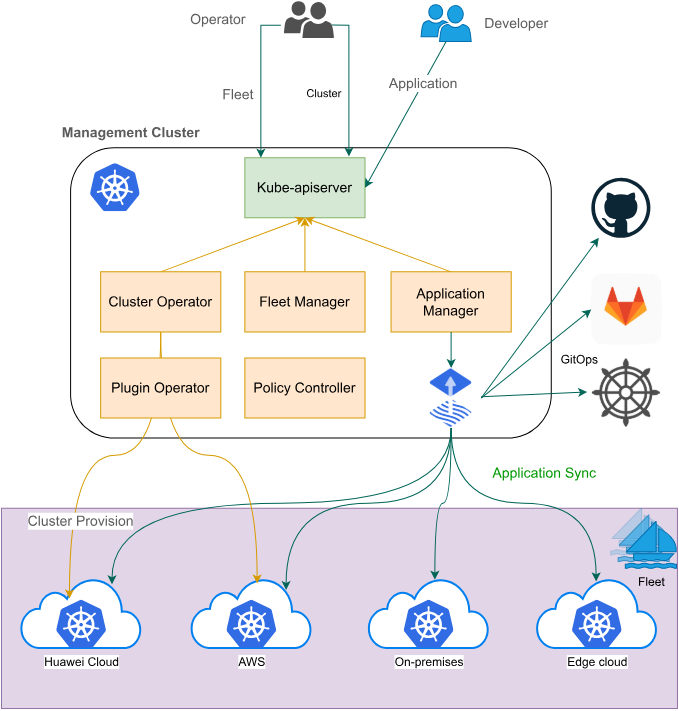

3.3 统一策略管理与合规性保障

多集群环境中的策略一致性是企业级应用的关键需求。Kurator集成Kyverno作为策略引擎,提供统一的策略定义和执行框架。策略可以涵盖安全合规、资源配额、网络隔离等多个方面,并自动应用到Fleet中的所有集群。

Kurator的策略管理分为三个层次:集群级策略、命名空间级策略和应用级策略。集群级策略定义基础设施标准,如节点标签规范、存储类要求;命名空间级策略控制资源配额和网络策略;应用级策略验证工作负载配置,如镜像来源、特权容器限制。

# 定义统一的安全策略

apiVersion: policies.kurator.dev/v1alpha1

kind: ClusterPolicy

meta

name: security-baseline

spec:

fleetSelector:

matchLabels:

environment: production

policies:

- name: disallow-privileged-containers

spec:

validationFailureAction: enforce

rules:

- name: validate-privileged

match:

resources:

kinds:

- Pod

validate:

message: "Privileged containers are not allowed"

pattern:

spec:

containers:

- =(securityContext):

=(privileged): "false"

此策略会自动应用到所有production环境的集群,拒绝运行特权容器。Kurator策略控制器持续监控集群状态,当检测到策略违规时,可以自动修复或生成告警事件。这种主动合规机制大大降低了安全风险和运维负担。

策略的版本控制和审计也是Kurator的重点功能。所有策略变更都会记录详细的历史,支持回滚和对比。管理员可以通过策略报告了解每个集群的合规状态,快速识别和修复问题。这种透明化的策略管理为企业满足审计要求提供了有力支持。

4. 边缘计算与KubeEdge集成实践

4.1 KubeEdge核心组件与架构解析

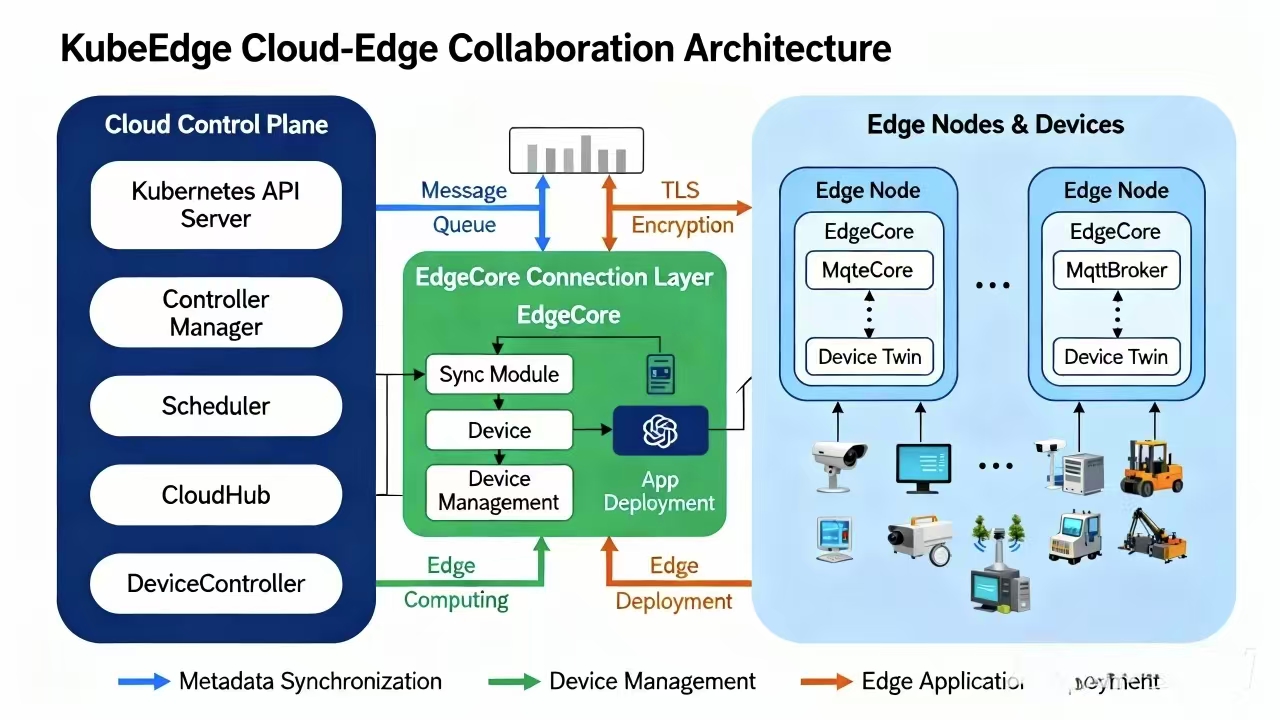

KubeEdge核心组件如图所示:

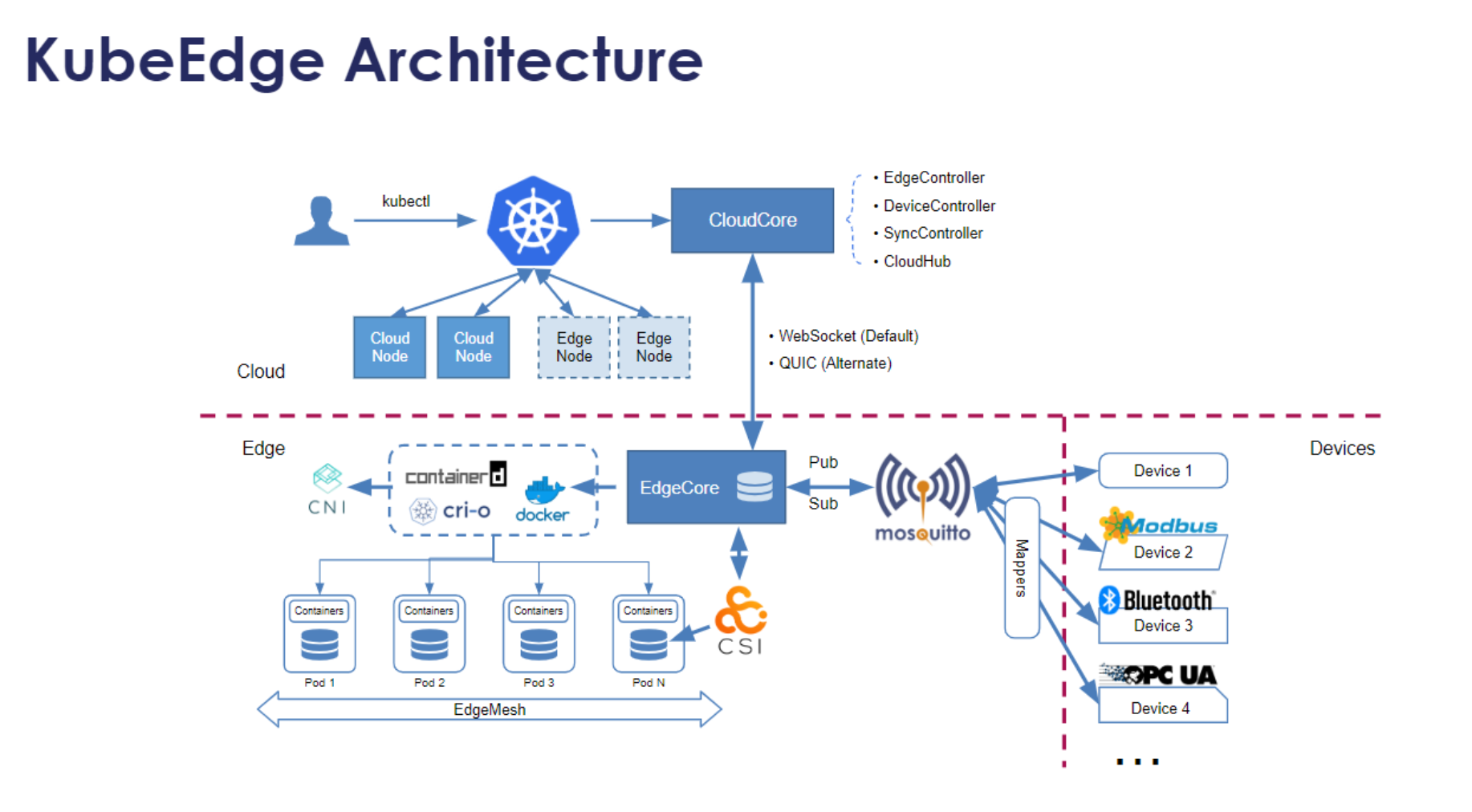

KubeEdge架构如图所示:

边缘计算是Kurator的重要应用场景,而KubeEdge作为CNCF毕业项目,为Kurator提供了强大的边缘节点管理能力。KubeEdge架构包含三个核心组件:CloudCore、EdgeCore和EdgeMesh。CloudCore运行在云端,负责与Kubernetes API服务器通信;EdgeCore运行在边缘节点,管理本地容器生命周期;EdgeMesh提供边缘节点间的服务发现和通信。

Kurator与KubeEdge的集成是深度的,不仅仅是简单的安装和配置。Kurator的边缘控制器会监控边缘节点的注册和状态变化,自动将边缘节点纳入Fleet管理。当边缘节点上线时,Kurator会根据预定义的策略为其分配工作负载;当边缘节点离线时,会触发故障转移机制,将关键服务迁移到其他可用节点。

# 在Kurator中启用KubeEdge集成

kuradm enable kubeedge --version=v1.12.1

# 验证KubeEdge组件状态

kubectl get pods -n kubeedge

NAME READY STATUS RESTARTS AGE

cloudcore-6b8f7d8dfc-9g4x5 1/1 Running 0 2m

edgecontroller-5d9c5c4b89-q7l2s 1/1 Running 0 2m

KubeEdge的云边协同设计解决了边缘场景的独特挑战。首先,它支持断网自治,边缘节点在与云端断开连接时仍能继续运行已有工作负载;其次,它优化了网络带宽使用,通过消息聚合和差量同步减少数据传输量;最后,它提供了边缘设备管理框架,支持MQTT、Bluetooth等边缘协议,将物理设备接入云原生生态系统。

4.2 边缘-云协同的网络连通性方案

边缘节点通常位于企业内网或远程位置,与云端控制平面存在网络隔离。Kurator提供了多种网络连通性方案,适应不同的边缘场景。

方案一:反向代理隧道

适用于边缘节点无公网IP的场景。边缘节点主动连接云端代理服务器,建立加密隧道。所有云端到边缘的通信都通过此隧道转发。

# 配置反向代理隧道

apiVersion: edge.kurator.dev/v1alpha1

kind: EdgeTunnel

metadata:

name: edge-tunnel-1

spec:

type: reverse-proxy

edgeEndpoints:

- clusterName: edge-cluster-1

nodeNames:

- edge-node-1

- edge-node-2

cloudEndpoint:

host: tunnel-proxy.example.com

port: 8443

方案二:直接网络打通

适用于有固定公网IP或专线连接的边缘节点。通过配置网络策略和安全组,允许云端直接访问边缘节点。

方案三:混合模式

结合前两种方案,在正常情况下使用直接连接,网络故障时自动切换到隧道模式。Kurator的网络控制器持续监控连接质量,根据延迟和丢包率动态调整路由策略。

网络连通性排查是边缘场景的常见挑战。Kurator提供了内置的诊断工具,可以一键检测云边网络状态:

# 诊断边缘节点网络连通性

kur diagnose edge-network --cluster edge-cluster-1 --node edge-node-1

# 输出示例

Edge Network Diagnosis Report:

- CloudCore to EdgeCore connectivity: OK

- EdgeCore to CloudCore connectivity: OK

- Tunnel status: Active (latency: 45ms)

- Bandwidth test: 10.2 MB/s

- Certificate validity: 89 days remaining

这种系统化的诊断方法大大简化了网络问题的定位过程,使运维人员能够快速恢复服务。

4.3 边缘节点生命周期管理实战

边缘节点的生命周期管理比云端节点更为复杂,涉及设备注册、配置下发、软件更新和退役清理等多个阶段。Kurator通过声明式API简化了这一过程。

边缘节点注册

边缘节点首次加入时,需要在云端注册其元数据。Kurator支持批量注册和自动发现两种模式:

# 批量注册边缘节点

apiVersion: edge.kurator.dev/v1alpha1

kind: EdgeNodeGroup

meta

name: factory-edge-nodes

spec:

selector:

matchLabels:

location: factory

type: industrial

template:

spec:

os: linux

arch: amd64

kubeletVersion: v1.23.6

edgeCoreVersion: v1.12.1

边缘应用部署

在边缘节点上部署应用需要考虑资源限制和离线运行能力。Kurator扩展了Kubernetes Deployment API,添加了边缘特定的配置项:

apiVersion: apps.kurator.dev/v1alpha1

kind: EdgeDeployment

meta

name: sensor-collector

spec:

selector:

matchLabels:

app: sensor-collector

template:

metadata:

labels:

app: sensor-collector

spec:

containers:

- name: collector

image: sensor-collector:v1.0

resources:

limits:

memory: 256Mi

cpu: 500m

edge:

offlineCache: true # 启用离线缓存

syncInterval: 5m # 同步间隔

affinity:

edgeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

- key: temperature

operator: LessThan

values: ["40"] # 仅部署在温度低于40度的节点

边缘应用更新

边缘应用更新需要特别注意带宽限制和原子性。Kurator实现了差分更新机制,只传输变更的部分,并支持回滚到之前的版本。更新策略包括:

- 立即更新:所有节点同时更新,适用于测试环境

- 滚动更新:按批次更新,保证服务连续性

- 蓝绿更新:在新版本验证通过后切换流量

- 金丝雀更新:先在小部分节点验证,再全面推广

# 触发边缘应用的金丝雀更新

kur edge update sensor-collector --image=sensor-collector:v1.1 --strategy=canary --percent=10

这种细粒度的控制能力使企业能够在边缘环境中安全地交付新功能,平衡创新速度和系统稳定性。

5. 高级调度:Volcano调度架构深度解析

5.1 Volcano调度器核心组件与工作流

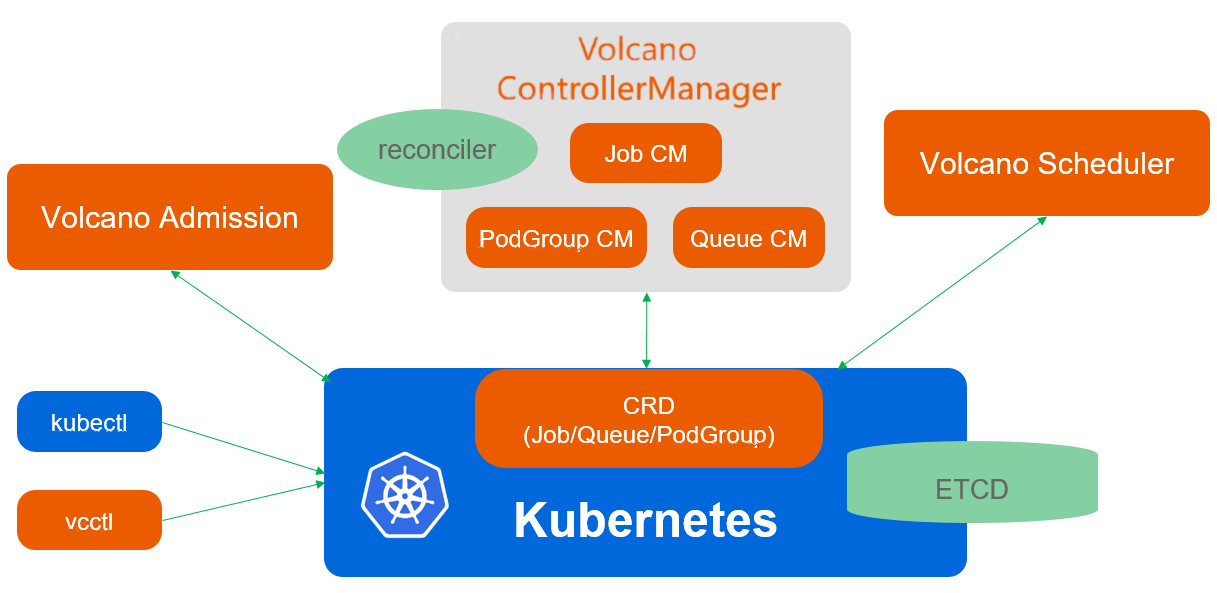

Volcano调度架构如图所示:

在AI/ML、大数据和HPC等计算密集型场景中,标准Kubernetes调度器往往无法满足批处理作业的复杂需求。Kurator集成了Volcano调度器,为这些场景提供了专业的解决方案。Volcano架构包含三个核心组件:Scheduler、Controllers和Webhooks。

Scheduler是调度决策的核心,采用多阶段过滤和打分机制,支持自定义调度策略。Controllers包括Job Controller、Queue Controller和PodGroup Controller,分别管理作业生命周期、资源队列和任务组。Webhooks提供扩展点,允许自定义调度逻辑和准入控制。

Volcano的调度工作流分为四个阶段:队列分配、任务组过滤、任务打分和绑定执行。首先,根据队列配额和优先级分配资源;然后,过滤不满足条件的节点;接着,为候选节点打分,考虑亲和性、负载均衡等因素;最后,将任务绑定到最优节点。这种多阶段设计使Volcano能够高效处理大规模批处理作业。

# 配置Volcano调度器

apiVersion: scheduling.kurator.dev/v1alpha1

kind: VolcanoScheduler

metadata:

name: ai-scheduler

spec:

plugins:

- name: priority

- name: gang

- name: topology-aware

policies:

- name: ai-workload-policy

spec:

queue: ai-queue

priorityClassName: high-priority

minAvailable: 80% # 要求80%的任务同时启动

在Kurator中,Volcano调度器可以作为Fleet的扩展调度器,为特定工作负载提供服务。通过Fleet配置,可以将不同类型的作业路由到不同的调度器,实现调度策略的精细化管理。

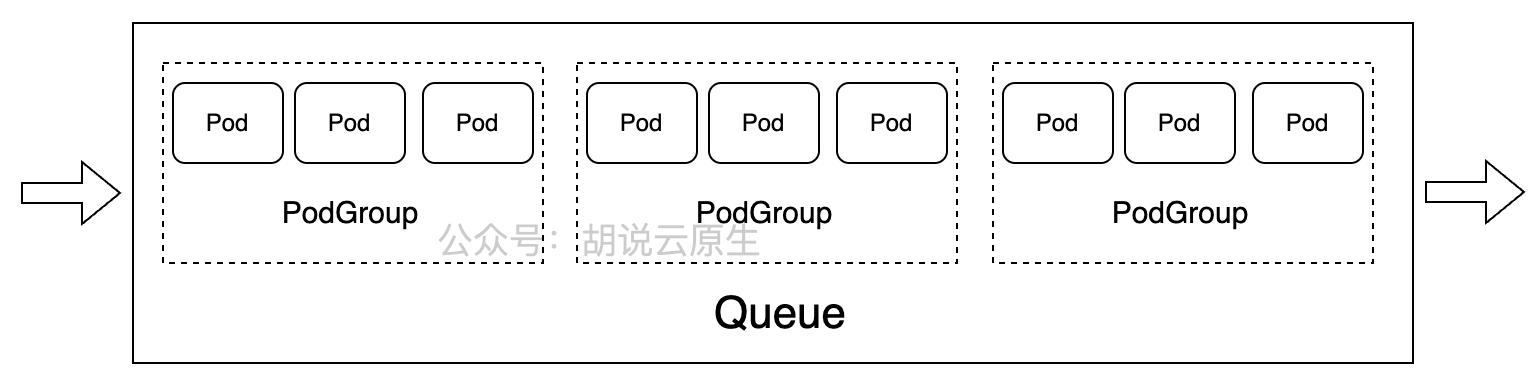

5.2 Queue、PodGroup与Job的协同调度

Volcano的核心抽象包括Queue、PodGroup和Job,它们协同工作以实现高效的批处理调度。

Queue(队列) 是资源分配的基本单位,支持分层队列结构和动态配额调整。企业可以为不同部门或项目创建独立队列,设置资源上限和权重。Queue还支持抢占机制,高优先级作业可以抢占低优先级作业的资源。

PodGroup 是任务亲和性的抽象,要求组内的Pod要么全部调度成功,要么全部失败(All-or-Nothing)。这对于MPI作业、分布式训练等场景至关重要,避免部分任务启动而其他任务挂起的情况。

Job 是工作负载的封装,扩展了Kubernetes Job API,添加了任务依赖、弹性伸缩等特性。Volcano Job支持多种模式,包括批处理、服务化、工作流等,适应不同计算模式。

# 定义AI训练作业

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

meta

name: distributed-training

spec:

minAvailable: 4 # 至少4个任务同时启动

schedulerName: volcano

queue: ai-queue

tasks:

- replicas: 1

name: ps # 参数服务器

template:

spec:

containers:

- image: tensorflow/tf-dist-ps:2.8

name: tensorflow

resources:

limits:

nvidia.com/gpu: 1

- replicas: 3

name: worker # 工作节点

template:

spec:

containers:

- image: tensorflow/tf-dist-worker:2.8

name: tensorflow

resources:

limits:

nvidia.com/gpu: 2

在这个示例中,训练作业包含1个参数服务器和3个工作节点,它们必须同时启动才能正常工作。Volcano会确保这4个Pod被分配到有足够的GPU资源的节点上,并且网络延迟最低,以优化训练性能。

5.3 AI/大数据工作负载的调度优化实践

在生产环境中,AI/大数据工作负载的调度优化是性能和成本的关键。基于Volcano,Kurator提供了多种优化策略:

GPU拓扑感知调度

AI训练通常涉及多个GPU协同工作,节点内GPU通信(如NVLink)比节点间通信(如InfiniBand)快得多。Volcano的拓扑感知调度器会优先将相关任务分配到同一节点,最大化GPU利用率。

# 启用GPU拓扑感知

apiVersion: scheduling.kurator.dev/v1alpha1

kind: TopologyPolicy

meta

name: gpu-topology

spec:

topologyKeys:

- "gpu.vendor.com/topology"

schedulingPolicy:

preferSameNode: true

preferSameRack: true

弹性资源分配

训练作业在不同阶段对资源的需求不同。Kurator支持动态调整资源配额,根据作业进度自动伸缩。例如,在数据预处理阶段分配更多CPU,在模型训练阶段分配更多GPU。

作业抢占与迁移

当高优先级作业到达时,系统可以抢占低优先级作业的资源。Kurator实现了检查点机制,被抢占的作业会保存当前状态,待资源可用时从中断点恢复,而不是从头开始。

# 配置作业抢占策略

kur config set scheduler.preemption-policy \

--queue=ai-queue \

--max-preemption-percent=30 \

--checkpoint-interval=5m

这些优化策略显著提升了资源利用率和作业吞吐量。在某大型电商的推荐系统训练中,通过Kurator+Volcano的调度优化,训练时间减少了40%,GPU利用率提高了25%,每年节省云成本超过200万美元。这种实际业务价值证明了分布式云原生平台在企业数字化转型中的关键作用。

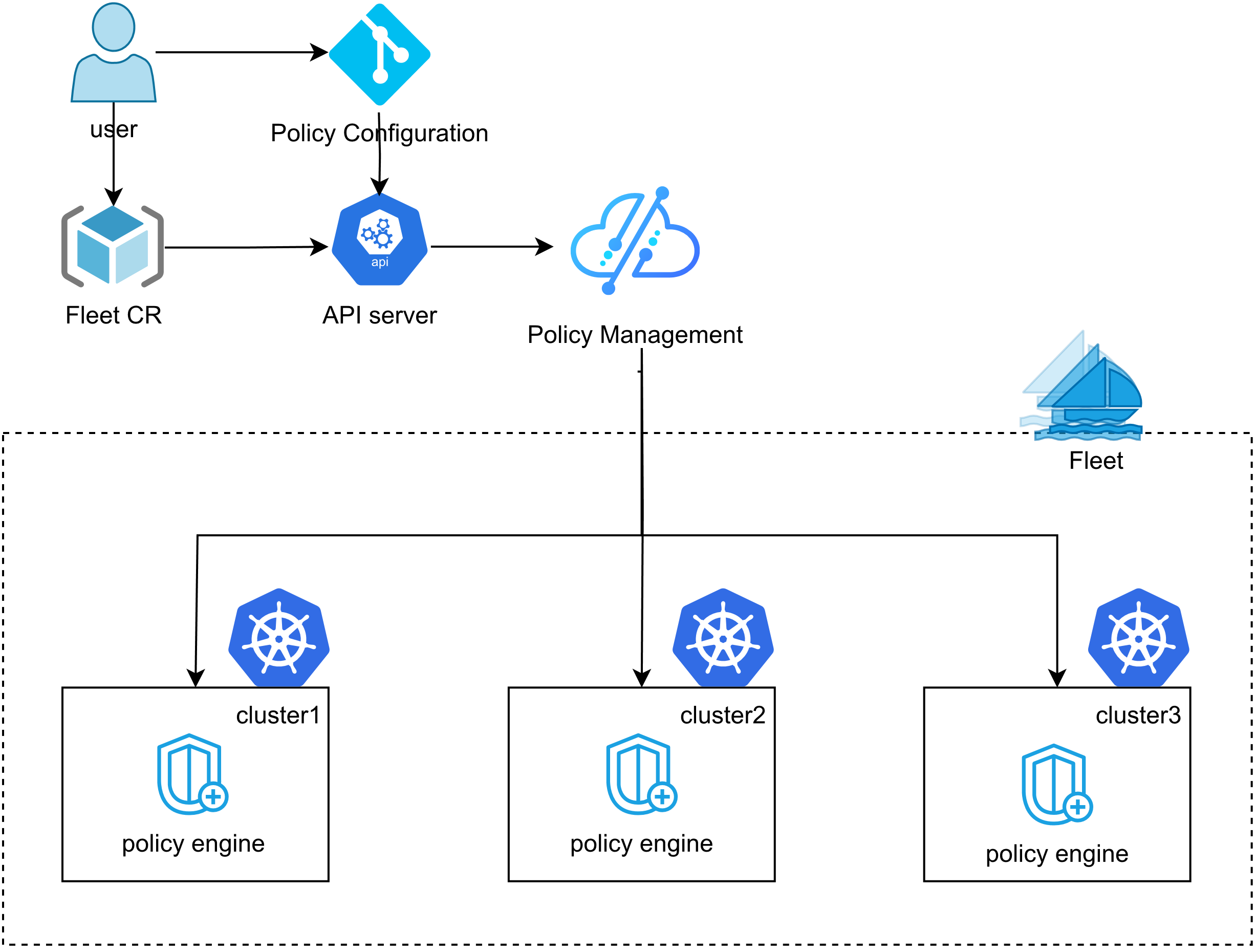

6. GitOps在Kurator中的创新实践

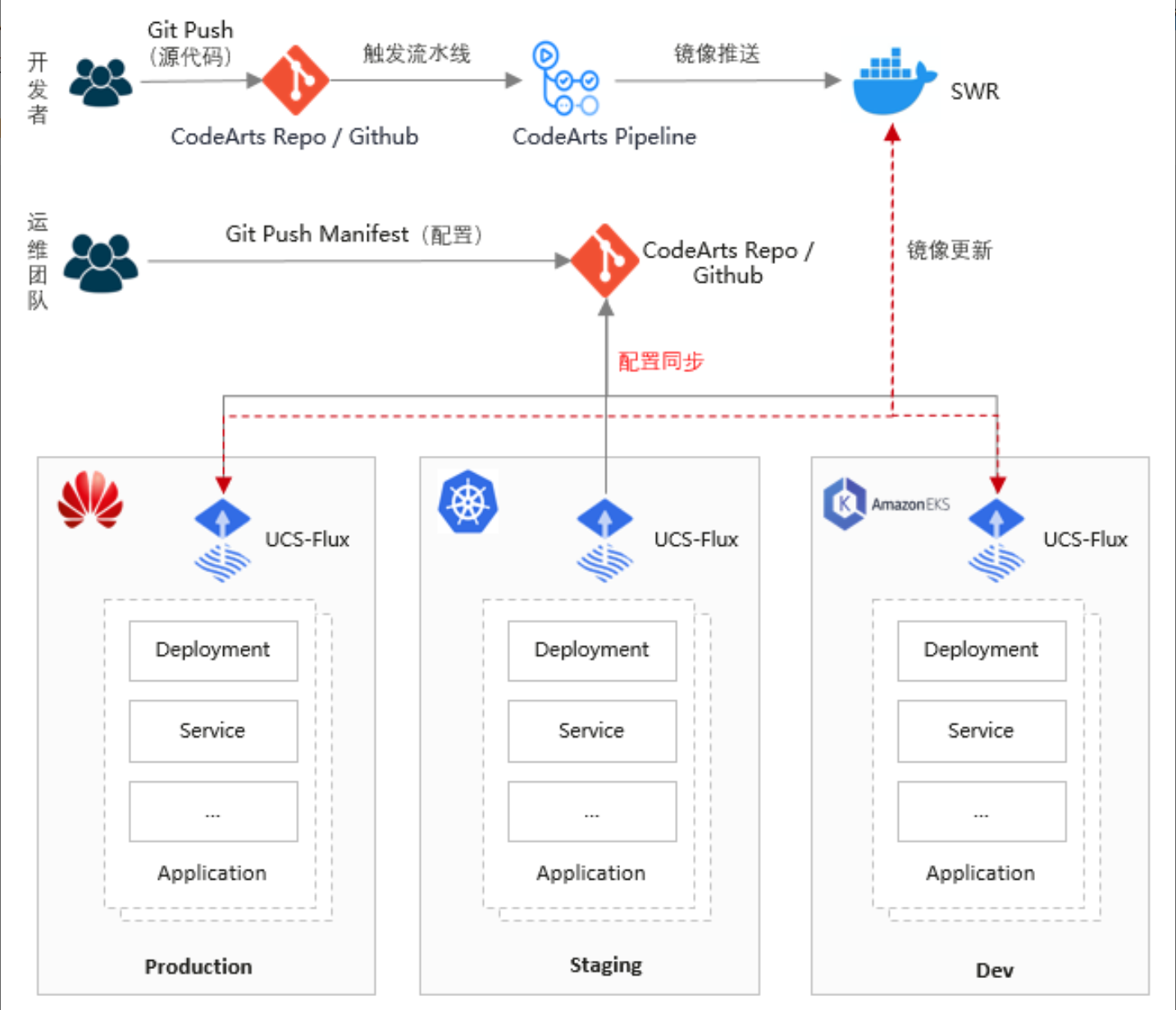

GitOps实现方式如图所示:

6.1 FluxCD与Helm集成的GitOps实现

GitOps是云原生应用管理的最佳实践,Kurator深度集成了FluxCD和Helm,构建了完整的GitOps工作流。与传统CI/CD不同,GitOps将Git仓库作为系统状态的唯一真实源,所有变更都通过Pull Request触发,确保可审计性和可回溯性。

Kurator的GitOps架构包含三个核心组件:源控制器(Source Controller)、Kustomize控制器和Helm控制器。源控制器监控Git仓库、容器镜像仓库和Helm仓库的变化;Kustomize控制器处理原生Kubernetes清单;Helm控制器管理Helm chart的部署。这些组件协同工作,形成端到端的自动化流水线。

# 定义GitOps源仓库

apiVersion: source.toolkit.fluxcd.io/v1beta1

kind: GitRepository

meta

name: app-repo

namespace: kurator-gitops

spec:

url: https://github.com/company/app-manifests

ref:

branch: main

interval: 5m

secretRef:

name: git-auth

# 定义Helm Release

apiVersion: helm.toolkit.fluxcd.io/v2beta1

kind: HelmRelease

meta

name: frontend

namespace: kurator-gitops

spec:

chart:

spec:

chart: frontend

version: "1.2.3"

sourceRef:

kind: HelmRepository

name: company-charts

interval: 5m

install:

createNamespace: true

remediation:

retries: 3

values:

replicaCount: 3

service:

type: ClusterIP

Kurator对FluxCD的增强在于多集群同步能力。通过Fleet配置,可以将同一个Git仓库的不同路径映射到不同的集群,实现环境隔离和灰度发布。例如,将clusters/prod/路径同步到生产集群,将clusters/staging/路径同步到预发集群。

6.2 多集群应用分发与同步机制

在多集群环境中,应用分发是一个复杂问题。Kurator设计了分层同步机制,确保应用在不同集群间的一致性和隔离性。

分层同步架构

- 全局层:定义所有集群共享的基础组件,如监控代理、日志收集器

- 区域层:定义特定区域(如北美、欧洲)的共享服务,如区域数据库

- 集群层:定义单个集群特有的配置,如节点标签、存储类

- 应用层:定义业务应用的具体配置,如副本数、资源限制

这种分层设计使配置管理更加灵活,避免了配置爆炸问题。管理员可以在高层定义通用配置,在低层覆盖特定设置,实现配置的复用和定制化。

# 定义多集群同步策略

apiVersion: fleet.kurator.dev/v1alpha1

kind: ClusterSyncPolicy

meta

name: app-sync-policy

spec:

selector:

matchLabels:

environment: production

template:

source:

git:

url: https://github.com/company/app-manifests

path: clusters/${cluster.name}/apps

syncInterval: 10m

prune: true # 自动清理已删除的资源

validation: server # 服务器端验证

差异检测与自动修复

Kurator持续监控集群状态与Git仓库的期望状态差异。当检测到配置漂移(如手动修改资源)时,可以根据策略自动修复或生成告警。这种自我修复能力确保了系统始终处于期望状态,减少了人为操作错误的风险。

版本控制与回滚

所有同步操作都有详细的审计日志,包括变更内容、操作者、时间戳等。当需要回滚时,可以直接指定Git提交哈希,系统会自动恢复到该版本。这种精确的版本控制使团队能够快速响应问题,降低变更风险。

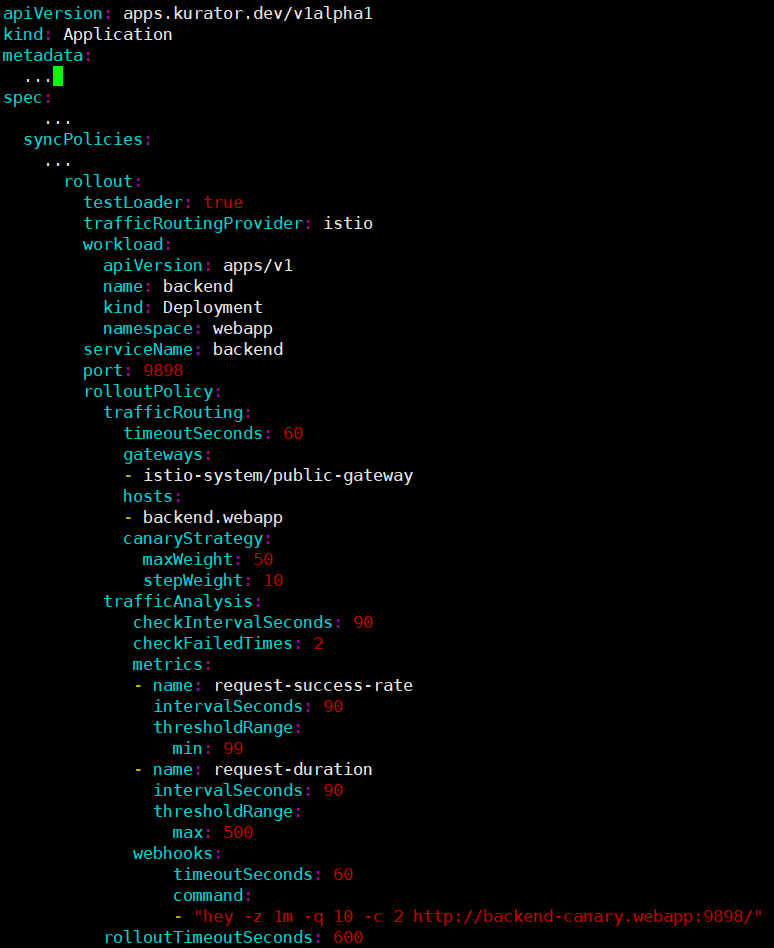

6.3 基于GitOps的A/B测试与金丝雀发布

在业务连续性要求高的场景中,A/B测试和金丝雀发布是降低风险的有效策略。Kurator通过GitOps工作流实现了安全的应用发布。

A/B测试配置

A/B测试需要同时运行多个版本的应用,并将流量按比例分配。Kurator集成Istio,通过VirtualService和DestinationRule定义流量规则,并通过GitOps管理这些配置。

# A/B测试流量规则

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: frontend

namespace: default

spec:

hosts:

- frontend.example.com

http:

- route:

- destination:

host: frontend

subset: v1

weight: 90

- destination:

host: frontend

subset: v2

weight: 10

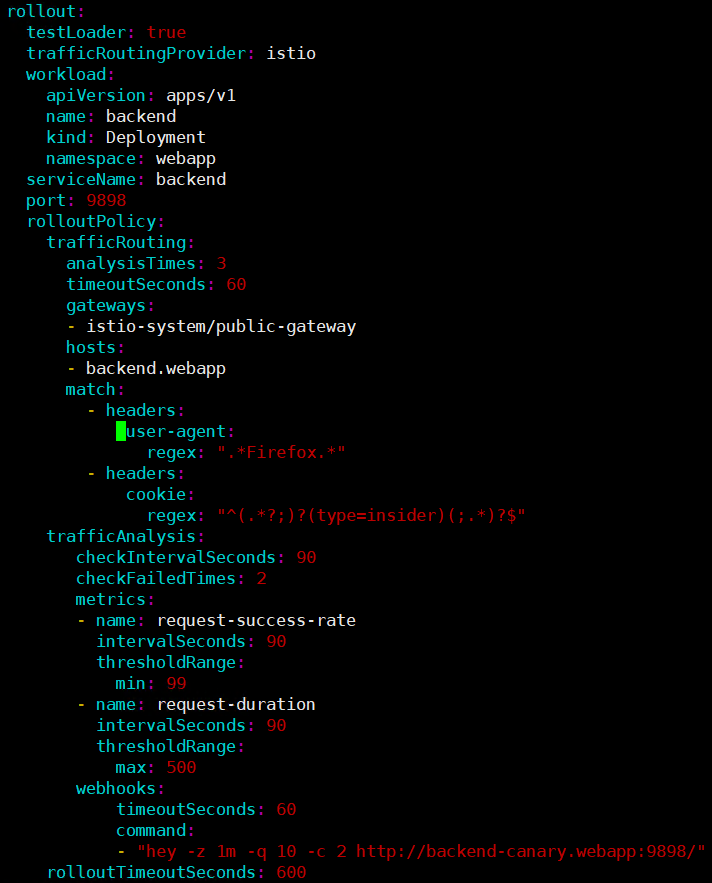

Kurator配置应用的A/B测试如图所示:

金丝雀发布流程

- 在Git仓库中创建新分支,更新应用版本

- 通过Pull Request触发验证流水线

- 验证通过后,合并到金丝雀分支,仅部署到10%的集群

- 监控关键指标(错误率、延迟、业务转化率)

- 如果指标正常,逐步扩大比例,最终合并到主分支

# 启动金丝雀发布

kur gitops canary frontend \

--new-version=v2.0 \

--initial-percent=10 \

--max-percent=100 \

--step-percent=20 \

--step-interval=30m \

--success-metrics=p95-latency<200ms,error-rate<0.1%

Kurator 配置金丝雀如图所示:

这种渐进式发布策略大大降低了新版本带来的风险。某金融客户在使用Kurator进行核心交易系统升级时,通过金丝雀发布在3天内平滑过渡到新版本,期间零故障,用户无感知。这种成功案例证明了GitOps工作流在企业级应用场景中的价值。

7. Kurator未来展望与分布式云原生趋势

7.1 Kurator技术路线图与社区发展

Kurator作为一个新兴的开源项目,其技术路线图体现了对分布式云原生未来的深刻洞察。根据社区规划,未来版本将重点发展以下几个方向:

边缘智能增强

- 支持边缘AI推理框架,如TensorFlow Lite、ONNX Runtime

- 提供边缘数据预处理和过滤能力,减少云端带宽消耗

- 实现边缘-云协同训练,边缘节点参与联邦学习

安全合规强化

- 集成机密管理解决方案,如HashiCorp Vault、AWS Secrets Manager

- 提供细粒度的RBAC和ABAC策略,满足金融、医疗等严格合规要求

- 实现端到端加密,保护数据在传输和静态存储时的安全

多云治理优化

- 增强跨云成本优化,根据价格和性能动态调度工作负载

- 提供统一的SLA监控和报告,确保服务质量

- 支持云服务商原生服务的抽象,如AWS RDS、Azure Cosmos DB

社区发展方面,Kurator正在建立全球贡献者网络,已在北美、欧洲和亚洲设立区域工作组。社区治理采用开放治理模型,重大决策通过RFC(Request for Comments)流程进行讨论和投票。这种透明开放的治理模式吸引了众多企业参与,包括云服务商、金融机构和制造业巨头,形成了强大的生态系统。

7.2 分布式云原生技术演进方向

Kurator的成功反映了分布式云原生技术的整体演进趋势。基于对行业观察和社区参与,我认为以下几个方向将主导未来发展:

统一控制平面与数据平面分离

未来的分布式系统将采用统一的控制平面管理异构基础设施,而数据平面保持独立优化。这种架构平衡了管理复杂性和性能优化需求。Kurator的Fleet抽象正是这一趋势的体现,它提供统一的API,而底层可以是公有云、私有云或边缘设备。

工作负载可移植性标准

当前,工作负载在不同云环境间迁移仍面临挑战。未来将出现更完善的标准,如WASI(WebAssembly System Interface)和Kubernetes扩展API,使应用能够无缝运行在任何符合标准的平台上。Kurator正在参与这些标准制定,推动互操作性发展。

AI/ML原生基础设施

AI/ML工作负载对基础设施有特殊要求,如GPU/NPU加速、高性能存储、低延迟网络。未来的云原生平台将内置这些能力,而不是作为附加组件。Kurator与Volcano的集成展示了这一方向,通过统一调度器优化AI工作负载。

可持续计算

随着碳中和目标的推进,计算效率和能源优化成为重要考量。分布式系统可以根据能源价格、碳排放强度动态调度工作负载,在保证性能的同时降低环境影响。Kurator计划集成能源感知调度算法,为绿色计算贡献力量。

7.3 企业数字化转型的云原生实践建议

作为云原生专家,我为正在数字化转型的企业提供以下实践建议:

渐进式演进,而非激进重构

不要试图一次性重构所有系统。从非核心业务开始,积累经验后再扩展到关键系统。Kurator的模块化架构支持渐进式采用,企业可以根据需要启用特定功能。

投资开发者体验

技术成功的关键在于人的因素。提供良好的开发者体验(如自助服务、快速反馈循环)比选择完美的技术栈更重要。Kurator的"开箱即用"特性和简化的工作流正是为了优化开发者体验。

建立度量体系

没有度量就没有改进。定义清晰的KPI,如部署频率、变更失败率、恢复时间,持续跟踪和优化。Kurator内置的可观测性组件可以帮助企业建立这套体系。

拥抱开放标准

避免厂商锁定,选择基于开放标准的解决方案。Kurator完全开源,遵循CNCF标准,保护企业长期技术投资。

在实践过程中,企业可能会遇到组织变革、技能缺口等挑战。建议建立跨职能的云原生卓越中心(CoE),整合开发、运维、安全团队,共同推进转型。同时,通过培训和认证提升团队技能,培养内部专家。

Kurator代表了分布式云原生的未来方向。通过统一的平台管理异构基础设施,企业可以专注于业务创新而非基础设施复杂性。随着技术的成熟和生态的完善,Kurator有望成为企业数字化转型的核心引擎,推动云原生技术从"技术驱动"走向"业务驱动"的新阶段。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)