别在多集群里瞎撞了!Kurator 全家桶带你从云端丝滑撸到边缘,实战避坑全指南

别在多集群里瞎撞了!Kurator 全家桶带你从云端丝滑撸到边缘,实战避坑全指南

嘿,各位在 Kubernetes 坑里摸爬滚打的兄弟们!今天咱们不聊那些大道理,直接上干货。如果你正被几十个集群的同步搞得头大,或者在云边协同的连通性上撞得满头包,那 Kurator 绝对是你必须要磕下来的硬骨头。

🏗️ 别再找安装包了,直接源码级搭建环境

干活得先有家伙。Kurator 的环境搭建其实没那么玄乎,咱们直接走源码路线,这样最透明,出了问题也好排查。

源码拉取与基础初始化

咱们第一步就是要把 Kurator 的代码仓库搞到本地。别去搜什么二进制包了,源码里的样板配置才是真正的财富。

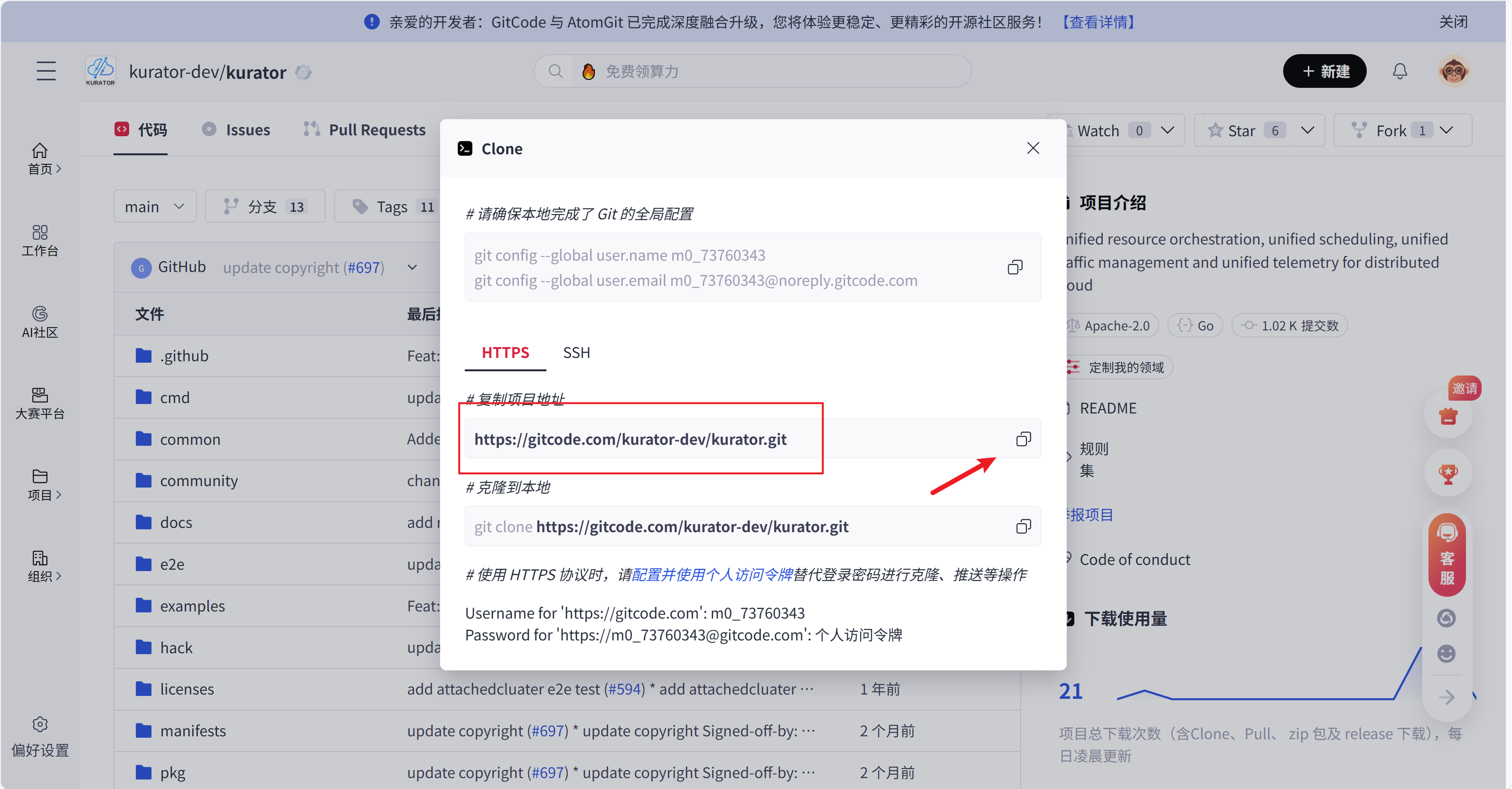

在项目地址中,可以看到可以clone到本地

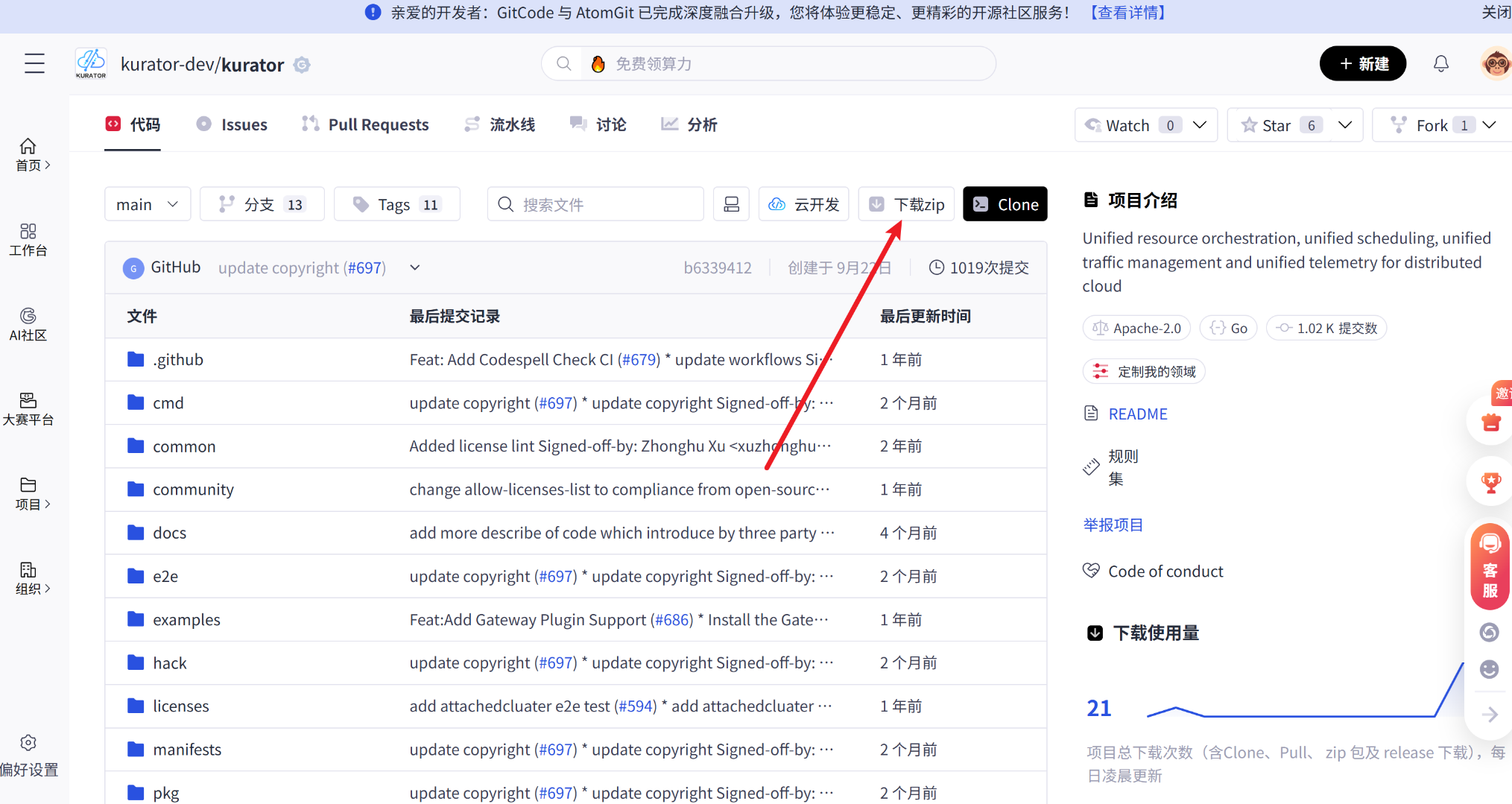

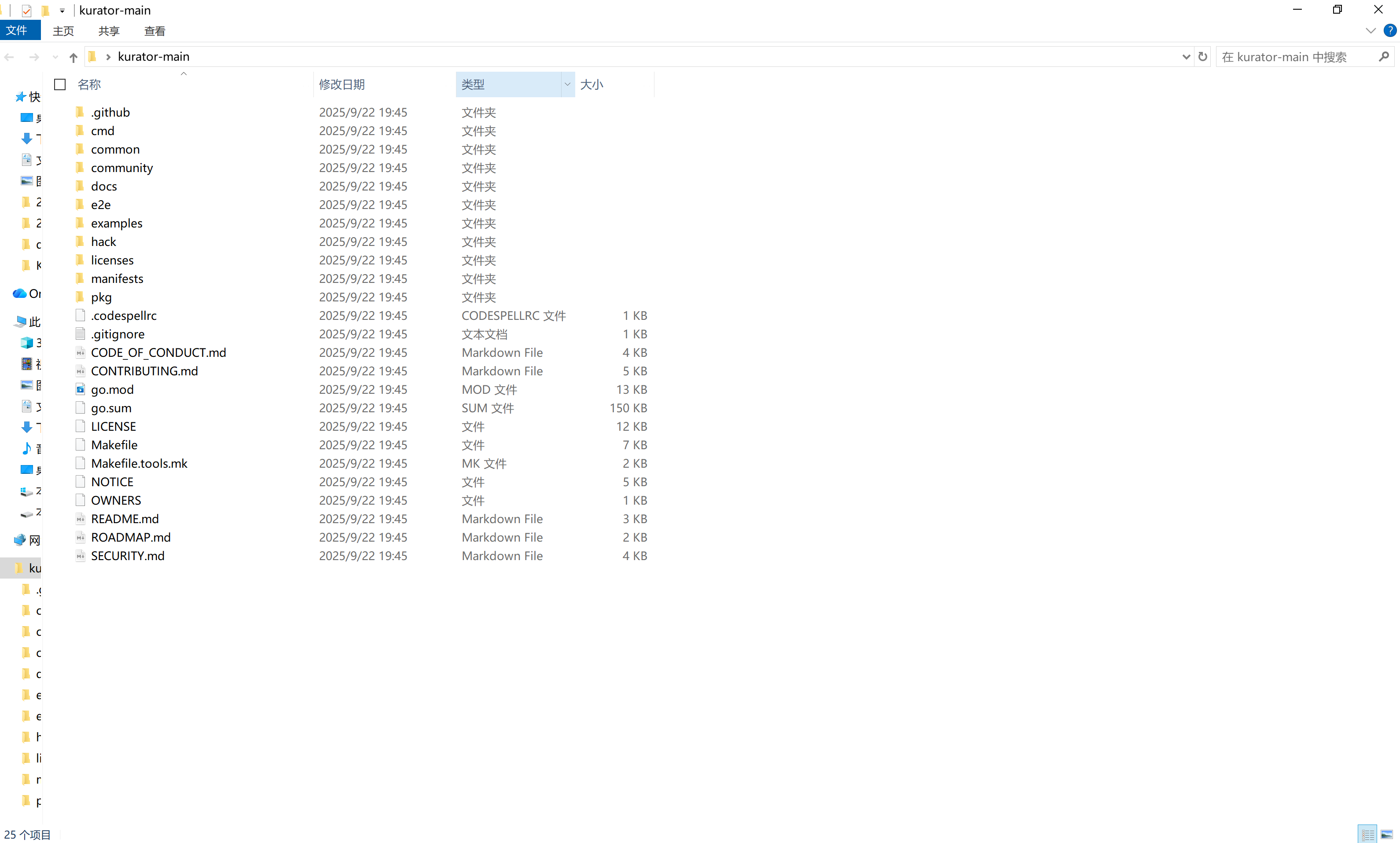

或者我们也可以下载到本地

可以看到我们资源文件已经下载下来了

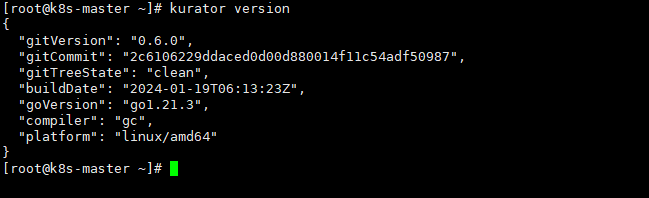

可以看到版本是0.6.0

搭建 CI/CD 流水线的“第一铲子”

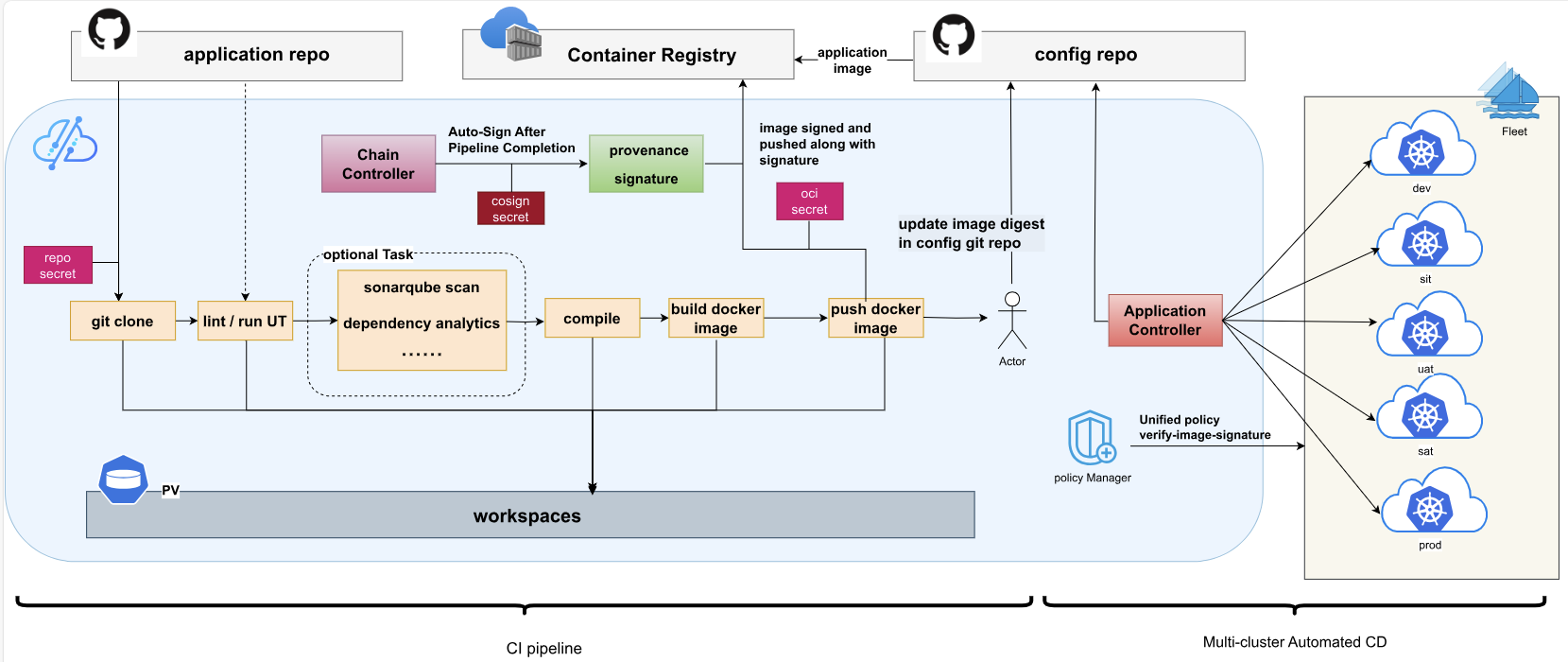

这张图展示了Kurator CI/CD的完整流程,从代码拉取、编译、安全扫描、镜像构建和签名,再到多环境自动部署,整个过程高度自动化,既保证了交付效率,又兼顾了安全性和可追溯性:

在 Kurator 里,CI/CD 不再是零散的 Jenkins 脚本。通过它提供的 API,你可以直接定义从代码提交到集群部署的全流程。我们通过安装 Kurator,本质上是在管理集群里种下了一颗“种子”,它会自动去监听 Git 的变动,然后驱动整个舰队进行更新。

# 这里是手搓的一段环境初始化与基础检查脚本

# 别直接拷贝,先看懂逻辑!

echo "🚀 开始初始化 Kurator 实战环境..."

# 1. 克隆仓库,这是咱们的命根子

git clone https://gitcode.com/kurator-dev/kurator.git

cd kurator

# 2. 预检环境,没有 kubectl 或者 Kind 的话先去面壁

if ! command -v kubectl &> /dev/null; then

echo "❌ 错误: 没装 kubectl 你玩个球?先去装一下。"

exit 1

fi

# 3. 执行安装。假设我们是在本地开发环境

# 这会部署 CRD 和 Operator

echo "📦 正在往集群里塞 Kurator 控制器..."

make install

make deploy

echo "✅ 环境搞定!现在你的集群已经具备‘舰队指挥官’的潜质了。"

🚢 舰队(Fleet)的艺术:身份映射与命名空间的潜规则

一旦环境好了,你就得开始管理“舰队”了。Kurator 引入了 Fleet 的概念,把一堆集群打包管理。这里面有两个非常硬核的逻辑:身份映射和命名空间相同性。

命名空间相同性:别乱起名字

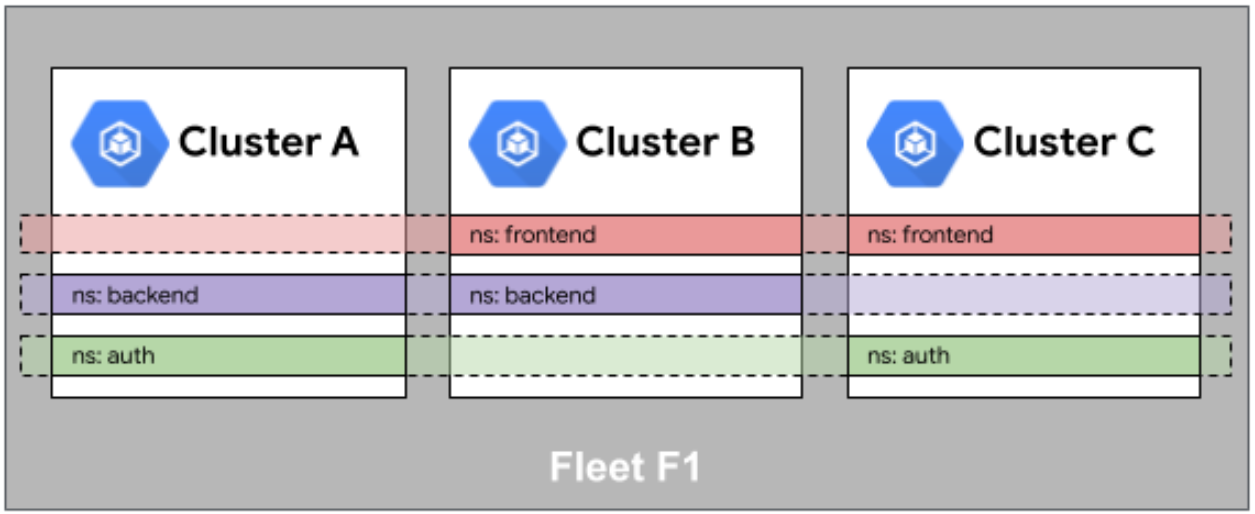

这是Fleet舰队中命名空间相同性的示意图,展示了多集群间命名空间的对齐逻辑与统一编排映射关系:

在 Fleet 里面,有一个潜规则叫“命名空间相同性(Namespace Sameness)”。意思就是,如果你在舰队里定义了一个叫 order-system 的命名空间,那么在所有子集群里,这个名字对应的业务逻辑、权限、资源配额都应该是对齐的。

为什么这么干?因为这样你在做多集群流量分发或者 GitOps 交付时,不需要为每个集群写一套代码。你只要对着 order-system 发号施令,全舰队都会同步响应。

身份映射:外网资源的“通行证”

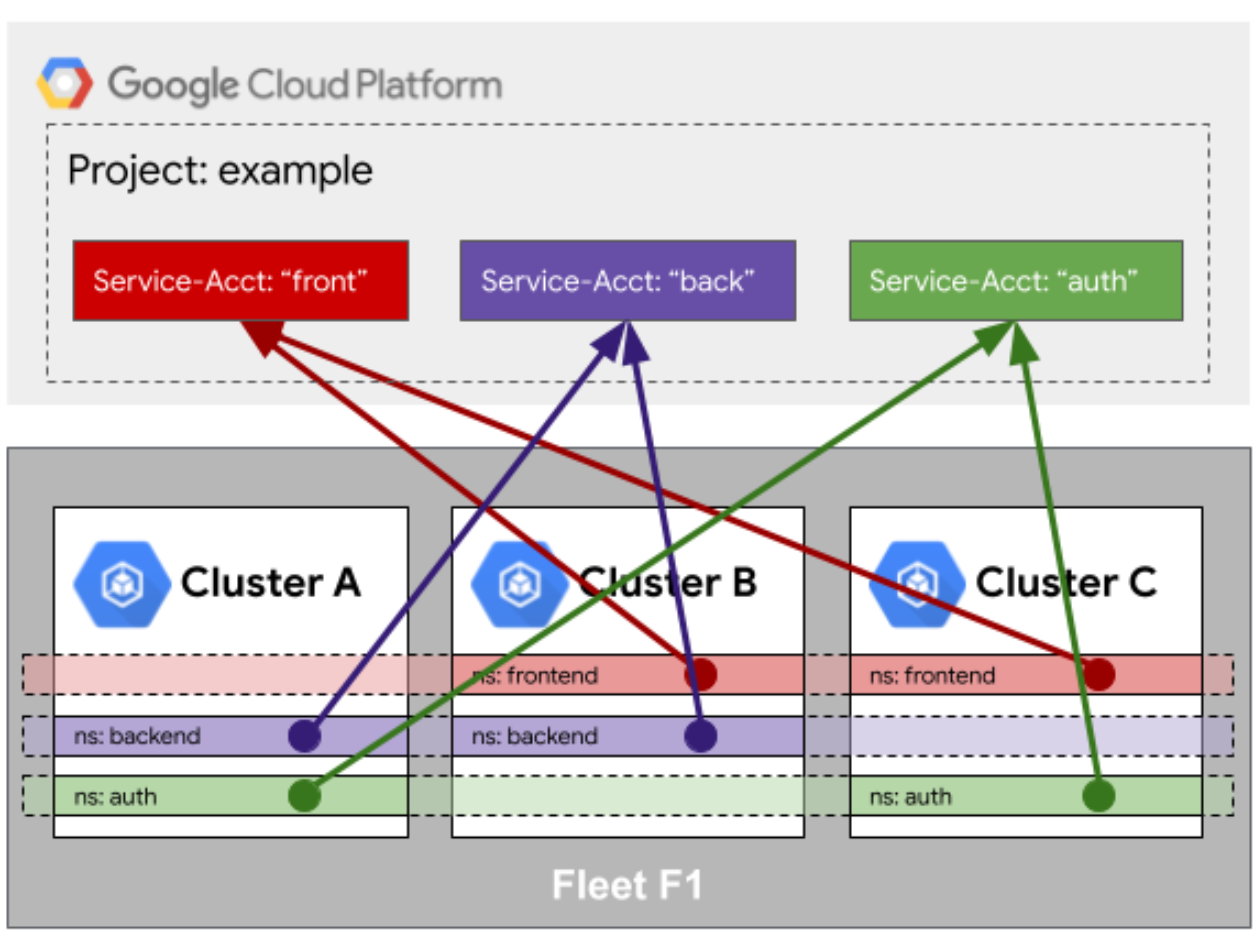

这是Fleet访问队列外部资源的身份映射示意图,展示了跨集群服务与云平台服务账户的统一身份关联机制:

当你的 Fleet 需要访问集群外部资源(比如云商的 RDS 或者 S3)时,身份映射(Identity Mapping)就派上用场了。Kurator 允许你把集群内的 ServiceAccount 映射成外部系统的身份标识。这样,你就不需要在 Secret 里硬编码那些危险的 AccessKey 了,既安全又丝滑,这才是大厂该有的玩法。

🛠️ GitOps 才是正道:FluxCD 与 Helm 的多集群华尔兹

手动 kubectl apply 的时代已经过去了。在 Kurator 里,GitOps 是绝对的核心。

FluxCD Helm 应用的工作流程

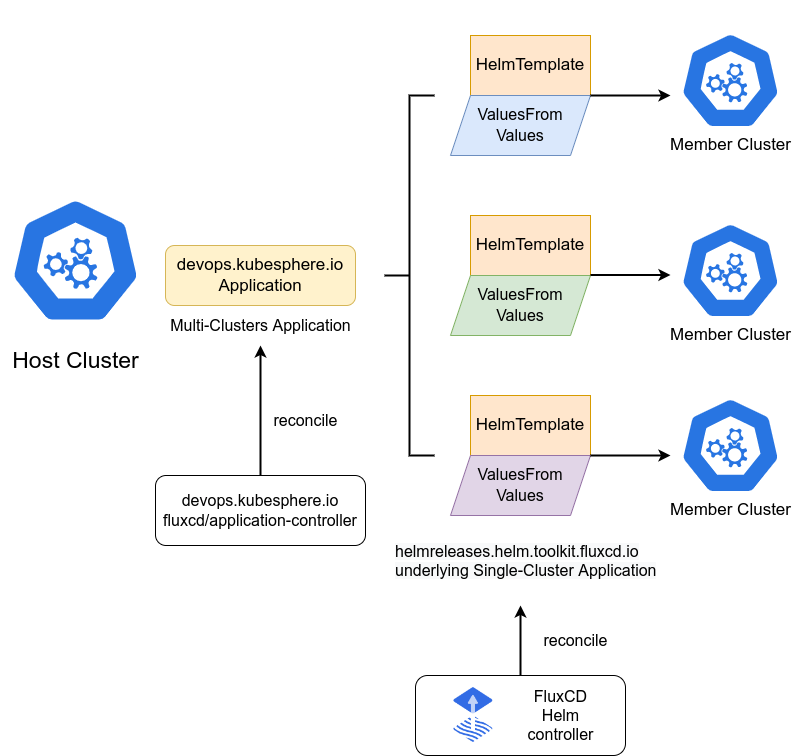

这是FluxCD Helm应用在多集群环境下的工作流程示意图,展示了控制器如何基于Helm模板与差异化配置,实现跨集群应用的统一编排与同步:

Kurator 深度集成了 FluxCD。它的工作流程是这样的:

- Git 监听:FluxCD 盯着你的 Git 仓库,看有没有 Helm Chart 的版本更新。

- 多集群分发:一旦有变动,Kurator 的控制器会根据你定义的 Fleet 策略,把这个更新推送到北京、上海甚至海外的所有子集群。

- 状态回退:如果发布失败,Git 回滚,集群秒级恢复。

配置金丝雀发布:稳稳的幸福

通过 Kurator 配置金丝雀(Canary)发布,简直是运维的救星。你可以定义流量比例,比如先让 5% 的用户试试新版本。如果监控指标(比如错误率)没飙升,再慢慢把流量切过去。

| 环节 | 关键配置项 | 作用 |

|---|---|---|

| 流量路由 | TrafficRouting |

决定哪些请求走新版本,哪些走老版本 |

| 阈值监控 | Analysis |

自动监控 Prometheus 里的成功率,不达标自动熔断 |

| 步进策略 | StepWeight |

比如 5% -> 20% -> 50% -> 100% |

# 手搓一段 GitOps 风格的 HelmRelease 配置

# 感受一下 Kurator 是如何控制多集群交付的

apiVersion: helm.toolkit.fluxcd.io/v2beta1

kind: HelmRelease

metadata:

name: awesome-app-canary

namespace: fleet-system

spec:

interval: 1m

chart:

spec:

chart: ./charts/my-web-app

sourceRef:

kind: GitRepository

name: main-repo

# 这里的 values 会被注入到所有子集群

values:

replicaCount: 3

canary:

enabled: true

analysis:

interval: 30s

threshold: 5

# 流量路由的关键:从 5% 开始灰度

maxWeight: 100

stepWeight: 5

🏔️ 卷到边缘去:KubeEdge 与云边协同的避坑手册

云端玩溜了?那咱们往边缘走。Kurator 对边缘计算的支持主要是通过 KubeEdge 实现的,这块的坑可不少。

KubeEdge 的核心组件与隧道机制

KubeEdge 分为云端的 CloudCore 和边缘端的 EdgeCore。它们之间并不是简单的 TCP 连接,而是有一套复杂的“隧道机制(Tunneling)”。

- CloudHub / EdgeHub:负责消息的下发和上报。

- EdgeMesh:解决边缘节点之间怎么互相找得到的难题。

- DeviceTwin:在云端存一份设备的“影子”,就算边缘断网了,云端也能看到最后的状态。

网络连通性排查:老司机的独门秘籍

云边协同最怕的就是网络不通。通常排查顺序是:

- 查隧道:看 CloudCore 的 10000/10002 端口是不是被防火墙拦了。

- 看证书:边缘端加不进来,90% 都是因为 Token 过期或者证书校验没过。

- 测延迟:边缘环境网络抖动是常态,隧道机制有没有配置自动重连?

🌋 算力压榨:Volcano 在高性能计算中的深度实操

如果你在跑 AI 训练或者大数据,原生的 K8s 调度器会让你想撞墙。这时候必须得用 Volcano。

Job、Queue 与 PodGroup 的三角恋

在 Volcano 里,这三者的关系非常有意思:

- Job:是你提交的任务,比如“训练一个猫狗识别模型”。

- Queue:是你的资源池。比如给研发组分 50 核,测试组分 10 核。

- PodGroup:这是灵魂。它解决的是“Gang Scheduling(成组调度)”问题。如果你的模型训练需要 8 个 GPU 节点同时开跑,PodGroup 能确保只有 8 个节点都到位了才开始,避免浪费算力。

云边协同计算场景

想象一下:你在云端用 Volcano 调度大规模的训练任务,然后把练好的模型通过 Kurator 的 GitOps 流程,分发到边缘侧的 KubeEdge 节点去跑推理。这就是典型的云边协同计算场景。

# 这是一个手搓的 Volcano Job,重点在 PodGroup 的成组调度

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

metadata:

name: heavy-ai-training

spec:

minAvailable: 4 # 核心!不到 4 个 Pod 不开工,防止资源死锁

schedulerName: volcano

queue: research-queue

tasks:

- replicas: 4

name: worker

template:

spec:

containers:

- name: training-box

image: trainer:v2.1

resources:

requests:

nvidia.com/gpu: 1

🌐 流量指挥官:Kurator 的流量路由实战

最后聊聊流量。Kurator 的流量路由(Traffic Routing)不仅仅是改个域名解析。它支持在多集群、云边端之间进行动态调度。

你可以配置路由规则,让北京的用户访问北京的集群,上海的用户访问上海的集群。如果北京集群崩了,Kurator 能自动把流量调度到最近的备份集群。这种全局的流量视角,才是 Kurator 作为“舰队指挥官”的真正魅力所在。

总结一下

从环境搭建那句 git clone 开始,到复杂的云边协同和 Volcano 调度,Kurator 帮我们屏蔽了太多的底层细节。虽然实操过程中还是会有网络、证书、配置对齐等各种小坑,但比起以前手撸脚本,这已经是“降维打击”了。

兄弟们,别光看,赶紧照着上面的代码去撸一遍。云原生这玩意儿,看十遍不如手搓一遍。下次咱们再聊聊怎么把 Kurator 里的监控指标和告警玩出花来,散会!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)