【前瞻创想】Kurator:云原生时代的分布式应用管理新范式

【前瞻创想】Kurator:云原生时代的分布式应用管理新范式

【前瞻创想】Kurator:云原生时代的分布式应用管理新范式

摘要

在云原生技术快速演进的今天,企业面临着多集群、多云、混合云环境下的应用管理复杂性挑战。Kurator作为新一代分布式云原生管理平台,通过深度集成Prometheus、Istio、Karmada、KubeEdge、Volcano等优秀开源项目,构建了一套完整的云原生应用生命周期管理体系。本文从架构设计、环境搭建、核心功能实践到未来发展方向,全面解读Kurator的技术内涵。通过丰富的实战案例,包括Fleet多集群分发、Karmada弹性伸缩、GitOps流水线构建、高级流量管理等,深入剖析Kurator在解决分布式云原生痛点方面的创新价值。结合笔者在云原生社区的实践经验,本文还对分布式云原生技术的演进方向提出前瞻性思考,为企业在云原生转型道路上提供切实可行的技术参考。

1. Kurator架构概览

1.1 核心组件解析

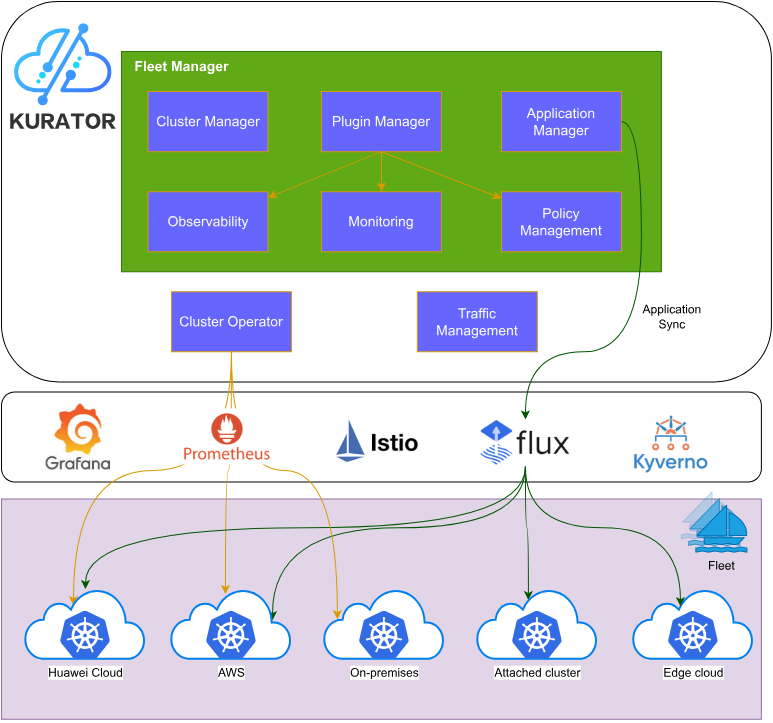

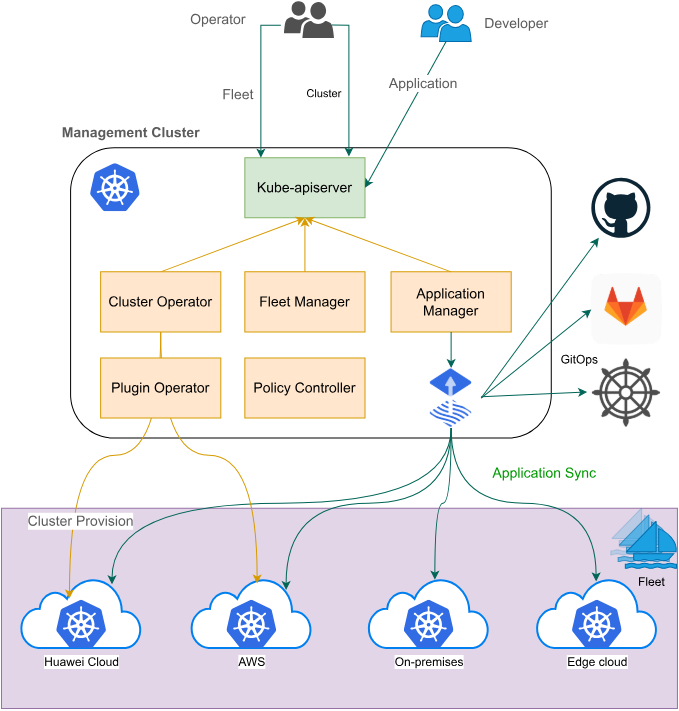

Kurator采用分层架构设计,其核心由Control Plane、Fleet Manager、Policy Engine和Observability四个主要部分组成。Control Plane作为整个系统的"大脑",负责集群注册、资源调度和策略管理;Fleet Manager专注于多集群应用分发,支持多种分发策略和回滚机制;Policy Engine提供统一的策略管理框架,涵盖安全、网络、资源配额等多个维度;Observability则集成了Prometheus、Grafana等监控工具,实现全栈可观测性。

这种架构设计的最大优势在于解耦性。各组件可以独立演进,同时通过标准API进行通信。例如,Fleet Manager可以独立升级而不影响Control Plane的稳定性,这种设计在大规模生产环境中尤为重要。

1.2 集成生态体系

Kurator并非重新发明轮子,而是通过深度集成现有优秀开源项目,构建完整的解决方案。在调度层,集成Volcano实现批处理作业的高效调度;在服务网格层,集成Istio提供高级流量管理能力;在边缘计算层,集成KubeEdge支持边缘节点管理;在多集群管理层,集成Karmada实现跨集群资源调度。

这种集成不是简单的拼凑,而是通过统一的抽象层和适配器模式,将不同项目的API和概念统一到Kurator的管理模型中。例如,Karmada的PropagationPolicy在Kurator中被抽象为ClusterPolicy,用户无需了解底层实现细节,即可通过统一的YAML配置实现跨集群部署。

2. 环境搭建与快速入门

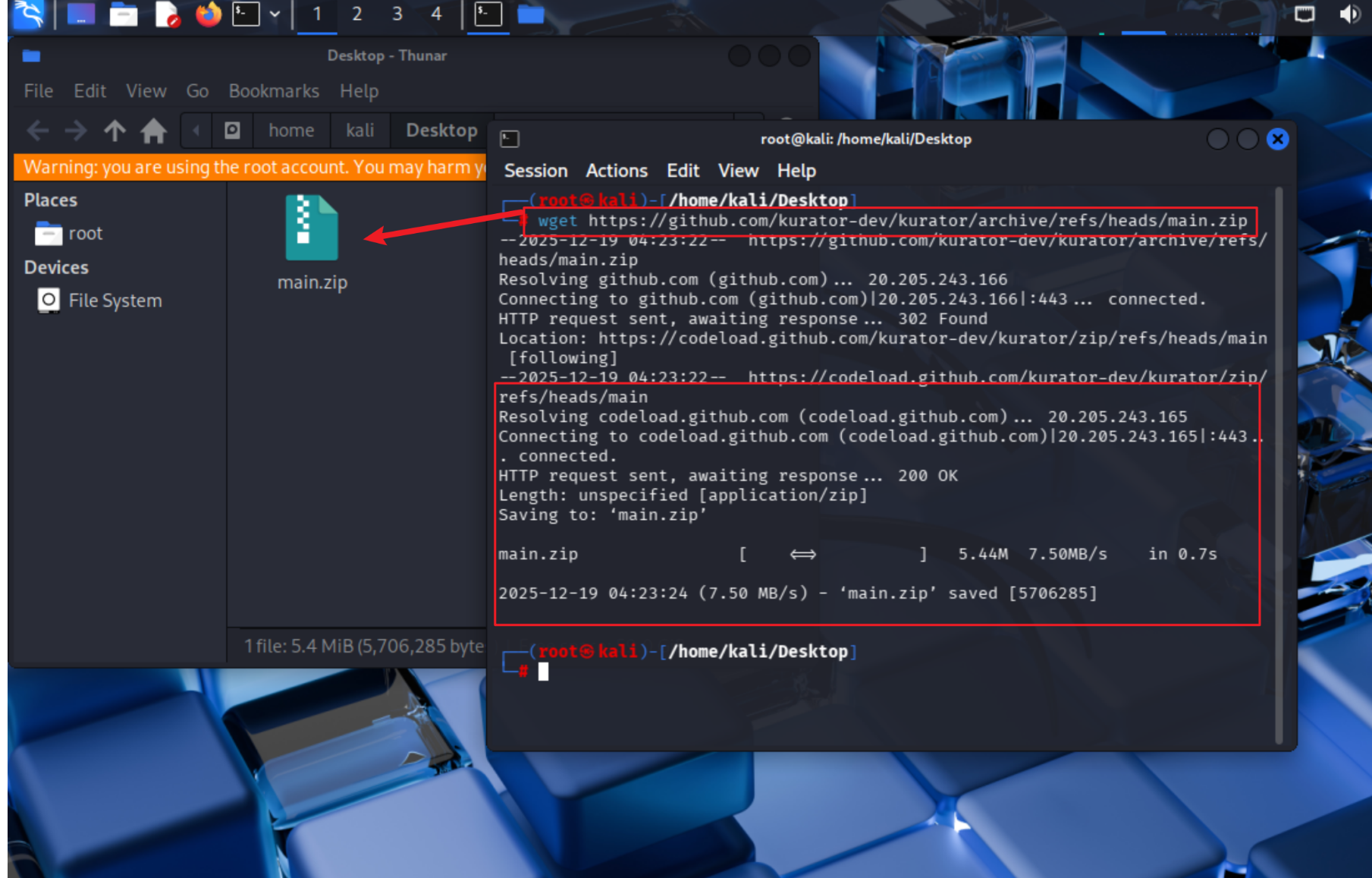

2.1 从源码构建Kurator

首先,我们需要获取Kurator源码。使用wget命令下载最新版本:

wget https://github.com/kurator-dev/kurator/archive/refs/heads/main.zip

unzip main.zip

cd kurator-main

Kurator支持多种部署方式,包括单集群部署、多集群部署和边缘集群部署。对于开发测试环境,我们可以使用脚本快速部署:

./scripts/install-kurator.sh --mode=development

该脚本会自动安装所有依赖组件,包括Kubernetes集群、Prometheus、Istio等。部署完成后,可以通过以下命令验证安装状态:

kubectl get pods -n kurator-system

2.2 基础环境配置

安装完成后,需要配置集群注册。Kurator支持自动发现和手动注册两种方式。这里我们演示手动注册:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Cluster

meta

name: cluster-1

spec:

kubeconfigSecret:

name: cluster-1-kubeconfig

namespace: kurator-system

创建kubeconfig secret:

kubectl create secret generic cluster-1-kubeconfig \

--from-file=kubeconfig=./cluster1.kubeconfig \

-n kurator-system

通过kubectl apply命令应用配置后,Kurator会自动连接到目标集群,并开始同步资源状态。这种设计使得集群管理变得简单直观,运维人员无需记忆复杂的命令行参数。

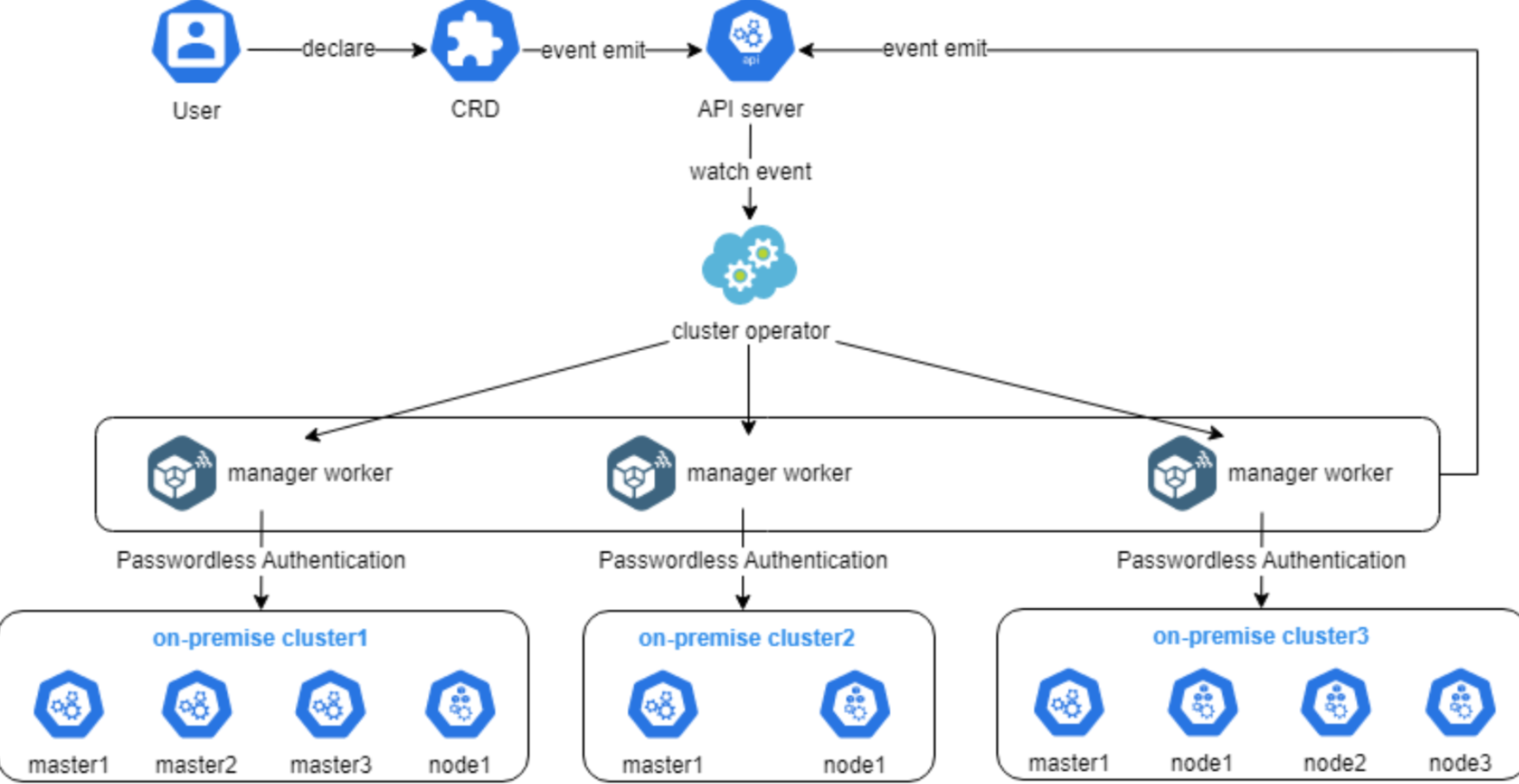

3. Fleet:多集群应用分发的核心引擎

3.1 Fleet架构设计

Fleet是Kurator的核心组件,负责多集群应用的分发和管理。其架构包含三个关键部分:Fleet Controller、Cluster Controller和Resource Syncer。Fleet Controller负责监听Fleet资源的变化,根据策略生成分发任务;Cluster Controller管理集群注册和状态同步;Resource Syncer则负责具体的资源同步操作。

Fleet支持多种分发策略,包括全量分发、按标签分发、按地域分发等。例如,我们可以配置一个Fleet资源,将应用分发到所有生产环境集群:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: prod-fleet

spec:

clusters:

selector:

matchLabels:

environment: production

resources:

- kind: Deployment

name: nginx

namespace: default

3.2 跨集群资源同步机制

Fleet的同步机制基于最终一致性模型,通过版本控制和冲突解决策略确保资源状态的一致性。当源集群中的资源发生变化时,Fleet Controller会生成一个新的同步任务,按照配置的策略分发到目标集群。

在同步过程中,Fleet会处理命名空间映射、资源转换等复杂场景。例如,可以配置不同集群使用不同的命名空间:

apiVersion: fleet.kurator.dev/v1alpha1

kind: ClusterPolicy

metadata:

name: namespace-mapping

spec:

namespaceMapping:

source: default

target:

- cluster-1: production

- cluster-2: staging

这种设计使得跨集群部署变得灵活且可控,特别适合多环境(开发、测试、生产)的应用管理场景。

4. Karmada集成:实现跨集群弹性伸缩

4.1 Karmada架构与Kurator集成

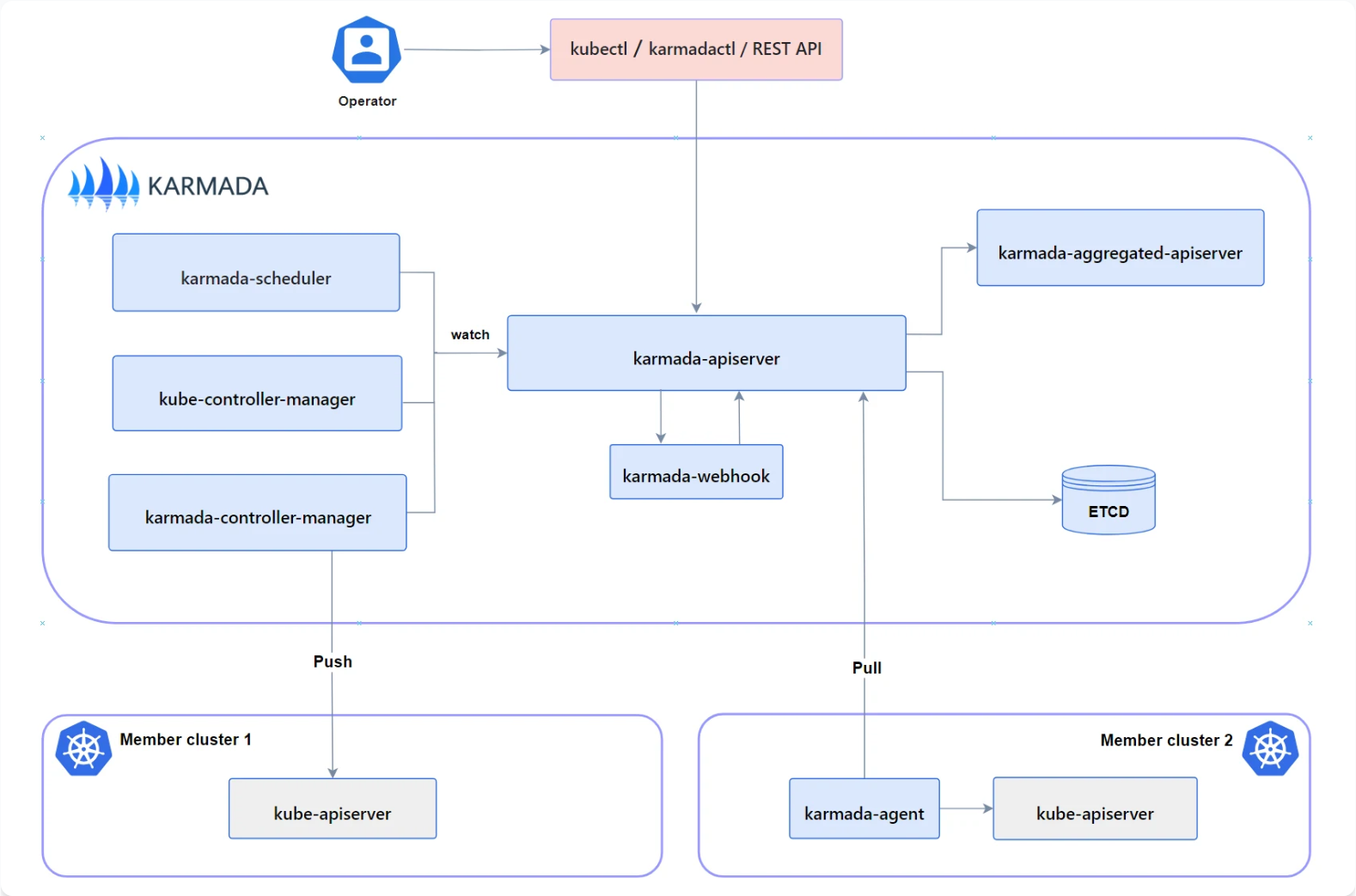

Karmada是CNCF的多集群管理项目,Kurator通过深度集成Karmada,提供了强大的跨集群资源调度能力。Karmada的核心组件包括karmada-control-plane、karmada-scheduler和karmada-agent。在Kurator中,这些组件被封装为统一的API,用户无需直接与Karmada交互。

Kurator对Karmada的集成主要体现在两个方面:一是通过ClusterPolicy统一管理分发策略,二是通过ResourceBinding实现资源绑定。例如,我们可以配置一个跨集群的Deployment,根据负载自动在不同集群间分配实例:

apiVersion: policy.kurator.dev/v1alpha1

kind: ClusterPolicy

meta

name: cross-cluster-autoscaling

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: web-app

placement:

clusterAffinity:

clusterNames:

- cluster-1

- cluster-2

replicaScheduling:

replicaDivisionPreference: Weighted

weights:

cluster-1: 70

cluster-2: 30

4.2 实战:配置跨集群自动扩缩容

结合Kubernetes HPA和Karmada的弹性能力,我们可以实现跨集群的自动扩缩容。首先,在源集群中创建HPA配置:

apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

meta

name: web-app-hpa

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: web-app

minReplicas: 3

maxReplicas: 20

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 50

然后,在Kurator中配置ClusterPolicy,启用跨集群扩缩容:

apiVersion: policy.kurator.dev/v1alpha1

kind: ClusterPolicy

meta

name: cross-cluster-hpa

spec:

resourceSelectors:

- apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

name: web-app-hpa

propagationPolicy:

allowAutoScaling: true

clusterResourceConstraints:

cluster-1:

maxReplicas: 15

cluster-2:

maxReplicas: 10

这种配置下,当CPU利用率超过50%时,HPA会触发扩缩容,Karmada会根据各集群的资源约束,智能地在不同集群间分配Pod实例。这大大提升了应用的可用性和资源利用率。

5. GitOps实践:Kurator的持续交付流水线

5.1 CI/CD架构设计

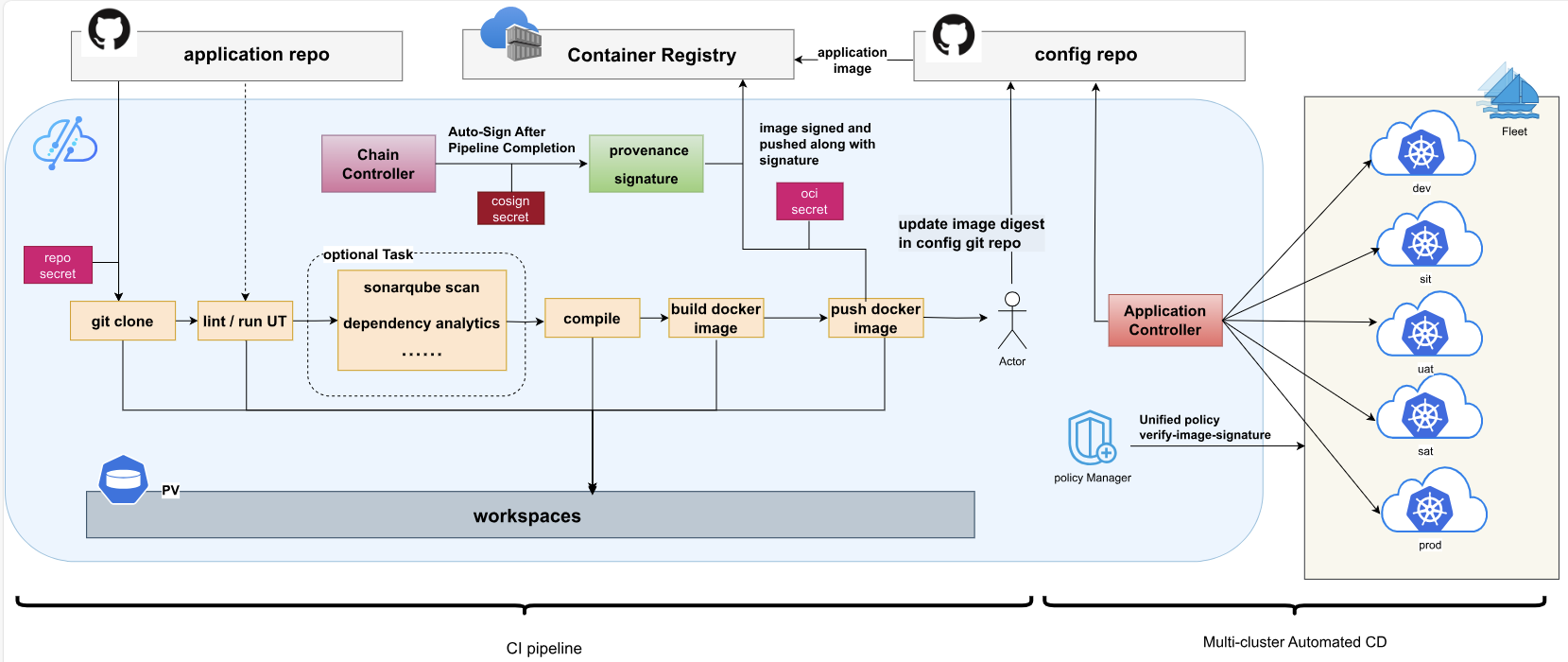

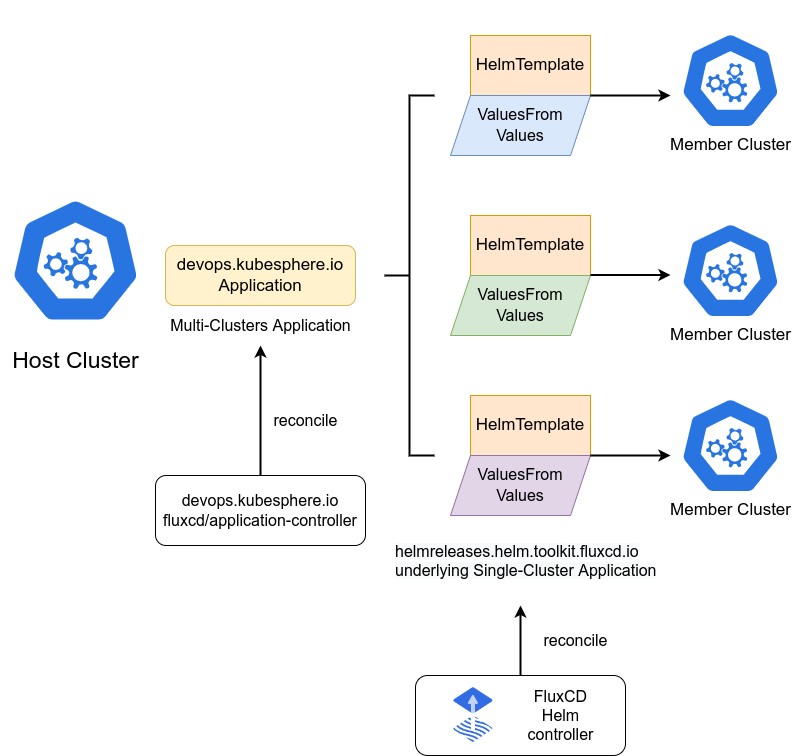

Kurator的CI/CD架构基于GitOps理念,采用声明式配置和自动化同步。整个流水线包含四个阶段:代码构建、镜像推送、配置更新和集群同步。Kurator集成了FluxCD作为GitOps引擎,通过Kustomize和Helm支持复杂的配置管理。

架构的核心是GitRepository和HelmRelease资源。GitRepository定义了配置仓库的位置和同步策略,HelmRelease则定义了Helm chart的部署参数。Kurator通过统一的API Gateway,将这些资源整合到管理界面中。

5.2 FluxCD与Helm集成实践

以下是一个完整的GitOps配置示例,展示如何通过Kurator管理Helm应用:

apiVersion: source.toolkit.fluxcd.io/v1beta2

kind: GitRepository

meta

name: app-config

namespace: flux-system

spec:

url: https://github.com/example/app-config

ref:

branch: main

interval: 5m

---

apiVersion: helm.toolkit.fluxcd.io/v2beta1

kind: HelmRelease

meta

name: nginx-app

namespace: default

spec:

chart:

spec:

chart: nginx

sourceRef:

kind: HelmRepository

name: bitnami

version: "14.0.0"

interval: 5m

targetNamespace: production

values:

replicaCount: 3

service:

type: ClusterIP

在Kurator中,我们可以通过ClusterPolicy将此配置分发到多个集群:

apiVersion: policy.kurator.dev/v1alpha1

kind: ClusterPolicy

meta

name: gitops-deployment

spec:

resourceSelectors:

- apiVersion: source.toolkit.fluxcd.io/v1beta2

kind: GitRepository

name: app-config

- apiVersion: helm.toolkit.fluxcd.io/v2beta1

kind: HelmRelease

name: nginx-app

placement:

clusterAffinity:

clusterNames:

- cluster-1

- cluster-2

当Git仓库中的配置发生变化时,FluxCD会自动检测并同步到所有目标集群,实现真正的GitOps工作流。这种设计不仅提高了部署效率,还确保了环境一致性。

6. 高级流量管理:金丝雀与蓝绿发布

6.1 基于Istio的流量切分

Kurator深度集成Istio,提供了强大的流量管理能力。通过VirtualService和DestinationRule,我们可以实现精细的流量控制。例如,配置金丝雀发布:

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: web-app-vs

spec:

hosts:

- web-app.example.com

http:

- route:

- destination:

host: web-app

subset: v1

weight: 90

- destination:

host: web-app

subset: v2

weight: 10

---

apiVersion: networking.istio.io/v1alpha3

kind: DestinationRule

meta

name: web-app-dr

spec:

host: web-app

subsets:

- name: v1

labels:

version: v1

- name: v2

labels:

version: v2

6.2 实战:配置渐进式发布策略

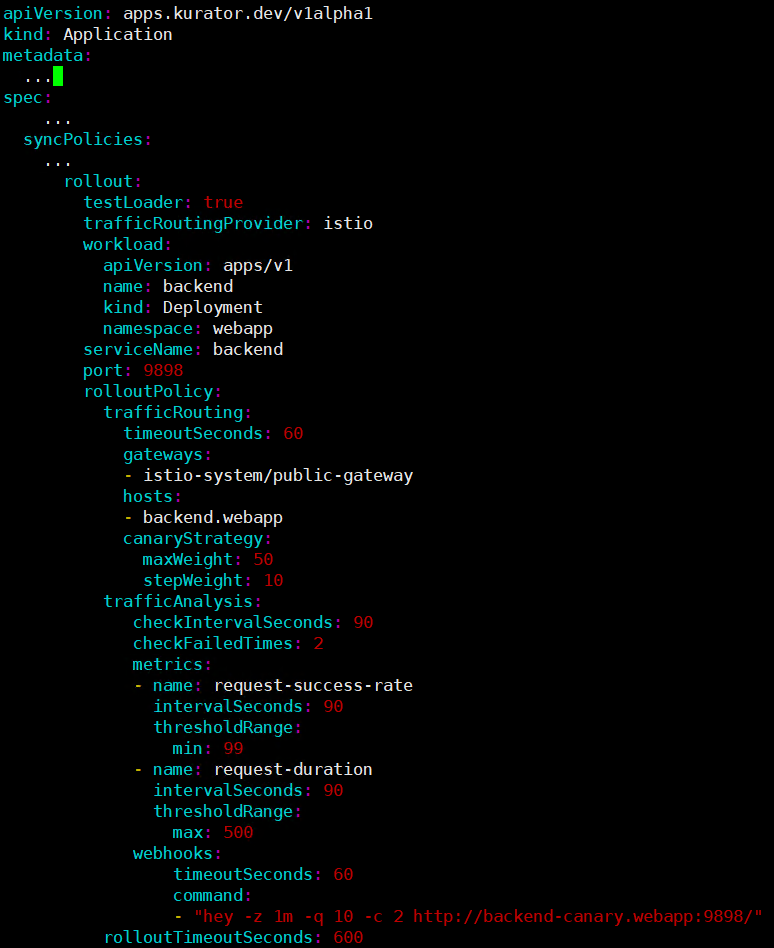

在Kurator中,我们可以通过ApplicationProfile统一管理发布策略。以下是一个渐进式金丝雀发布的配置:

apiVersion: apps.kurator.dev/v1alpha1

kind: ApplicationProfile

meta

name: progressive-canary

spec:

selector:

app: web-app

strategy:

type: ProgressiveCanary

steps:

- weight: 5

duration: 5m

metrics:

- type: RequestSuccessRate

threshold: 99.9

- weight: 20

duration: 10m

metrics:

- type: RequestSuccessRate

threshold: 99.9

- weight: 50

duration: 15m

metrics:

- type: RequestSuccessRate

threshold: 99.9

- weight: 100

该配置定义了四步渐进式发布,每步都有成功率阈值验证。如果任何一步的指标不达标,发布会自动回滚。Kurator通过集成Prometheus监控指标,实现了智能化的发布决策。

渐进式金丝雀发布的配置如图所示:

7. 未来展望:Kurator的技术演进方向

7.1 边缘计算集成路线

随着边缘计算的兴起,Kurator正在深化与KubeEdge的集成。未来版本将支持边缘节点的自动注册、边缘应用的离线运行、以及边缘-云协同调度。具体来说,Kurator计划实现:

- 边缘自治能力:当边缘节点与云端断开连接时,能够基于本地策略继续运行关键应用

- 智能数据同步:根据网络状况和数据重要性,动态调整同步策略

- 边缘安全增强:集成TEE(可信执行环境),确保边缘数据的安全性

7.2 智能调度与自治运维

Kurator的另一个重要方向是AI驱动的智能调度。通过集成Volcano的批处理调度能力,并结合机器学习算法,Kurator将能够:

- 预测性扩缩容:基于历史负载模式,预测未来资源需求,提前进行扩缩容

- 成本优化调度:考虑不同集群的资源成本,自动选择最优部署位置

- 自愈能力增强:自动检测异常模式,触发预防性维护操作

这些能力将使Kurator从一个管理平台演进为一个自治系统,大幅降低运维复杂性,提升系统可靠性。

结语

Kurator作为云原生技术的新一代集大成者,通过深度集成优秀开源项目,构建了一套完整的分布式云原生管理解决方案。从多集群应用分发到智能流量管理,从GitOps持续交付到边缘计算支持,Kurator正在重新定义云原生应用的管理方式。

在技术演进的道路上,Kurator面临着诸多挑战,包括性能优化、安全增强、生态扩展等。但随着云原生技术的成熟和社区的壮大,Kurator有望成为企业云原生转型的核心平台。对于技术从业者而言,深入理解Kurator的设计理念和实践方法,将有助于在云原生时代把握技术先机,推动企业数字化转型。

正如Kubernetes改变了应用部署方式,Kurator正在改变分布式应用的管理方式。在这个过程中,我们不仅是技术的使用者,更是技术演进的参与者和推动者。期待在云原生的未来,看到更多像Kurator这样的创新项目,共同构建更加开放、智能、高效的云原生生态。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)