【前瞻创想】咱们一起来盘盘 Kurator:手把手教你如何用分布式云原生平台搞定多集群和边缘计算管理

【前瞻创想】咱们一起来盘盘 Kurator:手把手教你如何用分布式云原生平台搞定多集群和边缘计算管理

说起现在的云原生开发,大家可能早就过了那个守着单个 Kubernetes 集群过日子的阶段了。现在讲究的是什么?是分布式云原生架构。你想想,业务稍微大一点,为了高可用、为了靠近用户,你得在不同的区域、不同的云厂商那儿开一堆集群,甚至还得把手伸到边缘计算的设备上。这时候问题就来了:这么多集群,怎么管?怎么保证策略一致?应用怎么优雅地跨集群调度?

Kurator 这哥们儿就是为了解决这些头疼事儿诞生的。它不是那种冷冰冰的工具,它更像是一个经验丰富的“大管家”,把业内那些顶尖的开源项目,像 Karmada、Volcano、Istio、Kyverno 啥的,全都整合在一起,给你搭好了一套现成的分布式底座。咱们今天不聊虚的,就直接上手,看看这套东西到底是怎么运转的,顺便把那些听起来玄乎的概念给拆解掉。

第一章:搞明白 Kurator 到底是个啥:分布式云原生的“大管家” 🏗️

为什么要聊分布式云原生架构?

咱们以前搞单集群,觉得只要把 Pod 跑起来就行了。但现在的场景变了,你的应用可能一半在阿里云,一半在腾讯云,还有一小块跑在客户机房的边缘节点上。这种分布式云原生架构,说白了就是要把这些散落在各地的资源,通过一个统一的入口管起来,让用户觉得就像在用一个超级大集群一样。Kurator 就是在干这个活儿,它把底层复杂的差异给抹平了。

Kurator 架构一眼看穿:不仅仅是简单的堆砌

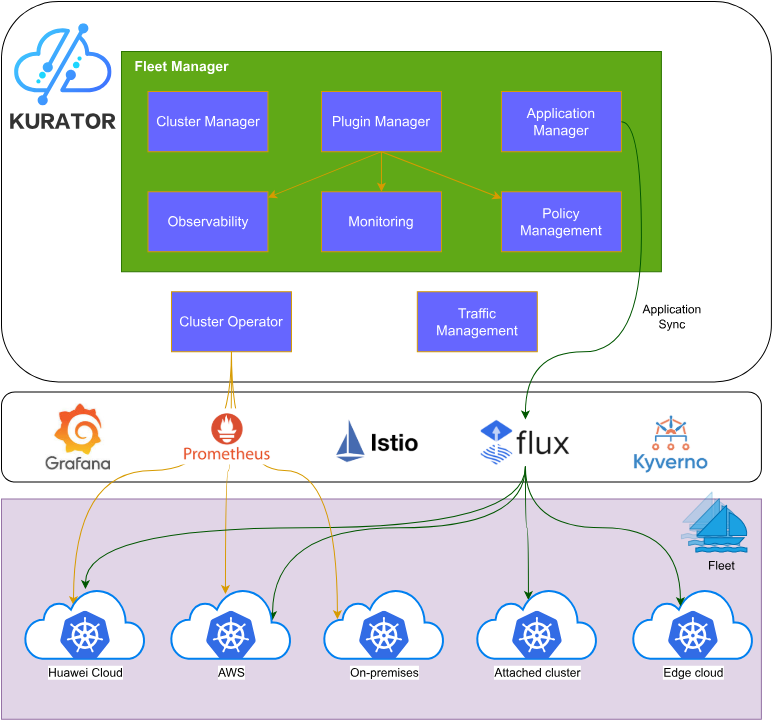

这张Kurator架构图挺清晰的,Kurator 架构分为 Fleet Manager 统一管理集群、插件、应用与策略,Operator 负责流量与同步,底层集成多云与观测组件:

很多人觉得 Kurator 就是把几个开源项目凑在一起,其实没那么简单。看 Kurator 架构,你会发现它有一个核心,就是“统一管理”。它在顶层设计了一套标准,不管是调度、安全还是网络,都通过这个大框架下发。它把多集群管理、边缘计算、服务网格这些碎片化的东西缝合得非常紧凑。这种架构的好处在于,你不需要自己去研究怎么让 Karmada 和 Istio 配合,Kurator 已经帮你调教好了。

逛逛 Kurator 的 GitHub 主页找灵感

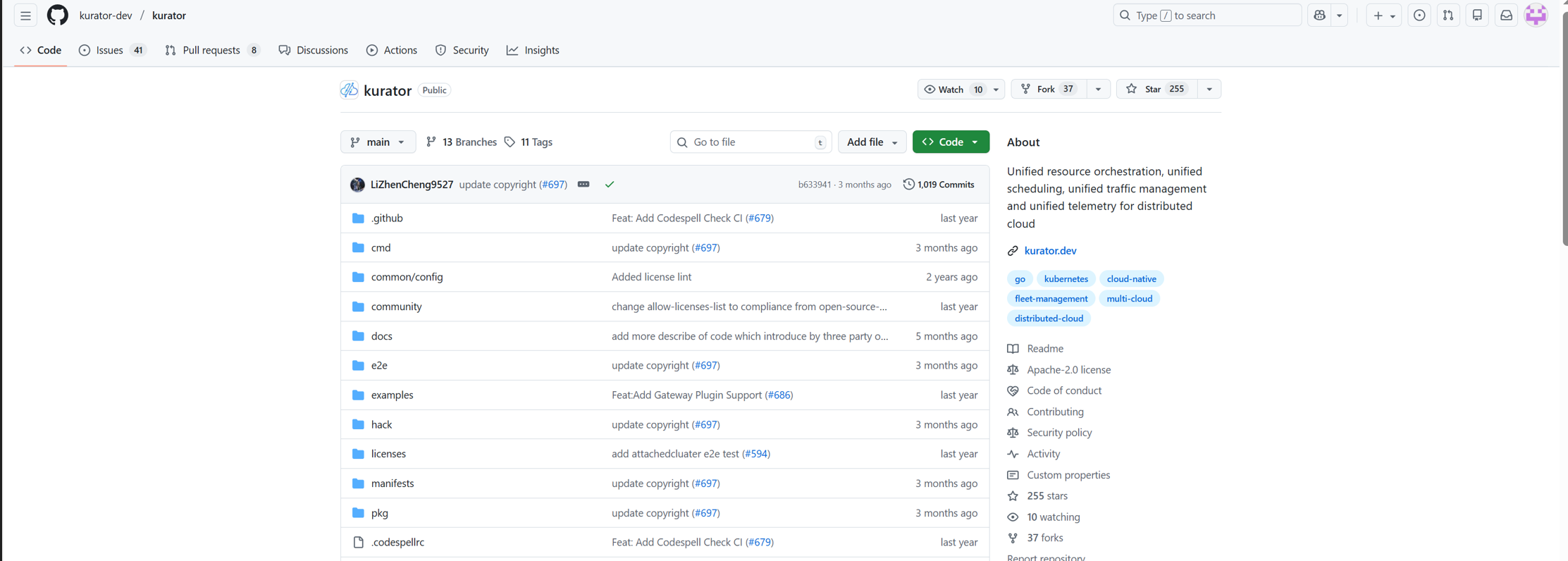

这是Kurator开源项目的GitHub主页概览,展示了其统一分布式云管理的核心定位、活跃的开发动态及社区贡献情况:

如果你想深入研究,我建议你先去 Kurator 开源项目的 GitHub 主页 看看。那上面不仅有最新的代码,还有很多实操的 Demo。你会发现它的社区活跃度挺高,很多分布式云原生遇到的坑,前人都已经在 Issue 里帮你填好了。看开源项目,主页就是最好的说明书,别总等着看文档,直接看代码逻辑和提出来的 PR,进步才最快。

第二章:动手实操第一步:把这套分布式底座环境给搭起来 🛠️

源码拉取:git clone 走起

咱们写技术文,不能光说不练。既然要搞实操,那环境肯定得先搞定。你得先有一台能连外网的 Linux 机器,配置别太寒碜,毕竟要跑不少组件。

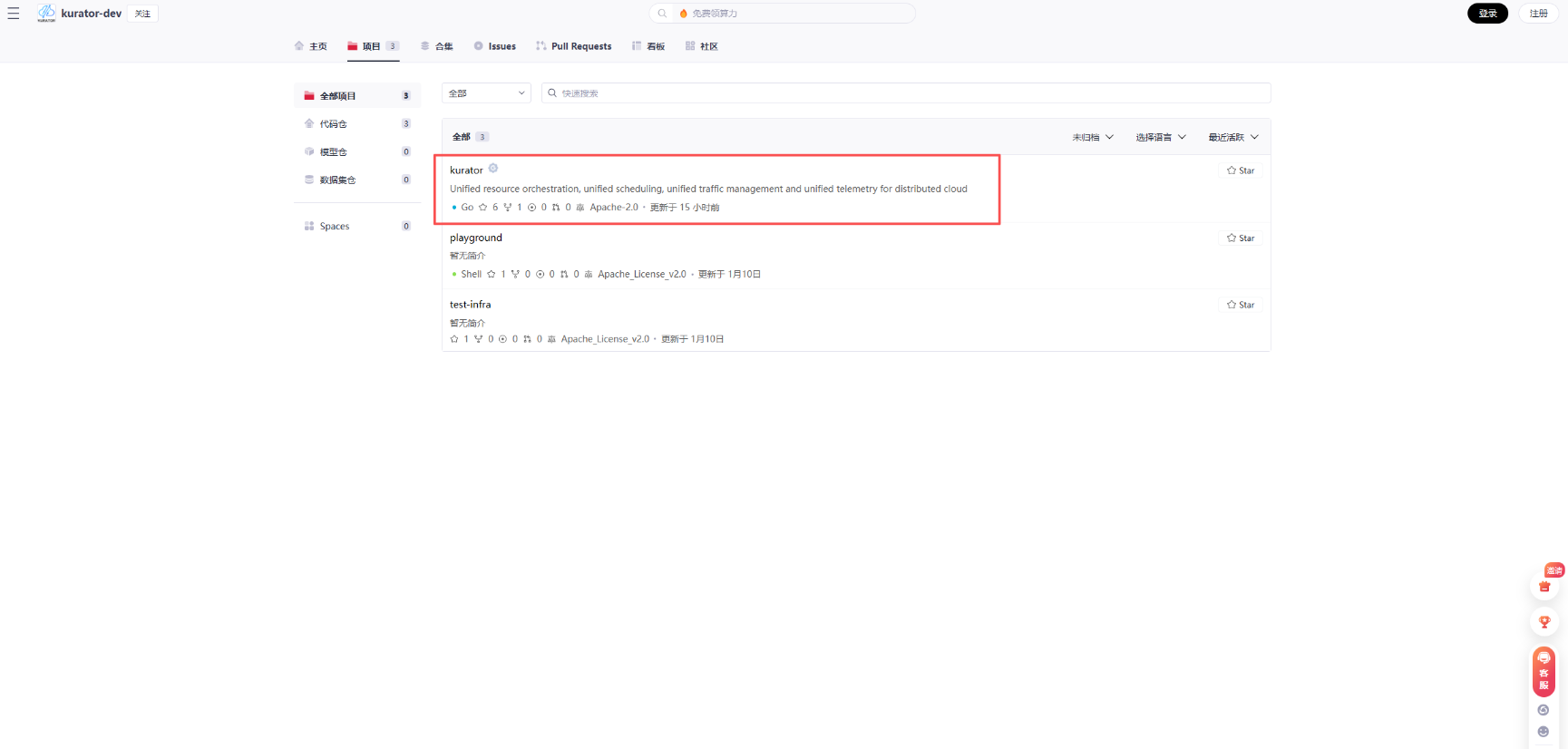

当然,感兴趣的同学,可以将项目下载下来体验一下:

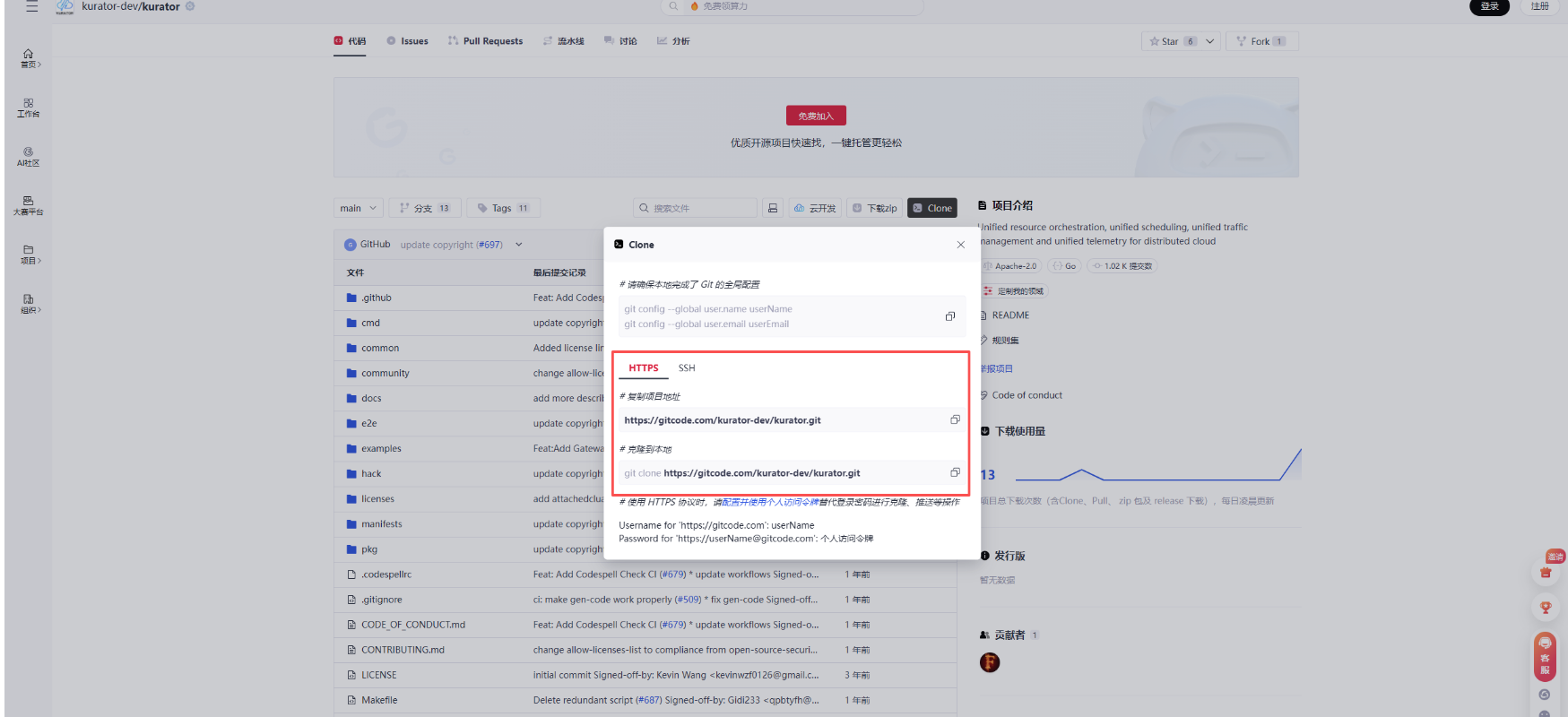

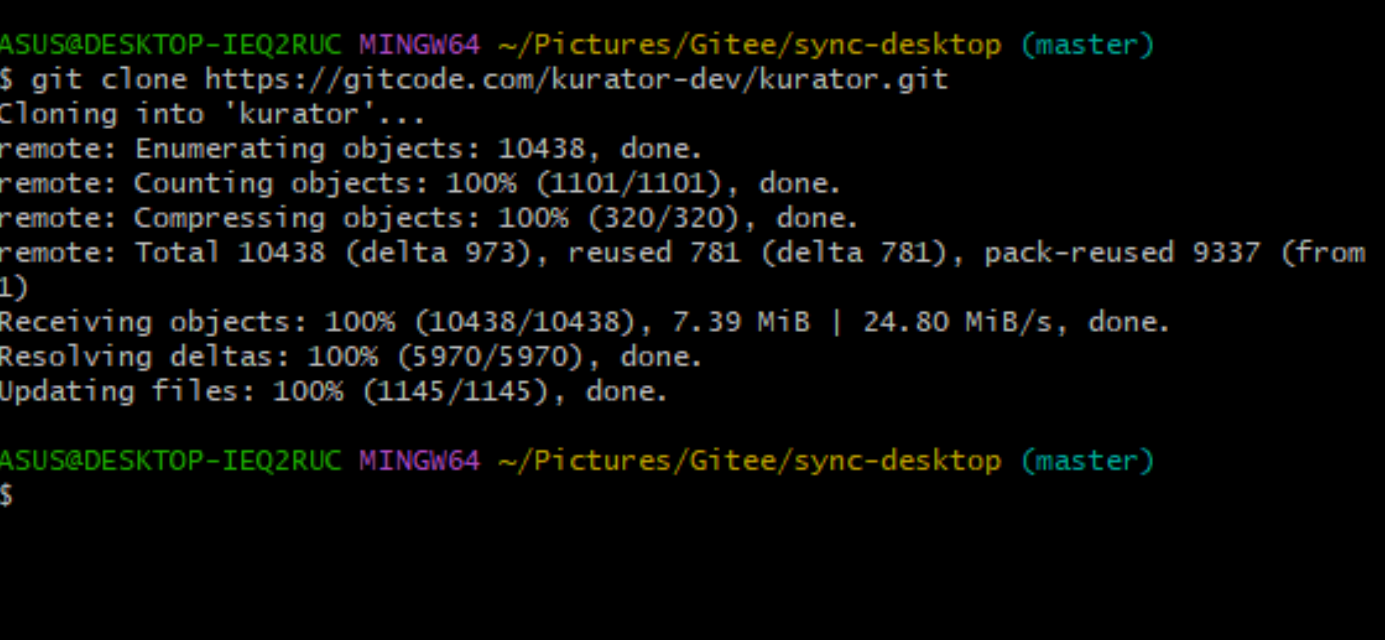

然后我们找到Kurator的https地址,通过git将其拉取到本地:

分别执行下面两条命令:

# 复制项目地址

https://gitcode.com/kurator-dev/kurator.git

# 克隆到本地

git clone https://gitcode.com/kurator-dev/kurator.git

实际克隆项目演示效果可以看到如下图:

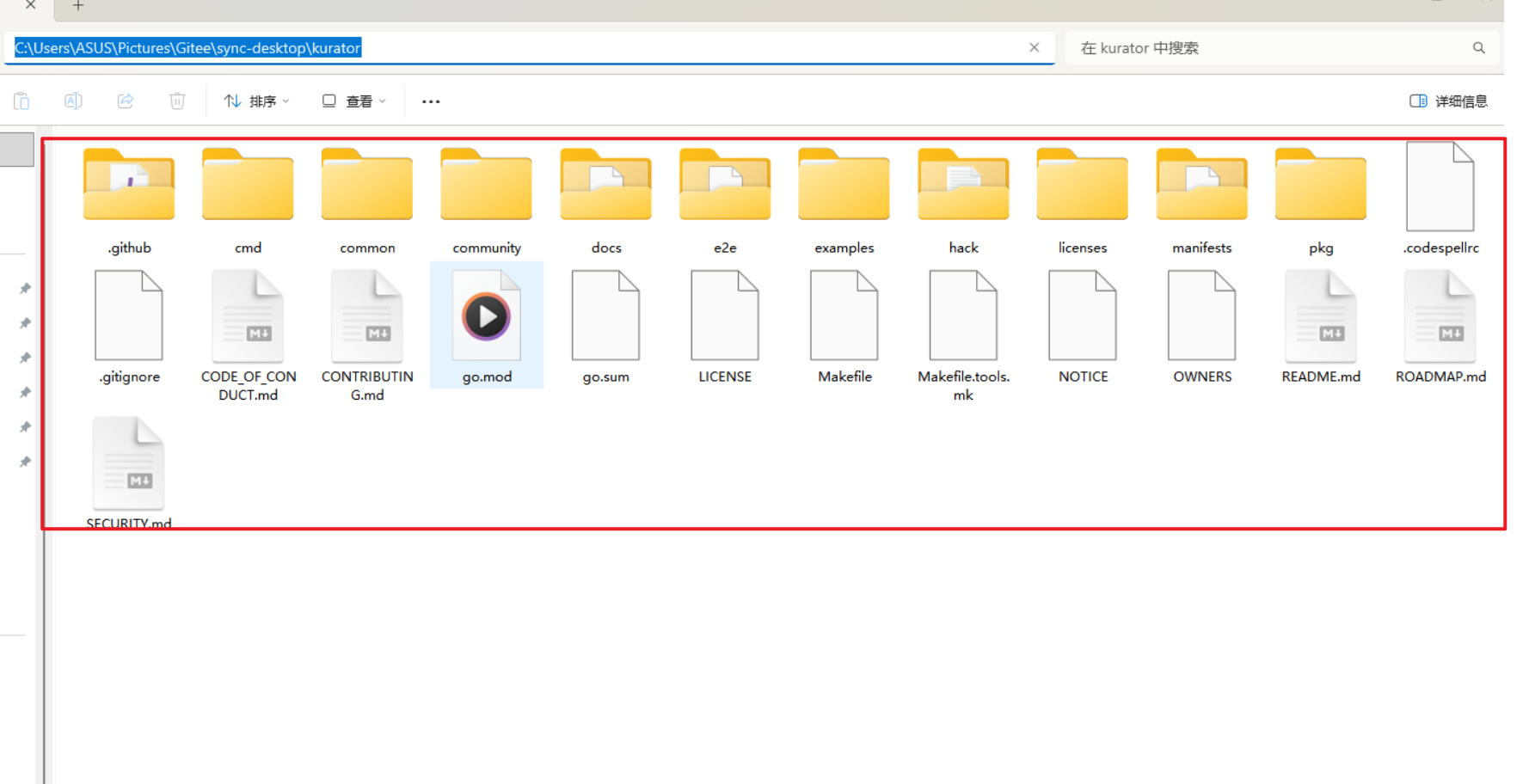

如下展示的便是完整的项目源码啦:

下载完成后,我们便可以进行项目部署及实战演练了。

核心依赖的预检与安装

拉下代码后,别急着运行。Kurator 依赖 Kubernetes 环境,通常我们会准备一个 Master 集群作为“控制面”。你需要确保你的环境中已经装好了 kubectl 和 helm。在搭建环境的过程中,Kurator 的脚本会自动帮你检查这些依赖。你会发现,它安装的时候会顺带把多集群管理的各种组件也给带上。

避坑指南:网络环境很重要

在实操过程中,最容易卡壳的就是网络。因为分布式云原生涉及到跨集群、跨区域的通信,如果你的控制面集群访问不到成员集群,那后面啥都玩不转。在搭环境的时候,一定要确认各集群之间的 API Server 是互通的。Kurator 在初始化的时候,会生成一些认证信息,这些东西要是传丢了,环境就废了,得重来。

第三章:多集群管理的“核武器”:Karmada 与 Volcano 的强强联手 🚀

拆解 Karmada 核心架构:跨集群调度的秘诀

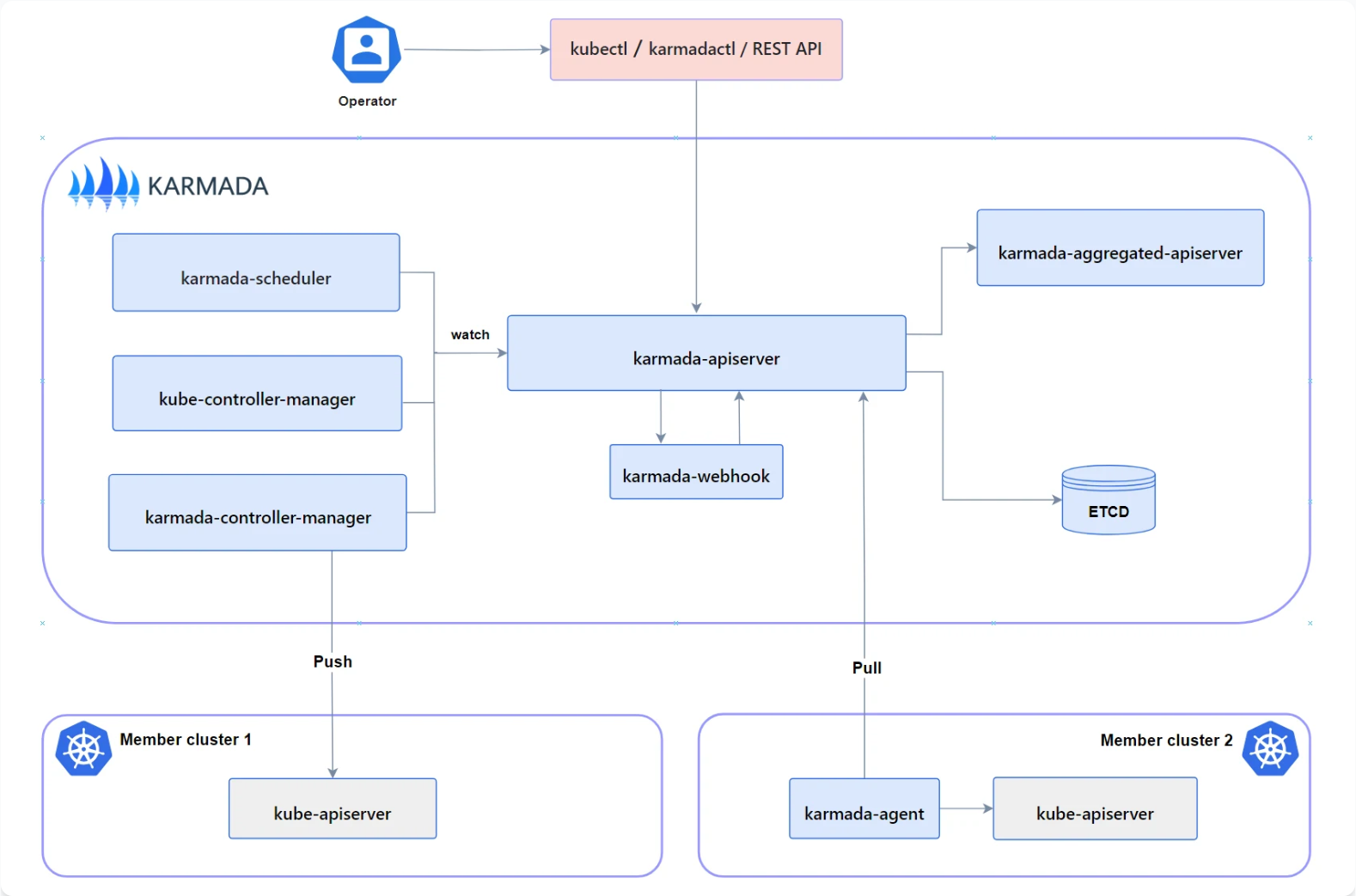

这是Karmada多集群管理平台的核心架构图,展示了控制平面如何通过推送和拉取两种模式与成员集群进行协同管理:

在 Kurator 的体系里,多集群管理的重任是交给 Karmada 的。Karmada 多集群管理平台的核心架构非常精妙,它有一套自己的 API Server 和调度器。简单点说,你在 Karmada 上发一个部署指令,它的调度器会根据各个集群的资源情况(比如谁的 CPU 闲着、谁的内存大),把任务拆分并分发出去。这种“联邦式”的管理模式,让你在操作成百上千个集群时,依然感觉像是在操作一个 localhost。

弹性伸缩:Karmada 是如何让应用在不同集群横跳的?

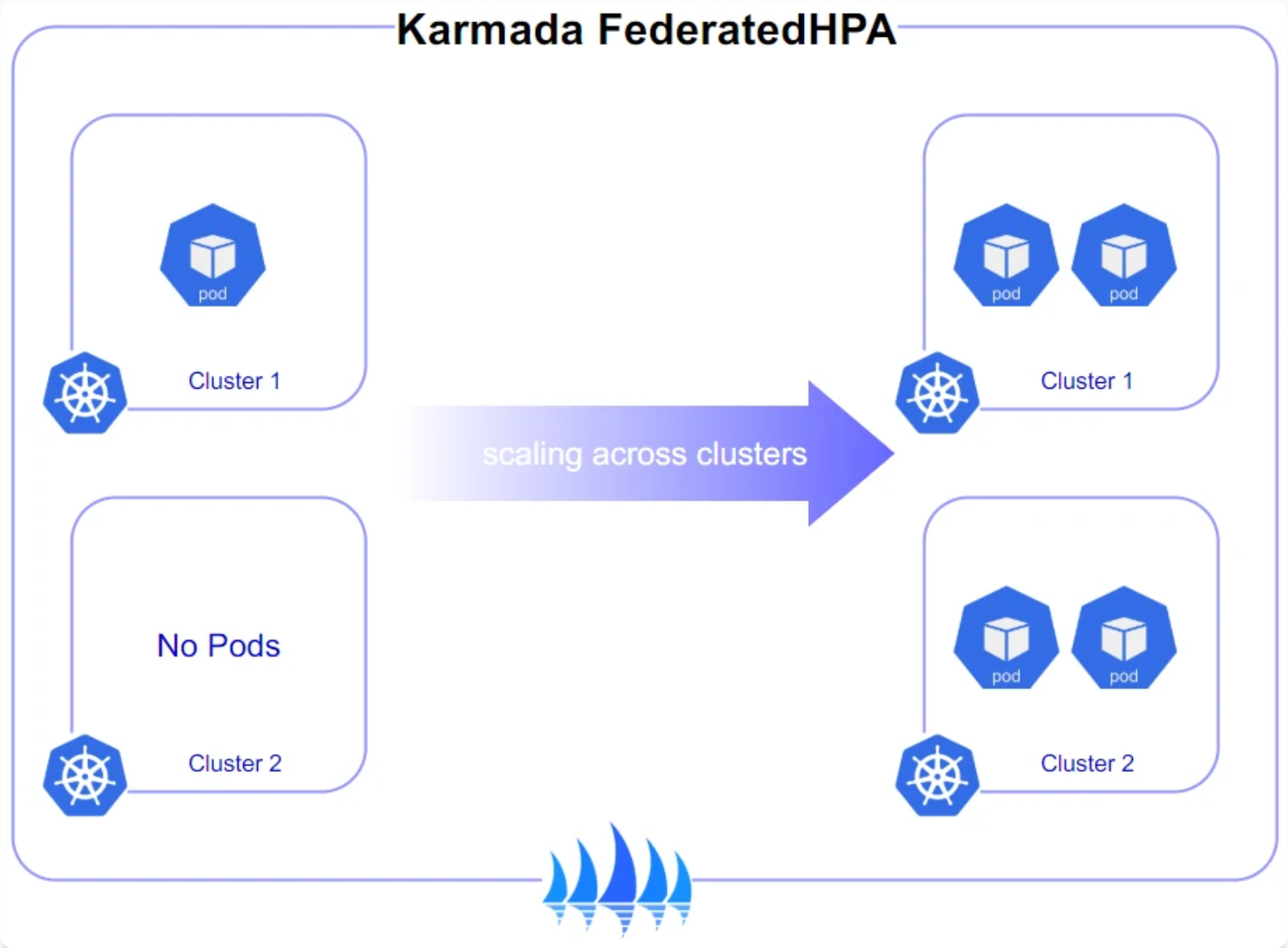

这是Karmada跨集群弹性伸缩策略参考图,展示了其如何通过FederatedHPA策略在多个成员集群间协调Pod副本数实现统一伸缩:

最牛的地方在于 Karmada 跨集群弹性伸缩策略。假设你搞促销活动,A 集群的资源爆了,Karmada 能自动识别出来,并把新增加的副本创建到 B 集群去。这种跨集群的弹性,是实现分布式云原生高可用的关键。你可以定义一个简单的 PropagationPolicy,告诉 Karmada:如果这个集群扛不住了,就往另外几个集群扩容。

Volcano 分组调度:大数据与 AI 业务的福音

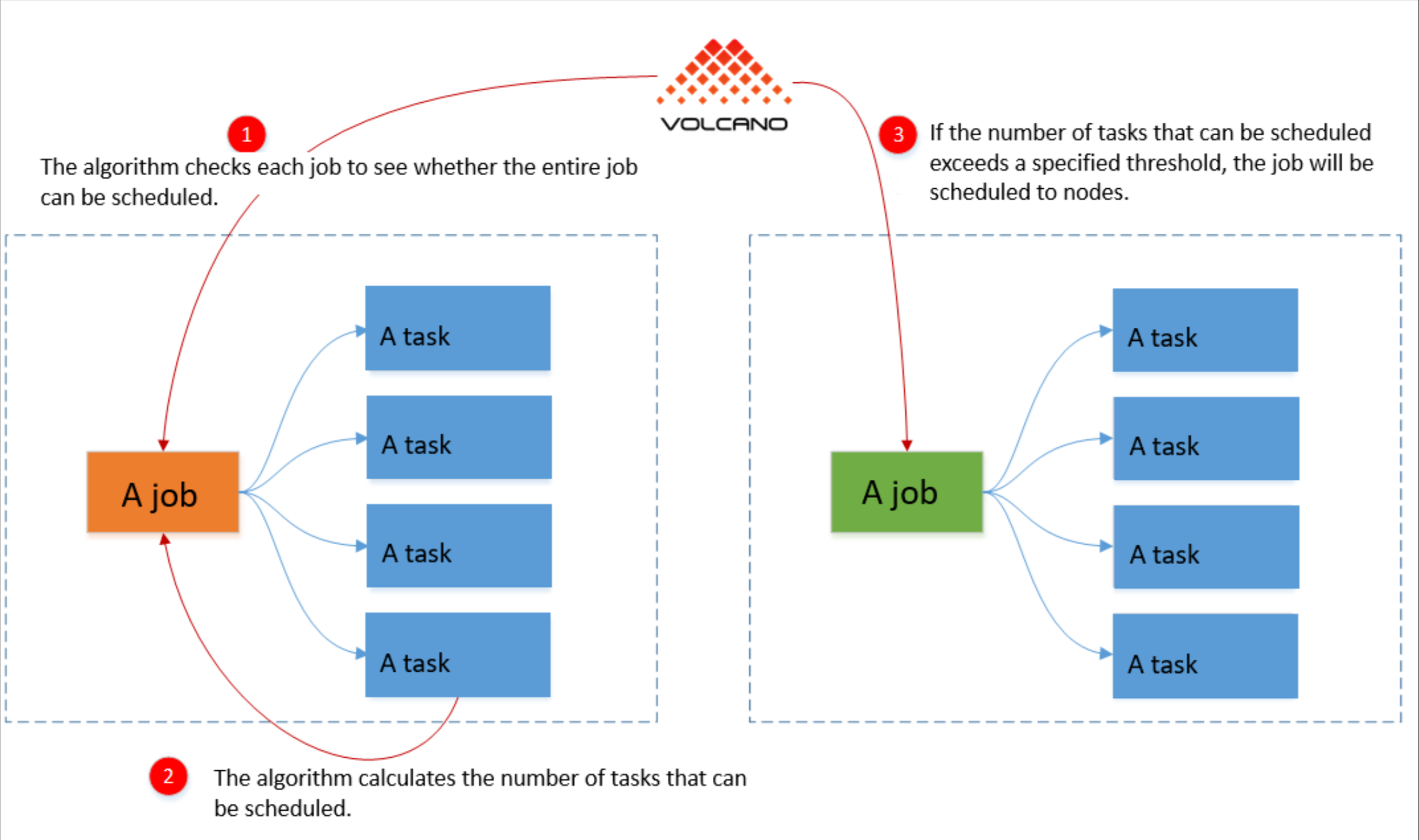

这是Volcano分组调度参考图,展示了其如何通过整体资源检查与阈值判断,实现批处理作业的成组调度与资源保障:

如果你的集群里还要跑一些大数据或者 AI 训练任务,那 Volcano 分组调度 就派上用场了。普通的 K8s 调度是一个 Pod 一个 Pod 来的,但 AI 训练往往需要一组 Pod 同时起来才能开工。Volcano 能实现“要么全都要,要么全不要”的调度逻辑(Gang Scheduling)。在 Kurator 里,Volcano 被集成进来,专门处理这些复杂的批处理任务,让资源利用率直接起飞。

这里给咱们看一段像手搓的配置,这是在 Karmada 里定义怎么分发应用的一个逻辑片段:

# 这是一个典型的分发策略,我把它改写得更直观一点

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

metadata:

name: my-app-distributor

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: web-server

placement:

clusterAffinity:

clusterNames:

- region-beijing-cluster

- region-shanghai-cluster

# 这里定义了副本怎么分,咱们各占一半,主打一个均衡

replicaScheduling:

replicaDivisionStrategy: Weighted

replicaSchedulingType: Divided

weightPreference:

staticWeightList:

- targetCluster:

clusterNames: ["region-beijing-cluster"]

weight: 1

- targetCluster:

clusterNames: ["region-shanghai-cluster"]

weight: 1

第四章:策略与安全:Fleet 队列是怎么让成百上千个集群听话的? 🛡️

身份相同性:Fleet 队列里的逻辑隔离

这是Fleet队列中身份相同性的官方示意图,直观展示了跨集群的命名空间与部署服务间关联映射关系:

当集群多到一定程度,你不可能一个一个去点。Kurator 引入了 Fleet(队列)的概念。这里面有个很重要的逻辑叫 Fleet 队列中身份相同性。意思就是说,如果你在 Fleet 级别的配置里定义了一个服务叫 auth-service,那么这个 Fleet 下属的所有集群里,只要叫这个名字的服务,都被视为同一个实体的不同副本。这极大地简化了身份认证和权限管理的逻辑,你不用在每个集群里重复造轮子。

借力 Kyverno:实现基于 Fleet 的统一策略下发

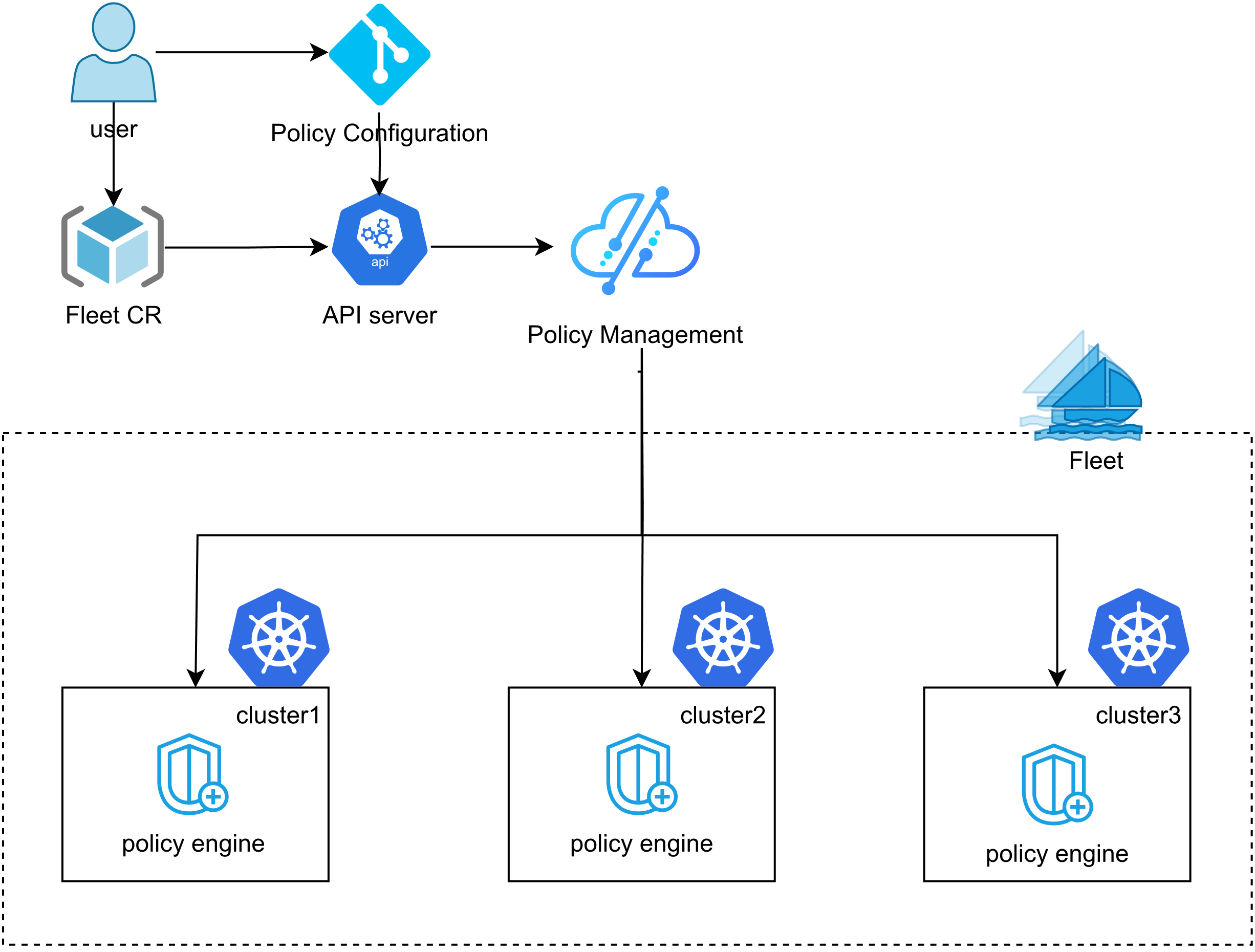

安全和合规怎么搞?Kurator 采用了 Fleet 基于 Kyverno 的多集群策略管理架构。Kyverno 是个好东西,它能用声明式的方法来管策略。比如你可以规定:这个队列里所有的 Pod 都不准用 Root 权限运行。Kurator 把 Kyverno 的策略直接绑定到 Fleet 上,只要你的集群归属这个 Fleet,策略就会自动同步过去。

Kurator 统一策略管理:拒绝配置碎片化

这张图展示了Kurator的统一策略管理架构,用户只需要在一处定义策略,就能通过Fleet和FluxCD自动同步到多个集群,配合Kyverno实现跨集群的一致性治理,真正做到“一次配置,全栈生效”:

以前管多集群最怕“配置漂移”,就是 A 集群改了,B 集群忘了。Kurator 的统一策略管理架构 解决了这个问题。它把所有的配置都集中在控制面,通过状态机去监控分发的过程。你只需要在顶层改一下,底下的所有集群都会跟着变。这种“一处定义,处处生效”的模式,才是分布式云原生的核心体验。

再来一段实操感十足的代码,这是给 Fleet 下发 Kyverno 策略的一个小例子:

# 给所有集群加个禁令:不许随便用 privileged 容器

apiVersion: kyverno.io/v1

kind: ClusterPolicy

metadata:

name: restrict-privileged-containers

annotations:

kurator.io/fleet: production-fleet # 关键点:这里关联到了我们的 Fleet

spec:

validationFailureAction: enforce

background: true

rules:

- name: check-privileged-mode

match:

any:

- resources:

kinds:

- Pod

validate:

message: "小老弟,privileged 容器不安全,别在生产 Fleet 里乱搞!"

pattern:

spec:

containers:

- securityContext:

=(privileged): false

第五章:连通性与边缘计算:把服务网格和 GitOps 铺到天边 🌐

Istio 服务网格:跨集群通信的“高速公路”

集群多了,集群间的通信怎么解决?Kurator 集成了 Istio 服务网格。这可不是简单的单集群 Istio,而是跨集群的网格。它能让你的 A 集群 Service 直接访问 B 集群的 Service,就像在本地一样,而且中间的流量全是加密的(mTLS)。在 Kurator 里,你不用去抠那些复杂的 Istio 配置,它已经帮你把跨集群的网格桥接好了,流量治理、熔断、限流全是全域生效的。

GitOps 边缘计算:让边缘设备像云端一样自动同步

说起边缘计算,大家最头疼的就是网络不稳定。Kurator 搞了一套 GitOps 边缘计算 的方案。简单说,就是边缘节点不直接听从控制面的指挥,而是盯着 Git 仓库看。Git 仓库里有什么配置,边缘节点就自动拉取什么。这种异步的方式完美解决了弱网环境下的管理难题。即便断网了,边缘节点也会按照最后的 Git 指令继续运行。

揭秘状态机:Kurator 资源分发背后的运行逻辑

很多人好奇,Kurator 怎么知道资源发没发成功?这就涉及到了 Kurator 分发流程的状态机。每一个资源(比如 Deployment 或者 Policy)在 Kurator 里都有一个状态,从 Pending 到 Deploying,再到最后各集群反馈回来的 Ready 或者 Failed。这个状态机是全自动运行的,它会不断地对比“预期状态”和“实际状态”,如果不一致,它就会一直尝试同步,直到成功为止。

最后展示一段模拟边缘计算场景下,用 GitOps 逻辑同步资源的任务定义:

# 这是一个模拟 GitOps 触发的任务,看起来很像手写的任务脚本

apiVersion: batch/v1

kind: Job

metadata:

name: edge-sync-task-v1

spec:

template:

spec:

containers:

- name: gitops-runner

image: kurator/gitops-agent:latest

env:

- name: GIT_REPO

value: "https://gitcode.com/my-org/edge-configs.git"

- name: TARGET_NAMESPACE

value: "edge-production"

# 脚本化的启动逻辑,模拟手动触发拉取同步

command: ["/bin/sh", "-c"]

args:

- |

echo "开始从 Git 仓库拉取最新的边缘配置..."

git clone $GIT_REPO /tmp/configs

cd /tmp/configs

echo "检测到配置变更,正在向本地边缘集群同步资源..."

kubectl apply -f . --recursive

echo "同步完成,正在上报状态给 Kurator 状态机..."

curl -X POST http://kurator-dashboard/api/status -d '{"status": "Synced"}'

restartPolicy: OnFailure

总结一下:分布式云原生没那么难

咱们今天这一通盘点,从环境搭建到 Karmada 调度,再到 Fleet 策略和边缘 GitOps,基本上把 Kurator 的看家本领都给过了一遍。你看,虽然分布式云原生架构 听起来很高大上,但只要你选对了工具,像 Kurator 这样把各种开源利器整合好,剩下的活儿其实就是写写配置、理理逻辑。

写文章和搞技术一样,最重要是贴近实操。你得真的去拉一下源码,真的去跑一下那些 YAML,才能体会到状态机在背后忙活的感觉。以后要是有人问你多集群怎么管,你就把 Kurator 甩给他就行了。

希望这篇实操文能帮你避开一些坑,要是觉得有用,赶紧去 GitHub 给人家点个 Star,支持一下开源项目。咱们下次有机会再聊聊具体的流量治理细节,回见!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)