全景深度拆解:Kurator云原生舰队管理实操,从集群生命周期到高级分发策略一站式掌握

全景深度拆解:Kurator云原生舰队管理实操,从集群生命周期到高级分发策略一站式掌握

现在的云原生圈子,大家聊的早就不只是怎么在单机房里折腾那几个 Kubernetes 集群了。随着业务越铺越开,有的应用在公有云,有的在私有云,甚至还有的在边缘端,这种“分布式云原生架构”成了大趋势。但说实话,管一个集群容易,管几十个、上百个集群,那简直是运维人员的噩梦。这时候,Kurator 就站出来了,它就像是一个超级指挥官,专门解决分布式环境下的各种疑难杂症。简单来说,Kurator 的核心目标就是打造一个“云原生舰队管理”平台,让咱们能像管理单集群一样,轻松拿捏成百上千个集群。

揭开Kurator的面纱:分布式云原生架构到底在玩什么? 🚀

咱们为什么需要分布式云原生架构?

以前咱们搞应用,可能守着一个大集群就够了。但现在为了高可用、为了靠近用户降低延迟,或者为了满足不同地区的数据合规性,咱们不得不把集群散布在不同的地方。这就是所谓的分布式云原生。但随之而来的问题也多:集群版本不统一、配置乱糟糟、流量调度难。Kurator 的出现,本质上是给这些分散的集群套上了一层标准化的外壳。它利用了 Kubernetes 集群的标准架构,但在其之上做了一层更高维度的封装,让分布式环境下的资源看起来像是一个逻辑上的整体。

Kurator 平台的总体架构深度解析

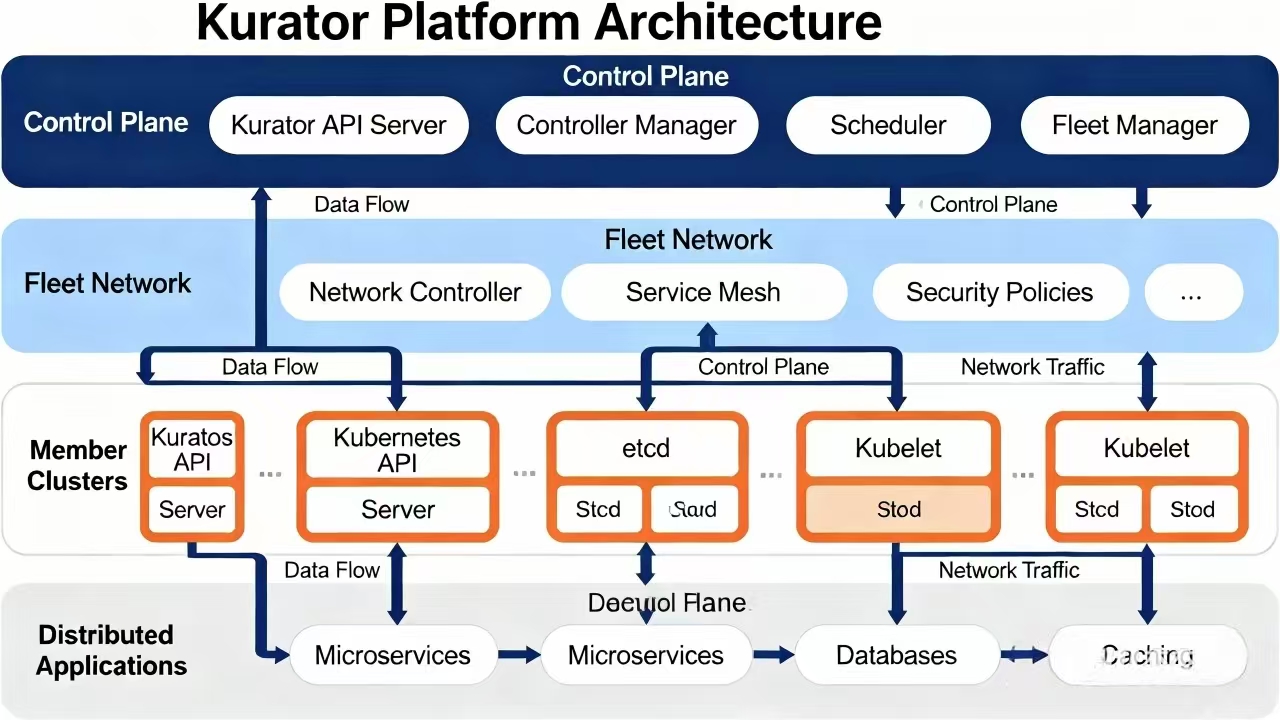

这是Kurator平台的总体架构图,展示了控制平面、集群网络、成员集群及应用层在统一管理框架下的数据流与组件关系:

聊到 Kurator 架构,你得把它想象成一个分层的蛋糕。最下面是各种异构的云基础设施,中间是 Kurator 的核心引擎。它的总体架构设计非常巧妙,并不是推翻 K8s 重新造轮子,而是通过扩展 K8s 的能力来实现。它整合了集群生命周期管理、应用分发、统一策略和监控运维。最核心的一点是,它把“舰队”的概念引入了进来,通过一个管理集群(Master Cluster)去遥控下面成群结队的从属集群(Worker Clusters),这种设计让多集群管理变得井井有条。

动手实操第一步:Kurator 环境搭建与基础配置 🛠️

源码搞定安装包:git clone 是第一步

咱们搞技术的,最喜欢的还是直接上手。要玩 Kurator,第一步得把它的“代码库”给拉下来。如果有感兴趣的朋友,可直接下载该源码体验试试:

下载到本地之后

我们只需要进行项目解压即可:

可以看到清晰的目录结构,剩下的就看大家想怎么玩了。

而且附带很多文档说明,简直是饭喂到嘴里来。

拉下来之后,你会发现里面有一堆 YAML 模板和脚本。这时候别急着一键运行,咱们得先理清楚环境要求。通常你需要一个现有的 K8s 集群作为“管理节点”,建议版本在 1.24 以上,这样兼容性最好。

认识 Kurator 的标准集群架构

在搭建环境的过程中,你会发现 Kurator 非常强调“标准化”。它推崇的 Kubernetes 集群的标准架构,通常包含了一套完整的控制平面和可动态伸缩的工作节点。在 Kurator 的逻辑里,每一个被它纳管的集群,都会被抽象成一个 Cluster 对象。搭建环境其实就是在管理集群里配置好这些 CRD(自定义资源),让管理集群知道怎么去连接、去控制那些远端的机器。

像管车队一样管集群:云原生舰队管理与生命周期 🚢

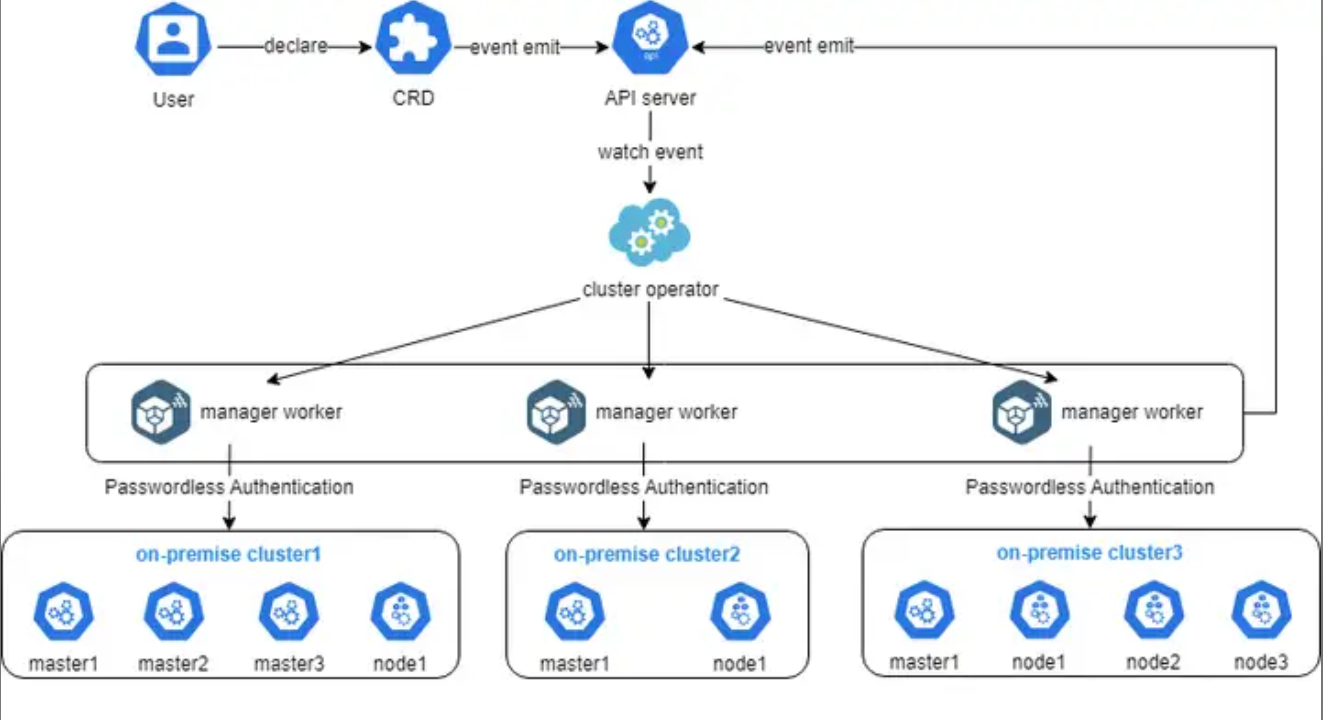

Cluster Operator 是怎么干活的?

这张图展示了Cluster Operator的实现细节,其实就是用户通过声明一个CRD,触发API Server事件,然后由Operator监听并调度多个管理worker去自动对接和管理不同的本地集群,整个过程用无密码认证打通,既安全又高效:

在 Kurator 里,有一个非常关键的组件叫 Cluster Operator。你可以把它理解为一个 24 小时待命的“运维管家”。Cluster Operator 的实现基于典型的 K8s 控制循环逻辑:它不断地去对齐“期望状态”和“实际状态”。比如你在 YAML 里定义了要创建一个包含 3 个节点的华为云集群,Cluster Operator 就会去调用底层的 API,买机器、装系统、挂载磁盘,直到这个集群真正跑起来。

自动化搞定集群的“生老病死”

这就是咱们常说的 Kurator 集群生命周期管理。以前咱们扩容一个集群,可能得写一大堆脚本。现在呢?只需要改一下 CRD 里的 replicas 数值,剩下的活儿全交给 Kurator。无论是创建、升级(比如从 K8s 1.25 升到 1.26)、扩缩容还是最后的销毁,全是自动化的。这种“一键式”的操作,极大减少了人工干预带来的低级错误。

这里我写一段大家常用的集群定义代码,你看,这结构是不是非常清晰:

# 这是一个简化的集群描述文件,手动配好基础信息就行

apiVersion: infrastructure.kurator.dev/v1alpha1

kind: CustomCluster

metadata:

name: my-first-fleet-cluster

namespace: kurator-system

spec:

# 这里定义了基础设施的提供者,比如你用的是自建机房

machineRef:

apiVersion: infrastructure.kurator.dev/v1alpha1

kind: UbuntuMachineTemplate

name: worker-nodes-template

# 定义 K8s 的版本,升级集群也就是改这里的一个数字

version: v1.26.3

# 这里的配置项决定了你的集群规模

controlPlane:

count: 3

endpoint: 192.168.1.100:6443

让应用分发更智能:状态机模型与调度黑科技 🧠

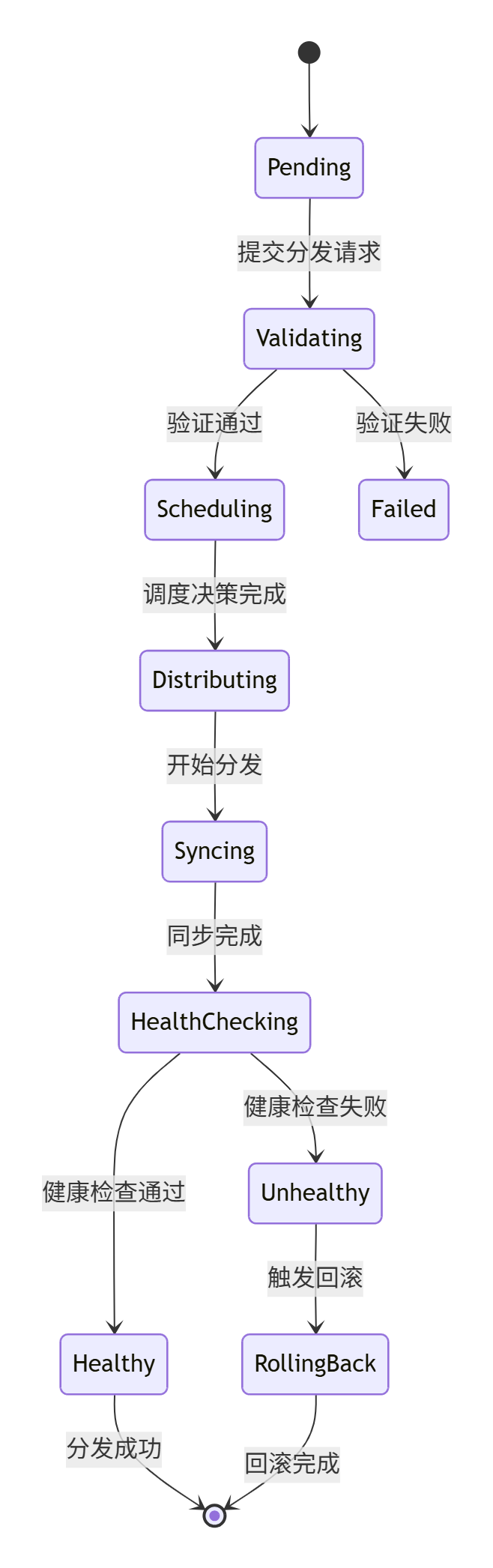

拆解 Kurator 分发流程的状态机

这是Kurator分发流程的状态机参考图,展示了从请求提交、调度、同步到健康检查与回滚的完整自动化发布生命周期:

应用写好了,怎么发到这成百上千个集群里?Kurator 有一套自己的逻辑。Kurator 分发流程的状态机是这套逻辑的核心。当一个分发任务(AppDistribution)被创建时,它会经历 Pending(等待)、Progressing(处理中)、Completed(完成)或者 Failed(失败)这些状态。状态机的精妙之处在于它支持“灰度发布”。比如你可以设置:先在 A 集群跑,如果状态变成 Completed 且健康检查没问题,再往 B、C 集群推。这种有节奏的分发,比那种“全量一把梭”安全多了。

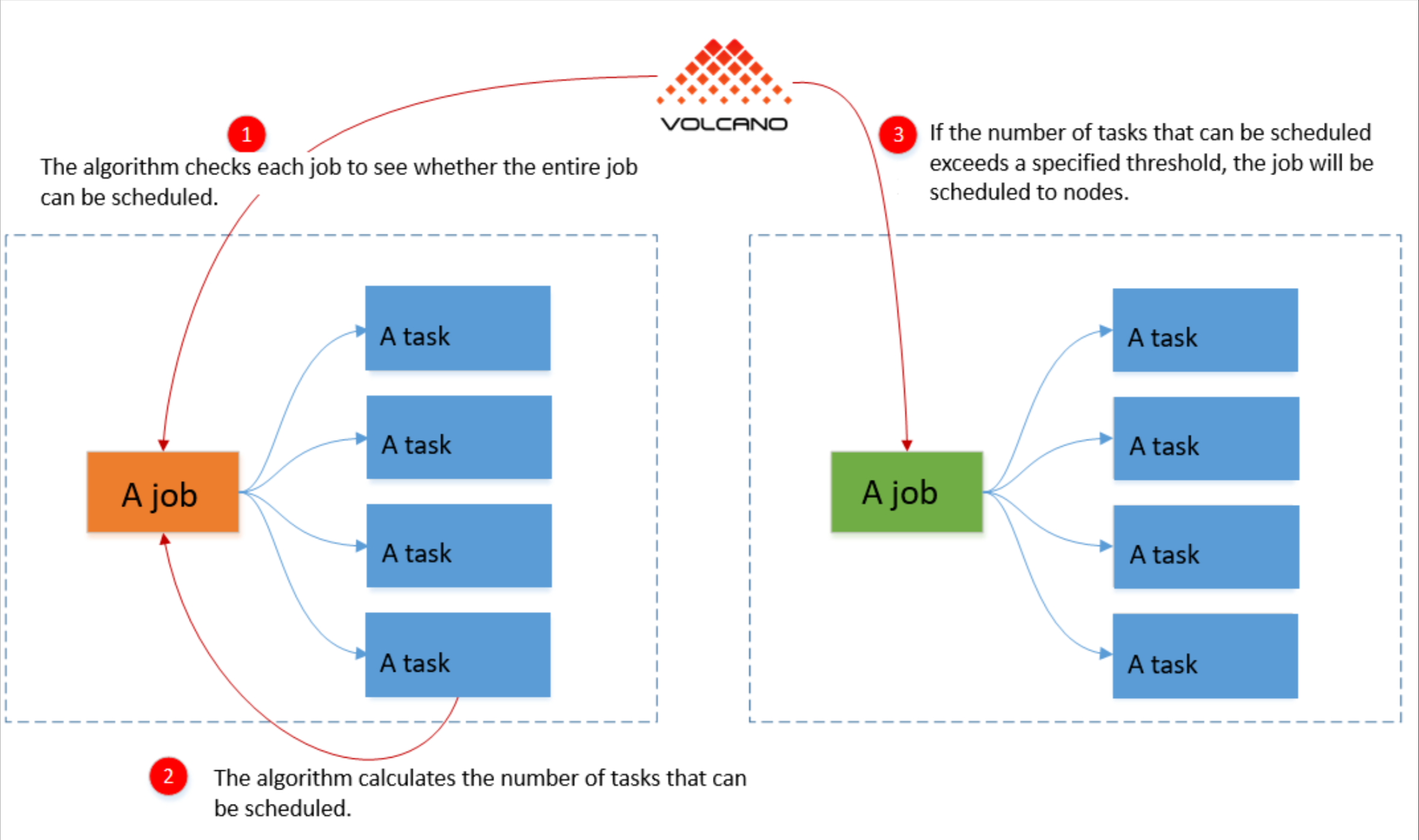

Volcano 分组调度:给计算资源加点“Buff”

这是Volcano分组调度参考图,展示了其如何通过整体资源检查与阈值判断,实现批处理作业的成组调度与资源保障:

在多集群环境下,任务的调度是个大难题。Kurator 集成了 Volcano 分组调度。Volcano 本来是搞 AI 训练、大数据计算的神器,因为它擅长处理“Gang Scheduling”(一组任务要么全跑,要么全不跑)。Kurator 把这种能力引入到了通用的应用分发里。比如你有一个分布式的微服务,需要同时在三个机房启动才能正常提供服务,Volcano 就能确保这些跨集群的资源申请是协同的,避免了资源碎片化导致的“死锁”现象。

下面这段代码展示了如何利用 Kurator 定义一个具有分发策略的应用,注意里面的状态追踪部分:

# 定义一个应用分发任务,让它自动在多个集群间流转

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: awesome-web-app

spec:

source:

# 告诉 Kurator 应用代码在哪

repository: https://github.com/my-org/web-app.git

revision: main

destination:

# 这里是关键:通过标签选择器找到你的“舰队”

fleet: production-fleet

# 分发策略,控制状态机的流转速度

syncPolicy:

automated:

prune: true

selfHeal: true

retry:

limit: 5

backoff:

duration: 5s

玩转流量艺术:统一策略下的流量路由与 AB 测试 🚦

统一策略管理架构是怎么“统一江湖”的?

集群多了,安全策略怎么管?网络隔离怎么做?你不可能跑到每个集群里去配 NetworkPolicy 或者 RBAC。Kurator 的统一策略管理架构就是为了解决这个问题。它在管理集群里定义一套总的策略,然后像“分发传单”一样,把这些策略同步到所有子集群。无论你的集群是在北京还是在纽约,只要归这个舰队管,策略就是一致的。这种“中控式”的配置管理,是企业级运维的刚需。

手把手教你配置 AB 测试流量路由

最后咱们聊聊最实操的部分:Kurator 的流量路由。当你把新版本应用发到集群里后,肯定不敢让用户全切过去。这时候 Kurator 配合 Service Mesh(如 Istio)的能力就显现出来了。通过在 Kurator 中配置 AB 测试,你可以根据请求头里的 user-id 或者 region 来分配流量。比如:测试用户去 v2 版本,普通用户留着 v1。

这是一个配置流量分发的实操例子,咱们手动模拟一下 A/B 测试的权重分配:

# 这个资源对象能控制不同版本之间的流量比例

apiVersion: gateway.kurator.dev/v1alpha1

kind: TrafficRoute

metadata:

name: web-app-ab-test

spec:

# 监听的域名

host: myapp.example.com

# 具体的路由规则

rules:

- matches:

- headers:

# 比如:带了 "version: beta" 头的请求全部去新版本

version: { exact: "beta" }

backend:

service: web-app-v2

port: 80

- backend:

# 默认流量全都去旧版本,稳如老狗

service: web-app-v1

port: 80

# 也可以按百分比配,比如 90% 的流量在这

weight: 90

搞完这一整套流程,你会发现 Kurator 并不是一个复杂的黑盒,它其实是把咱们平时繁琐的运维动作给标准化、自动化了。从最开始的 git clone 源码,到通过 Cluster Operator 管理集群的生命周期,再到利用状态机和 Volcano 搞定复杂分发,最后通过统一策略实现精细化的流量路由和 AB 测试。这一路走下来,分布式云原生的门槛真的降低了不少。

说白了,Kurator 就是给那些想要把业务跑在多云、跨云环境上的企业,提供了一把“万能钥匙”。如果你现在正被多集群管理搞得头大,或者正愁着怎么在分布式架构下做流量精细化控制,别犹豫,赶紧把 Kurator 跑起来试试。这种实操带来的成就感,可比光看文档强多了。下次咱们再聊聊怎么在 Kurator 里集成更高级的监控,今天就先到这,大家赶紧回去手操一遍吧!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)