【前瞻创想】分布式云原生平台Kurator实战:多云管理、边缘计算与GitOps的深度集成与应用实践指南

【前瞻创想】分布式云原生平台Kurator实战:多云管理、边缘计算与GitOps的深度集成与应用实践指南

【前瞻创想】分布式云原生平台Kurator实战:多云管理、边缘计算与GitOps的深度集成与应用实践指南

摘要

本文深入探讨开源分布式云原生平台Kurator的核心架构、关键技术集成与实战应用场景。作为站在众多优秀云原生项目肩膀上的创新平台,Kurator整合了Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada、Kyverno等开源技术,提供了多云多集群统一管理、边缘计算协同、GitOps自动化部署等核心能力。文章从Kurator的技术架构出发,详细阐述环境搭建过程,深入分析Fleet集群管理、Karmada跨集群调度、KubeEdge边缘计算、Volcano批处理优化等关键组件的实现原理,并通过实际代码示例展示GitOps工作流构建、多集群资源分发等高级功能。最后,结合云原生技术发展趋势,对Kurator的未来发展方向提出前瞻性思考,为构建企业级分布式云原生基础设施提供实践参考。

一、Kurator概览与云原生生态定位

1.1 Kurator平台核心价值

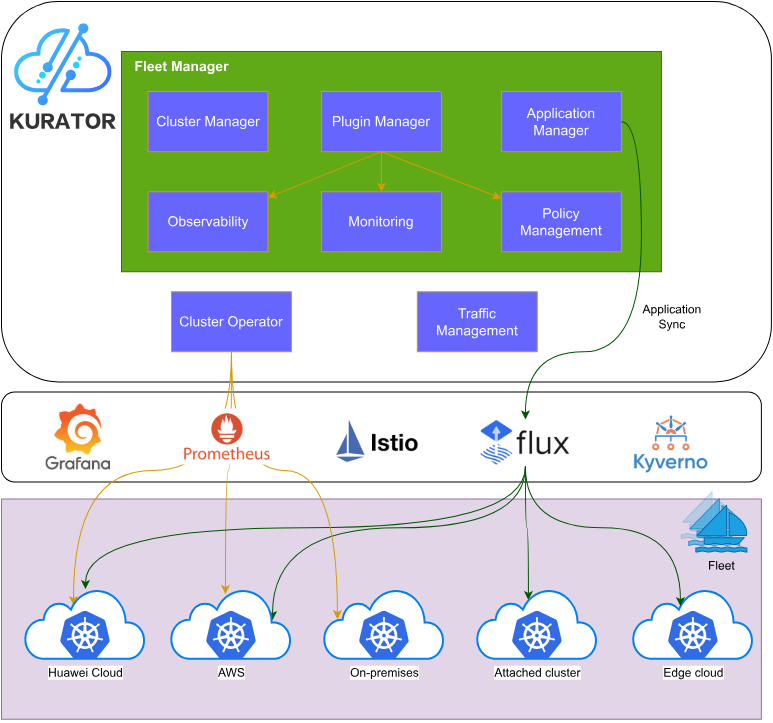

Kurator的核心价值参考图:

Kurator作为一个开源的分布式云原生平台,其核心价值在于帮助企业构建统一的分布式云原生基础设施,加速企业数字化转型进程。在当今多云、混合云、边缘计算并存的复杂IT环境中,企业面临着资源分散、管理割裂、应用部署复杂等挑战。Kurator通过提供统一的控制平面,实现了对分布在不同地理位置、不同云服务商、不同基础设施环境中的计算资源的集中管理与调度。

Kurator的核心价值体现在几个关键维度:首先是"统一性",通过统一的API和控制平面,消除了多云环境下的管理壁垒;其次是"自动化",基于GitOps理念实现了基础设施和应用的声明式管理;再者是"扩展性",通过集成众多成熟的云原生项目,构建了完整的解决方案生态系统;最后是"智能化",通过内置的调度策略、流量管理、监控告警等功能,实现了资源的优化利用和应用的高效运行。

1.2 技术架构与核心组件

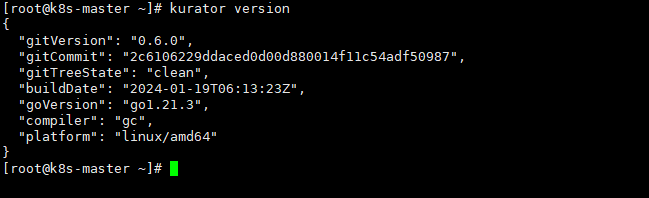

kurator架构参考图:

Kurator的技术架构是分层设计的,底层是各种基础设施资源,包括公有云、私有云、边缘节点等;中间层是Kubernetes集群层,负责基础容器编排;上层则是Kurator提供的统一控制平面,包括Fleet管理、策略引擎、调度系统等核心组件。

核心组件包括:Fleet Manager负责多集群的注册、分组和统一管理;GitOps Controller基于FluxCD实现声明式配置同步;Scheduling Engine整合了Karmada和Volcano实现跨集群和批处理调度;Edge Manager基于KubeEdge实现边缘节点管理;Policy Engine基于Kyverno实现策略统一管理;Observability Suite整合Prometheus等工具实现统一监控。

这些组件不是简单的拼凑,而是通过精心设计的API和扩展机制,实现了深度集成和协同工作,形成了1+1>2的效果。例如,Fleet Manager和GitOps Controller的结合,使得应用可以在多个集群之间自动同步和部署;Karmada和Volcano的协同,则实现了在多集群环境下对批处理作业的高效调度。

1.3 云原生生态中的独特定位

在云原生生态中,Kurator的独特定位是"集成者"和"扩展者"。作为集成者,Kurator不是重复造轮子,而是站在众多优秀开源项目的肩膀上,通过深度集成和优化,提供端到端的解决方案。作为扩展者,Kurator针对多云、边缘等复杂场景,对现有技术进行了扩展和增强,解决了单一项目无法解决的问题。

与单一的Kubernetes发行版不同,Kurator关注的是Kubernetes之上的场景,特别是跨集群、跨地域、跨基础设施的复杂场景。与单纯的多集群管理工具不同,Kurator不仅关注集群管理,更关注应用在多集群环境下的部署、调度、监控等全生命周期管理。与边缘计算框架不同,Kurator不仅关注边缘节点,更关注边缘与云端的协同,以及边缘节点之间的协同。

这种独特定位使得Kurator成为企业构建分布式云原生基础设施的理想选择,特别是在数字化转型深入阶段,当企业需要同时管理云上云下、中心边缘、多云多活等复杂场景时,Kurator的价值尤为凸显。

二、Kurator集成的关键开源技术解析

2.1 Karmada:多集群管理的核心引擎

Karmada作为Kurator中负责多集群管理的核心组件,提供了一套完整的跨集群资源调度和管理能力。Karmada的核心设计理念是"联邦即服务",将多个Kubernetes集群组织成一个逻辑联邦,通过统一的API提供服务,同时保持各成员集群的自治性。

Karmada的关键特性包括:PropagationPolicy实现资源的跨集群分发策略;ClusterAPI提供统一的集群管理接口;Scheduler实现基于策略的资源调度;Failover机制确保服务的高可用。在Kurator中,Karmada被深度集成到Fleet管理框架中,成为实现多集群统一管理的技术基础。

Karmada的工作流程是:首先将目标集群注册到Karmada控制平面;然后定义PropagationPolicy指定资源分发策略;接着Scheduler根据策略将资源分发到目标集群;最后通过反馈机制监控资源状态。这种设计模式使得Karmada能够灵活应对各种多集群场景,从简单的多环境部署到复杂的多活架构。

2.2 KubeEdge:边缘计算的桥接者

KubeEdge是Kurator中负责边缘计算的核心组件,它将Kubernetes的原生能力扩展到边缘节点,实现了云边协同。KubeEdge的核心架构包含三个主要组件:CloudCore运行在云端,负责与Kubernetes API Server通信;EdgeCore运行在边缘节点,负责本地容器管理和设备接入;EdgeMesh提供边缘节点之间的服务发现和通信。

在Kurator中,KubeEdge被集成到统一的边缘管理框架中,与中心集群的管理无缝衔接。KubeEdge的关键价值在于:实现了边缘节点的轻量化运行,适合资源受限的边缘环境;提供了离线自治能力,确保在网络不稳定时边缘应用仍能正常运行;支持多种边缘设备协议,便于物联网设备接入;实现了云边双向同步,确保配置和状态的一致性。

KubeEdge在Kurator中的典型应用场景包括:工业物联网中传感器数据的边缘处理;零售场景中门店应用的边缘部署;车联网中车辆数据的边缘计算等。这些场景的共同特点是:对延迟敏感、带宽有限、需要离线运行,而KubeEdge正是为解决这些问题而设计的。

2.3 Volcano:批处理工作负载的优化器

Volcano是Kurator中负责批处理工作负载调度的核心组件,它针对AI/ML、大数据分析、科学计算等批处理场景,对Kubernetes的调度能力进行了深度优化。Volcano的核心创新在于引入了队列(Queue)、作业(Job)和任务组(PodGroup)的概念,实现了更精细的资源管理和调度策略。

在Kurator中,Volcano与Karmada的集成,实现了跨集群的批处理作业调度。Volcano的关键特性包括:支持多种调度策略,如先进先出、公平共享、优先级调度等;提供任务依赖管理,支持复杂的DAG工作流;实现资源预留,避免资源碎片;支持异构硬件,如GPU、FPGA等加速器。

Volcano在Kurator中的价值在于:解决了传统Kubernetes调度器在批处理场景下的不足;通过资源优化,提高了集群资源利用率;通过任务依赖管理,简化了复杂工作流的部署;通过跨集群调度,实现了计算资源的弹性扩展。在AI训练、基因测序、金融风险分析等计算密集型场景中,Volcano的价值尤为明显。

三、环境搭建与Kurator部署实践

3.1 环境准备与依赖检查

在开始Kurator的安装部署之前,需要确保环境满足基本要求。Kurator支持在Linux、macOS等主流操作系统上运行,推荐使用Ubuntu 20.04或CentOS 7以上的系统。硬件要求方面,控制节点建议至少4核8GB内存,工作节点根据实际负载需求配置。

关键依赖组件包括:

- Kubernetes集群(v1.20+),用于运行Kurator控制平面

- kubectl(v1.20+),用于与Kubernetes集群交互

- Helm(v3.8+),用于安装Kurator相关组件

- Docker或containerd,用于容器运行时

- Git,用于获取源码

环境检查脚本示例:

#!/bin/bash

# 环境依赖检查脚本

echo "检查系统环境..."

# 检查操作系统

os=$(uname -s)

echo "操作系统: $os"

# 检查Kubernetes版本

kube_version=$(kubectl version --client --short | awk '{print $3}')

echo "kubectl 版本: $kube_version"

# 检查Helm版本

helm_version=$(helm version --short)

echo "Helm 版本: $helm_version"

# 检查Docker版本

docker_version=$(docker --version)

echo "Docker 版本: $docker_version"

# 检查Git版本

git_version=$(git --version)

echo "Git 版本: $git_version"

echo "环境检查完成,准备安装Kurator..."

3.2 Kurator源码获取与安装配置

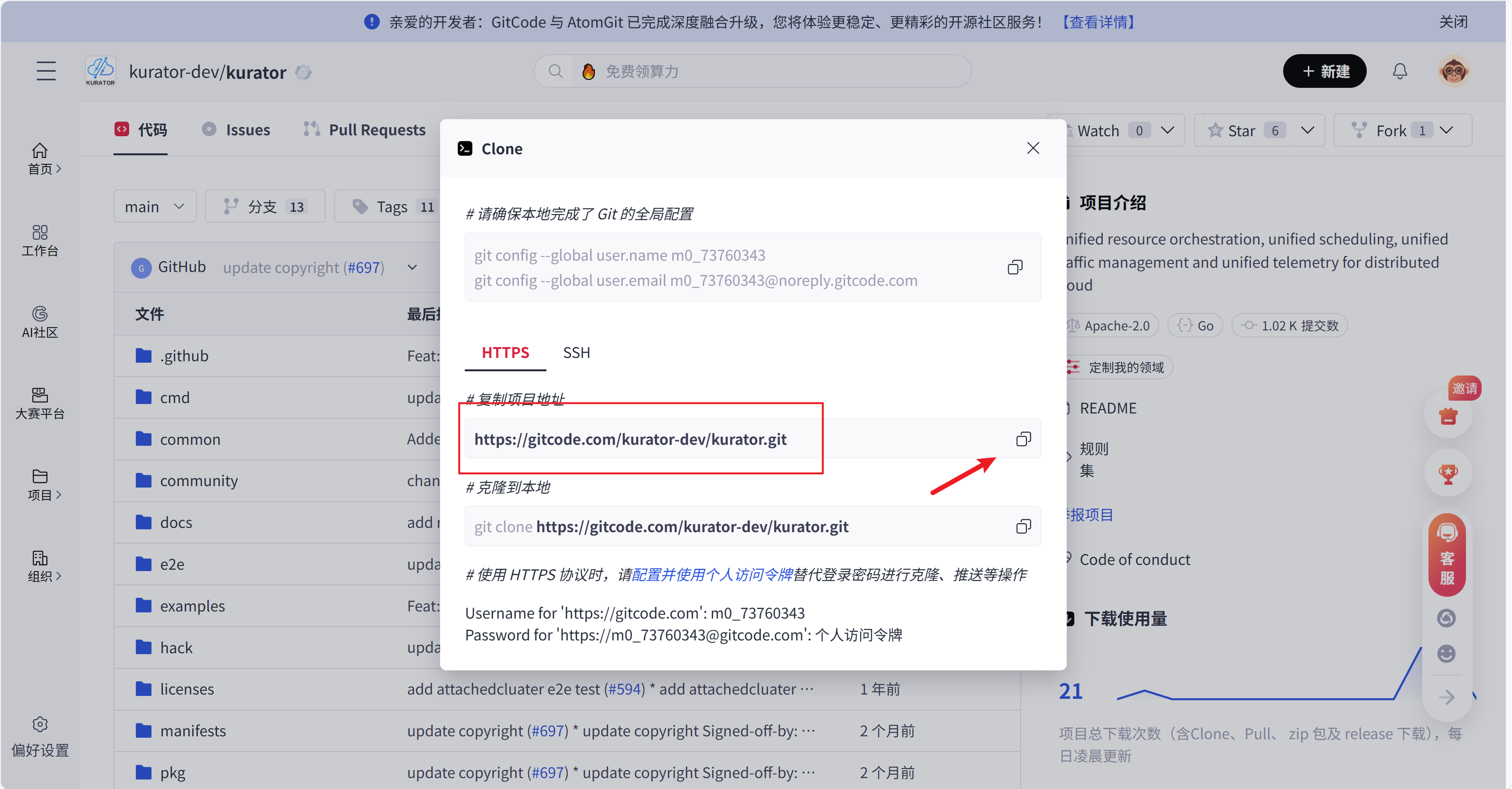

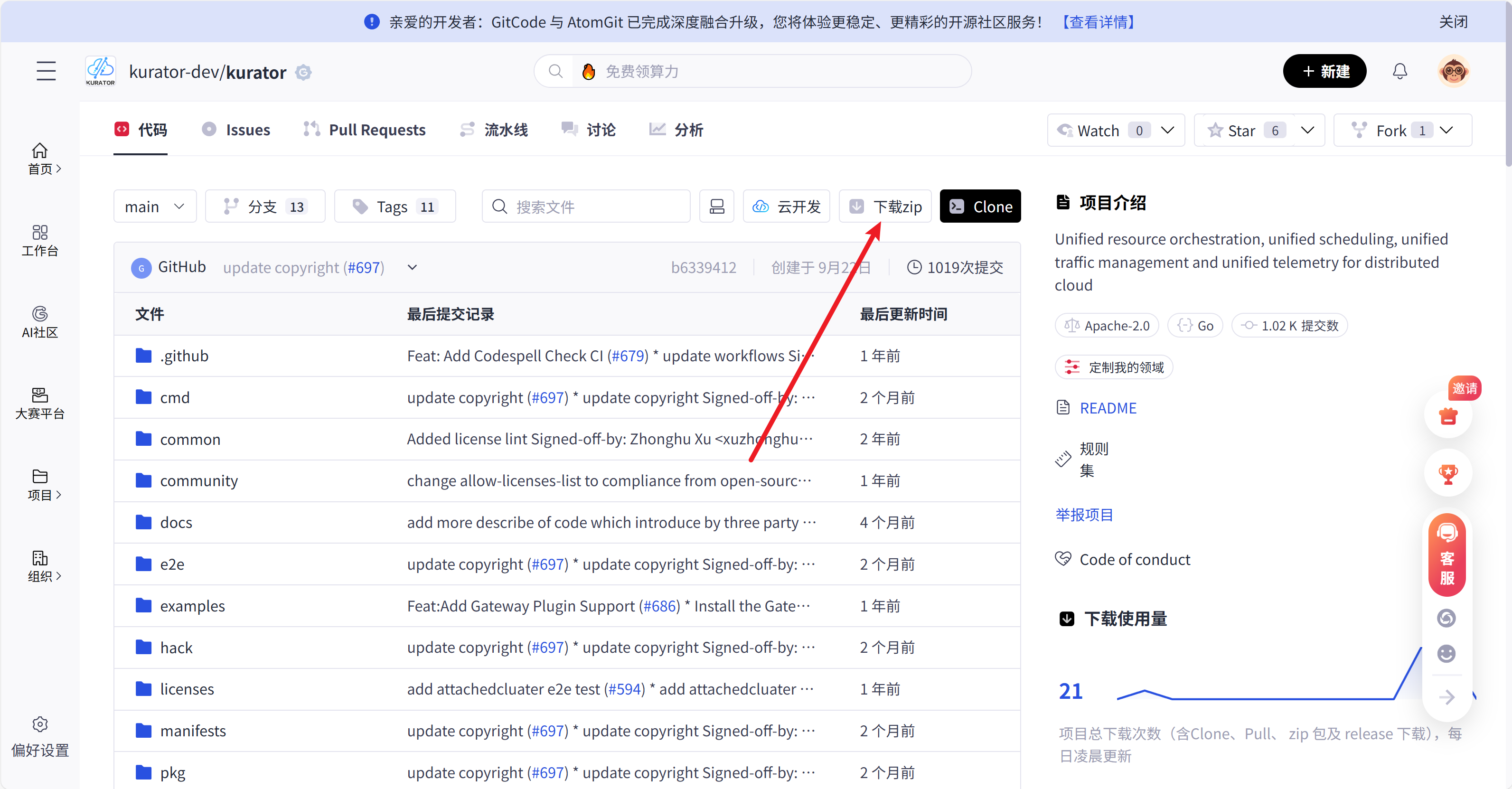

获取Kurator源码是安装的第一步,按照要求,我们使用git clone命令获取最新代码:

# 克隆Kurator源码仓库

git clone https://github.com/kurator-dev/kurator.git

cd kurator

# 查看目录结构

tree -L 2

在项目地址中,可以看到可以clone到本地

https://gitcode.com/kurator-dev/kurator.git

或者我们也可以下载到本地

可以看到我们资源文件已经下载下来了

可以看到版本是0.6.0

克隆完成后,目录结构如下:

- charts/:Helm chart目录,包含各组件的安装配置

- cmd/:命令行工具源码

- configs/:配置文件模板

- docs/:文档

- examples/:示例配置

- hack/:脚本工具

- pkg/:核心包代码

- scripts/:安装脚本

安装Kurator前需要进行配置,主要是设置集群连接信息、组件启用状态等。配置文件通常位于configs/install-config.yaml,关键配置项包括:

# install-config.yaml 示例

apiVersion: kurator.dev/v1alpha1

kind: InstallConfig

metadata:

name: kurator-install

spec:

# 控制平面配置

controlPlane:

namespace: kurator-system

replicas: 3

# 启用组件

components:

fleet: true

gitops: true

scheduling:

karmada: true

volcano: true

edge:

kubeedge: true

observability:

prometheus: true

grafana: true

# 集群连接信息

clusters:

- name: central-cluster

kubeconfig: /path/to/central.kubeconfig

- name: edge-cluster

kubeconfig: /path/to/edge.kubeconfig

3.3 集群初始化与功能验证

Kurator的安装可以通过脚本一键完成,安装过程会创建必要的CRD、部署控制平面组件、配置RBAC权限等。安装命令如下:

# 执行安装脚本

./scripts/install.sh --config configs/install-config.yaml

# 验证安装状态

kubectl get pods -n kurator-system

# 预期输出:

# NAME READY STATUS RESTARTS AGE

# kurator-controller-manager-0 2/2 Running 0 5m

# kurator-fleet-manager-0 2/2 Running 0 5m

# kurator-gitops-controller-0 2/2 Running 0 5m

# kurator-karmada-controller-0 2/2 Running 0 5m

# kurator-kubeedge-controller-0 2/2 Running 0 5m

# kurator-volcano-controller-0 2/2 Running 0 5m

安装完成后,需要验证核心功能是否正常工作。首先验证Fleet管理功能:

# 创建Fleet资源

cat <<EOF | kubectl apply -f -

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: test-fleet

spec:

clusters:

- name: central-cluster

- name: edge-cluster

EOF

# 验证Fleet状态

kubectl get fleet test-fleet -o yaml

接着验证GitOps功能,创建一个简单的应用部署:

# 创建GitRepository资源

cat <<EOF | kubectl apply -f -

apiVersion: source.toolkit.fluxcd.io/v1beta1

kind: GitRepository

metadata:

name: test-app

namespace: kurator-system

spec:

interval: 1m

url: https://github.com/kurator-dev/examples

ref:

branch: main

path: ./apps/test-app

EOF

# 验证应用部署状态

kubectl get gitrepository test-app -n kurator-system

通过这些验证步骤,可以确认Kurator的核心功能正常运行,为后续的深度实践打下基础。

四、Fleet集群管理深度实践

4.1 Fleet架构与核心概念

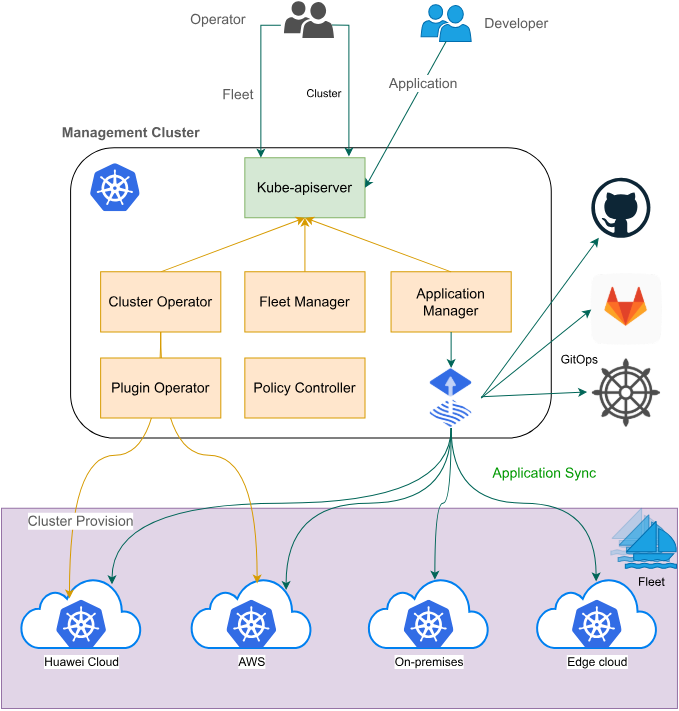

Fleet架构官方参考图:

Fleet是Kurator中负责多集群管理的核心抽象,它将多个物理集群组织成一个逻辑单元,提供统一的管理和调度能力。Fleet的核心概念包括:Fleet本身(集群组)、Cluster成员(具体集群)、Policy策略(管理规则)、Resource资源(分发对象)。

Fleet架构采用控制平面与数据平面分离的设计:控制平面运行在中心集群,负责策略制定和资源分发;数据平面分布在各成员集群,负责策略执行和状态上报。这种架构既保证了管理的集中性,又保持了执行的分布式特性,避免了单点瓶颈。

Fleet的关键价值在于:提供了统一的集群视图,简化了多集群管理复杂度;实现了策略的集中定义和分布式执行,确保一致性;支持动态集群加入和退出,适应业务变化;提供了丰富的扩展点,可以集成各种策略引擎和调度器。

4.2 集群注册与动态管理

Fleet 的集群注册官方参考图:

在Kurator中,集群注册是一个声明式的过程,通过创建Cluster资源对象实现。Cluster资源包含了集群的连接信息、标签、注解等元数据,这些信息会被Fleet Manager使用,实现集群的动态管理。

集群注册示例:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: production-cluster

labels:

environment: production

region: east

spec:

# 集群连接信息

kubeconfigSecret:

name: production-kubeconfig

namespace: kurator-system

# 集群能力描述

capabilities:

- name: gpu

count: 8

- name: storage

type: ssd

capacity: 10Ti

# 健康检查配置

healthCheck:

interval: 30s

timeout: 10s

集群注册后,Fleet Manager会自动建立与目标集群的连接,定期进行健康检查,并将集群状态同步到中心控制平面。这种设计使得集群管理变得动态化和自动化,大大降低了运维复杂度。

更高级的场景中,Kurator支持基于策略的集群自动注册。例如,当新集群创建时,可以通过Webhook或Operator自动触发注册流程,无需人工干预。这种自动化能力在大规模集群环境中尤为重要,可以显著提高管理效率。

4.3 跨集群资源分发与同步

Fleet的核心功能之一是跨集群资源分发,这通过PropagationPolicy资源实现。PropagationPolicy定义了哪些资源需要分发、分发到哪些集群、如何分发等策略。

PropagationPolicy示例:

apiVersion: policy.kurator.dev/v1alpha1

kind: PropagationPolicy

metadata:

name: app-propagation

spec:

# 选择需要分发的资源

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: frontend

- apiVersion: v1

kind: Service

name: frontend

# 选择目标集群

placement:

clusterAffinity:

clusterNames:

- production-cluster

- staging-cluster

# 或者基于标签选择

# clusterSelector:

# matchLabels:

# environment: production

# 分发策略

schedule:

type: Replicated

replicaScheduling:

type: Duplicated

在这个示例中,frontend Deployment和Service会被分发到production-cluster和staging-cluster两个集群,并且在每个集群中保持完整的副本。这种策略适用于需要多活部署的应用。

更复杂的场景中,PropagationPolicy可以结合Karmada的调度策略,实现基于资源需求、亲和性、反亲和性等条件的智能分发。例如,可以将计算密集型应用分发到具有GPU资源的集群,将延迟敏感型应用分发到靠近用户的边缘集群。这种智能调度能力是Kurator相比其他多集群管理工具的重要优势。

五、GitOps与CI/CD流水线构建

5.1 GitOps在Kurator中的实现架构

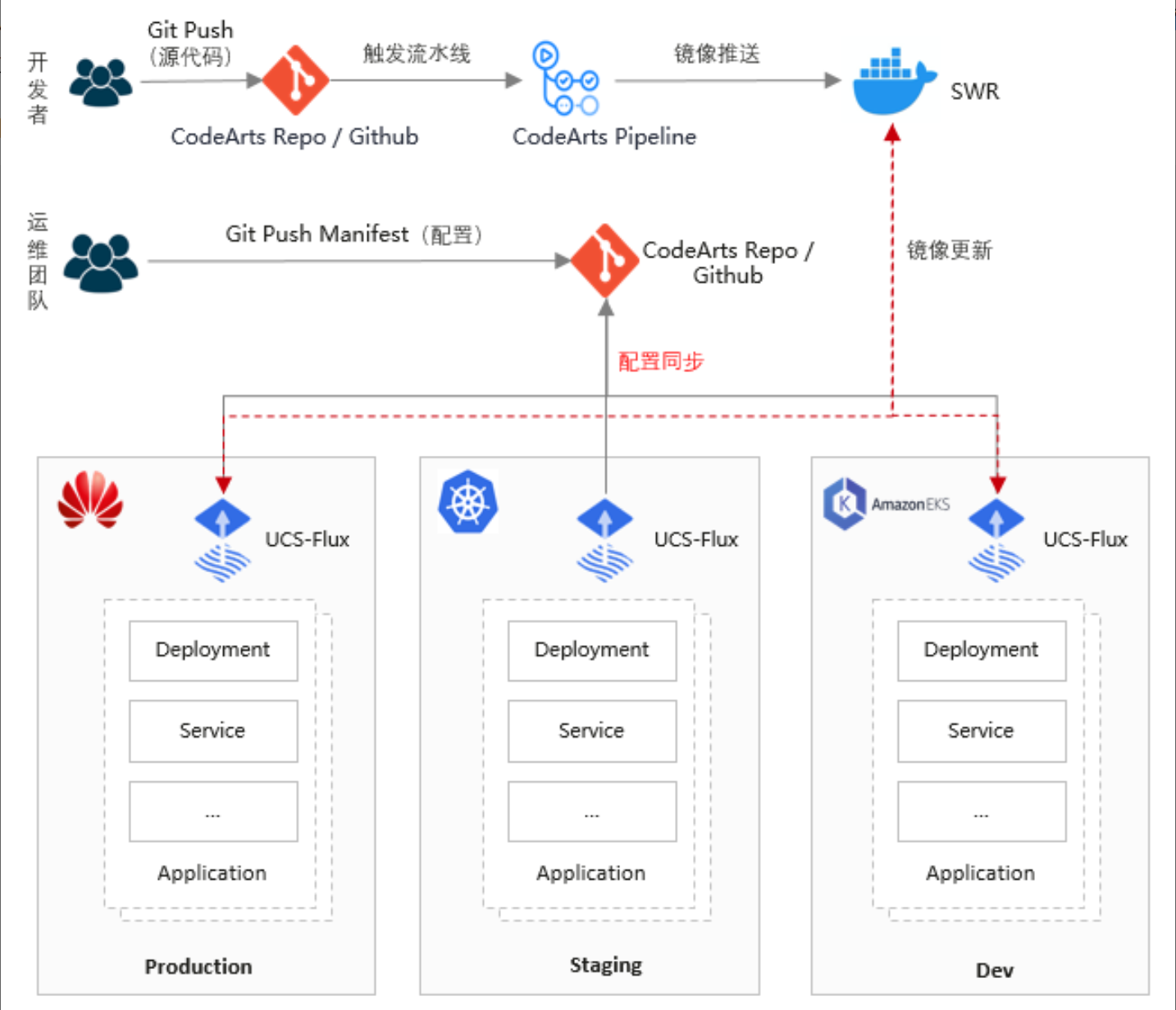

GitOps实现方式官方参考图:

GitOps是Kurator的核心工作模式,它将Git作为系统状态的唯一真实来源,通过声明式配置和自动化同步,实现基础设施和应用的持续交付。在Kurator中,GitOps的实现基于FluxCD,但进行了深度定制和扩展,以适应多集群、多环境的复杂场景。

Kurator的GitOps架构包含三个关键组件:Source Controller负责从Git仓库拉取配置;Kustomize Controller负责配置渲染和转换;Deployment Controller负责将配置应用到目标集群。这些组件协同工作,形成了一个闭环的自动化流程。

GitOps的核心价值在于:提高了系统的可审计性,所有变更都记录在Git中;增强了系统的可靠性,配置漂移会自动修正;简化了协作流程,开发和运维通过Git进行协作;实现了环境一致性,不同环境的配置差异通过分支或目录结构管理。

在Kurator中,GitOps不仅适用于应用部署,还适用于基础设施管理、策略配置、安全合规等多个方面,形成了全方位的声明式管理体系。这种统一的管理模式大大降低了系统的复杂度,提高了运维效率。

5.2 基于FluxCD的多环境部署实践

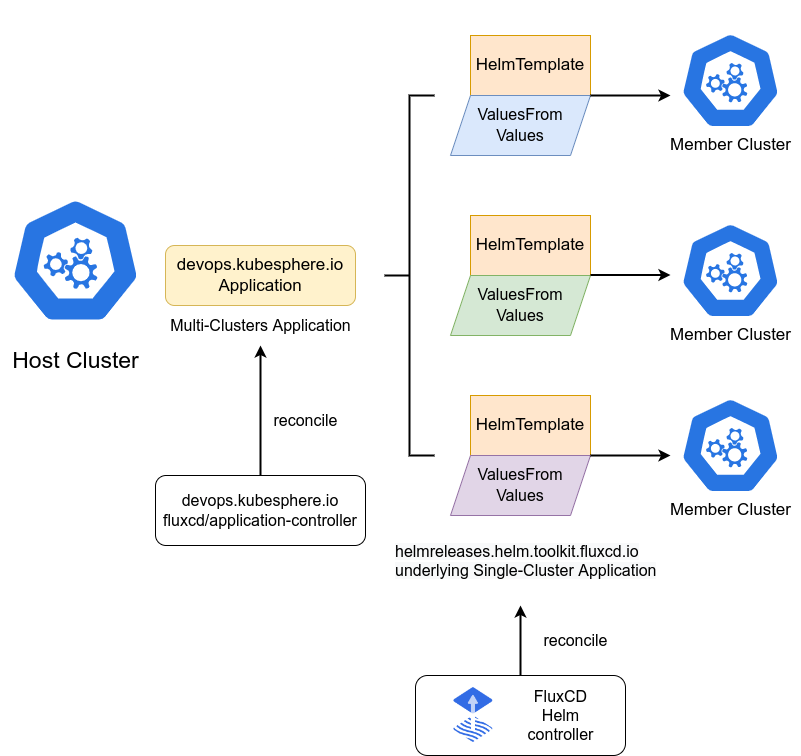

FluxCD Helm 应用的示意图:

在Kurator中,基于FluxCD实现多环境部署是一个典型场景。通过合理的仓库结构设计和策略配置,可以实现开发、测试、生产等多环境的自动化部署和同步。

仓库结构示例:

config-repo/

├── clusters/

│ ├── production/

│ │ ├── kustomization.yaml

│ │ └── resources/

│ ├── staging/

│ │ ├── kustomization.yaml

│ │ └── resources/

│ └── development/

│ ├── kustomization.yaml

│ └── resources/

├── apps/

│ ├── frontend/

│ │ ├── base/

│ │ ├── overlays/

│ │ │ ├── production/

│ │ │ ├── staging/

│ │ │ └── development/

│ │ └── kustomization.yaml

│ └── backend/

│ ├── base/

│ ├── overlays/

│ │ ├── production/

│ │ ├── staging/

│ │ └── development/

│ └── kustomization.yaml

└── infrastructure/

├── monitoring/

├── logging/

└── networking/

Kustomization配置示例:

apiVersion: kustomize.toolkit.fluxcd.io/v1beta1

kind: Kustomization

metadata:

name: frontend-production

namespace: kurator-system

spec:

interval: 5m

path: ./apps/frontend/overlays/production

prune: true

sourceRef:

kind: GitRepository

name: config-repo

targetNamespace: production

wait: true

postBuild:

substitute:

IMAGE_TAG: production-v1.0.0

这个配置会每5分钟从Git仓库拉取frontend应用在production环境的配置,应用到production命名空间。通过这种方式,可以实现不同环境的差异化部署,同时保持配置的统一管理。

5.3 Kurator CI/CD流水线设计与优化

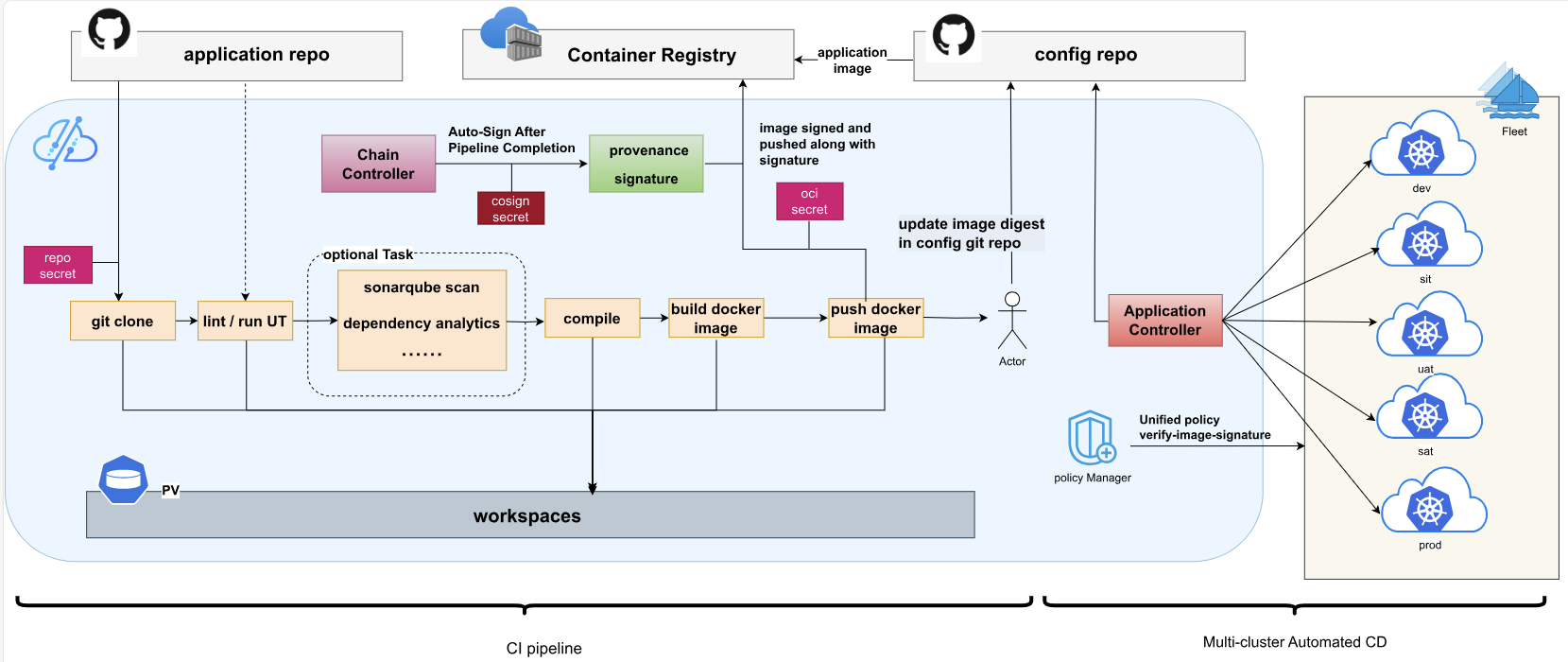

Kurator CI/CD 的结构参考图:

在Kurator中,CI/CD流水线的设计需要充分考虑多集群、多环境的特点。典型的流水线包括:代码构建、镜像推送、配置更新、多环境部署、验证测试等环节。

一个优化的CI/CD流水线示例(使用GitHub Actions):

name: Kurator CI/CD Pipeline

on:

push:

branches: [ main ]

paths:

- 'apps/frontend/**'

jobs:

build-and-push:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Set up QEMU

uses: docker/setup-qemu-action@v2

- name: Set up Docker Buildx

uses: docker/setup-buildx-action@v2

- name: Login to Container Registry

uses: docker/login-action@v2

with:

registry: ghcr.io

username: ${{ github.actor }}

password: ${{ secrets.GITHUB_TOKEN }}

- name: Build and push Docker image

uses: docker/build-push-action@v4

with:

context: apps/frontend

push: true

tags: ghcr.io/${{ github.repository }}/frontend:${{ github.sha }}

labels: |

org.opencontainers.image.source=${{ github.repositoryUrl }}

org.opencontainers.image.revision=${{ github.sha }}

- name: Update GitOps configuration

run: |

git config user.name "GitHub Actions"

git config user.email "actions@github.com"

# 更新镜像标签

sed -i "s|image: .*|image: ghcr.io/${{ github.repository }}/frontend:${{ github.sha }}|" \

apps/frontend/overlays/production/deployment.yaml

# 提交变更

git add apps/frontend/overlays/production/deployment.yaml

git commit -m "Update frontend image to ${{ github.sha }}"

git push

deploy-to-staging:

needs: build-and-push

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Set up kubectl

uses: azure/setup-kubectl@v3

- name: Deploy to staging

run: |

kubectl apply -f manifests/staging/frontend.yaml

kubectl rollout status deployment/frontend -n staging --timeout=5m

test-staging:

needs: deploy-to-staging

runs-on: ubuntu-latest

steps:

- name: Run integration tests

run: |

# 运行针对staging环境的集成测试

./scripts/run-tests.sh --env staging

deploy-to-production:

needs: test-staging

runs-on: ubuntu-latest

if: github.ref == 'refs/heads/main'

steps:

- name: Manual approval

uses: actions/manual-approval@v1

with:

secret: ${{ secrets.APPROVAL_SECRET }}

approvers: |

tech-lead

release-manager

- name: Promote to production

run: |

# 触发生产环境部署

curl -X POST \

-H "Authorization: token ${{ secrets.GITHUB_TOKEN }}" \

-H "Content-Type: application/json" \

-d '{"ref": "refs/heads/main"}' \

https://api.github.com/repos/${{ github.repository }}/actions/workflows/deploy-production.yml/dispatches

这个流水线示例展示了Kurator环境下的CI/CD最佳实践:镜像构建与配置更新分离;多环境分阶段部署;集成测试验证;生产环境人工审批。通过这种设计,既保证了部署的自动化,又确保了变更的安全性。

六、边缘计算与多集群调度实践

6.1 KubeEdge边缘节点管理深度解析

KubeEdge作为Kurator的边缘计算组件,其核心价值在于将Kubernetes的原生API扩展到边缘环境,实现云边协同。在Kurator中,KubeEdge的管理被集成到统一的控制平面,通过声明式API实现边缘节点的生命周期管理。

边缘节点注册示例:

apiVersion: edge.kurator.dev/v1alpha1

kind: EdgeNode

metadata:

name: factory-edge-node-01

labels:

location: factory-a

device-type: industrial-pc

spec:

# 节点连接信息

endpoint:

ip: 192.168.1.100

port: 10000

# 节点能力描述

capabilities:

cpu: "4"

memory: 8Gi

storage: 100Gi

gpu: "0"

# 设备接入配置

deviceConfig:

protocols:

- name: modbus

port: 502

- name: opcua

port: 4840

# 离线策略

offlinePolicy:

cacheTTL: 24h

autoRestart: true

这个配置定义了一个工业边缘节点,包含连接信息、硬件能力、支持的设备协议和离线策略。Kurator会自动将这个配置同步到KubeEdge控制平面,完成边缘节点的注册和配置。

在实际工业场景中,边缘节点往往面临网络不稳定、资源受限等挑战。Kurator通过KubeEdge提供了针对性的解决方案:网络隧道确保弱网环境下的可靠通信;轻量级运行时适应资源受限环境;离线自治保证网络中断时服务不中断;设备映射实现物理设备到Kubernetes资源的映射。这些能力使得Kurator在工业物联网、智能零售、车联网等边缘计算场景中具有显著优势。

6.2 Volcano分组调度策略实战

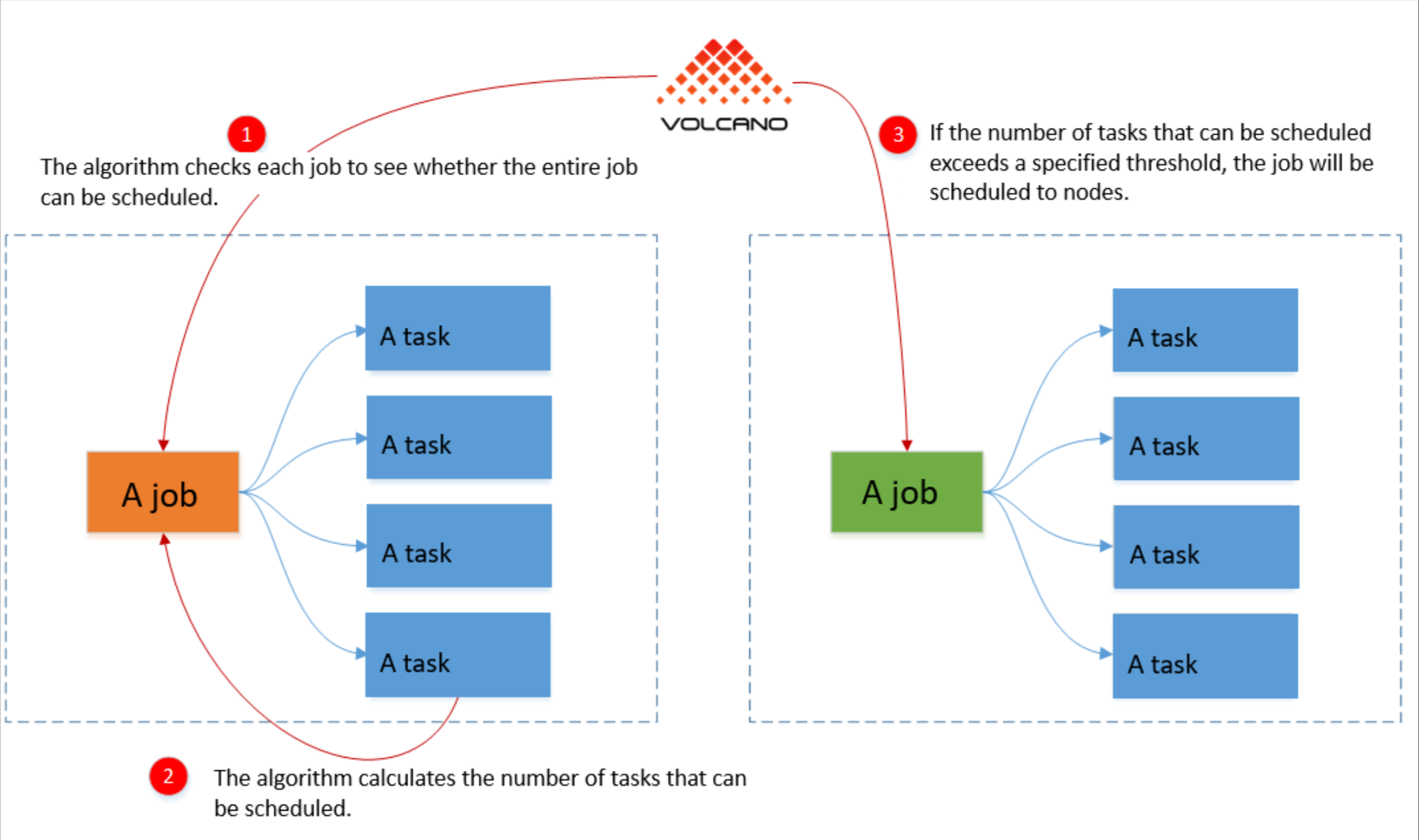

Volcano分组调度参考图:

Volcano作为Kurator的批处理调度组件,其核心创新在于引入了任务组(PodGroup)的概念,将相关联的Pod组织在一起进行统一调度,解决了传统Kubernetes调度器在批处理场景下的不足。

PodGroup配置示例:

apiVersion: scheduling.volcano.sh/v1beta1

kind: PodGroup

metadata:

name: ml-training-job

spec:

minMember: 8

minTaskMember:

- name: ps

minMember: 2

- name: worker

minMember: 6

queue: ai-training

priorityClassName: high-priority

这个配置定义了一个机器学习训练任务组,要求至少8个成员Pod,其中参数服务器(PS)2个,工作节点(Worker)6个。只有当所有Pod都能被调度时,整个任务组才会启动,避免了部分启动导致的资源浪费。

在Kurator中,Volcano与Karmada的集成实现了跨集群的批处理调度。例如,一个大型AI训练任务可以分布在多个集群中,利用不同集群的闲置GPU资源。调度策略可以基于集群负载、网络延迟、数据位置等因素进行优化,实现资源的全局最优利用。

这种跨集群批处理调度能力在AI训练、基因测序、金融风险计算等计算密集型场景中具有重要价值。通过Kurator的统一调度,企业可以构建弹性、高效的计算平台,应对各种复杂的批处理需求。

6.3 Karmada跨集群弹性伸缩实现

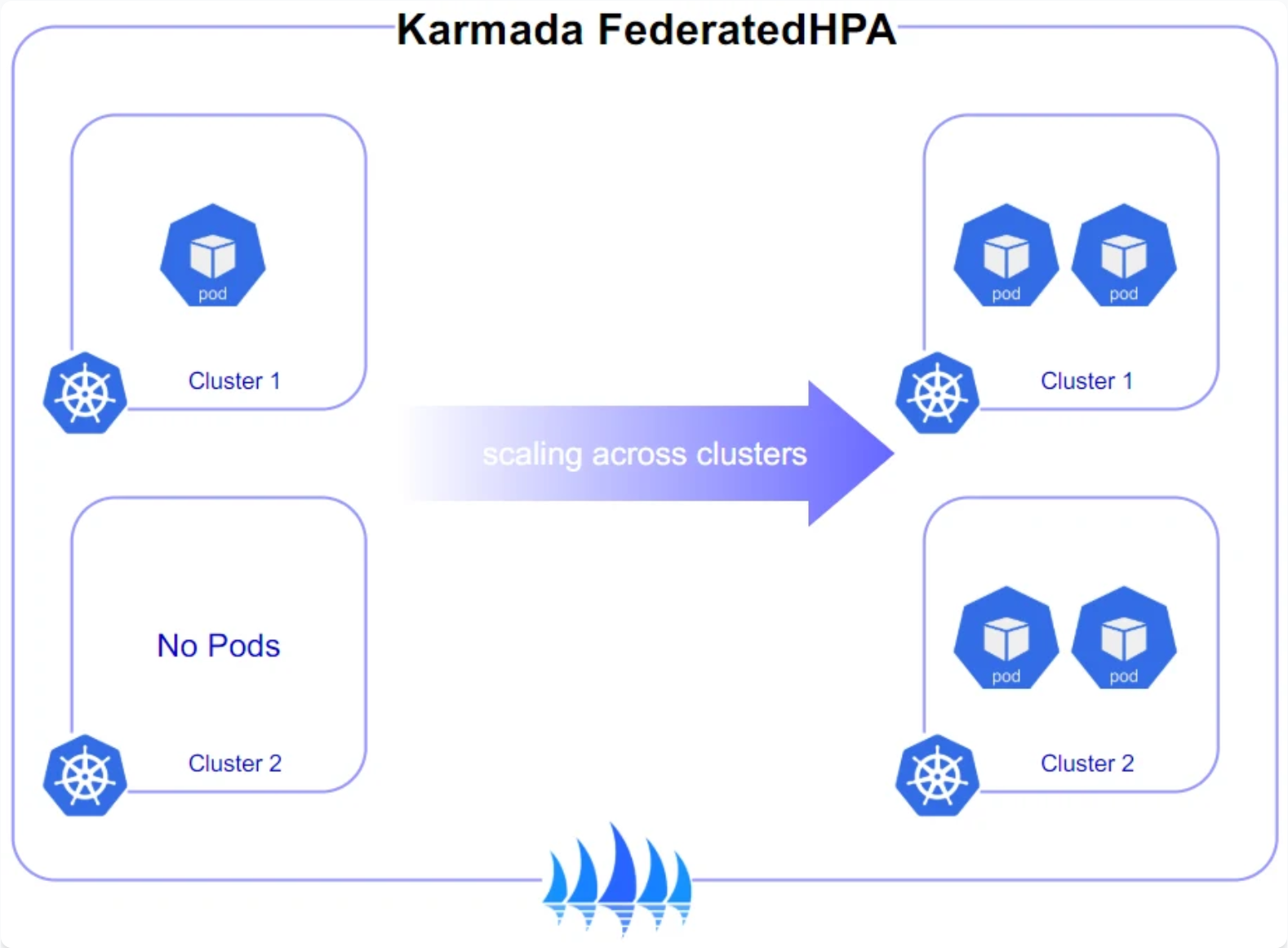

Karmada跨集群弹性伸缩策略参考图:

Karmada作为Kurator的多集群管理组件,提供了强大的跨集群弹性伸缩能力。与传统的单集群HPA不同,Karmada的弹性伸缩考虑了多集群环境下的资源分布和负载均衡。

跨集群弹性伸缩策略示例:

apiVersion: autoscaling.karmada.io/v1alpha1

kind: ClusterPropagationPolicy

metadata:

name: service-auto-scaling

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: frontend

placement:

clusterAffinity:

clusterNames:

- cluster-east

- cluster-west

- cluster-central

# 弹性伸缩策略

replicaScheduling:

replicaDivisionPreference: Aggregated

replicaSchedulingType: Divided

weightList:

- targetCluster:

clusterNames: ["cluster-east"]

weight: 50

- targetCluster:

clusterNames: ["cluster-west"]

weight: 30

- targetCluster:

clusterNames: ["cluster-central"]

weight: 20

# 基于负载的自动调整

autoScaling:

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 70

- type: External

external:

metricName: request-per-second

targetValue: 1000

behavior:

scaleUp:

stabilizationWindowSeconds: 300

policies:

- type: Percent

value: 20

periodSeconds: 60

scaleDown:

stabilizationWindowSeconds: 600

policies:

- type: Percent

value: 10

periodSeconds: 120

这个策略定义了一个跨三个集群的前端服务部署,初始副本分配比例为50:30:20。当CPU利用率超过70%或每秒请求数超过1000时,会触发扩容;扩容比例为20%,冷却时间为5分钟。缩容则更为保守,比例为10%,冷却时间为10分钟,避免频繁震荡。

在实际应用中,这种跨集群弹性伸缩能力对于全球分布式应用至关重要。例如,电商平台可以根据不同地区的访问量动态调整各区域集群的资源分配;视频流媒体服务可以根据用户地理位置和观看高峰时段,优化内容分发节点的资源使用。通过Kurator的智能调度,企业可以实现资源利用的最大化和用户体验的最优化。

七、Kurator高级功能与生产实践

7.1 统一遥测与监控体系构建

在分布式云原生环境中,统一的监控和告警体系至关重要。Kurator整合了Prometheus、Grafana、Loki等开源工具,构建了端到端的可观测性解决方案。核心组件包括:指标采集(Prometheus)、日志收集(Loki/Fluentd)、链路追踪(Jaeger)、可视化展示(Grafana)。

监控体系配置示例:

apiVersion: monitoring.kurator.dev/v1alpha1

kind: MonitoringStack

metadata:

name: production-monitoring

spec:

# Prometheus配置

prometheus:

replicas: 3

retention: 15d

remoteWrite:

- url: https://prometheus-us-central1.grafana.net/api/prom/push

basicAuth:

username: "your-username"

passwordSecret:

name: grafana-cloud-secret

key: password

# Grafana配置

grafana:

adminUser: admin

adminPasswordSecret:

name: grafana-admin-secret

key: password

datasources:

- name: Prometheus

type: prometheus

url: http://prometheus.production-monitoring.svc:9090

- name: Loki

type: loki

url: http://loki.production-monitoring.svc:3100

# 告警配置

alertmanager:

route:

receiver: 'team-slack'

routes:

- match:

severity: critical

receiver: 'team-email'

receivers:

- name: 'team-slack'

slack_configs:

- api_url: https://hooks.slack.com/services/xxx/yyy/zzz

channel: '#alerts'

- name: 'team-email'

email_configs:

- to: 'team@example.com'

在生产环境中,监控体系需要考虑多维度数据采集:基础设施层(CPU、内存、磁盘、网络)、平台层(Kubernetes资源使用、Pod状态)、应用层(业务指标、错误率、延迟)、用户体验层(页面加载时间、API响应时间)。Kurator通过统一的配置管理,简化了多层监控的复杂性,实现了从基础设施到业务应用的全栈可观测性。

7.2 网络连通性与服务发现优化

在多集群、多云环境中,网络连通性和服务发现是核心挑战。Kurator整合了Istio、CoreDNS、MetalLB等组件,提供了端到端的网络解决方案。核心能力包括:跨集群服务发现、统一入口网关、流量管理、安全通信。

跨集群服务发现配置示例:

apiVersion: networking.istio.io/v1alpha3

kind: ServiceEntry

metadata:

name: remote-service

spec:

hosts:

- remote-service.default.svc.cluster.local

location: MESH_INTERNAL

resolution: DNS

endpoints:

- address: cluster-east.default.svc.cluster.local

ports:

http: 8080

- address: cluster-west.default.svc.cluster.local

ports:

http: 8080

ports:

- number: 8080

name: http

protocol: HTTP

这个配置定义了一个跨集群的服务条目,将remote-service服务映射到east和west两个集群中的实例。Istio会自动处理服务发现和负载均衡,客户端无需关心服务的实际位置。

在网络通信方面,Kurator支持多种连接模式:直接连接(集群之间网络互通)、代理连接(通过中心代理转发)、隧道连接(通过加密隧道通信)。根据安全要求和网络条件,可以选择最适合的连接方式。例如,在公有云和私有云混合环境中,通常使用隧道连接确保安全;在同VPC内的集群,可以使用直接连接提高性能。

7.3 安全策略与合规管理实践

安全是云原生环境的核心关注点。Kurator整合了Kyverno、OPA Gatekeeper、Falco等安全工具,提供了从准入控制到运行时防护的全方位安全解决方案。核心能力包括:策略即代码、合规检查、漏洞扫描、运行时防护。

安全策略配置示例(使用Kyverno):

apiVersion: kyverno.io/v1

kind: ClusterPolicy

metadata:

name: require-pod-security

spec:

validationFailureAction: enforce

background: true

rules:

- name: require-run-as-nonroot

match:

resources:

kinds:

- Pod

validate:

message: "Containers must run as non-root users"

pattern:

spec:

securityContext:

runAsNonRoot: true

- name: require-readonly-rootfs

match:

resources:

kinds:

- Pod

validate:

message: "Root filesystem must be read-only"

pattern:

spec:

containers:

- name: "*"

securityContext:

readOnlyRootFilesystem: true

- name: disallow-latest-tag

match:

resources:

kinds:

- Pod

validate:

message: "Image tag 'latest' is not allowed"

pattern:

spec:

containers:

- name: "*"

image: "!*:latest"

这个策略定义了三个安全规则:容器必须以非root用户运行、根文件系统必须只读、禁止使用latest标签。这些规则会在资源创建时自动验证,不符合要求的资源会被拒绝。

在生产环境中,安全策略需要分层设计:基础设施层(网络隔离、主机安全)、平台层(Kubernetes RBAC、Pod安全策略)、应用层(镜像签名、依赖扫描)、数据层(加密、访问控制)。Kurator通过统一的策略管理框架,简化了多层次安全策略的实施和维护,帮助企业满足合规要求,降低安全风险。

八、Kurator未来发展与技术展望

8.1 Kurator技术路线图分析

Kurator作为新兴的分布式云原生平台,其技术路线图反映了云原生技术的发展趋势。根据社区讨论和贡献分析,Kurator未来的发展重点将集中在几个关键领域:更深度的边缘计算支持、AI/ML工作负载优化、多云成本优化、安全合规增强。

在边缘计算方面,Kurator计划增强离线自治能力,支持更复杂的边缘应用场景;优化边缘到云的通信协议,减少带宽消耗;集成更多边缘设备协议,扩大生态兼容性。这些改进将使Kurator在工业物联网、智能城市、车联网等边缘场景中更具竞争力。

在AI/ML领域,Kurator将深化与Volcano、Kubeflow等项目的集成,提供端到端的机器学习生命周期管理;优化GPU等加速器资源的调度和利用;支持分布式训练和推理的自动化部署。这些能力将帮助企业在AI时代构建高效、弹性的计算平台。

多云成本优化是企业关注的重点,Kurator计划引入智能调度算法,根据资源价格、性能、延迟等因素,自动选择最优的部署位置;提供细粒度的资源使用分析和优化建议;支持spot实例和预留实例的混合使用策略。这些功能将帮助企业显著降低云基础设施成本。

8.2 分布式云原生技术趋势洞察

分布式云原生技术正在快速发展,几个关键趋势值得关注:边缘原生(Edge-Native)架构、服务网格(Service Mesh)与API网关的融合、GitOps成为标准工作模式、WASM成为新的运行时选项。

边缘原生架构正从简单的边缘代理向完整的边缘运行时演进。未来的边缘节点将具备更强的自治能力,能够在网络中断时独立运行复杂应用;边缘与云的协同将更加智能化,根据网络条件和业务需求动态调整任务分配;边缘安全将得到加强,确保在不可信环境中的数据安全和应用完整性。

服务网格与API网关的融合是另一个重要趋势。传统的边界网关和内部服务网格正在整合,形成统一的流量管理平面。这种整合简化了架构,提高了性能,增强了可观测性。Kurator通过Istio的深度集成,已经在这一方向取得了显著进展,未来将进一步优化跨集群、跨云的流量管理能力。

GitOps正在成为云原生的标准工作模式,从基础设施管理扩展到应用交付、安全合规、成本优化等各个方面。Kurator的GitOps实现将更加智能化,支持自动化的策略优化、配置漂移检测和修复、变更影响分析等功能。这些增强将进一步提高系统的可靠性和运维效率。

8.3 社区贡献与生态建设策略

开源社区是Kurator成功的关键。未来,Kurator社区将重点关注几个方面:降低贡献门槛、加强文档建设、扩展生态系统、建立认证体系。

降低贡献门槛是社区增长的基础。Kurator计划提供更完善的开发环境搭建指南、代码贡献流程说明、问题分类标签(good first issue、help wanted等)。这些措施将帮助新贡献者快速上手,扩大社区规模。

文档建设是用户体验的关键。Kurator将重构文档结构,提供针对不同角色(开发者、运维、架构师)的定制化内容;增加真实场景的案例研究;提供交互式学习环境。这些改进将显著提升用户的学习效率和使用体验。

生态系统扩展是平台价值的体现。Kurator将建立合作伙伴计划,与云服务商、硬件厂商、ISV合作,提供预集成的解决方案;开发插件市场,支持第三方扩展;举办黑客马拉松和开发者大会,激发创新。这些举措将加速Kurator生态的繁荣。

认证体系是专业认可的标志。Kurator计划推出管理员和开发者认证项目,建立培训课程和考试体系;与高校和培训机构合作,培养云原生人才;设立社区贡献奖励机制,表彰杰出贡献者。这些措施将提高Kurator的专业认可度,促进人才生态的发展。

总结

Kurator作为新一代分布式云原生平台,通过深度集成众多优秀开源项目,为企业提供了构建统一云原生基础设施的强大工具。从多集群管理到边缘计算,从GitOps自动化到智能调度,Kurator解决了企业在数字化转型过程中面临的核心挑战。

通过本文的深度实践,我们可以看到Kurator在环境搭建、集群管理、应用部署、监控告警等方面的强大能力。这些能力不是孤立的功能点,而是相互协同、形成完整解决方案的有机组成部分。正是这种系统性的设计,使得Kurator能够在复杂的分布式环境中提供一致、可靠的服务。

展望未来,随着云原生技术的不断发展,Kurator将继续演进,更好地支持边缘计算、AI/ML、多云优化等新兴场景。作为云原生社区的重要成员,Kurator的发展将受益于开源协作的力量,同时也将为整个生态做出贡献。

对于企业而言,采用Kurator意味着拥抱开放标准、避免厂商锁定、加速创新步伐。无论是大型企业构建全球分布式基础设施,还是中小企业快速实现数字化转型,Kurator都提供了灵活、可扩展的解决方案。

在云原生的浪潮中,Kurator不仅是一个技术平台,更是一种新的思维方式。它倡导的声明式API、自动化运维、持续交付等理念,正在重塑企业的IT架构和组织文化。通过深入理解并实践这些理念,企业可以在数字化转型的道路上走得更远、更稳。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)