【探索实战】Kurator分布式云原生平台:从架构设计到企业级实践

【探索实战】Kurator分布式云原生平台:从架构设计到企业级实践

【探索实战】Kurator分布式云原生平台:从架构设计到企业级实践

摘要

本文深入探讨Kurator这一开源分布式云原生平台的核心架构、关键功能及企业级实践。Kurator作为站在众多流行云原生软件栈(包括Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada、Kyverno等)肩膀上的平台,提供了多云、边缘云协同的统一管理能力。文章通过环境搭建、Fleet集群管理、Karmada集成、统一流量治理、GitOps实践等维度,结合真实场景代码示例,剖析Kurator如何解决企业分布式云原生基础设施建设中的痛点,并对其未来发展方向进行前瞻性思考。通过本文,读者将获得从理论到实践的完整认知,为构建企业级分布式云原生平台提供技术参考。

1. Kurator架构概览与核心价值

1.1 分布式云原生的挑战与机遇

随着企业数字化转型深入,多云、混合云、边缘计算等场景日益普及,传统的单一集群管理方式已无法满足现代应用的需求。企业面临集群分散管理、应用分发复杂、流量治理困难、监控数据孤岛等挑战。Kurator应运而生,通过统一的控制平面和声明式API,为分布式云原生环境提供一体化解决方案。

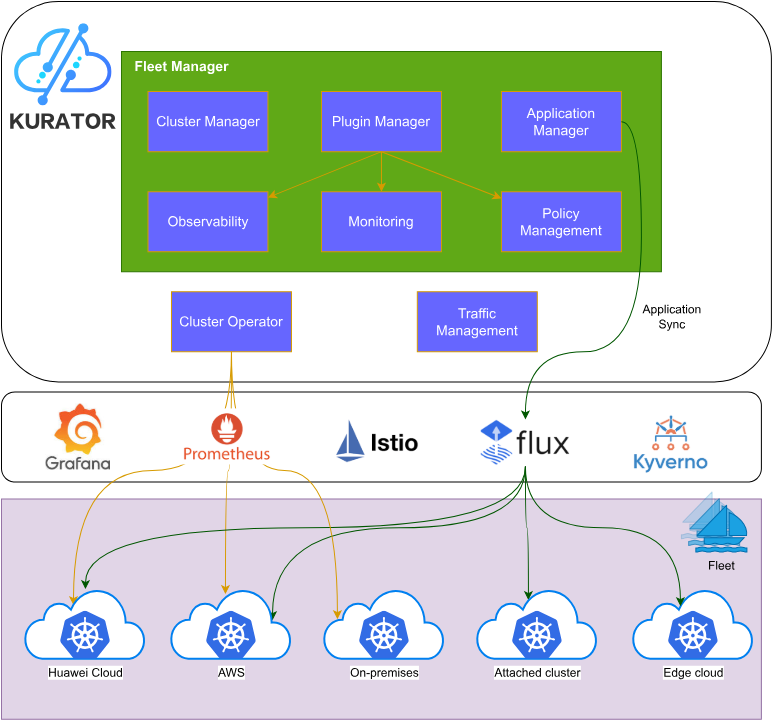

1.2 Kurator架构设计哲学

Kurator采用分层架构设计,底层集成多个成熟的云原生项目,中间层提供统一的抽象和API,上层提供企业级功能。其设计哲学遵循"站在巨人肩膀上"的原则,不是重新发明轮子,而是通过整合和增强现有生态,提供1+1>2的价值。这种架构保证了技术的先进性和稳定性,同时降低了用户的学习成本。

1.3 核心能力矩阵

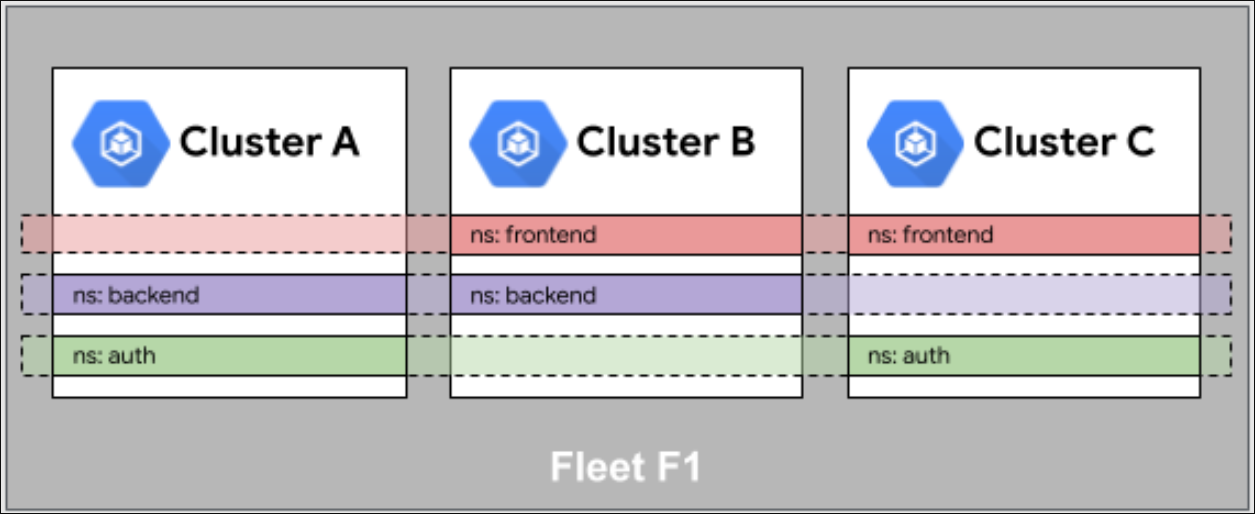

Kurator提供六大核心能力:多云/边缘云协同、统一资源编排、统一调度、统一流量管理、统一遥测、基础设施即代码。这些能力相互协同,形成完整的分布式云原生管理闭环。特别是其Fleet概念,将多个物理或逻辑集群抽象为一个管理单元,极大简化了多集群管理的复杂性。

1.4 企业价值与落地场景

在实际企业场景中,Kurator帮助某金融企业实现了核心业务系统的多活部署,将故障恢复时间从分钟级缩短到秒级;帮助某零售企业将边缘计算节点与中心云无缝集成,实现了实时库存管理和智能推荐。这些案例证明,Kurator不仅是技术平台,更是企业数字化转型的战略支撑。

2. 环境搭建与安装实践

2.1 前置环境准备

在开始Kurator安装前,需要准备以下环境:

- 至少一台Linux服务器(推荐Ubuntu 20.04+或CentOS 7+)

- Kubernetes集群(v1.23+版本,可使用Kind或Minikube进行测试)

- Helm(v3.8+)

- kubectl(与Kubernetes集群版本匹配)

- 适当开放的网络端口(特别是API Server端口)

# 检查环境依赖

kubectl version --client --short

helm version --short

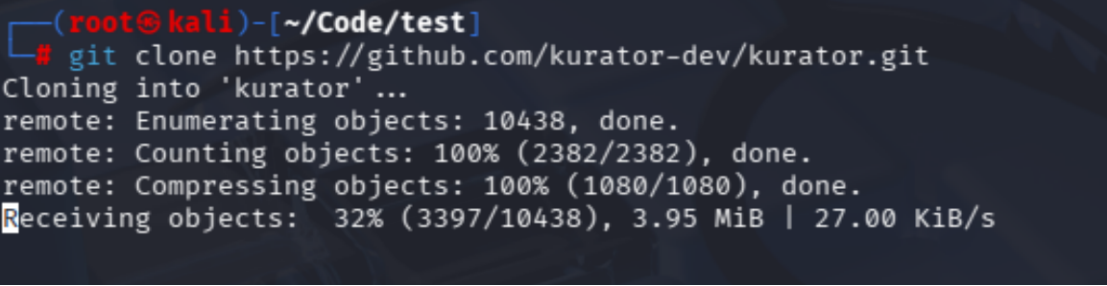

2.2 源码获取与基础配置

使用Git获取Kurator源码是安装的第一步,这不仅提供了安装脚本,还包含了示例配置和文档:

git clone https://github.com/kurator-dev/kurator.git

cd kurator

获取源码后,需要根据环境调整配置。在tools/kurator-installer/config.yaml中,可以设置集群信息、网络插件、存储类等参数。对于测试环境,通常使用默认配置即可;对于生产环境,需要仔细规划网络拓扑和资源分配。

2.3 一键安装与常见问题排查

Kurator提供了便捷的一键安装脚本,简化了复杂的部署过程:

# 运行安装脚本

./tools/kurator-installer/install.sh

安装过程中常见问题及解决方案:

- 镜像拉取失败:配置镜像仓库代理或使用本地镜像仓库

- 网络插件冲突:确保目标集群没有预先安装CNI插件

- 资源不足:至少保证4GB内存和2核CPU用于测试环境

- 证书问题:清理旧证书或使用

--force参数重新生成

2.4 验证安装与基础功能测试

安装完成后,通过以下命令验证Kurator组件状态:

kubectl get pods -n kurator-system

所有Pod应处于Running状态。接着,创建一个简单的Fleet资源测试基础功能:

# example-fleet.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

meta

name: example-fleet

spec:

clusters:

- name: member-cluster-1

kubeconfigSecret:

name: member-cluster-1-kubeconfig

应用配置并观察状态变化,确认Kurator核心功能正常运行。

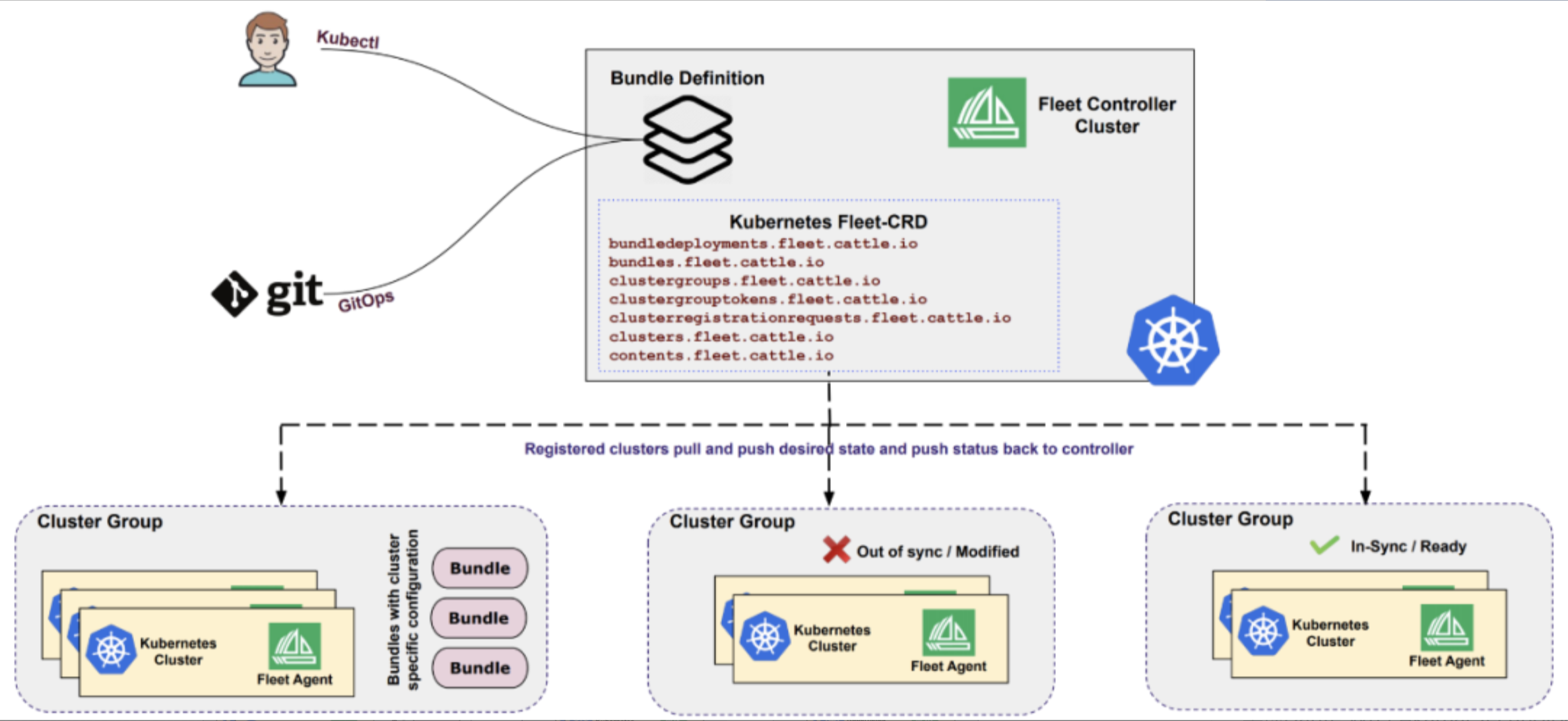

3. Fleet:统一集群管理的核心

3.1 Fleet概念与设计思想

Fleet是Kurator的核心抽象,代表一组逻辑上关联的Kubernetes集群。不同于简单的集群列表,Fleet提供了统一的命名空间、服务账号、网络策略等基础设置,使得跨集群管理如同管理单一集群般简单。Fleet的设计思想是"逻辑统一,物理分散",既保持集群独立性,又提供统一管理视图。

3.2 集群注册与生命周期管理

将集群加入Fleet是首要步骤。Kurator支持两种注册方式:推送模式(中心控制面主动连接成员集群)和拉取模式(成员集群主动连接控制面)。以下是推送模式的注册流程:

# cluster-registration.yaml

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

meta

name: production-cluster

spec:

type: Kubernetes

kubeconfigSecret:

name: production-cluster-kubeconfig

namespace: kurator-system

注册后,Kurator自动监控集群健康状态,提供统一的集群生命周期管理界面,包括集群升级、扩缩容、备份恢复等操作。

3.3 跨集群服务发现与通信

Fleet解决了跨集群服务发现的难题。通过ServiceImport和ServiceExport资源,Kurator实现了跨集群服务的自动发现和访问:

# service-export.yaml

apiVersion: multicluster.x-k8s.io/v1alpha1

kind: ServiceExport

meta

name: frontend

namespace: default

# service-import.yaml

apiVersion: multicluster.x-k8s.io/v1alpha1

kind: ServiceImport

meta

name: frontend

namespace: default

spec:

type: ClusterSetIP

ports:

- port: 80

protocol: TCP

这种机制使得应用无需关心服务部署在哪个集群,简化了分布式应用架构设计。

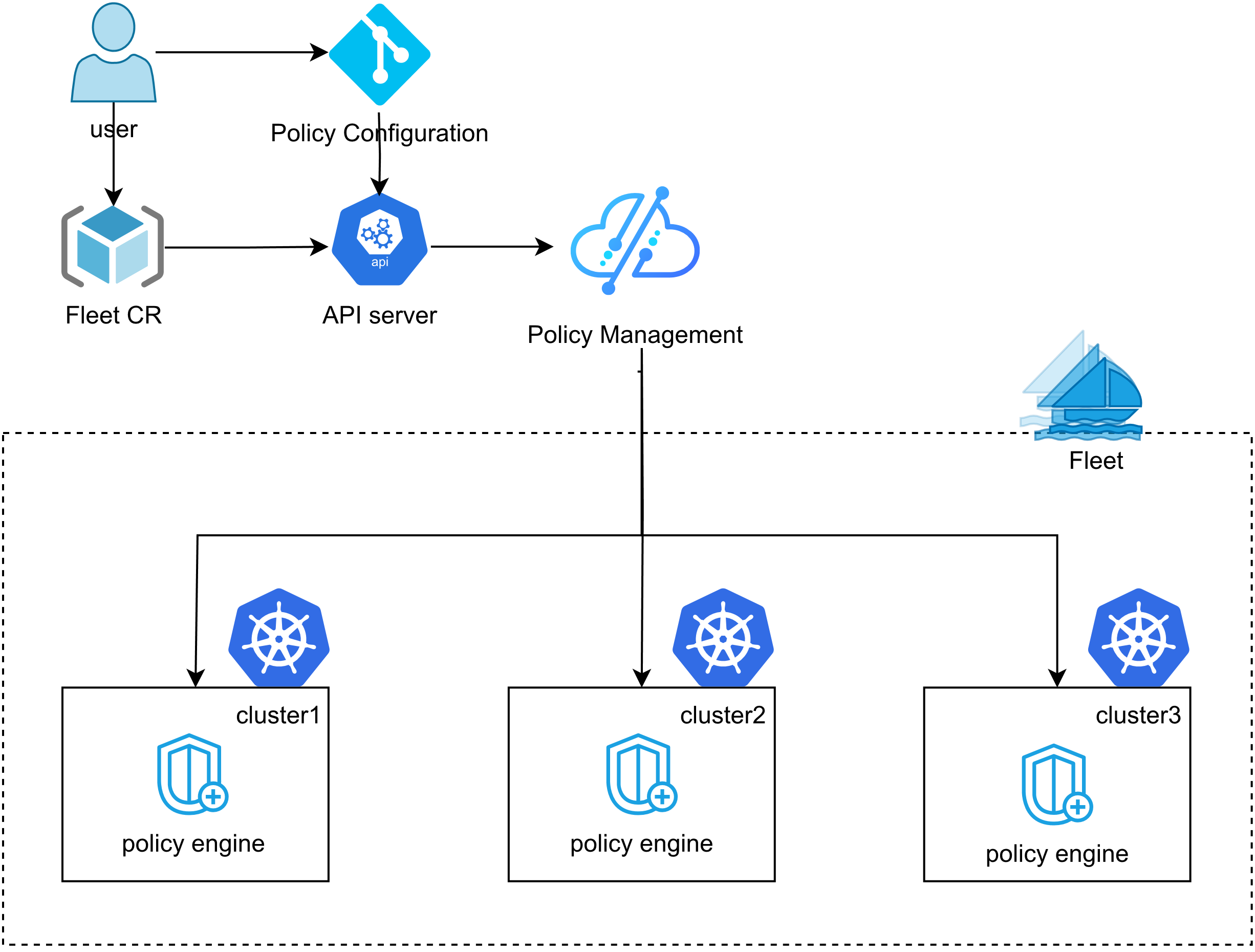

3.4 统一策略管理与合规性保障

企业环境中,策略一致性至关重要。Kurator集成Kyverno等策略引擎,通过ClusterPolicy在Fleet级别定义统一策略:

# cluster-policy.yaml

apiVersion: policies.kurator.dev/v1alpha1

kind: ClusterPolicy

meta

name: require-namespace-labels

spec:

fleetSelector:

matchLabels:

environment: production

policy:

validationFailureAction: enforce

rules:

- name: check-namespace-labels

match:

any:

- resources:

kinds:

- Namespace

validate:

message: "Namespaces must have team and application labels"

pattern:

meta

labels:

team: "?*"

application: "?*"

这类策略确保所有成员集群符合企业安全和合规要求,大大降低了管理复杂性。

4. Karmada集成:跨集群应用分发与弹性伸缩

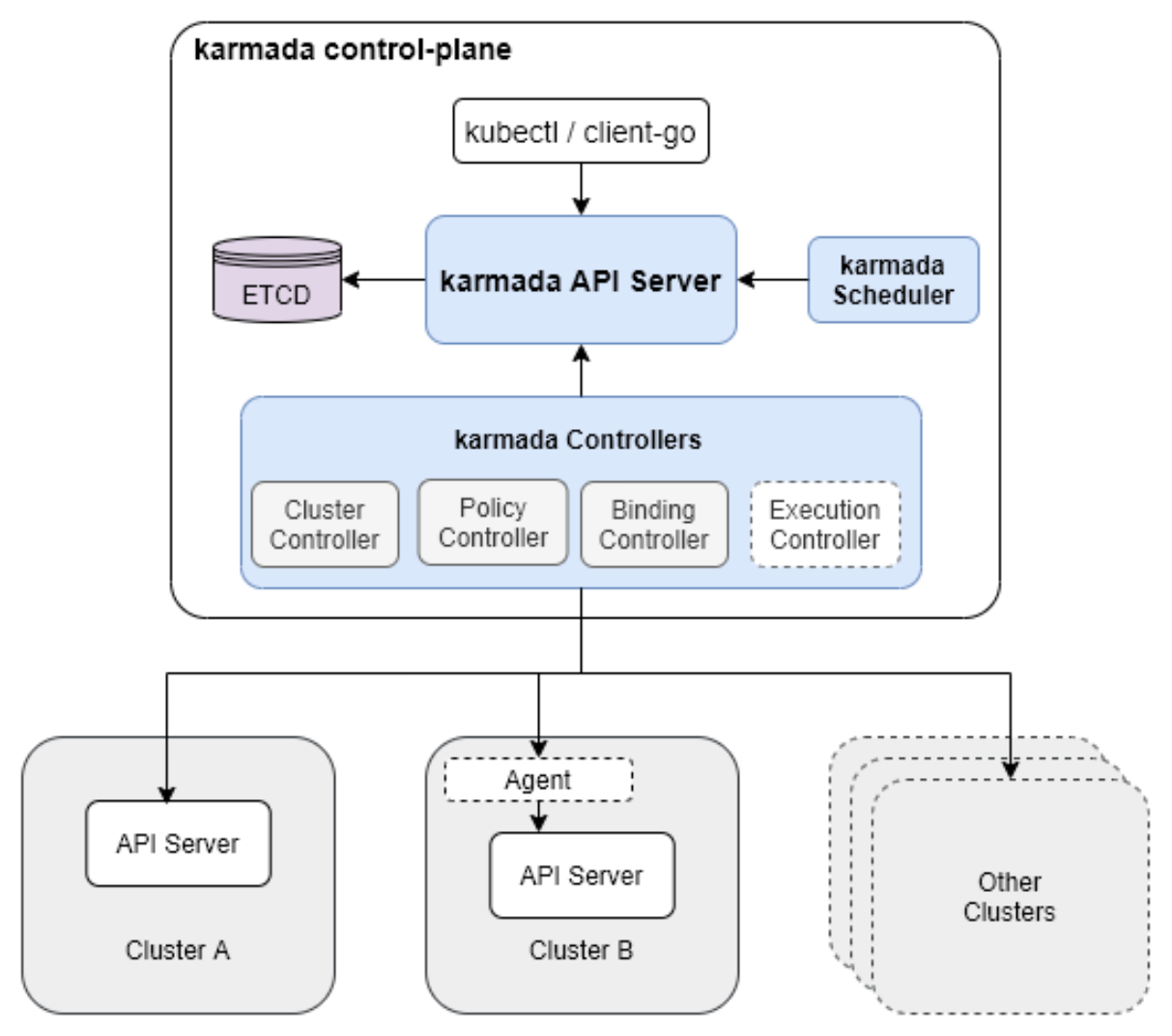

4.1 Karmada与Kurator的协同架构

Karmada作为CNCF孵化项目,专注于多集群调度和应用分发。Kurator深度集成Karmada,将其作为跨集群应用管理的核心引擎。Kurator负责上层抽象和用户体验,Karmada处理底层调度复杂性,两者形成完美互补。这种架构使用户既能享受Karmada的强大能力,又无需直接面对其复杂配置。

4.2 应用分发策略设计

在Kurator中,通过PropagationPolicy定义应用如何分发到成员集群:

# propagation-policy.yaml

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

metadata:

name: frontend-policy

namespace: default

spec:

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: frontend

placement:

clusterAffinity:

clusterNames:

- cluster-1

- cluster-2

replicaScheduling:

replicaDivisionPreference: Weighted

replicaSchedulingType: Divided

weightList:

- targetCluster:

clusterNames:

- cluster-1

weight: 70

- targetCluster:

clusterNames:

- cluster-2

weight: 30

这种策略不仅指定目标集群,还可配置副本分配比例,实现精细化的流量控制和资源优化。

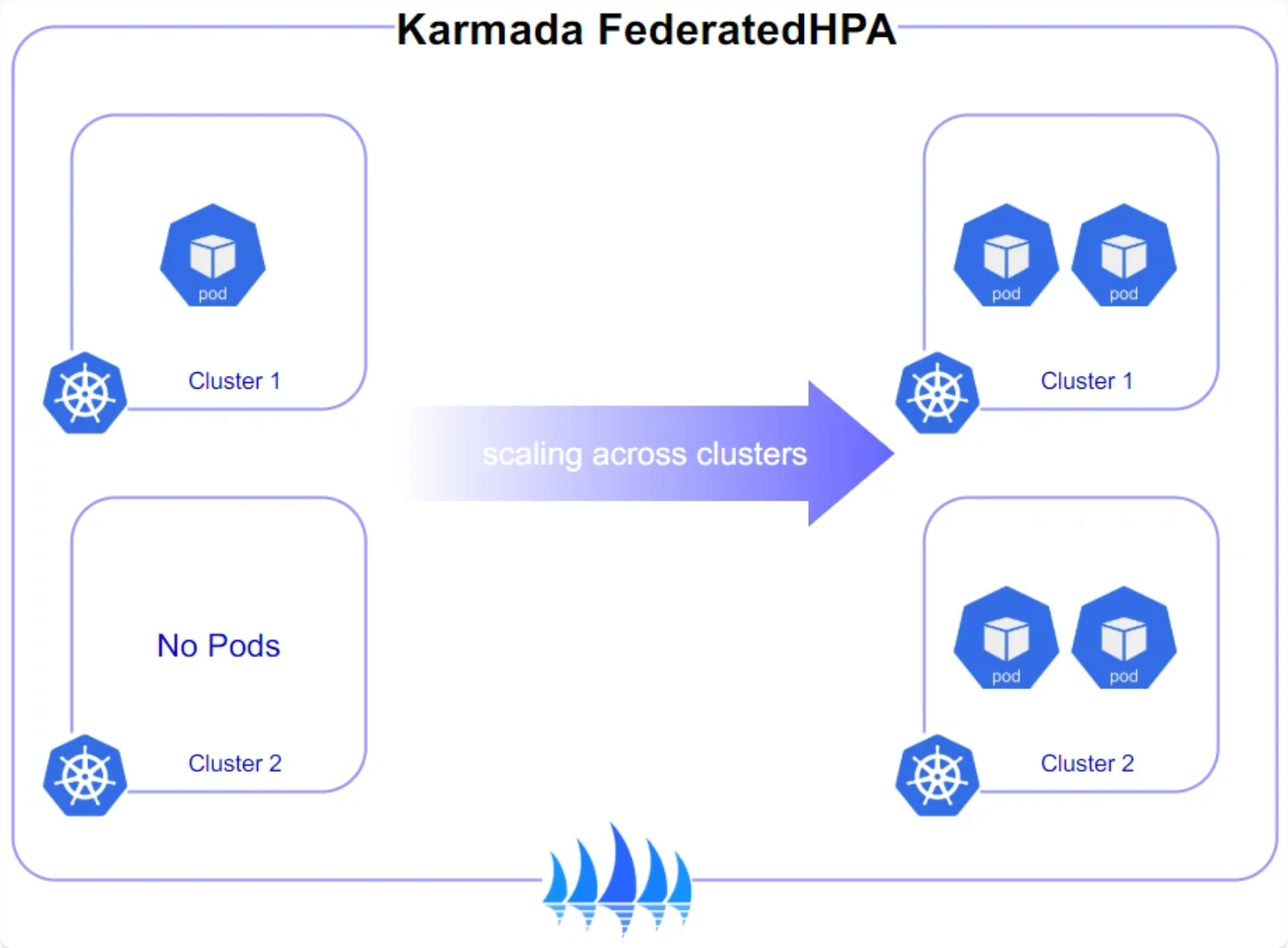

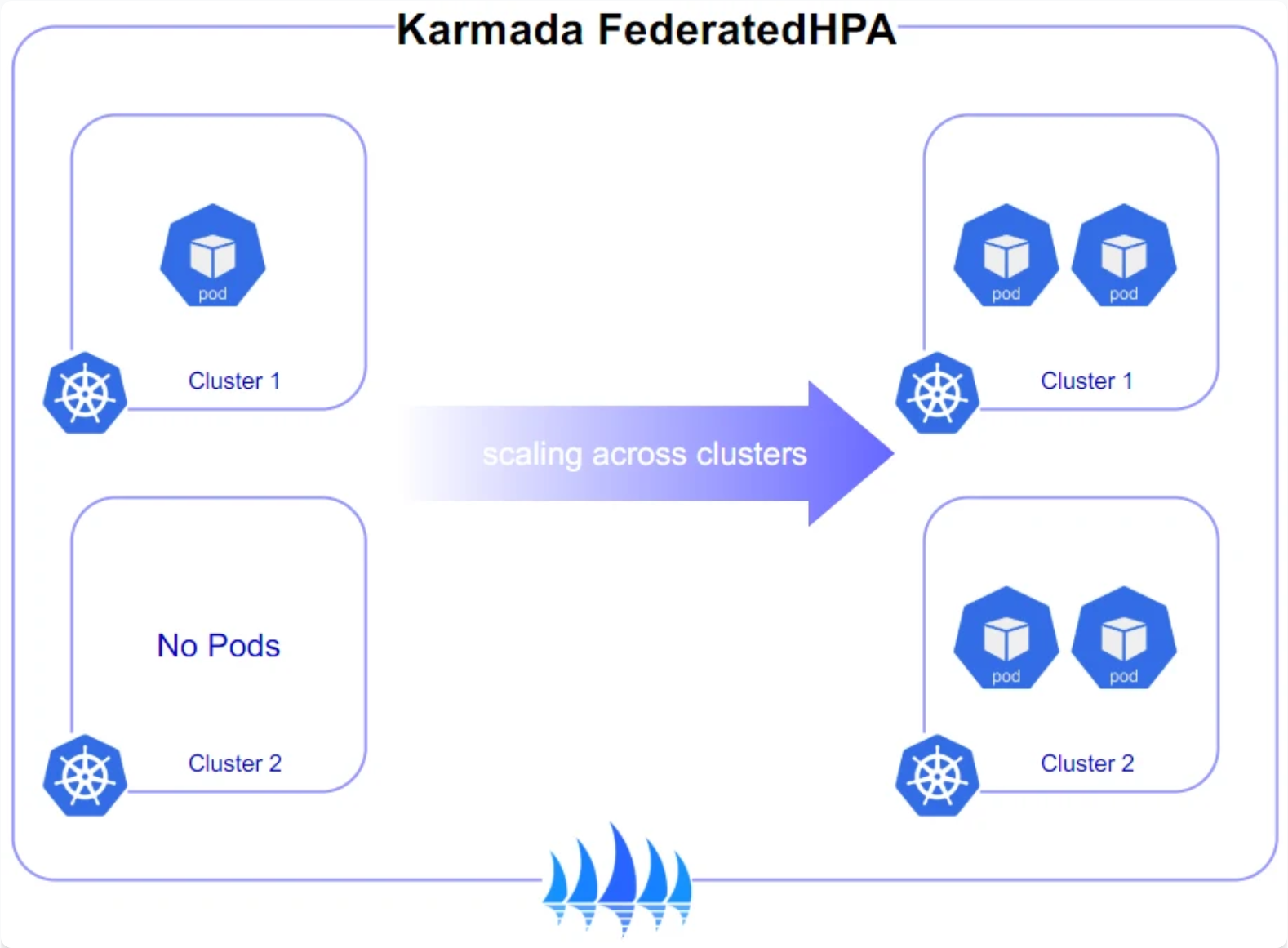

4.3 跨集群弹性伸缩实践

Kurator结合Karmada和HPA,实现真正的跨集群弹性伸缩。当单一集群资源不足时,自动将负载分散到其他集群:

# federated-hpa.yaml

apiVersion: autoscaling.karmada.io/v1alpha1

kind: FederatedHorizontalPodAutoscaler

meta

name: frontend-fhpa

namespace: default

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: frontend

minReplicas: 3

maxReplicas: 20

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 50

spreadConstraints:

- maxGroups: 3

topologyKey: cluster

5. 统一流量治理:Istio与金丝雀发布

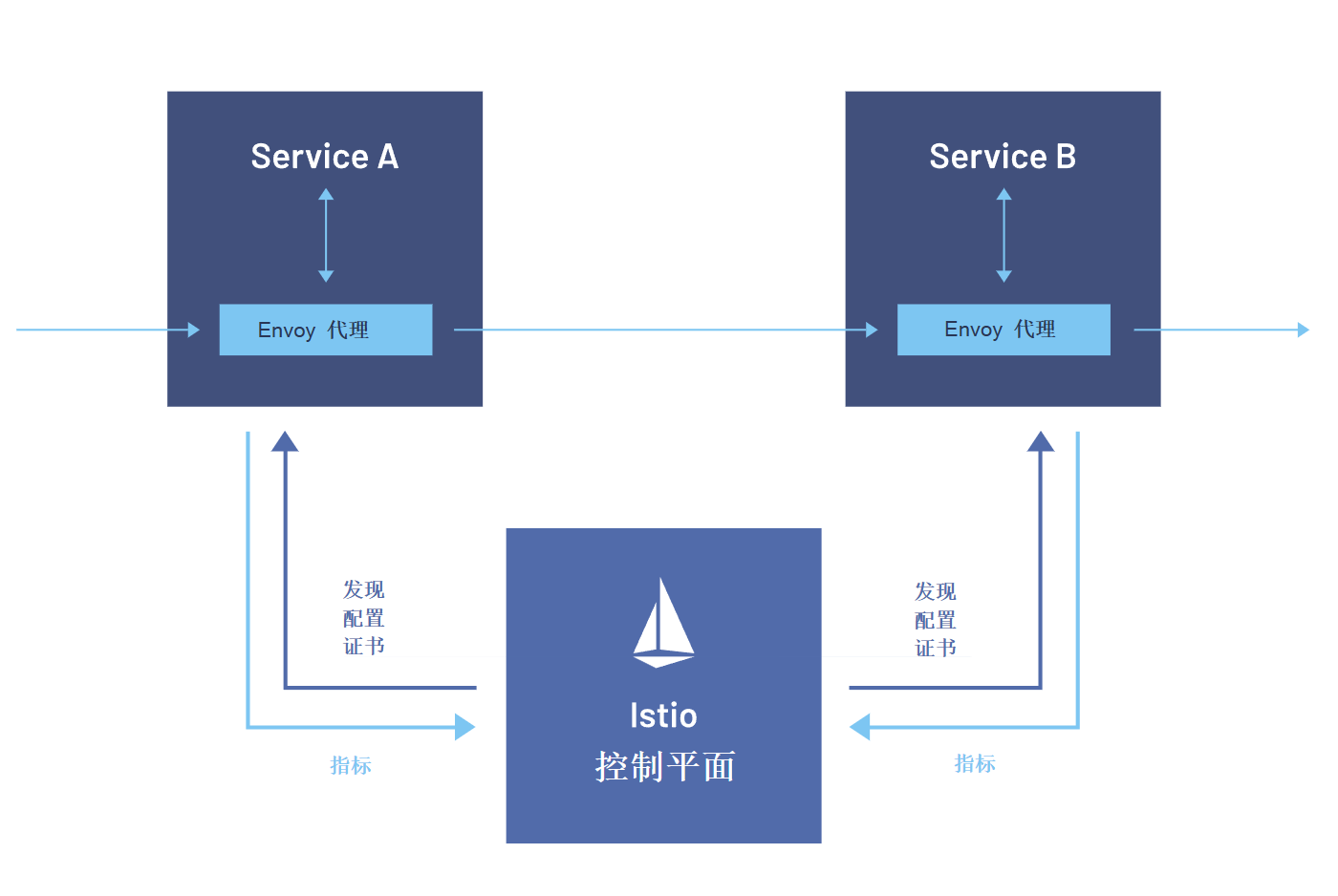

5.1 Kurator流量治理架构

Kurator集成Istio作为服务网格,提供跨集群的统一流量管理能力。不同于单集群Istio部署,Kurator通过多网格控制平面和东西向网关,实现了真正的跨集群服务通信。架构上分为三层:全局控制面(Kurator)、网格控制面(Istio)、数据面(Envoy),各司其职又紧密协同。

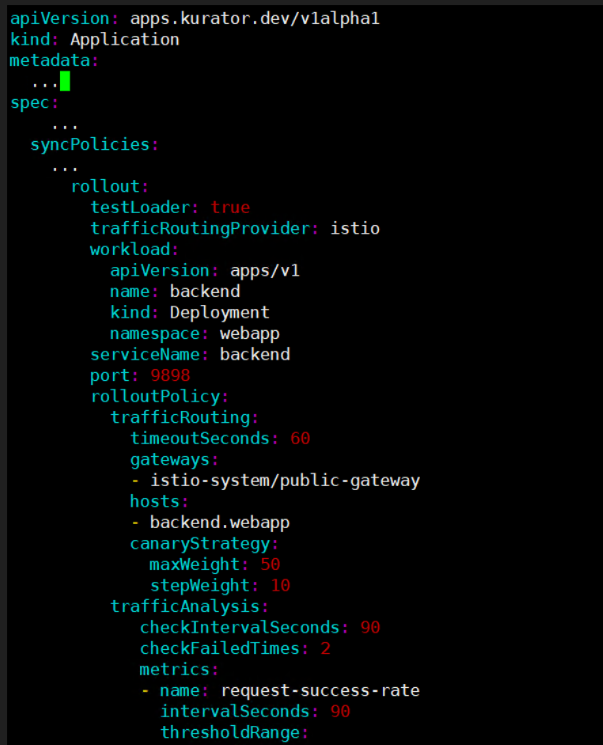

5.2 金丝雀发布配置实践

金丝雀发布是渐进式交付的核心策略。在Kurator中,通过VirtualService和DestinationRule定义流量切分规则:

# canary-release.yaml

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: frontend

namespace: default

spec:

hosts:

- frontend

http:

- route:

- destination:

host: frontend

subset: v1

weight: 90

- destination:

host: frontend

subset: v2

weight: 10

---

apiVersion: networking.istio.io/v1alpha3

kind: DestinationRule

meta

name: frontend

namespace: default

spec:

host: frontend

subsets:

- name: v1

labels:

version: v1

- name: v2

labels:

version: v2

这种配置将10%流量导向新版本,90%保持在稳定版本,根据监控指标动态调整比例,显著降低发布风险。

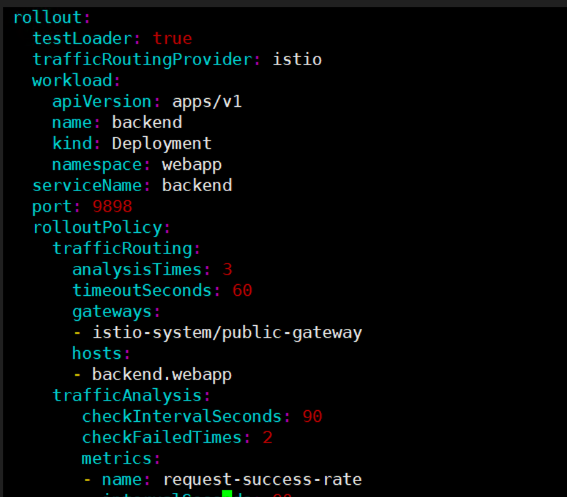

Kurator 配置金丝雀:

5.3 蓝绿发布与A/B测试高级场景

对于更复杂的场景,如蓝绿发布和A/B测试,Kurator提供了更精细的流量控制:

# blue-green-deployment.yaml

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

meta

name: payment-service

namespace: default

spec:

hosts:

- payment

http:

- match:

- headers:

x-user-type:

exact: premium

route:

- destination:

host: payment

subset: blue

- route:

- destination:

host: payment

subset: green

---

apiVersion: testing.kurator.dev/v1alpha1

kind: ABTest

meta

name: checkout-test

namespace: default

spec:

targetService: checkout

variants:

- name: variant-a

weight: 50

headers:

x-variant: a

- name: variant-b

weight: 50

headers:

x-variant: b

metrics:

- name: conversion-rate

query: sum(rate(checkout_success_total[5m])) / sum(rate(checkout_total[5m]))

goal: maximize

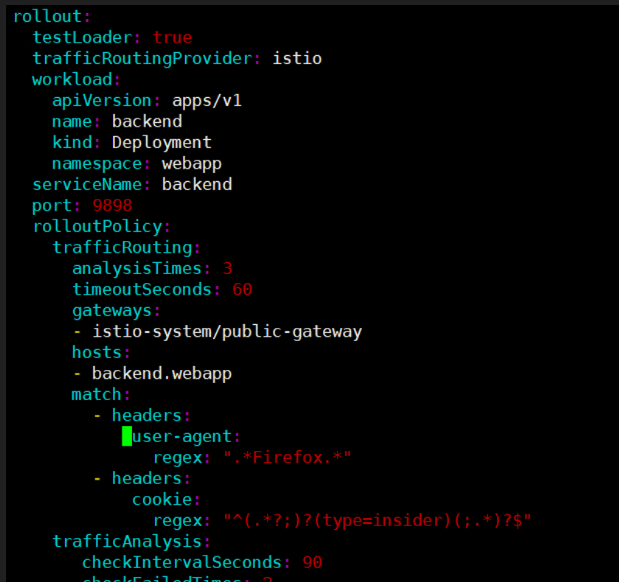

Kurator 配置蓝绿发布: Kurator配置应用的A/B测试:

Kurator配置应用的A/B测试:

5.4 跨集群流量治理的挑战与优化

跨集群流量治理面临网络延迟、故障域隔离等挑战。Kurator通过智能流量路由和熔断机制优化体验:

# cross-cluster-traffic.yaml

apiVersion: networking.istio.io/v1alpha3

kind: ServiceEntry

meta

name: remote-frontend

namespace: default

spec:

hosts:

- frontend.remote

location: MESH_INTERNAL

endpoints:

- address: cluster-2-gateway

ports:

http: 15443

resolution: DNS

---

apiVersion: networking.istio.io/v1alpha3

kind: DestinationRule

meta

name: remote-frontend-dr

namespace: default

spec:

host: frontend.remote

trafficPolicy:

connectionPool:

tcp:

maxConnections: 100

http:

http1MaxPendingRequests: 10

maxRequestsPerConnection: 10

outlierDetection:

consecutive5xxErrors: 5

interval: 30s

baseEjectionTime: 30s

这种配置确保在跨集群通信中,即使某个集群出现故障,也不会导致级联失败,保证了整体系统稳定性。

6. GitOps:声明式应用管理实践

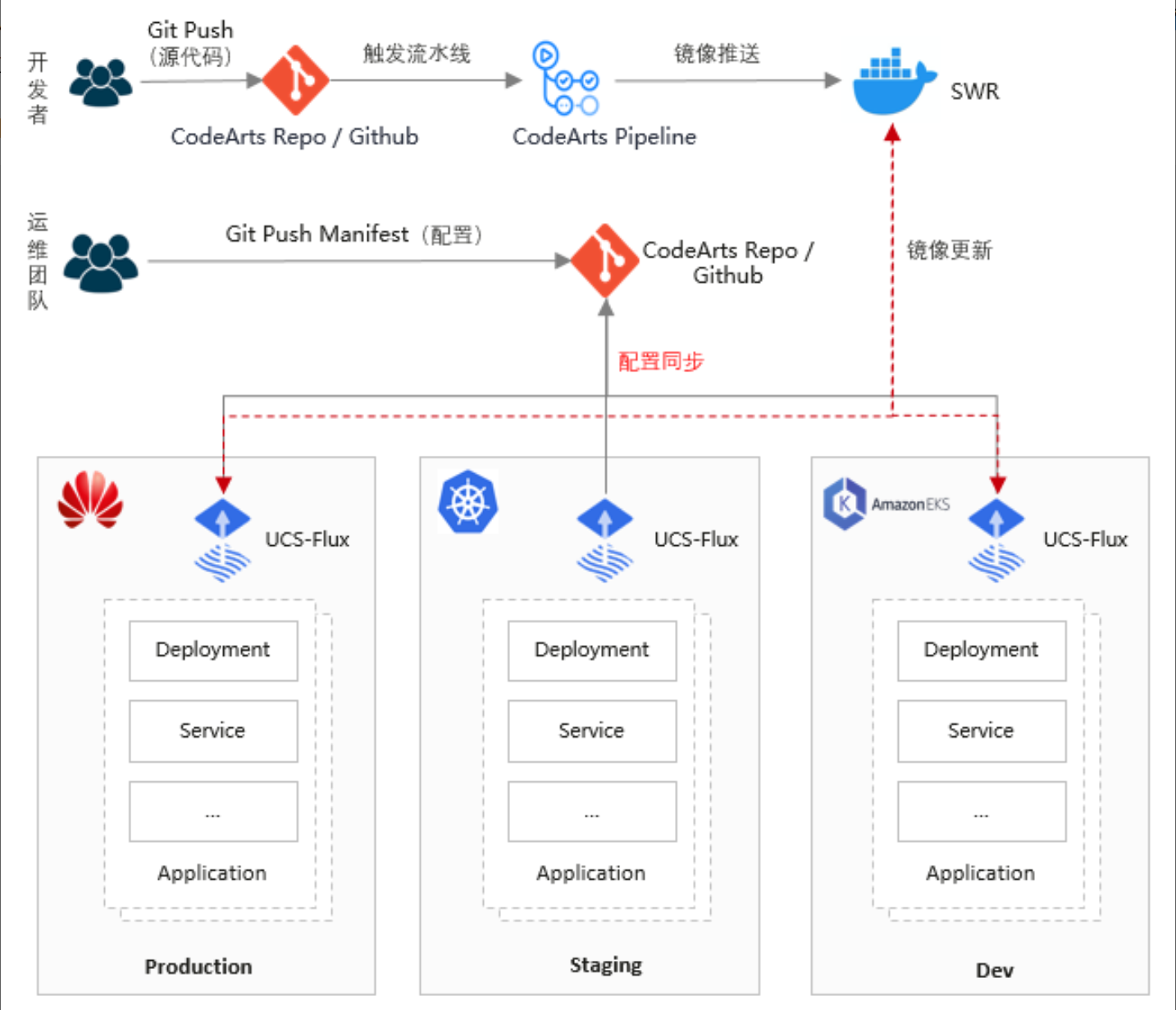

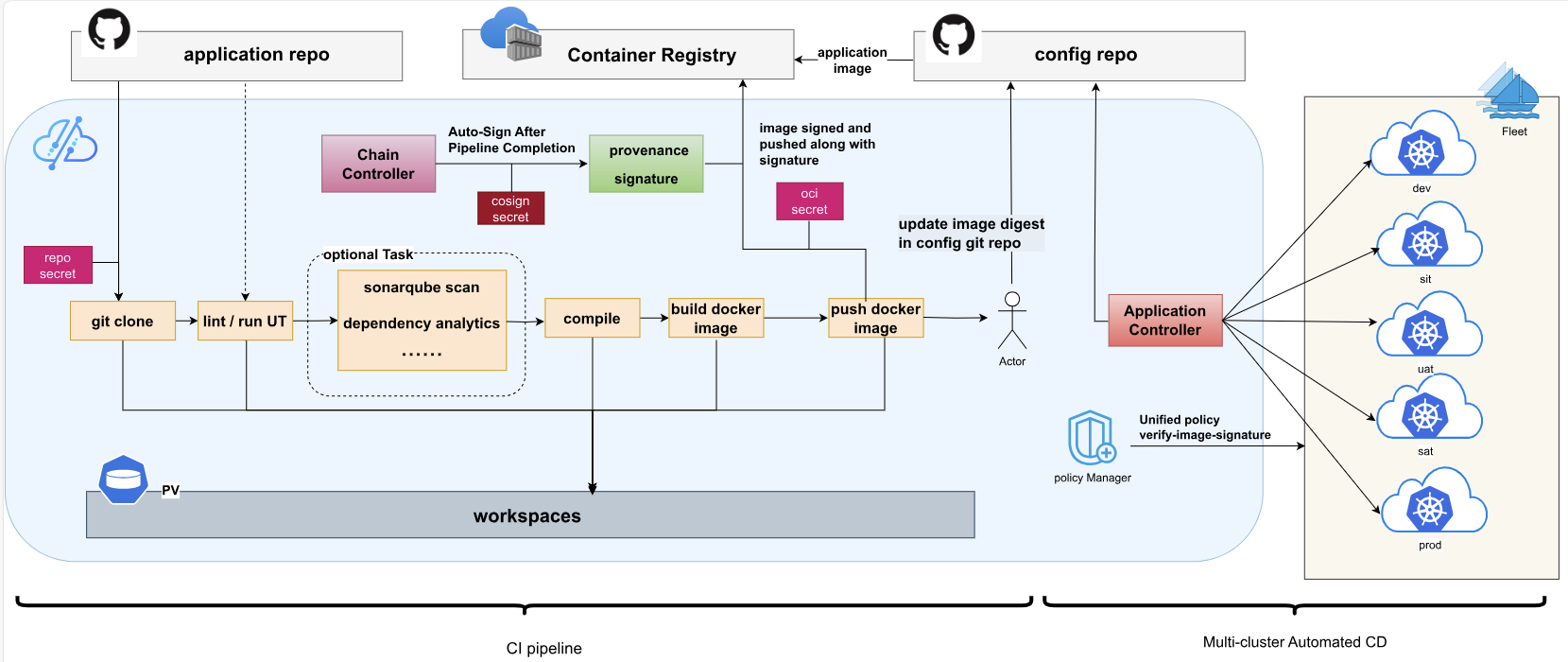

6.1 Kurator GitOps架构解析

Kurator基于FluxCD构建GitOps能力,将Git仓库作为唯一事实源。架构包括:Source Controller(监控Git仓库)、Kustomize Controller(处理Kustomize)、Helm Controller(管理Helm发布)、Notification Controller(事件通知)。这种设计实现了基础设施即代码(IaC)和应用配置即代码(CaC)的统一。

6.2 多环境GitOps仓库设计

企业级GitOps需要精心设计仓库结构。Kurator推荐以下分层结构:

gitops-repo/

├── clusters/

│ ├── production/

│ │ ├── fleet.yaml

│ │ ├── applications/

│ │ │ ├── frontend.yaml

│ │ │ └── backend.yaml

│ │ └── kustomization.yaml

│ └── staging/

│ ├── fleet.yaml

│ └── applications/

├── base/

│ ├── frontend/

│ │ ├── deployment.yaml

│ │ ├── service.yaml

│ │ └── kustomization.yaml

│ └── backend/

├── environments/

│ ├── production.yaml

│ └── staging.yaml

└── flux-system/

├── gotk-components.yaml

├── gotk-sync.yaml

└── kustomization.yaml

这种结构支持环境差异化配置,同时保持代码复用,大幅提升了管理效率。

6.3 自动化CI/CD流水线集成

Kurator与Jenkins、GitHub Actions等CI工具深度集成,构建端到端自动化流水线:

# github-action.yaml

name: Kurator CI/CD Pipeline

on:

push:

branches: [main]

paths:

- 'apps/**'

- 'clusters/**'

jobs:

validate:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Setup Kubeconfig

run: |

mkdir -p ~/.kube

echo "${{ secrets.KUBECONFIG }}" > ~/.kube/config

- name: Validate Kubernetes manifests

run: |

kubectl apply -f apps/ --dry-run=server

deploy:

needs: validate

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v3

- name: Deploy to staging

if: github.ref == 'refs/heads/main'

run: |

kubectl apply -k clusters/staging/applications

promote:

needs: deploy

runs-on: ubuntu-latest

environment: production

steps:

- uses: actions/checkout@v3

- name: Promote to production

run: |

kubectl apply -k clusters/production/applications

env:

KUBECONFIG: ${{ secrets.PROD_KUBECONFIG }}

某制造企业使用此流水线,将应用发布周期从数小时缩短到分钟级,同时通过自动化验证减少了80%的人为错误。

7. Kurator未来发展方向与思考

7.1 边缘计算与云边协同演进

随着5G和IoT技术普及,边缘计算成为新焦点。Kurator将深化与KubeEdge集成,支持轻量级边缘节点管理、边缘自治、云边协同调度等能力。未来版本将提供边缘应用一键分发、边缘数据缓存、边缘AI推理等特性,使企业能够构建真正的云边端一体化架构。

7.2 人工智能驱动的智能运维

AIOps是云原生平台的下一个前沿。Kurator计划集成机器学习能力,实现:

- 智能故障预测:基于历史数据预测潜在故障

- 自动根因分析:当故障发生时自动定位问题根源

- 动态资源优化:根据负载模式自动调整资源分配

- 智能策略推荐:基于最佳实践自动生成安全和性能策略

这些能力将大幅降低运维复杂度,使平台从"自动化"迈向"智能化"。

7.3 多租户与服务网格深度融合

企业环境中,多租户隔离和服务网格深度集成是关键需求。Kurator将加强以下方面:

- 基于身份的访问控制(ID-based RBAC)

- 租户级资源配额和计费

- 跨租户服务通信的安全策略

- 服务网格与应用生命周期管理的统一API

这些改进将使Kurator更适合大型企业和服务提供商使用,成为真正的企业级分布式云原生平台。

7.4 开源生态与标准化建设

作为开源项目,Kurator积极参与CNCF生态建设,致力于:

- 推动多集群管理标准制定

- 与更多CNCF项目深度集成

- 构建活跃的开发者和用户社区

- 提供企业级支持和培训服务

通过标准化和生态建设,Kurator将降低企业采用分布式云原生技术的门槛,加速数字化转型进程。

结语

Kurator作为分布式云原生平台,通过统一的抽象和强大的集成能力,为企业构建现代化基础设施提供了完整解决方案。从环境搭建到高级流量治理,从GitOps实践到智能运维,Kurator展现出强大的技术深度和业务价值。随着云原生技术不断发展,Kurator将持续进化,成为企业数字化转型的关键支撑。技术人员应当深入理解其架构思想,结合企业实际需求,在实践中不断探索和创新,真正发挥分布式云原生的价值。

本文仅是Kurator应用的冰山一角,更多高级特性和最佳实践需要在实际项目中不断积累。期待与各位云原生爱好者共同探索,推动技术进步。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)