【前瞻创想】别再被多云K8s折磨了!手把手教你用Kurator搞定云边协同和流量治理,实操干货

【前瞻创想】别再被多云K8s折磨了!手把手教你用Kurator搞定云边协同和流量治理,实操干货

哈喽各位,又是咱们老生常谈的云原生时间。最近在社区里看到不少兄弟在吐槽:集群多了之后管理简直就是噩梦,什么边缘节点掉线、金丝雀发布流量切不过去、AI任务调度排队排到天荒地老… 真的,这些坑我都踩过。

其实吧,Kurator 这玩意儿也就是为了解决这些破事儿诞生的。它不是想重新发明轮子,而是把 Karmada、KubeEdge、Volcano、Istio 这些业界最能打的组件给你揉在了一起,搞成了一个开箱即用的“全家桶”。今天咱们就不读文档了,我直接带大家把这套环境搭起来,顺便把里头最核心的几个硬骨头——像什么流量路由、云边隧道、还有那个让人头秃的Fleet身份映射——统统嚼碎了喂给你。

第一章:先把地基打牢——搞定云边协同那些事儿

咱们先不谈怎么装Kurator,先聊聊很多人最头疼的KubeEdge云边协同架构。很多时候你觉得Kurator难用,其实是因为没搞懂底下KubeEdge的逻辑。

1.1 云边协同计算场景到底是啥?

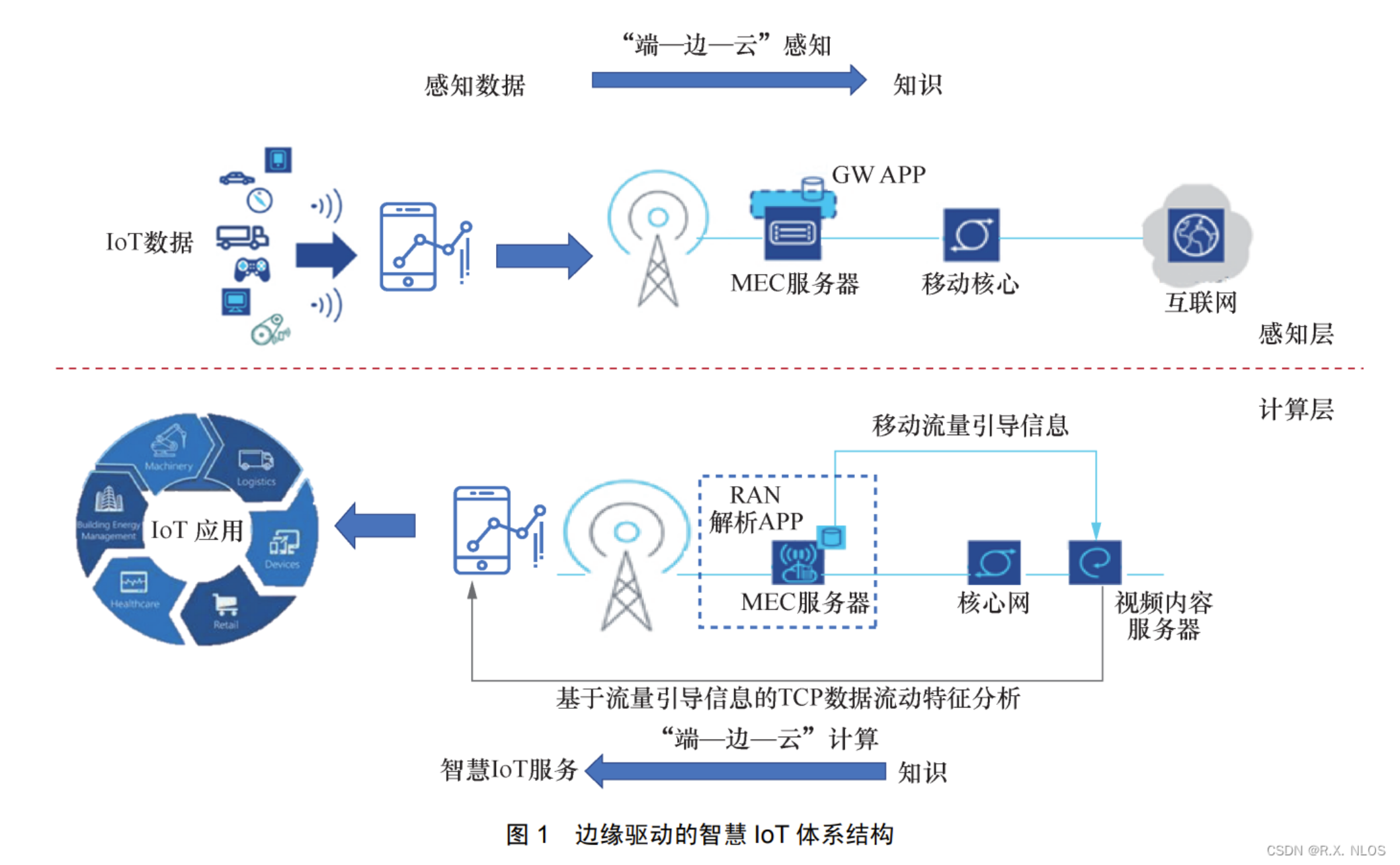

这张图展示了云边协同计算场景:终端数据在边缘侧实时处理,再与云端协同分析,实现低时延、高效率的智能应用,适用于工业、交通等对响应速度要求高的领域:

老铁们,别把云边协同想得太高大上。说白了,就是你的服务器在数据中心(云端),而你的摄像头、机械臂或者传感器在几千公里外的工厂里(边缘端)。

云边协同计算场景最典型的就是:我们在云端用强大的GPU训练AI模型,然后通过Kurator把这个模型下发到边缘节点的树莓派或者Jetson Nano上进行实时推理。边缘端只负责算,算完把结果回传给云端,或者在断网的时候也能自己玩。这就是Kurator在边缘场景最擅长干的事儿。

1.2 KubeEdge的核心组件与隧道机制

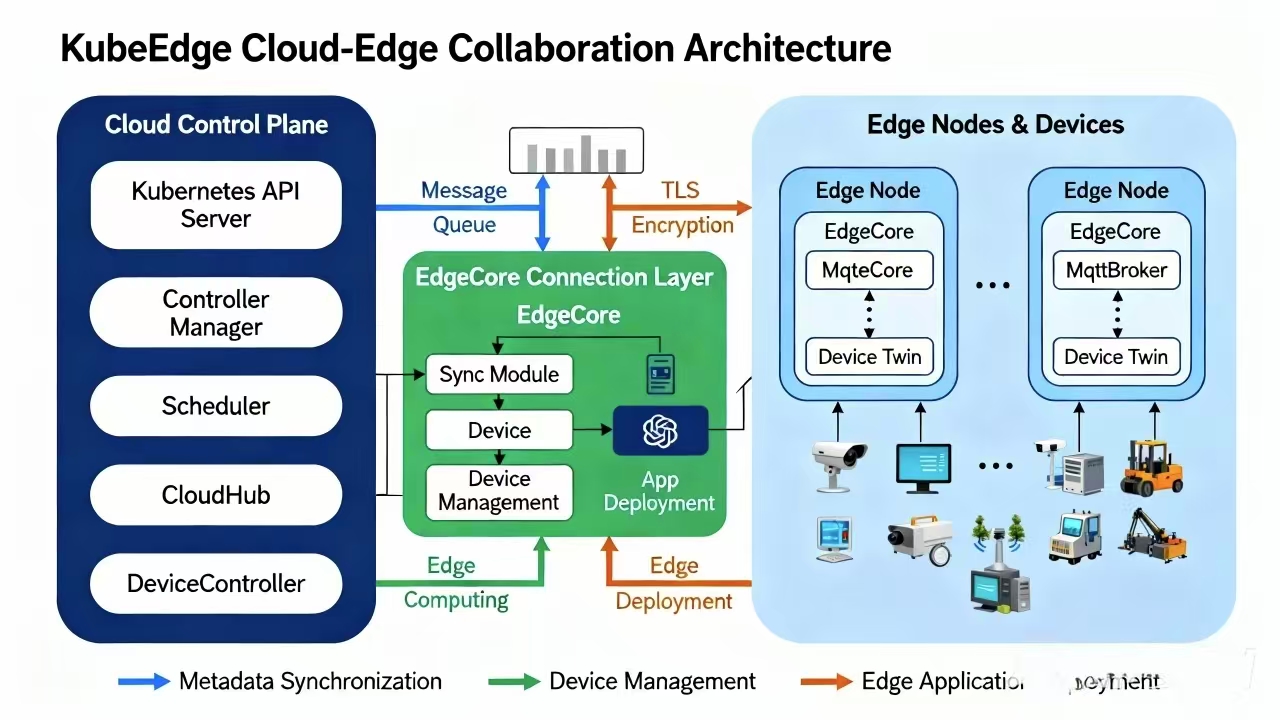

这是KubeEdge云边协同架构的核心组件图,展示了云端控制平面、消息通道与边缘节点的全链路组件及交互方式:

在Kurator集成的KubeEdge里,有两个老大哥你必须认识:CloudCore 和 EdgeCore。

- CloudCore:坐在云端指挥部,负责监听K8s的事件,把指令发下去。

- EdgeCore:蹲在边缘节点,干苦力的,负责管理Pod运行和设备数据。

这里头有个核心技术叫隧道机制。你可能会问,边缘节点通常都在内网,云端怎么连过去?这就靠CloudHub和EdgeHub建立的WebSocket长连接隧道。即使边缘节点没有公网IP,只要它能访问外网,这个隧道就能通。Kurator在部署的时候,会自动帮你配置这些证书和隧道参数,省了你手搓证书的半条命。

1.3 网络连通性排查指南

但实操中,隧道经常断,怎么排查?网络连通性排查一般我用这三板斧:

- 看日志:直接去EdgeCore日志里搜

connect关键字,如果看到Connection refused,多半是云端端口没放行。 - 查CloudCore Service:确保CloudCore暴露的Service(默认10000和10002端口)不仅是ClusterIP,如果是跨公网,得是NodePort或者LoadBalancer。

- 检查Token:边缘节点加入集群是需要Token的,Kurator生成的Token有时候会过期,这也是个坑点。

第二章:环境搭建——别眨眼,这里是起手式

聊完了原理,咱们动手。想玩转Kurator,你得先把它弄到本地。这一步非常关键,很多配置模板都在源码里。

2.1 获取Kurator源码

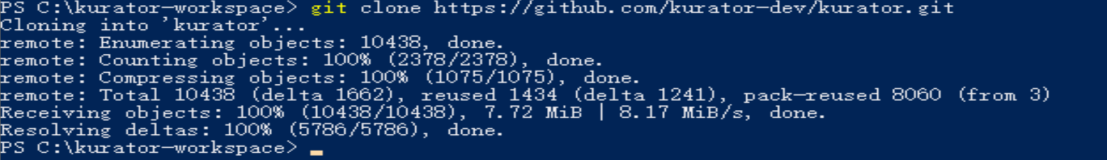

别到处找乱七八糟的包了,直接去GitCode拉最新的源码,因为我们后续的GitOps配置和示例文件都在这。打开你的终端,敲下这一行:

# 兄弟们,这个地址记好了,咱们所有的配置文件模板都在这

# 建议切到一个干净的目录再操作

git clone https://gitcode.com/kurator-dev/kurator.git

cd kurator

# 看看里头的examples目录,咱们后面的操作都要用到

ls -F examples/

如果显示下面的问题

表示没用设置git代理,我们可以先设置git代理;先看一下电脑上的代理端口

再设置git的代理端口,设置成本地代理

git config --global http.proxy http://127.0.0.1:7890

然后再拉取

git clone https://github.com/kurator-dev/kurator.git

就可以拉取资源了,当然也可以换源,你们可以试试

2.2 初始化控制平面

虽然Kurator支持各种安装方式,但我强烈建议你先用Kind或者Minikube在本地起一个控制面集群试手。安装好Kurator Operator之后,它会自动把咱们前面提到的KubeEdge、Volcano这些组件作为Addon装进去。这里我就不废话贴一堆安装日志了,重点是你要确认所有Pod都Running了再进行下一步。

第三章:多集群舰队管理——Fleet与GitOps的艺术

环境好了,现在假设你手头有三个集群:一个控制面,两个工作集群(Cluster-A和Cluster-B)。这时候Kurator的威力才真正显现出来。

3.1 Fleet舰队中命名空间相同性

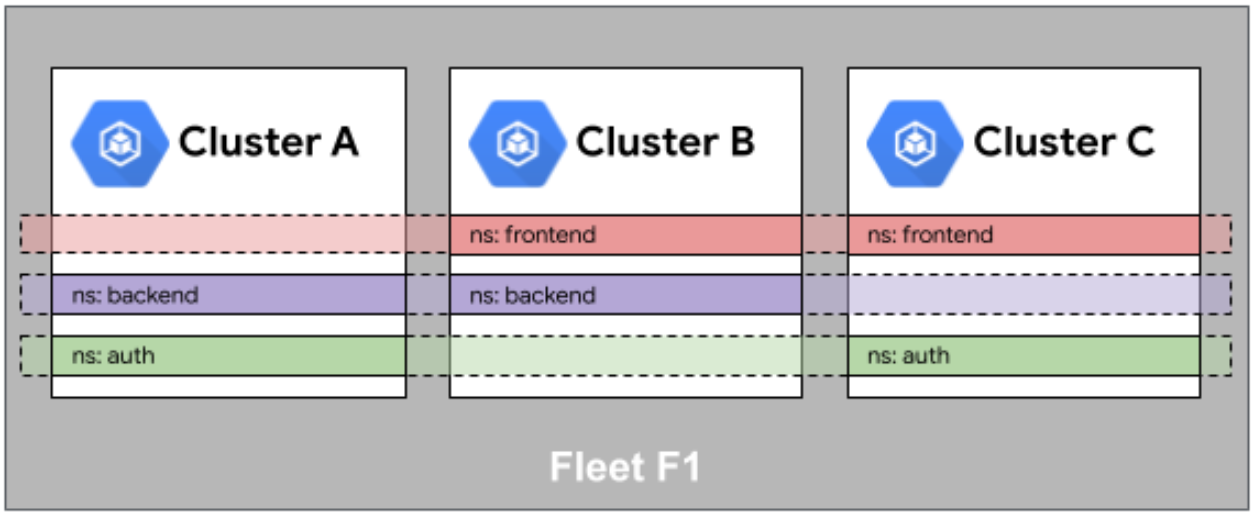

这是Fleet舰队中命名空间相同性的示意图,展示了多集群间命名空间的对齐逻辑与统一编排映射关系:

这个概念听着绕口,其实特好理解。在Fleet舰队中命名空间相同性(Namespace Sameness)意味着:只要你在Kurator控制面创建了一个叫 backend-prod 的Namespace,Kurator就会自动确保你所有的成员集群里都有这个Namespace。

这就解决了“配置漂移”的问题。你不需要去每个集群里手动 kubectl create ns。这对于微服务治理至关重要,因为服务发现通常是基于Namespace的,如果名字对不上,服务直接就找不到家了。

3.2 GitOps实现方式与FluxCD Helm工作流

现在咱们讲讲怎么发布应用。手动Apply YAML那是石器时代的事了,Kurator里咱们用GitOps实现方式。

Kurator集成了FluxCD。它的工作逻辑是:你把K8s的YAML文件推送到Git仓库,FluxCD在集群里有个Controller,大概每隔几分钟就去拉一下代码,发现不一样了就自动同步。

特别是FluxCD Helm应用在多集群环境下的工作流程,这里有个很骚的操作:

- 你在Git仓库里放一个

HelmReleaseCRD文件。 - FluxCD检测到后,不是直接部署,而是生成Chart。

- Kurator的联邦能力会接管这个Chart,根据你定义的“分发策略”(PropagationPolicy),决定是发给Cluster-A还是Cluster-B,或者是两个都发。

这里给大伙看个我手搓的GitOps配置片段,这决定了你的应用怎么同步:

apiVersion: source.toolkit.fluxcd.io/v1beta2

kind: GitRepository

metadata:

name: my-app-repo

namespace: kurator-system

spec:

interval: 1m0s # 既然是实操,我就设短点,1分钟同步一次

url: https://github.com/your-org/your-app-config.git

ref:

branch: main

---

# 下面这个是重点,告诉Flux去哪找Helm Chart

apiVersion: helm.toolkit.fluxcd.io/v1beta2

kind: HelmRelease

metadata:

name: microservice-demo

namespace: kurator-system

spec:

chart:

spec:

chart: ./charts/backend

sourceRef:

kind: GitRepository

name: my-app-repo

interval: 1m0s

# 这里有个坑,Values里的image tag一定要跟你的CI流水线对上

values:

replicaCount: 3

image:

repository: myregistry/backend

tag: "v1.0.2"

3.3 Fleet访问队列外部资源的身份映射

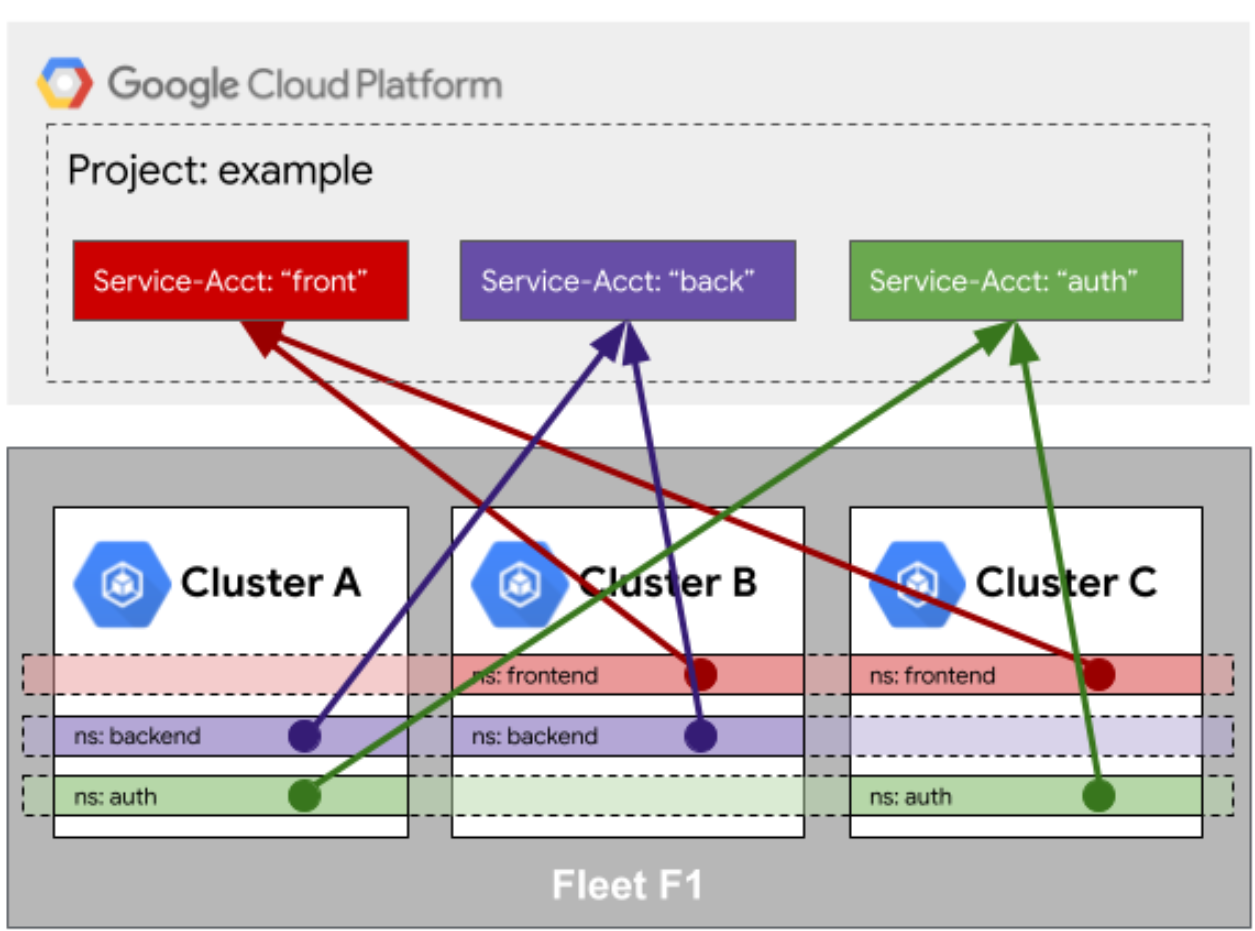

这是Fleet访问队列外部资源的身份映射示意图,展示了跨集群服务与云平台服务账户的统一身份关联机制:

多集群最怕啥?怕权限乱。比如Cluster-A里的Pod想访问AWS上的S3桶,或者阿里云的RDS。你总不能把AK/SK写死在镜像里吧?

这就用到了Fleet访问队列外部资源的身份映射。Kurator利用Workload Identity的思想,把Fleet里的ServiceAccount映射到云厂商的IAM角色上。

简单说,你在Kurator控制面定义一个“身份映射规则”,说:只要是 prod 命名空间下的 data-processor 服务,就有权访问 my-s3-bucket。Kurator会自动把临时的Token注入到成员集群的Pod里。这样,哪怕你的集群跨了三个云厂商,权限管理依然是收敛在Kurator这一处的。

第四章:算力调度——Volcano让资源不再闲置

要是你的业务涉及AI训练或者大数据处理,那原生K8s调度器就是个弟弟。Kurator直接把Volcano给整进来了。

4.1 Volcano中Job、Queue与PodGroup关系

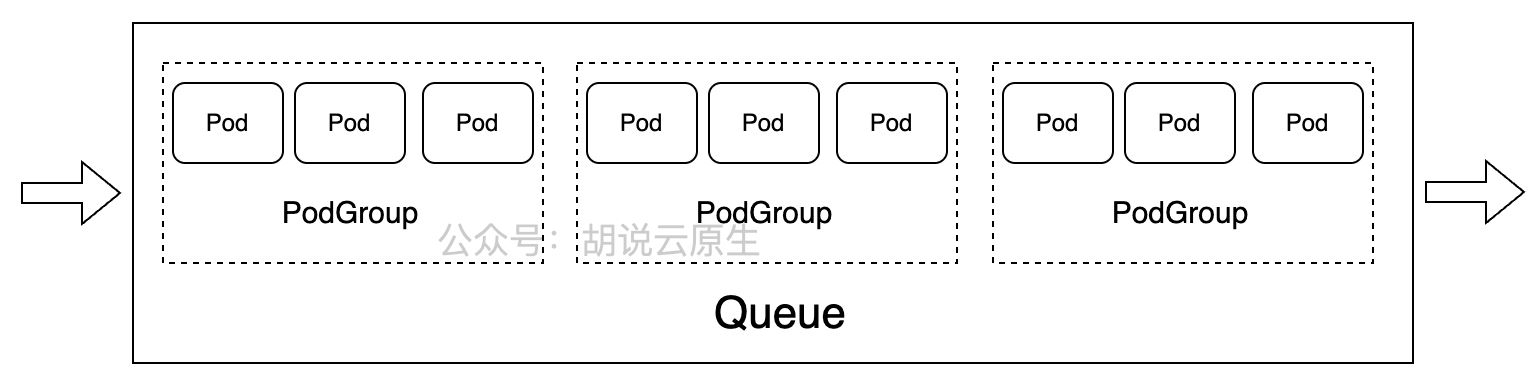

这是Volcano中Job、Queue与PodGroup关系的参考图,直观展示了任务队列如何管理多个PodGroup及其Pod的调度分组:

这三个概念是Volcano的灵魂,搞不清它们就别谈批处理。

- Job:这个大家都懂,就是一次计算任务。

- Queue:这个关键了,它是资源分配的“排队通道”。你可以给研发部一个Queue,给测试部一个Queue,通过权重控制谁的作业优先跑。

- PodGroup:这是个狠角色。原生的Pod是单打独斗的,但AI训练往往需要10个Pod同时启动才能跑(All-or-Nothing)。PodGroup就是把这10个Pod绑成一个团伙。

关系就是:Job提交到Queue里排队,Job创建时会生成一个PodGroup,调度器只有看到PodGroup里要求的最小资源(minMember)都满足了,才会把整个PodGroup放行。

下面这个是我常用的一个Volcano Job配置,专门用来跑那些死贵死贵的GPU任务:

apiVersion: batch.volcano.sh/v1alpha1

kind: Job

metadata:

name: tensorflow-training-job

spec:

minAvailable: 2 # 划重点:至少要有2个Pod能跑,我才开始干活,不然我就死等

schedulerName: volcano

queue: research-queue # 提交到研发队列,权重高

tasks:

- replicas: 1

name: ps # 参数服务器

template:

spec:

containers:

- image: tf-estimator:v1.0

name: ps

command: ["python", "ps.py"]

- replicas: 2

name: worker # 干活的节点

template:

spec:

containers:

- image: tf-estimator:v1.0

name: worker

# 这里要是资源不够,整个Job都会Pending,不会占着茅坑不拉屎

resources:

limits:

nvidia.com/gpu: 1

4.2 Kurator来搭建CI/CD流水线

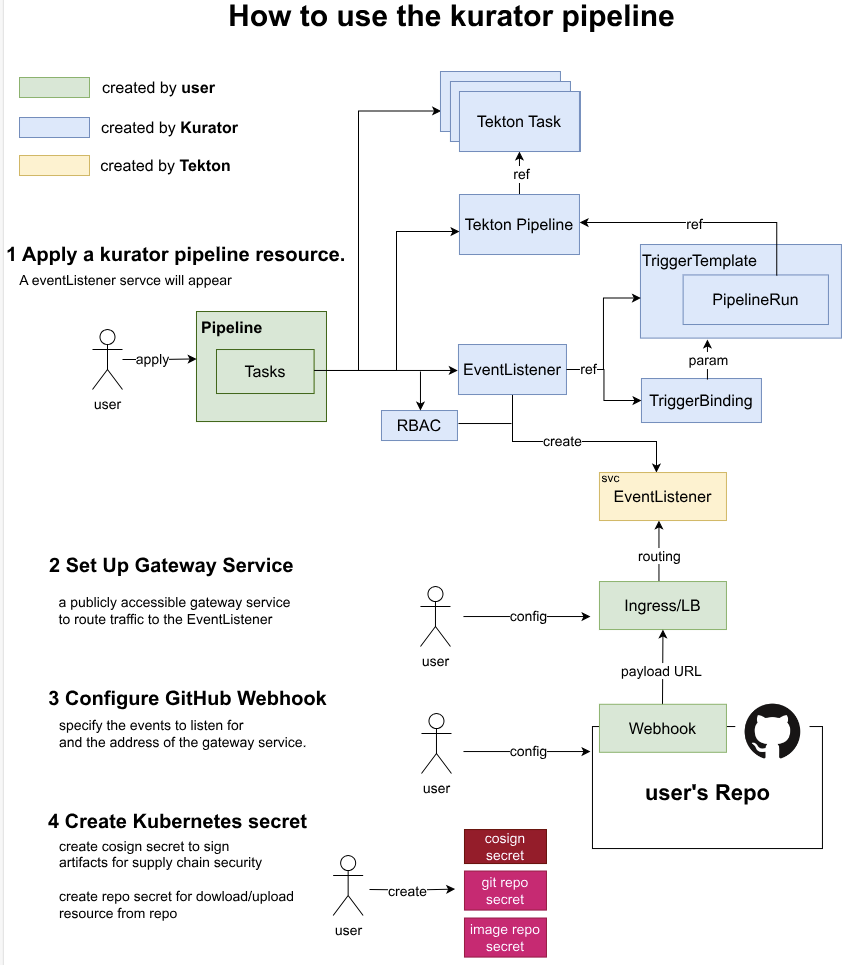

这张图讲的是怎么用Kurator来搭建CI/CD流水线,从配置Pipeline、设置网关、绑定GitHub Webhook,再到创建各种密钥,一步步教你把自动化构建和部署跑起来,整个流程清晰又实用:

除了调度,Kurator还能串联Tekton或者Jenkins来搞定Kurator来搭建CI/CD流水线。

不过Kurator的玩法是“配置即代码”。我们通常会定义一个Pipeline CRD,当代码合并到Main分支时,触发镜像构建,然后自动修改我们上面提到的FluxCD仓库里的Image Tag。这样,从代码提交到多集群同步,整个流程是全自动的闭环。

第五章:流量的大管家——路由与发布

最后,咱们得聊聊流量。服务部署好了,流量怎么进来?怎么做灰度?

5.1 Kurator的流量路由

Kurator并没有重新写一个Ingress Controller,而是基于Istio和Gateway API做了封装。Kurator的流量路由最强的地方在于“多集群路由”。

你可以定义一个全局的Gateway,Kurator会根据Header或者Path,把请求分发到不同集群的Service上。比如 /api/v1 去老集群,/api/v2 去新集群,这对客户端是完全透明的。

5.2 通过Kurator配置金丝雀

在这个基础上,通过Kurator配置金丝雀(Canary Release)就非常丝滑了。你不需要手动改Service的Selector。

你只需要定义一个 Canary 对象,告诉Kurator:“我要把5%的流量切到新版本,如果5分钟内错误率没超过1%,就自动加到20%。”

Kurator会去通过Prometheus拉监控数据,自动调整Istio的VirtualService权重。如果报错了,它还能自动回滚,这就叫“睡得着的发布”。

最后给大伙看个流量切分的配置,这个东西救过我好几次命:

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

metadata:

name: global-route

spec:

hosts:

- "*"

gateways:

- public-gateway

http:

- match:

- uri:

prefix: /payments

route:

- destination:

host: payment-service

subset: v1

weight: 90 # 稳的一批的老版本

- destination:

host: payment-service

subset: v2-canary

weight: 10 # 这里的10%就是金丝雀流量,出事了赶紧把这行改成0

headers:

response:

add:

x-canary-version: "true" # 方便咱们调试的时候看Header

结语

写了这么多,其实就想告诉大家一个理儿:云原生玩到最后,玩的就是资源整合和自动化。Kurator这东西,把KubeEdge的边缘能力、Volcano的算力调度、FluxCD的GitOps流、以及Istio的流量治理给串起来了。

咱们今天讲的从环境搭建、到Fleet管理、再到最后的流量切分,基本涵盖了一个企业级平台落地的全过程。当然,实操中肯定还会有各种奇奇怪怪的报错,比如API版本不兼容啊、边缘节点证书过期啊等等。但只要你掌握了咱们今天聊的这些核心逻辑——身份映射怎么做、隧道怎么通、GitOps流怎么转,剩下的也就是查查Log的事儿了。

行了,代码也给了,逻辑也盘了,剩下的就看各位老铁回去怎么折腾了。有问题咱们评论区见,回见了您嘞!

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献21条内容

已为社区贡献21条内容

所有评论(0)