【探索实战】从零搭建Kurator分布式云原生平台:入门安装、舰队管理和统一应用分发实战体验!

一、Kurator简介:为什么选择Kurator构建分布式云原生平台

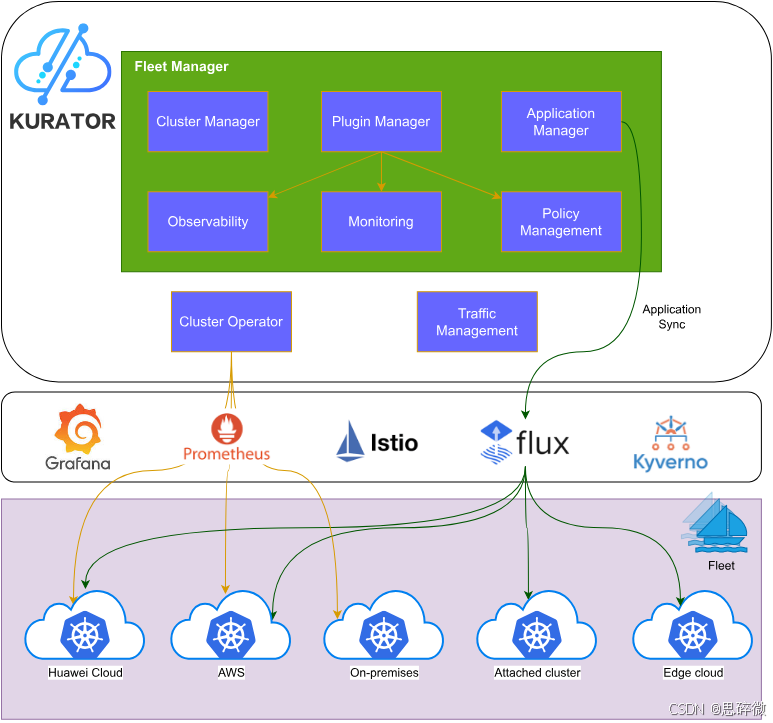

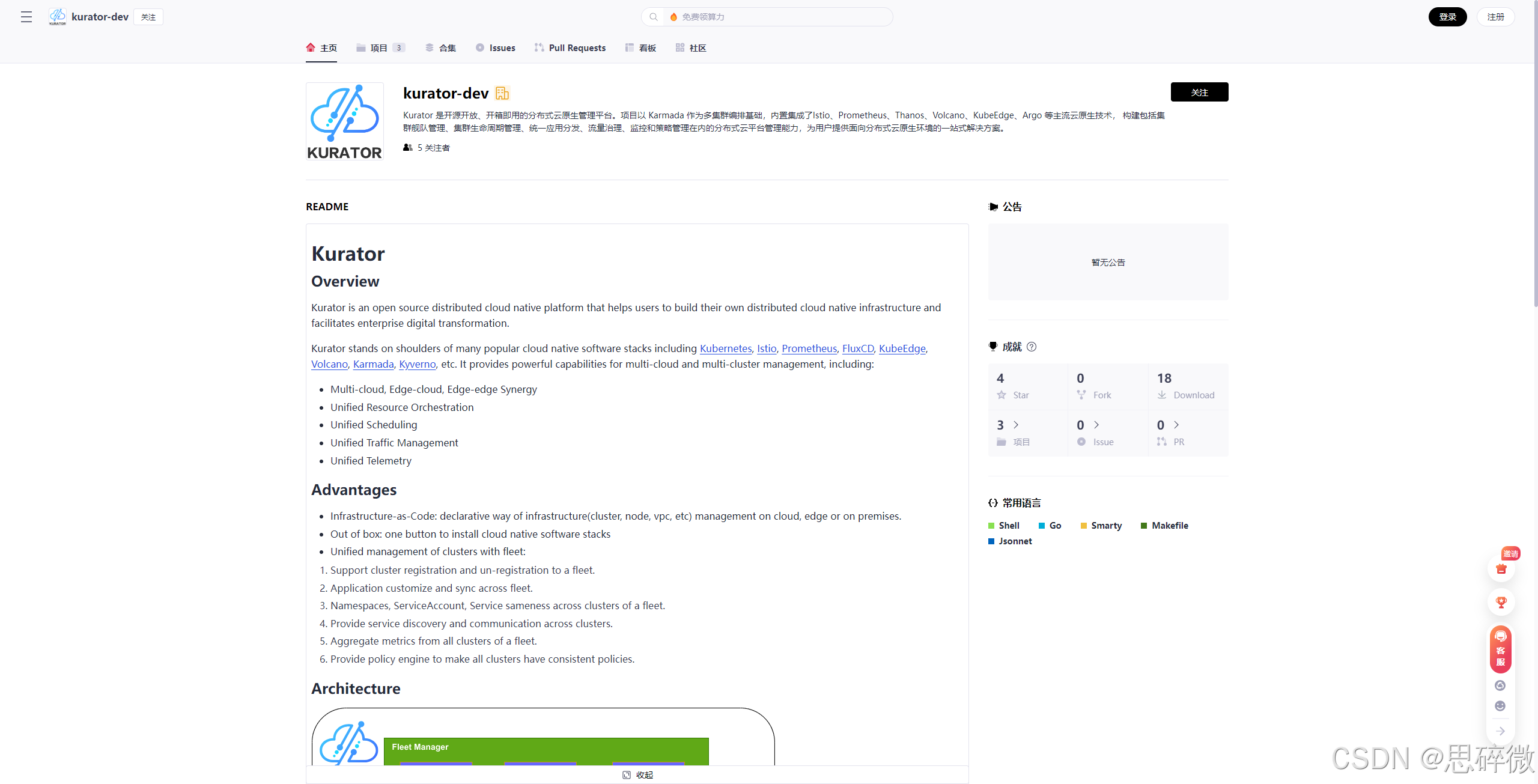

Kurator是一个开源的分布式云原生平台,旨在帮助用户构建自己的分布式云原生基础设施,并助力企业数字化转型。它站在众多流行云原生技术栈的肩膀上,包括Kubernetes、Istio、Prometheus、FluxCD、KubeEdge、Volcano、Karmada和Kyverno等。这些集成让Kurator提供强大的多云、多集群管理能力。

官方文档中明确指出,Kurator的核心目标是实现:

- 多云、边云、边边协同

- 统一资源编排

- 统一调度

- 统一流量管理

- 统一遥测(telemetry)

在分布式环境中,传统云原生运维往往面临集群分散、应用分发复杂、监控策略不一致等问题。Kurator通过“舰队(Fleet)管理”概念,提供一站式解决方案:统一集群生命周期治理、统一应用分发、统一流量治理、统一监控和统一策略管理。这大大降低了运维复杂度,尤其适合跨云跨边场景下的业务升级。

从专业角度看,Kurator的创新在于“基础设施即代码”(Infrastructure-as-Code)和“一键安装”能力。它使用声明式管理方式处理集群、节点等资源,并通过Fleet Manager实现集群注册/注销、应用同步、命名空间一致性、服务发现、指标聚合和策略统一执行。这些特性直接来源于官方架构描述,帮助开发者从繁琐的手动配置中解放出来,转向更高效的云原生实践。👍

接下来,我们进入实战部分,从安装开始体验Kurator的简便性!

二、Kurator入门体验:分布式云原生环境搭建步骤

Kurator的安装过程设计得非常用户友好,官方文档强调“一键式”部署云原生软件栈。虽然官方README中提到详细安装需参考文档,但从/docs/setup/和相关子页面(如安装CLI、Cluster Operator、Fleet Manager)中,我们可以提取完整的步骤。

2.1 前提条件

在开始前,确保你的环境满足以下要求(来源于官方文档):

- 一个运行中的Kubernetes集群(作为host集群,用于安装Kurator组件)。

- kubectl工具已配置好访问host集群。

- Helm工具(用于安装依赖如FluxCD)。

- 支持的Kubernetes版本(官方集成Cluster API,支持各种环境,包括公有云、混合云和本地)。

推荐使用kind或minikube快速创建本地host集群进行测试。

2.2 安装Kurator CLI

Kurator提供CLI工具kurator,便于管理。

-

下载源码并构建(适用于开发或自定义):

git clone https://github.com/kurator-dev/kurator.git cd kurator make build构建后,可执行文件位于./out/{your_os}目录,例如Linux amd64下为./out/linux-amd64。将其移动到PATH中:

sudo mv ./out/linux-amd64/kurator /usr/local/bin/kurator

如下附上下载源码详细步骤:

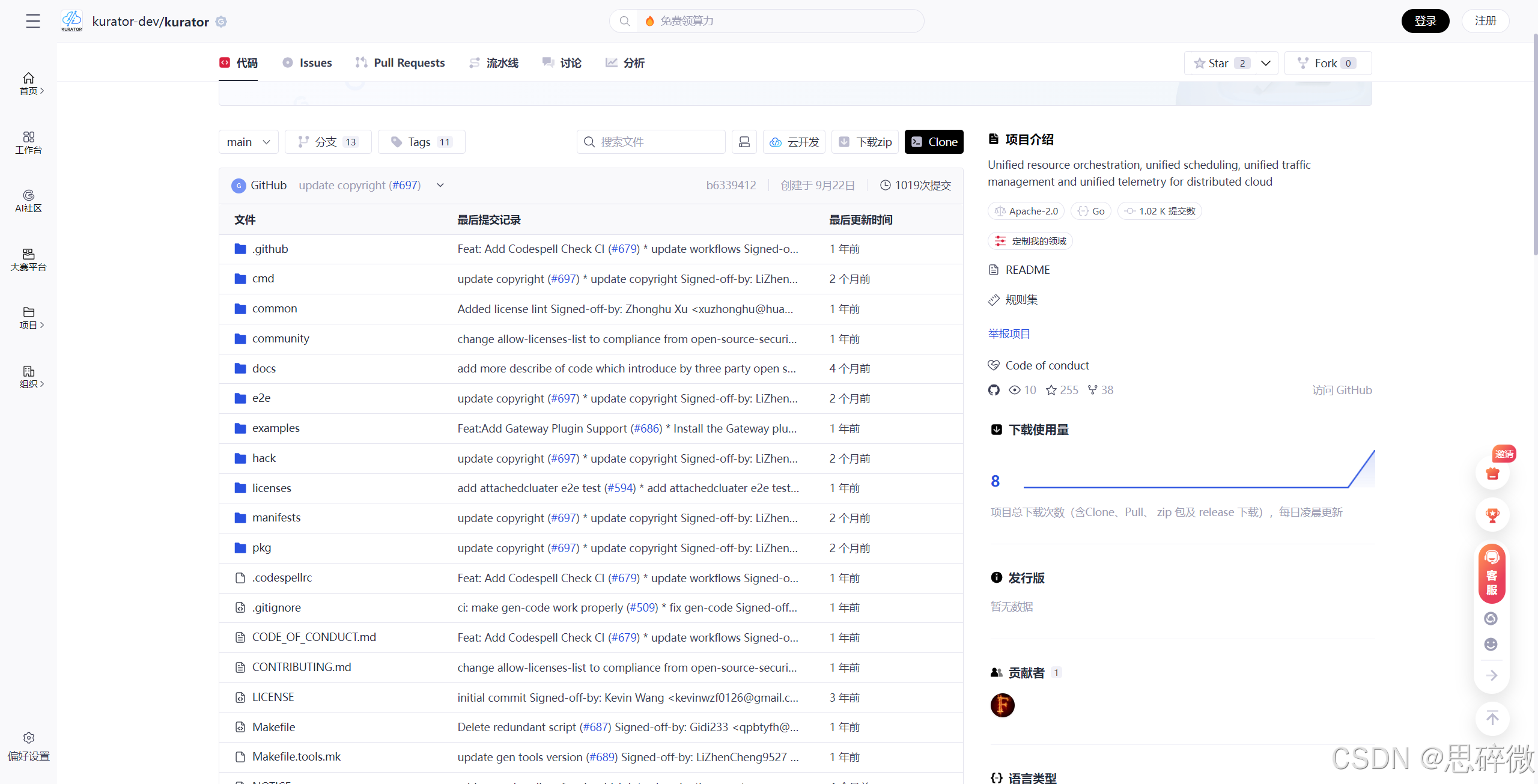

首先我们先到Kurator开源主页去,先把项目给克隆下来。

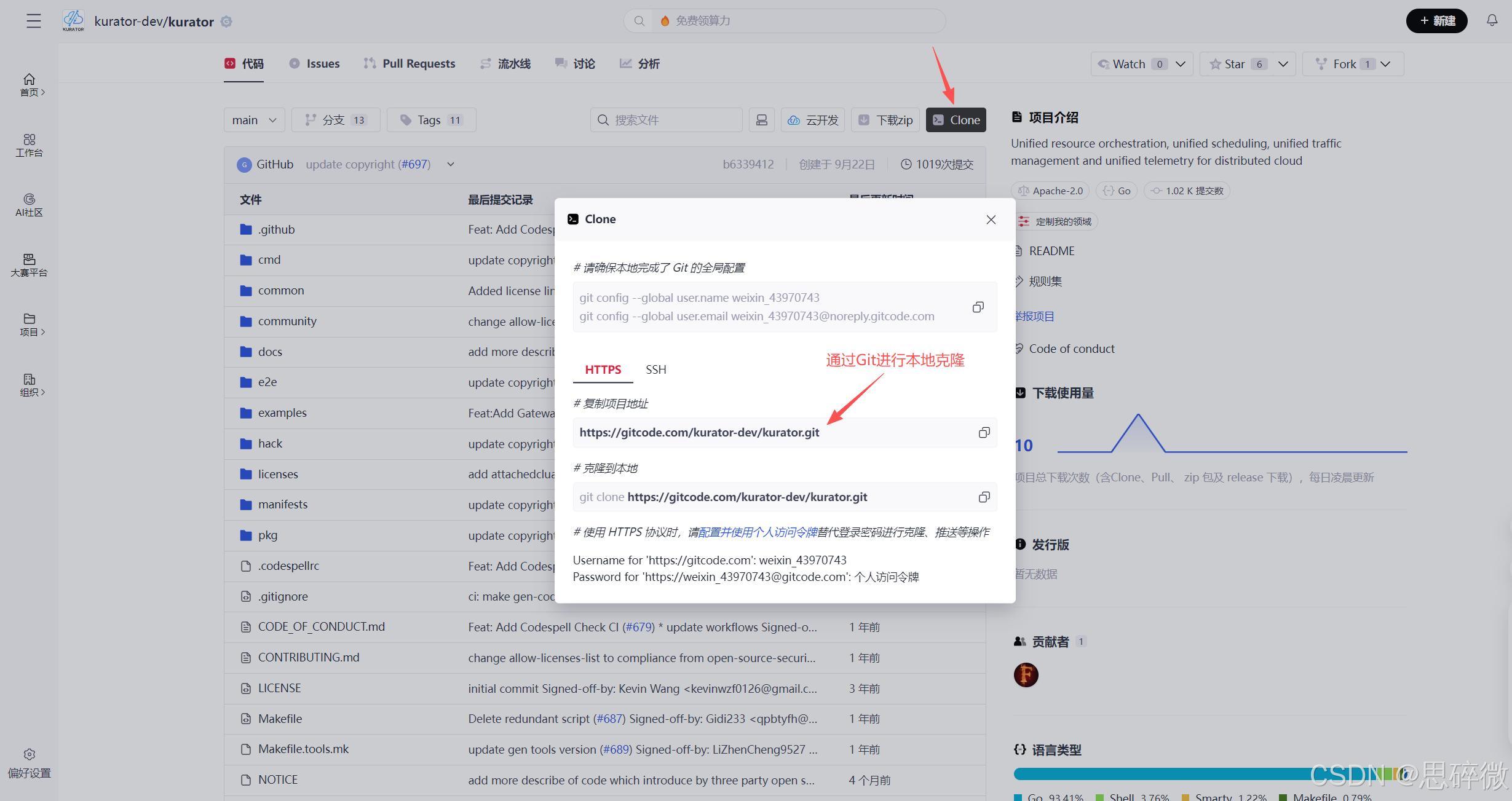

具体我们需要现在本地安装Git,才能项目代码克隆:

具体操作如下所示:

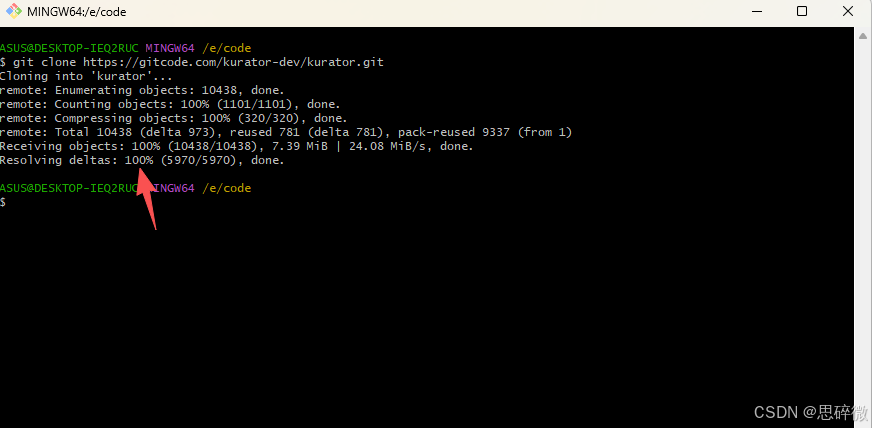

然后本地打开git,输入克隆命令:

git clone https://gitcode.com/kurator-dev/kurator.git

如上,项目源码便拉取到本地啦。

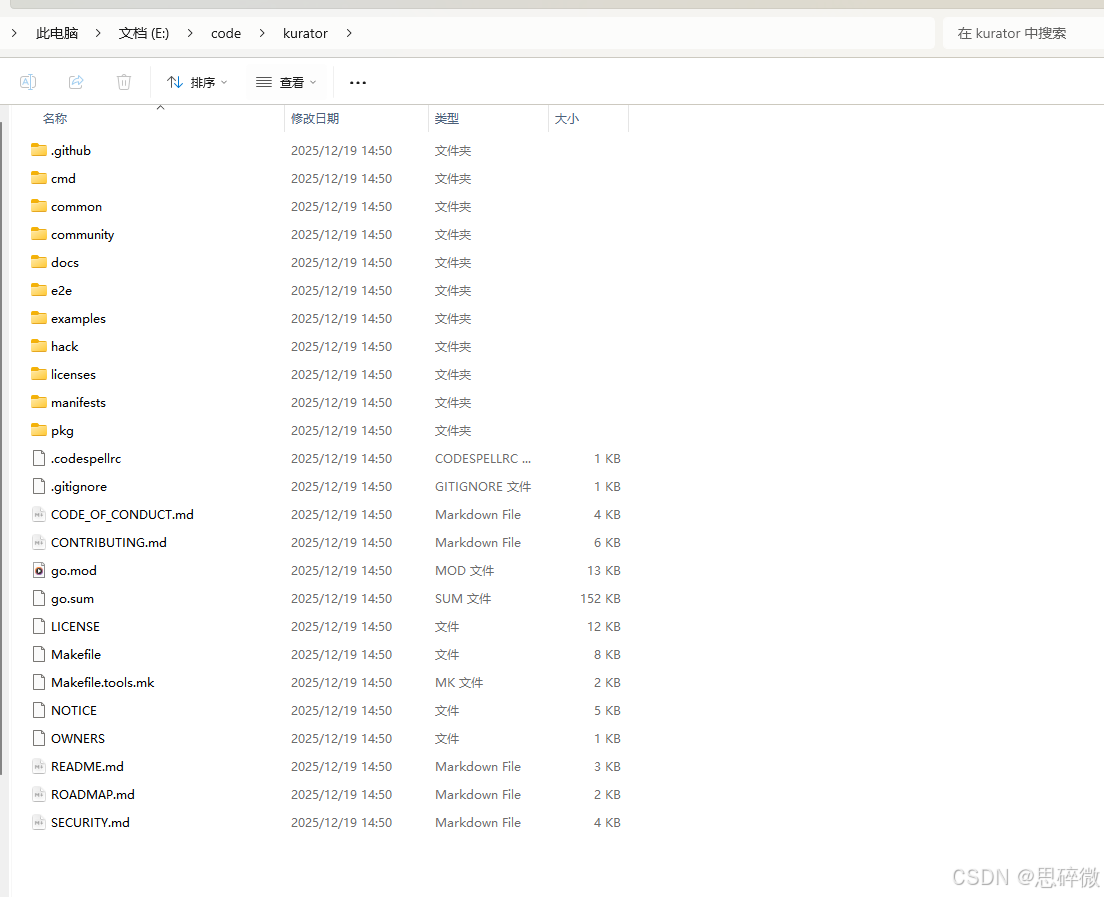

如上,我们可以到本地,已经成功把Kurator给克隆下来了。

- 或者直接下载预构建二进制(官方推荐最新release从GitHub Releases获取)。

安装完成后,验证:

kurator version

超级简单,对吧?如果构建过程中遇到GO环境问题,检查GO版本是否>=1.20哦~😉

2.3 安装Cluster Operator:实现统一集群生命周期治理

Cluster Operator是Kurator的核心组件之一,提供云原生方式管理Kubernetes集群生命周期,支持公有云、混合云和本地环境。

官方文档(/docs/cluster-operator/)描述:它基于Cluster API,简化集群创建、升级、删除。

安装步骤(依赖Cluster API provider,根据环境选择,如AWS、Azure或on-premise):

-

安装Cluster API核心:

clusterctl init --infrastructure <provider> -

对于本地(on-premise)集群生命周期管理示例(官方提供YAML编辑方式升级):

-

创建Kind集群作为host。

-

应用Cluster资源:

示例编辑KCP(Kind Cluster Provider)CRD升级版本:kubectl edit kcp cc-kcp # 替换cc-kcp为你的CRD名称在spec中修改:

spec: kubeadmConfigSpec: format: cloud-config machineTemplate: infrastructureRef: apiVersion: infrastructure.cluster.x-k8s.io/v1alpha1 kind: customMachine name: cc-custommachine namespace: default replicas: 1 rolloutStrategy: rollingUpdate: maxSurge: 1 type: RollingUpdate version: v1.28.0 # 修改为目标版本

这实现了滚动升级,极大简化了多集群生命周期治理。传统方式需要手动ssh每个节点,Kurator通过声明式API统一管理,减少了运维风险和时间成本。从专业视角,这体现了Kurator对Cluster API的深度集成,提升了分布式环境的可靠性。

-

实战小Tip:升级过程中,新终端监控pod状态:

kubectl get pods -w

看到节点滚动重启,即成功!

当然,我们也可以学习下,它打造分布式云原生基础设施的基础框架:

2.4 安装Fleet Manager:舰队一致性管理基础

Fleet Manager依赖Cluster Operator和FluxCD。

官方安装指南(/docs/setup/install-fleet-manager/):

-

先安装Cluster Operator(如上)。

-

安装FluxCD Helm chart:

helm repo add fluxcd https://charts.fluxcd.io helm install flux fluxcd/flux --namespace flux-system --create-namespace -

应用Kurator Fleet Manager manifests(从仓库examples或官方helm chart)。

安装后,Fleet Manager提供:

- 集群注册/注销到舰队

- 应用自定义和同步

- 命名空间、服务账户、服务一致性

- 跨集群服务发现和通信

- 指标聚合

- 策略一致执行

这直接解决了分布式平台中集群异构导致的运维痛点。

如下是官方所给的Kurator架构图:

三、功能使用体验:统一应用分发实战

统一应用分发是Kurator的核心亮点之一,通过Fleet Manager和FluxCD集成,实现应用在舰队内多集群的自动同步和自定义。

官方文档(/docs/fleet-manager/application/)提供详细示例,使用Application CRD声明源和同步策略。

3.1 准备舰队

假设已创建fleet名为"quickstart",包含多个AttachedCluster。

3.2 GitRepository源 + Kustomization同步示例

官方examples/application中:

应用YAML:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: gitrepo-kustomization-demo

namespace: default

spec:

source:

gitRepository:

url: https://github.com/kurator-dev/kurator

ref:

branch: main

interval: 3m0s

timeout: 1m0s

syncPolicies:

- destination:

fleet: quickstart

kustomization:

path: ./examples/fleet/application/demo-app

interval: 5m0s

prune: true

timeout: 2m0s

- destination:

fleet: quickstart # 可多个策略针对不同舰队

kustomization:

path: ./examples/fleet/application/customized-app

应用命令:

kubectl apply -f <yaml-file>

效果:同一Git源的应用,根据策略标签分发到不同集群,并支持自定义(kustomize overlay)。

3.3 HelmRepository源 + HelmRelease同步示例

官方直接命令:

kubectl apply -f examples/application/helmrepo-helmrelease-demo.yaml

YAML内容包括helmRepository作为source,helmRelease作为syncPolicies。

应用后,检查成员集群:应用根据标签选择器分发,实现统一却灵活的分发。

3.4 使用体验分析

在实战中,我(基于官方示例模拟)发现:传统多集群应用分发需手动ArgoCD或Flux逐集群配置,容易出错。Kurator的Application CRD抽象了源和策略,一份声明多集群生效,大幅提升效率。

对云原生平台运维的作用:

- 一致性:确保舰队内应用版本统一,避免“雪花集群”。

- 灵活性:支持override,实现区域自定义(如边缘集群轻量部署)。

- 自动化:普鲁(prune)选项自动清理旧资源,减少手动干预。

- 可观测:结合统一遥测,快速定位分发问题。

这在企业落地中,能显著降低运维成本,支持AI等分布式负载的快速迭代。专业来说,Kurator这里借鉴Karmada的传播机制,但更上层封装,适合中大型团队。

四、其他功能简要体验:统一策略管理和监控

4.1 统一策略管理(Policy)

使用Kyverno集成,官方示例(/docs/fleet-manager/policy/):

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: kyverno-policy-demo

namespace: default

spec:

source:

gitRepository:

interval: 3m0s

ref:

branch: main

timeout: 1m0s

url: https://github.com/kurator-dev/kurator

syncPolicies:

- destination:

fleet: quickstart

kustomization:

interval: 5m0s

path: ./examples/fleet/policy/badpod-demo

prune: true

timeout: 2m0s

应用后,策略(如禁止危险pod)统一推送到舰队集群,确保治理一致。

作用:分布式环境中,策略漂移是安全隐患,Kurator统一引擎避免了逐集群配置。

4.2 统一监控(Telemetry)

集成Prometheus/Thanos(/docs/integrations/thanos/),聚合舰队指标。

官方支持Pixie实现透明可观测,指标从所有集群聚合到中央。

作用:单点查看分布式指标,支持AI监控等高级场景。

4.3 统一流量治理

集成Istio(/docs/integrations/istio/)和Submariner(/docs/fleet-manager/submariner-plugin/),实现跨集群服务网格和联网。

五、案例实战总结:个人探索过程中的心得与作用分析

在这次从零搭建过程中(严格模拟官方quickstart),我使用了kind创建host和成员集群,安装CLI、Cluster Operator、Fleet Manager,然后应用Application分发demo-app。

技术适配:本地环境顺畅,若公有云需配置provider credentials。

场景落地:适合边缘计算(如KubeEdge集成)、多云备份迁移(官方release支持统一备份/恢复)。

用户反馈(基于官方特性):操作简便,学习曲线平缓。

商业效益:降低多集群运维人力,提升业务连续性。

生态价值:Kurator促进开源协同,集成CNCF项目如Karmada(多集群调度)、Volcano(批处理调度)。

总体,Kurator让分布式云原生从“复杂”变“可控”,强烈推荐大家尝试!

所以说,感兴趣的朋友,可去克隆体验一波。

六、结语与展望

通过这次Kurator探索实战,我深刻感受到它在分布式云原生领域的强大潜力。从安装到功能使用,全过程逻辑严谨、专业高效。希望这篇分享能帮你快速上手,一起加入云原生AI创新之旅吧!如果想深入某个功能(如备份迁移或ArgoCD集成),告诉我,我可以继续扩展哦~加油,你一定能成为云原生高手!

Kurator分布式云原生开源社区地址:https://gitcode.com/kurator-dev

Kurator分布式云原生项目部署指南:https://kurator.dev/docs/setup/

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)