还在为多集群管理抓狂?手搓 Kurator 云原生舰队,带你实现从基础架构到流量治理的“降维打击”!

还在为多集群管理抓狂?手搓 Kurator 云原生舰队,带你实现从基础架构到流量治理的“降维打击”!

兄弟们,如果你正在被几十个 K8s 集群折磨得彻夜难眠,一会儿这个集群的网络崩了,一会儿那个集群的存储挂了,那咱今天聊的 Kurator 绝对是你的救星。简单来说,Kurator 就是华为云开源的一套“全能型”多集群管理工具箱。它不只是帮你装个集群那么简单,而是把分布式云原生的那一套复杂逻辑,像拼乐高一样给你整合成了一个整体。

你可以把它想象成一个超级指挥官,它把散落在各处的 K8s 集群编成了一支战无不胜的“航空母舰舰队”(Fleet)。不管你的集群是在私有云、公有云还是边缘侧,Kurator 都能让你像管理一个单集群一样轻松。今天我就作为 Kurator 的老兵,带大家撸起袖子,从零开始手搓一套云原生舰队,把多集群管理这块硬骨头给啃下来!

第一章:别再手动搬砖了,先给你的云原生实验室“打地基” 🏗️

搞技术实操,最忌讳的就是光说不练。咱第一步得把环境支棱起来。Kurator 的设计非常贴心,它不是要把现有的 K8s 体系推倒重来,而是基于社区最成熟的方案(比如 Cluster API、Karmada、Istio)做了一层完美的封装。

1.1 源码在手,天下我有:快速搭建 Kurator 开发环境

咱们手搓的第一步,肯定是先把“兵书”拿下来。Kurator 的源码包里藏着很多自动化的脚本和 Operator 的定义。

在我们开启正式篇章之前,我们先来学习下如何克隆Kurator项目吧,如下附上如何获取Kurator项目详细步骤教程:

我们可直接下载zip压缩包:

直接点击下载:

接下来,我们只需要解压即可。

进去之后,你会发现它的代码结构非常清晰,pkg 目录下全是干货。咱们搭建环境的过程,本质上就是在本地或者控制集群里跑起 Kurator 的控制面,让它具备指挥其他集群的能力。

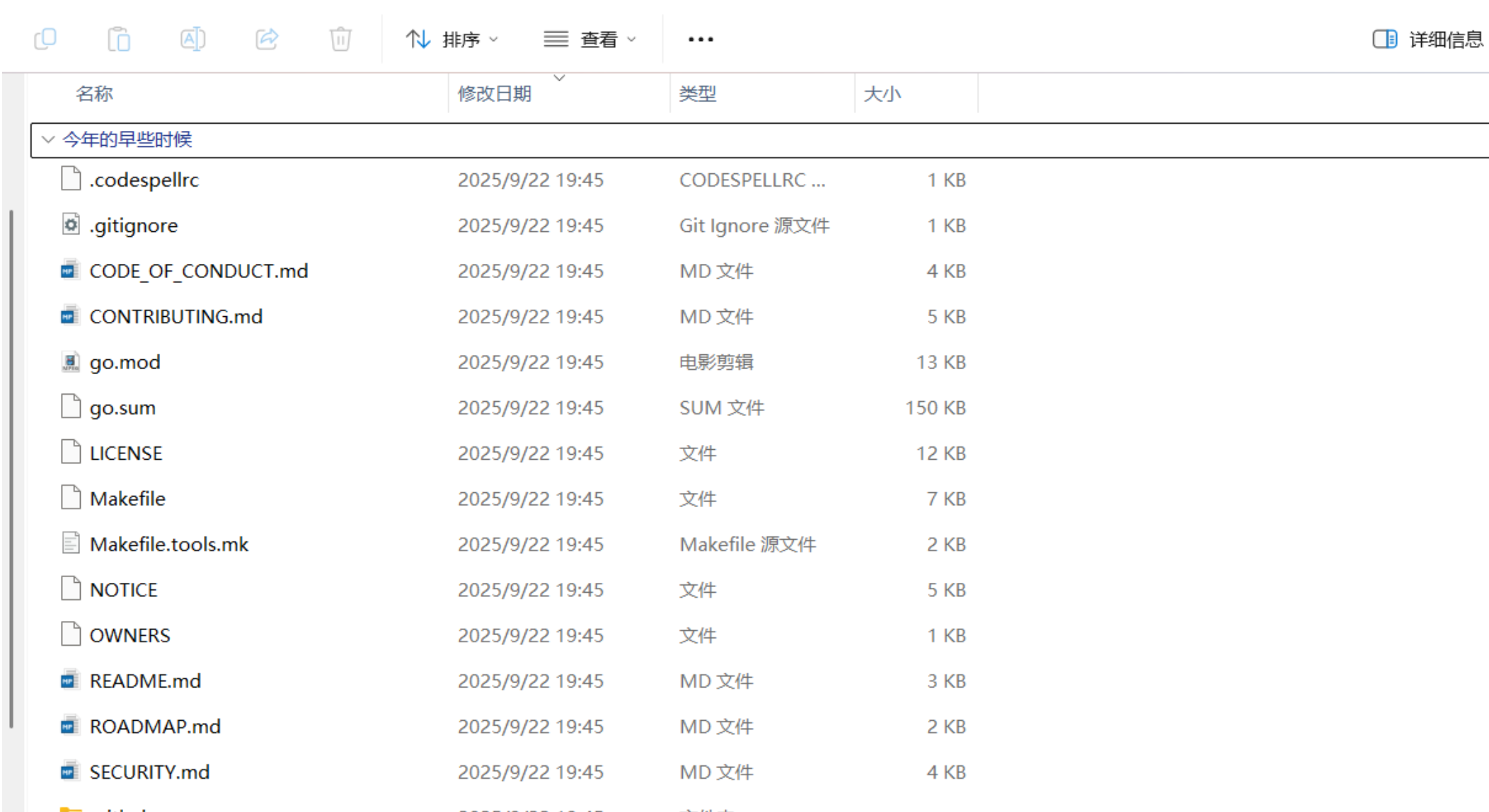

1.2 揭秘 Kurator 平台的总体架构:这套“全家桶”是怎么设计的?

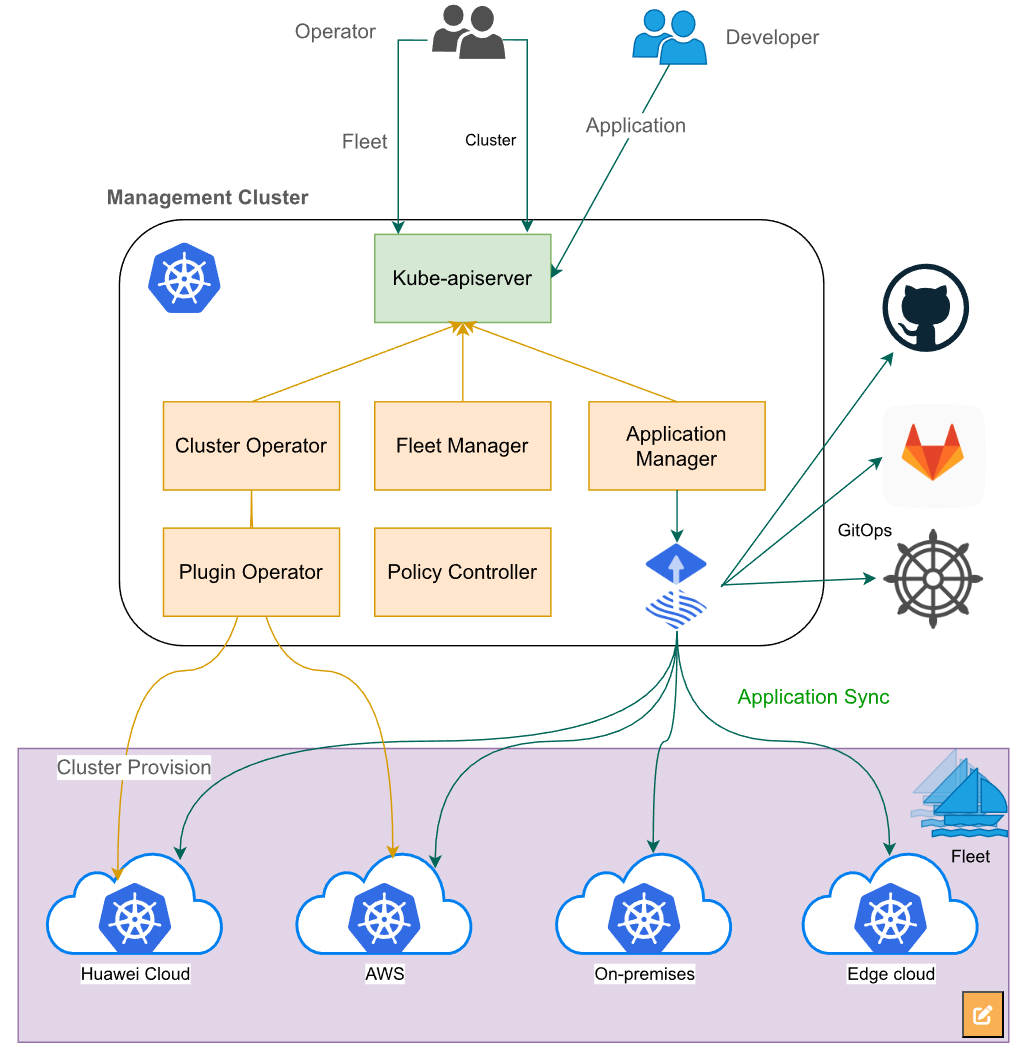

这是Kurator平台的总体架构图,展示了控制平面、集群网络、成员集群及应用层在统一管理框架下的数据流与组件关系:

聊到 Kurator 平台的总体架构,你得把它看成一个“1+N”的结构。

- 1个控制面:也就是咱们的“旗舰”,负责发号施令。

- N个成员集群:那些被管理的 K8s 集群。

这个架构最骚的地方在于它的“模块化”。它集成了 Cluster API 来管集群生命周期,集成了 Karmada 来管应用分发,集成了 Istio 来管网络。它不是简单的堆砌,而是通过一套统一的 API 把这些顶尖的开源项目给“缝合”得天衣无缝。你在用的时候,感受不到是在操作好几个软件,这就是架构的力量。

1.3 Cluster Operator 的实现:集群生命周期的自动导航

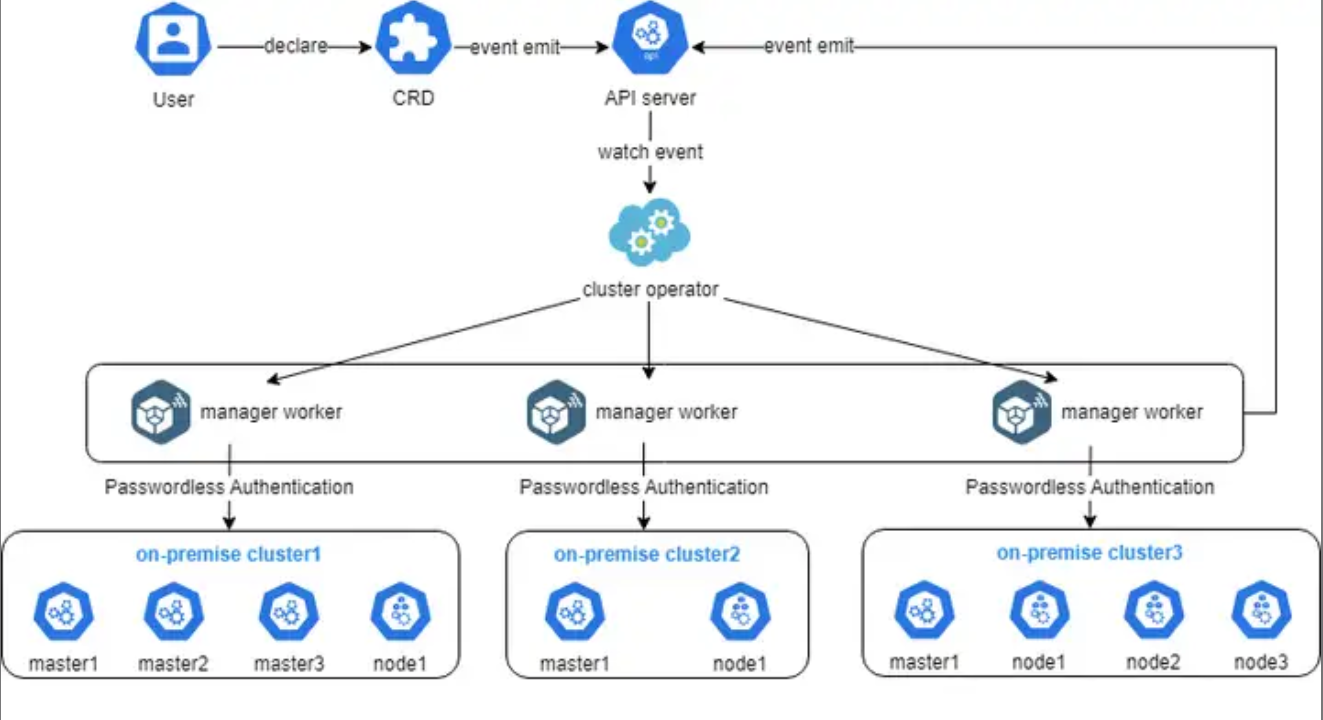

这张图展示了Cluster Operator的实现细节,其实就是用户通过声明一个CRD,触发API Server事件,然后由Operator监听并调度多个管理worker去自动对接和管理不同的本地集群,整个过程用无密码认证打通,既安全又高效:

在 Kurator 里,集群不是手动一个个装的。它是通过 Cluster Operator 的实现 来完成自动化闭环。

简单说,你写一个 YAML,告诉 Operator:“我想要一个在腾讯云上的 3 节点 K8s 集群”。Operator 就会自动去调用底层的 CAPI 接口,去刷系统镜像、装 kubelet、配证书。

这种“声明式”的集群管理,让我们可以像管理 Pod 一样管理集群。集群坏了?删掉 CRD 资源,Operator 自动帮你重建。这才是真正的自动化运维。

第二章:云原生舰队管理,让你的集群“整齐划一” 🚢

环境搭好了,接下来就是要把那些散兵游勇给编成“正规军”。在 Kurator 看来,单独的集群只是点,而“舰队”(Fleet)才是面。

2.1 云原生舰队管理:把你的集群编排成“正规军”

这张图讲的是云原生舰队管理,就是通过一个管理中心集群来统一管理多个下属集群,不管是创建、注册还是部署应用,都可以集中控制:

云原生舰队管理 是 Kurator 的核心灵魂。它引入了“Fleet”的概念,把具有相同业务属性或地理位置的集群划归到一个队列里。

为什么要这么干?因为这样你可以批量下发策略。比如,我想让华东区的所有集群都开启安全加固,我只需要在 Fleet 级别操作一下,下面的几十个集群就都会自动同步。

2.2 Kubernetes 集群的标准架构:整齐划一才是战斗力

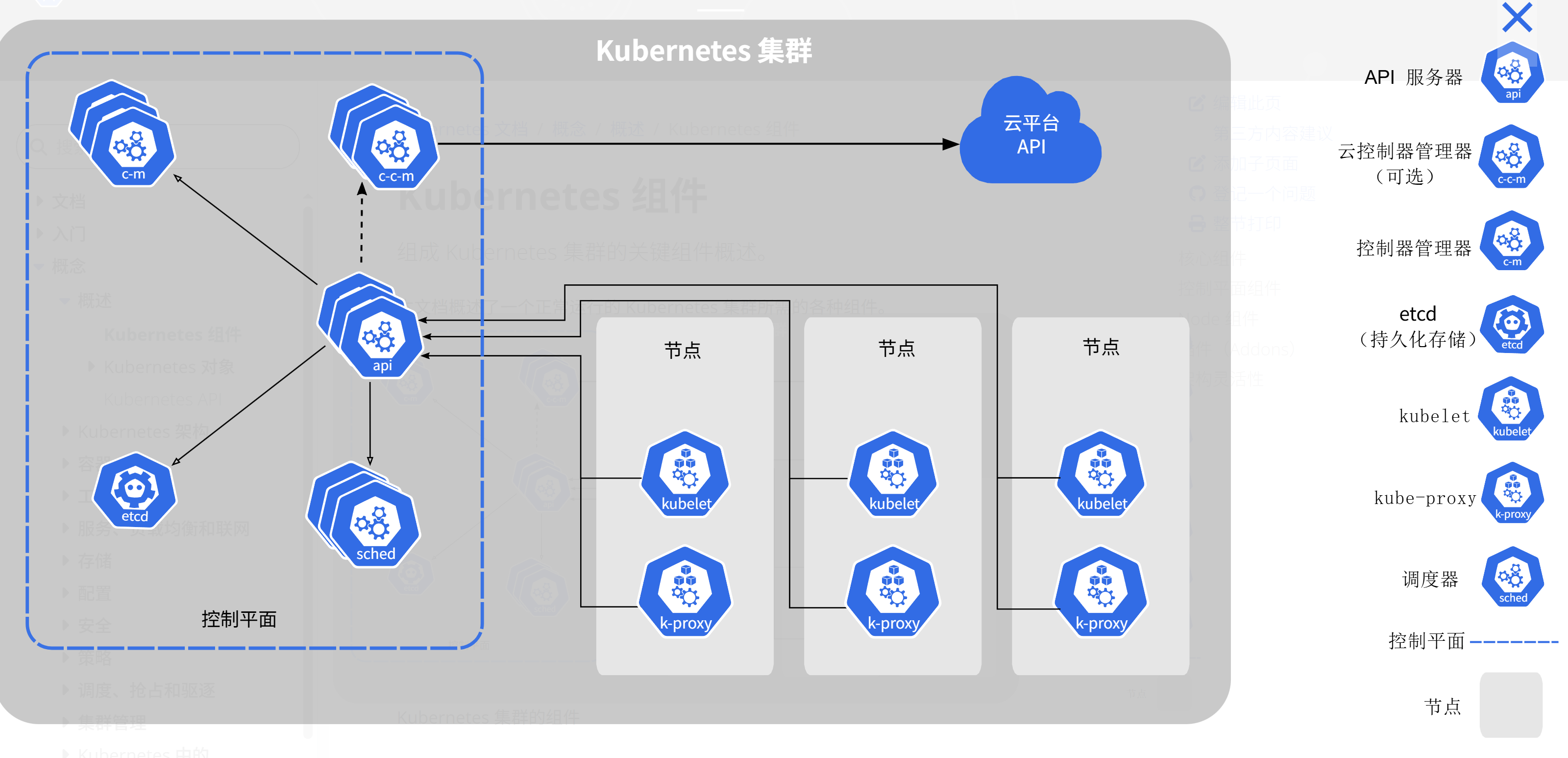

这是Kubernetes集群的标准架构参考图,展示了包含控制平面组件、工作节点及云平台集成的完整集群部署模型:

在组建舰队时,Kurator 强推一套 Kubernetes 集群的标准架构。

很多时候,多集群管理之所以难,是因为每个集群长得都不一样:有的用 Calico,有的用 Flannel;有的版本是 1.24,有的是 1.26。Kurator 通过定义一套标准蓝图,确保舰队里的所有成员集群在底层架构上是“同模”的。这种一致性是实现后续高级功能(如跨集群漂移)的基础。

2.3 Fleet 队列中服务相同性:跨集群访问不再有隔阂

这是一个非常硬核的实战点:Fleet 队列中服务相同性(Service Sameness)。

在传统的思维里,集群 A 里的 order-service 和集群 B 里的 order-service 是两个东西。但在 Kurator 的 Fleet 里,它们被视为同一个逻辑实体。

这意味着什么?这意味着当你的前端应用调用 order-service 时,Kurator 的网络层可以自动帮你做跨集群的负载均衡。哪怕 A 集群的服务挂了,流量也会无感知地飘到 B 集群。这种“逻辑统一”让多集群业务开发变得跟单集群一模一样。

第三章:存储与分发的“终极秘籍”,多集群也要数据自由 💾

集群和网络搞定了,接下来就是最头疼的:应用怎么发?数据怎么存?

3.1 统一分布式存储:Kurator 怎么利用 Rook 玩转跨集群存储?

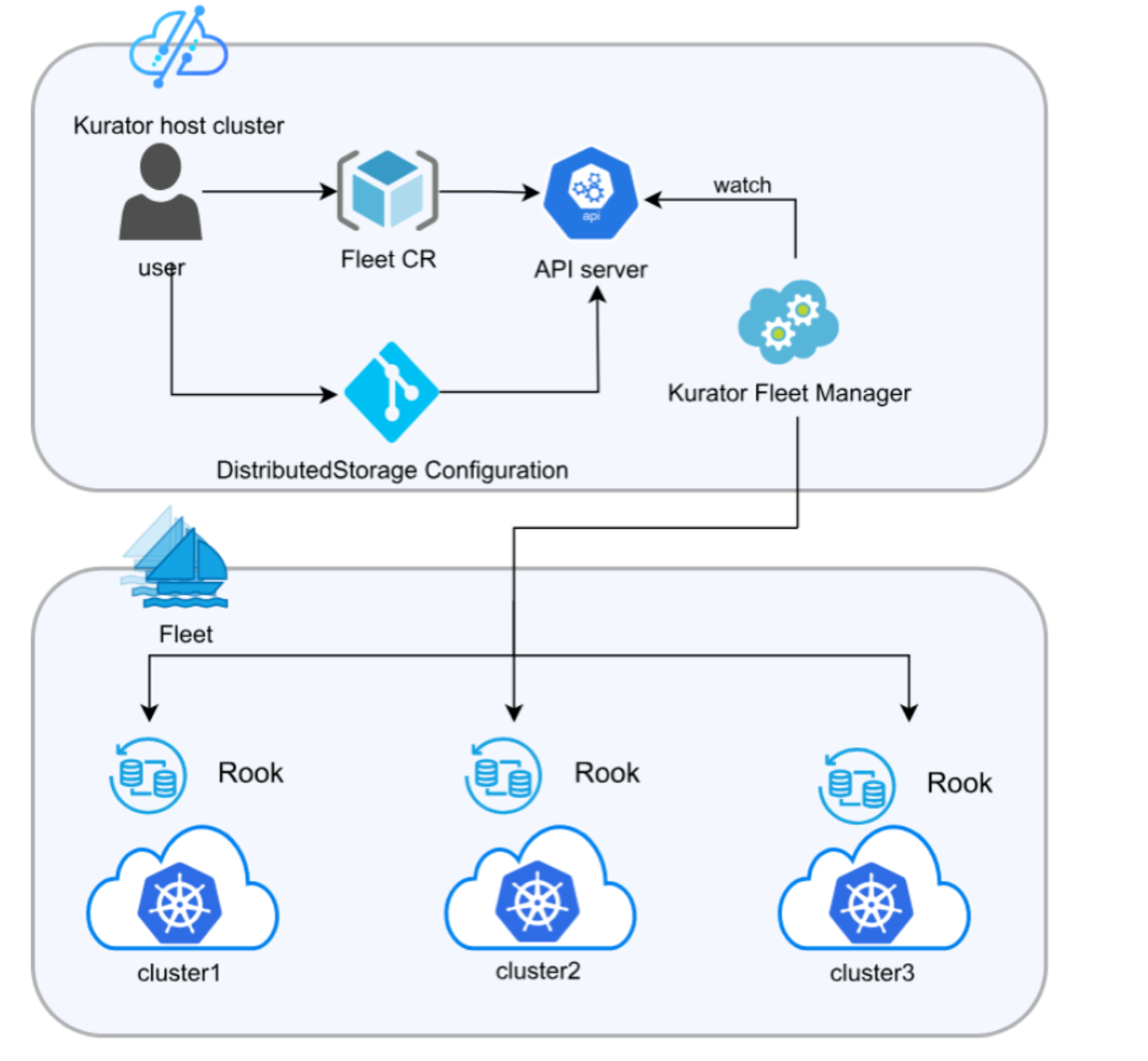

这张图展示了Kurator的统一分布式存储架构,用户通过定义一个配置就能够在多个集群里自动部署和管理Rook存储:

在多集群环境下,存储通常是孤岛。但 Kurator 的统一分布式存储架构 打破了这个僵局。它非常聪明地选择了 Rook 作为存储底座。

Fleet 基于 Rook 构建统一分布式存储的架构,本质上是把 Fleet 里面各个节点上的空闲磁盘给“焊”在一起,组成一个跨集群的 Ceph 集群。

这种架构下,数据不再被局限在某个特定的 K8s 集群里。即使你的 Pod 从北京集群漂移到了上海集群,它依然能挂载原来的持久化卷(PV),因为底层存储池是全舰队共享的。这才是真正的“云原生存储自由”。

3.2 Karmada 集成实践:应用分发如何做到“指哪打哪”?

说到应用分发,Karmada 集成实践 是 Kurator 最引以为傲的部分。Karmada 是目前多集群调度的天花板,Kurator 把它集成进来后,提供了一套极致丝滑的操作体验。

你可以定义复杂的调度策略:比如“高可用模式”(每个集群发一个副本),或者“负载均衡模式”(哪个集群资源多发哪里)。

3.3 手搓实操:Kurator 统一应用分发的管理架构

在 Kurator 统一应用分发管理架构 中,最核心的就是写一份“分发策略(PropagationPolicy)”。下面我手搓一个实战中常用的 YAML 示例,让大家感受一下这种掌控感。

# 这是我手写的 PropagationPolicy,专门用来处理多集群分发

apiVersion: policy.karmada.io/v1alpha1

kind: PropagationPolicy

metadata:

name: my-web-app-distributor

namespace: default

spec:

# 这里的 Selector 决定了我们要分发哪个 Deployment

resourceSelectors:

- apiVersion: apps/v1

kind: Deployment

name: my-awesome-web

# 这里的 placement 是核心:我们要把应用发往哪里?

placement:

clusterAffinity:

clusterNames:

- member-cluster-shanghai

- member-cluster-guangzhou

# 策略:均匀分布,保证高可用

replicaScheduling:

replicaDivisionStrategy: Weighted

replicaSchedulingType: Divided

通过这段代码,你不需要去上海集群敲命令,也不需要去广州集群敲命令,只需要在 Kurator 控制面一推,应用就自动同步过去了。

第四章:流量控制的艺术:Istio 架构与 A/B 测试的实操心法 🚦

应用跑起来了,最后一步就是怎么接流量。多集群的流量治理,如果没有好工具,那就是一场灾难。

4.1 Istio 服务网格的完整架构:让多集群网络不再是噩梦

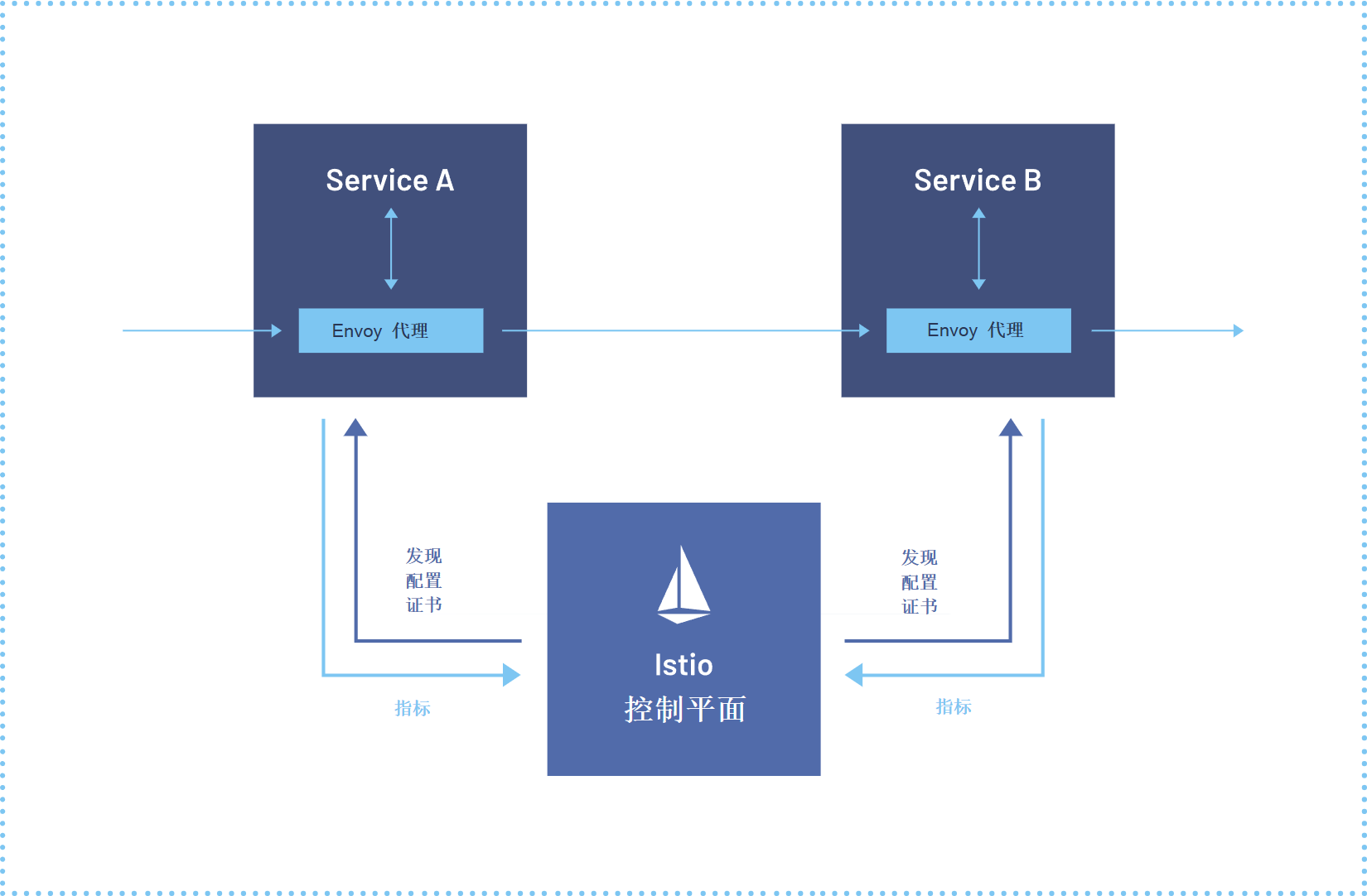

这是Istio服务网格的参考架构图,展示了服务间通过Envoy代理进行通信,并由统一控制平面提供发现、配置与安全策略:

Kurator 内置了 Istio 服务网格的完整架构。在多集群场景下,Istio 的部署极其复杂,但 Kurator 帮我们把这些坑都填平了。

它实现了一个跨集群的 Service Mesh。无论你的服务分布在哪个集群,它们都处于同一个安全、可观测的网络平面内。所有的东西流量(集群间通讯)都会经过 mTLS 加密,安全感直接拉满。

4.2 落地 GitOps 工作流:代码一推,万物同步

在实战中,我们不推荐手动修改配置,而是推崇 GitOps 工作流。

Kurator 支持与 FluxCD 或 ArgoCD 配合。你的集群配置、应用 YAML、甚至是 Istio 的流量规则,都存在 Git 里。

- 开发者提交代码到 Git。

- Kurator 自动感知变化。

- 自动化流水线将变更推送到整个 Fleet。

这种方式让多集群管理变得可审计、可回滚,简直是运维人员的福音。

4.3 在 Kurator 中配置 AB 测试:怎么优雅地做线上灰度?

这是很多老铁最关心的实战场景:Kurator 中配置 AB 测试。

利用集成的 Istio,我们可以通过修改 VirtualService 来实现极其精细的流量切分。比如,我们可以让带了 env: beta 这个 Header 的流量去访问新版本,而普通用户继续访问老版本。

下面这段手搓的代码演示了如何在多集群环境下做一个 A/B 测试配置:

# 手搓一个 A/B 测试流量规则,基于 HTTP Header 进行切分

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

metadata:

name: user-service-ab-test

spec:

hosts:

- user-service

http:

- match:

- headers:

user-role:

exact: internal-beta # 内部测试用户

route:

- destination:

host: user-service

subset: v2 # 指向新版本

- route:

- destination:

host: user-service

subset: v1 # 其他人全看老版本

weight: 100

第五章:总结与进阶建议 🎓

走完这一整套流程,你会发现 Kurator 并不是一个孤立的工具,而是一个集大成者。它把 云原生舰队管理 的理念落到了实处,通过 Karmada 集成实践 解决了分发问题,通过 Istio 服务网格 解决了流量问题,又通过 Rook 搞定了存储。

| 核心价值点 | 解决的问题 | 推荐指数 |

|---|---|---|

| Cluster Operator | 解决“集群怎么来”的体力活 | ⭐⭐⭐⭐⭐ |

| GitOps 工作流 | 解决“配置怎么管”的合规性 | ⭐⭐⭐⭐ |

| 统一分布式存储 | 解决“数据怎么移”的硬骨头 | ⭐⭐⭐⭐⭐ |

最后,给各位想在生产环境使用 Kurator 的老铁一个建议:一定要先定标准。先把你的 Kubernetes 集群的标准架构 定好,再通过 Kurator 去批量复制。只有底座稳了,上面的 A/B 测试、多集群容灾才能玩得转。

Kurator 的世界很大,今天咱们只是揭开了冰山一角。如果你已经心动了,赶紧按照文章开头的命令,把源码拉下来自己手搓一遍吧!云原生的精髓,不在于看懂了多少文档,而在于你亲自踩过多少坑、写过多少 YAML。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献11条内容

已为社区贡献11条内容

所有评论(0)