【前瞻创想】搞定多云环境并不难!聊聊 Kurator 如何帮你轻松驾驭云原生舰队管理与统一存储架构

【前瞻创想】搞定多云环境并不难!聊聊 Kurator 如何帮你轻松驾驭云原生舰队管理与统一存储架构

咱们做技术的,特别是搞云原生的兄弟们,最近是不是总听到“多云”、“混合云”这些词儿磨耳朵?说是为了高可用,为了不被一家云厂商锁死,结果呢?运维的坑是一个接一个。本来管一个 Kubernetes 集群就已经掉不少头发了,现在好了,搞了一堆集群,还得是跨云的,这简直是把难度系数直接拉满啊!😂

不过别慌,今天咱们就来聊聊 Kurator。这玩意儿,就像是一个超级指挥官,专门治各种“集群甚至舰队管理不服”。咱们就拿着它的架构图,像剥洋葱一样,一层层把这事儿给捋顺了。准备好了吗?咱们发车!🚗💨

一、 咱们先来看看 Kurator 的“上帝视角”:总体架构是个啥样?

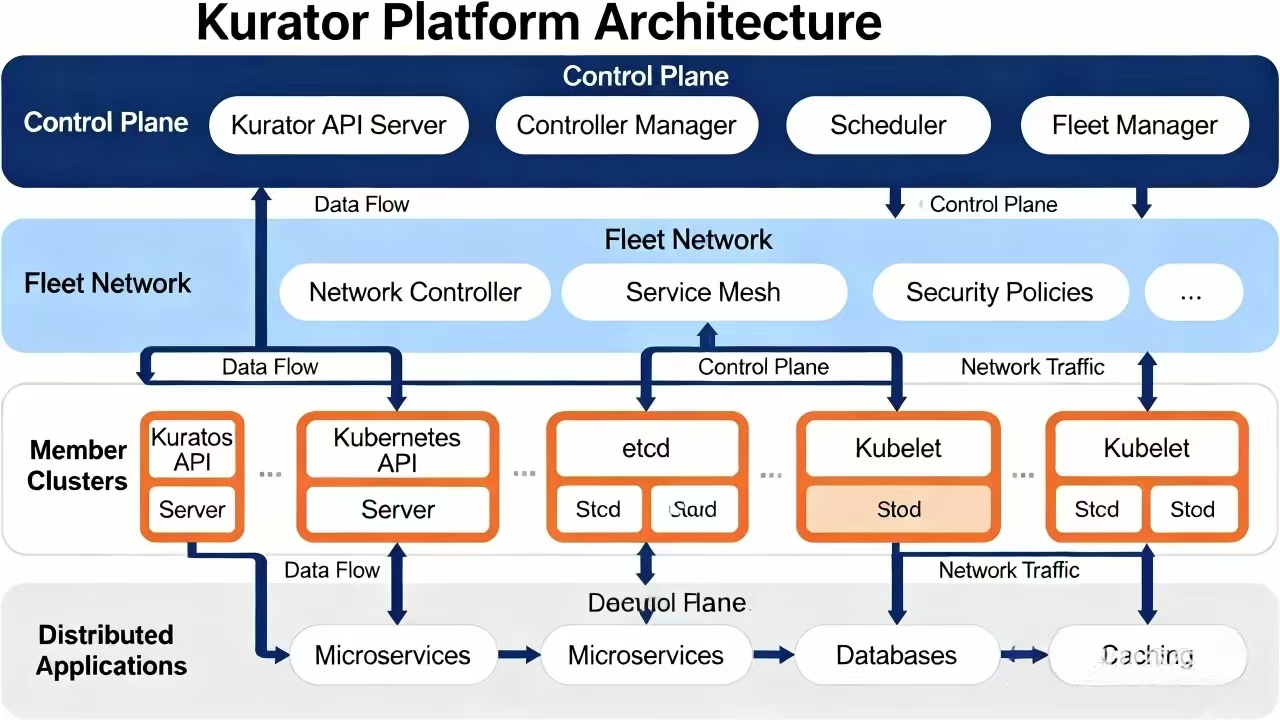

这是Kurator平台的总体架构图,展示了控制平面、集群网络、成员集群及应用层在统一管理框架下的数据流与组件关系:

说实话,第一次看 Kurator 平台的总体架构,你可能会觉得眼花。但你仔细琢磨一下,它其实逻辑特别清晰。你就把它想象成一个巨大的“夹心饼干”。

最底下那层,是咱们的基础设施,不管是阿里云、AWS,还是你自己机房里的裸金属,Kurator 都不挑食。中间这层核心,就是它的控制平面。这里面有个非常关键的角色,叫 Cluster Operator。

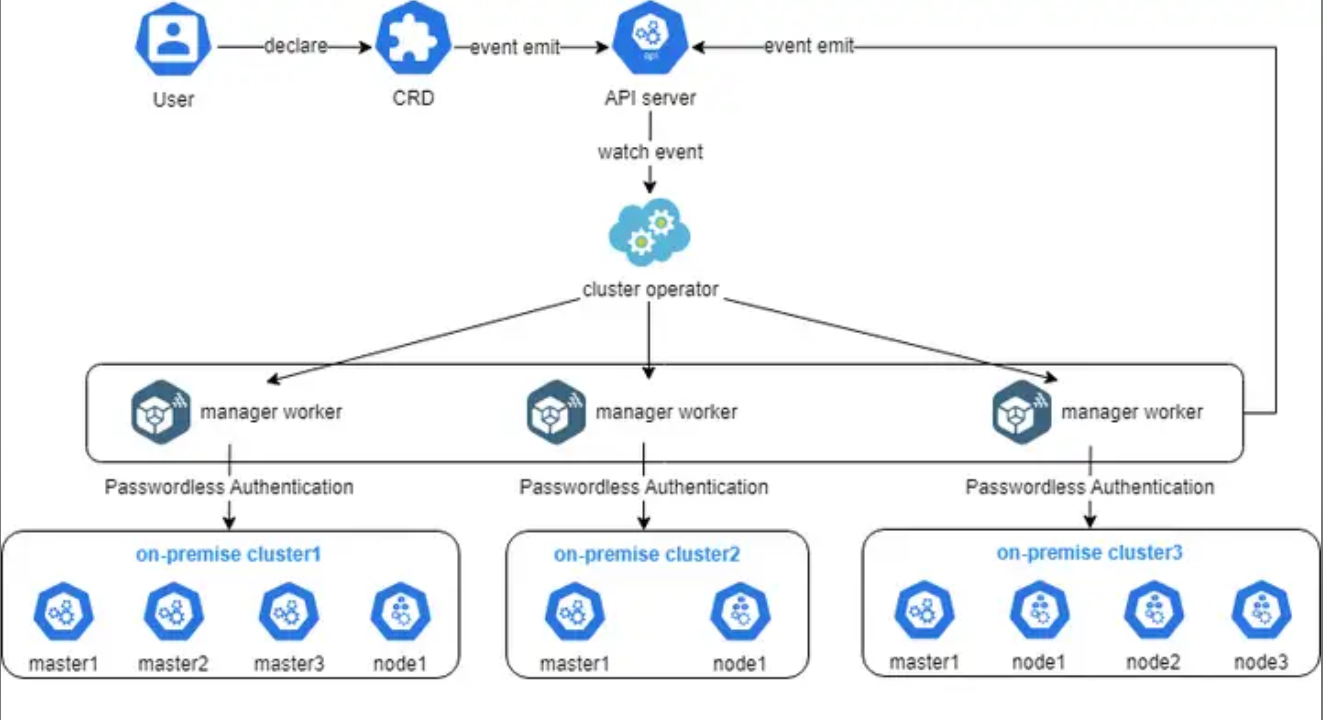

这张图展示了Cluster Operator的实现细节,其实就是用户通过声明一个CRD,触发API Server事件,然后由Operator监听并调度多个管理worker去自动对接和管理不同的本地集群,整个过程用无密码认证打通,既安全又高效:

Cluster Operator 的实现 可是个技术活。咱们都知道 Operator 模式是 K8s 的精髓对吧?Kurator 里的这个 Operator,它就像是一个不知疲倦的管家。它不仅盯着你集群的生命周期——从创建、升级到销毁,它还负责盯着集群的“健康状况”。它的实现逻辑里,大量用到了调和循环(Reconcile Loop)。简单说,就是它手里拿个小本本(你的期望状态),不停地去比对现实情况(集群实际状态)。一旦发现不对劲,比如节点挂了,或者版本低了,它立马就去干活,自动把现实给“掰”回来。这就把咱们从繁琐的人肉运维里解放出来了,爽不爽?😎

再往上看,Kurator 的架构里还藏着 Kubernetes 集群的标准架构 的影子。虽然 Kurator 是管集群的,但它自己生成的或者纳管的集群,那都是标准的 K8s。Control Plane、Worker Node、ETCD,一个都不少。这就保证了兼容性,你以前在 K8s 上学的那些命令,kubectl 啥的,在这儿依然好使,不用重新考证!🎓

二、 真正的重头戏:云原生舰队管理与 Karmada 的神助攻

好,基座打好了,咱们得聊聊核心痛点了——怎么管这么多集群?这就得提到 云原生舰队管理(Fleet Management)了。

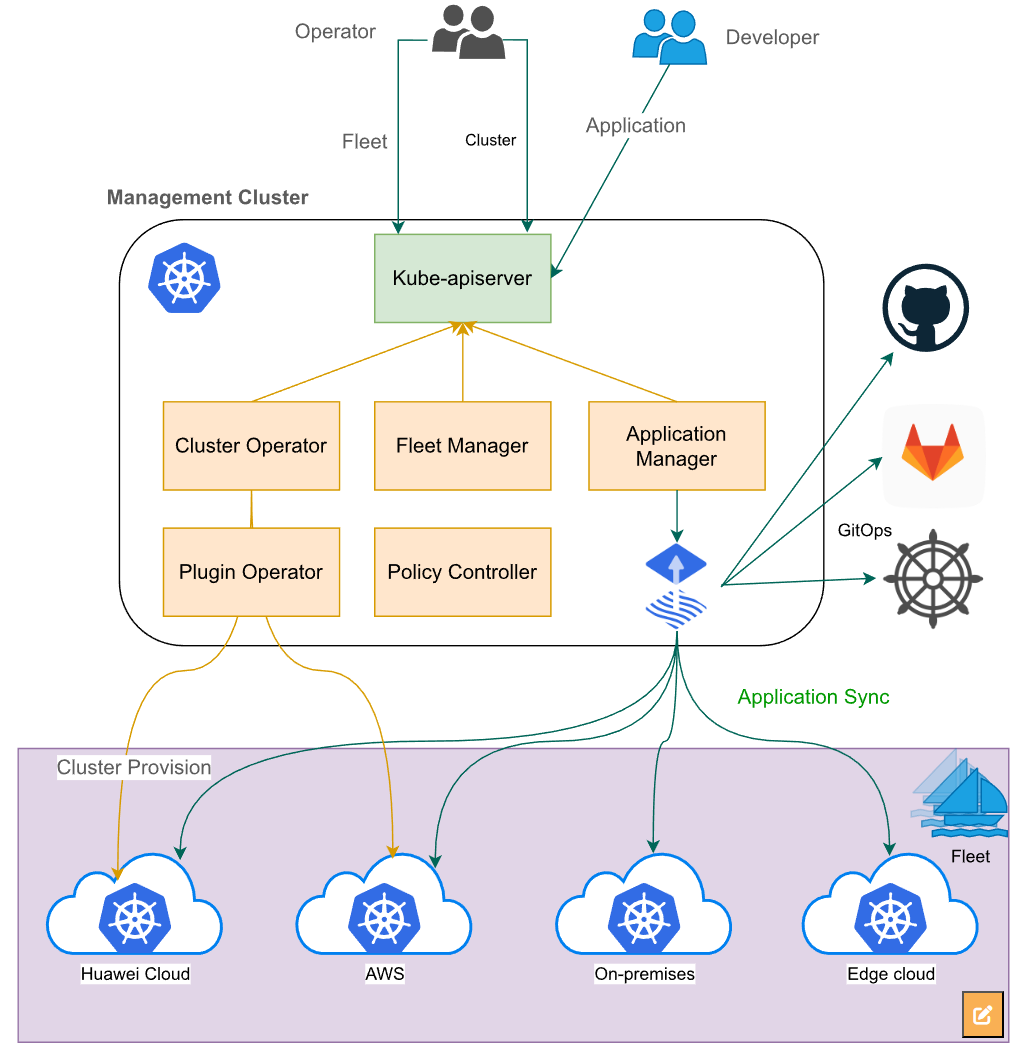

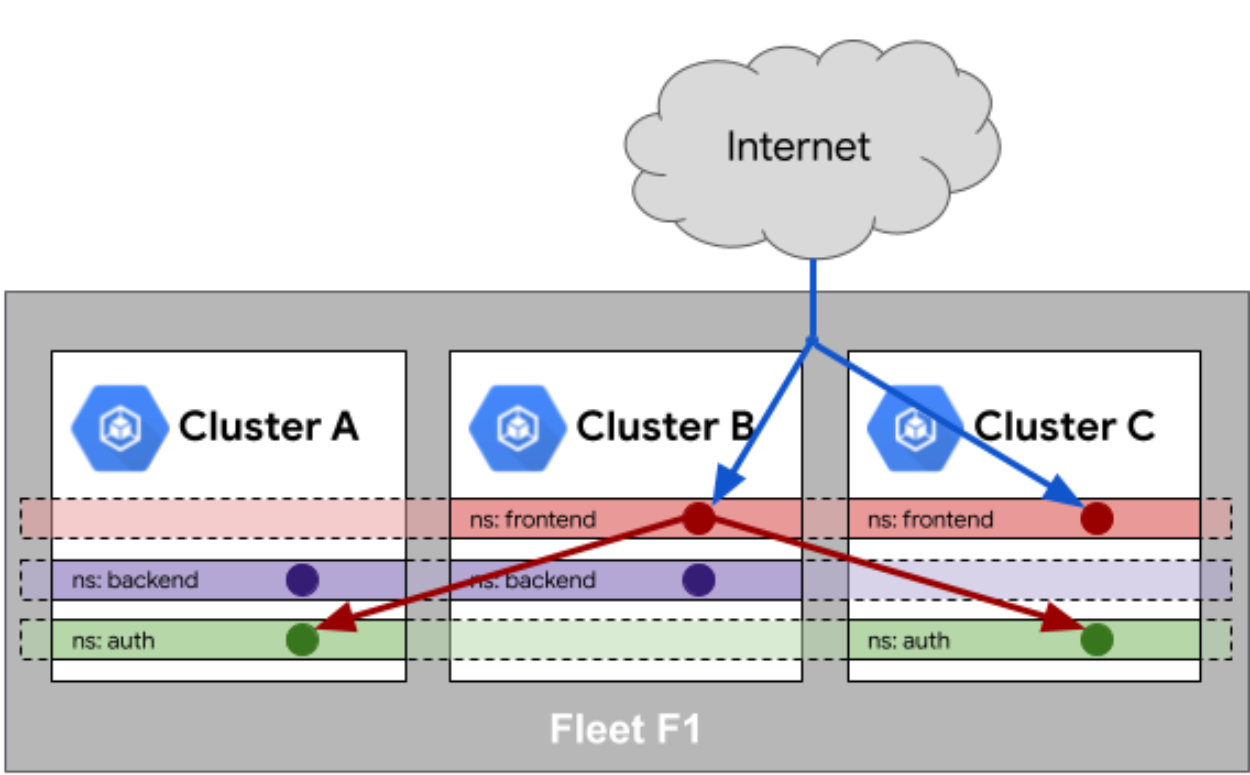

这张图讲的是云原生舰队管理,就是通过一个管理中心集群来统一管理多个下属集群,不管是创建、注册还是部署应用,都可以集中控制:

啥叫“舰队”?一个集群是条船,几十个集群那就是个舰队啊!Kurator 引入了 Fleet 的概念,就是为了让你像管一个集群一样,去管一堆集群。

但这事儿光靠嘴说是没用的,得有真本事。Kurator 在这里面集成了 Karmada。Karmada 集成实践 是 Kurator 最骚的操作之一。Karmada 本身就是为了多云编排生的,Kurator 把它拿过来,做了一层更丝滑的封装。

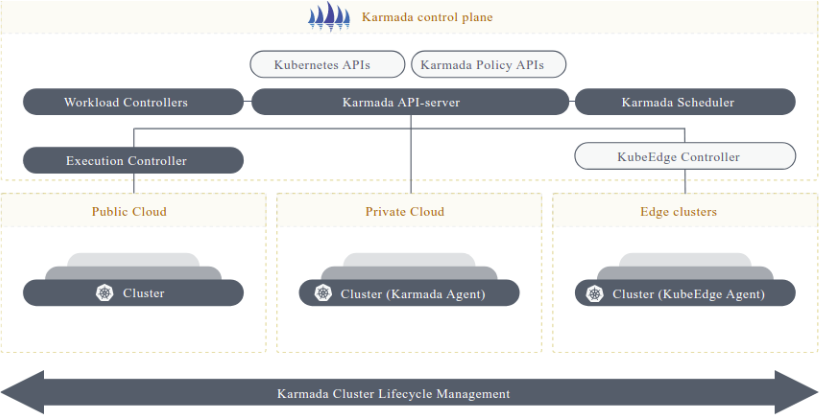

这是Karmada集成实践的参考架构图,展示了其控制平面如何通过统一的策略API纳管多云、私有云及边缘异构集群:

想象一下,你有一个应用,想发到北京、上海、甚至美国的机房。在没有 Kurator 之前,你得切一个个集群去 apply yaml,累死个人。有了 Karmada 集成后,你只需要把应用丢给 Kurator 的控制面,告诉它:“嘿,我要在这个 Fleet 里部署。” 剩下的事儿,Karmada 的调度器就帮你干了。它会根据资源情况、网络延迟,甚至是你定义的策略,自动把负载分发出去。

这里面有个很有意思的点,叫 Fleet 队列中服务相同性。这是啥意思呢?就是说,虽然你的应用跑在不同的云上,底层的 IP、甚至存储类可能都不一样,但在逻辑上,它们得是“双胞胎”甚至“多胞胎”。Kurator 通过抽象,保证了不管你这服务是在 A 云还是 B 云,它的服务发现机制、它的命名规范,对外表现是一模一样的。这对于上层的微服务调用来说,简直就是福音,完全不用改代码就能跨云调用,是不是很神奇?✨

这是Fleet队列中服务相同性参考图,展示了其如何在不同集群间跨命名空间智能识别并分发关联服务:

三、 别光说不练,动手搭建环境才是正经事 🛠️

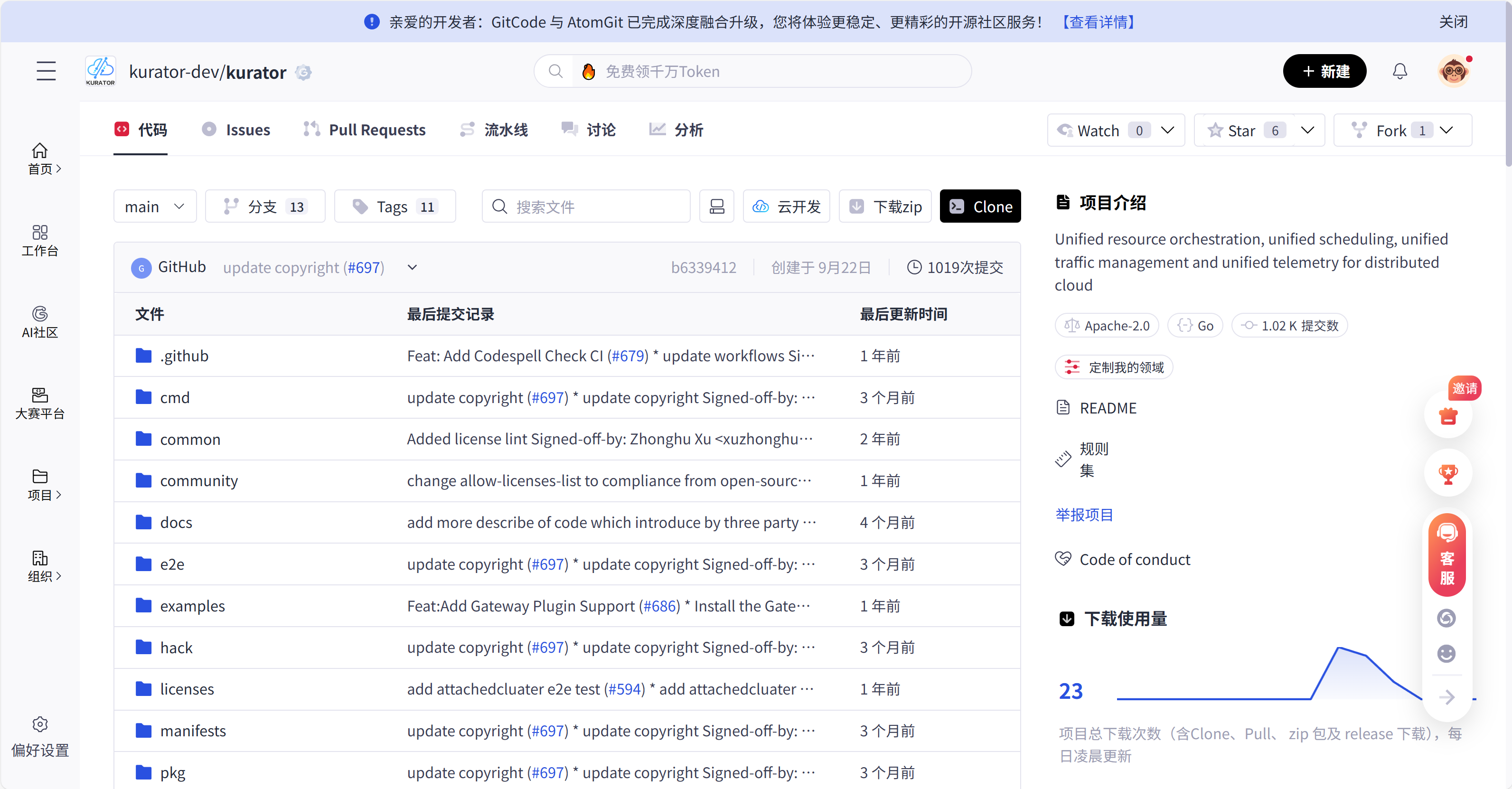

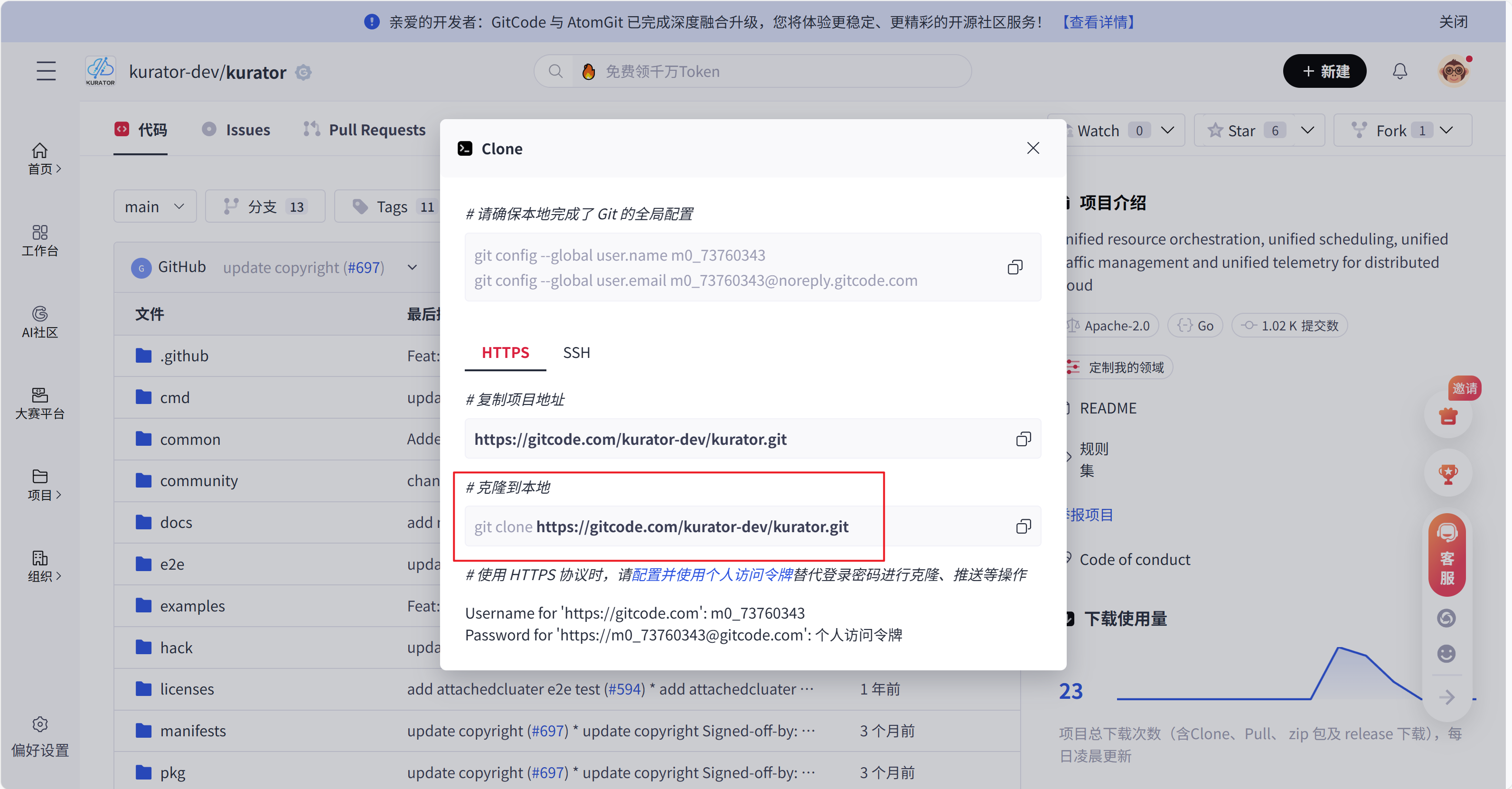

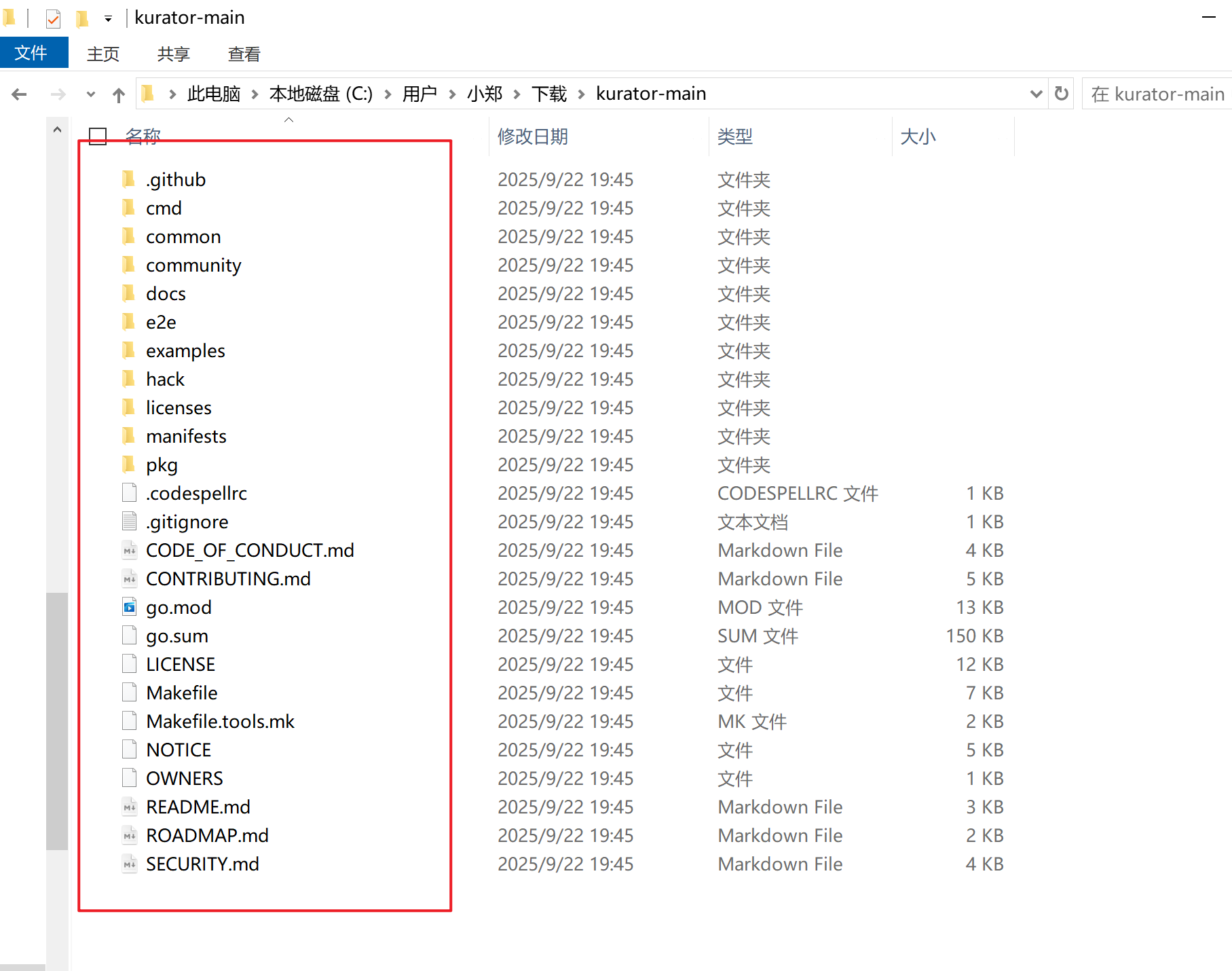

如图这是kurator的gitCode站内资源

点击项目中可以看到如下的源码文件内容

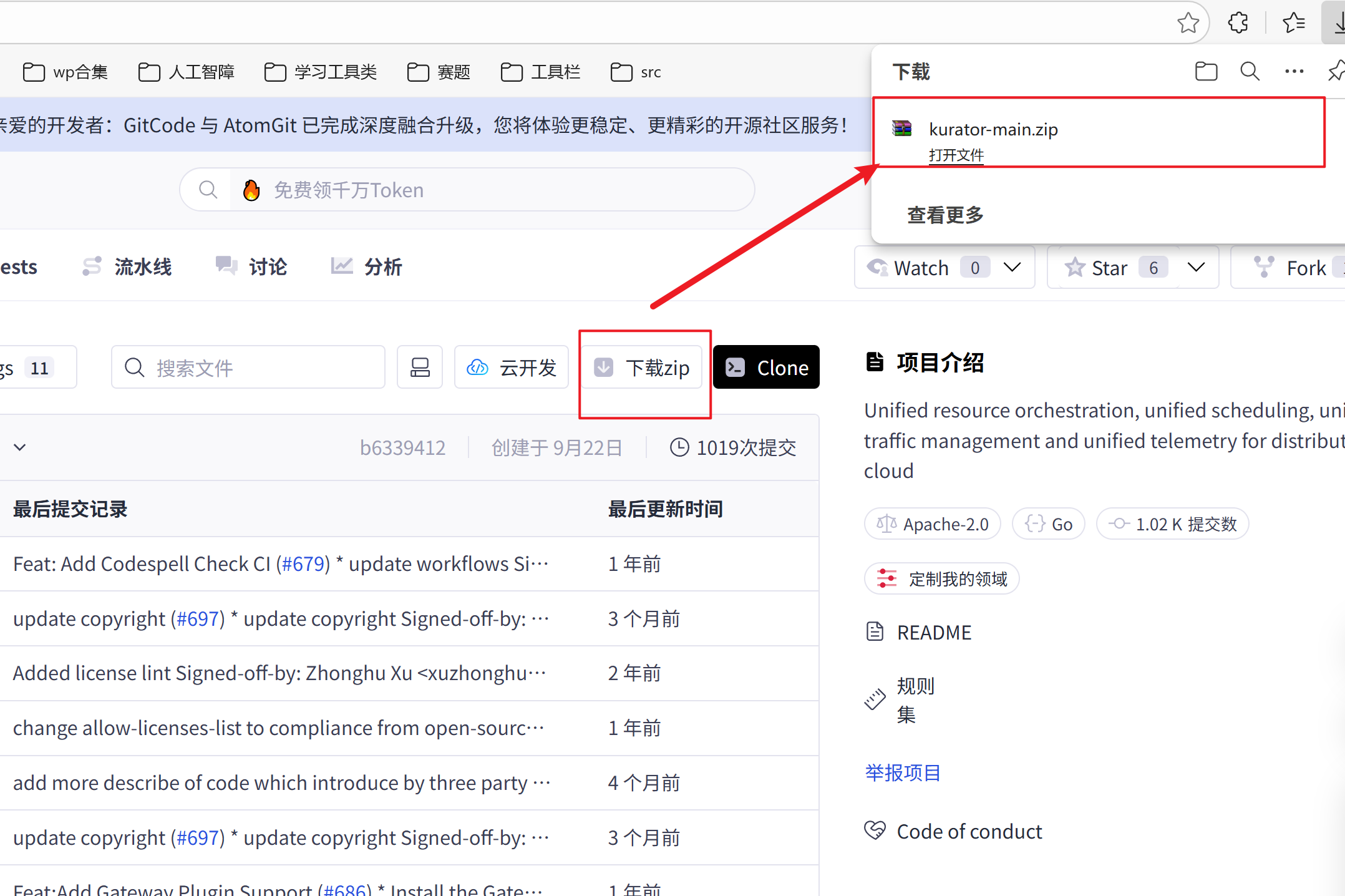

到这一步我们下载源码就分成方便啦

如果我们有git环境就可以直接用命令clone到本地

如果没有的话也可以直接下载zip包

下载下来解压缩就能得到源码文件啦

如下是源码文件

搭建环境的时候,记得留意一下网络。国内拉镜像有时候挺感人的,你懂的,可能需要配置一些镜像加速器。💡

四、 存储也是个大麻烦?看 Kurator 如何统一分布式存储

集群跑起来了,应用发出去了,接下来大家最头疼的问题通常是——数据存哪儿?😱

在多云环境下,AWS 有 EBS,阿里云有云盘,私有云有 NFS。这乱七八糟的存储接口,能把运维逼疯。Kurator 给出的答案是:Kurator 的统一分布式存储架构。

它这套架构的核心思想是“屏蔽差异”。它不想让你去操心底下到底是哪家的盘,它只想给你提供一个标准的 PVC(持久卷声明)。

为了做到这一点,Kurator 采用了 Fleet 基于 Rook 构建统一分布式存储的架构。Rook 大家都熟吧?它是云原生存储的编排器,而 Ceph 是分布式存储的老大哥。Kurator 巧妙地把 Rook 塞到了它的 Fleet 管理中。

这是怎么运作的呢?很简单。当你在 Kurator 里启用存储插件时,它会自动在你的各个成员集群里部署 Rook Operator 和 Ceph 集群。然后,它会把这些分散在各个集群里的存储资源,逻辑上聚合成一个大的“存储池”。

这就好比你虽然在三个不同的银行开了户(三个不同的云),但 Kurator 给了你一张“黑卡”(统一存储接口),你刷这张卡,后台自动去调配资金。对于上层应用来说,它根本不知道数据是存在 AWS 的 SSD 上,还是本地的硬盘上,它只知道:“我要 10G 空间”,然后 Kurator 就给它了。这种 Kurator 统一应用分发的管理架构 配合上统一存储,才是真正的“一次编写,到处运行”。📦

五、 流量与发布的艺术:Istio 与 GitOps 的完美邂逅

应用跑得好不好,流量治理少不了。在 Kurator 的世界里,Istio 服务网格的完整架构 是被深度集成的。

咱们都知道 Istio 强,但维护 Istio 是真难。Kurator 把 Istio 的控制面和数据面(Envoy Proxy)的管理也给接管了。在多集群环境下,Kurator 会帮你打通不同集群间的网络,构建一个跨集群的 Service Mesh。这意味着,你的服务 A 在集群 1,想调用集群 2 的服务 B,就像调用本地服务一样简单,mTLS 加密、熔断、限流,全都给你安排得明明白白。🛡️

然后,咱们还得聊聊 GitOps 工作流。在 Kurator 里,我们强烈推荐别手动 kubectl apply 了,太 Low 且容易出错。

Kurator 完美支持 ArgoCD 或者 Flux 这种 GitOps 工具。你的所有配置,包括 Kurator 自身的配置、应用的配置、Istio 的规则,统统存到 Git 仓库里。

这就形成了一个闭环:

- 开发者提交代码到 Git。

- CI 流水线跑测试,打镜像。

- CD 系统(GitOps)发现 Git 仓库变了,自动把变更同步到 Kurator 管理的 Fleet 中。

- Kurator 负责把这些变更落地到具体的物理集群。

这套流程走下来,那叫一个丝滑!🏄♂️

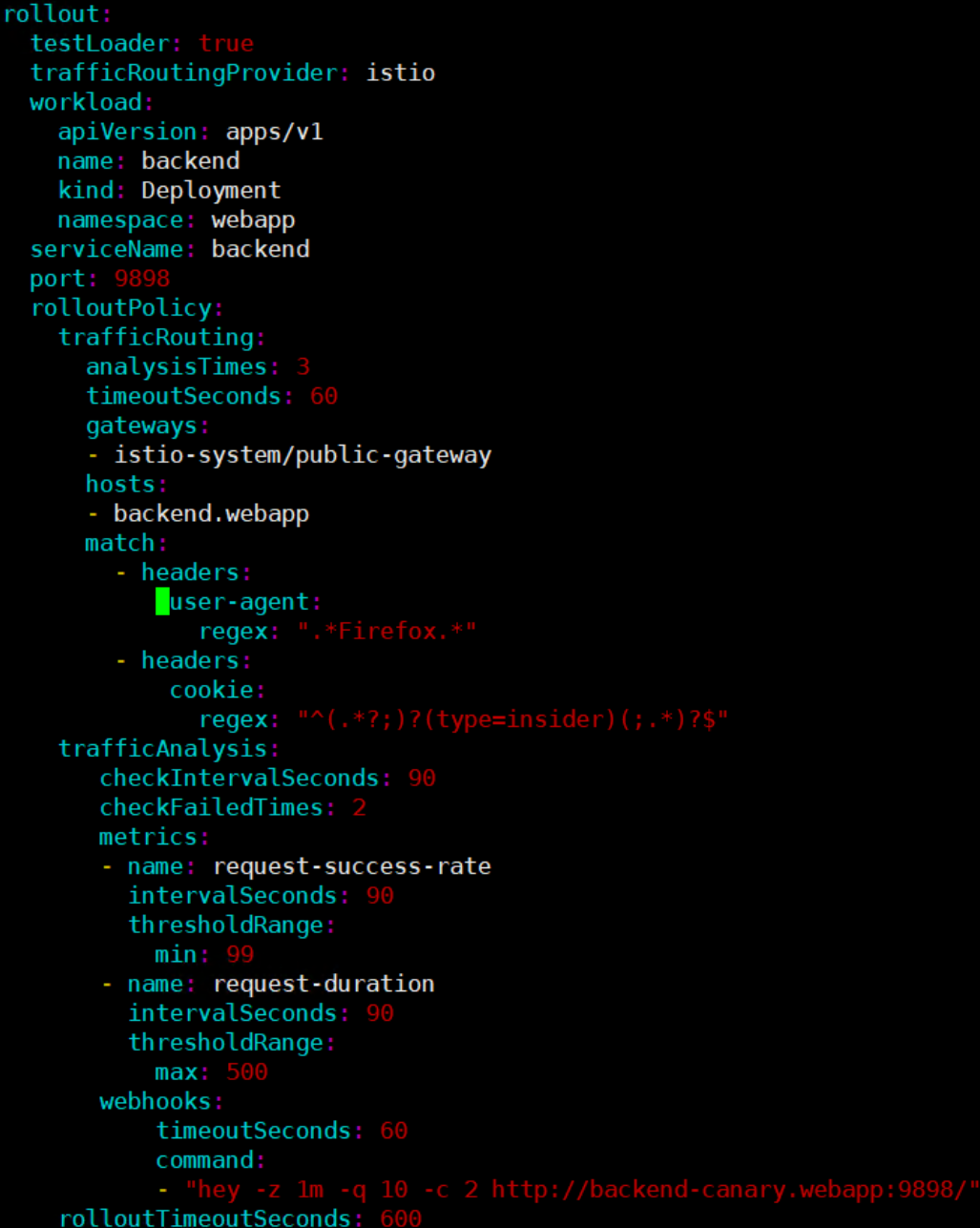

六、 高阶玩法:怎么在 Kurator 里搞定 A/B 测试?

最后,咱们来点高阶的。老板突然说:“咱们新版本上线,先切 10% 的流量试试水,没问题再全量。” 这种 Kurator 中配置 A/B 测试 的需求,怎么破?

别急,既然咱们有 Istio 和 Kurator,这事儿就是分分钟的。

咱们需要定义一个流量切分规则。通常我们会用到 VirtualService 和 DestinationRule。在 Kurator 里,你只需要把这些规则像分发应用一样分发下去就行。

来看个手写的配置片段,感受一下这种掌控流量的快感:

# 这是一个简单的 VirtualService 配置示例

# 假装咱们有个服务叫 my-cool-app

apiVersion: networking.istio.io/v1beta1

kind: VirtualService

metadata:

name: my-cool-app-route

namespace: default

spec:

hosts:

- my-cool-app

http:

- route:

- destination:

host: my-cool-app

subset: v1

weight: 90 # 旧版本 v1 吃掉 90% 的流量

- destination:

host: my-cool-app

subset: v2

weight: 10 # 新版本 v2 先尝鲜 10%

把这个文件往 Git 里一推,Kurator 的 GitOps 管道一跑,线上的流量立马就开始分流了。

但是,怎么确认它真的生效了呢?咱们不能光看仪表盘,最好写个小脚本去验证一下。这也是 Kurator 统一应用分发的管理架构 中很重要的一环——验证。

来,再整一段验证脚本:

import requests

import time

# 这是一个极其简单的验证脚本,用来统计流量分布

url = "http://my-cool-app.example.com"

v1_count = 0

v2_count = 0

print("开始进行流量打点测试... (按 Ctrl+C 停止)")

try:

for i in range(100):

# 假装发请求

response = requests.get(url)

# 假设响应头里带了版本信息

version = response.headers.get('X-Version', 'unknown')

if version == 'v1':

v1_count += 1

elif version == 'v2':

v2_count += 1

print(f"🎉 捕捉到一个 V2 版本的响应! (请求 #{i+1})")

time.sleep(0.1) # 别把服务压垮了哈哈

print(f"\n测试结束: v1={v1_count}, v2={v2_count}")

print("这比例看着还挺准的吧?😎")

except KeyboardInterrupt:

print("\n测试手动停止。")

通过这样的配置和验证,你可以非常有信心地告诉老板:“放心吧,灰度发布正在平稳运行中!”

这是在Kurator中配置A/B测试的YAML示例,展示了如何基于用户代理和Cookie的头部匹配规则进行精细化流量分割与多维度指标分析:

总的来说,Kurator 就是要把云原生那些复杂的碎片——K8s、Karmada、Istio、Rook、Prometheus 等等——拼成一个完整的、好用的拼图。它不是要造新轮子,而是要让轮子滚得更顺畅。

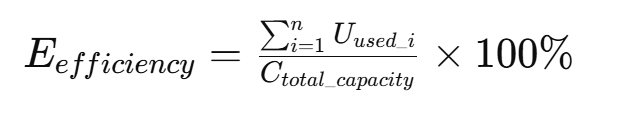

如果在架构设计中涉及到资源利用率的计算,比如在多集群调度时,我们可能会用到一个简单的资源效率公式:

其中 ( U_{used} ) 代表已使用的资源,( C_{total} ) 代表总容量。Kurator 的调度器就在不断地优化这个 ( E ),让你的每一分钱云资源都不浪费。💰

好啦,关于 Kurator 的这点事儿,今天就先聊到这儿。技术这东西,还得靠自己多折腾。赶紧把那个 git clone 命令敲起来,去构建属于你的云原生舰队吧!加油!🌟

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)