【探索实战】从多集群困境到统一云原生底座:Kurator 分布式云原生的深度落地之路

【探索实战】从多集群困境到统一云原生底座:Kurator 分布式云原生的深度落地之路

在大多数企业的云原生演进路径里,多集群、多云、多区域已成为不可逆的趋势。集群数量往往从几个到几十个,再到上百个;团队从 Kubernetes 运维跨向 Mesh、监控、分发、策略治理等更复杂的体系。分布式云原生的管理难度往往指数级增加。

在这样的背景下,我所在团队决定引入 Kurator 作为统一云原生治理的控制面,落地一个具备强治理能力、覆盖多区域的分布式云原生平台。

本文将从 入门体验、功能使用深度实践、真实落地案例 三个维度展开,分享我在 Kurator 上的实战经验,以及它在我们的生产体系中带来的深刻变化。

一、Kurator 入门实战:搭建与踩坑

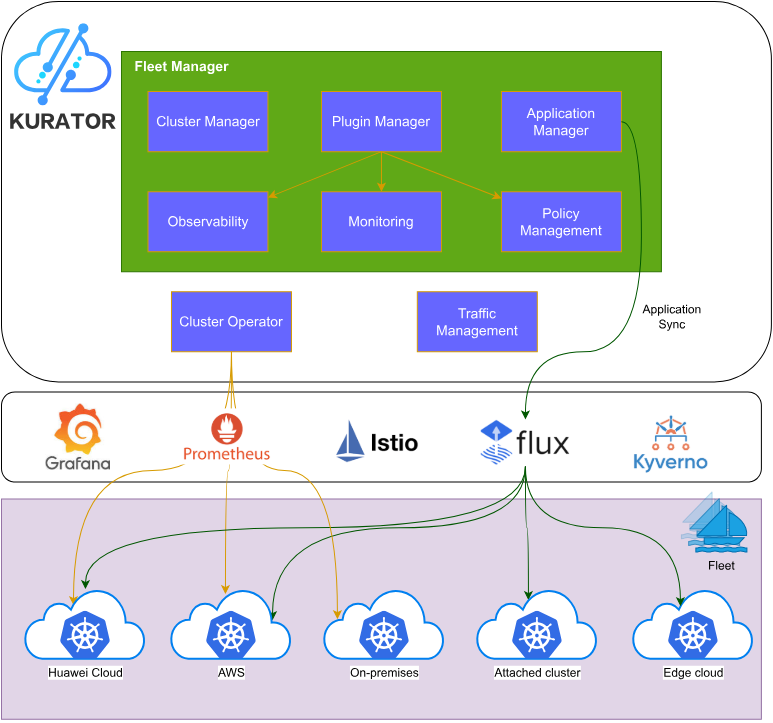

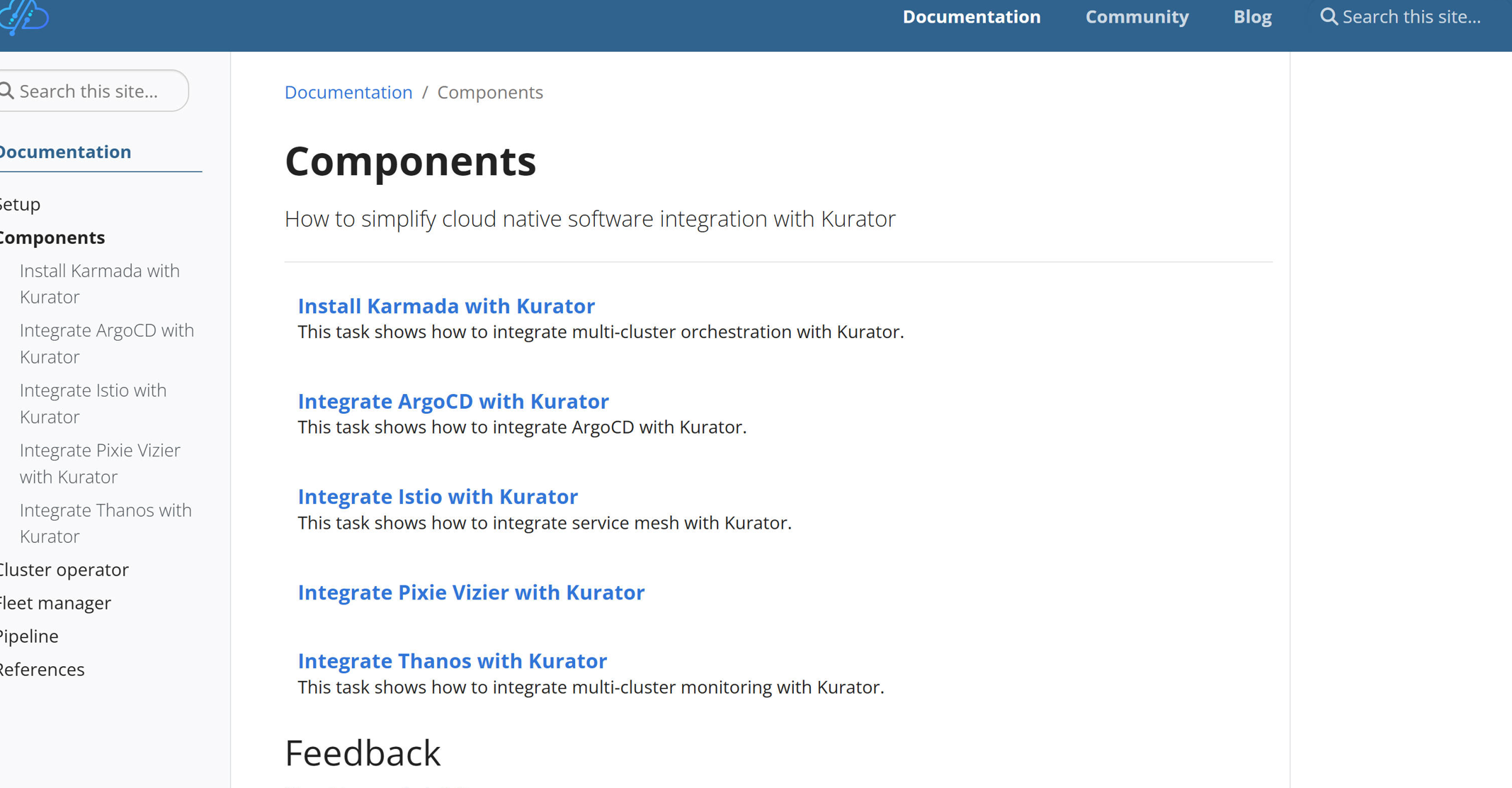

Kurator 的定位是一个 统一管理多集群、应用、流量、策略、监控的分布式云原生平台。它整合了多种优秀的 CNCF 项目,并将“多集群治理”能力做到更高层级抽象。

1. 初次安装:环境准备与部署体验

我们在安装 Kurator 时选择了最基础的单控制面部署方式,只需要准备一个管理集群:

curl -LO https://github.com/kurator-dev/kurator/releases/latest/download/kuratorctl

chmod +x kuratorctl

sudo mv kuratorctl /usr/local/bin

部署控制面:

kuratorctl init --cluster kubeconfig.yaml

小坑 1:集群版本兼容

Kurator 对 Kubernetes 版本要求较高,推荐 >=1.25,我们由于某边缘集群版本为 1.23,导致 cluster-registration 时失败。

解决方式:升级或使用 Kurator 的 agent 模式 兼容旧集群。

小坑 2:Webhook 证书异常

在首次部署 Kurator 的 CRD 时,Webhook 校验会出现 CSR 未自动批准。我们采用如下方式解决:

kubectl certificate approve kurator-webhook-csr

此后 Kurator 工作完全正常,控制面 UI 与 CLI 均可正常使用。

二、深入功能使用实践:从多集群治理到统一流量与监控

Kurator 的核心价值不仅仅是“能管理多集群”,而是 构建一个跨集群统一治理的平台。下面我将基于三个生产中的典型使用场景深入展开。

2.1 集群生命周期治理:像管理应用一样管理集群

我们最常用的是 Kurator 的 Cluster API 驱动的集群生命周期管理。

创建一个新的 K8s 集群,只需要提交一个 Kurator 的 Cluster CRD:

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: prod-cluster-ap-southeast

spec:

provider: eks

region: ap-southeast-1

version: "1.29"

nodePools:

- name: worker

instanceType: m5.large

count: 5

创建:

kubectl apply -f cluster.yaml

Kurator 会自动完成:

- 节点资源创建

- 控制面与工作节点初始化

- 网络插件自动安装

- 监控/日志/策略 Agent 自动下发

实际价值分析:

- 跨多云管理统一化:我们管理了 EKS、ACK、裸金属 K8s,不再需要分别学习三套 API。

- 集群一致性增强:Kurator 会统一安装 CNI、CIS Benchmarks、监控组件,避免集群之间 “配置漂移”。

- 生命周期自动化:扩缩容、升级、删除均通过 CRD 完成,极大降低运维成本。

2.2 统一应用分发:一次发布,多集群上线

Kurator 的应用分发基于 Karmada,这是我认为 Kurator 最强大的核心能力之一。

例如,我们需要在三地(北京、上海、新加坡)同时部署支付服务,可以通过 PropagationPolicy 精确控制分发策略:

apiVersion: apps.kurator.dev/v1alpha1

kind: DistributePolicy

metadata:

name: payment-global

spec:

targets:

- cluster: bj-prod

- cluster: sh-prod

- cluster: sg-prod

strategy: RollingUpdate

交付只需:

kuratorctl apply -f payment.yaml --policy payment-global

实际价值:

- 一次部署,多集群自动扩散

- 支持 差异化配置(如不同地区的 ConfigMap、镜像源)

- 自动处理版本回滚、策略编排

- 结合 Metrics 实现智能调度(例如新加坡高负载时自动切流量到上海)

Kurator 把应用交付的复杂度从“多集群管理”变成了“单次发布”,极大提升了研发团队的效率。

2.3 统一流量治理:跨集群流量像一个大 Mesh

借助 Kurator 内置的 Istio 体系,我们实现了跨集群流量治理。

一个典型场景:北京与上海两个集群部署 Payment 服务,需要做到“同城优先,跨城兜底”。

只需定义:

apiVersion: networking.istio.io/v1alpha3

kind: VirtualService

metadata:

name: payment

spec:

hosts:

- payment.svc.global

http:

- route:

- destination:

host: payment

subset: bj

weight: 80

- destination:

host: payment

subset: sh

weight: 20

再加上 Kurator 的 跨集群 Gateway 自动同步,我们构建了一套真正全球联通的 Mesh Traffic 系统。

实际价值:

- 灾备容灾:任一集群故障时,流量自动切换。

- 跨运营商网络优化:通过智能路由提高访问速度。

- 蓝绿发布、金丝雀等策略统一管理。

三、真实落地案例:我们如何用 Kurator 打造统一云原生底座

以下是我们企业真实落地 Kurator 构建分布式云原生平台的过程总结。

3.1 技术选型:为什么是 Kurator?

我们评估过:

| 项目 | 多集群 | 应用分发 | 流量治理 | 策略统一 | 易用性 |

|---|---|---|---|---|---|

| Karmada | 强 | 强 | 弱 | 弱 | 中 |

| Istio | 弱 | 无 | 强 | 中 | 复杂 |

| Fleet/ArgoCD | 配置分发强 | 强 | 无 | 中 | 强 |

| Crossplane | 强 | 弱 | 弱 | 中 | 强 |

| Kurator | 强 | 强 | 强 | 强 | 最强 |

我们的结论:

Kurator 是最接近日常运维“实际场景”的产品:统一治理平台、应用管理、流量、策略、监控一体化,真正面向“平台工程”建设。

3.2 技术适配与攻坚

在落地过程中,我们主要攻克了三大问题:

🟦 1. 多云网络连通不稳定

通过 Kurator 的跨集群 Gateway Mesh,我们用 MTLS + 双向代理优化了链路质量。

🟦 2. 边缘集群算力有限

Kurator 的轻量 agent 模式让 Karmada/Istio 控制面集中化,大幅降低边缘侧资源开销。

🟦 3. 集群差异化配置过多

利用 Kurator 的差异化 Overlay 机制解决,例如不同地域的镜像仓库与环境变量。

3.3 用户反馈与商业价值

上线 Kurator 后,内部团队反馈:

- 发布效率提升 60%-80%

- 运维人力减少 40%

- 平均故障恢复时间下降 70%(跨集群流量治理功不可没)

- 多云调度让机器成本降低 25%

更重要的是,Kurator 让多个业务团队从“管理集群”回归“管理业务”,平台工程能力显著提升。

四、总结:Kurator 为分布式云原生带来的真正价值

在实践了近半年后,我对 Kurator 的判断是:

Kurator 把多集群运维变成了一种“产品化能力”,而非分散的工具链拼装。

它真正解决了过去云原生平台遇到的痛点:

- 多集群不一致

- 多云碎片化运维

- 应用无法统一分发

- 跨集群流量不可视

- 策略难以统一落地

未来,我们还计划使用 Kurator 进一步拓展:

- AI Sandbox(AI workload with Volcano)

- 边缘云管理(KubeEdge)

- 更细粒度的全局策略治理

Kurator 的实战价值远超预期,它为我们构建了一个真正意义上的 分布式云原生运营底座。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)