【探索实战】解锁分布式云原生:从零到一的Kurator实战之旅——揭秘如何一站式搞定多集群管理与云边协同

【探索实战】解锁分布式云原生:从零到一的Kurator实战之旅——揭秘如何一站式搞定多集群管理与云边协同

【探索实战】解锁分布式云原生:从零到一的Kurator实战之旅——揭秘如何一站式搞定多集群管理与云边协同

引言:当云原生遇上分布式,我们为何需要Kurator?

今天,当我们谈论云原生时,场景已不再局限于单个数据中心或一朵云。混合云、边缘计算的兴起,让应用需要运行在跨越公有云、私有云甚至边缘设备的多个集群中。这时,一个尖锐的问题摆在面前:如何像管理一个集群一样,去高效、一致地管理成百上千个分布式集群? 你是否也在为多集群应用部署的复杂性、网络连接的脆弱性、监控数据的碎片化而头疼?

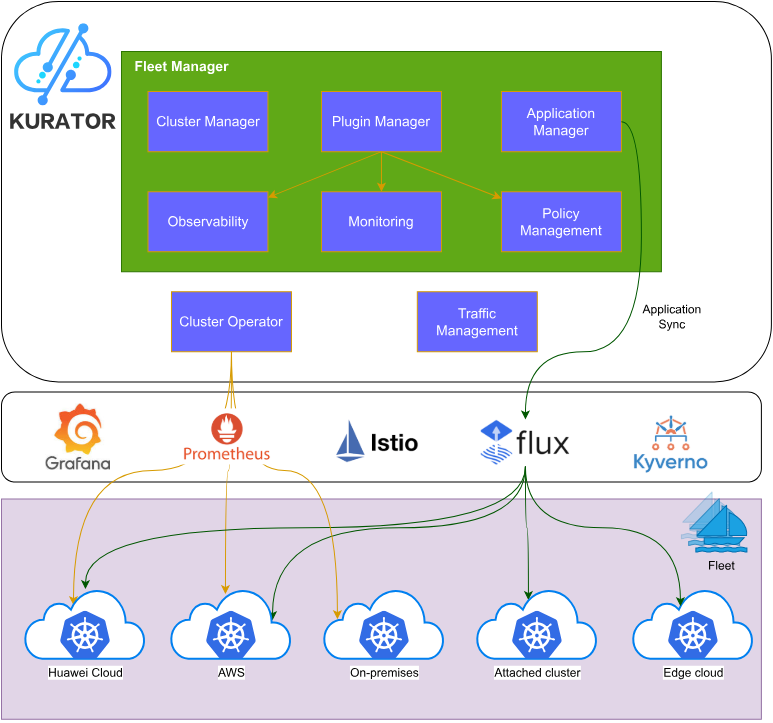

正是在这样的背景下,Kurator应运而生。它不是又一个从零造轮子的平台,而是一个**“云原生乐高”的集成大师**。它基于强大的Karmada多集群编排引擎,将Istio、Prometheus、KubeEdge等一众你耳熟能详的顶级开源项目无缝整合,为你提供开箱即用的统一资源编排、统一调度、统一流量治理和统一可观测性能力。简单说,Kurator想做的就是:把分布式云原生的复杂性留给自己,把简单、统一的操作体验留给用户。

如图是kurator架构参考图,可以看到每一层不同组件间的作用,作为一个整体的统一:

本文将带你从零开始,亲手搭建并探索Kurator,通过真实的操作和深度思考,感受它如何化繁为简,成为你管理分布式云原生基础设施的得力助手。

第一部分:轻松起步——你的第一个Kurator分布式环境搭建

在深入理论之前,让我们先动起手来。一个成功的实践,始于顺畅的环境准备。

1.1 准备工作:理清思路,备好工具

搭建一个分布式环境听起来 daunting,但Kurator通过良好的设计将其简化。在开始之前,请确认你的本地开发环境满足以下基本要求:

- 一台可联网的Linux或macOS主机:作为管理控制平面。

- Kubernetes集群:至少需要一个已存在的Kubernetes集群(版本1.20+),作为安装Kurator的宿主集群(Host Cluster)。Minikube、Kind或任意一个公有云上的托管集群均可。

- kubectl和helm:基础的Kubernetes管理工具。

- 网络通畅:能够访问GitHub和容器镜像仓库。

我们今天的目标是搭建一个最小化的Kurator舰队(Fleet),它包含一个宿主集群和至少一个成员集群。宿主集群负责运行Kurator的控制平面,而成员集群则是被管理的业务集群。

1.2 安装过程:三步走,遇见“拦路虎”与破解之法

安装主要分为三步:获取软件、安装命令行工具、部署控制平面。

第一步:获取Kurator

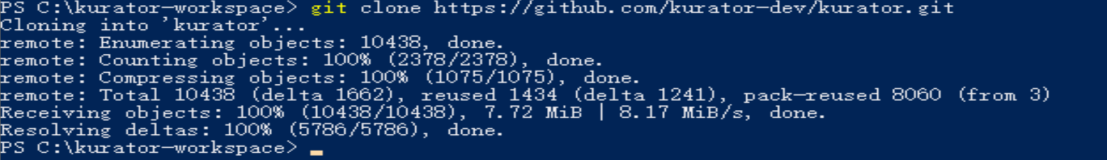

你可以选择下载压缩包或克隆代码库。对于大多数想要快速体验的用户,直接下载最新发布的二进制文件是最快的。但为了更深入的理解,我们选择克隆仓库,里面包含了部署所需的全部CRD和配置文件。

# 克隆 Kurator 仓库到本地

git clone https://github.com/kurator-dev/kurator.git

cd kurator

📌 可能遇到的小问题1:网络连接超时或缓慢。由于仓库托管在GitHub,国内用户偶尔会遇到克隆慢的问题。一个实用的解决办法是使用国内镜像源,或先通过wget下载zip包:wget https://github.com/kurator-dev/kurator/archive/refs/heads/main.zip,再解压查看。

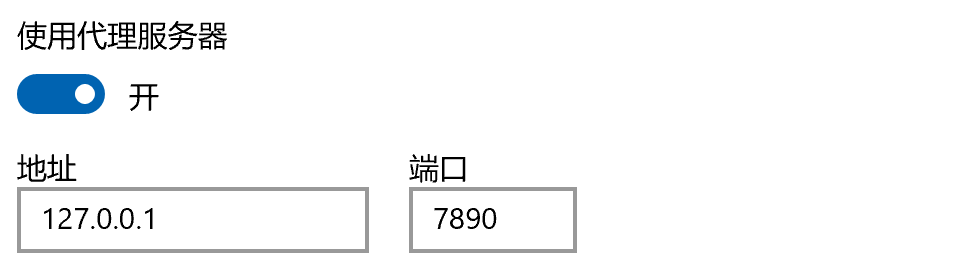

如果显示下面的问题

表示没用设置git代理,我们可以先设置git代理;先看一下电脑上的代理端口

再设置git的代理端口,设置成本地代理

git config --global http.proxy http://127.0.0.1:7890

然后再拉取

git clone https://github.com/kurator-dev/kurator.git

就可以拉取资源了,当然也可以换源,你们可以试试

第二步:安装Kurator CLI工具

CLI工具kurator是你与管理平面交互的主要手段。安装非常简单:

# 进入脚本目录并执行安装

cd kurator/hack

./install-cli.sh

安装后,在终端输入kurator --version验证是否成功。这个工具后续将用于创建集群、管理舰队。

📌 可能遇到的小问题2:脚本执行权限问题。如果报错Permission denied,请执行chmod +x install-cli.sh给脚本添加执行权限。此外,请确保你的$GOPATH/bin或/usr/local/bin在系统的PATH环境变量中,以便全局调用kurator命令。

第三步:部署Kurator控制平面(Cluster Operator)

控制平面是Kurator的大脑,它以Operator的形式运行在你的宿主集群上。我们使用Helm进行一键部署:

# 添加kurator的helm仓库并更新

helm repo add kurator https://kurator.dev/helm-charts

helm repo update

# 在kurator-system命名空间中安装cluster-operator

helm install cluster-operator kurator/cluster-operator -n kurator-system --create-namespace

使用kubectl get pods -n kurator-system查看Pod状态,当所有Pod都显示为Running时,说明控制平面就绪。

📌 可能遇到的小问题3:镜像拉取失败。这是云原生世界最常见的问题之一。由于部分镜像可能托管在quay.io或gcr.io,国内网络环境可能无法直接拉取。解决方法有二:一是使用科学上网;二是预先将所需镜像拉取到可访问的私有仓库,并通过--set image.repository=your-registry.com/kurator参数在Helm安装时覆盖镜像地址。Kurator的文档通常会在安装指南中列出所有需要的镜像。

至此,你的Kurator管理平台已经准备就绪。接下来,就是见证它如何施展魔法的时刻了。

第二部分:核心功能初探——以“统一应用分发”为例感受运维变革

Kurator功能众多,我们挑选 “统一应用分发” 这个最直观、最能体现其价值的场景来深度体验。想象一下,你有一个微服务应用,需要同时部署到位于阿里云、华为云和你本地机房内的三个Kubernetes集群中。没有Kurator时,你需要写三套Helm Chart或Kustomize配置,分别在三个环境中操作三次。而有了Kurator,你只需要一次定义,多处运行。

2.1 功能体验:定义一次,部署到所有集群

首先,我们需要创建一个舰队(Fleet),将我们要管理的三个目标集群聚合在一起。这里我们假设你已经通过Kurator的集群生命周期管理功能(kurator create cluster命令)或手动接入(kurator join命令)了这三个集群。接着,我们编写一个Fleet资源声明:

# fleet-demo.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: production-fleet

namespace: default

spec:

clusters:

- name: cluster-alibaba

kind: AttachedCluster # 表示这是一个已存在、被附着的集群

- name: cluster-huawei

kind: AttachedCluster

- name: cluster-onprem

kind: AttachedCluster

应用这个配置:kubectl apply -f fleet-demo.yaml。Kurator会自动在幕后通过Karmada,将这些集群纳入统一管理。

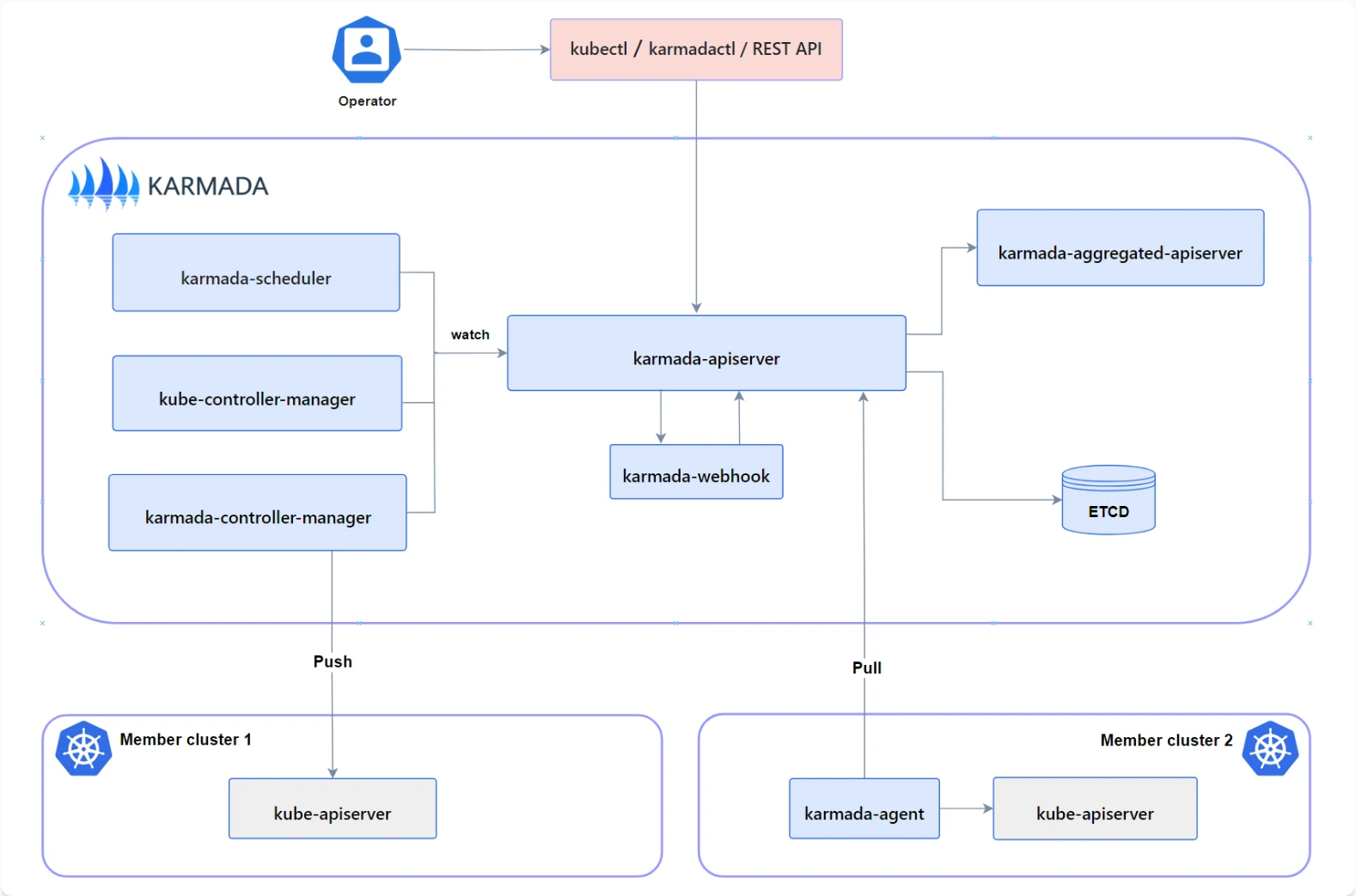

Karmada是一个有趣的东西,这个是karmada架构官方参考图,感兴趣的朋友们可以看看了解一下:

现在,我们来部署一个Nginx应用。你不再需要为每个集群编写Deployment,而是创建一个Kurator提供的DistributionPolicy(分发策略)和ResourceTemplate(资源模板)。

# nginx-distribution.yaml

apiVersion: policy.kurator.dev/v1alpha1

kind: DistributionPolicy

metadata:

name: nginx-global

namespace: default

spec:

resourceSelector:

apiVersion: apps/v1

kind: Deployment

name: nginx-deployment

placement:

clusterAffinity:

clusterNames:

- cluster-alibaba

- cluster-huawei

- cluster-onprem

schedulingMode: Duplicated # 每个集群都部署一份完整的副本

---

apiVersion: apps/v1

kind: Deployment

metadata:

name: nginx-deployment

namespace: default

annotations:

# 这个关键注解告诉Kurator此资源需要被分发

policy.kurator.dev/distribution-policy: nginx-global

spec:

replicas: 2

selector:

matchLabels:

app: nginx

template:

metadata:

labels:

app: nginx

spec:

containers:

- name: nginx

image: nginx:1.21

ports:

- containerPort: 80

当你应用这个yaml文件后,神奇的事情发生了。Kurator的控制平面会监听到这个带有特殊注解的Deployment,并根据关联的DistributionPolicy,将应用自动分发到production-fleet舰队下的三个集群中。你只需要在宿主集群操作一次。

2.2 作用分析:运维模式从“手工劳作”到“智能管控”的升维

这个简单的操作背后,是运维模式的根本性改变。让我们分析一下Kurator的“统一应用分发”带来的价值:

- 一致性得到绝对保障:所有集群中的应用部署定义完全同步,源自同一份“真相之源”。彻底避免了因手动拷贝、修改导致的配置漂移(Configuration Drift)问题。对于金融、政务等对一致性要求极高的场景,这是基石。

- 效率呈指数级提升:运维人员从重复、繁琐的跨集群操作中解放出来。新应用上线、版本回滚、配置更新等操作,从过去的“N次操作”变为“1次操作”,极大地提升了部署效率,并降低了人为出错概率。

- 策略驱动,意图优先:你的关注点从“如何在某个集群部署”上升到了“应该在哪些集群部署、以何种策略部署”。通过

DistributionPolicy,你可以灵活定义分发的目标集群集合(Placement)、调度模式(SchedulingMode,如 duplicated 或 divided)、甚至进行差异化配置(OverridePolicy)。运维变得更声明式、更智能。

这种“舰队”抽象和“策略驱动”的分发模型,正是Kurator站在Karmada等巨人肩膀上,为实际生产环境提炼出的最佳实践封装。它让多集群管理从一种“高技术门槛的杂技”,变成了任何团队都能轻松上手的“标准操作”。

第三部分:实战深化——构建企业级分布式云原生平台的落地思考

光有功能体验还不够,让我们代入一个更真实的场景,看看Kurator如何助力一个中型互联网公司“凌云科技”完成他们的云原生演进。

3.1 技术选型与适配:为什么是Kurator?

“凌云科技”原有业务集中在阿里云,随着业务发展,他们需要将服务延伸至边缘节点(智能工厂)以满足低延迟需求,同时为了数据安全,部分核心业务需留在私有云。他们面临着混合云+边缘的典型分布式架构挑战。

在技术选型时,他们评估了若干方案:

- 方案A:自研多集群管控平台:投入大、周期长、风险高。

- 方案B:采用多个独立工具链(如用Argo CD做分发,用Submariner做网络)。集成复杂度高,各工具间接口不一,维护成本巨大。

- 方案C:采用Kurator:一个集成化的统一平台。

他们最终选择了Kurator,核心原因是其 “开箱即用的一体化” 特性。Kurator不仅基于Karmada解决了最根本的多集群编排问题,更关键的是,它预集成并深度优化了云原生生态的“黄金搭档”:

- 流量治理:直接集成Istio,提供跨集群的统一服务发现和东西向流量治理,这让微服务在跨云通信时与在单一集群内体验无异。

- 监控告警:集成Prometheus + Thanos,自动收集所有成员集群的指标,在控制平面提供统一的监控视图,解决了“数据孤岛”问题。

- 边缘协同:原生集成KubeEdge,将Kubernetes的能力无缝延伸至边缘节点,实现了云端应用下发、边缘设备管理的统一。

“这就像购买了一整套智能家居系统,而不是分别购买灯泡、开关和音响然后自己琢磨怎么接线。” —— 凌云科技的架构师这样评价。

3.2 场景落地与攻坚:从平滑对接到价值呈现

落地过程并非一帆风顺。团队遇到了两个主要挑战:

挑战一:现有集群的平滑接入。

公司已有数十个运行中的业务集群,如何以最小侵入式的方式接入Kurator?Kurator的 AttachedCluster 资源类型成了救星。它允许你通过提供目标集群的kubeconfig,将其作为“已附着集群”纳入舰队管理,无需在目标集群预先安装任何Kurator组件,实现了对存量环境的零打扰接入。

挑战二:跨云网络互通。

阿里云、私有云和边缘节点网络不互通。Kurator本身不直接解决底层网络问题,但它与Submariner、Cilium ClusterMesh等跨集群网络方案友好兼容。团队最终选择了Cilium,利用其BGP模式打通了云间网络。Kurator的价值在于,在网络打通后,它能基于统一的Service DNS名称进行服务发现和流量调度,屏蔽了底层网络的复杂性。

用户反馈与商业效益:

- 运维团队:从“救火队员”变为“规划师”。以前40%的时间用于处理各集群的部署差异和网络故障,现在90%的时间可专注于优化资源利用率和制定分发策略。

- 开发团队:获得了透明的跨集群部署能力。发布新功能时,只需关心业务镜像和资源配置,无需知晓最终运行在哪个云上,实现了真正的基础设施无关性。

- 商业效益:资源成本优化约15%。通过Kurator的统一视图和调度策略,可以更智能地将在线业务、批量计算任务调度到不同性价比的云资源或边缘资源上。边缘场景的落地,更是直接帮助公司拿下了两个重要的工业互联网项目,带来了新的增长点。

3.3 生态协同与未来:Kurator的“连接器”价值

Kurator的生态价值在于它扮演了一个 “超级连接器” 的角色。它没有试图替换Istio、Prometheus,而是承认它们在其专业领域的领导地位,并致力于解决它们之间的“连接”与“协同”问题。

对于开源社区,Kurator的实践为云原生项目集成提供了一个优秀范本。它证明了通过合理的抽象和CRD设计,可以将多个复杂系统的能力聚合成一个更高级、更易用的产品力。对于用户和企业,它大幅降低了分布式云原生技术的整体拥有成本(TCO)和入门门槛,加速了混合云和边缘计算技术的普惠化。

总结与展望

通过从搭建到功能体验,再到深度实战案例的剖析,我们可以看到Kurator绝非简单的工具堆砌。它是一个经过深思熟虑设计的、面向生产级分布式云原生环境的一站式管理平台。它的核心优势在于集成、统一和简化。

对于正在或即将踏上分布式云原生之旅的团队,Kurator提供了一个极具吸引力的起点。它让你无需在整合各种工具上耗费大量精力,而是能快速获得关键的跨集群管理能力,从而将宝贵的研发资源聚焦于业务创新本身。

当然,Kurator作为一个年轻的项目,仍在快速发展中。在诸如多集群安全策略的统一管理、更精细化的成本分析与优化、对更多异构计算资源(如Serverless容器、函数)的支持等方面,社区还有广阔的探索空间。但它的理念和已经实现的能力,已经为我们清晰地描绘了分布式云原生管理的未来图景:统一、智能、无处不在。

无论你是想初步了解多集群管理,还是正在为复杂的混合云环境寻找破局之道,Kurator都值得你花费一个下午的时间,亲自部署和尝试。它可能会成为你云原生工具箱中最具战略价值的那一件。

Kurator分布式云原生开源社区地址:https://gitcode.com/kurator-dev

Kurator分布式云原生项目部署指南:https://kurator.dev/docs/setup/

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)