【前瞻创想】解锁分布式云原生新范式:一个云原生老兵的Kurator实战与深度思考,从零构建一体化管理平台

【前瞻创想】解锁分布式云原生新范式:一个云原生老兵的Kurator实战与深度思考,从零构建一体化管理平台

【前瞻创想】解锁分布式云原生新范式:一个云原生老兵的Kurator实战与深度思考,从零构建一体化管理平台

一、 缘起与挑战:我们为何需要Kurator这样的“粘合剂”?

在多年的云原生社区参与和技术布道生涯中,我亲眼见证了企业从单集群走向多集群,再到混合云、边缘计算的演进历程。每一次架构升级都带来新的能力释放,但也伴随着管理复杂度的指数级增长。你是否也曾被这些问题困扰?

- 异构环境协同之痛:中心云、边缘节点、第三方云上的集群宛如信息孤岛,部署应用需要写多套配置,执行多次命令。

- 技术栈集成之殇:即便选用了Karmada、Istio、Prometheus等顶级开源项目,将它们有机整合、统一运维所耗费的精力,常常超过业务开发本身。

- 一致体验难求:开发者渴望一致的部署、监控、调试体验,而运维者则追求统一的策略、安全和合规管控,这在分布式环境下往往难以两全。

正是在这样的背景下,Kurator 走入了我的视野。它不是一个从零造轮子的平台,而是一个精准的 “价值整合者”。官方定义是“开箱即用的分布式云原生管理平台”,但我更愿意称它为 “云原生乐高套装的专业说明书” 。它将以Karmada为核心的多套顶级开源软件(Istio, Prometheus, KubeEdge, Volcano等)精巧地集成在一起,并提供统一的操作入口和管理平面,让企业能快速获得跨云、跨边、跨集群的一体化管控能力。

二、 Kurator全景透视:一体化设计如何化繁为简?

Kurator的设计哲学深深吸引了我:“集成优于构建,体验优于功能堆砌”。它没有选择重复发明类似Karmada的多集群调度轮子,而是站在巨人的肩膀上,做更高层次的抽象和串联。

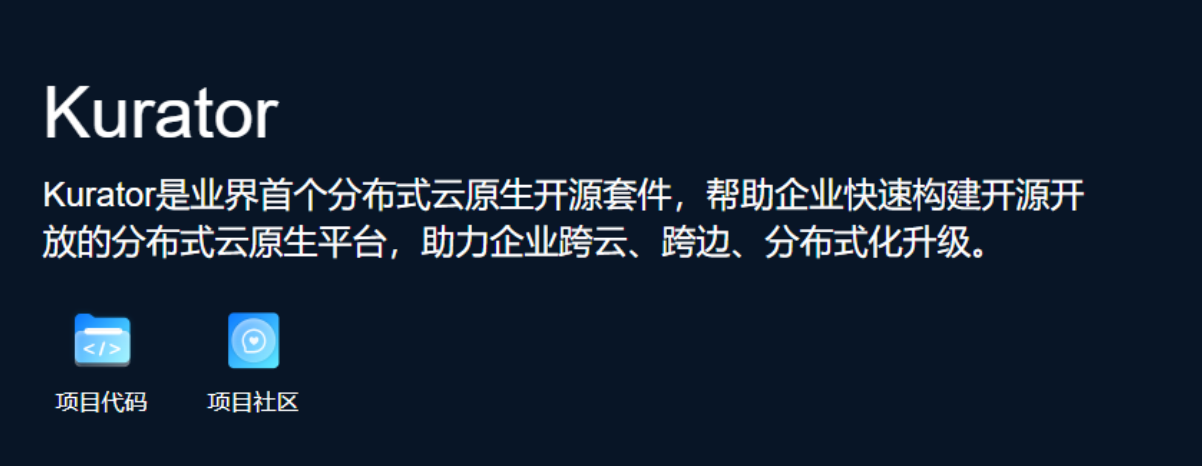

2.1 核心架构:三层设计,各司其职

Kurator的架构清晰体现了其定位:

- 基础设施层:纳管任何符合标准的Kubernetes集群,无论是公有云、私有云还是边缘节点。

- 协同编排层:以 Karmada 为坚实底座,实现真正的“一次定义,随处部署”。Kurator在此基础上,通过自定义资源定义(CRD)和控制器,进一步简化了多集群应用和策略的声明方式。

- 统一能力层:这是Kurator的“魔法”所在。它通过Fleet(集群舰队) 这一核心概念,将分布式集群抽象为一个逻辑整体。在这个Fleet之上,所有的高级能力——如通过Istio实现的统一流量治理、通过Prometheus+Thanos实现的统一可观测性、通过Volcano实现的统一批量调度、通过KubeEdge实现的云边协同——都被无缝集成并提供一致的操作接口。

从Kurator架构参考图中可以看到Kurator的三层架构,我们还能看到Kurator的组件部分:

2.2 创新优势:不止于集成

与单纯的项目堆砌相比,Kurator带来了几个关键的创新点:

- 声明式的舰队管理:你只需要用YAML描述你想要的多集群拓扑和策略,Kurator会自动完成集群的注册、组件安装和策略分发。这比手动操作或编写特定脚本的可靠性高出一个数量级。

- 能力按需装配:你需要流量治理吗?启用Istio组件。需要边缘计算吗?装配KubeEdge。这种模块化设计避免了“一刀切”带来的资源浪费,让平台更轻盈。

- 统一的操作体验:无论是通过

kurator命令行工具,还是通过观察Fleet相关的CRD状态,你都能在一个地方掌握全局。这极大地降低了认知负荷和操作风险。

三、 深潜核心组件:Kurator如何驾驭这些“明星项目”?

理解Kurator如何集成这些顶级项目,是评估其价值的关键。我们来剖析几个核心集成点。

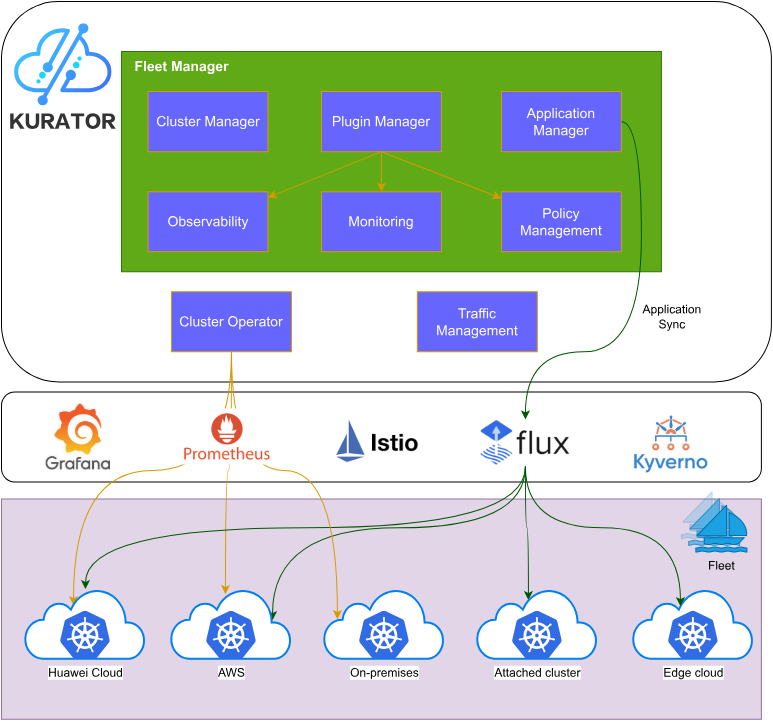

3.1 以Karmada为引擎的跨集群调度

Karmada是Kubernetes原生API的多集群、多云编排引擎。Kurator并非简单封装,而是通过 Fleet 和 Cluster 资源,提供了更上层的抽象。

# 一个简化的Fleet示例,声明一个包含两个集群的舰队

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: production-fleet

spec:

clusters:

- name: cloud-cluster

credential: # 引用集群访问凭证

- name: edge-cluster

credential:

# 在这个Fleet上可以关联各种插件,如监控、网络

plugin:

monitoring: {} # 启用监控插件(将自动部署Prometheus+Thanos)

当你创建一个Fleet时,Kurator的后台控制器会自动在目标集群上安装Karmada的Agent(karmada-agent),并完成集群的自动加入。这意味着你将复杂的跨集群网络和安全配置,简化为了对Fleet资源的状态维护。

Karmada调度引擎官方参考图:

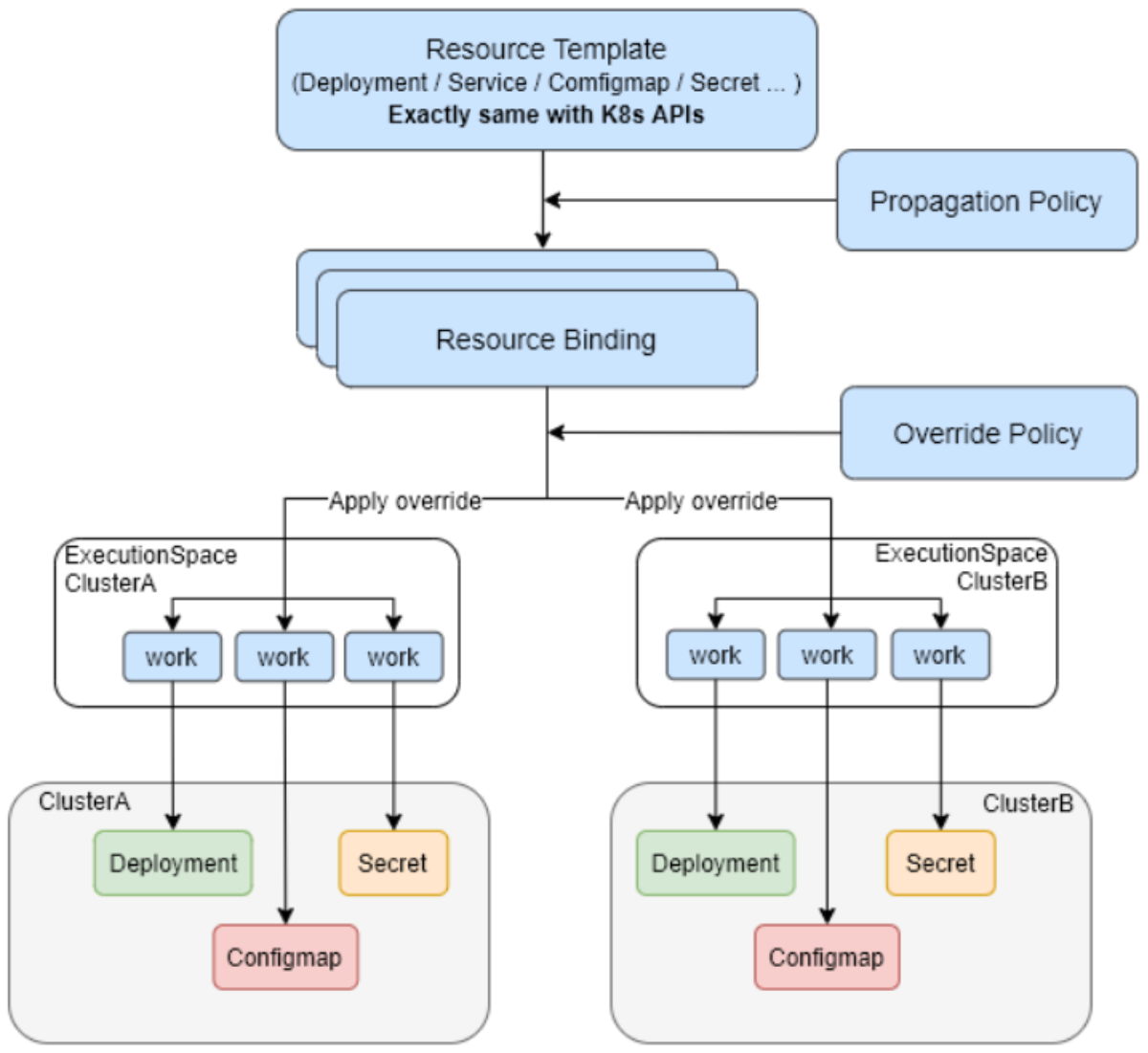

3.2 统一流量治理:集成Istio的智慧

在分布式场景下,服务可能分布在多个集群。Kurator通过集成Istio及相应的多集群服务网格方案,实现了跨集群的服务发现和流量路由。

其关键在于,Kurator管理了多集群环境下Istio控制平面和数据平面的协同部署与配置分发。它确保了所有集群内的Envoy边车代理能够接收来自正确控制平面的指令,并能解析其他集群中的服务地址。这使得一个集群内的服务可以像调用本地服务一样,透明、安全地调用另一个集群中的服务,并支持全局限流、熔断和灰度发布策略。

lstio服务网格参考图,不同服务的流量经过lstio的统一流量治理:

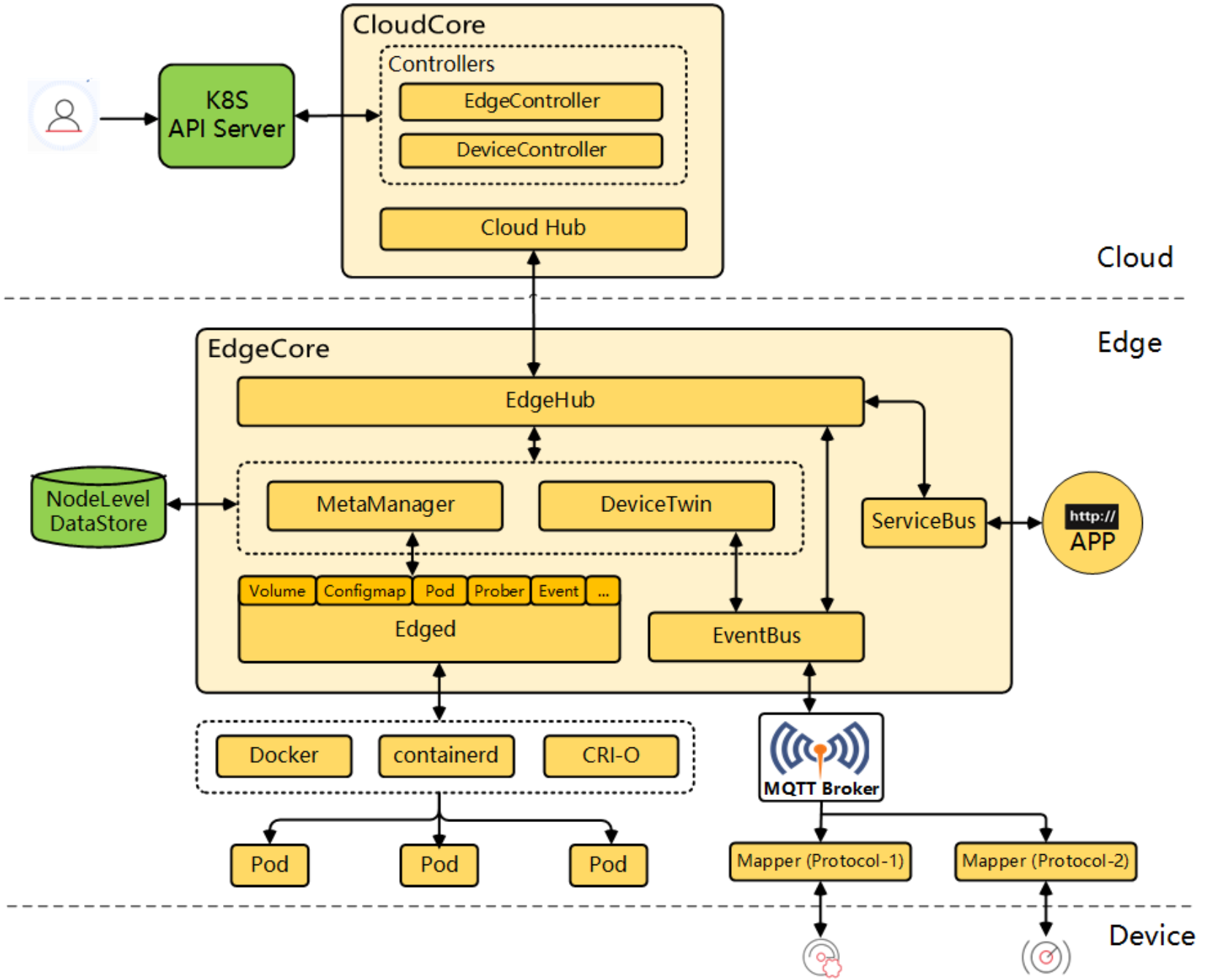

3.3 云边协同:KubeEdge的无缝融合

对于边缘计算场景,Kurator对KubeEdge的集成尤为亮眼。它简化了边缘节点的大规模纳管流程。

- 边缘集群定义:在Fleet中定义一个边缘集群时,可以指定其特性(如资源受限、网络不稳定)。

- 自动部署:Kurator会自动在该集群的云端部分部署KubeEdge的云核心(CloudCore),并生成边缘侧(EdgeCore)的安装令牌和配置。

- 应用协同分发:通过Karmada,你可以将一个应用的工作负载(Deployment)下发到边缘集群。Karmada负责将应用下发到边缘集群的云端,而KubeEdge则负责将其进一步同步到成千上万的边缘节点。

这是KubeEdge架构参考图,朋友们可以看看他的组件部分和不同组件的链接:

这个过程将原本需要深度定制和手工操作的云边协同,变成了一个声明式的、自动化的流程。

四、 实战启航:快速构建你的第一个分布式舰队

理论已足,让我们动手。以下实践基于Kurator最新版本,假设你已有一个可以操作的Kubernetes集群作为“主集群”(Host Cluster)。

4.1 环境准备与Kurator安装

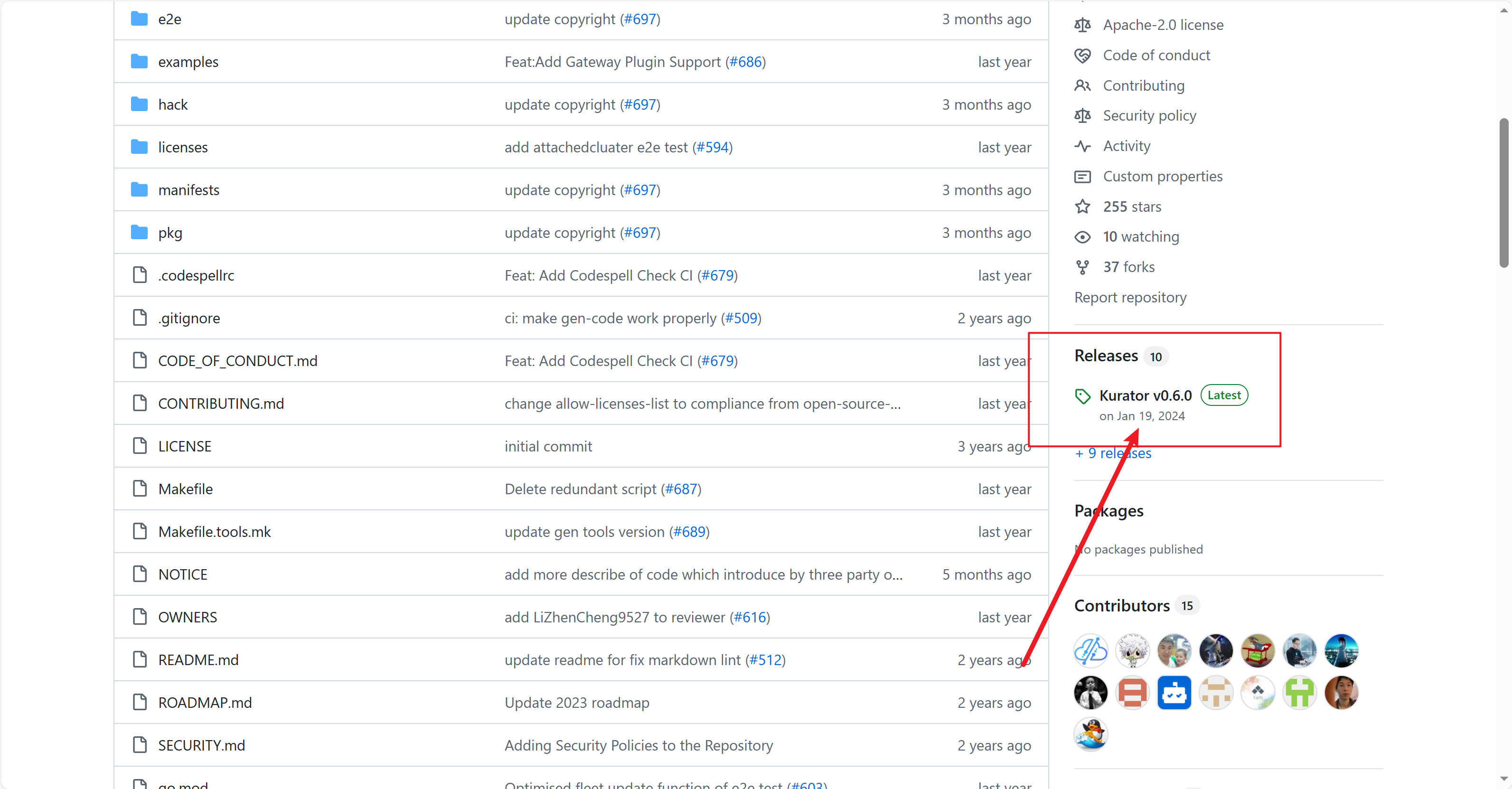

首先,获取Kurator的源代码,里面包含了部署所需的清单文件和工具。

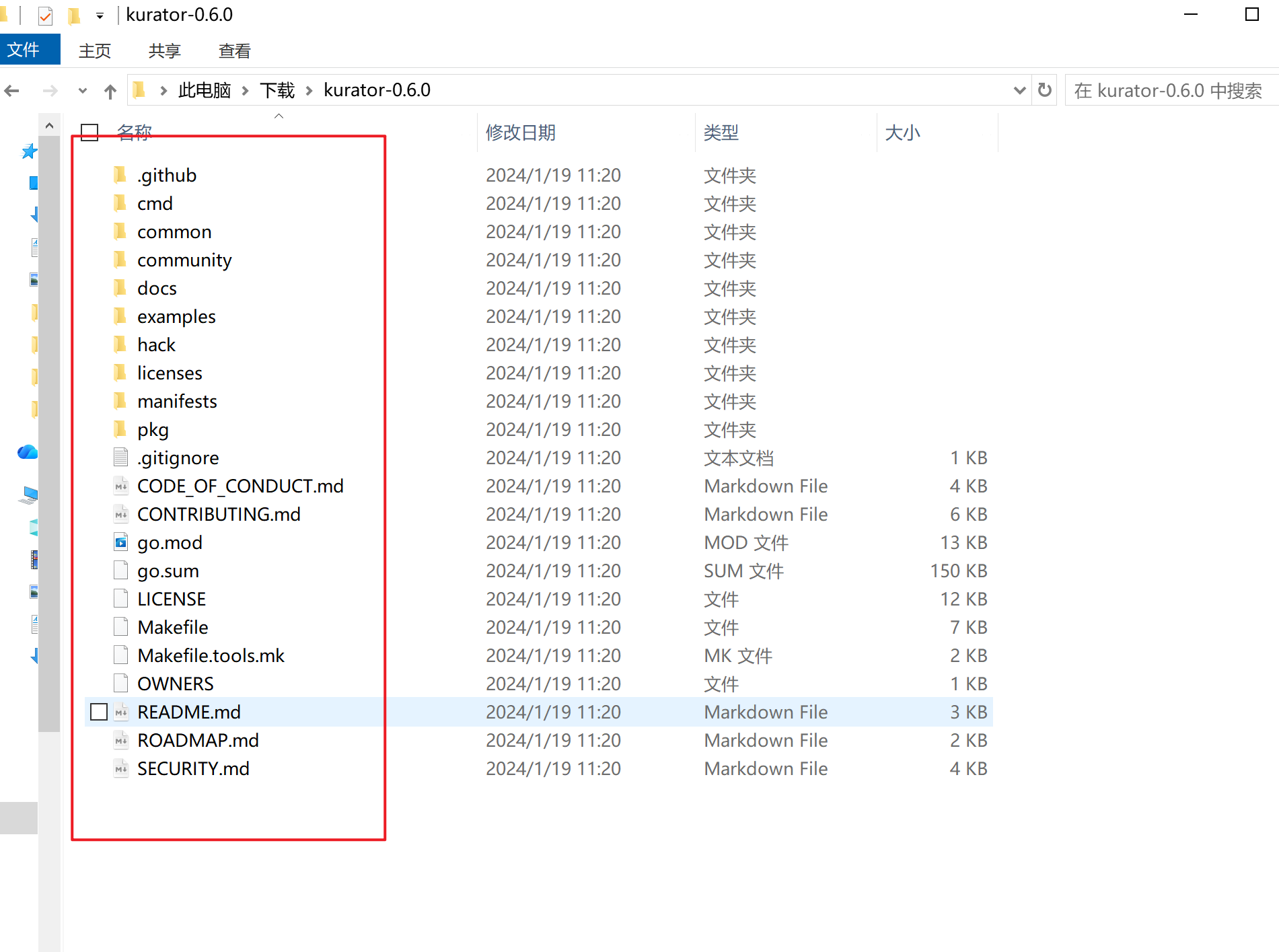

我们可以从github上面下载源码,我把源码标注出来啦

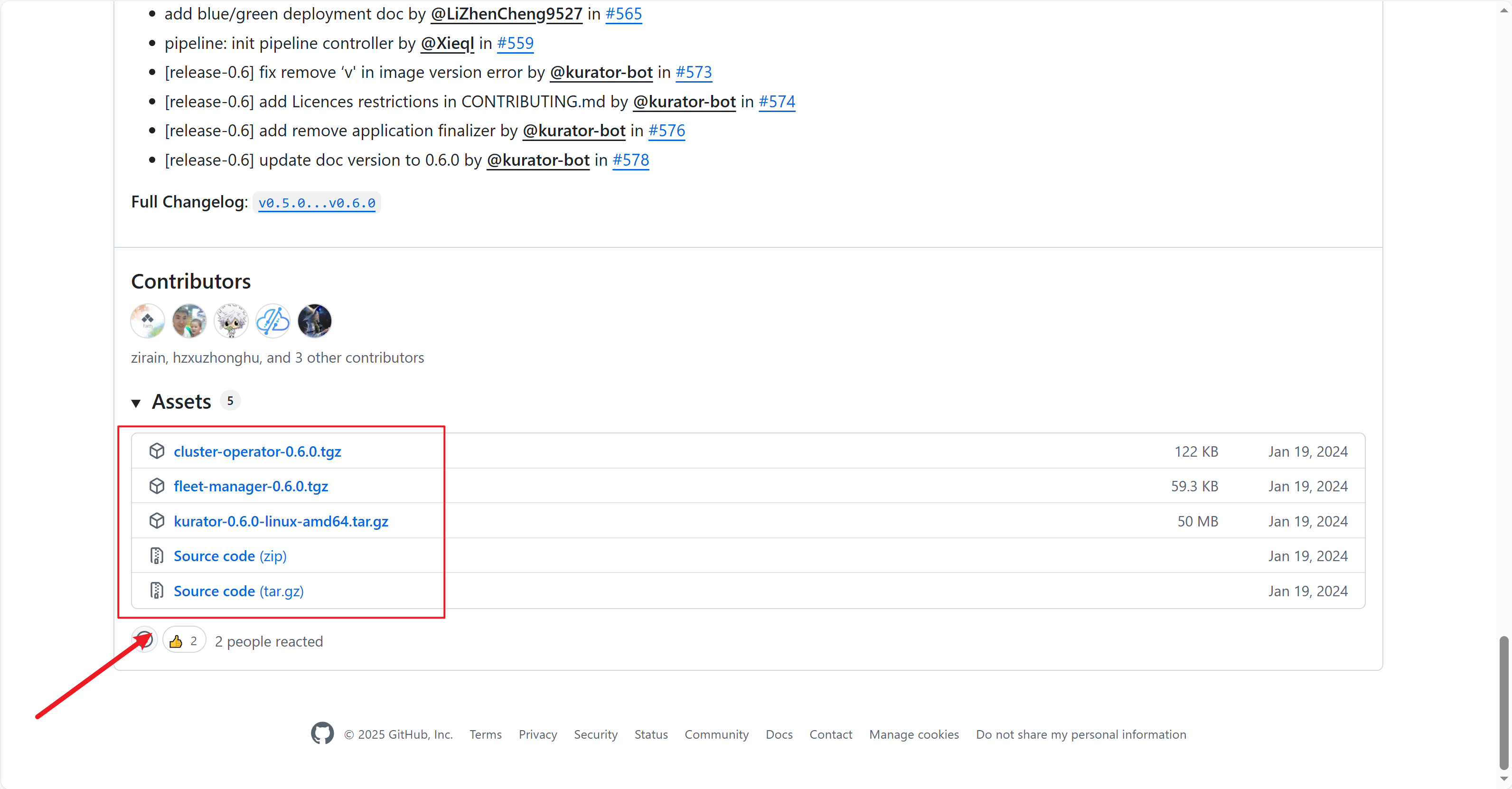

点击后拉到最下面就可以看到源码压缩包啦,不同需求的朋友可以下载不同平台的源码

下载下来解压就可以看到源码文件啦

接下来,我们使用项目提供的脚本安装kurator命令行工具和核心的Cluster Operator。这个Operator是管理集群生命周期的核心组件。

# 安装 kurator cli 工具

make install.cli

# 验证安装

kurator version

# 在主机集群上安装 cluster operator

kubectl apply -f ./deploy/cluster-operator.yaml

等待Cluster Operator的Pod进入Running状态:

kubectl get pods -n kurator-system -w

4.2 创建并纳管首个集群舰队

现在,我们假设你还有另外两个Kubernetes集群(可以是Minikube、Kind创建的测试集群),目标是将它们纳管进来,形成一个舰队。

第一步,为要纳管的集群创建访问凭证Secret。在主集群上执行:

# 将目标集群的kubeconfig文件内容复制过来,创建secret

# 这里以名为 “member-1” 的集群为例

kubectl create secret generic member-1-kubeconfig --from-file=kubeconfig=/path/to/member-1-kubeconfig -n kurator-system

第二步,创建 Cluster 自定义资源,代表一个被纳管的集群。

# cluster-member1.yaml

apiVersion: cluster.kurator.dev/v1alpha1

kind: Cluster

metadata:

name: member-1

namespace: default

spec:

kubeconfig:

secretRef:

name: member-1-kubeconfig

namespace: kurator-system

key: kubeconfig

kubectl apply -f cluster-member1.yaml

创建后,Kurator的Cluster Operator会开始工作,与目标集群建立连接并验证其状态。

第三步,将多个Cluster聚合为一个 Fleet。

# my-first-fleet.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: my-first-fleet

namespace: default

spec:

clusters:

- name: member-1

kind: Cluster

apiVersion: cluster.kurator.dev/v1alpha1

# 可以继续添加 member-2, member-3...

kubectl apply -f my-first-fleet.yaml

至此,你已经成功创建了一个逻辑上的集群舰队。你可以检查Fleet的状态:

kubectl get fleet my-first-fleet -o yaml

在状态中,你将看到各个集群的健康状况以及已安装的组件信息。

4.3 启用高级能力:以统一监控为例

有了舰队,我们就可以轻松地为其添加能力。启用统一监控是一个展示Kurator价值的好例子。

你只需要在Fleet的配置中启用Monitoring插件即可。Kurator会利用其内置的配置,自动在舰队的所有集群中部署一套完整的监控栈:在每个集群部署Prometheus,在主集群或指定集群部署Thanos用于全局查询和长期存储。

# fleet-with-monitoring.yaml

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: monitored-fleet

spec:

clusters:

# ... 集群列表

plugin:

monitoring:

thanos: {} # 启用Thanos组件进行全局聚合

# 你可以在这里进行详细的监控配置,如存储大小、数据保留策略等

应用这个配置后,Kurator会启动一系列任务,完成跨集群的Prometheus配置、服务发现、以及Thanos Sidecar的注入。最终,你可以通过一个统一的Grafana界面,查询和观测所有集群的指标,而无需在每个集群间手动切换。

五、 深度场景演练:构建跨集群金丝雀发布流水线

为了体现Kurator的实践深度,我们构想一个进阶场景:为一个微服务应用,在横跨中心云和边缘云的舰队中,实现自动化的金丝雀发布。这需要融合统一应用分发、统一流量治理和统一监控三项能力。

步骤分解:

- 应用定义:使用Kurator(背后是Karmada)的

PropagationPolicy,将一个应用的Deployment和Service定义分发到舰队中的两个集群:cloud-cluster(承担95%流量)和edge-cluster(承担5%流量,用作金丝雀环境)。 - 监控就绪:确保上述监控插件已启用,并已配置好针对该应用的业务指标(如请求延迟、错误率)的收集和告警。

- 流量调度:通过Kurator集成的Istio多集群网格,配置

VirtualService和DestinationRule。初始状态,所有流量指向cloud-cluster的服务版本v1。 - 发布与观测:将新版本v2的应用,仅分发到

edge-cluster。然后,修改Istio的流量规则,将5%的全局流量切到edge-cluster的v2版本。 - 决策与完成:在监控平台上观察v2版本的关键指标。若在预设观察期内一切正常,则逐步将v2版本分发到

cloud-cluster并扩大流量比例,直至完成100%发布。若出现异常,则立即将edge-cluster的流量切回v1版本,并进行回滚。

这个过程看似复杂,但通过Kurator提供的统一抽象和API,可以被编排到一个GitOps流水线中。开发者只需在Git仓库中更新应用镜像版本和流量策略的声明文件,Kurator便能协同Karmada和Istio,自动、可靠地完成整个跨区域的金丝雀发布流程。这极大地降低了分布式发布的复杂性和风险,是Kurator“一体化”价值的极致体现。

六、 展望与谏言:分布式云原生的未来与Kurator的机遇

基于我在云原生社区的观察,分布式云原生正在从“可选”走向“必选”。未来,基础设施将更加泛在,从数据中心延伸到5G MEC、工厂、车载计算单元。这意味着管理对象的规模、异构性和网络不确定性会剧增。

对Kurator项目的发展,我有以下几点浅见:

- 强化“策略即代码”与GitOps:当前Kurator提供了声明式API,未来可以更深度地与Flux/Argo CD等GitOps工具集成,将整个舰队的安全策略、网络策略、合规基线都纳入版本化、可审计的GitOps流程中,实现真正意义上的不可变基础设施。

- 深化对“边缘”特性的感知与调度:与KubeEdge的集成是一个开始。未来需要更智能的策略,例如:根据边缘节点的网络带宽、存储空间、电池电量等动态条件,自动调整工作负载的部署和行为(如离线模式切换、数据缓存策略)。

- 构建面向应用的智能调度建议:当前的调度主要基于资源。未来可以集成机器学习能力,分析应用的历史运行数据(性能、故障关联性),向开发者建议更优的多集群部署拓扑,例如:“将A服务和B服务部署在同一可用区以减少延迟”或“避免将此服务部署在上月发生过故障的集群”。

- 拥抱开放标准,降低锁定风险:Kurator以Karmada为基础是明智之举。未来应持续拥抱如OCM(Open Cluster Management)、Service Mesh Interface(SMI)等开放标准或事实标准。这能确保用户的核心资产(如应用定义、策略)不被单一平台锁定,保持架构的灵活性与可持续性。

七、 结语:成为分布式云原生时代的“驾驭者”

回顾这次Kurator的探索之旅,它给我的最大启示是:在云原生技术爆炸的时代,“选择与集成”的能力,其重要性正逐渐赶超“从零构建”的能力。Kurator项目正是这种理念的优秀实践。它将一系列复杂且强大的开源项目,通过精巧的设计粘合起来,提供了一条通往分布式云原生的平滑升级路径。

对于企业而言,与其投入巨大成本自行整合并维护一套分布式云平台,不如基于Kurator这样的开源方案进行定制和扩展,将核心团队精力聚焦于创造差异化业务价值。

对于开发者而言,学习Kurator是理解分布式云原生完整图景的绝佳方式。它帮你跳出了单一工具的局限,从一个更高的视角去思考如何设计、部署和管理一个真正健壮、弹性的全球化应用。

分布式云原生的浪潮已至,愿你我都能借助像Kurator这样的利器,从容驾驭,破浪前行。

Kurator分布式云原生开源社区地址:https://gitcode.com/kurator-dev

Kurator分布式云原生项目部署指南:https://kurator.dev/docs/setup/

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)