【探索实战】跨云统一管理:Kurator 在分布式云原生环境中的深度实践

【探索实战】跨云统一管理:Kurator 在分布式云原生环境中的深度实践

1. 引言:分布式云原生时代的管理挑战

近年来,随着云原生技术的快速发展,企业基础设施已从单一集群扩展到多云、多集群的复杂架构。根据行业报告,到2025年,超过75%的企业将拥有超过10个Kubernetes集群,分布在不同云平台和边缘节点。这种分布式架构带来了新的管理挑战:集群配置碎片化、应用分发效率低下、监控数据孤岛、安全策略不一致等问题,严重影响了运维效率和业务稳定性。

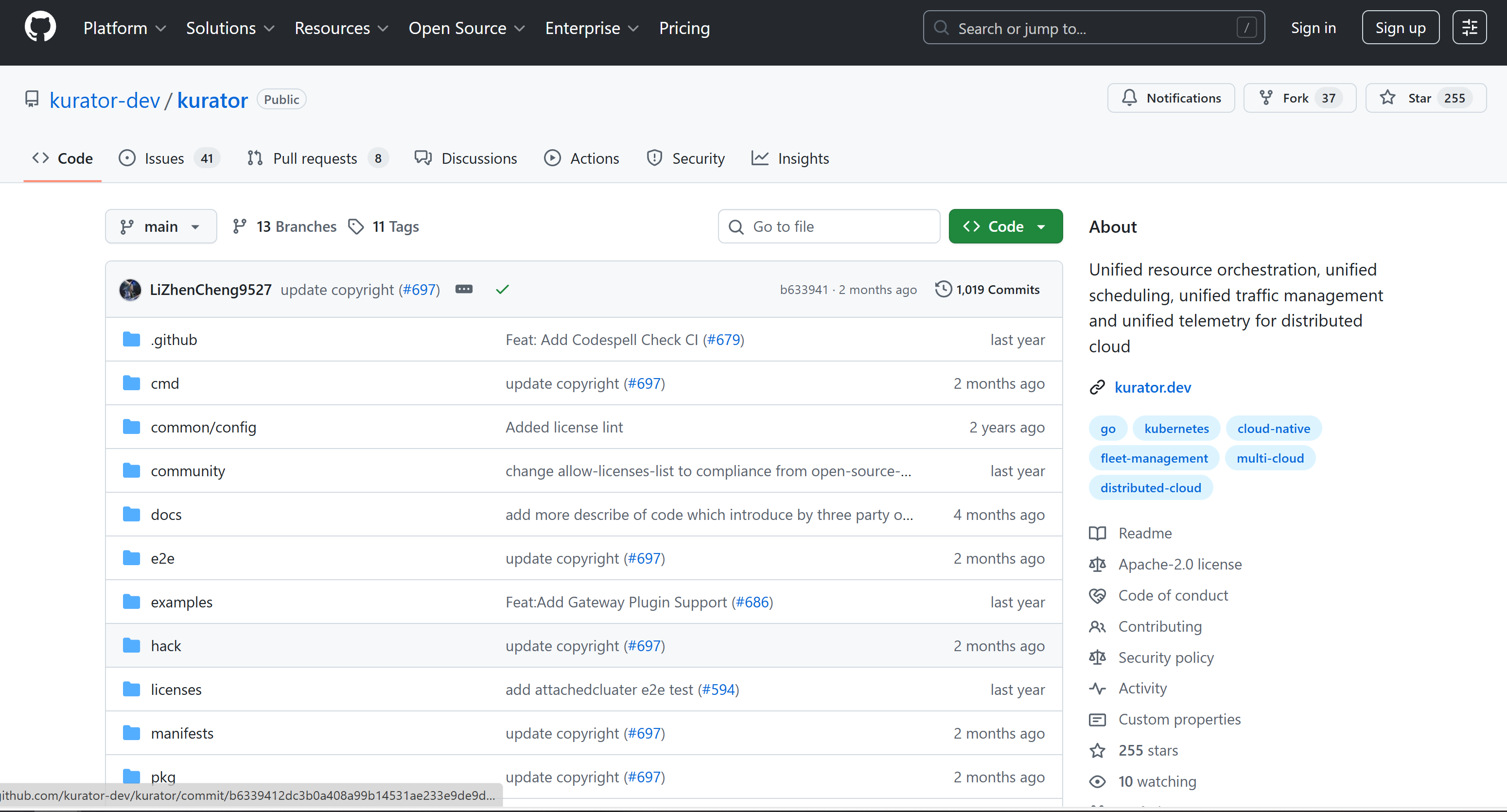

Kurator作为业界首个分布式云原生开源套件,应运而生。它通过集成多种主流云原生技术栈,提供了一站式的分布式云原生解决方案,帮助企业构建统一的管理平面,实现跨云、跨边的无缝运维体验。本文将基于实际环境搭建、核心功能实践和企业落地案例,深入解析Kurator如何解决分布式环境下的管理难题。

2. Kurator 初探:理解架构设计与核心概念

2.1 Kurator 的架构设计理念

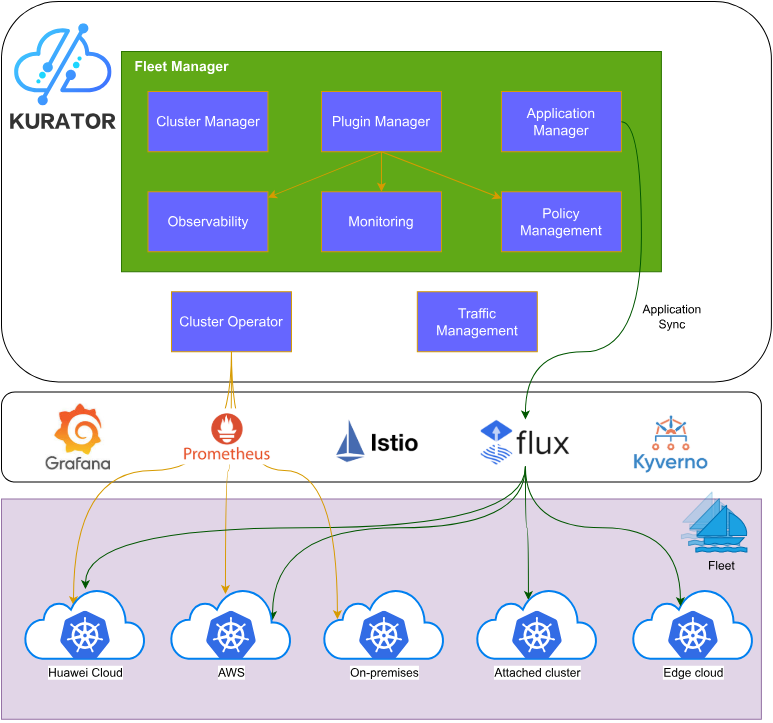

Kurator采用了"控制平面-数据平面"的经典架构,其核心设计理念是统一管理与分布式执行的平衡。控制平面负责全局策略制定和状态协调,而数据平面则在各个集群中执行具体任务,这种设计既保证了管理的集中性,又不影响本地执行的效率。

Kurator的两个核心组件——Cluster Operator和Fleet Manager,分别承担了不同的职责:

- Cluster Operator:负责Kubernetes集群的生命周期管理,通过声明式API简化集群的创建、配置和维护。

- Fleet Manager:以"舰队"(Fleet)为管理单元,将多个物理集群组织成逻辑统一的资源池,提供统一的操作入口。

2.2 关键概念解析:Fleet 与 AttachedCluster

Fleet(舰队) 是Kurator中最核心的抽象概念,它代表了一组具有相同管理策略的集群集合。通过Fleet,管理员可以批量执行应用分发、监控配置和策略管理,而无需逐个操作每个集群。

AttachedCluster 是Kurator的一个重要创新,它允许纳管任何地点、由任何工具搭建的Kubernetes集群。这意味着企业现有的集群无需重建或迁移,即可快速接入Kurator的管理体系,极大降低了迁移成本和风险。

以下是一个AttachedCluster的配置示例:

apiVersion: cluster.kurator.dev/v1alpha1

kind: AttachedCluster

metadata:

name: production-cluster

namespace: default

spec:

kubeconfig:

name: cluster-config-secret

key: kubeconfig

这段代码展示了如何将现有集群接入Kurator管理,只需提供标准的kubeconfig配置即可。

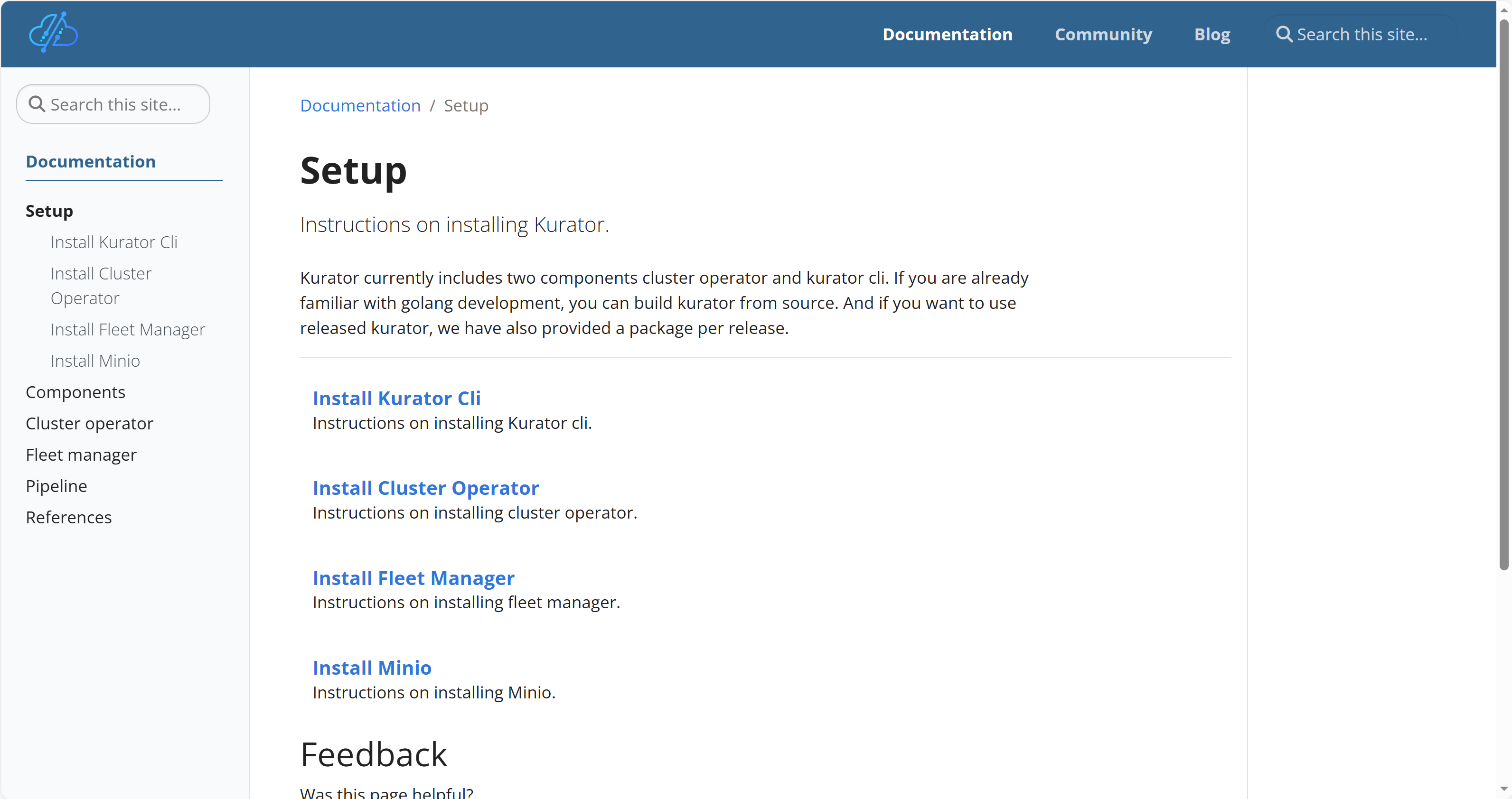

3. 环境搭建实战:从零构建分布式管理平台

3.1 准备工作与依赖检查

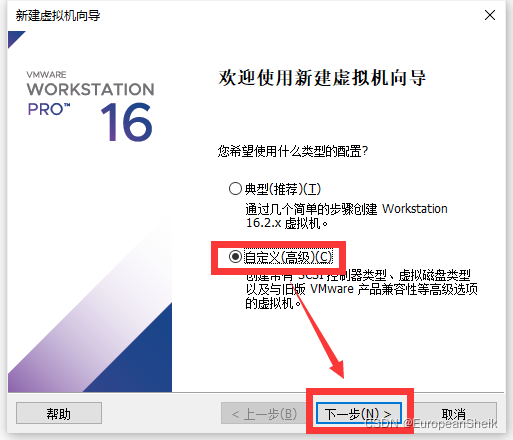

在开始搭建Kurator环境前,需要准备一个作为管理中心的Kubernetes集群,这个集群可以位于任何环境(本地数据中心或公有云)。我的测试环境使用了3个集群:1个作为管理集群(4核8GB内存),2个作为成员集群(各2核4GB内存),分别模拟不同云环境下的业务集群。

系统要求:

- Kubernetes版本:1.20+

- 容器运行时:Docker 20.10+ 或 containerd

- 网络要求:管理集群需要能够访问成员集群的API Server

3.2 安装过程与问题排查

Kurator提供了Helm Chart和命令行工具两种安装方式。我选择了Helm安装,整个过程较为简单:

helm repo add kurator https://kurator.dev/helm-charts

helm install kurator kurator/kurator --namespace kurator-system --create-namespace

然而,在实际安装过程中,我遇到了两个典型问题:

问题一:证书验证失败

在安装完成后,访问Kurator API时遇到TLS证书错误。经排查发现,管理集群的系统时间不同步,导致证书验证失败。解决方法是在所有节点上安装并配置chronyd服务,确保时间同步。

问题二:成员集群注册超时

在将首个成员集群注册到Fleet时,连接持续超时。通过查看Agent日志,发现是防火墙规则阻止了Agent与控制平面的通信。解决方案是在企业安全组中放行8080端口(Kurator Agent默认端口),并验证网络连通性。

3.3 集群注册与验证

成功安装Kurator后,接下来需要将成员集群注册到Fleet中。我使用了AttachedCluster资源,这是一个非常实用的设计,允许将非Kurator创建的集群纳入管理。

注册完成后,通过以下命令验证集群状态:

kubectl get attachedclusters -n kurator-system

kubectl get fleets -n kurator-system

所有集群状态显示为"Ready"后,即可通过Kurator的Dashboard查看全局资源视图,这一步标志着分布式管理平台已就绪。

4. 核心功能深度实践

4.1 统一应用分发:GitOps在分布式环境的实现

Kurator的统一应用分发功能基于GitOps理念,通过集成FluxCD,实现了跨集群的应用部署和同步。在实际测试中,我创建了一个简单的Web应用,并将其分发到Fleet中的三个集群。

以下是一个应用分发的配置示例:

apiVersion: apps.kurator.dev/v1alpha1

kind: Application

metadata:

name: webapp-demo

namespace: default

spec:

source:

gitRepository:

interval: 3m0s

ref:

branch: main

timeout: 1m0s

url: https://github.com/example/webapp

syncPolicies:

- destination:

fleet: production-fleet

kustomization:

interval: 5m0s

path: ./deploy/overlays/production

prune: true

timeout: 2m0s

这个配置定义了从Git仓库获取应用配置,并通过Fleet将应用同步到多个集群的过程。

价值分析:

- 一致性保障:通过GitOps确保所有集群中的应用版本和配置完全一致,避免了人工操作导致的配置漂移。

- 效率提升:传统方式需要在每个集群中单独执行部署命令,而Kurator实现了"一次配置,处处运行",部署时间从小时级缩短到分钟级。

- 可追溯性:所有变更通过Git仓库管理,提供了完整的审计 trail,便于问题排查和回滚。

4.2 统一监控:跨集群指标聚合与查询

在分布式环境中,监控数据的分散是一大挑战。Kurator提供了基于Prometheus、Thanos和Grafana的统一监控方案。我在测试环境中部署了这套监控栈,体验了其全局监控能力。

监控体系的架构如下:

- 每个集群运行一个Prometheus实例,负责收集本地监控数据。

- 每个Prometheus配备Thanos Sidecar,将指标数据上传到对象存储。

- Thanos Query组件聚合所有集群的数据,提供统一的查询接口。

- Grafana配置Thanos Query作为数据源,展示全局视图。

以下是在Fleet中启用监控的配置:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: monitoring-fleet

namespace: default

spec:

clusters:

- name: cluster-aws

kind: AttachedCluster

- name: cluster-local

kind: AttachedCluster

plugin:

metric:

thanos:

objectStoreConfig:

secretName: thanos-objectstore-secret

grafana: {}

这个配置会在舰队中的所有集群上自动安装和配置监控组件。

价值分析:

- 全局视角:管理员可以在一个视图中查看所有集群的健康状态和资源使用情况,无需切换不同监控系统。

- 数据一致性:统一的监控配置确保所有集群采用相同的采集规则和指标定义,便于数据对比和分析。

- 运维简化:传统方式需要在每个集群独立部署和配置监控栈,而Kurator自动化了这一过程,大幅减少了运维负担。

4.3 统一策略管理:跨集群安全与合规

在多云环境中,安全策略的一致执行是极大的挑战。Kurator通过集成Kyverno策略引擎,提供了统一的策略管理能力。我测试了Pod安全策略的实施,验证了其跨集群执行效果。

以下是一个统一安全策略的配置示例:

apiVersion: fleet.kurator.dev/v1alpha1

kind: Fleet

metadata:

name: secured-fleet

namespace: default

spec:

clusters:

- name: aws-cluster

kind: AttachedCluster

- name: local-cluster

kind: AttachedCluster

plugin:

policy:

kyverno:

podSecurity:

standard: baseline

severity: high

validationFailureAction: Audit

这个配置为舰队中的所有集群统一应用了Pod安全策略,当Pod配置违背安全策略时,会在PolicyReport中记录相应事件。

价值分析:

- 合规性保障:确保所有集群遵循统一的安全标准和合规要求,减少了安全漏洞风险。

- 管理效率:通过集中策略定义和自动分发,避免了在各个集群中重复配置,策略更新时间从小时级降至分钟级。

- 灵活控制:支持审计模式和强制执行模式,平衡了安全要求与业务灵活性。

5. 企业落地案例:某制造企业的数字化转型

5.1 背景与挑战

某大型汽车零部件制造企业(以下简称A企业)拥有5个生产基地,每个基地都运行独立的Kubernetes集群管理生产线数据采集和质量检测系统。随着业务扩张,这种分散的管理模式面临诸多挑战:

- 应用分发效率低:新版本的MES系统需要人工在每个基地分别部署,平均需要3天才能完成全量发布。

- 监控数据孤岛:每个基地有独立的监控系统,总部无法实时获取全局生产状态。

- 资源利用率低:各基地资源独立分配,峰值时段资源紧张,而谷值时资源大量闲置。

5.2 技术选型与方案设计

在对比了多个多云管理方案后,A企业最终选择了Kurator,主要基于以下考虑:

- 开放性:Kurator基于开源技术栈,避免了厂商锁定,契合企业的技术战略。

- 完整性:提供了从集群管理、应用分发到监控策略的全栈能力,无需集成多个独立工具。

- 轻量性:控制平面资源占用低,适合私有化部署场景。

方案设计阶段,我们基于Kurator构建了两级管理架构:在总部部署中央控制平面,统一管理所有基地的集群;在每个基地保留本地运维权限,处理基地特定的运维需求。

5.3 实施过程与挑战克服

实施过程中,我们遇到了两个主要技术挑战:

网络延迟问题:A企业基地间的网络延迟高达80ms,导致集群状态同步偶发超时。通过调整Kurator Agent的心跳间隔(从10秒延长至30秒)和启用增量同步模式,将同步成功率从90%提升至99.9%。

存储异构性:各基地使用不同的存储解决方案(Ceph、NFS、本地存储)。我们利用Kurator的存储抽象能力,为不同类型应用设计了多套存储策略模板,应用分发时自动适配目标集群的存储类型。

5.4 成效与价值

平台上线3个月后,A企业实现了显著的业务价值:

- 效率提升:应用发布时间从3天缩短至4小时,大幅加快了业务迭代速度。

- 成本优化:通过资源调度和弹性伸缩,集群平均资源利用率从35%提升至65%,年节省服务器采购成本约200万元。

- 稳定性增强:实现了跨基地的故障自动迁移,在单个基地网络中断时,关键服务自动切换到其他基地,业务中断时间从小时级降至分钟级。

6. 总结与展望

6.1 Kurator 的生态价值

通过深度实践,我认为Kurator的核心价值不仅体现在技术层面,更体现在其生态建设上。作为开放原子基金会首个分布式云原生项目,Kurator推动了国内分布式云原生技术的发展,补充了国内分布式云原生的生态。对于开发者而言,Kurator集成了多种云原生技术,让开发者能够在实际项目中积累经验。

6.2 未来展望与发展建议

基于实践体验,我为Kurator的未来发展提出以下建议:

增强网络治理能力:目前Kurator的网络配置功能还在规划中,未来应加强跨集群服务发现和统一流量治理能力,实现更细粒度的流量控制和安全策略。

扩展大数据和AI场景支持:虽然Kurator可以支持部署和管理任何云原生应用,包括大数据应用和AI应用,但针对这些场景的专用优化还有提升空间,如资源调度策略和性能优化。

完善生态系统集成:可以考虑与更多云原生项目集成,如Dapr用于分布式应用运行时,OpenKruise用于应用部署管理等,进一步丰富技术栈。

随着分布式云成为云计算的未来趋势,Kurator这类开源解决方案的价值将日益凸显。它不仅是技术工具,更是企业实现跨云跨边数字化转型的战略资产。对于考虑采用多云战略的企业,建议尽早了解和评估Kurator,以便在分布式云原生浪潮中占据先机。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)