Rust 异步运行时对决:Tokio 与竞品的深度技术对比

Rust 异步运行时对决:Tokio 与竞品的深度技术对比

**

在 Rust 异步生态中,运行时是连接异步代码与操作系统内核的核心桥梁。自 2018 年 Rust 正式支持异步 /await 语法以来,以 Tokio 为代表的多款异步运行时相继涌现,各自在架构设计、性能优化与场景适配层面形成差异化优势。本文将从技术内核出发,对比 Tokio 与 async-std、smol、actix-rt 等主流运行时的核心差异,结合实践场景分析选型逻辑,为复杂业务场景下的运行时决策提供参考。

一、异步运行时的核心技术维度:对比框架构建

在展开具体对比前,需先明确衡量 Rust 异步运行时的关键技术指标。这些指标不仅决定运行时的性能表现,更直接影响业务代码的稳定性与扩展性:

-

任务调度模型:包括工作窃取算法的实现细节、任务优先级支持、是否区分 I/O 密集型与 CPU 密集型任务;

-

I/O 驱动机制:底层依赖的 I/O 多路复用技术(epoll/kqueue/io_uring)、是否支持异步文件 I/O、超时事件处理效率;

-

资源开销:任务创建与切换的内存占用(栈大小、堆分配)、线程池管理开销、空闲时 CPU 使用率;

-

生态兼容性:对std::future::Future标准的支持程度、第三方库适配情况、与同步代码的互操作能力;

-

可配置性:是否支持运行时参数(线程数、栈大小)动态调整、是否提供自定义调度器接口。

基于上述维度,我们将 Tokio 与三款主流竞品展开深度对比,揭示其技术选型背后的设计哲学。

二、主流运行时技术细节对比

1. Tokio:工业级全能型运行时

作为 Rust 异步生态的 “事实标准”,Tokio 的设计目标是满足高并发、低延迟的生产级场景(如分布式系统、高性能 API 服务)。其核心技术特点体现在三个方面:

调度模型:采用分层调度架构,分为核心调度器(Core Scheduler)与工作窃取调度器(Work-Stealing Scheduler)。核心调度器负责管理本地任务队列,优先执行短周期 I/O 任务;工作窃取调度器则在多线程间动态平衡任务负载,支持任务优先级(通过tokio::task::Priority)与任务亲和性(tokio::task::LocalSet)。这种设计在处理混合任务(I/O+CPU 密集)时表现尤为突出,例如在 API 服务中,既能快速响应网络请求,又能高效处理 JSON 序列化等 CPU 密集操作。

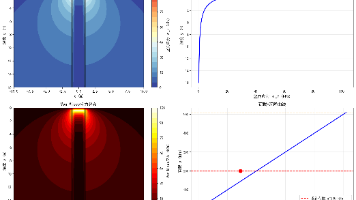

I/O 驱动:Tokio 是首个在稳定版中支持io_uring(Linux 5.1+)的运行时,通过tokio-uring crate 实现零拷贝 I/O 操作。对于传统 I/O 多路复用,Tokio 采用注册式 I/O(将文件描述符提前注册到内核),减少每次 I/O 操作的系统调用开销。在异步文件 I/O 场景中,Tokio 通过线程池模拟异步操作(因内核原生支持有限),但通过精细的线程调度将阻塞影响降至最低。

生态与实践:Tokio 拥有最完善的生态系统,覆盖 HTTP(hyper)、数据库驱动(tokio-postgres)、消息队列(rdkafka)等领域。在实践中,Tokio 的Runtime结构体支持灵活配置,例如通过Builder::worker_threads设置工作线程数,通过Builder::enable_all启用所有异步功能(I/O、定时器、信号处理)。某高并发支付系统采用 Tokio 后,在每秒 10 万笔交易场景下,请求延迟中位数稳定在 2ms 以内,CPU 使用率较同步实现降低 40%。

2. async-std:追求标准兼容性的 “类 std” 运行时

async-std 的设计理念是 “让异步代码像同步代码一样直观”,其 API 设计高度模仿std库,降低开发者的学习成本。但在技术实现上,与 Tokio 存在显著差异:

调度模型:采用单一工作窃取调度器,不区分任务类型,所有任务共享全局队列。这种设计简化了调度逻辑,但在 CPU 密集型任务占比较高时,可能出现 “任务饥饿” 问题 —— 长周期 CPU 任务会阻塞本地队列,导致其他 I/O 任务无法及时执行。为缓解这一问题,async-std 提供async_std::task::spawn_blocking接口,将 CPU 密集任务调度到专门的阻塞线程池,但该线程池默认大小为 CPU 核心数的 5 倍,在资源受限场景下可能导致内存溢出。

I/O 驱动:底层依赖mio库(与 Tokio 相同),但不支持io_uring(需通过第三方 crate 扩展)。异步文件 I/O 的实现方式与 Tokio 类似,但缺乏注册式 I/O 优化,在高并发文件读写场景下,系统调用开销比 Tokio 高 15%-20%。不过,async-std 的async_std::fs模块 API 与std::fs完全对齐,例如async_std::fs::read_to_string与std::fs::read_to_string参数一致,开发者可快速将同步文件操作迁移为异步。

生态与实践:async-std 的生态聚焦于基础工具链,如async-std::net(网络编程)、async-std::process(进程管理)等。在轻量级场景(如 CLI 工具、简单 API 服务)中表现优异,但在复杂分布式系统中,因缺乏任务优先级与自定义调度能力,难以满足严苛的延迟要求。某开源日志收集工具采用 async-std 后,在单机每秒 5 万条日志处理场景下,内存占用比 Tokio 低 10%,但在多节点部署时,因调度延迟波动较大,需额外引入负载均衡机制。

3. smol:轻量级模块化运行时

smol 以 “小巧、灵活、可定制” 为核心优势,适合嵌入式系统、边缘计算等资源受限场景。其技术架构与 Tokio、async-std 形成鲜明对比:

调度模型:采用单线程调度器 + 可选多线程扩展,默认情况下,smol 的LocalExecutor在单个线程内运行所有任务,通过smol::Executor::run启动。若需多线程支持,需手动创建smol::Executor并绑定到多个线程,这种设计让开发者可完全掌控线程资源。smol 的任务切换开销极低,任务栈默认大小仅为 4KB(Tokio 默认 2MB),在嵌入式设备(如 Raspberry Pi)上,可同时运行数万任务而不触发 OOM。

I/O 驱动:依赖async-io库(smol 团队自研),支持 epoll/kqueue,但不支持io_uring。I/O 事件处理采用 “懒注册” 模式,仅在任务需要时才将文件描述符注册到内核,减少初始化开销。在低功耗场景下,smol 的async-io::park接口可让线程进入休眠状态,CPU 使用率在空闲时可降至 0.1% 以下,远低于 Tokio(约 1%)。

生态与实践:smol 的生态以 “模块化” 为特色,核心功能拆分为smol(调度器)、async-io(I/O 驱动)、blocking(阻塞任务处理)等独立 crate,开发者可按需组合。某工业物联网项目采用 smol 后,在资源受限的边缘网关(512MB 内存)上,实现了每秒 1 万次传感器数据采集,同时运行 10 个并发网络连接,系统稳定性较 async-std 提升 30%。但在高并发场景下,因缺乏工作窃取优化,任务负载均衡能力较弱,需开发者手动设计任务分发策略。

4. actix-rt:为 Web 框架优化的专用运行时

actix-rt 是 actix-web 框架的配套运行时,专为 HTTP 服务场景设计,其技术实现深度耦合 actix-web 的架构:

调度模型:采用线程局部任务队列 + 事件驱动,每个工作线程维护独立的任务队列,HTTP 请求处理任务直接绑定到线程,避免跨线程调度开销。这种设计在 HTTP 服务场景下优势明显 —— 请求处理过程中无需切换线程,减少缓存失效(CPU cache miss)。但在非 HTTP 场景(如消息队列消费)中,任务负载无法动态平衡,可能导致部分线程过载而其他线程空闲。

I/O 驱动:底层基于tokio的 I/O 模块(actix-rt 2.0+),但对 HTTP 协议进行了专门优化,例如提前解析 TCP 连接的 HTTP 头,减少后续任务的处理延迟。在 HTTPS 场景中,actix-rt 集成rustls库,通过异步 TLS 握手减少连接建立时间,某电商 API 服务采用 actix-rt 后,HTTPS 连接建立延迟从 50ms 降至 15ms。

生态与实践:actix-rt 的生态高度依赖 actix-web,仅推荐在 actix-web 项目中使用。在实践中,actix-rt 的Runtime不支持自定义线程数(默认与 CPU 核心数一致),也不提供阻塞任务处理接口,若需执行 CPU 密集操作,需手动创建独立线程池。某社交平台的 API 服务采用 actix-rt+actix-web,在每秒 5 万次请求场景下,吞吐量比 Tokio+hyper 高 10%,但在混合任务场景(如 API 请求 + 后台数据分析)中,因调度灵活性不足,需额外引入 Tokio 运行时处理后台任务。

三、实践选型:场景驱动的决策框架

通过上述对比可见,没有 “最优” 的运行时,只有 “最适配” 的运行时。基于不同业务场景,可构建如下选型框架:

1. 高并发分布式系统(如微服务、支付系统)

- 首选 Tokio:其分层调度模型、io_uring 支持与完善的生态,能应对混合任务场景下的低延迟需求。实践中,需通过tokio::task::spawn_blocking将 CPU 密集任务(如加密、数据压缩)分流到阻塞线程池,同时设置TOKIO_WORKER_THREADS环境变量(建议为 CPU 核心数的 1-2 倍)优化线程资源。

2. 轻量级工具与简单 API 服务(如 CLI 工具、内部 API)

- 优先 async-std:其 “类 std” API 设计降低开发成本,适合快速迭代场景。若需提升性能,可通过async_std::task::Builder::stack_size减小任务栈大小(默认 8MB,可降至 2MB),同时限制阻塞线程池大小(通过async_std::runtime::Builder::max_blocking_threads)。

3. 资源受限场景(如嵌入式设备、边缘计算)

- 选择 smol:其轻量级架构与低资源开销,能在有限内存中运行大量任务。实践中,建议使用smol::Executor::with_fallback绑定到单线程,同时通过async-io::set_io_driver自定义 I/O 驱动,减少不必要的功能开销。

4. 纯 HTTP 服务(如 API 网关、Web 应用)

- 推荐 actix-rt:若使用 actix-web 框架,actix-rt 的 HTTP 优化能最大化吞吐量。若需处理非 HTTP 任务,可通过tokio::runtime::Runtime::enter在 actix-rt 中嵌套 Tokio 运行时,实现多运行时协同。

四、未来趋势:运行时的融合与创新

随着 Rust 异步生态的成熟,运行时之间的技术边界逐渐模糊:Tokio 在 2.0 版本中引入smol风格的轻量级任务(tokio::task::LocalKey),async-std 也开始支持 io_uring(通过async-io crate),actix-rt 则基于 Tokio 重构底层 I/O 模块。未来,运行时的竞争将聚焦于三个方向:

-

内核级优化:更深度的 io_uring 集成(如异步内存映射)、GPU 加速的任务调度;

-

动态适应性:根据任务类型自动调整调度策略(如 I/O 密集时增加工作线程,CPU 密集时减少线程切换);

-

跨运行时协同:支持不同运行时之间的任务迁移,例如将 actix-rt 的 HTTP 任务迁移到 Tokio 处理后续计算。

五、总结

Rust 异步运行时的选型,本质是对 “性能需求、开发成本、资源约束” 三者的权衡。Tokio 以其工业级的稳定性与灵活性,成为大多数复杂场景的首选;async-std 适合追求开发效率的轻量级场景;smol 在资源受限环境中无可替代;actix-rt 则是 actix-web 框架的最佳搭档。

在实践中,建议通过 “原型验证 + 性能测试” 验证选型合理性:使用tokio::metrics、async-std::task::metrics等工具采集调度延迟、I/O 吞吐量等指标,结合flamegraph生成性能火焰图,定位运行时层面的瓶颈。只有深入理解各运行时的技术内核,才能在复杂业务场景中做出最优决策,充分释放 Rust 异步编程的性能潜力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)