Rust WebSocket支持的实现:从协议理解到生产级工程实践

Rust WebSocket支持的实现:从协议理解到生产级工程实践

引言

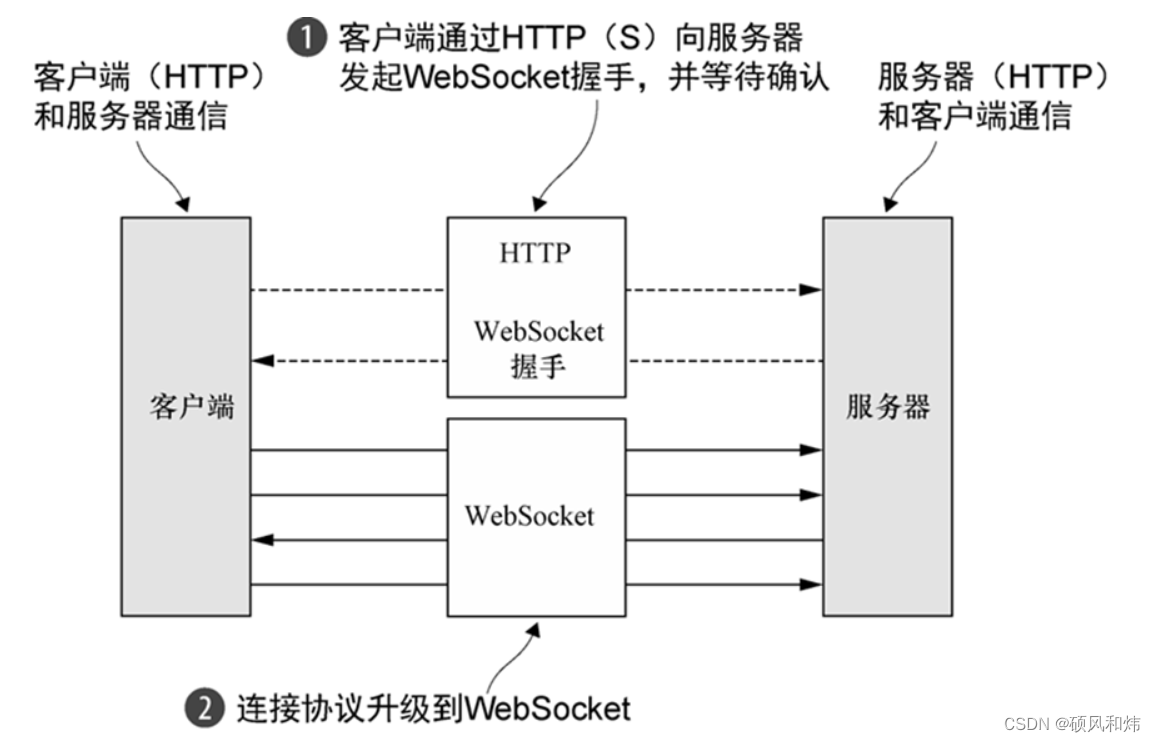

WebSocket作为现代Web应用实时通信的基石,其在Rust生态中的实现充分展现了系统编程语言在高并发场景下的独特优势。与传统的HTTP轮询相比,WebSocket通过单一TCP连接实现全双工通信,极大降低了延迟和服务器负载。本文将深入探讨Rust实现WebSocket服务的技术细节,从协议升级机制到状态管理,从并发模型到错误恢复,展现一个生产级WebSocket服务所需的工程深度。

WebSocket协议升级的底层机制

WebSocket的建立始于HTTP协议升级握手,这是一个精妙的设计:客户端发送带有Upgrade: websocket头的HTTP请求,服务器验证后返回101状态码完成协议切换。在Rust中,这个过程涉及对底层TCP流的精确控制和HTTP协议的深度理解。

Tokio生态的tokio-tungstenite库提供了异步WebSocket实现,但理解其背后的机制至关重要。协议升级不仅仅是响应头的交换,更涉及TCP连接状态的转移:从HTTP的请求-响应模式转变为持久化的双向消息流。这种转变要求服务器在握手完成后立即释放HTTP处理逻辑占用的资源,将连接句柄移交给WebSocket处理器。

在Axum框架中,这一过程通过类型系统优雅地表达。WebSocketUpgrade类型封装了协议升级的意图,而真正的连接建立发生在回调函数中。这种设计避免了竞态条件:握手响应必须完整发送后才能开始WebSocket帧的传输,否则会导致协议混乱。

消息帧的解析与状态机实现

WebSocket协议定义了细致的帧格式:每个消息被切分为一个或多个帧,每帧包含操作码、掩码位、载荷长度等元数据。Rust的类型系统天然适合实现这种结构化的协议解析。通过枚举类型表达不同的帧类型(文本、二进制、关闭、Ping、Pong),编译器确保所有情况都被妥善处理。

use axum::{

extract::ws::{Message, WebSocket, WebSocketUpgrade},

response::Response,

routing::get,

Router,

};

use futures::{sink::SinkExt, stream::StreamExt};

use std::sync::Arc;

use tokio::sync::RwLock;

// 连接状态管理

#[derive(Clone)]

struct ConnectionState {

active_connections: Arc<RwLock<std::collections::HashMap<String, tokio::sync::mpsc::Sender<Message>>>>,

}

async fn websocket_handler(

ws: WebSocketUpgrade,

state: Arc<ConnectionState>,

) -> Response {

ws.on_upgrade(|socket| handle_socket(socket, state))

}

async fn handle_socket(socket: WebSocket, state: Arc<ConnectionState>) {

let (mut sender, mut receiver) = socket.split();

let connection_id = uuid::Uuid::new_v4().to_string();

// 创建消息通道用于跨连接通信

let (tx, mut rx) = tokio::sync::mpsc::channel::<Message>(100);

{

let mut connections = state.active_connections.write().await;

connections.insert(connection_id.clone(), tx);

}

// 发送任务:从通道接收消息并发送给客户端

let send_task = tokio::spawn(async move {

while let Some(msg) = rx.recv().await {

if sender.send(msg).await.is_err() {

break;

}

}

});

// 接收任务:处理客户端消息

let recv_task = tokio::spawn(async move {

while let Some(Ok(msg)) = receiver.next().await {

match msg {

Message::Text(text) => {

// 广播给其他连接

broadcast_message(&state, &connection_id, Message::Text(text)).await;

}

Message::Close(_) => break,

Message::Ping(data) => {

// 自动响应Pong保持连接活跃

// Axum会自动处理,这里仅作示例

}

_ => {}

}

}

// 清理连接

let mut connections = state.active_connections.write().await;

connections.remove(&connection_id);

});

// 等待任一任务完成

tokio::select! {

_ = send_task => {},

_ = recv_task => {},

}

}

async fn broadcast_message(

state: &ConnectionState,

sender_id: &str,

message: Message,

) {

let connections = state.active_connections.read().await;

for (id, tx) in connections.iter() {

if id != sender_id {

let _ = tx.send(message.clone()).await;

}

}

}

这个实现展示了几个关键的工程决策。首先,使用split()方法将WebSocket分离为独立的发送和接收半边,允许并发处理双向通信。这利用了Rust的所有权系统:两个半边拥有不同的能力(一个只能发送,一个只能接收),在类型层面防止了数据竞争。

并发模型与背压处理

WebSocket服务的核心挑战在于管理数以千计的并发连接。Rust的异步运行时Tokio提供了高效的任务调度,但合理的架构设计同样关键。上述代码采用了Actor模式的变体:每个WebSocket连接对应两个异步任务,通过mpsc通道通信。

通道容量的设置(这里是100)体现了对背压的考量。当消息生产速度超过网络发送速度时,通道会填满,send()调用将等待,从而自然地限制了消息产生速率。这种机制避免了内存无限增长,是生产环境中必不可少的保护措施。

更深层次的问题是慢客户端的处理。如果某个客户端网络状况不佳,其接收缓冲区长期满载,不应阻塞其他客户端的消息发送。上述实现中,广播时使用try_send()而非send()会更合适:发送失败时直接丢弃消息或标记该连接为慢客户端,避免影响整体性能。

连接生命周期与优雅关闭

WebSocket连接的生命周期管理比HTTP复杂得多。连接可能因客户端主动关闭、网络故障、服务器重启等多种原因终止,每种情况都需要妥善处理。Rust的Drop trait和异步任务取消机制为此提供了坚实基础。

心跳机制是保持连接健康的标准做法。WebSocket协议定义了Ping/Pong帧用于此目的。在Rust实现中,可以启动一个定时器任务,定期发送Ping帧,若在超时时间内未收到Pong响应,则主动关闭连接。这避免了僵尸连接消耗服务器资源。

use std::time::Duration;

async fn heartbeat_task(

sender: &mut futures::stream::SplitSink<WebSocket, Message>,

) {

let mut interval = tokio::time::interval(Duration::from_secs(30));

loop {

interval.tick().await;

if sender.send(Message::Ping(vec![])).await.is_err() {

break;

}

}

}

优雅关闭在服务器升级场景中尤为重要。收到关闭信号后,服务器应停止接受新连接,但允许现有连接完成当前操作。可以通过tokio::signal监听系统信号,结合tokio::select!实现超时等待:给予连接一定时间自然结束,超时后强制断开。

状态同步与分布式考量

在单机多核环境下,共享状态的管理是WebSocket服务的另一难点。上述代码使用Arc<RwLock<HashMap>>存储活跃连接,这是常见的模式,但存在性能瓶颈。读写锁在高并发场景下会成为争用点,特别是频繁的连接建立和断开。

更优化的方案是使用分片锁(shard lock)或无锁数据结构如DashMap。分片锁将连接集合分割为多个子集,每个子集独立加锁,显著降低争用概率。对于广播场景,可以进一步优化:维护一个只增不减的连接列表,通过原子标记失效连接,定期批量清理,避免频繁的写锁获取。

当系统扩展到多实例部署时,WebSocket连接的亲和性成为问题。不同于无状态的HTTP请求可以任意路由,WebSocket连接必须保持在同一实例上。常见的解决方案包括:使用Redis的pub/sub功能在实例间转发消息,或采用一致性哈希将特定用户的连接固定到特定实例。这些分布式策略需要在代码设计之初就考虑,避免后期重构的高昂成本。

安全性与资源限制

生产级WebSocket服务必须防范恶意客户端的攻击。首先是消息大小限制:应拒绝接收超过阈值的单条消息,防止内存耗尽攻击。其次是连接数限制:单IP的并发连接数应设置上限,防止单一来源占用所有资源。第三是速率限制:检测异常高频的消息发送,可能标志着DDoS攻击。

Rust的类型系统在实现这些限制时提供了天然优势。可以定义一个包装类型LimitedWebSocket,在底层WebSocket之上添加限制逻辑。通过newtype模式,确保业务代码只能访问受限版本,从根源上避免绕过安全检查。

struct RateLimiter {

last_message_time: tokio::time::Instant,

message_count: usize,

window: Duration,

max_messages: usize,

}

impl RateLimiter {

fn check_and_update(&mut self) -> bool {

let now = tokio::time::Instant::now();

if now.duration_since(self.last_message_time) > self.window {

self.message_count = 0;

self.last_message_time = now;

}

self.message_count += 1;

self.message_count <= self.max_messages

}

}

总结与最佳实践

Rust实现WebSocket服务的过程,是语言特性与工程需求完美结合的典范。所有权系统确保了并发安全,异步运行时提供了高效的I/O处理,类型系统帮助我们正确建模复杂的协议状态。关键的工程考量包括:使用通道解耦发送和接收逻辑,实施背压控制防止内存溢出,通过心跳机制维护连接健康,采用分片策略降低锁争用,以及在架构层面为分布式扩展预留空间。掌握这些原则,就能构建出既高性能又可靠的实时通信系统,充分发挥Rust在系统编程领域的潜力。

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)