【YOLOv5 Note-9】YOLOv5模型网络结构中加入MobileViT模块

yolov5

yolov5 - Ultralytics YOLOv8的前身,是一个用于目标检测、图像分割和图像分类任务的先进模型。

项目地址:https://gitcode.com/gh_mirrors/yo/yolov5

·

一、神经网络的前中后期

在神经网络中,特别是在深度卷积神经网络(CNN)中,“网络早期(低层)”、“网络中期(中层)”和“网络后期(高层)”通常指的是网络结构中不同层级的部分,每个部分在特征提取和信息处理方面有其特定的作用和特性。

1. 网络早期(低层)

- 在网络的早期阶段插入

MobileViT可能会对原始图像进行较深层次的处理,有助于捕捉更丰富的空间特征。但同时,Transformer可能无法充分利用其处理高级语义特征的能力。

2. 网络中期(中层)

- 在网络的中间层插入

MobileViT可能是一个平衡点,可以在提取一定级别的特征后利用Transformer的长程依赖捕捉能力。

3. 网络后期(高层)

- 在网络的后期阶段插入

MobileViT会使其处理更抽象的特征,有助于捕捉复杂的上下文信息,但可能会丢失一些细节信息。

二、插入 MobileViT 模块

在YOLOv5配置中插入 MobileViT 模块需要考虑到模块的功能和网络的整体架构。MobileViT 结合了卷积神经网络(CNN)和Transformer的特点,适合于复杂特征的提取和长程依赖的捕捉。基于这些考虑,以下是几个较为合适的的插入位置:

-

主干网络中的中期阶段:

- 例如,在

[-1, 1, Conv, [256, 3, 2]]和[-1, 6, C3, [256]]之间。 - 这里,

MobileViT可以处理相对抽象的特征,并利用其Transformer部分捕捉更复杂的依赖关系。

- 例如,在

-

主干网络后期:

- 在更深的层次,例如在

[-1, 1, Conv, [512, 3, 2]]和[-1, 9, C3, [512]]之间。 - 在这个位置,

MobileViT将处理高级特征,并可能更好地利用Transformer结构处理复杂的场景。

- 在更深的层次,例如在

-

检测头前期:

- 在检测头的初始阶段,例如在

[[17, 20, 23], 1, Detect, [nc, anchors]]之前。 - 这可以使

MobileViT直接对用于检测的特征进行最后的优化。

- 在检测头的初始阶段,例如在

三、各类型YOLOv5模型的前中后期划分

以yolov5l.yaml为例

网络前期(低层)

- 定位:主干网络(backbone)的开始部分。

- 包含的层:

[-1, 1, Conv, [64, 6, 2, 2]]# 0-P1/2[-1, 1, Conv, [128, 3, 2]]# 1-P2/4

- 作用:这些层主要负责捕获基础视觉特征,如边缘、纹理等。特征相对简单,更多关注细节。

网络中期(中层)

- 定位:主干网络中的中间部分。

- 包含的层:

[-1, 3, C3, [128]][-1, 1, Conv, [256, 3, 2]]# 3-P3/8[-1, 6, C3, [256]]

- 作用:这些层处理更复杂的特征,例如特定的形状和模式。开始从细节特征过渡到更抽象的特征表示。

网络后期(高层)

- 定位:主干网络的末尾以及检测头(head)。

- 包含的层:

[-1, 1, Conv, [512, 3, 2]]# 5-P4/16[-1, 9, C3, [512]][-1, 1, Conv, [1024, 3, 2]]# 7-P5/32[-1, 3, C3, [1024]][-1, 1, SPPF, [1024, 5]]# 9- 检测头(head)中的所有层

- 作用:这些层负责处理高级别的特征,通常与目标检测任务直接相关。在这里,特征更加抽象,与目标的类别、位置等信息密切相关。

代码实现 MobileViT 模块插入:

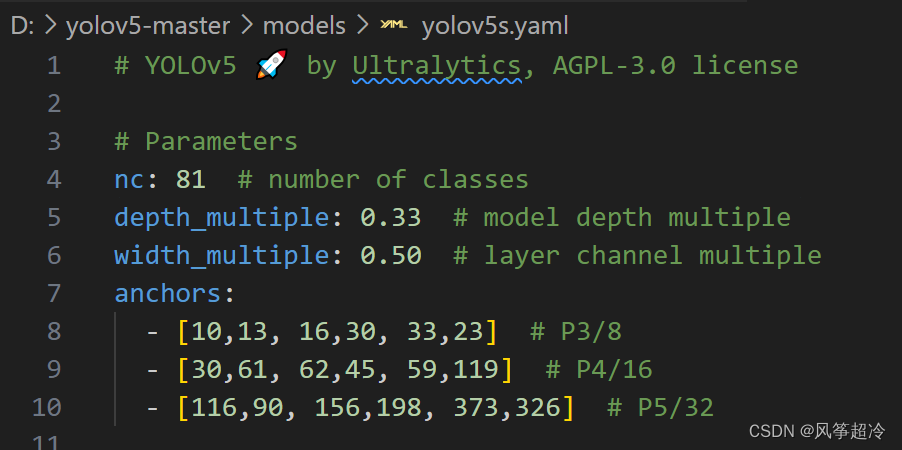

# YOLOv5 🚀 by Ultralytics, AGPL-3.0 license

# Parameters

nc: 80 # number of classes

depth_multiple: 1.0 # model depth multiple

width_multiple: 1.0 # layer channel multiple

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# YOLOv5 v6.0 backbone

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [64, 6, 2, 2]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, C3, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 6, MobileViT, [256]],

[-1, 6, C3, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 6, MobileViT, [256]],

[-1, 9, C3, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 3, C3, [1024]],

[-1, 1, SPPF, [1024, 5]], # 9

]

# YOLOv5 v6.0 head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 17 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 20 (P4/16-medium)

[-1, 3, MobileViT, [512, False]],

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 23 (P5/32-large)

[[17, 20, 23], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

yolov5 - Ultralytics YOLOv8的前身,是一个用于目标检测、图像分割和图像分类任务的先进模型。

最近提交(Master分支:1 个月前 )

a3555241

Signed-off-by: Glenn Jocher <glenn.jocher@ultralytics.com> 2 天前

6629839d

Refactor code for speed and clarity 8 天前

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)