【Stable Diffusion】ComfyUI自助搭建工作流-文生图

哈喽大家好,前几期分享了一些常用的插件,非常适合抄作业用,但想动手搭建自己的工作流,就要搞懂各个节点是做什么的,这样才能灵活的掌握和使用ComfyUI

开始基础工作流拆解之前,先介绍下SD基础的转化流程

【输入】—(转换)—【潜在空间】—(转换)—【输出】

无论是文生图还是图生图,提示词/图片作为输入基础信息传递给AI,AI并不认识这些,这里需要转化成计算机认识的内容到潜在空间中

所有的运算和生成过程也都是在潜在空间,当完成图片后,需要再从潜在空间次转化出来,转化成我们看得懂的像素图像

从零搭建文生图

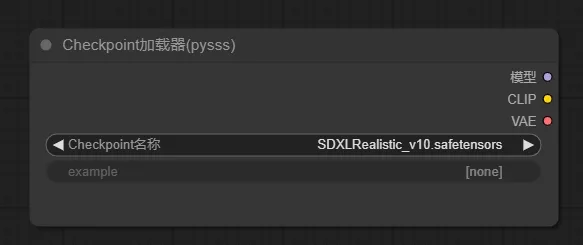

1、加载器

首先添加大模型的加载器,通过加载器这一个节点来延伸出整个工作流的节点

2、正反向提示词节点

可以看到这里有三个延伸点,首先是CLIP文本编码器,将节点延伸就可以看到常用的基本节点,也可以【搜索】插件节点,延伸出的CLIP节点会自动连上(再连接一个负向提示词文本编码器)

这里对应的是文本部分的【输入】—(转换)—【潜在空间】

3、模型

同样的,从模型节点拖出一个K采样器,可以看到,K采样器上正负提示词与CLIP文本节点上的颜色是相同的,将相对应的节点相连即可

模型的【输入】—(转换)—【潜在空间】

4、Latent

可以看到,这时采样器左边缺少一个Latent节点,延伸出来是个空Latent,这个空Latent就是分辨率的输入

(分辨率的【输入】—(转换)—【潜在空间】)

右边的Laten延伸出来,就是VAE的解码,就是从潜在空间的内容通过VAE的解码转化成像素

(这里不要忘记VAE和大模型的VAE相连,或者单独连接一个VAE加载器,VAE解码没有对应大模型是无法完成的)

【潜在空间】—(转换)—【输出】

5、保存图像

从VAE延伸出保存图像节点,这样文生图的基本工作流就搭建完成了

正因为每个节点所连接的节点不是唯一的,这使得ComfyUI的自由度比WebUI高得多,在理解

【输入】—(转换)—【潜在空间】—(转换)—【输出】

这个基本逻辑下,知道每个节点可以链接什么,对发散自定义工作流就非常有帮助了

资源分享

为了帮助大家更好地掌握 ComfyUI,我在去年花了几个月的时间,撰写并录制了一套ComfyUI的基础教程,共六篇。这套教程详细介绍了选择ComfyUI的理由、其优缺点、下载安装方法、模型与插件的安装、工作流节点和底层逻辑详解、遮罩修改重绘/Inpenting模块以及SDXL工作流手把手搭建。

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

一、ComfyUI配置指南

- 报错指南

- 环境配置

- 脚本更新

- 后记

- …

二、ComfyUI基础入门

- 软件安装篇

- 插件安装篇

- …

三、 ComfyUI工作流节点/底层逻辑详解

- ComfyUI 基础概念理解

- Stable diffusion 工作原理

- 工作流底层逻辑

- 必备插件补全

- …

四、ComfyUI节点技巧进阶/多模型串联

- 节点进阶详解

- 提词技巧精通

- 多模型节点串联

- …

五、ComfyUI遮罩修改重绘/Inpenting模块详解

- 图像分辨率

- 姿势

- …

六、ComfyUI超实用SDXL工作流手把手搭建

- Refined模型

- SDXL风格化提示词

- SDXL工作流搭建

- …

由于篇幅原因,本文精选几个章节,详细版点击下方卡片免费领取

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)