本地电脑使用ollama部署大模型并安装Chatbox

某些场景下可能希望构建一个完全本地离线可用的大模型,方法很多,模型也很多,比如 qwen、qwen2、llama3等,最简单快捷的首推使用 ollama 部署,模型选用 qwen 或 qwen2,针对中文任务效果更好。

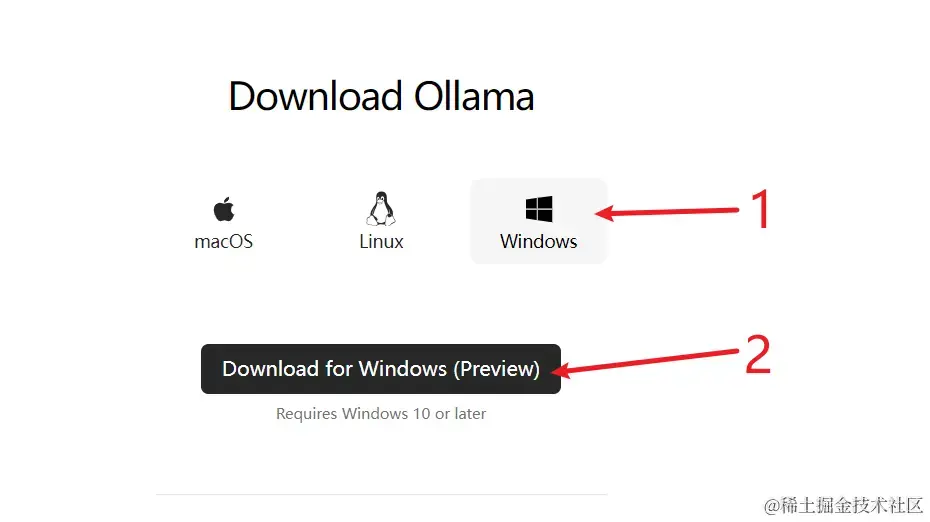

首先下载 ollama 双击安装(277MB)

ollama下载地址: www.ollama.com/download

下载后双击安装

安装完毕后打开命令行黑窗口

开始菜单中找到命令提示符,点击打开

或者随便打开任意一个文件夹,然后在文件夹地址栏中输入 cmd 按回车。

都能打开一个黑窗口

找到想要使用的模型,推荐 qwen系列

打开这个网址 www.ollama.com/library 可以选择要使用的模型

比如使用 qwen,点击进入后,会看到如下

点击下拉框,可选择模型版本列表,4b 代表该模型有40亿参数,当然参数越大效果越好,但同样也要求你的电脑配置越高,不够高的话不仅运行慢,还可能卡死机。

如果你有英伟达显卡,并且独立显存不低于12G,可以选择 14b / 32b 版本,否则建议选择 7b

选择后,右侧会显示对应的下载命令,点击复制图标复制该命令,以7b为例命令是 ollama run qwen:7b

复制后回到黑窗口,点击鼠标右键粘贴该命令,然后回车,就开始了下载,耐心等待下载完毕。

直接在黑窗口交互方式使用

上面下载完毕后,就可以直接在黑窗口中使用了,试试先询问它是谁吧

关闭了黑窗口,如何在次使用呢

还记得怎么打开cmd吗,用同样方法去打开它,然后同样去粘贴命令。7b的命令是ollama run qwen:7b

就自动打开了。

还想使用其他模型怎么办

同样方法,去 www.ollama.com/library 这个地址找到想用的模型,点击进入,选择模型版本,复制右侧命令,到 cmd黑窗口中粘贴回车。

cmd黑窗口太难用了,有没有ui界面

搭配 ollama 最好用的ui界面首推ollama官方的 docs.openwebui.com

如果你懂 docker部署或略懂代码,可参考手动安装。

如果你只想下载一个exe鼠标点点就能使用,可下载 chatbox,双击安装,同安装其他软件一样方法

第一次运行点击设置

然后点击“显示”,再从下拉框里选择 “ollama”

然后在模型下拉框里选择你要使用的模型,所有通过 ollama run 命令安装的模型都会在此显示,选择好后点击保存

接着就可以发问了。更多使用方法可在左侧探索哦

如果想更改模型怎么办呢?看到左下角的“设置”了吗,点它就行了

pyVideoTrans视频翻译配音软件中能接入吗

当然可以,打开视频翻译软件-左上角设置菜单-本地兼容openai大模型–填写地址“http://127.0.0.1:11434/v1”

就可以了。主界面翻译渠道选择“LocalLLM”,完毕

一、大模型全套的学习路线

学习大型人工智能模型,如GPT-3、BERT或任何其他先进的神经网络模型,需要系统的方法和持续的努力。既然要系统的学习大模型,那么学习路线是必不可少的,下面的这份路线能帮助你快速梳理知识,形成自己的体系。

L1级别:AI大模型时代的华丽登场

L2级别:AI大模型API应用开发工程

L3级别:大模型应用架构进阶实践

L4级别:大模型微调与私有化部署

一般掌握到第四个级别,市场上大多数岗位都是可以胜任,但要还不是天花板,天花板级别要求更加严格,对于算法和实战是非常苛刻的。建议普通人掌握到L4级别即可。

以上的AI大模型学习路线,不知道为什么发出来就有点糊,高清版可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

本文转自 https://blog.csdn.net/2401_82469710/article/details/140554083?spm=1001.2014.3001.5501,如有侵权,请联系删除。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)