一文讲透Python线程池ThreadPoolExecutor!

01、初识

Pythonthreading

这就是线程池的思想(当然没这么简单),但是自己编写线程池很难写的比较完美,还需要考虑复杂情况下的线程同步,很容易发生死锁。从Python3.2concurrent.futuresThreadPoolExecutorProcessPoolExecutorthreadingmultiprocessing进一步抽象(这里主要关注线程池),不仅可以帮我们自动调度线程,还可以做到:

-

主线程可以获取某一个线程(或者任务的)的状态,以及返回值。

-

当一个线程完成的时候,主线程能够立即知道。

-

让多线程和多进程的编码接口一致。

02、实例

简单使用

from concurrent.futures import ThreadPoolExecutor

import time

# 参数times用来模拟网络请求的时间

def get_html(times):

time.sleep(times)

print("get page {}s finished".format(times))

return times

executor = ThreadPoolExecutor(max_workers=2)

# 通过submit函数提交执行的函数到线程池中,submit函数立即返回,不阻塞

task1 = executor.submit(get_html, (3))

task2 = executor.submit(get_html, (2))

# done方法用于判定某个任务是否完成

print(task1.done())

# cancel方法用于取消某个任务,该任务没有放入线程池中才能取消成功

print(task2.cancel())time.sleep(4)print(task1.done())

# result方法可以获取task的执行结果

print(task1.result())

# 执行结果# False

# 表明task1未执行完成# False

# 表明task2取消失败,因为已经放入了线程池中

# get page 2s finished# get page 3s finished# True

# 由于在get page 3s finished之后才打印,所以此时task1必然完成了

# 3

# 得到task1的任务返回值-

ThreadPoolExecutormax_workers -

使用

submitsubmit() -

通过

submitdone()task1task1task1 -

使用

cancel()task1,task2 -

使用

result()方法可以获取任务的返回值。查看内部代码,发现这个方法是阻塞的。

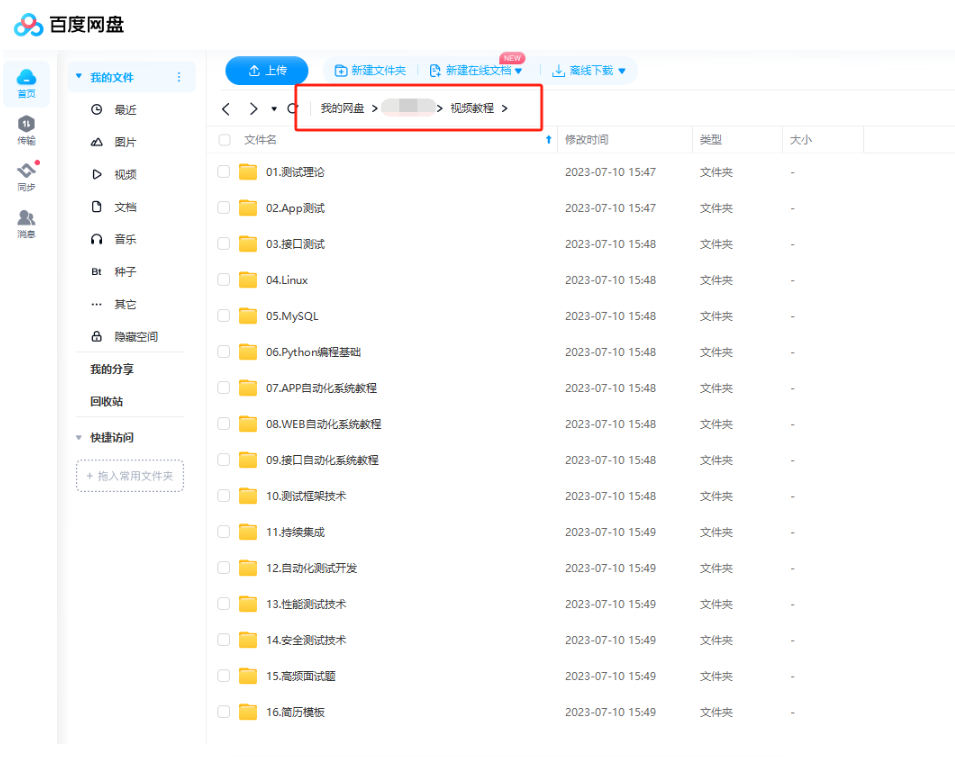

现在我也找了很多测试的朋友,做了一个分享技术的交流群,共享了很多我们收集的技术文档和视频教程。

如果你不想再体验自学时找不到资源,没人解答问题,坚持几天便放弃的感受

可以加入我们一起交流。而且还有很多在自动化,性能,安全,测试开发等等方面有一定建树的技术大牛

分享他们的经验,还会分享很多直播讲座和技术沙龙

可以免费学习!划重点!开源的!!!

qq群号:1150305204【暗号:csdn999】

as_completed

上面虽然提供了判断任务是否结束的方法,但是不能在主线程中一直判断啊。有时候我们是得知某个任务结束了,就去获取结果,而不是一直判断每个任务有没有结束。这是就可以使用as_completed

from concurrent.futures import ThreadPoolExecutor, as_completed

import time

# 参数times用来模拟网络请求的时间

def get_html(times):

time.sleep(times)

print("get page {}s finished".format(times))

return times

executor = ThreadPoolExecutor(max_workers=2)

urls = [3, 2, 4] # 并不是真的url

all_task = [executor.submit(get_html, (url)) for url in urls]

for future in as_completed(all_task):

data = future.result()

print("in main: get page {}s success".format(data))#

执行结果

# get page 2s finished

# in main: get page 2s success

# get page 3s finished

# in main: get page 3s success

# get page 4s finished

# in main: get page 4s successas_completed()yield

map

除了上面的as_completedexecutor.map

from concurrent.futures import ThreadPoolExecutor

import time

# 参数times用来模拟网络请求的时间def get_html(times):

time.sleep(times)

print("get page {}s finished".format(times))

return times

executor = ThreadPoolExecutor(max_workers=2)

urls = [3, 2, 4] # 并不是真的url

for data in executor.map(get_html, urls):

print("in main: get page {}s success".format(data))

# 执行结果

# get page 2s finished

# get page 3s finished

# in main: get page 3s success

# in main: get page 2s success

# get page 4s finished

# in main: get page 4s success使用mapsubmitmappythonmapurlsget_html函数,并分配各线程池。可以看到执行结果与上面的as_completedurls

wait

wait

from concurrent.futures import ThreadPoolExecutor, wait, ALL_COMPLETED, FIRST_COMPLETEDimport time

# 参数times用来模拟网络请求的时间

def get_html(times):

time.sleep(times)

print("get page {}s finished".format(times))

return times

executor = ThreadPoolExecutor(max_workers=2)

urls = [3, 2, 4] # 并不是真的url

all_task = [executor.submit(get_html, (url)) for url in urls]

wait(all_task, return_when=ALL_COMPLETED)print("main")

# 执行结果

# get page 2s finished

# get page 3s finished

# get page 4s finished

# mainwaitreturn_whenALL_COMPLETEDmainFIRST_COMPLETED

03、源码分析

cocurrent.future模块中的futuresubmit()futureThreadPoolExecutor

下面简单介绍ThreadPoolExecutor

1.init方法

init

2.submit方法

submit_base.Future()和_WorkItem()_WorkItem()future象进行设置,最后会将future

3.adjust_thread_count方法

这个方法的含义很好理解,主要是创建指定的线程数。但是实现上有点难以理解,比如线程执行函数中的weakref.ref,涉及到了弱引用等概念,留待以后理解。

4._WorkItem对象

_WorkItemself.future.set_result(result)

5.线程执行函数--_worker

这是线程池创建线程时指定的函数入口,主要是从队列中依次取出task执行,但是函数的第一个参数还不是很明白。留待以后。

04、总结

-

future的设计理念很棒,在线程池/进程池和携程中都存在future对象,是异步编程的核心。

-

ThreadPoolExecutor 让线程的使用更加方便,减小了线程创建/销毁的资源损耗,无需考虑线程间的复杂同步,方便主线程与子线程的交互。

-

线程池的抽象程度很高,多线程和多进程的编码接口一致。

未完成

-

对future模块的理解。

-

weakref.ref是什么?

-

线程执行函数入口_worker的第一个参数的意思。

学习上

作为一个软件测试的过来人,我想尽自己最大的努力,帮助每一个伙伴都能顺利找到工作。所以我整理了下面这份资源,现在免费分享给大家,有需要的小伙伴可以关注【公众号:开心螺蛳粉】自提!

软件测试面试文档

我们学习必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有字节大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

行动吧,在路上总比一直观望的要好,未来的你肯定会感谢现在拼搏的自己!如果想学习提升找不到资料,没人答疑解惑时,请及时加入群:1150305204,里面有各种测试开发资料和技术可以一起交流哦。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)