上海人工智能实验室的书生·浦语大模型学习笔记--day 1

书生·浦语是上海人工智能实验室和商汤科技联合研发的一款大模型,这次有机会参与试用,特记录每日学习情况。

今天学习了书生·浦语的全链路开源体系,它包括了数据、预训练、微调、部署、评测和应用这六个方面。

一、数据

书生·浦语大模型的数据集名为"书生·万卷",发布日期 2023 年 8 月 14 日。它是一个包含1.6万亿token的多语种高质量数据集,涵盖多种模态和任务。包含文本数据(50 亿个文档,数据量超 1TB),图像-文本数据集(超 2200 万个文件,数据量超 140GB),视频数据(超 1000 个文件,数据量超 900GB)。这个数据集为模型的训练提供了丰富的语言信息和知识基础。

二、预训练

书生·浦语大模型使用了InternLM-Train进行预训练。InternLM-Train是一个基于Transformer架构的预训练模型,它具有1040亿参数,通过在书生·万卷数据集上进行训练,使模型具备了强大的语言理解和生成能力。它支持从 8 卡到千卡训练,千卡训练效率达 92%;无缝接入 HuggingFace 等技术生态,支持各类轻量化技术。

三、微调

为了进一步提升模型的性能和适应特定任务,上海人工智能实验室开发了XTuner微调框架。XTuner可以根据不同的任务需求,对大模型进行微调,使其在特定领域或任务上表现更加优秀。它具有以下特点:

- 支持多种任务类型,如增量预训练,指令微调,工具类指令微调

- 支持全量参数、LoRA、QLoRA 等低成本微调,覆盖各类 SFT 场景

- 支持多种大语言模型的微调,如 InternLM, Llama, QWen, BaiChuan, ChatGLM,适配多种开源生态,支持加载 HuggingFace、ModelScope 模型或数据集

- 支持自动优化加速,如 Flash Attention, DeepSpeed ZeRO, Pytorch FSDP,使得开发者无需关注复杂的现存优化与计算加速细节

- 支持多种硬件,覆盖 NVIDIA 20 系以上所有显卡,最低只需 8GB 现存即可微调 7B 模型

- 支持多种数据格式,如 Alpaca, MOSS, OpenAI, Guanacao 等等。

四、部署

为了方便模型的使用和应用,上海人工智能实验室开发了LMDeploy部署框架。LMDeploy提供大模型在 GPU 上部署的全流程解决方案,包括模型轻量化、推理和服务。可以将大模型快速部署到各种计算平台上,实现模型的实时推理和应用。它具有以下特点:

- 接口支持:Python, gRPC, RESTful

- 量化支持:4bit 、8bit

- 推理引擎:turbomind, pytorch

- 服务:openai-server, gradio, triton inference server

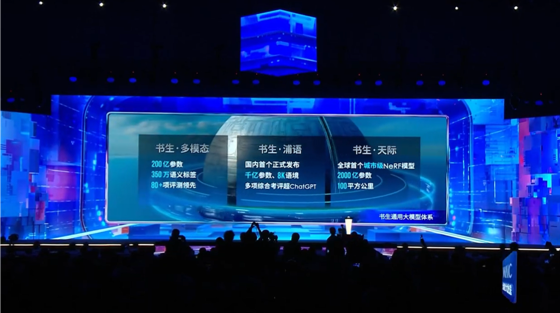

书生·浦语大模型包含三大类:

五、评测

上海人工智能实验室开发了OpenCompass评测框架,它包含80 套评测集,40 万道题目。OpenCompass可以对模型在多个任务和数据集上的表现进行全面评估,从而了解模型的优势和局限性。它具体包括6 大维度的评测集:

- 学科:初中考试、中国高考、大学考试、语言能力考试、职业资格考试

- 语言:字词释义、成语习语、语义相似、指代消解、翻译

- 知识:知识问答、多语种知识问答

- 理解:阅读理解、内容分析、内容总结

- 推理:因果推理、常识推理、代码推理、数学推理

- 安全:偏见、有害性、公平性、隐私性、真实性、合法性

六、应用

上海人工智能实验室还开发了Lagent多模态智能体工具箱和AgentLego多模态智能体工具箱。这些工具箱可以帮助开发者构建和训练多模态智能体,实现图文混合创作、多模态对话等应用场景。

Lagent 是一种轻量级智能体框架,它具有以下特点:

- 支持多种类型的智能体能力,如 ReAct, ReWoo, AutoGPT

- 灵活支持多种大语言模型,如 OpenAI 的 GPT-3.5/4, 上海人工智能实验室的 InternLM, Hugging Face 的 Transformers, meta 的 Llama

- 简单易拓展,支持丰富的工具,如 AI 工具(文生图、文生语音、图片描述),能力拓展(搜索,计算器,代码解释器), Rapid API(出行 API, 财经 API, 体育咨询 API)

AgentLego是一种多模态智能体工具箱,它具有以下特色:

- 丰富的工具集合,尤其是提供了大量视觉、多模态相关领域的前沿算法功能

- 支持多个主流智能体系统,如 Lagent, LangChain, Transformers Agent 等

- 灵活的多模态工具调用接口,可以轻松支持各类输入输出格式的工具函数

- 一键式远程工具部署,轻松使用和调试大模型智能体

七、大模型

书生·浦语大模型有三个规格:

- 轻量级:InternLM-7B,社区低成本可用最佳模型规模

- 中量级:InternLM-20B,商业场景可开发定制高精度较小模型规模

- 重量级:InternLM-123B,通用大语言模型能力全面覆盖千亿模型规模

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)