大模型训练所需的硬件配置

·

1. 引入

训练一个大模型,到底需要投入多少块GPU,需要多少数据,训练多长时间能达到一个不错的效果?

本文引用靠谱的数据,来回答这些问题。

2. 全流程训练

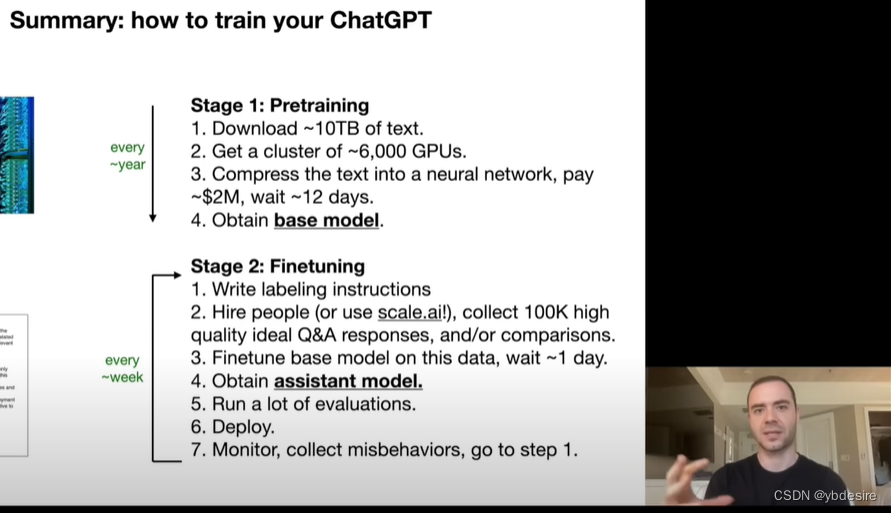

大模型的训练,简单来说,分为Pretraining和Finetuning(微调),Pretraining需要非常多的数据和算力,Finetuning相对来说对算力的要求比较低。

3. OpenAI的训练

根据参考1,OpenAI的科学家Andrej Karpathy讲解(他们训练ChatGPT的配置),在Pretraining的步骤,需要10TB的数据,6000个GPU,训练12天。

4. LLaMA-7B

参考2中给了一个结论:

- Keep in mind that the original LLaMA training for the 7B model required 83k A100 80GB hours, so you’ll need access to a cluster.

所以,LLaMA在训练7B的模型时,需要83K的A100(80GB显存)。也就是说,如果你有83块A100(80G),需要训练1000小时(42天),才能训练一个7B的模型。

5. qwen不同大小模型的训练、推理配置

(1)qwen微调配置:https://github.com/QwenLM/Qwen?tab=readme-ov-file#profiling-of-memory-and-speed

(2)qwen推理配置:https://github.com/QwenLM/Qwen?tab=readme-ov-file#inference-performance

参考

- https://www.youtube.com/watch?v=zjkBMFhNj_g (19分钟开始)

- https://github.com/Lightning-AI/lit-llama/blob/main/howto/train_redpajama.md

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)