极大似然估计(Maximum-Likelihood)的理解

极大似然估计 是建立在 极大似然原理 的基础上的一个统计方法,是概率论在统计学中的应用。

目录

1、极大似然原理

极大似然原理:在随机试验中,许多事件都有可能发生,概率大的事件发生的概率也大。若只进行一次试验,事件 A 发生了,则我们有理由认为 A 比其他事件发生的概率都大。

例如,一个箱子里有红黑两种颜色的球,数量为10个和1个,但并不知道到底哪种颜色的球为10个那种颜色的球为1个,这时我们随机从箱子里拿出一个球,如果这个球是红色的,那我们就认为盒子里红球有10个,黑球有1个。

2、极大似然估计

极大似然估计(ML)就是利用已知的样本结果(如上例中摸出来的球是红色的),反推最有可能(最大概率)导致这样结果的参数值(如上例中得出10红1黑的结论)。这也是统计学中用样本估计整体的一种阐述。

ML 提供了一种给定观察数据来评估模型参数的方法,即:“模型已定,参数未知”。通过若干次试验,观察其结果,利用试验结果得到某个参数值能够使样本出现的概率为最大,则称为极大似然估计。

如何理解“模型已定,参数未知”呢?这里的模型可以是一个参数未定的公式,也可以认为是一个机器学习模型。

如指数分布公式

分布函数模型已知,参数 λ 即是所求参数,给定一组随机变量集 D,求最合适的一个参数

使得在该参数下 D 发生的概率最高。

再例如,我们有一个模型,模型中的未知参数为 ![]() ,取值范围为

,取值范围为 ![]() 。还有一组含有 N 个样本的数据集 D:

。还有一组含有 N 个样本的数据集 D:

![]()

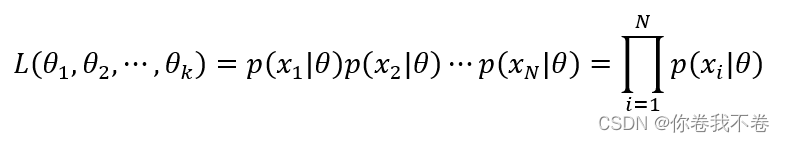

我们要求得一组模型的参数 ![]() ,使得数据集D出现的概率最大。定义似然函数(数据集D发生的概率)如下:

,使得数据集D出现的概率最大。定义似然函数(数据集D发生的概率)如下:

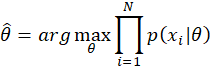

求解该似然函数就是求一组参数 ![]() 使得

使得 ![]() 达到最大值,此时

达到最大值,此时 ![]() 就是

就是 ![]() 的最大似然估计量。

的最大似然估计量。

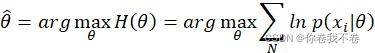

求解最大值,哪一定会涉及到函数求导,但是看 L 的公式就知道直接对求导过程大可能很麻烦且结果阶数较高,而考虑到函数 ln(L) 与 L 具有相同的趋势与最大值点,因此实际应用中为了便于分析,一般都会使用 对数似然函数 H=ln(L) 来求解 ![]() 。

。

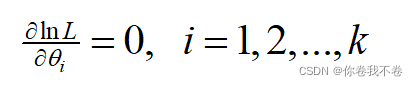

然后令其 偏导数 等于 0:

方程的解只是一个估计值,只有在样本数趋于无限多的时候,它才会接近于真实值。

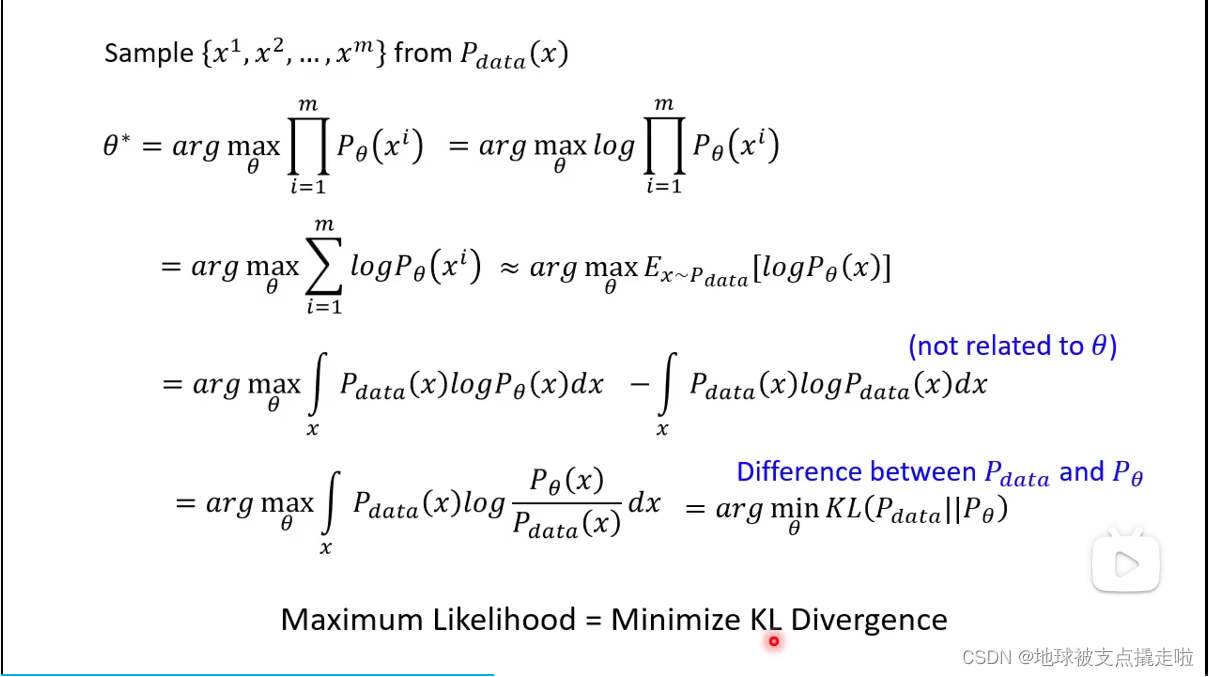

PS:补一个李宏毅老师在讲解 diffusion module 时候的一个推导,即:

maximum likelihood = minimize KL divergence(KL散度)

参考:

吴传生:《经济数学-概率论与数理统计》

AtomGit 是由开放原子开源基金会联合 CSDN 等生态伙伴共同推出的新一代开源与人工智能协作平台。平台坚持“开放、中立、公益”的理念,把代码托管、模型共享、数据集托管、智能体开发体验和算力服务整合在一起,为开发者提供从开发、训练到部署的一站式体验。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)