无监督领域自适应(Unsupervised Domain Adaptation)介绍

无监督领域自适应(Domain Adaptation)介绍背景相关概念相关工作总结参考背景为了解决传统监督学习需要大量人工标注的问题。顾名思义,就是将某个领域或者任务学习好的知识或模式,应用到到新的不同但相关?的领域中,达到可观的效果。比如我们最常见的fine-tuning。根据目前已有的研究显示,1)深度神经网络可以很好地学习到数据间的可迁移特征,或者叫做域不变(domain in...

背景

-

为了解决传统监督学习需要大量人工标注的问题。顾名思义,就是将某个领域或者任务学习好的知识或模式,应用到到新的不同但相关?的领域中,达到可观的效果。比如我们最常见的fine-tuning。

-

根据目前已有的研究显示,1)深度神经网络可以很好地学习到数据间的可迁移特征,或者叫做域不变(domain invariant)特征; 2)但由于层数的增加,特征由general到task-specific,越来越不适合迁移,但同时也要保证特征足够。

-

领域自适应(Domain Adaptation):迁移学习的一种。域适应是一种针对解决源域集和目标域分布偏移(domain shift)?的机器学习算法。各式各样的域适应方法旨在通过学习源域和目标域的域不变(domain invariant)特征,从而在目标域没有或少量标签的情况下,将从源域学到的分类器应用于目标域。

-

域适应方法:

- find a mapping from representations of the source domain to those of the target;

- find domain-invariant representations that are shared between the two domains;

相关概念

- 领域差异(Domain Discrepancy)

- 域定义:由d维特征空间X和边缘概率分布P(X)组成,即D={X, P(x)}, x∈X,领域差异就是说Ps != Pt;

- 不同域中pixel distributions可以各种各样。我们定义Low-level分布的不同表现在噪声、分辨率、光和颜色等,High-level分布的不同表现在类别数量、目标类型和几何形变等;

- 不同但相关:源域和目标域的分布在Low-level不同但在High-level相同;

- 域不变特征:用作High-level segment alignment。将源域和目标域特征分为domain invariant和domain specify。domain invariant为两个域共有特征,而domain specify为私有。

相关工作

- 常用深度域适应网络结构(以GRL[5]为例)

- 特征提取器:feature extraction & domain confusion

- 分类器:object classification

- 域差异度量器:domain discrepancy measure

- 常用深度域适应loss function

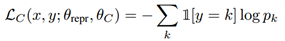

- 目标分类: CrossEntropy Loss

- 域适应(distribution discrepancy measure)

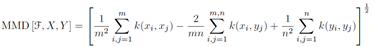

- MMD:Maximum Mean Discrepancy

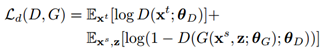

- DAA:Domain Adversarial Adaptation

- MMD:Maximum Mean Discrepancy

- 目标分类: CrossEntropy Loss

- 常用深度域适应方法

- 领域分布差异度量常用的方法有MMD和Jensen–Shannon距离。通过拉近分布差异,来学习到域不变特征(domain invariant);

- MMD-based:1)将特征映射到一个有意义的空间;2)在该空间中拉近分布距离;

- DAA-based:1)domain classification;2)domain confusion。

- MMD-based(以RTN为例)

- 将特征映射到一个有意义空间

- 在该空间中拉近分布距离,使抽取到域不变(domain invariant)特征

- DAA-based(以ADDA[6]为例)

- domain discrimination:区分源域和目标域

- domain confusion:confuse源域和目标域,使抽取到域不变(domain invariant)特征

总结

这个是我2017年年尾总结的一份PPT,举的例子都是2017年前的方法,相对陈旧,但是概念性的东西依然可以参考。

UDA的发展先是用MMD提取域不变特征,之后是神经网络和MMD结合,之后神经网络和对抗学习结合,总而言之都是在拉近两个域的距离。现在18和19年为了更细致的拉近,用伪标签或者条件GAN按类别拉近已经成为了主流。

参考

【1】M. Long, H. Zhu, J. Wang, and M. I. Jordan. Unsupervised domain adaptation with residual transfer networks. In

NeurIPS, pages 136–144, 2016.

【2】M. Long, J. Wang, and M. I. Jordan. Deep transfer learning with joint adaptation networks. ICML, pages 2208–2217, 2017.

【3】S. J. Pan, I. W. Tsang, J. T. Kwok, and Q. Yang. Domain adaptation via transfer component analysis. IEEE Transactions on Neural Networks, 22(2):199–210, 2011.

【4】Z. Pei, Z. Cao, M. Long, and J. Wang. Multi-adversarial domain adaptation. In AAAI, 2018.

【5】 Y. Ganin, E. Ustinova, H. Ajakan, P. Germain, H. Larochelle, F. Laviolette, M. Marchand, and V. Lempitsky. Domainadversarial training of neural networks. JMLR, 17(1):2096–2030, 2016.

【6】E. Tzeng, J. Hoffman, K. Saenko, and T. Darrell. Adversarial discriminative domain adaptation. In CVPR, pages 7167–

7176, 2017

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)