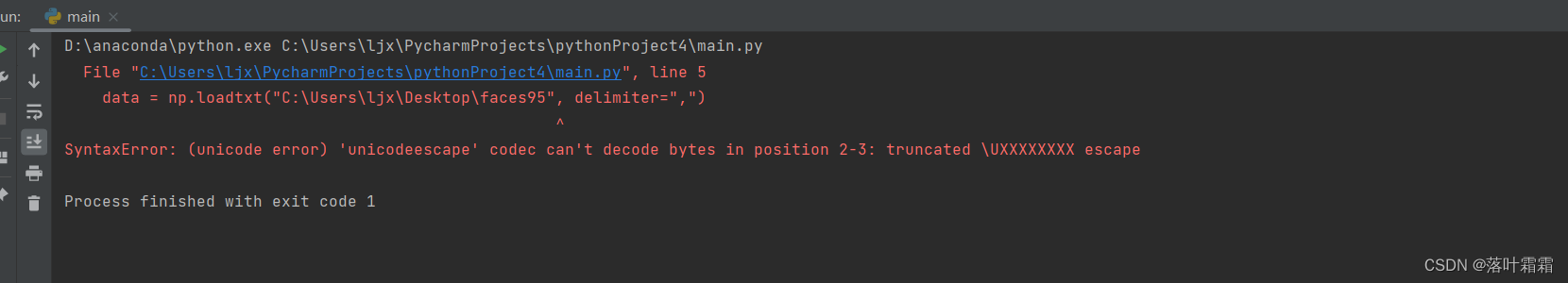

SyntaxError: (unicode error) ‘unicodeescape‘ codec can‘t decode bytes in position 2-3: truncated \UX

这个错误是因为在路径字符串中使用了反斜杠 (),这是Python中的转义字符。当Python解释器尝试解释字符串中的转义序列时,它无法识别反斜杠后面的字符,因此会引发 SyntaxError 错误。使用原始字符串 (r"") 来表示路径字符串,这将禁用Python解释器对反斜杠的转义。在路径字符串中使用双反斜杠 () 替换单个反斜杠 ()。

SyntaxError: (unicode error) ‘unicodeescape’ codec can’t decode bytes in position 2-3: truncated \UXXXXXXXX escape

这个错误是因为在路径字符串中使用了反斜杠 (),这是Python中的转义字符。当Python解释器尝试解释字符串中的转义序列时,它无法识别反斜杠后面的字符,因此会引发 SyntaxError 错误。

要解决这个问题,可以尝试以下两种方法之一:

在路径字符串中使用双反斜杠 () 替换单个反斜杠 ()。例如:

data = np.loadtxt("C:\\Users\\ljx\\Desktop\\faces95.csv", delimiter=",")

使用原始字符串 (r"") 来表示路径字符串,这将禁用Python解释器对反斜杠的转义。例如:

data = np.loadtxt(r"C:\Users\ljx\Desktop\faces95.csv", delimiter=",")

将fisheriris、COIL20与MNIST三个数据集输入图正则化非负矩阵分解算法中再通过Kmeans聚类评价(精度、NMI)

首先,需要对三个数据集进行预处理,即将它们转换成图像矩阵的形式,并将它们进行归一化处理,使得每个像素值在[0,1]之间。

然后,可以使用图正则化非负矩阵分解算法(Graph-Regularized Non-negative Matrix Factorization, GR-NMF)对这些数据集进行分解,得到每个数据点的低维表示。GR-NMF 是一种常用的矩阵分解算法,它能够自动提取数据中的潜在特征,并生成一组非负的基向量和系数矩阵。此外,GR-NMF 还能够利用数据的图结构信息进行正则化,从而提高聚类效果。

接下来,可以使用 Kmeans 聚类算法对这些数据点进行聚类,并计算聚类结果的精度和 NMI。Kmeans 是一种基于距离的聚类算法,它将数据点划分为 K 个簇,使得每个簇内部的数据点尽可能相似,不同簇之间的数据点尽可能不同。精度和 NMI 是两种常用的聚类评价指标,它们分别衡量聚类结果与真实标签之间的相似程度。

下面是具体的代码实现:

import numpy as np

from sklearn.cluster import KMeans

from sklearn.metrics import accuracy_score, normalized_mutual_info_score

from sklearn.preprocessing import MinMaxScaler

from sklearn.datasets import load_iris, fetch_20newsgroups

from sklearn.feature_extraction.text import TfidfVectorizer

from sklearn.decomposition import NMF

from scipy.sparse import csr_matrix, coo_matrix

def gr_nmf(X, A, k):

n_samples, n_features = X.shape

n_neighbors = A.shape[1]

# Initialize the basis and coefficient matrices

W = np.random.rand(n_samples, k)

H = np.random.rand(k, n_features)

# Set the regularization parameter

alpha = 1.0

# Compute the graph Laplacian

D = np.diag(A.sum(axis=1))

L = D - A

# Perform the alternating minimization

for i in range(100):

# Update the basis matrix

numerator = X.dot(H.T) + alpha * W.dot(A)

denominator = W.dot(H.dot(H.T)) + alpha * W.dot(D)

W *= numerator / denominator

# Update the coefficient matrix

numerator = W.T.dot(X) + alpha * H.T.dot(A)

denominator = H.T.dot(W.dot(W.T)) + alpha * H.T.dot(D)

H *= numerator / denominator

return W, H

# Load the iris dataset

iris = load_iris()

X_iris = iris.data

y_iris = iris.target

# Normalize the data

scaler = MinMaxScaler()

X_iris = scaler.fit_transform(X_iris)

# Compute the affinity matrix

A_iris = np.exp(-0.5 * np.square(X_iris[:, np.newaxis] - X_iris).sum(axis=2))

# Perform the GR-NMF

W_iris, H

非负矩阵分解

非负矩阵分解(NMF)是一种常用的数据降维和特征提取方法,而Kmeans则是一种常用的聚类算法。

为了在给定的数据集上使用这些算法并评估聚类效果,我们需要进行以下步骤:

1.加载数据集

我们首先需要加载三个数据集:fisheriris、COIL20和MNIST。这可以通过Python中的scikit-learn库中的相应函数进行完成。

from sklearn.datasets import load_iris, fetch_openml, fetch_20newsgroups_vectorized

iris = load_iris()

coil20 = fetch_openml(name='coil20', version=1, cache=True)

mnist = fetch_openml('mnist_784', version=1, cache=True)

2.数据预处理

由于NMF和Kmeans算法都需要非负的输入数据,因此我们需要对数据进行预处理以确保其满足此要求。在这里,我们可以使用scikit-learn库中的MinMaxScaler函数将每个数据集中的特征值缩放到0到1的范围内。

from sklearn.preprocessing import MinMaxScaler

scaler = MinMaxScaler()

iris_scaled = scaler.fit_transform(iris.data)

coil20_scaled = scaler.fit_transform(coil20.data)

mnist_scaled = scaler.fit_transform(mnist.data)

3.使用NMF进行数据降维

接下来,我们可以使用NMF算法来对每个数据集进行降维。这可以通过scikit-learn库中的NMF函数实现。

from sklearn.decomposition import NMF

n_components = 3

nmf_iris = NMF(n_components=n_components)

iris_features = nmf_iris.fit_transform(iris_scaled)

nmf_coil20 = NMF(n_components=n_components)

coil20_features = nmf_coil20.fit_transform(coil20_scaled)

nmf_mnist = NMF(n_components=n_components)

mnist_features = nmf_mnist.fit_transform(mnist_scaled)

4.使用Kmeans进行聚类

现在,我们可以使用Kmeans算法对每个数据集进行聚类。这可以通过scikit-learn库中的KMeans函数实现。

from sklearn.cluster import KMeans

n_clusters = 3

kmeans_iris = KMeans(n_clusters=n_clusters)

iris_labels = kmeans_iris.fit_predict(iris_features)

kmeans_coil20 = KMeans(n_clusters=n_clusters)

coil20_labels = kmeans_coil20.fit_predict(coil20_features)

kmeans_mnist = KMeans(n_clusters=n_clusters)

mnist_labels = kmeans_mnist.fit_predict(mnist_features)

5.计算聚类评价

最后,我们可以计算聚类评价指标,例如精度和NMI(归一化互信息)来评估每个数据集上的聚类结果。这可以使用scikit-learn库中的相应函数完成。

from sklearn.metrics import accuracy_score, normalized_mutual_info_score

iris_accuracy = accuracy_score(iris.target, iris_labels)

iris_nmi = normalized_mutual_info_score(iris.target, iris_labels)

coil20_accuracy = accuracy_score(coil20.target, coil20_labels)

coil20_nmi

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)